Redis持久化深度解析:RDB與AOF的終極對決與實戰優化

引言:一次生產事故引發的思考

凌晨3點,我被一通緊急電話驚醒。線上Redis集群崩潰,6GB的緩存數據全部丟失,導致MySQL瞬間承壓暴增,整個交易系統陷入癱瘓。事后復盤發現,問題的根源竟是一個被忽視的持久化配置細節。

這次事故讓我深刻意識到:Redis持久化不僅僅是簡單的數據備份,更是保障系統高可用的關鍵防線。今天,我將結合5年的運維實戰經驗,深度剖析Redis的RDB與AOF兩大持久化機制,幫你避開那些"血淚坑"。

一、為什么Redis持久化如此重要?

1.1 Redis的"阿喀琉斯之踵"

Redis以其極致的性能著稱,但內存存儲的特性也帶來了致命弱點:

?斷電即失:服務器宕機、進程崩潰都會導致數據永久丟失

?成本壓力:純內存方案成本高昂,1TB內存服務器月租可達數萬元

?合規要求:金融、電商等行業對數據持久性有嚴格的監管要求

1.2 持久化帶來的價值

通過合理的持久化策略,我們可以:

? 實現秒級RTO(恢復時間目標),將故障恢復時間從小時級降至分鐘級

? 支持跨機房容災,構建異地多活架構

? 滿足數據審計需求,實現關鍵操作的追溯回放

二、RDB:簡單粗暴的快照機制

2.1 RDB的工作原理

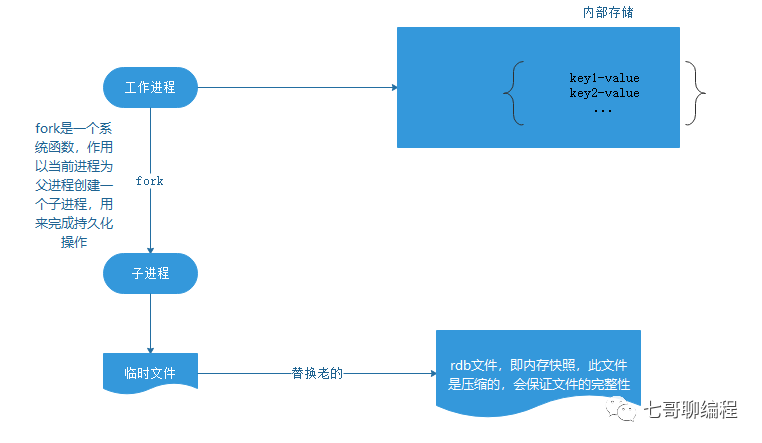

RDB(Redis Database)采用定期快照的方式,將某一時刻的內存數據完整地持久化到磁盤。想象一下,這就像給Redis的內存狀態拍了一張"全家福"。

# redis.conf 中的 RDB 配置示例 save 900 1 # 900秒內至少1個key變化則觸發 save 300 10 # 300秒內至少10個key變化則觸發 save 60 10000 # 60秒內至少10000個key變化則觸發 dbfilename dump.rdb # RDB文件名 dir/var/lib/redis # RDB文件存儲路徑 rdbcompressionyes # 開啟壓縮(LZF算法) rdbchecksumyes # 開啟CRC64校驗 stop-writes-on-bgsave-erroryes# 后臺保存出錯時停止寫入

2.2 觸發機制詳解

RDB持久化有多種觸發方式,每種都有其適用場景:

# Python示例:監控RDB觸發情況 importredis importtime r = redis.Redis(host='localhost', port=6379) # 手動觸發 BGSAVE defmanual_backup(): result = r.bgsave() print(f"后臺保存已觸發:{result}") # 監控保存進度 whileTrue: info = r.info('persistence') ifinfo['rdb_bgsave_in_progress'] ==0: print(f"RDB保存完成,耗時:{info['rdb_last_bgsave_time_sec']}秒") break time.sleep(1) print(f"保存中...當前進度:{info['rdb_current_bgsave_time_sec']}秒") # 獲取RDB統計信息 defget_rdb_stats(): info = r.info('persistence') stats = { '最后保存時間': time.strftime('%Y-%m-%d %H:%M:%S', time.localtime(info['rdb_last_save_time'])), '最后保存狀態':'ok'ifinfo['rdb_last_bgsave_status'] =='ok'else'failed', '當前保存進行中': info['rdb_bgsave_in_progress'] ==1, 'fork耗時(ms)': info['latest_fork_usec'] /1000 } returnstats

2.3 RDB的優勢與劣勢

優勢:

?恢復速度快:加載RDB文件比重放AOF日志快10倍以上

?存儲效率高:二進制格式+壓縮,文件體積小

?性能影響小:fork子進程異步執行,主進程無阻塞

劣勢:

?數據丟失風險:最多丟失一個快照周期的數據

?fork開銷大:大內存實例fork可能導致毫秒級阻塞

2.4 實戰優化技巧

# 1. 避免頻繁全量備份導致的IO壓力 # 錯誤示例:生產環境不要這樣配置! save 10 1 # 每10秒只要有1個key變化就備份 # 2. 合理設置備份策略 # 推薦配置:根據業務特點調整 save 3600 1 # 1小時內至少1次變更 save 300 100 # 5分鐘內至少100次變更 save 60 10000 # 1分鐘內至少10000次變更 # 3. 利用主從復制減少主庫壓力 # 在從庫上執行RDB備份 redis-cli -h slave_host CONFIG SET save"900 1"

三、AOF:精確到每一條命令的日志

3.1 AOF的核心機制

AOF(Append Only File)通過記錄每一條寫命令來實現持久化,類似MySQL的binlog。這種方式可以最大程度地減少數據丟失。

# AOF 核心配置 appendonlyyes # 開啟AOF appendfilename"appendonly.aof" # AOF文件名 appendfsync everysec # 每秒同步一次(推薦) # appendfsync always # 每次寫入都同步(最安全但最慢) # appendfsync no # 由操作系統決定(最快但最不安全) no-appendfsync-on-rewrite no # 重寫時是否暫停同步 auto-aof-rewrite-percentage 100 # 文件增長100%時觸發重寫 auto-aof-rewrite-min-size 64mb # AOF文件最小重寫大小

3.2 AOF重寫機制深度剖析

AOF文件會不斷增長,重寫機制通過生成等效的最小命令集來壓縮文件:

# 模擬AOF重寫過程 classAOFRewriter: def__init__(self): self.commands = [] self.data = {} defrecord_command(self, cmd): """記錄原始命令""" self.commands.append(cmd) # 模擬執行命令 ifcmd.startswith("SET"): parts = cmd.split() self.data[parts[1]] = parts[2] elifcmd.startswith("INCR"): key = cmd.split()[1] self.data[key] =str(int(self.data.get(key,0)) +1) defrewrite(self): """生成優化后的命令集""" optimized = [] forkey, valueinself.data.items(): optimized.append(f"SET{key}{value}") returnoptimized # 示例:優化前后對比 rewriter = AOFRewriter() original_commands = [ "SET counter 0", "INCR counter", "INCR counter", "INCR counter", "SET name redis", "SET name Redis6.0" ] forcmdinoriginal_commands: rewriter.record_command(cmd) print(f"原始命令數:{len(original_commands)}") print(f"優化后命令數:{len(rewriter.rewrite())}") print(f"壓縮率:{(1-len(rewriter.rewrite())/len(original_commands))*100:.1f}%")

3.3 AOF的三種同步策略對比

#!/bin/bash

# 性能測試腳本:對比不同fsync策略

echo"測試環境準備..."

redis-cli FLUSHDB > /dev/null

strategies=("always""everysec""no")

forstrategyin"${strategies[@]}";do

echo"測試 appendfsync =$strategy"

redis-cli CONFIG SET appendfsync$strategy> /dev/null

# 使用redis-benchmark測試

result=$(redis-benchmark -tset-n 100000 -q)

echo"$result"| grep"SET"

# 檢查實際持久化情況

sync_count=$(grep -c"sync"/var/log/redis/redis.log |tail-1)

echo"同步次數:$sync_count"

echo"---"

done

3.4 AOF優化實踐

-- Lua腳本:批量操作優化AOF記錄

-- 將多個命令合并為一個原子操作,減少AOF條目

localprefix = KEYS[1]

localcount =tonumber(ARGV[1])

localvalue = ARGV[2]

localresults = {}

fori =1, countdo

localkey = prefix ..':'.. i

redis.call('SET', key, value)

table.insert(results, key)

end

returnresults

四、RDB vs AOF:如何選擇?

4.1 核心指標對比

| 指標 | RDB | AOF |

| 數據安全性 | 較低(可能丟失分鐘級數據) | 高(最多丟失1秒數據) |

| 恢復速度 | 快(直接加載二進制) | 慢(需要重放所有命令) |

| 文件體積 | 小(壓縮后的二進制) | 大(文本格式命令日志) |

| 性能影響 | 周期性fork開銷 | 持續的磁盤IO |

| 適用場景 | 數據分析、緩存 | 消息隊列、計數器 |

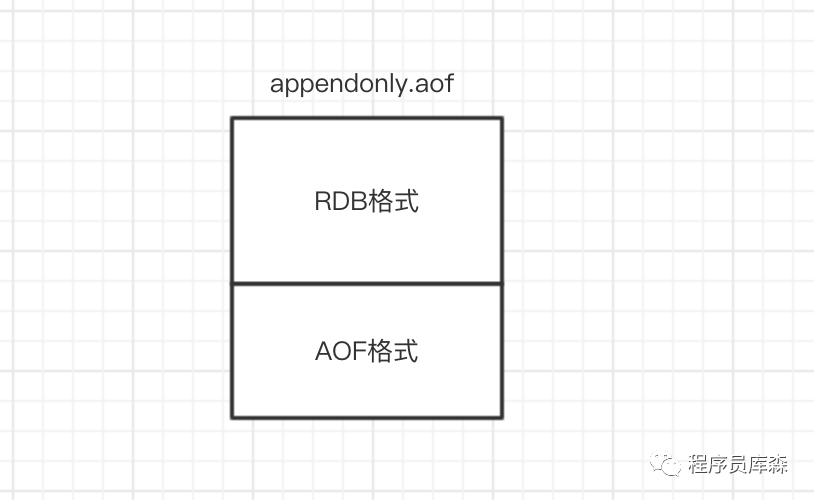

4.2 混合持久化:魚和熊掌兼得

Redis 4.0引入的混合持久化結合了兩者優勢:

# 開啟混合持久化 aof-use-rdb-preambleyes # 工作原理: # 1. AOF重寫時,先生成RDB格式的基礎數據 # 2. 后續增量命令以AOF格式追加 # 3. 恢復時先加載RDB部分,再重放AOF增量

4.3 實戰選型決策樹

defchoose_persistence_strategy(requirements):

"""根據業務需求推薦持久化策略"""

ifrequirements['data_loss_tolerance'] <=?1: ?# 秒級

? ? ? ??if?requirements['recovery_time'] <=?60: ? ?# 1分鐘內恢復

? ? ? ? ? ??return"混合持久化 (RDB+AOF)"

? ? ? ??else:

? ? ? ? ? ??return"AOF everysec"

? ??

? ??elif?requirements['data_loss_tolerance'] <=?300: ?# 5分鐘

? ? ? ??if?requirements['memory_size'] >=32: # GB

return"RDB + 從庫AOF"

else:

return"RDB (save 300 10)"

else: # 可容忍較大數據丟失

return"RDB (save 3600 1)"

# 示例:電商訂單緩存

order_cache_req = {

'data_loss_tolerance':60, # 可容忍60秒數據丟失

'recovery_time':30, # 要求30秒內恢復

'memory_size':16 # 16GB內存

}

print(f"推薦方案:{choose_persistence_strategy(order_cache_req)}")

五、生產環境最佳實踐

5.1 監控告警體系

# 持久化監控指標采集

importredis

importtime

fromdatetimeimportdatetime

classPersistenceMonitor:

def__init__(self, redis_client):

self.redis = redis_client

self.alert_thresholds = {

'rdb_last_save_delay':3600, # RDB超過1小時未保存

'aof_rewrite_delay':7200, # AOF超過2小時未重寫

'aof_size_mb':1024, # AOF文件超過1GB

'fork_time_ms':1000 # fork時間超過1秒

}

defcheck_health(self):

"""健康檢查并返回告警"""

alerts = []

info =self.redis.info('persistence')

# 檢查RDB狀態

last_save_delay = time.time() - info['rdb_last_save_time']

iflast_save_delay >self.alert_thresholds['rdb_last_save_delay']:

alerts.append({

'level':'WARNING',

'message':f'RDB已{last_save_delay/3600:.1f}小時未保存'

})

# 檢查AOF大小

ifinfo.get('aof_enabled'):

aof_size_mb = info['aof_current_size'] /1024/1024

ifaof_size_mb >self.alert_thresholds['aof_size_mb']:

alerts.append({

'level':'WARNING',

'message':f'AOF文件過大:{aof_size_mb:.1f}MB'

})

returnalerts

# 使用示例

monitor = PersistenceMonitor(redis.Redis())

alerts = monitor.check_health()

foralertinalerts:

print(f"[{alert['level']}]{alert['message']}")

5.2 備份恢復演練

#!/bin/bash # 自動化備份恢復測試腳本 REDIS_HOST="localhost" REDIS_PORT="6379" BACKUP_DIR="/data/redis-backup" TEST_KEY="backup$(date +%s)" # 1. 寫入測試數據 echo"寫入測試數據..." redis-cli SET$TEST_KEY"test_value"EX 3600 # 2. 執行備份 echo"執行BGSAVE..." redis-cli BGSAVE sleep5 # 3. 備份文件 cp/var/lib/redis/dump.rdb$BACKUP_DIR/dump_$(date+%Y%m%d_%H%M%S).rdb # 4. 模擬數據丟失 redis-cli DEL$TEST_KEY # 5. 恢復數據 echo"停止Redis..." systemctl stop redis echo"恢復備份..." cp$BACKUP_DIR/dump_*.rdb /var/lib/redis/dump.rdb echo"啟動Redis..." systemctl start redis # 6. 驗證恢復 ifredis-cli GET$TEST_KEY| grep -q"test_value";then echo"? 備份恢復成功" else echo"? 備份恢復失敗" exit1 fi

5.3 容量規劃與優化

# 持久化容量評估工具

classPersistenceCapacityPlanner:

def__init__(self, daily_writes, avg_key_size, avg_value_size):

self.daily_writes = daily_writes

self.avg_key_size = avg_key_size

self.avg_value_size = avg_value_size

defestimate_aof_growth(self, days=30):

"""估算AOF文件增長"""

# 每條命令約占用: SET key value

cmd_size =6+self.avg_key_size +self.avg_value_size

daily_growth_mb = (self.daily_writes * cmd_size) /1024/1024

# 考慮重寫壓縮率約60%

after_rewrite = daily_growth_mb *0.4

return{

'daily_growth_mb': daily_growth_mb,

'monthly_size_mb': after_rewrite * days,

'recommended_rewrite_size_mb': daily_growth_mb *2

}

defestimate_rdb_size(self, total_keys):

"""估算RDB文件大小"""

# RDB壓縮率通常在30-50%

raw_size = total_keys * (self.avg_key_size +self.avg_value_size)

compressed_size_mb = (raw_size *0.4) /1024/1024

return{

'estimated_size_mb': compressed_size_mb,

'backup_time_estimate_sec': compressed_size_mb /100# 假設100MB/s

}

# 使用示例

planner = PersistenceCapacityPlanner(

daily_writes=10_000_000, # 日寫入1000萬次

avg_key_size=20,

avg_value_size=100

)

aof_estimate = planner.estimate_aof_growth()

print(f"AOF日增長:{aof_estimate['daily_growth_mb']:.1f}MB")

print(f"建議重寫閾值:{aof_estimate['recommended_rewrite_size_mb']:.1f}MB")

六、踩坑經驗與故障案例

6.1 案例一:fork阻塞導致的雪崩

問題描述:32GB內存的Redis實例,執行BGSAVE時主線程阻塞3秒,導致大量請求超時。

根因分析:

? Linux的fork采用COW(寫時復制)機制

? 需要復制頁表,32GB約需要64MB頁表

? 在內存壓力大時,分配頁表內存耗時增加

解決方案:

# 1. 開啟大頁內存,減少頁表項 echonever > /sys/kernel/mm/transparent_hugepage/enabled # 2. 調整內核參數 sysctl -w vm.overcommit_memory=1 # 3. 錯峰執行持久化 redis-cli CONFIG SET save""# 禁用自動RDB # 通過crontab在業務低峰期手動觸發 0 3 * * * redis-cli BGSAVE

6.2 案例二:AOF重寫死循環

問題描述:AOF文件達到5GB后觸發重寫,但重寫期間新增數據量大于重寫壓縮量,導致重寫永遠無法完成。

解決方案:

-- 限流腳本:重寫期間降低寫入速度

localcurrent = redis.call('INFO','persistence')

ifstring.match(current,'aof_rewrite_in_progress:1')then

-- AOF重寫中,限制寫入

localkey = KEYS[1]

locallimit =tonumber(ARGV[1])

localcurrent_qps = redis.call('INCR','qps_counter')

ifcurrent_qps > limitthen

return{err ='系統繁忙,請稍后重試'}

end

end

-- 正常執行業務邏輯

returnredis.call('SET', KEYS[1], ARGV[2])

6.3 案例三:混合持久化的版本兼容問題

問題描述:從Redis 5.0降級到4.0時,無法識別混合格式的AOF文件。

預防措施:

# 版本兼容性檢查工具

importstruct

defcheck_aof_format(filepath):

"""檢查AOF文件格式"""

withopen(filepath,'rb')asf:

header = f.read(9)

ifheader.startswith(b'REDIS'):

# RDB格式頭部

version = struct.unpack('bbbbbbbb', header[5:])

returnf"混合格式 (RDB v{version})"

elifheader.startswith(b'*'):

# 純AOF格式

return"純AOF格式"

else:

return"未知格式"

# 遷移前檢查

aof_format = check_aof_format('/var/lib/redis/appendonly.aof')

print(f"當前AOF格式:{aof_format}")

if"混合"inaof_format:

print("警告: 目標版本可能不支持混合格式,建議先執行BGREWRITEAOF")

七、性能調優實戰

7.1 基準測試與調優

#!/bin/bash # 持久化性能基準測試 echo"=== 持久化性能基準測試 ===" # 測試1: 無持久化 redis-cli CONFIG SET save"" redis-cli CONFIG SET appendonly no echo"場景1: 無持久化" redis-benchmark -tset,get -n 1000000 -q # 測試2: 僅RDB redis-cli CONFIG SET save"60 1000" redis-cli CONFIG SET appendonly no echo"場景2: 僅RDB" redis-benchmark -tset,get -n 1000000 -q # 測試3: 僅AOF (everysec) redis-cli CONFIG SET save"" redis-cli CONFIG SET appendonlyyes redis-cli CONFIG SET appendfsync everysec echo"場景3: AOF everysec" redis-benchmark -tset,get -n 1000000 -q # 測試4: RDB+AOF redis-cli CONFIG SET save"60 1000" redis-cli CONFIG SET appendonlyyes echo"場景4: RDB+AOF" redis-benchmark -tset,get -n 1000000 -q

7.2 持久化與內存優化

# 內存碎片與持久化關系分析

defanalyze_memory_fragmentation(redis_client):

"""分析內存碎片對持久化的影響"""

info = redis_client.info('memory')

fragmentation_ratio = info['mem_fragmentation_ratio']

used_memory_gb = info['used_memory'] /1024/1024/1024

recommendations = []

iffragmentation_ratio >1.5:

recommendations.append({

'issue':'內存碎片率過高',

'impact':f'RDB文件可能增大{(fragmentation_ratio-1)*100:.1f}%',

'solution':'考慮執行內存整理: MEMORY PURGE'

})

ifused_memory_gb >16andfragmentation_ratio >1.2:

fork_time_estimate = used_memory_gb *100# ms

recommendations.append({

'issue':'大內存+高碎片',

'impact':f'fork預計阻塞{fork_time_estimate:.0f}ms',

'solution':'建議使用主從架構,在從節點執行持久化'

})

returnrecommendations

八、未來展望與新特性

8.1 Redis 7.0的持久化改進

Redis 7.0帶來了多項持久化優化:

1.增量RDB快照:只保存變更的數據頁,大幅減少IO

2.AOF時間戳記錄:支持按時間點恢復(PITR)

3.多線程持久化:利用多核CPU加速RDB生成

8.2 云原生時代的持久化策略

在Kubernetes環境下,持久化策略需要重新思考:

# Redis StatefulSet with 持久化配置 apiVersion:apps/v1 kind:StatefulSet metadata: name:redis-cluster spec: volumeClaimTemplates: -metadata: name:redis-data spec: accessModes:["ReadWriteOnce"] storageClassName:"fast-ssd" resources: requests: storage:100Gi template: spec: containers: -name:redis image:redis:7.0 volumeMounts: -name:redis-data mountPath:/data command: -redis-server ---save9001 ---appendonlyyes ---appendfsynceverysec

結語:持久化的平衡藝術

Redis持久化不是非黑即白的選擇題,而是需要根據業務特點精心權衡的平衡藝術。記住這幾個核心原則:

1.沒有銀彈:RDB快但可能丟數據,AOF安全但恢復慢

2.監控先行:建立完善的監控體系,及時發現問題

3.演練常態化:定期進行故障演練,驗證恢復流程

4.與時俱進:關注Redis新版本特性,適時升級優化

最后,回到文章開頭的生產事故,我們最終采用了混合持久化+主從架構的方案,將RTO從4小時縮短到5分鐘,RPO從6小時縮短到1秒。技術選型沒有對錯,只有適合與否。

-

內存

+關注

關注

9文章

3219瀏覽量

76432 -

集群

+關注

關注

0文章

149瀏覽量

17677 -

Redis

+關注

關注

0文章

392瀏覽量

12228

原文標題:Redis持久化深度解析:RDB與AOF的終極對決與實戰優化

文章出處:【微信號:magedu-Linux,微信公眾號:馬哥Linux運維】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

深度剖析Redis的兩大持久化機制

深度剖析Redis的兩大持久化機制

評論