Redis緩存穿透、雪崩、擊穿三大難題的解決方案與實(shí)戰(zhàn)

作為一名資深運(yùn)維工程師,我在生產(chǎn)環(huán)境中處理過無數(shù)次Redis相關(guān)的故障。今天分享三個讓無數(shù)運(yùn)維人員半夜被叫醒的經(jīng)典問題及其完整解決方案。

前言:那些讓人崩潰的凌晨電話

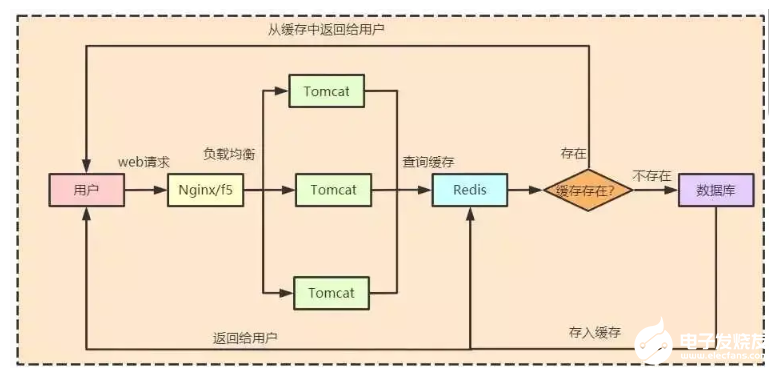

凌晨3點(diǎn),手機(jī)鈴聲急促響起:"系統(tǒng)掛了!用戶無法登錄!數(shù)據(jù)庫CPU飆到100%!"這樣的場景,相信每個運(yùn)維工程師都不陌生。而在我7年的運(yùn)維生涯中,80%的此類故障都與Redis緩存的三大經(jīng)典問題有關(guān):緩存穿透、緩存雪崩、緩存擊穿。

一、緩存穿透:惡意攻擊的噩夢

問題現(xiàn)象

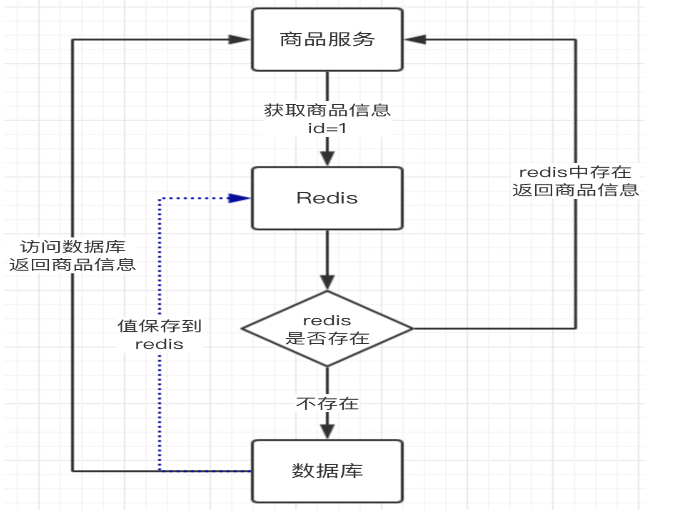

用戶瘋狂查詢數(shù)據(jù)庫中不存在的數(shù)據(jù),每次查詢都繞過緩存直接打到數(shù)據(jù)庫,導(dǎo)致數(shù)據(jù)庫壓力驟增。

真實(shí)案例回顧

某電商平臺遭遇惡意攻擊,攻擊者使用隨機(jī)生成的商品ID瘋狂查詢商品信息。由于這些ID在數(shù)據(jù)庫中根本不存在,Redis緩存無法命中,每次請求都直接打到MySQL,導(dǎo)致數(shù)據(jù)庫連接池瞬間耗盡。

監(jiān)控?cái)?shù)據(jù)觸目驚心:

? 數(shù)據(jù)庫QPS:從平時的500/s飆升到8000/s

? 緩存命中率:從95%跌至10%

? 系統(tǒng)響應(yīng)時間:從50ms激增到5000ms

解決方案詳解

方案一:布隆過濾器(推薦指數(shù))

布隆過濾器是解決緩存穿透最優(yōu)雅的方案,其核心思想是"寧可錯殺,不可放過"。

實(shí)現(xiàn)步驟:

importredis importmmh3 frombitarrayimportbitarray classBloomFilter: def__init__(self, capacity=1000000, error_rate=0.001): """ 初始化布隆過濾器 capacity: 預(yù)計(jì)數(shù)據(jù)量 error_rate: 誤判率 """ self.capacity = capacity self.error_rate = error_rate self.bit_num =self._get_bit_num() self.hash_num =self._get_hash_num() self.bit_array = bitarray(self.bit_num) self.bit_array.setall(0) self.redis_client = redis.Redis(host='localhost', port=6379, db=0) def_get_bit_num(self): """計(jì)算位數(shù)組大小""" returnint(-self.capacity * math.log(self.error_rate) / (math.log(2) **2)) def_get_hash_num(self): """計(jì)算哈希函數(shù)個數(shù)""" returnint(self.bit_num * math.log(2) /self.capacity) def_hash(self, value): """多重哈希函數(shù)""" h1 = mmh3.hash(value,0) h2 = mmh3.hash(value, h1) foriinrange(self.hash_num): yield(h1 + i * h2) %self.bit_num defadd(self, value): """添加元素""" forindexinself._hash(value): self.bit_array[index] =1 defis_exist(self, value): """判斷元素是否存在""" forindexinself._hash(value): ifnotself.bit_array[index]: returnFalse returnTrue # 業(yè)務(wù)層面的使用 defget_product_info(product_id): # 先經(jīng)過布隆過濾器檢查 ifnotbloom_filter.is_exist(product_id): return{"error":"商品不存在"} # 查詢緩存 cache_key =f"product:{product_id}" cached_data = redis_client.get(cache_key) ifcached_data: returnjson.loads(cached_data) # 查詢數(shù)據(jù)庫 product = database.query_product(product_id) ifproduct: # 緩存數(shù)據(jù) redis_client.setex(cache_key,3600, json.dumps(product)) returnproduct else: # 緩存空值,防止重復(fù)查詢 redis_client.setex(cache_key,300, json.dumps({})) return{"error":"商品不存在"}

運(yùn)維部署建議:

? 布隆過濾器數(shù)據(jù)存儲在Redis中,支持集群部署

? 定期重建布隆過濾器,避免誤判率過高

? 監(jiān)控布隆過濾器的容量使用情況

方案二:空值緩存

簡單但有效的方案,將查詢結(jié)果為空的Key也緩存起來。

defquery_with_null_cache(key):

# 1. 查詢緩存

cached_data = redis_client.get(f"cache:{key}")

ifcached_dataisnotNone:

returnjson.loads(cached_data)ifcached_data !="null"elseNone

# 2. 查詢數(shù)據(jù)庫

data = database.query(key)

# 3. 緩存結(jié)果(包括空值)

ifdata:

redis_client.setex(f"cache:{key}",3600, json.dumps(data))

else:

# 緩存空值,但設(shè)置較短的過期時間

redis_client.setex(f"cache:{key}",300,"null")

returndata

注意事項(xiàng):

? 空值緩存時間要比正常數(shù)據(jù)短

? 需要考慮存儲成本

? 要有清理機(jī)制防止垃圾數(shù)據(jù)堆積

二、緩存雪崩:系統(tǒng)癱瘓的元兇

問題現(xiàn)象

大量緩存在同一時間失效,導(dǎo)致大量請求直接打到數(shù)據(jù)庫,引發(fā)數(shù)據(jù)庫壓力過大甚至宕機(jī)。

血淚教訓(xùn)

某金融系統(tǒng)在促銷活動期間,由于緩存批量過期,瞬間10萬+用戶的查詢請求全部打到數(shù)據(jù)庫,導(dǎo)致整個交易系統(tǒng)癱瘓45分鐘,直接損失超過500萬。

解決方案

方案一:隨機(jī)過期時間

importrandom importtime defset_cache_with_random_expire(key, data, base_expire=3600): """ 設(shè)置帶隨機(jī)過期時間的緩存 base_expire: 基礎(chǔ)過期時間(秒) """ # 在基礎(chǔ)時間上增加隨機(jī)波動(±20%) random_factor = random.uniform(0.8,1.2) expire_time =int(base_expire * random_factor) redis_client.setex(key, expire_time, json.dumps(data)) # 記錄日志便于運(yùn)維監(jiān)控 logger.info(f"Cache set:{key}, expire:{expire_time}s") # 批量緩存預(yù)熱時的應(yīng)用 defbatch_warm_up_cache(data_list): """批量緩存預(yù)熱,避免同時過期""" fordataindata_list: key =f"product:{data['id']}" # 每個緩存的過期時間都不同 set_cache_with_random_expire(key, data,3600) # 控制頻率,避免Redis壓力過大 time.sleep(0.01)

方案二:多級緩存架構(gòu)

classMultiLevelCache:

def__init__(self):

self.l1_cache = {} # 本地緩存

self.l2_cache = redis.Redis() # Redis緩存

self.l3_cache = memcached.Client(['127.0.0.1:11211']) # Memcached緩存

defget(self, key):

# L1緩存命中

ifkeyinself.l1_cache:

self.metrics.incr('l1_hit')

returnself.l1_cache[key]

# L2緩存命中

l2_data =self.l2_cache.get(key)

ifl2_data:

self.metrics.incr('l2_hit')

# 回寫L1緩存

self.l1_cache[key] = json.loads(l2_data)

returnself.l1_cache[key]

# L3緩存命中

l3_data =self.l3_cache.get(key)

ifl3_data:

self.metrics.incr('l3_hit')

# 回寫上級緩存

self.l1_cache[key] = l3_data

self.l2_cache.setex(key,3600, json.dumps(l3_data))

returnl3_data

# 緩存未命中,查詢數(shù)據(jù)庫

self.metrics.incr('cache_miss')

returnNone

defset(self, key, value, expire=3600):

# 同時寫入所有緩存層級

self.l1_cache[key] = value

self.l2_cache.setex(key, expire, json.dumps(value))

self.l3_cache.set(key, value, time=expire)

方案三:互斥鎖重建緩存

importthreading fromcontextlibimportcontextmanager classCacheRebuildManager: def__init__(self): self.rebuilding_keys =set() self.lock = threading.Lock() @contextmanager defrebuild_lock(self, key): """互斥鎖控制緩存重建""" withself.lock: ifkeyinself.rebuilding_keys: # 如果正在重建,等待一段時間 time.sleep(0.1) yieldFalse else: self.rebuilding_keys.add(key) try: yieldTrue finally: self.rebuilding_keys.discard(key) rebuild_manager = CacheRebuildManager() defget_data_with_rebuild_protection(key): # 查詢緩存 cached_data = redis_client.get(key) ifcached_data: returnjson.loads(cached_data) # 緩存未命中,嘗試獲取重建鎖 withrebuild_manager.rebuild_lock(key)asshould_rebuild: ifshould_rebuild: # 獲得鎖,進(jìn)行數(shù)據(jù)重建 data = database.query(key) ifdata: # 設(shè)置隨機(jī)過期時間防止雪崩 expire_time = random.randint(3600,4320) # 1-1.2小時 redis_client.setex(key, expire_time, json.dumps(data)) returndata else: # 等待重建完成后再次查詢緩存 time.sleep(0.1) cached_data = redis_client.get(key) returnjson.loads(cached_data)ifcached_dataelseNone

三、緩存擊穿:熱點(diǎn)數(shù)據(jù)的陷阱

問題描述

某個熱點(diǎn)Key突然失效,導(dǎo)致大量請求同時查詢數(shù)據(jù)庫,造成瞬時壓力。

經(jīng)典案例

某視頻平臺的熱門視頻緩存過期,瞬間5000+并發(fā)請求打到數(shù)據(jù)庫查詢視頻信息,導(dǎo)致數(shù)據(jù)庫連接池耗盡,整個視頻服務(wù)不可用。

解決方案

方案一:永不過期 + 邏輯過期

importjson importtime importthreading classLogicalExpireCache: def__init__(self): self.redis_client = redis.Redis() self.executor = ThreadPoolExecutor(max_workers=10) defset_with_logical_expire(self, key, data, expire_seconds): """設(shè)置帶邏輯過期時間的緩存""" cache_data = { 'data': data, 'expire_time': time.time() + expire_seconds } # 永不過期,但包含邏輯過期時間 self.redis_client.set(key, json.dumps(cache_data)) defget_with_logical_expire(self, key): """獲取帶邏輯過期檢查的緩存""" cached_json =self.redis_client.get(key) ifnotcached_json: returnNone cached_data = json.loads(cached_json) current_time = time.time() # 檢查是否邏輯過期 ifcurrent_time < cached_data['expire_time']: ? ? ? ? ? ??# 未過期,直接返回 ? ? ? ? ? ??return?cached_data['data'] ? ? ? ??else: ? ? ? ? ? ??# 已過期,異步刷新緩存,先返回舊數(shù)據(jù) ? ? ? ? ? ??self.executor.submit(self._refresh_cache_async, key) ? ? ? ? ? ??return?cached_data['data'] ? ?? ? ??def?_refresh_cache_async(self, key): ? ? ? ??"""異步刷新緩存""" ? ? ? ??try: ? ? ? ? ? ??# 獲取分布式鎖,避免并發(fā)刷新 ? ? ? ? ? ? lock_key =?f"lock:{key}" ? ? ? ? ? ??if?self.redis_client.set(lock_key,?"1", nx=True, ex=10): ? ? ? ? ? ? ? ??# 獲得鎖,開始刷新 ? ? ? ? ? ? ? ? new_data = database.query(key) ? ? ? ? ? ? ? ??if?new_data: ? ? ? ? ? ? ? ? ? ??self.set_with_logical_expire(key, new_data,?3600) ? ? ? ? ? ? ? ??self.redis_client.delete(lock_key) ? ? ? ??except?Exception?as?e: ? ? ? ? ? ? logger.error(f"異步刷新緩存失敗:?{key}, 錯誤:?{e}") # 使用示例 cache_manager = LogicalExpireCache() def?get_hot_video_info(video_id): ? ? cache_key =?f"video:{video_id}" ? ?? ? ??# 嘗試從緩存獲取 ? ? video_info = cache_manager.get_with_logical_expire(cache_key) ? ?? ? ??if?video_info?is?None: ? ? ? ??# 緩存完全不存在,同步查詢 ? ? ? ? video_info = database.query_video(video_id) ? ? ? ??if?video_info: ? ? ? ? ? ? cache_manager.set_with_logical_expire(cache_key, video_info,?3600) ? ?? ? ??return?video_info

方案二:分布式鎖 + 雙重檢查

importuuid importtime classDistributedLock: def__init__(self, redis_client, key, timeout=10): self.redis_client = redis_client self.key =f"lock:{key}" self.timeout = timeout self.identifier =str(uuid.uuid4()) def__enter__(self): # 嘗試獲取鎖 end_time = time.time() +self.timeout whiletime.time() < end_time: ? ? ? ? ? ??if?self.redis_client.set(self.key,?self.identifier, nx=True, ex=self.timeout): ? ? ? ? ? ? ? ??return?self ? ? ? ? ? ? time.sleep(0.001) ? ? ? ??raise?TimeoutError("獲取分布式鎖超時") ? ?? ? ??def?__exit__(self, exc_type, exc_val, exc_tb): ? ? ? ??# 釋放鎖(使用Lua腳本確保原子性) ? ? ? ? unlock_script =?""" ? ? ? ? if redis.call("get", KEYS[1]) == ARGV[1] then ? ? ? ? ? ? return redis.call("del", KEYS[1]) ? ? ? ? else ? ? ? ? ? ? return 0 ? ? ? ? end ? ? ? ? """ ? ? ? ??self.redis_client.eval(unlock_script,?1,?self.key,?self.identifier) def?get_data_with_distributed_lock(key): ? ??"""使用分布式鎖防止緩存擊穿""" ? ??# 第一次檢查緩存 ? ? cached_data = redis_client.get(key) ? ??if?cached_data: ? ? ? ??return?json.loads(cached_data) ? ?? ? ??# 緩存未命中,嘗試獲取分布式鎖 ? ??try: ? ? ? ??with?DistributedLock(redis_client, key, timeout=5): ? ? ? ? ? ??# 獲得鎖后,再次檢查緩存(雙重檢查) ? ? ? ? ? ? cached_data = redis_client.get(key) ? ? ? ? ? ??if?cached_data: ? ? ? ? ? ? ? ??return?json.loads(cached_data) ? ? ? ? ? ?? ? ? ? ? ? ??# 查詢數(shù)據(jù)庫并緩存 ? ? ? ? ? ? data = database.query(key) ? ? ? ? ? ??if?data: ? ? ? ? ? ? ? ? redis_client.setex(key,?3600, json.dumps(data)) ? ? ? ? ? ??return?data ? ?? ? ??except?TimeoutError: ? ? ? ??# 獲取鎖超時,直接查詢數(shù)據(jù)庫(降級策略) ? ? ? ? logger.warning(f"獲取鎖超時,直接查數(shù)據(jù)庫:?{key}") ? ? ? ??return?database.query(key)

四、生產(chǎn)環(huán)境最佳實(shí)踐

監(jiān)控告警體系

classCacheMonitor:

def__init__(self):

self.metrics = {}

defrecord_cache_hit_rate(self):

"""監(jiān)控緩存命中率"""

hit_rate =self.redis_client.get('cache_hit_rate')

ifhit_rateandfloat(hit_rate) 0.85:

self.send_alert("Redis內(nèi)存使用過高",f"使用率:{memory_usage:.2%}")

defcheck_slow_queries(self):

"""檢查慢查詢"""

slow_logs =self.redis_client.slowlog_get(10)

forloginslow_logs:

iflog['duration'] >10000: # 超過10ms

self.send_alert("發(fā)現(xiàn)慢查詢",f"耗時:{log['duration']}μs, 命令:{log['command']}")

# 定時監(jiān)控任務(wù)

defmonitoring_task():

monitor = CacheMonitor()

whileTrue:

try:

monitor.record_cache_hit_rate()

monitor.monitor_redis_memory()

monitor.check_slow_queries()

exceptExceptionase:

logger.error(f"監(jiān)控任務(wù)異常:{e}")

time.sleep(60)

緩存預(yù)熱策略

classCacheWarmUp:

def__init__(self):

self.redis_client = redis.Redis()

self.thread_pool = ThreadPoolExecutor(max_workers=20)

defwarm_up_hot_data(self):

"""預(yù)熱熱點(diǎn)數(shù)據(jù)"""

# 獲取熱點(diǎn)商品ID列表

hot_products = database.query("SELECT id FROM products WHERE is_hot = 1")

# 并發(fā)預(yù)熱

futures = []

forproductinhot_products:

future =self.thread_pool.submit(self._warm_single_product, product['id'])

futures.append(future)

# 等待所有任務(wù)完成

success_count =0

forfutureinfutures:

try:

future.result(timeout=30)

success_count +=1

exceptExceptionase:

logger.error(f"預(yù)熱失敗:{e}")

logger.info(f"緩存預(yù)熱完成,成功:{success_count}/{len(hot_products)}")

def_warm_single_product(self, product_id):

"""預(yù)熱單個商品緩存"""

try:

product_info = database.query_product(product_id)

ifproduct_info:

cache_key =f"product:{product_id}"

expire_time = random.randint(3600,4320) # 隨機(jī)過期時間

self.redis_client.setex(cache_key, expire_time, json.dumps(product_info))

exceptExceptionase:

logger.error(f"預(yù)熱商品{product_id}失敗:{e}")

raise

# 應(yīng)用啟動時執(zhí)行緩存預(yù)熱

if__name__ =="__main__":

warm_up = CacheWarmUp()

warm_up.warm_up_hot_data()

容災(zāi)備份方案

classCacheDisasterRecovery: def__init__(self): self.master_redis = redis.Redis(host='master-redis') self.slave_redis = redis.Redis(host='slave-redis') self.local_cache = {} defget_with_fallback(self, key): """多級降級查詢""" try: # 1. 主Redis data =self.master_redis.get(key) ifdata: returnjson.loads(data) exceptExceptionase: logger.warning(f"主Redis故障:{e}") try: # 2. 從Redis data =self.slave_redis.get(key) ifdata: returnjson.loads(data) exceptExceptionase: logger.warning(f"從Redis故障:{e}") # 3. 本地緩存 ifkeyinself.local_cache: cache_item =self.local_cache[key] iftime.time() < cache_item['expire_time']: ? ? ? ? ? ? ? ? logger.info(f"命中本地緩存:?{key}") ? ? ? ? ? ? ? ??return?cache_item['data'] ? ? ? ?? ? ? ? ??# 4. 數(shù)據(jù)庫查詢 ? ? ? ??try: ? ? ? ? ? ? data = database.query(key) ? ? ? ? ? ??if?data: ? ? ? ? ? ? ? ??# 同步到本地緩存 ? ? ? ? ? ? ? ??self.local_cache[key] = { ? ? ? ? ? ? ? ? ? ??'data': data, ? ? ? ? ? ? ? ? ? ??'expire_time': time.time() +?300??# 5分鐘本地緩存 ? ? ? ? ? ? ? ? } ? ? ? ? ? ??return?data ? ? ? ??except?Exception?as?e: ? ? ? ? ? ? logger.error(f"數(shù)據(jù)庫查詢失敗:?{e}") ? ? ? ? ? ??return?None

五、性能優(yōu)化與調(diào)優(yōu)

Redis配置優(yōu)化

# redis.conf 生產(chǎn)環(huán)境推薦配置 # 內(nèi)存優(yōu)化 maxmemory 8gb maxmemory-policy allkeys-lru # 持久化配置 save 900 1 save 300 10 save 60 10000 stop-writes-on-bgsave-erroryes rdbcompressionyes rdbchecksumyes # 網(wǎng)絡(luò)優(yōu)化 tcp-keepalive 300 timeout0 # 慢查詢?nèi)罩?slowlog-log-slower-than 10000 slowlog-max-len 128 # 客戶端連接 maxclients 10000

連接池配置

importredis.connection # Redis連接池配置 redis_pool = redis.ConnectionPool( host='localhost', port=6379, db=0, max_connections=100, # 最大連接數(shù) retry_on_timeout=True, # 超時重試 health_check_interval=30,# 健康檢查間隔 socket_connect_timeout=5,# 連接超時 socket_timeout=5, # 讀寫超時 ) redis_client = redis.Redis(connection_pool=redis_pool)

六、故障排查實(shí)戰(zhàn)手冊

常見問題診斷

# 1. 查看Redis內(nèi)存使用情況 redis-cli info memory # 2. 監(jiān)控慢查詢 redis-cli slowlog get 10 # 3. 查看客戶端連接 redis-cli info clients # 4. 監(jiān)控鍵空間命中率 redis-cli info stats | grep keyspace # 5. 查看過期鍵統(tǒng)計(jì) redis-cli info keyspace

應(yīng)急處理腳本

#!/usr/bin/env python3 """Redis應(yīng)急處理工具""" importredis importsys importtime classRedisEmergencyKit: def__init__(self, host='localhost', port=6379): self.redis_client = redis.Redis(host=host, port=port) defflush_expired_keys(self): """清理過期鍵""" print("開始清理過期鍵...") count =0 forkeyinself.redis_client.scan_iter(): ifself.redis_client.ttl(key) ==0: self.redis_client.delete(key) count +=1 print(f"清理完成,共刪除{count}個過期鍵") defanalyze_big_keys(self, limit=10): """分析大鍵""" print(f"分析占用內(nèi)存最大的{limit}個鍵...") big_keys = [] forkeyinself.redis_client.scan_iter(): memory =self.redis_client.memory_usage(key) ifmemory: big_keys.append((key.decode(), memory)) big_keys.sort(key=lambdax: x[1], reverse=True) forkey, memoryinbig_keys[:limit]: print(f"{key}:{memory /1024:.2f}KB") defemergency_cache_clear(self, pattern): """緊急清理指定模式的緩存""" print(f"緊急清理模式{pattern}的緩存...") count =0 forkeyinself.redis_client.scan_iter(match=pattern): self.redis_client.delete(key) count +=1 print(f"清理完成,共刪除{count}個鍵") if__name__ =="__main__": iflen(sys.argv) ") print("命令: flush_expired | analyze_big_keys | clear_pattern") sys.exit(1) kit = RedisEmergencyKit() command = sys.argv[1] ifcommand =="flush_expired": kit.flush_expired_keys() elifcommand =="analyze_big_keys": kit.analyze_big_keys() elifcommand =="clear_pattern"andlen(sys.argv) >2: kit.emergency_cache_clear(sys.argv[2]) else: print("未知命令")

總結(jié)

通過本文的深入分析,我們了解了Redis三大經(jīng)典問題的本質(zhì)和解決方案:

緩存穿透:使用布隆過濾器或空值緩存,構(gòu)建第一道防線

緩存雪崩:通過隨機(jī)過期時間、多級緩存、互斥鎖等方式分散風(fēng)險

緩存擊穿:采用邏輯過期或分布式鎖,保護(hù)熱點(diǎn)數(shù)據(jù)

作為運(yùn)維工程師,我們不僅要掌握這些解決方案,更要建立完善的監(jiān)控體系、預(yù)熱機(jī)制和應(yīng)急預(yù)案。記住:好的運(yùn)維不是沒有故障,而是故障發(fā)生時能夠快速響應(yīng)和恢復(fù)。

在我的運(yùn)維生涯中,這些方案幫我避免了無數(shù)次半夜的緊急電話。希望這篇文章能對各位同行有所幫助,讓我們一起構(gòu)建更穩(wěn)定、更高效的系統(tǒng)!

-

cpu

+關(guān)注

關(guān)注

68文章

11305瀏覽量

225525 -

緩存

+關(guān)注

關(guān)注

1文章

248瀏覽量

27799 -

數(shù)據(jù)庫

+關(guān)注

關(guān)注

7文章

4061瀏覽量

68451 -

Redis

+關(guān)注

關(guān)注

0文章

392瀏覽量

12228

原文標(biāo)題:Redis緩存穿透、雪崩、擊穿三大難題的解決方案與實(shí)戰(zhàn)

文章出處:【微信號:magedu-Linux,微信公眾號:馬哥Linux運(yùn)維】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

關(guān)于Redis緩存的原因及解決方案

Redis緩存和MySQL數(shù)據(jù)不一致原因和解決方案

Redis在高速緩存系統(tǒng)中的序列化算法研究

redis緩存mysql數(shù)據(jù)

Redis實(shí)戰(zhàn)的常見問題和解決方法

緩存雪崩/穿透/擊穿的解決方案

Redis緩存的異常原因及其處理辦法分析

如何在SpringBoot中解決Redis的緩存穿透等問題

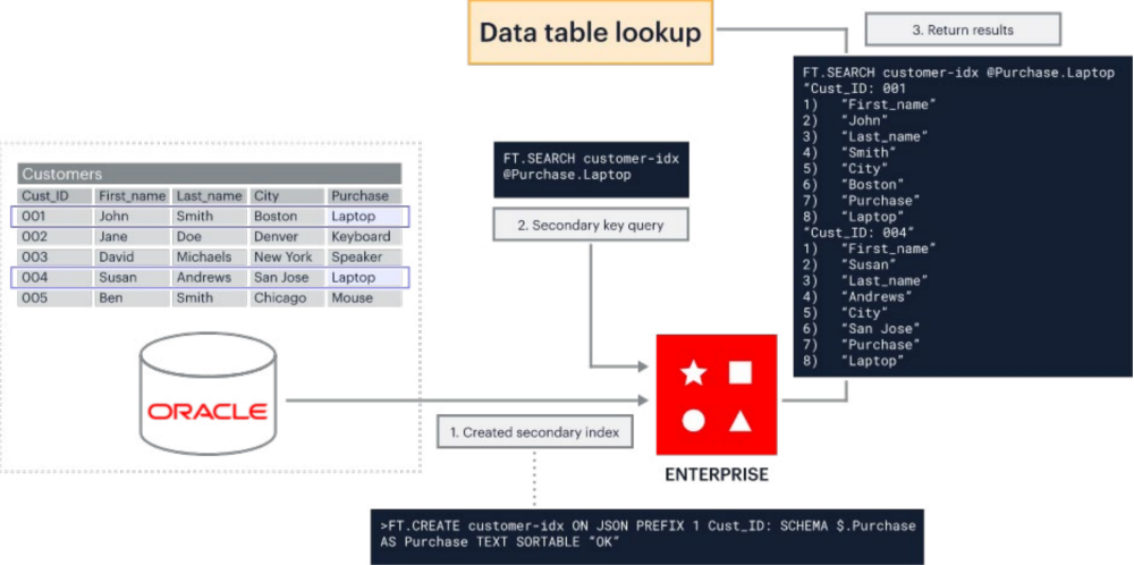

Oracle與Redis Enterprise協(xié)同,作為企業(yè)緩存解決方案

Redis Enterprise vs ElastiCache——如何選擇緩存解決方案?

Redis緩存的經(jīng)典問題和解決方案

Redis緩存的經(jīng)典問題和解決方案

評論