Groq LPU 如何讓萬億參數(shù)模型「飛」起來?揭秘 Kimi K2 40 倍提速背后的黑科技?

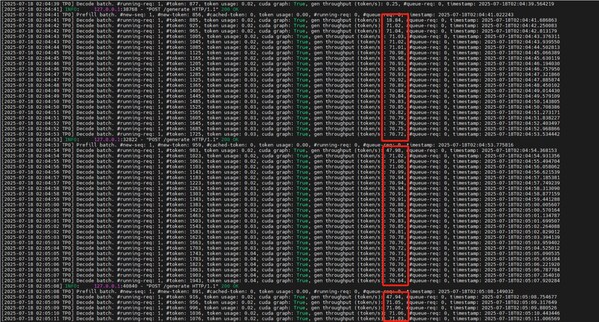

最近,Moonshot AI 的千億參數(shù)大模型 ?Kimi K2? 在 ?GroqCloud? 上開放預覽,引發(fā)了開發(fā)者社區(qū)的瘋狂討論——?為什么 Groq 能跑得這么快??

傳統(tǒng) AI 推理硬件(如 GPU)往往面臨一個兩難選擇:

? ?快?(但犧牲精度)

? ?準?(但延遲高到無法接受)

而 Groq 的 ?LPU(Language Processing Unit)? 卻打破了這一魔咒,?既快又準?。

1. 精度與速度的「魚與熊掌」:如何兼得??

傳統(tǒng)硬件的「量化陷阱」?

大多數(shù) AI 加速器(如 GPU)為了提升推理速度,會采用 ?INT8/FP8 等低精度計算?,但這會導致?累積誤差?,模型質量大幅下降。

Groq 的「TruePoint Numerics」黑科技?

Groq 的解決方案是 ?動態(tài)精度調整?:

權重/激活函數(shù)?:用低精度存儲(節(jié)省內存)

矩陣運算?:全精度計算(保證結果無損)

輸出階段?:根據(jù)下游需求?智能選擇量化策略?

這樣一來,?速度比 BF16 快 2-4 倍,但精度無損?(MMLU/HumanEval 等基準測試驗證)。

傳統(tǒng) AI 芯片(如 GPU)依賴 ?HBM/DRAM? 作為主存,?每次權重訪問延遲高達數(shù)百納秒?,嚴重影響推理速度。

而 Groq ?直接集成數(shù)百兆片上 SRAM?,讓權重加載?零延遲?,計算單元?全速運轉?。

審核編輯 黃宇

-

AI

+關注

關注

91文章

39754瀏覽量

301344 -

大模型

+關注

關注

2文章

3648瀏覽量

5176

發(fā)布評論請先 登錄

大模型 ai coding 比較

開源大模型算力革命下:電子谷連接技術的堅守與未來

Dynamo 0.4在NVIDIA Blackwell上通過PD分離將性能提升4倍

浪潮信息發(fā)布"元腦SD200"超節(jié)點,面向萬億參數(shù)大模型創(chuàng)新設計

請問InDTU IHDMP協(xié)議使用的CRC校驗使用的什么參數(shù)模型?

面向萬億級參數(shù)大模型,“超節(jié)點”涌現(xiàn)

奇異摩爾邀您相約2025 AI網絡技術應用創(chuàng)新大會

硅基流動攜手沐曦首發(fā)基于曦云的Kimi K2推理服務

萬億參數(shù)!元腦企智一體機率先支持Kimi K2大模型

API讓電商“飛”起來,告別手動操作

?Groq LPU 如何讓萬億參數(shù)模型「飛」起來?揭秘 Kimi K2 40 倍提速背后的黑科技

?Groq LPU 如何讓萬億參數(shù)模型「飛」起來?揭秘 Kimi K2 40 倍提速背后的黑科技

評論