擴展定律描述了 AI 系統性能如何隨訓練數據、模型參數或計算資源規模的增加而提高。

如同許多眾所周知的自然經驗法則(例如,凡事有起必有落,或每一個作用力都有一個大小相等、方向相反的反作用力)一樣,在 AI 領域,大家一直認為,計算、訓練數據和參數越多,AI 模型就越好。

然而 AI 發展至今,已經需要三條不同定律來描述不同計算資源配置如何影響模型性能。這三條 AI 擴展定律分別是預訓練擴展、后訓練擴展和測試時擴展(也稱為長思考),它們共同反映了這一領域隨著技術的發展而演變的過程,而這些技術能夠在各種日益復雜的 AI 用例中使用更多的計算資源。

特別是最近興起的測試時擴展技術(在推理階段應用更多計算資源以提高準確性),使 AI 推理模型成為了可能。這種新的大語言模型 (LLM) 能通過執行多次推理來解決復雜問題,同時描述執行任務所需的步驟。然而,測試時擴展需要大量計算資源來支持 AI 推理,這將進一步推動對加速計算的需求。

什么是預訓練擴展?

預訓練擴展是最初的 AI 發展定律。該定律表明:通過提升訓練數據集規模、模型參數數量,以及增加計算資源,開發者能夠實現模型智能水平和準確率的可預測性提升。

數據、模型大小和計算這三個要素相互關聯。根據研究論文所述的預訓練擴展定律,大模型被輸入的數據越多,其整體性能越高。為此,開發者必須擴大計算規模,而這又進一步推動了對強大加速計算資源的需求,以運行這些大規模訓練的工作負載。

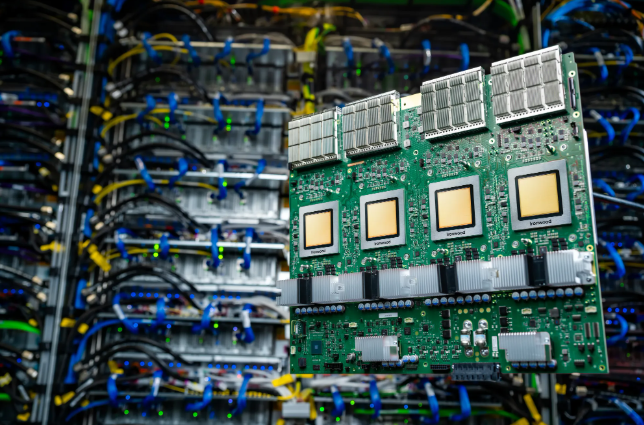

預訓練擴展定律帶來了具有突破性能力的大模型,同時也激發了模型架構方面的重大創新,包括十億和萬億參數級 transformer 模型、混合專家模型和新分布式訓練技術的興起,而這些都對計算資源提出了極高要求。

隨著人類不斷產生大量的多模態數據,包括文本、圖像、音頻、視頻和傳感器信息,這些豐富的數據將被用于訓練強大的未來 AI 模型,因此預訓練擴展定律適用性還將持續。

預訓練擴展是 AI 發展的基本原則,它建立了模型、數據集和計算

與 AI 收益之間的聯系。混合專家是 AI 訓練中的一種常用模型架構。

什么是后訓練擴展?

預訓練大型基礎模型并非易事,它需要大量的投入、專業的技術專家以及數據集。然而,一旦一家公司預訓練并發布了一個模型,就進而降低了使用 AI 的門檻,讓其他人能夠使用他們預訓練的模型作為基礎,并根據自己的應用進行調整。

這種后訓練的過程進一步增加了企業和更廣泛開發者社區對加速計算的持續需求。流行的開源模型可以衍生出數百甚至數千個在眾多領域中訓練過的變體模型。

為各種用例開發這些衍生模型可能需要比預訓練原始基礎模型多出約 30 倍的計算資源。

后訓練技術可以進一步提高模型針對企業所需用例的專業性和相關性。預訓練就像是送 AI 模型去學校學習基礎技能,而后訓練則是教會模型適用于其預期工作的技能。例如,大語言模型在經過后訓練后可以處理諸如觀點分析或翻譯等任務,或者理解醫療或法律等特定領域的術語。

后訓練擴展定律認為,可以使用微調、剪枝、量化、蒸餾、強化學習和合成數據增強等技術,進一步提高預訓練模型的性能,包括計算效率、準確性或領域專業性。

微調是使用額外的訓練數據為特定領域和應用定制 AI 模型。可以使用的訓練數據包括企業內部數據集,或成對的樣本模型輸入和輸出。

蒸餾需要一對 AI 模型,即一個大型、復雜的教師模型和一個輕量級的學生模型。在最常見的蒸餾技術(稱為離線蒸餾)中,學生模型會學習模仿預訓練教師模型的輸出。

強化學習 (RL)是一種機器學習技術,它通過獎勵模型來訓練一個智能體,使其做出與特定用例相符的決策。智能體的目標是在與環境交互的過程中,隨著時間推移最大化累積獎勵。例如,一個聊天機器人 LLM 可以通過用戶的“點贊”反應獲得正向強化。這種技術被稱為基于人類反饋的強化學習 (RLHF)。另一種更新的技術是基于 AI 反饋的強化學習 (RLAIF)。它使用 AI 模型的反饋來指導學習過程,從而簡化后訓練的優化工作。

Best-of-n 采樣會從語言模型中生成多個輸出,并根據獎勵模型選擇其中獎勵分數最高的輸出。這種方法通常用于在不修改模型參數的情況下提升 AI 的輸出質量,是強化學習微調的一種替代方案。

搜索方法會在選擇最終輸出之前探索一系列潛在的決策路徑。這種后訓練的技術可以通過迭代的方式逐步改進模型的響應。

為了支持后訓練,開發者可以使用合成數據增強或補充他們的微調數據集。使用由 AI 生成的數據去補充現實世界的數據集,可以使模型更善于處理原始訓練數據中罕見或缺失的邊緣案例。

后訓練擴展使用微調、剪枝和蒸餾等技術完善預訓練模型,以提高效率和任務相關性。

什么是測試時擴展?

LLM 可以對輸入的提示作出快速響應。雖然該過程非常適合回答簡單問題,但在面對用戶提出的復雜問題時可能就不那么奏效了。而回答復雜問題是代理式 AI 工作負載的一項基本能力,這項工作要求 LLM 在得出答案之前先對問題進行推理。

這與大多數人類的思維方式類似——當被問到像 2 加 2 這樣的問題時,我們可以立即給出答案,不需要涉及加法或整數的基本原理。但如果當場被要求制定一個能讓公司利潤增長 10% 的商業計劃,那么我們就需要對各種選項進行推理,并給出一個多步驟的答案。

測試時擴展也被稱為長思考,發生在推理過程中。傳統的 AI 模型會根據用戶提示快速生成一個一次性的答案,而使用測試時擴展技術的模型則會在推理過程中進行額外的計算,以便在得出最佳答案之前對多個備選答案進行推理。

在為開發者生成復雜、定制化的代碼等任務中,這種 AI 推理過程可能需要花費數分鐘甚至數小時——與傳統 LLM 的單次推理相比,對于復雜的查詢,它可能需要超過 100 倍的計算資源,而傳統 LLM 在第一次嘗試時幾乎不可能正確回答復雜問題。

這種測試時計算的能力使 AI 模型能夠探索問題的不同解決方案,并將復雜的請求分解為多個步驟。在許多情況下,它們在推理時會向用戶展示自己的工作。研究發現,在向 AI 模型提供需要多個推理和規劃步驟的開放式提示時,測試時擴展能夠提高回答的質量。

測試時計算方法有很多,包括:

思維鏈提示:將復雜的問題分解為一系列較簡單的步驟。

多數表決抽樣:針對相同的提示生成多個回答,然后選擇出現頻率最高的答案作為最終輸出。

搜索:探索并評估響應的樹狀結構中存在的多條路徑。

像 Best-of-n 采樣這樣的后訓練方法也可以在推理階段用于“長思考”,以優化響應,使其更符合人類偏好或其他目標。

測試時擴展通過進行額外的計算改進 AI 推理,從而增強模型的推理能力,使模型能夠有效解決復雜的多步驟問題。

測試時擴展如何實現 AI 推理

測試時計算的興起使 AI 能夠對復雜的開放式用戶查詢作出有理有據、實用且更加準確的回答。這種能力對于自主代理式 AI 和物理 AI 應用所期望的詳細、多步驟推理任務至關重要,為各個行業的用戶提供了能夠加快工作速度的超強助手,提高效率和生產力。

在醫療領域,模型可以使用測試時擴展技術分析海量數據,推斷疾病的發展情況,并根據藥物分子的化學結構預測新療法可能引發的潛在并發癥。它們還可以梳理臨床試驗數據庫,以便推薦符合個人疾病特征的治療方案,同時分享其對不同研究利弊的推理過程。

在零售和供應鏈物流領域,“長思考”可以助力解決短期運營挑戰和長期戰略目標所需的復雜決策。通過推理技術,企業能夠同時預測和評估多種場景,從而降低風險并應對可擴展性挑戰。這有助于實現更準確的需求預測、優化供應鏈路線以及做出與組織可持續發展目標一致的采購決策。

全球各地的企業都可以使用該技術起草詳細的商業計劃,生成復雜的代碼來調試軟件,或優化送貨卡車、倉庫機器人和自動駕駛出租車的行駛路線。

AI 推理模型正在迅速發展。過去幾周內,OpenAI o1-mini 和 o3-mini、DeepSeek R1 以及谷歌 DeepMind 的 Gemini 2.0 Flash Thinking 相繼推出,預計很快還會有更多的新模型推出。

這些模型需要大量的計算資源進行推理以及正確回答復雜問題,這意味著企業需要擴展其加速計算資源來提供支持復雜問題解答、編碼和多步驟規劃的下一代 AI 推理工具。

-

NVIDIA

+關注

關注

14文章

5594瀏覽量

109739 -

AI

+關注

關注

91文章

39793瀏覽量

301412 -

模型

+關注

關注

1文章

3752瀏覽量

52111

原文標題:如何通過擴展定律推動更智能、更強大的 AI

文章出處:【微信號:NVIDIA_China,微信公眾號:NVIDIA英偉達】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

華為破解HBM依賴!AI推理黑科技UCM上線,9月正式開源

如何在邊緣AI應用場景中實現高性能、低功耗推理(上)

如何在邊緣AI應用場景中實現高性能、低功耗推理(上)

使用NORDIC AI的好處

AMD Vitis AI 5.1測試版發布

什么是AI模型的推理能力

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+AI芯片到AGI芯片

今日看點丨華為發布AI推理創新技術UCM;比亞迪汽車出口暴增130%

PCIe協議分析儀能測試哪些設備?

研華科技推出緊湊型邊緣AI推理系統AIR-120

信而泰×DeepSeek:AI推理引擎驅動網絡智能診斷邁向 “自愈”時代

Nordic收購 Neuton.AI 關于產品技術的分析

谷歌第七代TPU Ironwood深度解讀:AI推理時代的硬件革命

測試時擴展技術如何實現AI推理

測試時擴展技術如何實現AI推理

評論