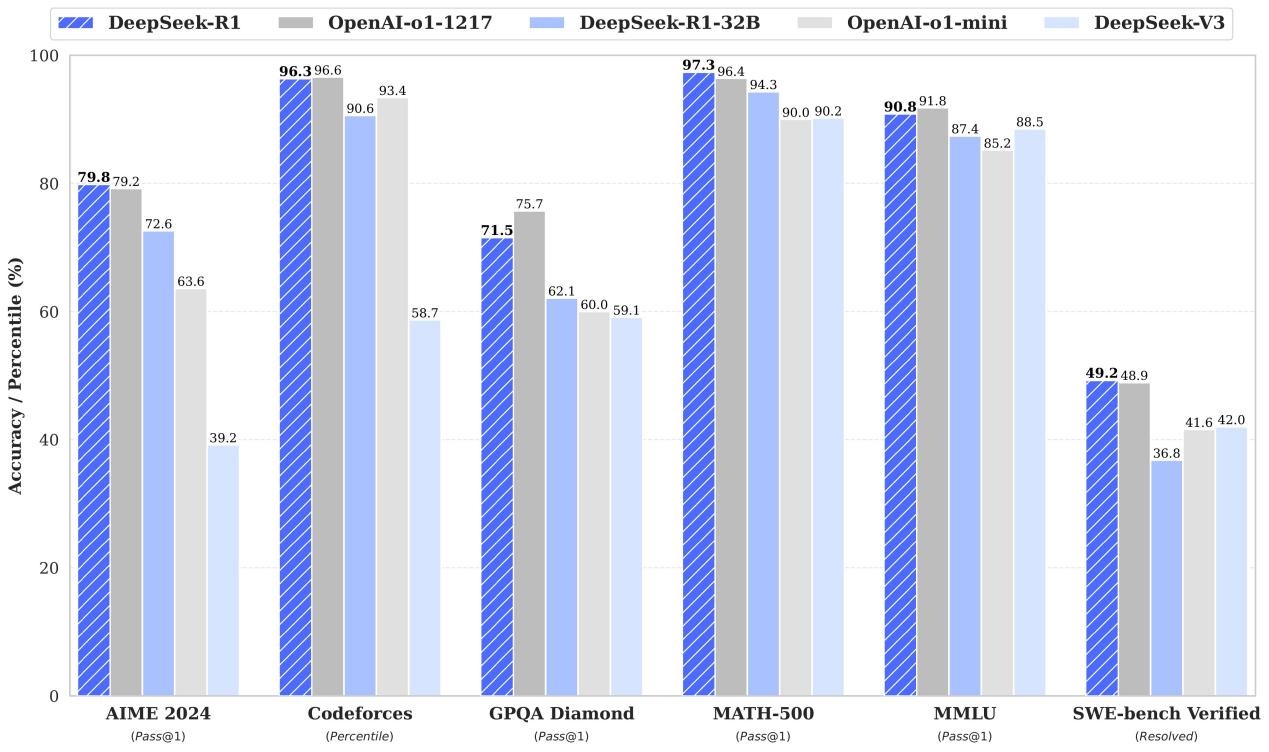

近期,“國產之光”DeepSeek系列大模型發展迅猛,領跑開源大模型技術與生態,為中國人工智能行業帶來了前所未有的變革動力,對全球科技競爭格局產生積極影響。

1稀疏計算

助力DeepSeek R1模型高效部署

日前,墨芯人工智能(Moffett AI)已完成與DeepSeek R1全系列蒸餾模型的推理部署。憑借自研的雙稀疏算法技術,墨芯S40計算卡性能得到充分釋放,為DeepSeek R1的高效部署提供了強勁的算力后盾,并在較短時間內完成DeepSeek-R1-70B* 和DeepSeek-R1-32B* 等中、大模型部署,且成功實現單卡支持DeepSeek-R1-32B*部署。

墨芯S40計算卡支持DeepSeek R1-70B和DeepSeek R1-32B推理部署

2軟硬件協同

提升DeepSeek R1模型推理效率

DeepSeek-R1蒸餾模型是DeepSeek在模型壓縮與優化領域的重要創新,通過蒸餾技術實現了高效、低成本的AI推理,適合企業內部實施部署,實現降本增效。

DeepSeek-R1-70B* 和DeepSeek-R1-32B*是DeepSeek-R1蒸餾模型的中大規模和大規模模型。DeepSeek-R1-32B*推理速度較快,實時性要求高的場景,擅長處理日常對話、文檔生成和基礎代碼輔助;DeepSeek-R1-70B*側重復雜邏輯推理、科研分析、高質量內容創作。

墨芯的稀疏計算技術則是通過算法與硬件的協同設計,有效地減少蒸餾模型部署所需的資源,其中稀疏化技術將模型中的稠密張量轉換為等效的稀疏張量,使張量中產生大量的零元素,通過剪枝,有效消減模型冗余,以顯著加快計算速度,實現了大模型的高效稀疏化,顯著提升DeepSeek-R1系列蒸餾模型的推理速度并降低能耗。

此外,相較于傳統推理平臺,墨芯S40算力卡能夠實現“單卡推理大模型”,簡化了多卡分布式處理大模型的復雜部署流程,降低了時間、功耗和成本。這一優勢在DeepSeek-R1蒸餾模型的部署中得到了充分體現,墨芯的S40計算卡滿足了高算力需求,降低了總擁有成本(TCO),為 AI大模型在各行業的應用提供了支持。

墨芯人工智能與DeepSeek-R1蒸餾模型的成功部署,實現了國產AI算力基座和國產大模型在應用層面的“雙向奔赴”,展示了稀疏計算技術在大模型領域的實踐成果,也為企業部署“高性能”且“用得起”的大模型提供新思路。

備注:

DeepSeek-R1-70B*:指DeepSeek-R1-Distill-Llama-70B模型

DeepSeek-R1-32B*:指DeepSeek-R1-Distill-Qwen-32B模型

關于墨芯人工智能

墨芯人工智能是稀疏計算引領者,致力于提供云端和終端AI計算平臺和服務。通過全球領先的稀疏計算技術優勢,打造軟硬協同的新一代智能計算平臺。產品性能位居行業領先,相較行業主流產品,在算力、能效比與成本等方面均實現數量級優化。面向互聯網、運營商、金融、制造、醫療、交通、能源、生命科學、自動駕駛等眾多行業與場景,提供高算力、低功耗、高性價比的AI算力服務,賦能前沿科技的進步與社會的智能化升級。

-

墨芯

+關注

關注

0文章

22瀏覽量

1286 -

大模型

+關注

關注

2文章

3650瀏覽量

5186 -

DeepSeek

+關注

關注

2文章

835瀏覽量

3270

原文標題:墨芯S40計算卡完成DeepSeek大模型部署, 支持單卡推理大模型

文章出處:【微信號:墨芯人工智能,微信公眾號:墨芯人工智能】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

DeepSeek模型如何在云服務器上部署?

墨芯人工智能亮相2025外灘大會

本地部署openWebUI + ollama+DeepSeek 打造智能知識庫并實現遠程訪問

【VisionFive 2單板計算機試用體驗】3、開源大語言模型部署

Arm Neoverse N2平臺實現DeepSeek-R1滿血版部署

Deepseek海思SD3403邊緣計算AI產品系統

【幸狐Omni3576邊緣計算套件試用體驗】CPU部署DeekSeek-R1模型(1B和7B)

DeepSeek在昇騰上的模型部署的常見問題及解決方案

【幸狐Omni3576邊緣計算套件試用體驗】DeepSeek 部署及測試

博實結完成DeepSeek大模型本地化部署

RT-Thread虛擬化部署DeepSeek大模型實踐

在英特爾哪吒開發套件上部署DeepSeek-R1的實現方式

墨芯S40計算卡實現DeepSeek大模型部署

墨芯S40計算卡實現DeepSeek大模型部署

評論