近日,vLLM項(xiàng)目宣布正式成為PyTorch生態(tài)系統(tǒng)的一部分,標(biāo)志著該項(xiàng)目與PyTorch的合作進(jìn)入了一個(gè)全新的階段。本文將從以下幾個(gè)方面進(jìn)行介紹,特別提醒:安裝方案在第四個(gè)部分,可選擇性閱讀。

vLLM項(xiàng)目概述

vLLM的成就與實(shí)際應(yīng)用

支持流行模型

安裝與使用vLLM

總結(jié)

一,vLLM項(xiàng)目概述

vLLM是一個(gè)為大型語言模型(LLMs)設(shè)計(jì)的高吞吐量、內(nèi)存高效的推理和服務(wù)引擎。該項(xiàng)目最初基于創(chuàng)新的PagedAttention算法構(gòu)建,如今已經(jīng)發(fā)展成為一個(gè)全面的、最先進(jìn)的推理引擎。vLLM社區(qū)不斷為其添加新功能和優(yōu)化,包括流水線并行處理、分塊預(yù)填充、推測(cè)性解碼和分離服務(wù)。

二,vLLM的成就與實(shí)際應(yīng)用

自發(fā)布以來,vLLM獲得了超過31,000個(gè)GitHub星標(biāo),這一成就證明了其受歡迎程度和社區(qū)的活力。vLLM與PyTorch的深度集成,使其能夠支持包括NVIDIA GPU、AMD GPU、Google Cloud TPU在內(nèi)的多種硬件后端,確保了跨平臺(tái)的兼容性和性能優(yōu)化。

在今年的亞馬遜Prime Day,vLLM在向數(shù)百萬用戶提供快速響應(yīng)中發(fā)揮了關(guān)鍵作用。它在三個(gè)區(qū)域的80,000個(gè)Trainium和Inferentia芯片上,每分鐘處理了300萬個(gè)令牌,同時(shí)保持了P99延遲在1秒以內(nèi)的首次響應(yīng)。這意味著,當(dāng)客戶與亞馬遜應(yīng)用中的Rufus聊天時(shí),他們實(shí)際上是在與vLLM互動(dòng)。

三,支持流行模型

vLLM與領(lǐng)先的模型供應(yīng)商緊密合作,支持包括Meta LLAMA、Mistral、QWen和DeepSeek在內(nèi)的流行模型。特別值得一提的是,vLLM作為首發(fā)合作伙伴,首次啟用了LLAMA 3.1(405B)模型,展示了其處理復(fù)雜和資源密集型語言模型的能力。

四,安裝與使用vLLM

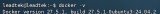

安裝vLLM非常簡單,用戶只需在命令行中運(yùn)行:

pip install vllm

vLLM既可以作為OpenAI API兼容服務(wù)器運(yùn)行,也可以作為一個(gè)簡單的函數(shù)使用。以下是如何使用vLLM生成文本的示例代碼:

vllm serve meta-llama/Llama-3.1-8B

將vLLM作為簡單函數(shù)運(yùn)行:

from vllm import LLM, SamplingParams

五,總結(jié)

隨著vLLM的加入,PyTorch生態(tài)系統(tǒng)更加強(qiáng)大,為LLM服務(wù)帶來了便捷和高效。期待vLLM在未來解鎖更多創(chuàng)新,推動(dòng)AI技術(shù)的普及和發(fā)展

如果你有更好的文章,歡迎投稿!

稿件接收郵箱:nami.liu@pasuntech.com

更多精彩內(nèi)容請(qǐng)關(guān)注“算力魔方?”!

審核編輯 黃宇

-

英特爾

+關(guān)注

關(guān)注

61文章

10279瀏覽量

179492 -

pytorch

+關(guān)注

關(guān)注

2文章

813瀏覽量

14736 -

LLM

+關(guān)注

關(guān)注

1文章

341瀏覽量

1272

發(fā)布評(píng)論請(qǐng)先 登錄

如何在NVIDIA Jetson AGX Thor上通過Docker高效部署vLLM推理服務(wù)

NVIDIA TensorRT LLM 1.0推理框架正式上線

威宏科技加入Arm Total Design生態(tài)系統(tǒng),攜手推動(dòng)AI與HPC芯片創(chuàng)新

BPI-AIM7 RK3588 AI與 Nvidia Jetson Nano 生態(tài)系統(tǒng)兼容的低功耗 AI 模塊

智慧科研新紀(jì)元:善思創(chuàng)興引領(lǐng)AI與自動(dòng)化變革

昂瑞微OM6626系列開啟Apple和Google雙生態(tài)智能尋物新紀(jì)元

vLLM Meetup上海站成功舉辦

如何在魔搭社區(qū)使用TensorRT-LLM加速優(yōu)化Qwen3系列模型推理部署

詳解 LLM 推理模型的現(xiàn)狀

深藍(lán)汽車攜手華為開創(chuàng)全民智駕新紀(jì)元

如何在光子學(xué)中利用電子生態(tài)系統(tǒng)

安森美PRISM生態(tài)系統(tǒng)助力相機(jī)開發(fā)

vLLM項(xiàng)目加入PyTorch生態(tài)系統(tǒng),引領(lǐng)LLM推理新紀(jì)元

vLLM項(xiàng)目加入PyTorch生態(tài)系統(tǒng),引領(lǐng)LLM推理新紀(jì)元

評(píng)論