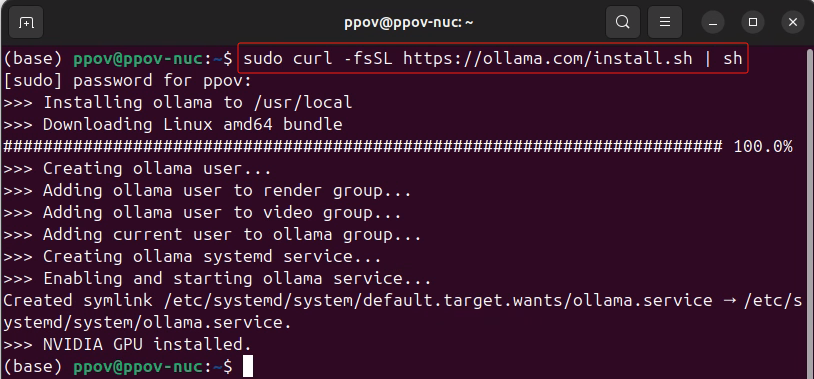

Ollama 是一個(gè)開源的大語言模型服務(wù)工具,它的核心目的是簡(jiǎn)化大語言模型(LLMs)的本地部署和運(yùn)行過程,請(qǐng)參考《Gemma 2+Ollama在算力魔方上幫你在LeetCode解題》,一條命令完成Ollama的安裝。

一,Llama3.2 Vision簡(jiǎn)介

Llama 3.2 Vision是一個(gè)多模態(tài)大型語言模型(LLMs)的集合,它包括預(yù)訓(xùn)練和指令調(diào)整的圖像推理生成模型,有兩種參數(shù)規(guī)模:11B(110億參數(shù))和90B(900億參數(shù))。Llama 3.2 Vision在視覺識(shí)別、圖像推理、字幕以及回答有關(guān)圖像的通用問題方面進(jìn)行了優(yōu)化,在常見的行業(yè)基準(zhǔn)上優(yōu)于許多可用的開源和封閉多模式模型。

二,在算力魔方4060版上完成部署

算力魔方?4060版是一款包含4060 8G顯卡的迷你主機(jī),運(yùn)行:

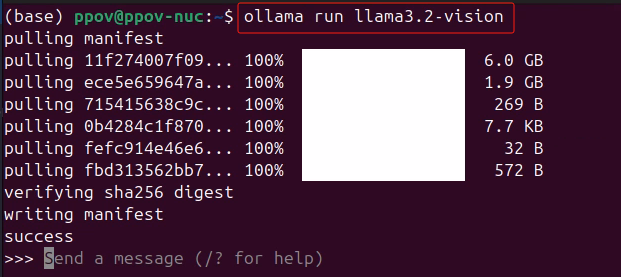

ollama run llama3.2-vision

完成Llama 3.2 Vision 11B模型下載和部署。

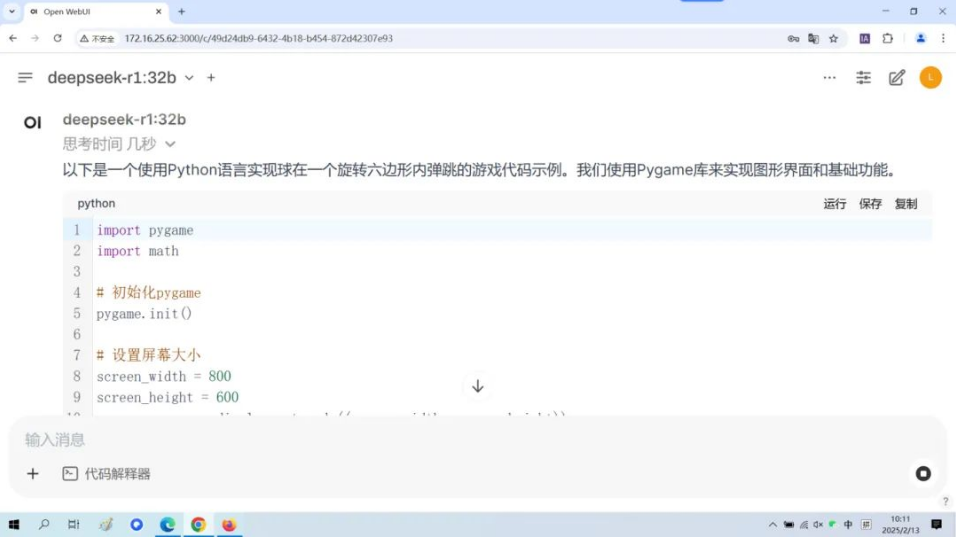

三,Llama 3.2實(shí)現(xiàn)圖片識(shí)別

將圖片輸入Llama3.2-Vision,然后直接輸入問題,即可獲得圖片信息,如下面視頻所示:

視頻若無加載,請(qǐng)移步至主頁查看關(guān)聯(lián)視頻。

四,總結(jié)

在算力魔方?4060版上,用Ollama輕松搞定Llama 3.2 Vision模型本地部署。

更多精彩內(nèi)容請(qǐng)關(guān)注“算力魔方?”!

審核編輯 黃宇

-

模型

+關(guān)注

關(guān)注

1文章

3805瀏覽量

52232 -

Vision

+關(guān)注

關(guān)注

1文章

205瀏覽量

19483

發(fā)布評(píng)論請(qǐng)先 登錄

本地部署OpenClaw,只要500元的開發(fā)板?

技嘉與趨境科技聯(lián)合部署AMaaS平臺(tái) 推動(dòng)本地大模型應(yīng)用加速落地

如何在ZYNQ本地部署DeepSeek模型

從云端到邊緣:聯(lián)發(fā)科MT8371/MT8391平臺(tái)實(shí)現(xiàn)7B大模型本地部署

【CIE全國RISC-V創(chuàng)新應(yīng)用大賽】基于 K1 AI CPU 的大模型部署落地

vision board部署模型到openmv的代碼導(dǎo)致連接超時(shí)怎么解決?

本地部署openWebUI + ollama+DeepSeek 打造智能知識(shí)庫并實(shí)現(xiàn)遠(yuǎn)程訪問

宏集HMI-4G套裝,輕松搞定“數(shù)據(jù)上云+異地遠(yuǎn)程運(yùn)維”

【VisionFive 2單板計(jì)算機(jī)試用體驗(yàn)】3、開源大語言模型部署

如何本地部署NVIDIA Cosmos Reason-1-7B模型

使用 NPU 插件對(duì)量化的 Llama 3.1 8b 模型進(jìn)行推理時(shí)出現(xiàn)“從 __Int64 轉(zhuǎn)換為無符號(hào) int 的錯(cuò)誤”,怎么解決?

【幸狐Omni3576邊緣計(jì)算套件試用體驗(yàn)】CPU部署DeekSeek-R1模型(1B和7B)

DeepSeek R1模型本地部署與產(chǎn)品接入實(shí)操

用Ollama輕松搞定Llama 3.2 Vision模型本地部署

用Ollama輕松搞定Llama 3.2 Vision模型本地部署

評(píng)論