導(dǎo)讀

2023年以ChatGPT為代表的大語言模型橫空出世,它的出現(xiàn)標(biāo)志著自然語言處理領(lǐng)域取得了重大突破。它在文本生成、對(duì)話系統(tǒng)和語言理解等方面展現(xiàn)出了強(qiáng)大的能力,為人工智能技術(shù)的發(fā)展開辟了新的可能性。同時(shí),人工智能技術(shù)正在進(jìn)入各種應(yīng)用領(lǐng)域,在智慧城市、智能制造、智慧醫(yī)療、智慧農(nóng)業(yè)等領(lǐng)域發(fā)揮著重要作用。

本期介紹:模型案例:|手機(jī)識(shí)別模型!

RT-DETR

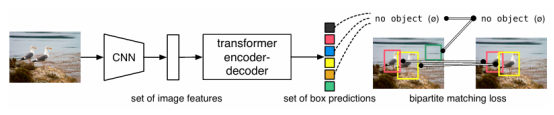

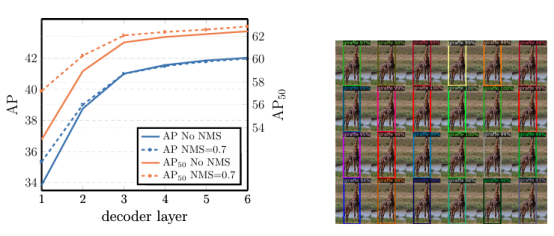

RT-DETR是基于DETR架構(gòu)的端到端對(duì)象檢測(cè)器,完全消除了對(duì)NMS的需求。通過這樣做,RT-DETR顯著減少了之前基于卷積神經(jīng)網(wǎng)絡(luò)(CNN)的對(duì)象檢測(cè)器(如YOLO系列)的延遲。它結(jié)合了強(qiáng)大的主干、混合編碼器和獨(dú)特的查詢選擇器,可以快速準(zhǔn)確地處理特征。

RT-DETR架構(gòu)的關(guān)鍵組件

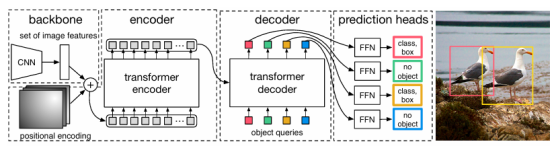

Backbone網(wǎng)絡(luò):通常采用高效的卷積神經(jīng)網(wǎng)絡(luò)(CNN)作為特征提取的基礎(chǔ),例如ResNet或EfficientNet,以獲取圖像的多尺度特征。從主干,RT-DETR提取三個(gè)級(jí)別的特征- S3,S4和S5,這些多尺度特征有助于模型理解圖像的高級(jí)和細(xì)粒度細(xì)節(jié)。

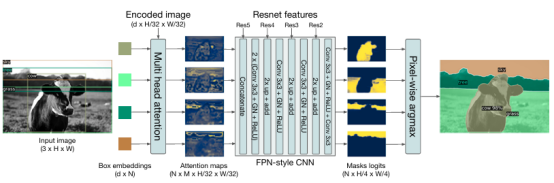

Transformer編碼器-解碼器:RT-DETR中使用了Transformer的編碼器-解碼器結(jié)構(gòu),該混合編碼器包括兩個(gè)主要部分:基于注意力的尺度內(nèi)特征交互(AIFI)和跨尺度特征融合(CCFF)。

基于注意力的尺度內(nèi)特征交互(AIFI)

這個(gè)組件的核心思想是利用自注意力機(jī)制在同一尺度內(nèi)進(jìn)行特征交互。AIFI能夠讓模型有效地捕捉同一尺度特征圖中各個(gè)位置之間的關(guān)系。

具體而言,AIFI通過計(jì)算特征的注意力權(quán)重,使得模型能夠關(guān)注到重要的區(qū)域,并抑制冗余信息,從而增強(qiáng)對(duì)目標(biāo)的定位和表征能力。

這種尺度內(nèi)的交互有助于在相似尺寸的物體之間建立聯(lián)系,提高對(duì)密集目標(biāo)的檢測(cè)能力。

跨尺度特征融合(CCFF)

CCFF負(fù)責(zé)整合來自不同尺度的特征,以便于模型能夠從多層次的信息中獲得更全面的上下文。這一過程通常涉及將來自不同尺度的特征圖進(jìn)行融合,通過卷積操作、上采樣或下采樣等方式,將這些特征進(jìn)行對(duì)齊并結(jié)合在一起。

CCFF不僅允許模型綜合不同尺度特征的優(yōu)勢(shì),還能提高對(duì)各種大小目標(biāo)的檢測(cè)能力。

多尺度特征金字塔:RT-DETR通常會(huì)借助特征金字塔網(wǎng)絡(luò)(FPN)來融合來自不同層次的特征,以加強(qiáng)對(duì)不同大小目標(biāo)的檢測(cè)能力。

目標(biāo)查詢(Object Queries):解碼器使用的目標(biāo)查詢是關(guān)鍵組件,它們用于引導(dǎo)模型對(duì)目標(biāo)的檢測(cè),允許模型在生成檢測(cè)結(jié)果時(shí)關(guān)注不同的潛在目標(biāo)。

類別和邊界框回歸:在解碼器中,RT-DETR通過類別預(yù)測(cè)和邊界框回歸來輸出目標(biāo)的類別和位置。

高效的訓(xùn)練策略:RT-DETR往往結(jié)合了一些改進(jìn)的訓(xùn)練策略,如動(dòng)態(tài)圖損失(Dynamic Loss)和圖像增強(qiáng)技術(shù),以提高模型的收斂速度和檢測(cè)精度。

后處理:如NMS(非極大值抑制)處理步驟,以去除冗余的檢測(cè)框和優(yōu)化最終的檢測(cè)結(jié)果。

手機(jī)識(shí)別模型

該 AI 模型由 Swift yolo 算法生成,專為 Seeed Studio Grove Vision AI (V2) 設(shè)備設(shè)計(jì),能夠高效識(shí)別和檢測(cè)到手機(jī)。

應(yīng)用場(chǎng)景

該模型適用于多種應(yīng)用場(chǎng)景,包括零售、安全、公共空間監(jiān)控和個(gè)人監(jiān)督。

在零售業(yè),該模型可以實(shí)時(shí)監(jiān)控手機(jī)庫存,幫助員工及時(shí)補(bǔ)貨;

在安全方面,它可以幫助識(shí)別和跟蹤丟失或被盜的手機(jī);

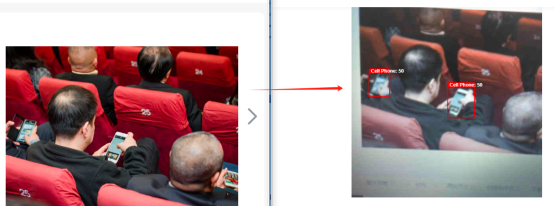

在個(gè)人監(jiān)督,很多學(xué)生上課玩手機(jī),可以通過此模型進(jìn)行監(jiān)控。

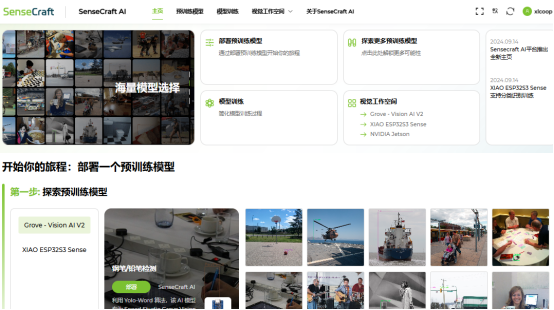

SenseCraft Al平臺(tái)

SenseCraft Al平臺(tái),是柴火母公司矽遞科技旗下的AI平臺(tái),支持Grove-Vision AI V2、XIAO ESP32S3 Sense和NVIDlA Jetson設(shè)備的模型部署、模型訓(xùn)練和數(shù)據(jù)輸出。

SenseCraft Al平臺(tái)為使用者提供海量模型,簡化模型訓(xùn)練過程并提供專業(yè)的AI視覺工作空間。

在Grove - Vision AI V2模塊上部署模型

1、打開SenseCraft AI平臺(tái),如果第一次使用請(qǐng)先注冊(cè)一個(gè)會(huì)員賬號(hào),還可以設(shè)置語言為中文。

平臺(tái)地址:

https://sensecraft.seeed.cc/ai/#/model

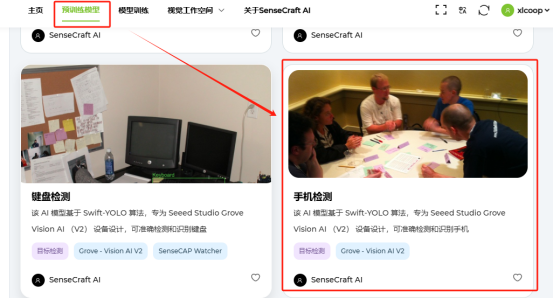

2、在頂部單擊【預(yù)訓(xùn)練模型】菜單,在公共AI模型列表中找到【手機(jī)檢測(cè)】模型,單擊此模型圖片,如下圖所示。

3、進(jìn)入【手機(jī)檢測(cè)】模型介紹頁面,單擊右側(cè)的“部署模型”按鈕,如下圖所示。

4、進(jìn)入部署手機(jī)檢測(cè)模型頁面,按提示步驟先連接攝像頭,再連接設(shè)備到電腦USB接口上,最后單擊【連接設(shè)備】按鈕,如下圖所示。

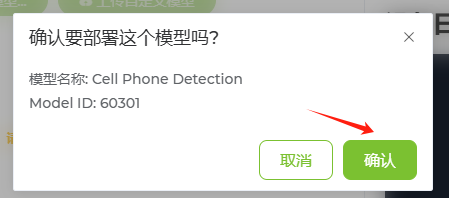

5、彈出部署模型窗口,單擊“確定”按鈕,如下圖所示。

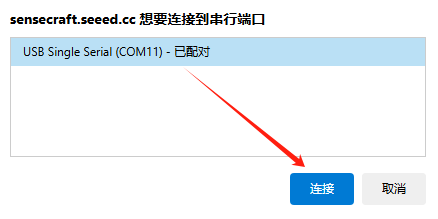

6、彈出連接到串行端口窗口,選擇端口號(hào)后單擊“連接”按鈕,如下圖所示。

7、開始進(jìn)行模型部署、固件下載、設(shè)備重啟等過程,完成后在預(yù)覽中即可看到當(dāng)前攝像頭視頻內(nèi)容,將攝像頭對(duì)準(zhǔn)手機(jī)圖片查看預(yù)測(cè)效果,如下圖所示。

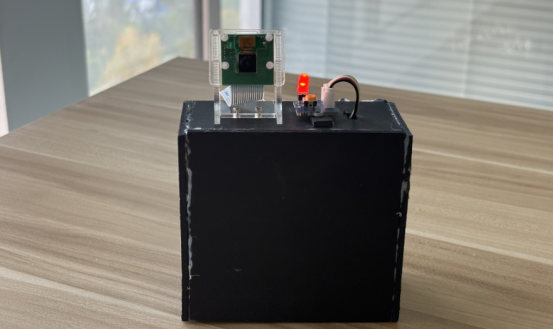

原型設(shè)計(jì)

利用此手機(jī)識(shí)別模型,設(shè)計(jì)一個(gè)桌面手機(jī)監(jiān)控裝置,此裝置在檢測(cè)到有人用手機(jī)時(shí)會(huì)點(diǎn)亮led模塊,也可改為蜂鳴器模塊進(jìn)行報(bào)警,這樣就有了一個(gè)防沉迷手機(jī)檢測(cè)裝置。

模型推理演示,請(qǐng)看如下視頻

Grove Al視覺模塊 V2套裝介紹

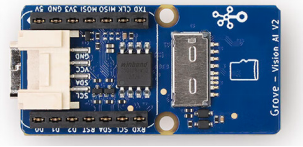

Grove Al視覺模塊 V2

OV5647-62攝像頭

Grove - Vision Al Module V2是一款拇指大小的人工智能視覺模塊, 配備Himax WiseEye2 HX6538處理器和Arm Ethos-U55嵌入式神經(jīng)網(wǎng)絡(luò)加速單元(NPU), 該處理器采用 ArmCortex-M55雙核架構(gòu)。

Arm Ethos-U55 嵌入式神經(jīng)網(wǎng)絡(luò)處理器(NPU)

嵌入式神經(jīng)網(wǎng)絡(luò)處理器(NPU)是一種特別設(shè)計(jì)用于執(zhí)行神經(jīng)網(wǎng)絡(luò)計(jì)算的高效率處理器。它主要基于數(shù)據(jù)驅(qū)動(dòng)并行計(jì)算架構(gòu),特別擅長處理視頻、圖像等大量的多媒體數(shù)據(jù)。NPU模仿了生物神經(jīng)網(wǎng)絡(luò)的架構(gòu),與CPU、GPU相比,它能夠通過更少的指令(一條或幾條)完成神經(jīng)元的處理,因此在深度學(xué)習(xí)的處理效率方面具有明顯優(yōu)勢(shì)。

它具有標(biāo)準(zhǔn)的CSI接口, 并與樹莓派相機(jī)兼容。它有一個(gè)內(nèi)置的數(shù)字麥克風(fēng)和SD卡插槽。它非常適用于各種嵌入式視覺項(xiàng)目。

有了SenseCraft Al算法平臺(tái), 經(jīng)過訓(xùn)練的ML模型可以部署到傳感器, 而不需要編碼。它兼容XIAO系列和Arduino生態(tài)系統(tǒng), 是各種物體檢測(cè)應(yīng)用的理想選擇。

主要硬件配置

- 板卡基于WiseEye2 HX6538處理器, 采用雙核ARM Cortex-M55架構(gòu)

- 配備集成Arm Ethos-U55嵌入式神經(jīng)網(wǎng)絡(luò)處理器(NPU), 兼容的樹莓派相機(jī)

- 板載PDM麥克風(fēng), SD卡插槽, Type-C, Grove接口, 豐富的外設(shè)支持樣機(jī)開發(fā)

- Seeed Studio XIAO的可擴(kuò)展性, SenseCraft Al的現(xiàn)成AI模型用于無代碼部署。

- 支持各種有效的模型, 包括MobilenetV1、MobilenetV2、 Eficientnet-Lite、Yolov5和Yolov8.

寫在最后

SenseCraft-AI平臺(tái)的模型倉數(shù)量還很少,但是好消息是它支持自定義模型上傳并輸出推理結(jié)果,平臺(tái)會(huì)逐漸增加模型倉的數(shù)量和分享有愛好者設(shè)計(jì)的模型倉原型,敬請(qǐng)關(guān)注!

-

手機(jī)

+關(guān)注

關(guān)注

36文章

6996瀏覽量

161005 -

模型

+關(guān)注

關(guān)注

1文章

3752瀏覽量

52101

原文標(biāo)題:模型案例:| 手機(jī)識(shí)別模型!

文章出處:【微信號(hào):ChaiHuoMakerSpace,微信公眾號(hào):柴火創(chuàng)客空間】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

【正點(diǎn)原子STM32N647開發(fā)板試用】--人體檢測(cè)模型體驗(yàn)

Termux手機(jī)攝像頭采集圖像/視頻流 部署 YOLO 模型推理

低成本AI邊緣計(jì)算盒子DIY:基于迅為RK3568和開源模型,輕松玩轉(zhuǎn)智能識(shí)別

如何精準(zhǔn)驅(qū)動(dòng)菜品識(shí)別模型--基于米爾瑞芯微RK3576邊緣計(jì)算盒

米爾RK3576邊緣計(jì)算盒精準(zhǔn)驅(qū)動(dòng)菜品識(shí)別模型性能強(qiáng)悍

迅為RK3568開發(fā)板模型推理測(cè)試實(shí)戰(zhàn)LPRNet?車牌識(shí)別

廣和通發(fā)布自研端側(cè)語音識(shí)別大模型FiboASR

基于LockAI視覺識(shí)別模塊:C++人臉識(shí)別

基于LockAI視覺識(shí)別模塊:C++人臉識(shí)別

手機(jī)識(shí)別模型案例

手機(jī)識(shí)別模型案例

評(píng)論