深度學(xué)習(xí)模型的魯棒性優(yōu)化是一個(gè)復(fù)雜但至關(guān)重要的任務(wù),它涉及多個(gè)方面的技術(shù)和策略。以下是一些關(guān)鍵的優(yōu)化方法:

一、數(shù)據(jù)預(yù)處理與增強(qiáng)

- 數(shù)據(jù)清洗 :去除數(shù)據(jù)中的噪聲和異常值,這是提高模型魯棒性的基礎(chǔ)步驟。異常值和噪聲可能會(huì)誤導(dǎo)模型的訓(xùn)練,導(dǎo)致模型在面對(duì)新數(shù)據(jù)時(shí)表現(xiàn)不佳。

- 數(shù)據(jù)標(biāo)準(zhǔn)化/歸一化 :將數(shù)據(jù)轉(zhuǎn)換到同一尺度上,有助于模型更好地學(xué)習(xí)數(shù)據(jù)的內(nèi)在規(guī)律,從而提高模型的泛化能力和魯棒性。

- 數(shù)據(jù)增強(qiáng) :通過對(duì)原始數(shù)據(jù)進(jìn)行變換(如旋轉(zhuǎn)、縮放、翻轉(zhuǎn)、添加噪聲等),生成更多的訓(xùn)練樣本。這不僅可以增加數(shù)據(jù)的多樣性,還可以使模型學(xué)習(xí)到更加魯棒的特征,從而提高模型對(duì)輸入變化的適應(yīng)能力。

二、正則化技術(shù)

正則化是一種在訓(xùn)練過程中引入額外約束的技術(shù),旨在減少模型的復(fù)雜度并防止過擬合。常用的正則化方法包括:

- L1正則化 :通過向損失函數(shù)中添加權(quán)重的絕對(duì)值之和作為懲罰項(xiàng),來稀疏化模型的權(quán)重,從而提高模型的魯棒性。

- L2正則化 :通過向損失函數(shù)中添加權(quán)重的平方和作為懲罰項(xiàng),來限制模型權(quán)重的大小,防止模型過于復(fù)雜而引發(fā)過擬合。

- Dropout :在訓(xùn)練過程中隨機(jī)丟棄一部分神經(jīng)元,以防止模型對(duì)特定特征的過度依賴,從而提高模型的泛化能力和魯棒性。

三、對(duì)抗訓(xùn)練

對(duì)抗訓(xùn)練是一種通過引入對(duì)抗性樣本來訓(xùn)練模型的方法。對(duì)抗性樣本是指經(jīng)過微小擾動(dòng)后能夠?qū)е履P湾e(cuò)誤分類的輸入數(shù)據(jù)。通過將這些對(duì)抗性樣本加入到訓(xùn)練數(shù)據(jù)中,可以迫使模型學(xué)習(xí)到更加魯棒的特征表示,從而提高其對(duì)抗樣本的識(shí)別能力。對(duì)抗訓(xùn)練的具體步驟包括:

- 生成對(duì)抗性樣本:通過對(duì)輸入數(shù)據(jù)施加微小的擾動(dòng)來生成對(duì)抗性樣本。

- 訓(xùn)練模型:使用包含對(duì)抗性樣本的訓(xùn)練數(shù)據(jù)來訓(xùn)練模型。

- 評(píng)估模型:在測(cè)試集上評(píng)估模型的性能,并根據(jù)需要調(diào)整訓(xùn)練策略。

四、模型集成

模型集成是指將多個(gè)模型的預(yù)測(cè)結(jié)果進(jìn)行融合,以得到更加穩(wěn)定和準(zhǔn)確的預(yù)測(cè)結(jié)果。常用的模型集成方法包括投票、平均等。通過集成多個(gè)模型,可以減少單一模型的誤差和不確定性,從而提高整體的魯棒性。模型集成的具體步驟包括:

- 訓(xùn)練多個(gè)模型:使用不同的算法、參數(shù)或數(shù)據(jù)結(jié)構(gòu)來訓(xùn)練多個(gè)模型。

- 融合預(yù)測(cè)結(jié)果:將多個(gè)模型的預(yù)測(cè)結(jié)果進(jìn)行融合,得到最終的預(yù)測(cè)結(jié)果。

- 評(píng)估集成模型:在測(cè)試集上評(píng)估集成模型的性能,并根據(jù)需要調(diào)整集成策略。

五、選擇合適的模型結(jié)構(gòu)和參數(shù)

- 選擇合適的模型結(jié)構(gòu) :根據(jù)具體任務(wù)和數(shù)據(jù)特點(diǎn)選擇合適的模型結(jié)構(gòu),避免使用過于復(fù)雜或過于簡(jiǎn)單的模型。過于復(fù)雜的模型可能會(huì)引發(fā)過擬合,而過于簡(jiǎn)單的模型可能無法充分捕捉數(shù)據(jù)的內(nèi)在規(guī)律。

- 合理設(shè)置訓(xùn)練參數(shù) :包括學(xué)習(xí)率、批大小、訓(xùn)練輪次等,確保模型能夠在訓(xùn)練過程中充分學(xué)習(xí)并避免過擬合。

六、持續(xù)監(jiān)控與更新

- 持續(xù)監(jiān)控模型性能 :在模型上線后,持續(xù)監(jiān)控其在實(shí)際應(yīng)用中的性能表現(xiàn),及時(shí)發(fā)現(xiàn)并修復(fù)潛在的問題。

- 定期更新模型 :隨著數(shù)據(jù)的積累和技術(shù)的發(fā)展,定期更新模型以適應(yīng)新的數(shù)據(jù)分布和任務(wù)需求。

綜上所述,深度學(xué)習(xí)模型的魯棒性優(yōu)化是一個(gè)多方面的任務(wù),涉及數(shù)據(jù)預(yù)處理、正則化技術(shù)、對(duì)抗訓(xùn)練、模型集成以及選擇合適的模型結(jié)構(gòu)和參數(shù)等多個(gè)方面。通過綜合運(yùn)用這些方法和技術(shù),可以有效地提高深度學(xué)習(xí)模型的魯棒性和泛化能力。

-

數(shù)據(jù)

+關(guān)注

關(guān)注

8文章

7335瀏覽量

94757 -

模型

+關(guān)注

關(guān)注

1文章

3751瀏覽量

52099 -

魯棒性

+關(guān)注

關(guān)注

2文章

48瀏覽量

13161 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5598瀏覽量

124396

發(fā)布評(píng)論請(qǐng)先 登錄

機(jī)器學(xué)習(xí)和深度學(xué)習(xí)中需避免的 7 個(gè)常見錯(cuò)誤與局限性

穿孔機(jī)頂頭檢測(cè)儀 機(jī)器視覺深度學(xué)習(xí)

瞻芯電子G2 650V SiC MOSFET的魯棒性驗(yàn)證試驗(yàn)

【團(tuán)購(gòu)】獨(dú)家全套珍藏!龍哥LabVIEW視覺深度學(xué)習(xí)實(shí)戰(zhàn)課(11大系列課程,共5000+分鐘)

【團(tuán)購(gòu)】獨(dú)家全套珍藏!龍哥LabVIEW視覺深度學(xué)習(xí)實(shí)戰(zhàn)課程(11大系列課程,共5000+分鐘)

構(gòu)建CNN網(wǎng)絡(luò)模型并優(yōu)化的一般化建議

自動(dòng)駕駛中Transformer大模型會(huì)取代深度學(xué)習(xí)嗎?

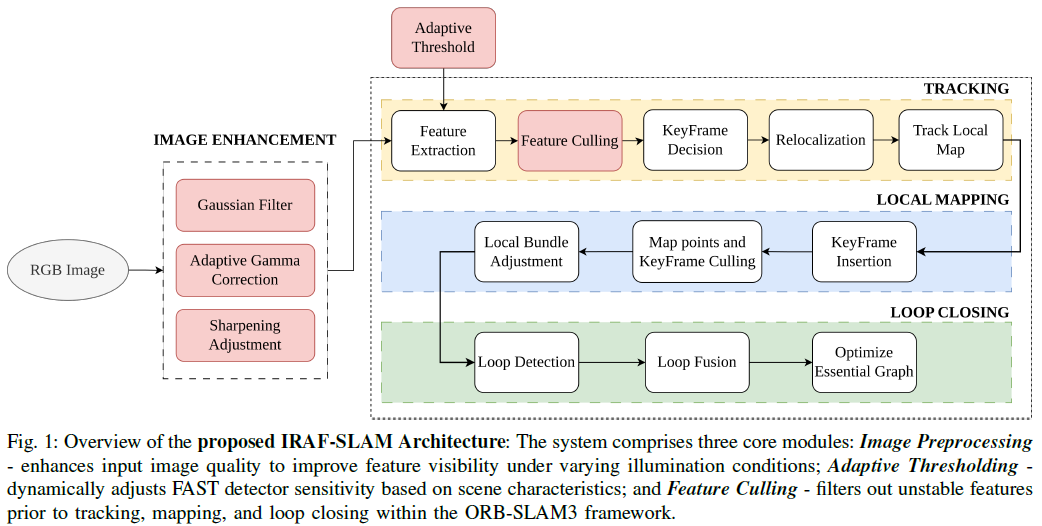

具備光照魯棒和自適應(yīng)特征剔除的VSLAM前端框架

深度學(xué)習(xí)模型的魯棒性優(yōu)化

深度學(xué)習(xí)模型的魯棒性優(yōu)化

評(píng)論