前不久OpenAI決定解散專注于AI的長期風險的“超級對齊”團隊(Superalignment team),現(xiàn)在又突發(fā)AGI團隊解散事件。OpenAI的安全政策遭業(yè)界質(zhì)疑。要知道面對越來越強大的AI技術,很多AI企業(yè)在安全政策上持續(xù)加大投入;但是OpenAI似乎在退步?要知道AI技術如果不加以控制可能會帶來災難性的后果。若缺乏有效的監(jiān)管與規(guī)劃,AGI的進展將面臨更多的不確定性與風險。現(xiàn)在;對于AGI(通用人工智能)OpenAI真的準備好了嗎?世界真的準備好了嗎?

據(jù)外媒報道,OpenAI公司正在解散其“AGI籌備”團隊,團隊負責人Miles Brundage離職,OpenAI公司的AGI團隊就OpenAI自身處理日益強大的人工智能技術的能力以及世界管理人工智能技術的準備情況向公司提供建議。

而OpenAI的AGI籌備團隊負責人Miles Brundage在周三通過Substack發(fā)布的帖子中宣布了這一消息,Miles Brundage透露已經(jīng)完成了他在OpenAI的目標。Miles Brundage想要減少偏見;可能會自己成立一家非營利組織,或加入現(xiàn)有的非營利組織,未來將專注于人工智能政策研究和倡導。

事件發(fā)生在OpenAI董事會可能計劃將公司重組為營利性企業(yè)之際;這就更讓業(yè)界擔心其安全性。以前的OpenAI是一個開源公司、非營利組織,但現(xiàn)在OpenAI似乎真的變了,OpenAI正在設法實現(xiàn)利潤最大化。

AI落地實踐的進程中;目前業(yè)界多認為在研究、開發(fā)和應用人工智能技術時,需要遵循的道德準則和社會價值觀,以確保人工智能的導向正確,如何讓引導AI;使其是受控制的;這是一個大的前提。確保AI的目標是為了讓世界變得更加美好;盡管甚至可以達到比人類更智能的AI系統(tǒng)。技術創(chuàng)新與安全性兼顧的可能性是需要重點考慮的。

-

人工智能

+關注

關注

1817文章

50095瀏覽量

265306 -

Agi

+關注

關注

0文章

101瀏覽量

10819 -

OpenAI

+關注

關注

9文章

1245瀏覽量

10064

發(fā)布評論請先 登錄

聲智科技助力第一屆產(chǎn)學結合高校通用人工智能大賽決賽圓滿落幕

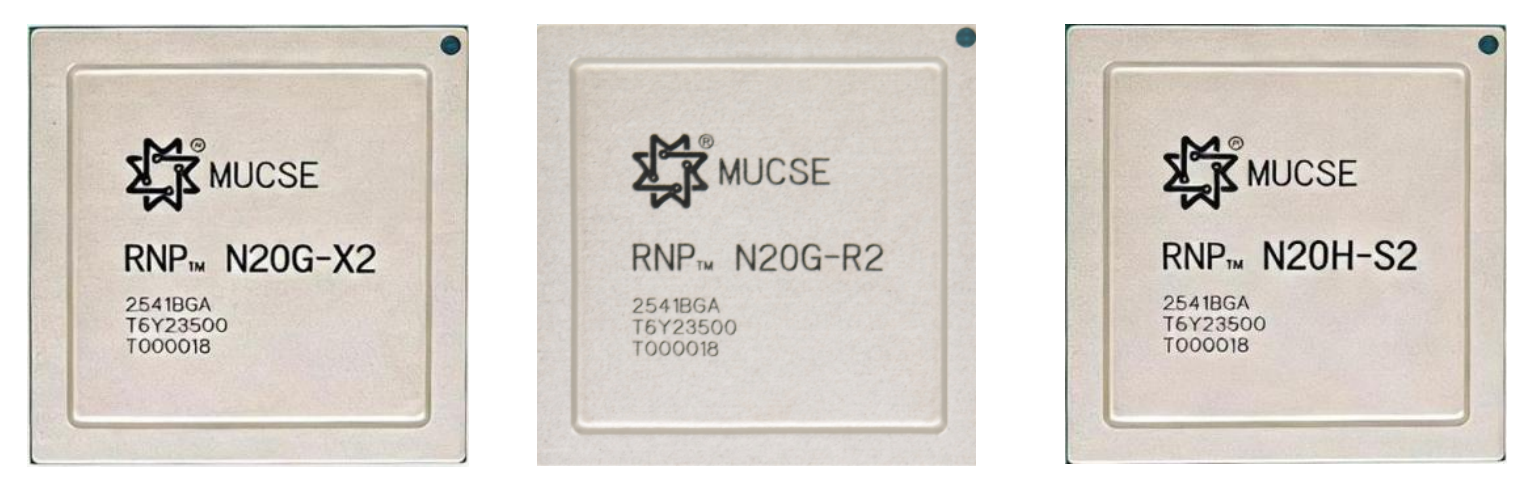

邁向AGI時代,網(wǎng)絡運力新保障,沐創(chuàng)發(fā)布100G智能網(wǎng)絡控制器芯片N20

物理人工智能面臨的安全風險

四維圖新亮相2025國際前瞻人工智能安全與治理大會

【艾為視角】保證大方向正確!利用人工智能解決一線實際問題

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+AI芯片到AGI芯片

《AI芯片:科技探索與AGI愿景》—— 勾勒計算未來的戰(zhàn)略羅盤

《AI芯片:科技探索與AGI愿景》—— 深入硬件核心的AGI指南

云天勵飛亮相2025深圳通用人工智能大會

勇藝達亮相2025深圳通用人工智能大會

挖到寶了!人工智能綜合實驗箱,高校新工科的寶藏神器

挖到寶了!比鄰星人工智能綜合實驗箱,高校新工科的寶藏神器!

中汽中心出席車用人工智能標準化促進中心成立會議

智慧路燈如何應用人工智能技術

安全政策遭質(zhì)疑 OpenAI解散AGI(通用人工智能)團隊

安全政策遭質(zhì)疑 OpenAI解散AGI(通用人工智能)團隊

評論