DeepMind 的新項目是什么?

開發機器人技術的一大挑戰,就在于必須投入大量精力來為每臺機器人、每項任務和每種環境訓練機器學習模型。近日,谷歌 DeepMind 團隊及其他 33 個研究機構正共同發起新項目,旨在創建一套通用 AI 系統來應對這個挑戰。據稱該系統能夠與不同類型的物理機器人協同運作,成功執行多種任務。

谷歌機器人部門高級軟件工程師 Pannag Sanketi 在采訪中表示,“我們觀察到,機器人在專項領域表現極佳,但在通用領域卻缺乏靈性。一般來講,大家需要為每項任務、每臺機器人和每種環境分別訓練一套模型,從零開始調整每一個變量。”

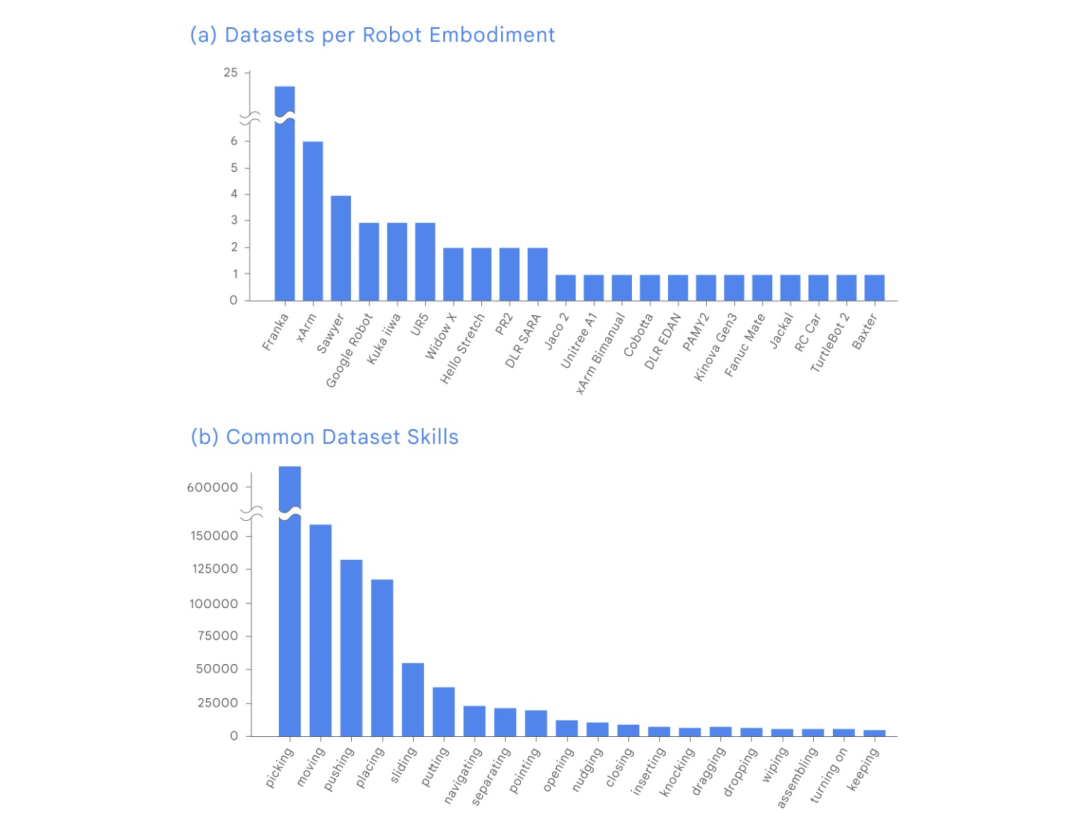

為了克服這個問題,讓機器人的訓練和部署變得更加輕松、快捷,谷歌 DeepMind 在名為 Open X-Embodiment 的大型共享數據庫項目中引入了兩大關鍵組件:一套包含了 22 種機器人類型數據的數據集,外加一系列能夠跨多種任務進行技能遷移的模型 RT-1-X(這是一個源自 RT-1 的機器人變壓器模型)。為了開發 Open X-Embodiment 數據集,研發人員在超過 100 萬個場景中展示了 500 多種技能和 150,000 項任務,因此,該數據集也是同類中最全面的機器人數據集。

此外,研究人員還在機器人實驗室和不同類型的物理裝置之上對模型進行了測試,并發現與傳統機器人訓練方法相比,新方案確實能取得更好的成績。

來自 Open X-Embodiment 數據集的樣本展示了 500 多種技能和 150,000 項任務。

Open X-Embodiment 數據集結合了跨實施例、數據集和技能的數據。

結合機器人數據

通常來講,不同類型的機器人往往擁有獨特的傳感器和執行器,所以需要配合專門的軟件模型。這就類似于不同生物體的大腦和神經系統需要專門進化,從而適應該生物的身體結構與所處環境。

但 Open X-Embodiment 的誕生卻出于這樣一條先驗性的假設:將來自不同機器人和任務的數據結合起來,就能創建一套優于專用模型的通用模型,足以驅動所有類型的機器人。這個概念在一定程度上受到大語言模型(LLM)的啟發,即在使用大型通用數據集進行訓練時,模型成果的匹配度甚至可以優于在特定數據集上訓練的小型針對性模型。而研究人員驚喜地發現,此項原理果然也適用于機器人領域。

為了創建 Open X-Embodiment 數據集,研究團隊收集了來自不同國家 20 個機構的 22 臺機器人具身的真實數據。該數據集包含超 100 萬種情節(所謂情節,是指機器人每次嘗試執行任務時所采取的一系列動作),其中具體涉及 500 多種技能和 15 萬個任務示例。

隨附的各模型均基于 Transformer,一套在大語言模型中也得以應用的深度學習架構。RT-1-X 建立在 Robotics Transformer 1(簡稱 RT-1)之上,是一套適用于在真實環境下實現機器人技術規模化的多任務模型。RT-2-X 則建立在 RT-1 后繼者 RT-2 的基礎之上——RT-2 是一種視覺語言動作(VLA)模型,能夠從機器人和網絡數據中學習,并具備響應自然語言命令的能力。

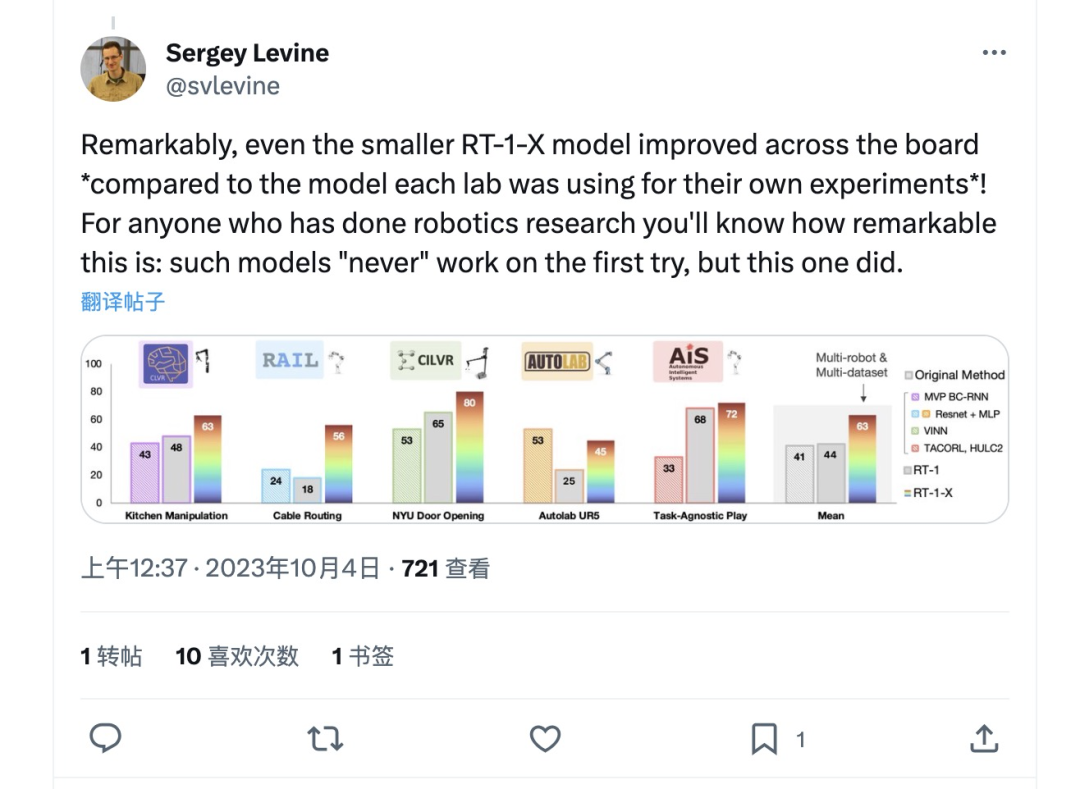

研究人員在五所不同研究實驗室的五臺常用機器人上測試了 RT-1-X 對各類任務的執行能力。與針對這些機器人開發的專用模型相比,RT-1-X 在拾取和移動物體、以及開門等任務上的成功率高出 50%。該模型還能將技能遷移至多種不同環境,這也是在特定視覺場景下訓練出的專用模型所做不到的。由此可見,由不同示例集訓練而成的模型在大多數任務中都優于專用模型。論文還提到,此模型適用于從機械手臂到四足動物在內的多種機器人。

加州大學伯克利分校副教授、論文聯合作者 Sergey Levine 寫道,“對于任何曾有機器人研究經驗的朋友來說,都能意識到這是多么了不起:這類模型「從來」就沒能第一次就嘗試成功,但這個模型卻做到了。”

值得注意的是,即使是規模較小的 RT-1-X 模型,也實現了對各實驗室內部專用模型的超越!對于任何曾有機器人研究經驗的朋友來說,都能意識到這是多么了不起:這類模型“從來”就沒能第一次就嘗試成功,但這個模型卻做到了。

在應急技能和處理訓練數據集中未涉及的新任務方面,RT-2-X 的成功率可達 RT-2 的 3 倍。具體來講,RT-2-X 在需要空間認知的任務上表現出更好的性能,例如理解“將蘋果放到布旁邊”和“將蘋果放到布上”兩種要求間的區別。

研究人員在 Open X 和 RT-X 的發布博文中寫道,“我們的結果表明,與其他平臺的數據進行聯合訓練之后,RT-2-X 獲得了原始數據集中并不具備的額外技能,使其能夠執行前所未見的新任務。”

步步邁向機器人研究的新未來

展望未來,科學家們正在考慮將這些進展與 DeepMind 開發的自我改進模型 RoboCat 的見解相結合,希望探索出新的研究方向。RoboCat 能夠學會在不同機械臂上執行各種任務,然后自動設計出新的訓練數據以提高自身性能。

Sanketi 認為,另一個潛在的研究方向,也可能是進一步研究不同數據集間的混合會如何影響跨機器人具身的能力泛化與改進效果。

該團隊目前已經開源了 Open X-Embodiment 數據集和小型 RT-1-X 模型,但并未公開 RT-2-X 模型。

Sanketi 總結道,“我們相信,這些工具將改變機器人的訓練方式,并加速該領域的研究進展。我們希望開源相關數據,并提供安全但受限的模型以減少障礙、加速研究。機器人技術的未來離不開機器人之間的相互學習,而這一切的前提,首先要求研究人員之間能夠相互學習。”

-

機器人

+關注

關注

213文章

31079瀏覽量

222255 -

AI

+關注

關注

91文章

39793瀏覽量

301405 -

數據集

+關注

關注

4文章

1236瀏覽量

26194 -

DeepMind

+關注

關注

0文章

131瀏覽量

12287

原文標題:DeepMind 全新 AI 項目曝光:可控制各類機器人,數據集有望開源

文章出處:【微信號:AI前線,微信公眾號:AI前線】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

你好,我是StackChan,超可愛的社區共創開源AI桌面機器人!

探索RISC-V在機器人領域的潛力

高精度機器人控制的核心——基于 MYD-LT536 開發板的精密運動控制方案

NVIDIA推出面向語言、機器人和生物學的全新開源AI技術

RK3576機器人核心:三屏異顯+八路攝像頭,重塑機器人交互與感知

NVIDIA 利用全新開源模型與仿真庫加速機器人研發進程

機器人競技幕后:磁傳感器芯片激活 “精準感知力”

開源鴻蒙驅動機器人與AI產業生態發展,M-Robots OS正式開源

全國首個開源鴻蒙機器人操作系統 M-Robots OS 正式開源

自制一個支持AI 控制的無刷平衡車機器人:開源項目D-BOT全攻略

【「# ROS 2智能機器人開發實踐」閱讀體驗】+內容初識

大象機器人攜手進迭時空推出 RISC-V 全棧開源六軸機械臂產品

NVIDIA 發布全球首個開源人形機器人基礎模型 Isaac GR00T N1——并推出加速機器人開發的仿真框架

DeepMind全新AI項目曝光:可控制各類機器人,數據集有望開源

DeepMind全新AI項目曝光:可控制各類機器人,數據集有望開源

評論