大型語言模型的出現極大地推動了自然語言處理領域的進步,但同時也存在一些局限性,比如模型可能會產生看似合理但實際上是錯誤或虛假的內容,這一現象被稱為幻覺(hallucination)。幻覺的存在使得大型語言模型在關鍵任務和實際應用中的可靠性受到挑戰。

模型產生幻覺可能是由于模型缺乏或錯誤地理解了相關的知識。當人類思考和記憶事物時,本體知識在我們的思維過程中扮演著重要角色。本體知識涉及類別、屬性以及它們之間的關系。它幫助我們理解世界、組織和分類信息,并且能夠推導出新的知識。對于語言模型,我們可以通過設計探測任務,模型內部的隱含知識和學習偏差。

背景介紹

為了探索大模型在預訓練階段學習到的各類知識,研究者們通過設計探針任務來對這些模型進行測試。通過模型在這些任務上的表現,我們可以了解語言模型在不同方面的學習偏差、錯誤或限制,并嘗試改進模型的性能和可靠性。然而,現有的知識探針主要研究模型對事實性知識的記憶,也就是描述具體事實、屬性和關系的知識。比如,我們知道在《西游記》中“孫悟空三打白骨精”,這就是一條具體的事實性知識。

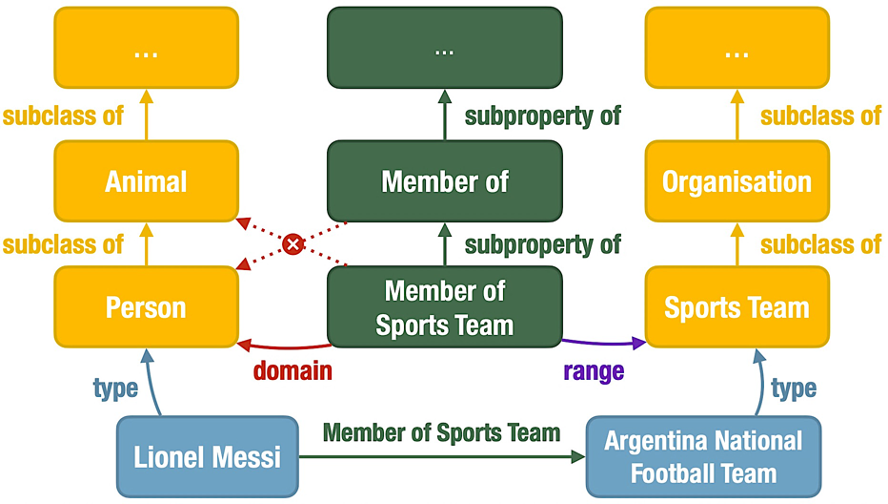

相比事實性知識,本體知識關注類和屬性、以及它們之間的關系,能夠描述概念之間的層級關系、屬性約束等關聯,為理解世界知識提供了一種結構化的方式。如下就是一個本體知識圖譜,從“孫悟空三打白骨精”這樣一條事實性知識,發散出了更多概念之間的關聯,包括實例類型(type)、子類(subclass)、子屬性(subproperty)、屬性領域(domain)和屬性范圍(range)。

本體知識可以幫助模型更好地理解現實世界中的對象及其關系,在問答等許多 NLP 任務中起著至關重要的作用。因此,探究預訓練語言模型是否記憶和理解本體知識,能夠拓展學術界對語言模型認知能力的認識,在這個大模型快速發展的時代具有重要意義。

探針方法

我們研究了基于編碼器的預訓練語言模型 BERT 和 RoBERTa,以及基于解碼器的大模型 ChatGPT。對于編碼器結構模型,我們使用基于提示詞(prompt)的探針方法,探究模型是否能夠根據未被遮蓋的上下文預測出正確的答案;而對于解碼器結構模型,我們則將需要填空的提示詞轉化成多項選擇題,探究模型是否能夠給出正確的選擇。2.1記憶任務

我們設計了五個記憶任務子測試,每個任務子測試都是為了探測預訓練語言模型對于一種本體關系的記憶能力:

1. 給定實例的類型;

2. 給定類的上級類別;

3. 給定屬性的上級屬性;

4. 給定屬性的領域約束;

5. 給定屬性的范圍約束。

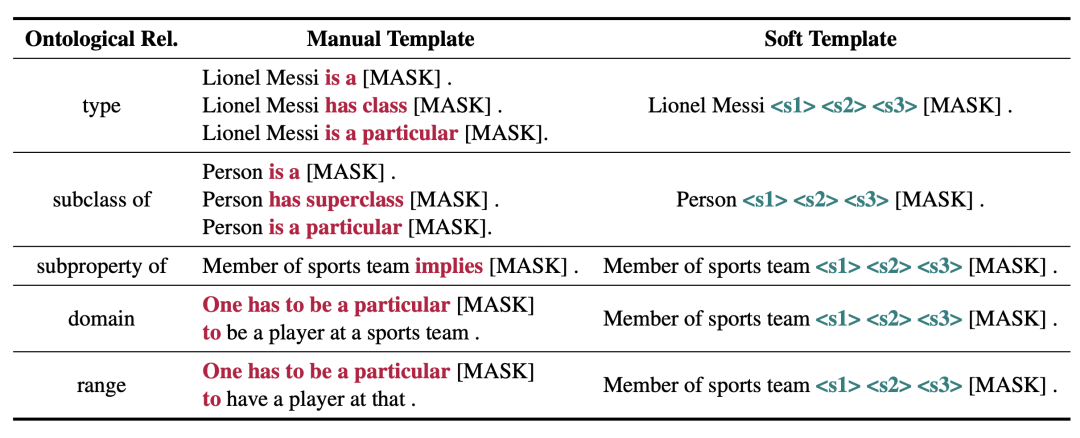

對于 BERT 模型,我們使用人工提示和可訓練的軟提示(soft prompt)進行探針測試,為每種本體關系設計了如下提示詞。模型基于對數概率預測,對候選詞進行排序。

2.2推理任務

我們根據資源描述框架模式(Resource Description Framework Schema, RDFS)中規定的規則構建推理任務,每個推理子任務探索預訓練語言模型按照一條三段論規則進行推理的能力。對于每個前提,我們區分模型輸入中是否明確包含前提,并利用記憶任務的探針結果進一步區分這個前提是否被模型記憶,探究前提的不同形式對模型推理的影響。

為了防止模型通過對假設的記憶而非推理過程得出正確結論,我們使用生造詞替換假設提示中包含的特定實例、類和屬性。對于編碼器結構的模型,我們通過創建沒有特殊語義的詞嵌入來獲得預訓練語言模型的生造詞。

實驗結果與發現

3.1記憶任務

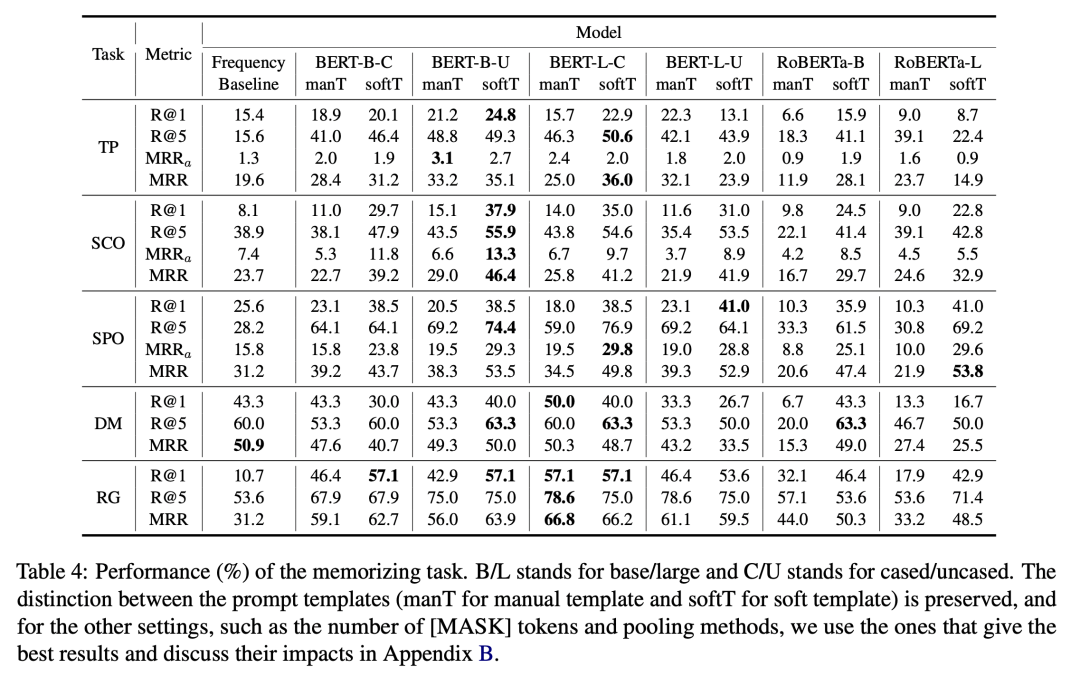

通過對實驗數據的分析,我們發現:BERT 和 RoBERTa 模型可以記憶一定的本體知識,但并不完美。

BERT和 RoBERTa 在記憶任務中擊敗了一個較強的頻率基線模型。這表明,在預訓練過程中,語言模型不僅學習了關于實體的事實性知識,而且學習了事實背后更加抽象的本體關系,這對于模型更好地組織對于世界的認識至關重要。然而,模型在五個子任務上的準確率還有很大提升空間,表明模型對本體知識記憶的局限性。

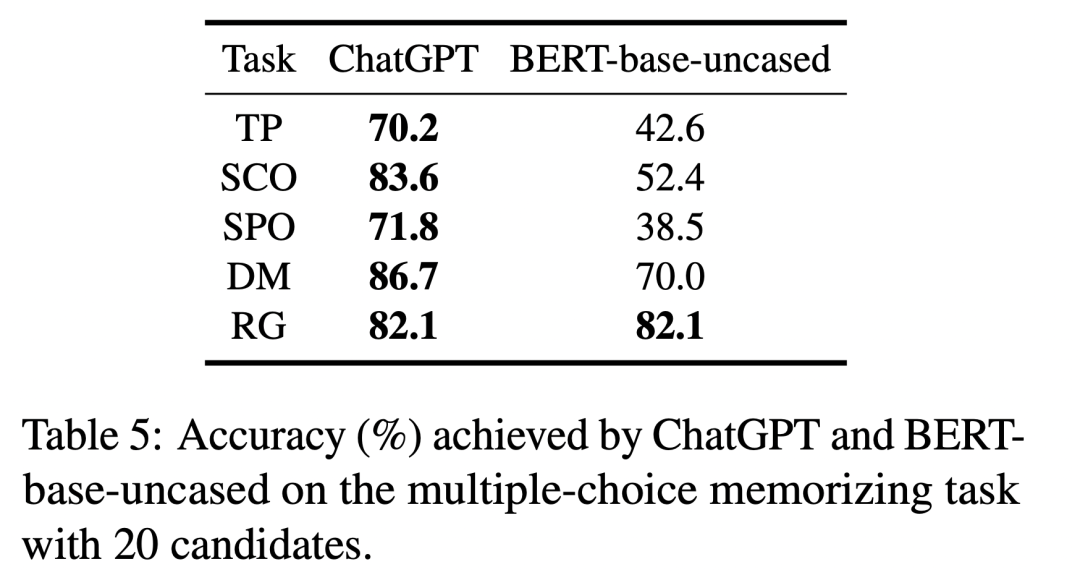

ChatGPT 相比于 BERT 模型,在記憶任務中準確率有了顯著提升。

由于多項選擇與填空的難度并不直接可比,我們將多項選擇形式的提示詞輸入給 BERT-base-uncased 模型,并與 ChatGPT 進行比較。從下表可以看出,在大多數與本體知識相關的記憶任務中,ChatGPT 在準確性方面明顯優于 BERT-base-uncased,展現出更強的本體知識記憶能力。

3.2推理任務

通過對實驗數據的分析,我們發現:BERT 和 RoBERTa 模型對本體知識的理解也是比較有限的。

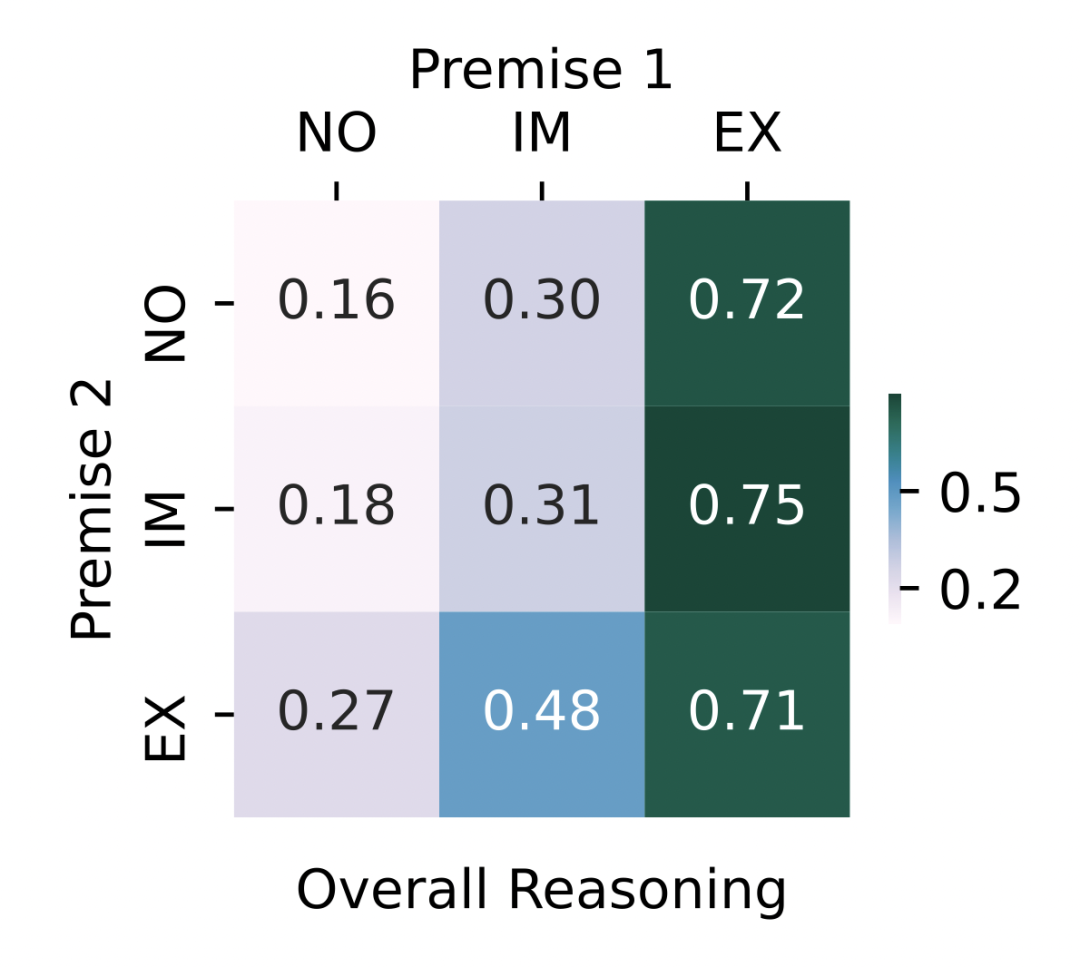

下圖展示了對所有推理規則和 BERT 與 RoBERTa 模型取平均之后的推理表現。當輸入文本中明確給出 時,模型能夠顯著提高正確答案的排名。由于 包含了需要預測的正確答案,這就使人懷疑表現的提升并非通過邏輯推理獲得的,而是因為模型傾向于預測輸入中出現的詞及相關詞匯。 當前提被隱式給定時,MRR 高于前提末給定時。這意味著一定程度上,預訓練語言模型可以利用編碼的本體知識,選擇正確的推理規則進行推理。但是,所有的前提組合都不能給出近乎完美(MRR 接近 1)的推理表現,說明預訓練語言模型對本體知識的理解能力仍具有局限性。

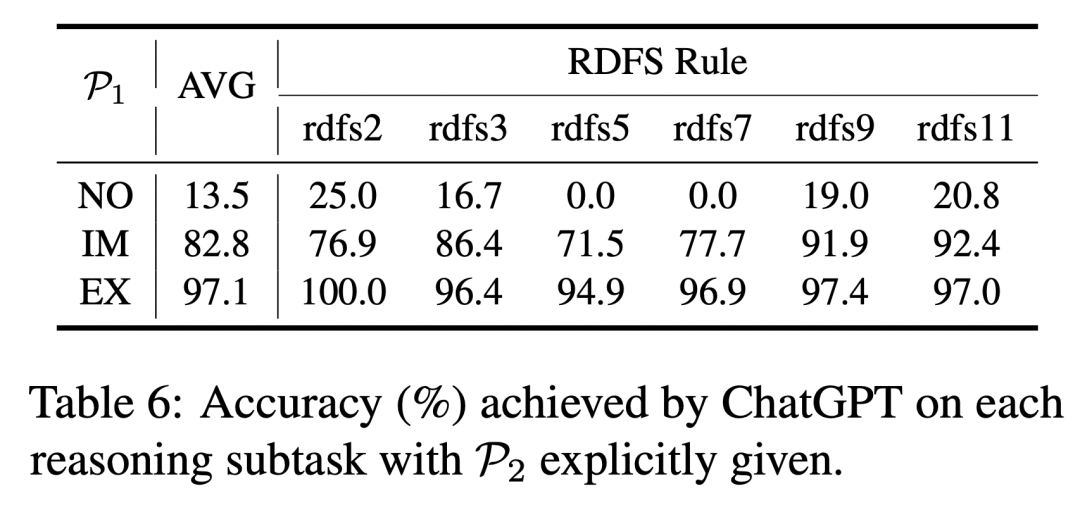

ChatGPT 具有更強大的推理和理解本體知識的能力。

當模型輸入或記憶中包含推理前提時,ChatGPT 在各項推理子任務中展現出了很高的準確性。同時,與 BERT-base-uncased 模型相比,ChatGPT 的顯式推理能力也更加優秀(97.1% vs 88.2%)。

總結

在本研究中,我們對預訓練語言模型是否能夠在預訓練過程中對本體知識進行有效編碼以及是否能夠深入理解語義內容進行了全面系統的探討,發現語言模型確實具備一定的能力來記憶和理解本體知識,并且能夠根據這些隱含的知識遵循本體知識推理規則進行一定程度的推理。然而,模型的記憶和推理都具有局限性。同時,ChatGPT 在兩個任務上的亮眼表現證明了模型對本體知識的記憶和理解仍具有進一步提升的可能。

責任編輯:彭菁

-

解碼器

+關注

關注

9文章

1218瀏覽量

43390 -

數據

+關注

關注

8文章

7335瀏覽量

94754 -

語言模型

+關注

關注

0文章

571瀏覽量

11310 -

自然語言處理

+關注

關注

1文章

630瀏覽量

14665 -

大模型

+關注

關注

2文章

3648瀏覽量

5179

原文標題:ACL 2023杰出論文 | 探測語言模型對本體知識的記憶與理解

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

【大語言模型:原理與工程實踐】探索《大語言模型原理與工程實踐》

【大語言模型:原理與工程實踐】核心技術綜述

【大語言模型:原理與工程實踐】大語言模型的基礎技術

【大語言模型:原理與工程實踐】大語言模型的評測

【大語言模型:原理與工程實踐】大語言模型的應用

基因組學大型語言模型在多項任務中均展現出卓越的性能和應用擴展空間

大型語言模型的應用

大語言模型的解碼策略與關鍵優化總結

大型語言模型在關鍵任務和實際應用中的挑戰

大型語言模型在關鍵任務和實際應用中的挑戰

評論