新一輪人工智能熱潮下,國內(nèi)大模型群雄逐鹿,目前已有超過80個大模型公開測試。而相關(guān)數(shù)據(jù)顯示,ChatGPT自發(fā)布以來,全球訪問量環(huán)比增幅持續(xù)下降,6月首次出現(xiàn)環(huán)比下滑9.7%。泡沫退去,如何在大模型時代保持市場競爭力?

針對大模型場景,昆侖芯早已在產(chǎn)品定義上作出布局,相較第一代產(chǎn)品,昆侖芯2代AI芯片可大幅優(yōu)化算力、互聯(lián)和高性能,而在研的下一代產(chǎn)品則將提供更佳的性能體驗。

在近日落幕的XceedCon2023人工智能芯片生態(tài)大會上,昆侖芯大模型端到端解決方案正式發(fā)布,該解決方案隨即入選2023世界人工智能大會卓越人工智能引領(lǐng)者獎(Super AI Leader,簡稱SAIL獎)TOP30榜單。

昆侖芯副總裁王勇、昆侖芯互聯(lián)網(wǎng)行業(yè)總經(jīng)理王志鵬先后在XceedCon2023人工智能芯片生態(tài)大會、2023世界人工智能大會對昆侖芯大模型端到端解決方案進行發(fā)布與推介。本篇以下內(nèi)容整理自現(xiàn)場實錄。

軟硬協(xié)同、技術(shù)創(chuàng)新

打造高性能產(chǎn)品矩陣

集十余年AI加速領(lǐng)域研發(fā)積累,昆侖芯核心團隊于2017年在Hot Chips上發(fā)布自研、面向通用人工智能計算的芯片核心架構(gòu)——昆侖芯XPU。目前,已有兩代昆侖芯AI芯片基于該架構(gòu)實現(xiàn)量產(chǎn)和規(guī)模部署。

昆侖芯XPU專為密集型計算而設(shè)計,相比GPU可提供更多AI加速單元,同時支持C/C++、類CUDA語法編程,兼具高性能和可編程性,適配幾乎所有主流AI場景,滿足不同行業(yè)的大模型訓推需求。

大模型的演進必將伴隨參數(shù)量的增加,更加依賴于分布式訓練與推理能力。昆侖芯2代系列產(chǎn)品搭載新一代核心架構(gòu)XPU-R,性能相較一代提升2-3倍,在分布式場景中優(yōu)勢明顯。

01.

大顯存

昆侖芯2代產(chǎn)品擁有32GB顯存容量,在同價位產(chǎn)品中內(nèi)存優(yōu)勢突出。

02.

高互聯(lián)

昆侖芯通過領(lǐng)先技術(shù),可實現(xiàn)單機八卡高速互聯(lián),帶寬達到200GB/s;支持Direct RDMA,可實現(xiàn)跨機間低延時、高速通訊。

昆侖芯推出針對不同參數(shù)級別的大模型產(chǎn)品矩陣,兼具顯存和算力成本優(yōu)勢。

昆侖芯AI加速卡R200-8F面向百億以內(nèi)參數(shù)量級,相比同類型產(chǎn)品性能提升20%;

昆侖芯AI加速器組R480-X8面向百億至千億參數(shù)量級,性能達到同類型產(chǎn)品的1.3倍以上;

昆侖芯AI加速器組R480-X8集群針對千億以上參數(shù)量級,可實現(xiàn)多機多卡分布式推理。

昆侖芯大模型解決方案軟件棧

軟件生態(tài)層面,昆侖芯提供了針對大模型場景的專用加速庫、豐富的云原生插件,支持文心一言、LLaMA、Bloom、ChatGLM、GPT等行業(yè)主流大模型。

昆侖芯XFT(XPU Fast Transformer)推理加速庫,較原生框架小算子版本性能提升5倍以上。目前,XFT加速庫已與百度飛槳、PyTorch等主流深度學習框架完成適配;

昆侖芯云原生插件可幫助用戶快速完成和大模型平臺的適配;同時提供昆侖芯SDK,幫助用戶快速完成適配和實時自定義開發(fā)。

昆侖芯xHuggingface開源推理套件

此外,昆侖芯全面擁抱開源社區(qū),積極攜手生態(tài)伙伴構(gòu)建軟硬一體的AI芯片生態(tài)。

昆侖芯打造了xHuggingface開源推理套件,僅修改1-2行代碼,即可快速搭建基于XPU的智能客服APP。同時,昆侖芯與飛槳PaddlePaddle的AI Studio社區(qū)緊密合作,基于xHuggingface開源推理套件向廣大開發(fā)者提供更快、更強、更省的算力產(chǎn)品;

昆侖芯與飛槳深入?yún)f(xié)同適配行業(yè)主流大模型,可支持超大規(guī)模分布式訓練與推理。針對稠密大模型,昆侖芯支持飛槳的Sharding并行、數(shù)據(jù)并行、模型并行、流水線并行四種并行方式;針對稀疏大模型,昆侖芯與飛槳共同打造大規(guī)模參數(shù)服務(wù)器架構(gòu),實現(xiàn)了萬億參數(shù)的大模型訓練。

深入場景、真實歷練

打磨端到端解決方案

昆侖芯深入了解不同應用場景下客戶的真實需求,憑借軟硬協(xié)同技術(shù)與高性能產(chǎn)品矩陣,為千行百業(yè)提供開箱即用的產(chǎn)品和全棧式AI服務(wù)。

大語言模型場景

昆侖芯推理加速方案

目前,昆侖芯已與業(yè)界主流開源大模型完成適配,向客戶開放開源軟件庫,供客戶進行二次修改、微調(diào),滿足不同推理場景下的個性化定制需求。

GPT百億參數(shù)大模型場景:昆侖芯產(chǎn)品的QPS相比主流165W產(chǎn)品提高30%以上,同時首字時延更低。

文心一格:目前已大規(guī)模應用昆侖芯產(chǎn)品,成本降低的同時,可實現(xiàn)2秒快速出圖。

昆侖芯訓練產(chǎn)品總覽

針對大語言模型訓練場景,昆侖芯也可提供一整套精調(diào)的訓練策略。目前,昆侖芯已適配pretrain、post-pretrain、SFT、LoRA等模型,可根據(jù)客戶的數(shù)據(jù)量與計算資源情況,靈活推薦不同的訓練模式。

能源行業(yè):昆侖芯解決方案通過SFT訓練模式,客戶僅使用少量數(shù)據(jù)即可2天打造專屬行業(yè)大模型。

智源研究院:昆侖芯和智源研究院在大模型方面已有深入合作。昆侖芯已完成和Aquila大語言模型推理任務(wù)的適配、精度調(diào)試和性能優(yōu)化,并實現(xiàn)大規(guī)模分布式推理上線,訓練任務(wù)適配優(yōu)化中;同時也適配了智源eva視覺大模型,初步驗證了大規(guī)模分布式預訓練能力。

稀疏大模型推薦場景

稀疏大模型存在訓練門檻高、算力消耗大等技術(shù)挑戰(zhàn)。對于算法和模型持續(xù)高頻迭代的推薦場景,昆侖芯始終將“安全可信”、“從GPU零成本無縫遷移”作為目標,實現(xiàn)訓練與推理系統(tǒng)的緊密耦合,為客戶降本增效。目前,昆侖芯已與互聯(lián)網(wǎng)頭部客戶完成了訓練場景的端到端聯(lián)合開發(fā),并在TB級以上稀疏大模型上完成了“替換主流GPU的全量上線”。

大模型的持續(xù)迭代加速了我國AI技術(shù)及AI產(chǎn)業(yè)的演進,利好政策的相繼出臺同時開啟了我國大模型商用浪潮。面向未來,昆侖芯將始終堅持軟硬協(xié)同創(chuàng)新,夯實AI領(lǐng)域綜合優(yōu)勢,加速大模型產(chǎn)業(yè)落地,勇立大模型時代潮頭。

責任編輯:彭菁

-

gpu

+關(guān)注

關(guān)注

28文章

5194瀏覽量

135450 -

開源

+關(guān)注

關(guān)注

3文章

4207瀏覽量

46139 -

昆侖芯科技

+關(guān)注

關(guān)注

0文章

40瀏覽量

1094

原文標題:來了!一文讀懂昆侖芯大模型端到端解決方案

文章出處:【微信號:昆侖芯科技,微信公眾號:昆侖芯科技】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

智譜AI正式上線并開源全新一代大模型GLM-5

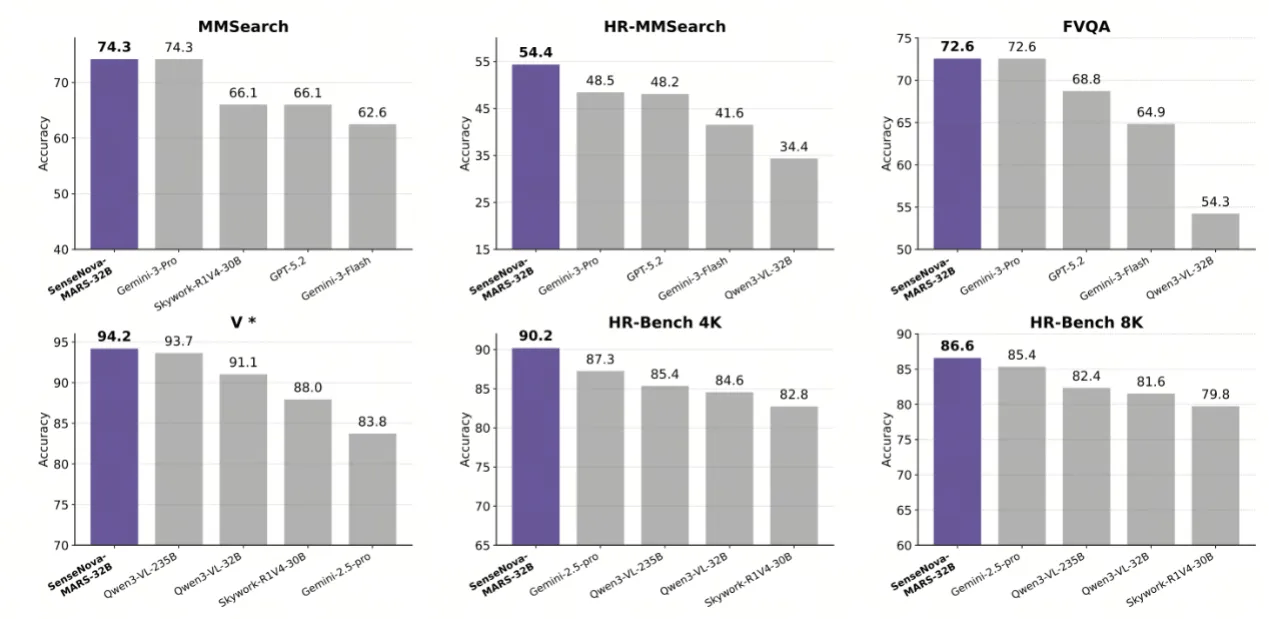

商湯開源SenseNova-MARS:突破多模態(tài)搜索推理天花板

昆侖芯科技亮相2025中國移動供應鏈生態(tài)合作大會

昆侖芯R200 AI加速卡技術(shù)規(guī)格解析

邁向云端算力巔峰:昆侖芯K200 AI加速卡全面解讀

專為邊緣而生:深度解析昆侖芯K100 AI加速卡,釋放128 TOPS極致能效

昆侖芯超節(jié)點亮相,單卡性能提升95%

昆侖芯重磅打造xHuggingface開源推理套件

昆侖芯重磅打造xHuggingface開源推理套件

評論