大模型是AI開發的新范式,是人工智能邁向通用智能的里程碑:大模型指通過在大規模寬泛的數據上進行訓練后能適應一系列下游任務的模型,本質依舊是基于統計學的語言模型,只不過“突現能力”賦予其強大的推理能力。大模型的訓練和推理都會用到AI芯片的算力支持,在數據和算法相同情況下,算力是大模型發展的關鍵,是人工智能時代的“石油”。

1.算法:大模型——人工智能邁向通用智能的里程碑

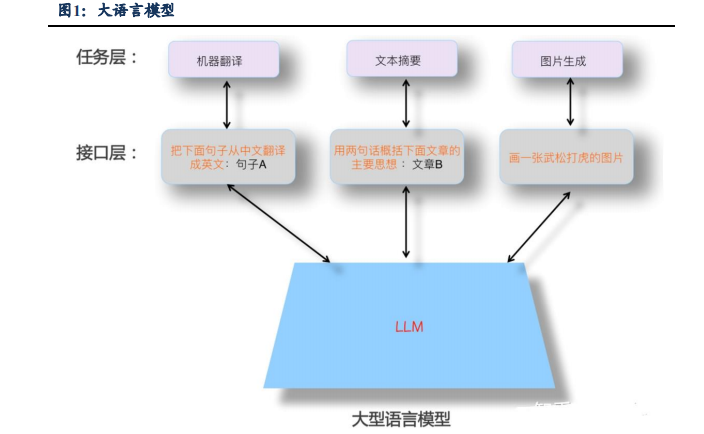

大模型就是Foundation Model(基礎模型),指通過在大規模寬泛的數據上進行訓練后能適應一系列下游任務的模型。大模型兼具“大規模”和“預訓練”兩種屬性,面向實際任務建模前需在海量通用數據上進行預先訓練,能大幅提升人工智能的泛化性、通用性、實用性,是人工智能邁向通用智能的里程碑技術。

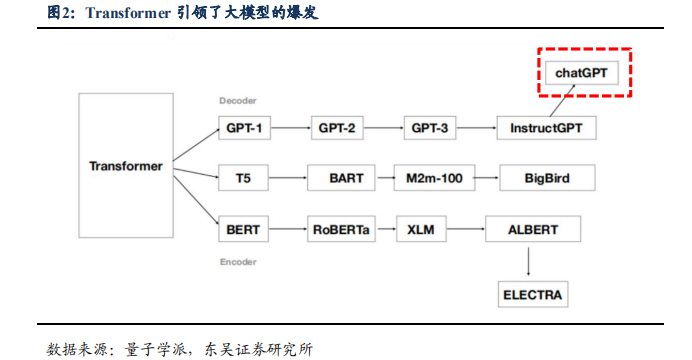

大模型的本質依舊是基于統計學的語言模型,“突現能力”賦予其強大的推理能力。當前幾乎所有參數規模超過千億的大語言模型都采取GPT模式。近些年來,大型語言模型研究的發展主要有三條技術路線:Bert模式、GPT模式以及混合模式。Bert模式適用于理解類、做理解類、某個場景的具體任務,專而輕,2019年后基本上就沒有什么標志性的新模型出現;混合模式大部分則是由國內采用;多數主流大語言模型走的還是GPT模式,2022年底在GPT-3.5的基礎上產生了ChatGPT,GPT技術路線愈發趨于繁榮。

GPT4作為人工智能領域最先進的語言模型,在如下四個方面有較大的改進。

1)多模態:GPT4可以接受文本和圖像形式的prompt,在人類給定由散布的文本和圖像組成的輸入的情況下生成相應的文本輸出(自然語言、代碼等);

2)多語言:在測試的26種語言的24種中,GPT-4優于GPT-3.5和其他大語言模型(Chinchilla,PaLM)的英語語言性能;

3)“記憶力”:GPT-4的最大token數為32,768,即2^15,相當于大約64,000個單詞或50頁的文字,遠超GPT-3.5和舊版ChatGPT的4,096個token;

4)個性化:GPT-4比GPT-3.5更原生地集成了可控性,用戶將能夠將“具有固定冗長、語氣和風格的經典ChatGPT個性”更改為更適合他們需要的東西。

2.算力:AI訓練的基礎設施

大模型算力成本主要分為初始訓練成本和后續運營成本。

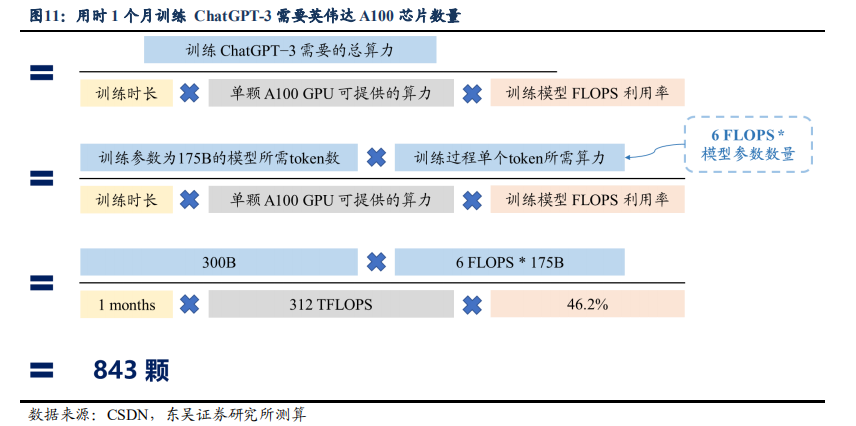

初始訓練:根據openAI官網數據,每個token(token是服務端生成的一串字符串,以作客戶端進行請求的一個令牌)的訓練成本通常約為6N FLOPS(FLOPS指每秒浮點運算次數,理解為計算速度,可以用來衡量硬件的性能),其中N是LLM(大型語言模型)的參數數量。1750億參數模型的GPT-3是在3000億token上進行訓練的。根據openAI官網數據,在訓練過程中,模型的FLOPS利用率為46.2%。我們假設訓練時間為1個月,采用英偉達A100進行訓練計算(峰值計算能力為312 TFLOPS FP16/FP32),則測算結果為需要843顆英偉達A100芯片。

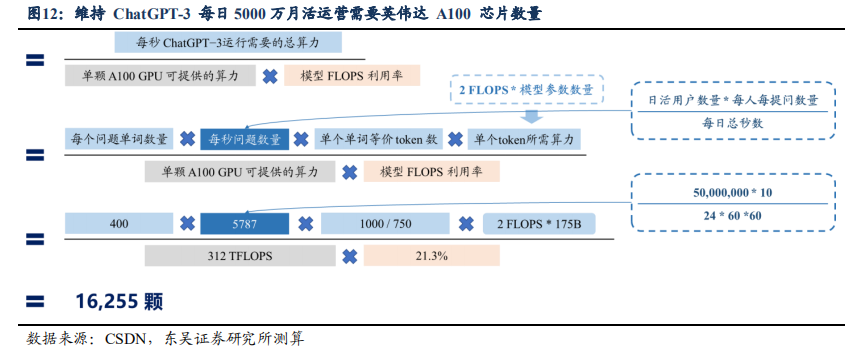

運營(推理)成本:運營階段所需算力量與使用者數量緊密相關。根據openAI官網數據,每個token的推理成本通常約為2N FLOPS,其中N是LLM的參數數量。根據openAI官網數據,在訓練過程中,模型的FLOPS利用率為21.3%。同樣采用英偉達A100進行推理計算(峰值計算能力為312 TFLOPS FP16/FP32)。我們假設GPT-3每日5000萬活躍用戶,每個用戶提10個問題,每個問題回答400字,則測算結果為需要16255顆英偉達A100芯片。

GPT-4為多模態大模型,對算力要求相比GPT-3會提升10倍。GPT-4的收費是8kcontext為$0.03/1k token,是GPT-3.5-turbo收費的15倍($0.002 / 1K tokens),因此我們推斷GPT-4的參數量是GPT-3的10倍以上,預計GPT-4的算力需求是GPT-3的10倍以上。

國產大模型有望帶動國內新增A100出貨量超200萬顆,使得中國算力市場空間增加2倍以上。我們假設國內百度,華為,阿里,騰訊,字節等前10位頭部大廠都會發布自己的大模型。

加速卡國產化率較低,美國制裁加速。根據IDC數據,2021年,中國加速卡市場中Nvidia占據超過80%市場份額。

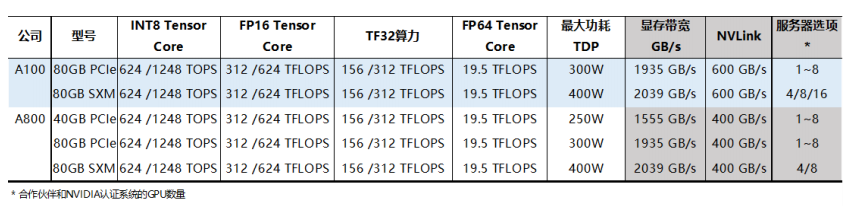

英偉達推出中國特供版A800,算力與A100基本一致。2022年11月8日,英偉達推出A800 GPU,將是面向中國客戶的A100 GPU的替代產品。A800符合美國政府關于減少出口管制的明確測試,并且不能通過編程來超過它。A800 GPU在算力上與A100保持一致,但增加了40GB顯存的PCIe版本,但在NVLink互聯速度上,A800相較于A100下降了200GB/s的速度。同時,A800 80GB SXM版本目前已經不支持16塊GPU的成套系統,上限被限制在8塊。總的來看,A800能夠滿足國內市場需求,是A100的平替版本。

3.數據:AI發展的驅動力

數據資源是AI產業發展的重要驅動力之一。數據集作為數據資源的核心組成部分,是指經過專業化設計、采集、清洗、標注和管理,生產出來的專供人工智能算法模型訓練的數據。

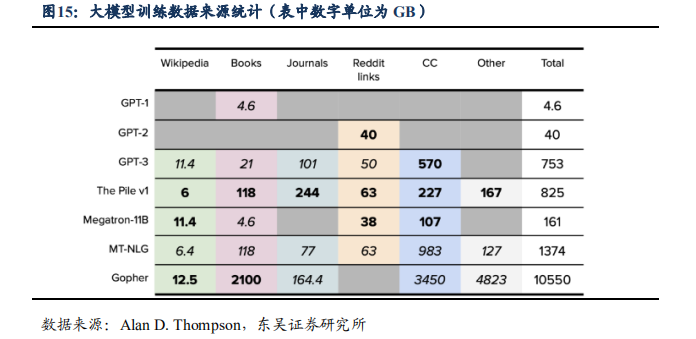

大模型的訓練數據主要來自于維基百科、書籍、期刊、Reddit社交新聞站點、Common Crawl和其他數據集。OpenAI雖沒有直接公開ChatGPT的相關訓練數據來源和細節,但可以從近些年業界公布過的其他大模型的訓練數據推測出ChatGPT的訓練數據來源,近幾年大模型訓練采用的數據來源基本類似。國內大模型的數據來源和自身優勢業務有較強相關性,如百度文心一言大模型的來源主要基于互聯網公開數據,包括網頁、搜索、圖片、語音日均調用數據,以及知識圖譜等。

GPT4依靠大量多模態數據訓練。GPT4是一個大規模的多模態模型,相比于此前的語言生成模型,數據方面最大的改進之一就是突破純文字的模態,增加了圖像模態的輸入,具有強大的圖像理解能力,即在預練習階段輸入任意順序的文本和圖畫,圖畫經過Vision Encoder向量化、文本經過普通transformer向量化,兩者組成多模的句向量,練習目標仍為next-word generation。根據騰訊云開發者推測,GPT4訓練數據中還額外增加了包含正誤數學問題、強弱推理、矛盾一致陳述及各種意識形態的數據,數據量可能是GPT3.5(45TB數據)的190倍。

4.應用:AI的星辰大海

AI時代已經來臨,最大的市場將是被AI賦能的下游應用市場。如果說AI是第四次工業革命,那么正如前三次工業革命,最大的市場將是被AI賦能的下游應用市場。本輪革命性的產品ChatGPT將極大地提升內容生產力,率先落地于AIGC領域,打開其產業的想象邊界。文本生成、代碼生成、圖像生成以及智能客服將是能直接賦予給下游行業的能力,打開其產業想象的邊界。

最直接的應用在內容創作領域。ChatGPT的功能核心是基于文本的理解和分析,與內容創作行業趨同。ChatGPT可用于創建新聞文章、博客文章甚至小說等內容,它可以生成原創且連貫的內容,為內容創作者節省時間和資源。整體生成式AI已用于創建圖像,視頻,3D對象,Skyboxes等。這大大節省了創作時間,同時帶來了多樣的創作風格。

ChatGPT解決了機器人的痛點。ChatGPT開啟了一種新的機器人范式,允許潛在的非技術型用戶參與到回路之中,ChatGPT可以為機器人場景生成代碼。在沒有任何微調的情況下,利用LLM的知識來控制不同的機器人動作,以完成各種任務。ChatGPT大大改善了機器人對指令的理解,并且不同于以前單一、明確的任務,機器人可以執行復合型的任務。

ChatGPT在芯片設計領域的應用。傳統的芯片設計強烈依賴模板而忽視了大量可以復用的優秀數據,同時數據量大導致ChatGPT泛化性更好。此外芯片硬件模塊相對單一,有一些成熟范式,芯片設計代碼復雜但人工不足,這些都與ChatGPT有很好的互補。AI使得芯片開發成本降低、周期縮短,具備足夠多訓練數據和AI能力的芯片設計公司競爭優勢可能會擴大。

審核編輯 :李倩

-

算法

+關注

關注

23文章

4784瀏覽量

98060 -

人工智能

+關注

關注

1817文章

50098瀏覽量

265384 -

ai技術

+關注

關注

1文章

1313瀏覽量

25747

原文標題:2023年AI技術科普:算法、算力、數據及應用

文章出處:【微信號:架構師技術聯盟,微信公眾號:架構師技術聯盟】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

五年完成從0到1,國產TPU的算力突圍

2025年曙光存儲以先進存力構建開放的算力底座并加速AI進化

云天勵飛出席GAIR 2025 AI算力新十年專場

華為發布AI容器技術Flex:ai,算力平均利用率提升30%

2023年AI技術科普:算法、算力、數據及應用

2023年AI技術科普:算法、算力、數據及應用

評論