深度學(xué)習(xí):神經(jīng)網(wǎng)絡(luò)算法的昨天、今天和明天

2016年,人工智能軟件包AlphaGo擊敗韓國圍棋大師李世石。圍棋是一種兩人抽象戰(zhàn)略棋盤游戲,其目標(biāo)是用棋子包圍比對手更多的領(lǐng)土。2017年,經(jīng)過改進(jìn)的新版AlphaGo(AlphaGo Master)擊敗了世界圍棋第一人柯潔。這種新穎的人工智能 (AI) 系統(tǒng)并沒有依靠先前建立的策略來擊敗人類對手,而是在某些特定領(lǐng)域似乎超越了人類的認(rèn)知,甚至表現(xiàn)出了一定的思考能力,有效地縮小了當(dāng)前技術(shù)水平與現(xiàn)有技術(shù)之間的差距。流行文化想象人工智能可以。

過去,人工智能一直像是遙遠(yuǎn)的科幻小說。但當(dāng)今世界很多技術(shù)的應(yīng)用已經(jīng)達(dá)到了堪稱人工智能的水平。除了前面提到的圍棋軟件外,最近還部署了一系列人工智能系統(tǒng)并取得了巨大的效果,包括自動駕駛系統(tǒng)、智能管家,甚至還有蘋果智能手機(jī)捆綁的語音助手 Siri。這些應(yīng)用背后的核心算法是深度學(xué)習(xí),它是機(jī)器學(xué)習(xí)最熱門的分支之一。與其他機(jī)器學(xué)習(xí)算法不同,深度學(xué)習(xí)依賴于對大量數(shù)據(jù)進(jìn)行迭代訓(xùn)練來發(fā)現(xiàn)數(shù)據(jù)的特征并提供相應(yīng)的結(jié)果。其中許多特征已經(jīng)超越了人類定義特征的表達(dá)能力,

然而,深度學(xué)習(xí)尚未在所有方面超越人類。相反,它完全取決于人類對所使用算法的設(shè)計決策。深度學(xué)習(xí)從誕生到結(jié)出我們今天看到的果實(shí),大約用了 50 年的時間。它的發(fā)展歷史讓我們得以一窺計算機(jī)科學(xué)家一絲不茍的獨(dú)創(chuàng)性,并提供了一個機(jī)會來討論這個令人興奮的領(lǐng)域的發(fā)展方向。

什么是深度學(xué)習(xí)?

深度學(xué)習(xí)利用所謂的人工神經(jīng)網(wǎng)絡(luò) (ANN)。盡管神經(jīng)網(wǎng)絡(luò)算法的名稱來源于它們模擬動物神經(jīng)元如何傳輸信息的事實(shí),但深度學(xué)習(xí)一詞來自所涉及的多層級聯(lián)神經(jīng)元——允許在信息傳輸中實(shí)現(xiàn)深度的多個層.

在動物中,神經(jīng)的一端連接到受體,另一端連接到動物的皮層,信號通過中間的多層神經(jīng)元傳導(dǎo)。神經(jīng)元實(shí)際上并不是一對一連接的,而是有多個連接(如輻射連接和收斂連接),從而形成網(wǎng)絡(luò)結(jié)構(gòu)。這種豐富的結(jié)構(gòu)最終使得信息的提取和動物大腦中相應(yīng)認(rèn)知的產(chǎn)生成為可能。動物的學(xué)習(xí)過程需要在大腦中整合外部信息。外部信息進(jìn)入神經(jīng)系統(tǒng),神經(jīng)系統(tǒng)又變成大腦皮層可以接收的信號。將信號與大腦中的現(xiàn)有信息進(jìn)行比較,從而可以建立完整的認(rèn)知。

同樣,使用計算機(jī)編程技術(shù),計算機(jī)科學(xué)家允許包含某些參數(shù)和權(quán)重的函數(shù)層來模擬神經(jīng)元的內(nèi)部操作,使用非線性操作的疊加來模擬神經(jīng)元之間的連接,并最終重新整合信息以產(chǎn)生分類或預(yù)測結(jié)果作為輸出。為了處理神經(jīng)網(wǎng)絡(luò)輸出與真實(shí)世界結(jié)果之間的差異,神經(jīng)網(wǎng)絡(luò)通過梯度逐層調(diào)整相應(yīng)的權(quán)重以減少差異,從而實(shí)現(xiàn)深度學(xué)習(xí)。

深度學(xué)習(xí)的起源

令人驚訝的是,模擬動物的神經(jīng)活動并不是深度學(xué)習(xí)的專有領(lǐng)域。早在 1957 年,F(xiàn)rank Rosenblatt 就提出了感知器的概念。感知器實(shí)際上是一個單層神經(jīng)網(wǎng)絡(luò),只能區(qū)分兩種類型的結(jié)果。該模型非常簡單,輸出和輸入信息之間的關(guān)系本質(zhì)上是一個加權(quán)和。雖然權(quán)重直接根據(jù)輸出與真實(shí)值的差自動調(diào)整,但整個系統(tǒng)的學(xué)習(xí)能力有限,只能用于簡單的數(shù)據(jù)擬合。

幾乎與此同時,神經(jīng)科學(xué)也出現(xiàn)了重大進(jìn)展。神經(jīng)科學(xué)家 David Hubel 和 Torsten Wiesel 對貓的視覺神經(jīng)系統(tǒng)進(jìn)行的研究證實(shí),大腦皮層對視覺特征的反應(yīng)是由不同的細(xì)胞完成的。在他們的模型中,簡單細(xì)胞感知光信息,而復(fù)雜細(xì)胞感知運(yùn)動信息。

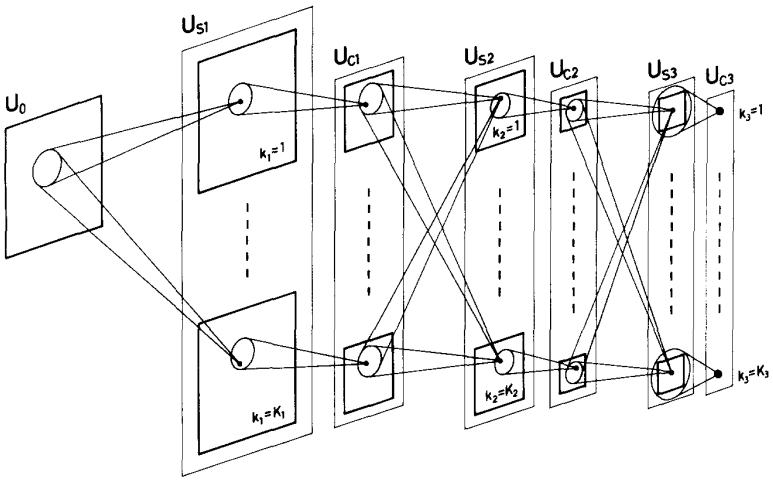

受此啟發(fā),日本學(xué)者福島邦彥于1980年提出新認(rèn)知網(wǎng)絡(luò)模型來識別手寫數(shù)字(圖1)。該網(wǎng)絡(luò)分為多層,每一層由一種神經(jīng)元組成。在網(wǎng)絡(luò)中,兩種類型的神經(jīng)元被用來交替提取和組合圖形信息。這兩種類型的神經(jīng)元后來演變成卷積層和提取層,它們?nèi)匀环浅V匾H欢@個網(wǎng)絡(luò)中存在的神經(jīng)元是人工設(shè)計的,它們不會自動適應(yīng)呈現(xiàn)的結(jié)果,因此它們不具備學(xué)習(xí)能力,并且僅限于識別一小組簡單數(shù)字的基本任務(wù)。

數(shù)字。1:neocognitron 機(jī)器的工作機(jī)制(來源:Fukushima,Kunihiko。“Neocognitron:一種能夠進(jìn)行視覺模式識別的分層神經(jīng)網(wǎng)絡(luò)。”Neural Networks 1.2(1988):119-130)

當(dāng)無法實(shí)現(xiàn)學(xué)習(xí)能力時,需要額外的手動設(shè)計來代替真正的自學(xué)習(xí)網(wǎng)絡(luò)。1982年,美國科學(xué)家約翰霍普菲爾德發(fā)明了一種神經(jīng)網(wǎng)絡(luò),它有幾個限制,可以在變化中保持記憶,從而促進(jìn)學(xué)習(xí)。同年,芬蘭科學(xué)家 Teuvo Kohonen 提出了一種基于無監(jiān)督算法向量量化神經(jīng)網(wǎng)絡(luò)(學(xué)習(xí)向量量化網(wǎng)絡(luò))的自組織映射,希望通過縮短輸入和輸出之間的歐氏距離,從復(fù)雜網(wǎng)絡(luò)中學(xué)習(xí)正確的關(guān)系。1987年,美國科學(xué)家Stephen Grossberg和Gail Carpenter在早期理論的基礎(chǔ)上提出了自適應(yīng)共振理論網(wǎng)絡(luò)。他們讓已知信息和未知信息產(chǎn)生共鳴,從已知信息推斷未知信息,實(shí)現(xiàn)類比學(xué)習(xí)。盡管這些網(wǎng)絡(luò)被附加了自組織、自適應(yīng)和記憶等關(guān)鍵詞,但相應(yīng)的學(xué)習(xí)方法并不高效。它需要基于應(yīng)用本身不斷優(yōu)化設(shè)計,再加上網(wǎng)絡(luò)內(nèi)存容量小,難以在實(shí)踐中應(yīng)用。

直到 1986 年計算機(jī)科學(xué)家 David Rumelhart、Geoffrey Hinton 和 Ronald Williams 發(fā)表了反向傳播算法,才逐漸解決神經(jīng)網(wǎng)絡(luò)學(xué)習(xí)問題。神經(jīng)網(wǎng)絡(luò)的輸出與真實(shí)值之間的差異現(xiàn)在可以通過與梯度相關(guān)的鏈?zhǔn)椒▌t反饋到每一層的權(quán)重中,從而有效地允許每一層函數(shù)以與感知機(jī)相同的方式進(jìn)行訓(xùn)練。這是 Geoffrey Hinton 在該領(lǐng)域的第一個里程碑。如今,他是谷歌的一名工程研究員,并且是圖靈獎的獲得者,這是計算機(jī)科學(xué)領(lǐng)域的最高榮譽(yù)。

“我們不想建立一個模型來模擬大腦的工作方式,”欣頓說。“我們會觀察大腦,同時認(rèn)為,既然大腦是一個可行的模型,我們應(yīng)該看看如果我們想創(chuàng)建其他一些可行的模型,大腦會提供靈感。反向傳播算法模擬的正是大腦的反饋機(jī)制。”

此后在 1994 年,Geoffrey Hinton 小組的博士后計算機(jī)科學(xué)家 Yann LeCun 結(jié)合神經(jīng)認(rèn)知機(jī)制和反向傳播算法創(chuàng)建了 LeNet,這是一種用于識別手寫郵政編碼的卷積神經(jīng)網(wǎng)絡(luò),實(shí)現(xiàn)了 99% 的自動識別,并且能夠處理幾乎任何形式的手寫。該算法取得了巨大成功,并被美國郵政系統(tǒng)投入使用。

深度學(xué)習(xí)時代來臨

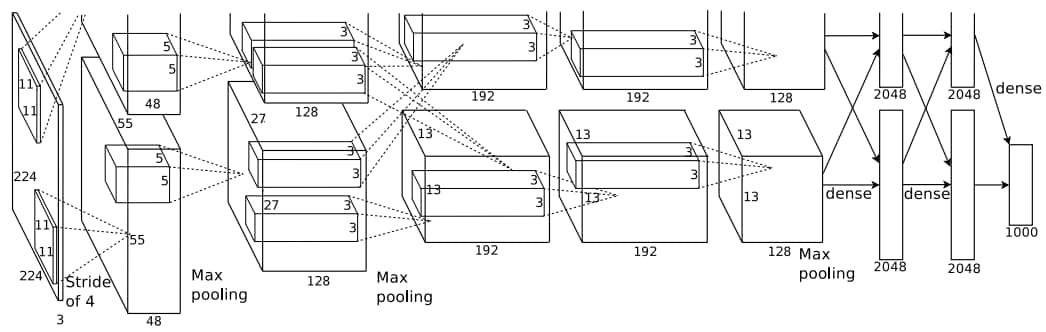

盡管取得了上述成就,但深度學(xué)習(xí)直到后來的某個時候才獲得顯著的普及。一個原因是神經(jīng)網(wǎng)絡(luò)需要更新大量參數(shù)(僅 2012 年提出的 AlexNet 就有 65 萬個神經(jīng)元和 6000 萬個參數(shù)),并且需要強(qiáng)大的數(shù)據(jù)處理和計算能力(圖 2 )). 此外,試圖通過減少網(wǎng)絡(luò)中的層數(shù)來減少數(shù)據(jù)量和訓(xùn)練時間會使深度學(xué)習(xí)不如其他機(jī)器學(xué)習(xí)方法(例如在 2000 年左右變得非常流行的支持向量機(jī))有效。Geoffrey Hinton 在 2006 年的另一篇論文首次使用深度信念網(wǎng)絡(luò)這個名稱,其中 Hinton 提供了一種優(yōu)化整個神經(jīng)網(wǎng)絡(luò)的方法。雖然這為深度學(xué)習(xí)的日后流行奠定了基礎(chǔ),但之所以使用深度網(wǎng)絡(luò)而不是之前的神經(jīng)網(wǎng)絡(luò)綽號,是因?yàn)橹髁餮芯科诳瘜ι窠?jīng)網(wǎng)絡(luò)這個詞持反感態(tài)度,甚至看到論文就拒絕投稿。某些論文標(biāo)題中使用的詞。

深度學(xué)習(xí)的重大轉(zhuǎn)折發(fā)生在 2012 年。計算機(jī)視覺領(lǐng)域的科學(xué)家開始意識到數(shù)據(jù)大小的重要性。2010 年,斯坦福大學(xué)計算機(jī)科學(xué)副教授李飛飛發(fā)布了 ImageNet,這是一個圖像數(shù)據(jù)庫,包含數(shù)千萬張手動標(biāo)記的圖像,屬于 1000 個類別,包括動物、植物、日常生活等領(lǐng)域。從 2010 年到 2017 年,計算機(jī)視覺專家根據(jù)這些圖像舉辦年度分類競賽,ImageNet 已成為全球視覺研究中機(jī)器學(xué)習(xí)和深度學(xué)習(xí)算法的試金石。2012 年,多倫多大學(xué) Geoffrey Hinton 的一名學(xué)生 Alex Krizhevsky 通過在兩塊 NVIDIA 顯卡 (GPU) 上編寫神經(jīng)網(wǎng)絡(luò)算法贏得了 ImageNet 分類競賽,他的算法大大超過了第二名參賽者的識別率。該網(wǎng)絡(luò)隨后被命名為 AlexNet。這是深度學(xué)習(xí)快速崛起的開始。

圖 2:AlexNet 的網(wǎng)絡(luò)結(jié)構(gòu)(來源:Krizhevsky、Alex、Ilya Sutskever 和 Geoffrey E. Hinton,“Imagenet classification with deep convolutional neural networks”,Advances in Neural Information Processing Systems,2012。)

從 AlexNet 開始,到 ImageNet 的數(shù)據(jù)支持和商用顯卡的計算支持,神經(jīng)網(wǎng)絡(luò)架構(gòu)研究逐漸爆發(fā)。首先,由于發(fā)布了多個軟件包(例如 Caffe、TensorFlow 和 Torch),實(shí)施深度學(xué)習(xí)變得更加容易。其次,ImageNet 分類競賽和 COCO 競賽的后續(xù)迭代,其中給定的任務(wù)涉及更復(fù)雜的圖像分割和描述,產(chǎn)生了 VGGNet、GoogLeNet、ResNet 和 DenseNet。這些神經(jīng)網(wǎng)絡(luò)使用的層數(shù)逐漸增加,從AlexNet的11層和VGGNet的19層到ResNet的150層,甚至DenseNet的200層,從而實(shí)現(xiàn)了真正的深度學(xué)習(xí)。在某些關(guān)于分類問題的數(shù)據(jù)集上進(jìn)行測試時,這些深度神經(jīng)網(wǎng)絡(luò)甚至超過了人類的識別精度(ImageNet 上的人類錯誤率約為 5%,而 SENet 可以達(dá)到 2.25%)。這在下表1:

表 1:歷屆 ImageNet 圖像分類競賽中表現(xiàn)最佳的網(wǎng)絡(luò)總結(jié)(來源:作者根據(jù)https://github.com/sovrasov/flops-counter.pytorch的原始論文計算得出)。

| 網(wǎng)絡(luò) | 亞歷克斯網(wǎng) | ZFNet | VGG網(wǎng) | 谷歌網(wǎng) | ResNet | ResNeXt | SENet |

| Top 5 錯誤率 | 15.32% | 13.51% | 7.32% | 6.67% | 3.57% | 3.03% | 2.25% |

| 層數(shù) | 8個 | 8個 | 16 | 22 | 152 | 152 | 154 |

| 參數(shù)個數(shù) | 60M | 60M | 138M | 7M | 60M | 44M | 67M |

| 年 | 2012 | 2013年 | 2014 | 2014 | 2015年 | 2016年 | 2017年 |

|---|

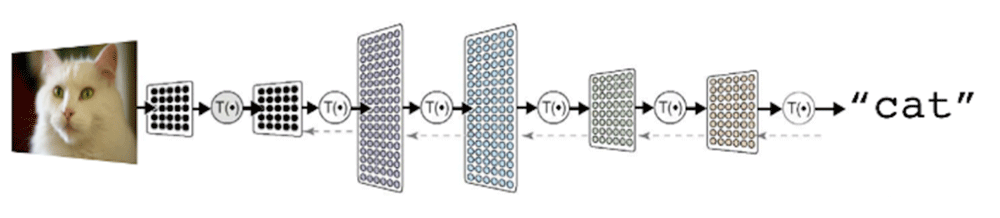

自這一突破以來,計算機(jī)科學(xué)家越來越多地使用神經(jīng)網(wǎng)絡(luò)算法來解決問題。除了上述在二維圖像的分類、分割和檢測中的應(yīng)用,神經(jīng)網(wǎng)絡(luò)還在時間信號領(lǐng)域甚至無監(jiān)督機(jī)器學(xué)習(xí)中得到應(yīng)用。循環(huán)神經(jīng)網(wǎng)絡(luò) (RN) 可以按時間順序接收信號輸入。網(wǎng)絡(luò)的每一層神經(jīng)元都可以壓縮和存儲記憶,而網(wǎng)絡(luò)本身可以從記憶中提取有效維度來進(jìn)行語音識別和文本理解。當(dāng)神經(jīng)網(wǎng)絡(luò)用于無監(jiān)督學(xué)習(xí)時,不是提取主成分或提取特征值,只需使用包含多層網(wǎng)絡(luò)的自動編碼器,即可自動縮小和提取原始信息。將上述與矢量量化網(wǎng)絡(luò)相結(jié)合,可以在不大量使用標(biāo)記數(shù)據(jù)的情況下對特征進(jìn)行聚類并獲得分類結(jié)果。現(xiàn)在毫無疑問,無論是在有效性還是在應(yīng)用范圍方面,神經(jīng)網(wǎng)絡(luò)都已成為無可爭議的王者。

深度學(xué)習(xí):最新技術(shù)和未來趨勢

2017 年,ImageNet 圖像分類大賽宣布完成決賽。但這并沒有預(yù)示著深度學(xué)習(xí)的終結(jié)。相反,研究和深度學(xué)習(xí)應(yīng)用已經(jīng)有效地超越了之前的分類問題階段,進(jìn)入了廣泛發(fā)展的第二階段。與此同時,深度學(xué)習(xí)相關(guān)國際會議論文投稿數(shù)量逐年呈指數(shù)級增長,表明越來越多的研究人員和工程師正在致力于深度學(xué)習(xí)算法的開發(fā)和應(yīng)用。未來幾年,深度學(xué)習(xí)的發(fā)展將主要順應(yīng)以下幾個趨勢。

首先,從結(jié)構(gòu)上講,使用的神經(jīng)網(wǎng)絡(luò)類型會更加多樣化。生成對抗網(wǎng)絡(luò) (GANs) 可以執(zhí)行卷積神經(jīng)網(wǎng)絡(luò)的逆過程,自 2016 年首次提出以來發(fā)展迅速,已成為深度學(xué)習(xí)的重要增長領(lǐng)域。因?yàn)樯疃葘W(xué)習(xí)算法可以從原始信息(比如圖像)中提取特征,那么逆過程在邏輯上應(yīng)該是可行的。換句話說,應(yīng)該可以使用雜亂的信號通過特定的神經(jīng)網(wǎng)絡(luò)生成相應(yīng)的圖像。正是基于這種洞察力,計算機(jī)科學(xué)家 Ian Goodfellow 提出了生成對抗網(wǎng)絡(luò)的概念。除了生成圖像的生成器之外,這種類型的網(wǎng)絡(luò)還提供鑒別器。在訓(xùn)練過程中,生成器傾向于掌握生成的圖片,這些圖片與真實(shí)圖片極其接近,而計算機(jī)很難區(qū)分。相比之下,鑒別器傾向于掌握區(qū)分真實(shí)圖片和生成圖片的魯棒能力。隨著兩者相互學(xué)習(xí),生成的圖像越逼真,鑒別器就越難鑒別。相反,鑒別器的能力越大,生成器就越有動力生成新的、更逼真的圖像。生成對抗網(wǎng)絡(luò)有著廣泛的應(yīng)用,從人臉生成和識別到圖像分辨率提升、視頻幀率提升、圖像風(fēng)格遷移等領(lǐng)域。

其次,此類網(wǎng)絡(luò)涉及的研究問題往往更加多樣化。一方面,在機(jī)器學(xué)習(xí)的其他分支中發(fā)現(xiàn)的一些概念,例如強(qiáng)化學(xué)習(xí)和遷移學(xué)習(xí),在深度學(xué)習(xí)中找到了新的位置。另一方面,深度學(xué)習(xí)的研究已經(jīng)從工程試錯發(fā)展到理論推導(dǎo)。深度學(xué)習(xí)因缺乏理論支撐而受到批評,在訓(xùn)練過程中幾乎完全依賴數(shù)據(jù)科學(xué)家的經(jīng)驗(yàn)。為了減少經(jīng)驗(yàn)對結(jié)果的影響,減少選擇超參數(shù)的時間,研究人員除了對最初的經(jīng)典網(wǎng)絡(luò)結(jié)構(gòu)進(jìn)行修改外,還在從根本上修正深度學(xué)習(xí)的效率。一些研究人員正試圖將其他機(jī)器學(xué)習(xí)方法(如壓縮感知和貝葉斯理論)聯(lián)系起來,以促進(jìn)深度學(xué)習(xí)從工程試錯到理論指導(dǎo)實(shí)踐的轉(zhuǎn)變。也有人努力解釋深度學(xué)習(xí)算法的有效性,而不是僅僅將整個網(wǎng)絡(luò)視為黑匣子。與此同時,研究人員一直忙于為超參數(shù)主題建立另一套機(jī)器學(xué)習(xí)問題,稱為元學(xué)習(xí),試圖降低超參數(shù)選擇過程的難度和隨機(jī)性。也有人努力解釋深度學(xué)習(xí)算法的有效性,而不是僅僅將整個網(wǎng)絡(luò)視為黑匣子。與此同時,研究人員一直忙于為超參數(shù)主題建立另一套機(jī)器學(xué)習(xí)問題,稱為元學(xué)習(xí),試圖降低超參數(shù)選擇過程的難度和隨機(jī)性。也有人努力解釋深度學(xué)習(xí)算法的有效性,而不是僅僅將整個網(wǎng)絡(luò)視為黑匣子。與此同時,研究人員一直忙于為超參數(shù)主題建立另一套機(jī)器學(xué)習(xí)問題,稱為元學(xué)習(xí),試圖降低超參數(shù)選擇過程的難度和隨機(jī)性。

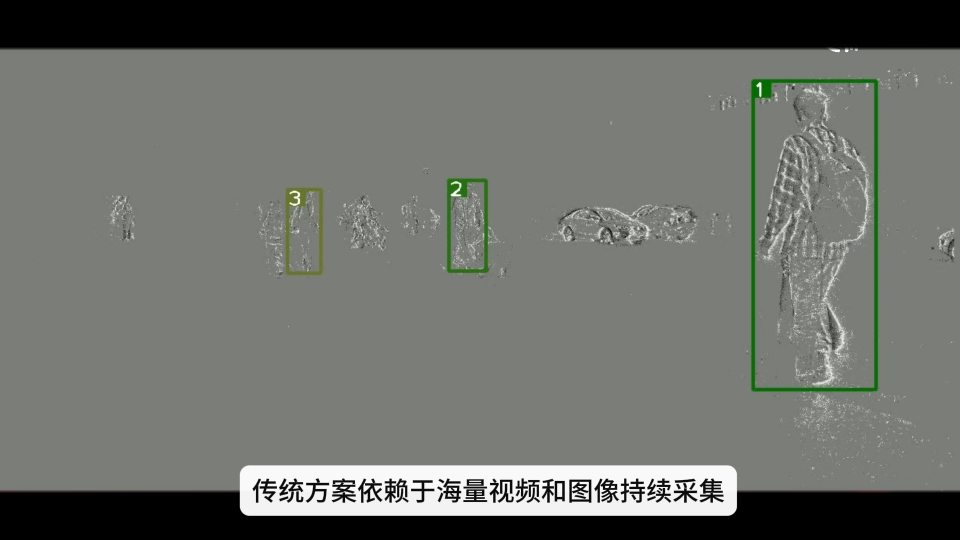

第三,由于最近大量注入新的研究成果,更多的算法正在商業(yè)產(chǎn)品中使用。除了幾家開發(fā)圖像生成小程序的小公司外,大公司也在深度學(xué)習(xí)領(lǐng)域爭奪地盤。互聯(lián)網(wǎng)巨頭谷歌、Facebook、微軟都設(shè)立了深度學(xué)習(xí)開發(fā)中心。他們的中國同行百度、阿里巴巴、騰訊、京東和字節(jié)跳動也各自建立了自己的深度學(xué)習(xí)研究中心。DeepMind、商湯科技、曠視科技等幾家扎根于深度學(xué)習(xí)技術(shù)的獨(dú)角獸公司,也在眾多競爭者中脫穎而出。2019年以來,行業(yè)相關(guān)的深度學(xué)習(xí)研究逐漸從發(fā)表論文轉(zhuǎn)向落地項目。比如騰訊AI Lab優(yōu)化了視頻播放,

第四,隨著5G技術(shù)的逐步普及,深度學(xué)習(xí)將與云計算一起走進(jìn)日常生活。由于缺乏計算資源,深度學(xué)習(xí)是一項普遍難以落地的技術(shù)。一臺帶有 GPU 的超級計算機(jī)的成本可能高達(dá) 3,411,900 美元(美元)或 500,000 日元(人民幣),而且并非所有公司都有資金和人才來充分利用此類設(shè)備。然而,隨著 5G 技術(shù)的普及和云計算的可用性,企業(yè)現(xiàn)在可以通過租用直接從云端獲取計算資源,而且成本低廉。公司可以將數(shù)據(jù)上傳到云端,并幾乎實(shí)時地從云端接收計算結(jié)果。許多新興的初創(chuàng)公司正在研究如何利用這一基礎(chǔ)設(shè)施,并組建了計算機(jī)科學(xué)家和數(shù)據(jù)科學(xué)家團(tuán)隊,為其他公司提供深度學(xué)習(xí)算法支持和硬件支持。這使得以前與計算機(jī)技術(shù)關(guān)系不大的行業(yè)(例如制造、服務(wù)、娛樂,甚至法律行業(yè))中的公司不再需要定義他們的問題并開發(fā)他們的解決方案。相反,他們現(xiàn)在可以通過與算法公司合作,從計算機(jī)技術(shù)行業(yè)的專業(yè)知識中受益,這樣他們就可以通過深度學(xué)習(xí)獲得授權(quán)。這使得以前與計算機(jī)技術(shù)關(guān)系不大的行業(yè)(例如制造、服務(wù)、娛樂,甚至法律行業(yè))中的公司不再需要定義他們的問題并開發(fā)他們的解決方案。相反,他們現(xiàn)在可以通過與算法公司合作,從計算機(jī)技術(shù)行業(yè)的專業(yè)知識中受益,這樣他們就可以通過深度學(xué)習(xí)獲得授權(quán)。這使得以前與計算機(jī)技術(shù)關(guān)系不大的行業(yè)(例如制造、服務(wù)、娛樂,甚至法律行業(yè))中的公司不再需要定義他們的問題并開發(fā)他們的解決方案。相反,他們現(xiàn)在可以通過與算法公司合作,從計算機(jī)技術(shù)行業(yè)的專業(yè)知識中受益,這樣他們就可以通過深度學(xué)習(xí)獲得授權(quán)。

總結(jié)與討論

50 多年來,深度學(xué)習(xí)從原型到成熟,從簡單到復(fù)雜。學(xué)術(shù)界和工業(yè)界積累了大量的理論和技術(shù)經(jīng)驗(yàn)。現(xiàn)在的發(fā)展方向比以往任何時候都更加多元化。一方面是因?yàn)楹芏嘞鄳?yīng)的產(chǎn)品已經(jīng)進(jìn)入研發(fā)階段,另一方面是因?yàn)橛嬎銠C(jī)科學(xué)家正在對深度學(xué)習(xí)進(jìn)行更細(xì)致的研究。

當(dāng)然,作為一門綜合學(xué)科,深度學(xué)習(xí)除了在圖像識別領(lǐng)域的核心發(fā)展歷程之外,還在語音分析和自然語言處理領(lǐng)域取得了碩果。同時,結(jié)合多種神經(jīng)網(wǎng)絡(luò)和多媒體格式正迅速成為研究的熱點(diǎn)領(lǐng)域。例如,結(jié)合圖像和語言處理的自動圖像字幕是一個具有挑戰(zhàn)性的問題。

還應(yīng)該注意的是,深度學(xué)習(xí)并不是實(shí)現(xiàn)神經(jīng)網(wǎng)絡(luò)的唯一方法。一些現(xiàn)階段應(yīng)用不那么廣泛的網(wǎng)絡(luò)結(jié)構(gòu),如自適應(yīng)共振網(wǎng)絡(luò)、霍普菲爾德網(wǎng)絡(luò)和受限玻爾茲曼機(jī),也可能有一天會推動整個行業(yè)進(jìn)一步發(fā)展。可以肯定的是,雖然深度學(xué)習(xí)目前似乎仍籠罩在難以捉摸的復(fù)雜和神秘光環(huán)中,但在不久的將來,這個科幻概念將成為許多大大小小的公司的基礎(chǔ)技術(shù)。

審核編輯黃昊宇

-

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5599瀏覽量

124398

發(fā)布評論請先 登錄

人工智能與機(jī)器學(xué)習(xí)在這些行業(yè)的深度應(yīng)用

機(jī)器學(xué)習(xí)和深度學(xué)習(xí)中需避免的 7 個常見錯誤與局限性

穿孔機(jī)頂頭檢測儀 機(jī)器視覺深度學(xué)習(xí)

【團(tuán)購】獨(dú)家全套珍藏!龍哥LabVIEW視覺深度學(xué)習(xí)實(shí)戰(zhàn)課(11大系列課程,共5000+分鐘)

【團(tuán)購】獨(dú)家全套珍藏!龍哥LabVIEW視覺深度學(xué)習(xí)實(shí)戰(zhàn)課程(11大系列課程,共5000+分鐘)

如何深度學(xué)習(xí)機(jī)器視覺的應(yīng)用場景

基于EVS事件感知的超低功耗多目標(biāo)檢測追蹤 #超低功耗視覺 #深度學(xué)習(xí) #機(jī)器學(xué)習(xí) #人工智能 #evs

如何實(shí)現(xiàn)"可用匿名數(shù)據(jù)"# AI# 人工智能# 隱私保護(hù)# 圖像處理# 黑科技# 安全 #深度學(xué)習(xí) #數(shù)據(jù)

如何在機(jī)器視覺中部署深度學(xué)習(xí)神經(jīng)網(wǎng)絡(luò)

深度學(xué)習(xí)對工業(yè)物聯(lián)網(wǎng)有哪些幫助

自動駕駛中Transformer大模型會取代深度學(xué)習(xí)嗎?

當(dāng)深度學(xué)習(xí)遇上嵌入式資源困境,特征空間如何破局?

嵌入式AI技術(shù)之深度學(xué)習(xí):數(shù)據(jù)樣本預(yù)處理過程中使用合適的特征變換對深度學(xué)習(xí)的意義

用樹莓派搞深度學(xué)習(xí)?TensorFlow啟動!

深度學(xué)習(xí)的長期發(fā)展仍在繼續(xù)

深度學(xué)習(xí)的長期發(fā)展仍在繼續(xù)

評論