前言

Overview

本文將探討 Kubernetes 中的網絡模型,以及對各種網絡模型進行分析。

Underlay Network Model

什么是 Underlay Network

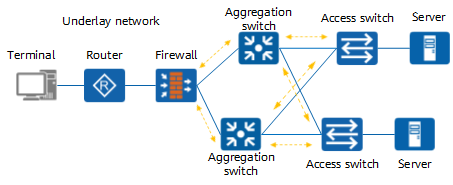

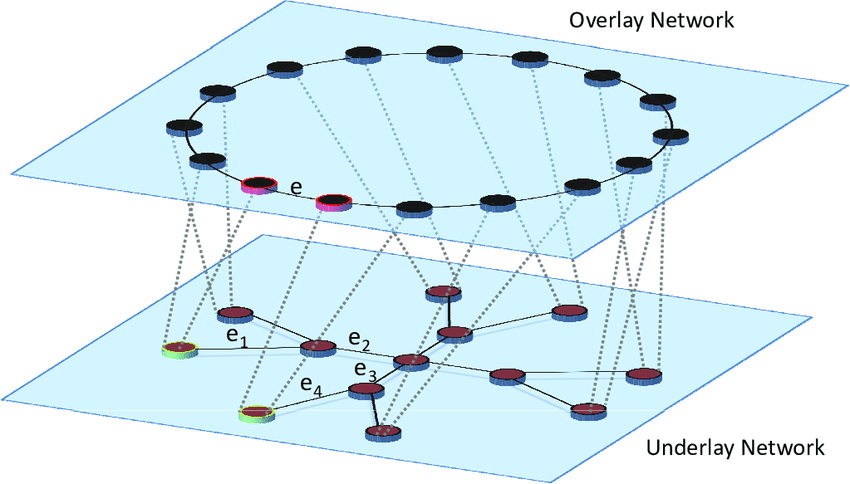

底層網絡Underlay Network顧名思義是指網絡設備基礎設施,如交換機,路由器,DWDM使用網絡介質將其鏈接成的物理網絡拓撲,負責網絡之間的數據包傳輸。

Underlay network topology

Underlay network topology

underlay network可以是二層,也可以是三層;二層的典型例子是以太網Ethernet,三層是的典型例子是互聯網Internet。

而工作于二層的技術是vlan,工作在三層的技術是由OSPF,BGP等協議組成。

k8s 中的 underlay network

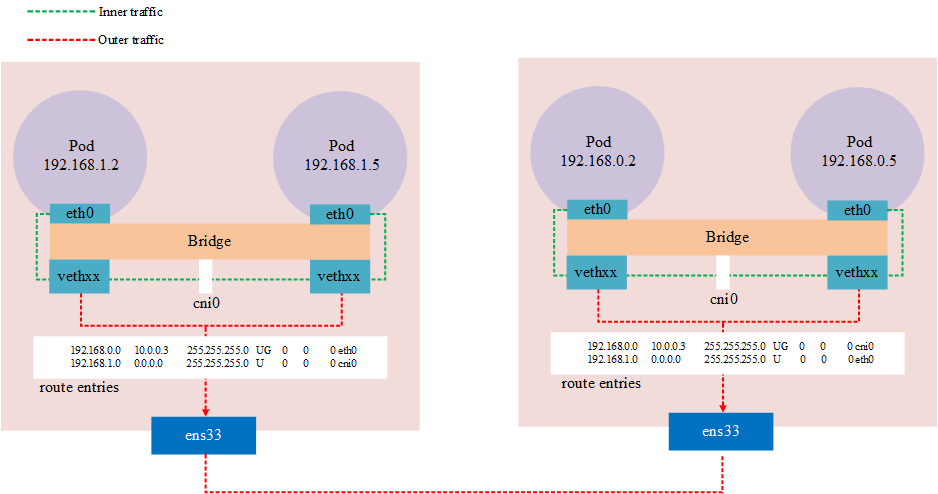

在 kubernetes 中,underlay network中比較典型的例子是通過將宿主機作為路由器設備,Pod 的網絡則通過學習路由條目從而實現跨節點通訊。

underlay network topology in kubernetes

underlay network topology in kubernetes

這種模型下典型的有flannel的host-gw模式與calicoBGP模式。

flannel host-gw

flannel host-gw模式中每個 Node 需要在同一個二層網絡中,并將 Node 作為一個路由器,跨節點通訊將通過路由表方式進行,這樣方式下將網絡模擬成一個underlay network。

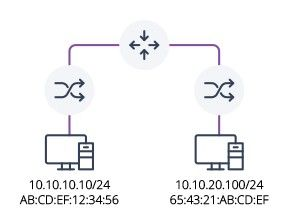

layer2 ethernet topology

layer2 ethernet topologyNotes:因為是通過路由方式,集群的 cidr 至少要配置 16,因為這樣可以保證,跨節點的 Node 作為一層網絡,同節點的 Pod 作為一個網絡。如果不是這種用情況,路由表處于相同的網絡中,會存在網絡不可達

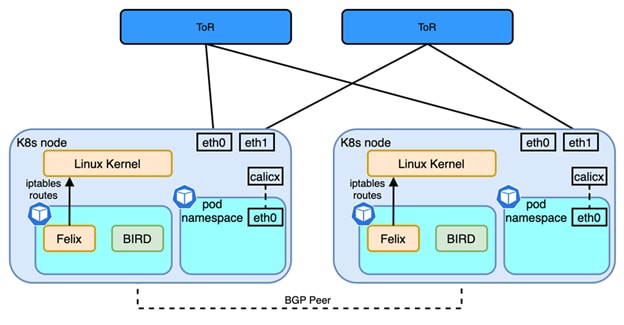

Calico BGP

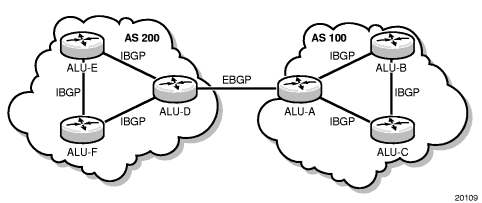

BGP(Border Gateway Protocol)是去中心化自治路由協議。它是通過維護 IP 路由表或前綴表來實現 AS (Autonomous System)之間的可訪問性,屬于向量路由協議。

BGP network topology

BGP network topology

與flannel不同的是,Calico提供了的BGP網絡解決方案,在網絡模型上,Calico與Flannel host-gw是近似的,但在軟件架構的實現上,flannel使用flanneld進程來維護路由信息;而Calico是包含多個守護進程的,其中Brid進程是一個BGP客戶端與路由反射器(Router Reflector),BGP客戶端負責從Felix中獲取路由并分發到其他BGP Peer,而反射器在 BGP 中起了優化的作用。在同一個 IBGP 中,BGP 客戶端僅需要和一個RR相連,這樣減少了AS內部維護的大量的 BGP 連接。通常情況下,RR是真實的路由設備,而Bird作為BGP客戶端工作。

Calico Network Architecture

Calico Network ArchitectureIPVLAN & MACVLAN

IPVLAN和MACVLAN是一種網卡虛擬化技術,兩者之間的區別為,IPVLAN允許一個物理網卡擁有多個 IP 地址,并且所有的虛擬接口用同一個 MAC 地址;而MACVLAN則是相反的,其允許同一個網卡擁有多個 MAC 地址,而虛擬出的網卡可以沒有 IP 地址。

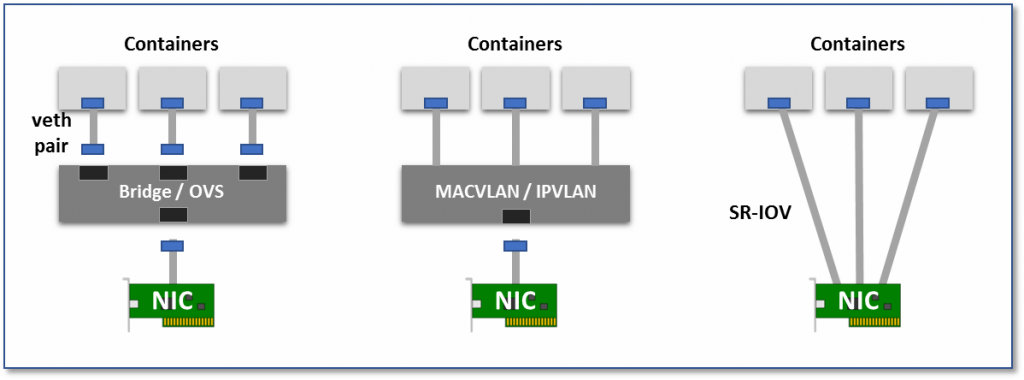

因為是網卡虛擬化技術,而不是網絡虛擬化技術,本質上來說屬于Overlay network,這種方式在虛擬化環境中與Overlay network相比最大的特點就是可以將 Pod 的網絡拉平到 Node 網絡同級,從而提供更高的性能、低延遲的網絡接口。本質上來說其網絡模型屬于下圖中第二個。

Virtual networking modes: bridging, multiplexing and SR-IOV

Virtual networking modes: bridging, multiplexing and SR-IOV- 虛擬網橋:創建一個虛擬網卡對(veth pair),一頭在容器內,一頭在宿主機的 root namespaces 內。這樣一來容器內發出的數據包可以通過網橋直接進入宿主機網絡棧,而發往容器的數據包也可以經過網橋進入容器。

- 多路復用:使用一個中間網絡設備,暴露多個虛擬網卡接口,容器網卡都可以介入這個中間設備,并通過 MAC/IP 地址來區分 packet 應該發往哪個容器設備。

- 硬件交換,為每個 Pod 分配一個虛擬網卡,這樣一來,Pod 與 Pod 之間的連接關系就會變得非常清晰,因為近乎物理機之間的通信基礎。如今大多數網卡都支持 SR-IOV 功能,該功能將單一的物理網卡虛擬成多個 VF 接口,每個 VF 接口都有單獨的虛擬 PCIe 通道,這些虛擬的 PCIe 通道共用物理網卡的 PCIe 通道。

在 kubernetes 中IPVLAN這種網絡模型下典型的 CNI 有,multus 與 danm。

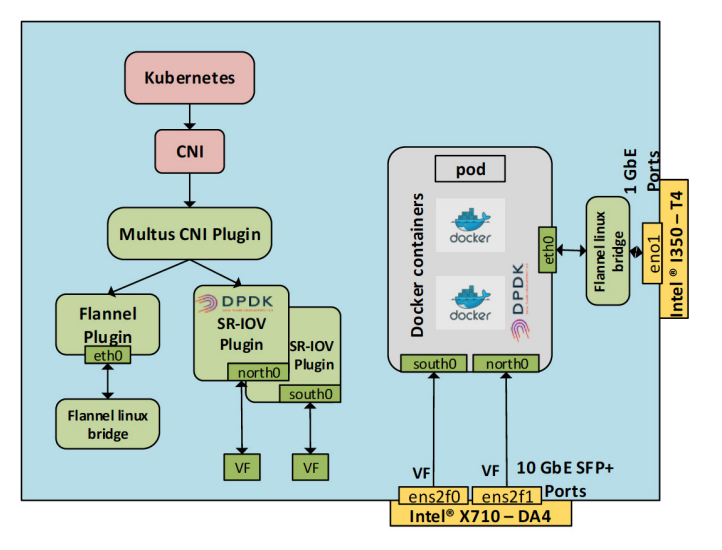

multus

multus是 intel 開源的 CNI 方案,是由傳統的cni與multus,并且提供了 SR-IOV CNI 插件使 K8s pod 能夠連接到 SR-IOV VF 。這是使用了IPVLAN/MACVLAN的功能。

當創建新的 Pod 后,SR-IOV 插件開始工作。配置 VF 將被移動到新的 CNI 名稱空間。該插件根據 CNI 配置文件中的 “name” 選項設置接口名稱。最后將 VF 狀態設置為 UP。

下圖是一個 Multus 和 SR-IOV CNI 插件的網絡環境,具有三個接口的 pod。

-

eth0是flannel網絡插件,也是作為 Pod 的默認網絡 -

VF 是主機的物理端口

ens2f0的實例化。這是英特爾 X710-DA4 上的一個端口。在 Pod 端的 VF 接口名稱為south0。 -

這個 VF 使用了 DPDK 驅動程序,此 VF 是從主機的物理端口

ens2f1實例化出的。這個是英特爾 X710-DA4 上另外一個端口。Pod 內的 VF 接口名稱為north0。該接口綁定到 DPDK 驅動程序vfio-pci。

Mutus networking Architecture overlay and SR-IOV

Mutus networking Architecture overlay and SR-IOVNotes:術語

- NIC:network interface card,網卡

- SR-IOV:single root I/O virtualization,硬件實現的功能,允許各虛擬機間共享 PCIe 設備。

- VF:Virtual Function,基于 PF,與 PF 或者其他 VF 共享一個物理資源。

- PF:PCIe Physical Function,擁有完全控制 PCIe 資源的能力

- DPDK:Data Plane Development Kit

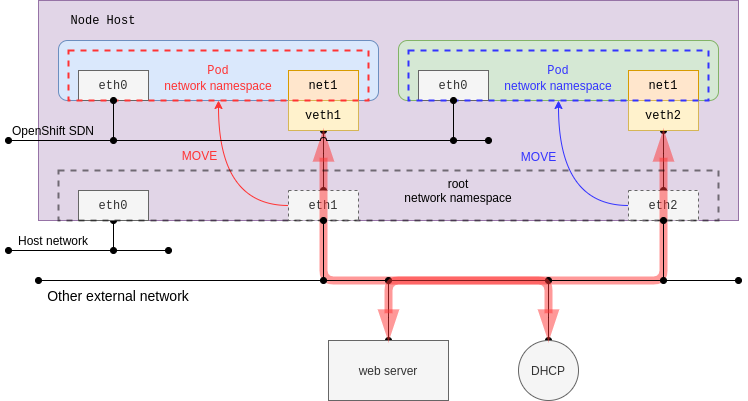

于此同時,也可以將主機接口直接移動到 Pod 的網絡名稱空間,當然這個接口是必須存在,并且不能是與默認網絡使用同一個接口。這種情況下,在普通網卡的環境中,就直接將 Pod 網絡與 Node 網絡處于同一個平面內了。

Mutus networking Architecture overlay and ipvlan

Mutus networking Architecture overlay and ipvlandanm

DANM 是諾基亞開源的 CNI 項目,目的是將電信級網絡引入 kubernetes 中,與 multus 相同的是,也提供了 SR-IOV/DPDK 的硬件技術,并且支持 IPVLAN.

Overlay Network Model

什么是 Overlay

疊加網絡是使用網絡虛擬化技術,在underlay網絡上構建出的虛擬邏輯網絡,而無需對物理網絡架構進行更改。本質上來說,overlay network使用的是一種或多種隧道協議 (tunneling),通過將數據包封裝,實現一個網絡到另一個網絡中的傳輸,具體來說隧道協議關注的是數據包(幀)。

overlay network topology

overlay network topology常見的網絡隧道技術

-

通用路由封裝 (

Generic Routing Encapsulation) 用于將來自 IPv4/IPv6 的數據包封裝為另一個協議的數據包中,通常工作與 L3 網絡層中。 -

VxLAN (

Virtual Extensible LAN),是一個簡單的隧道協議,本質上是將 L2 的以太網幀封裝為 L4 中 UDP 數據包的方法,使用4789作為默認端口。VxLAN也是VLAN的擴展,對于 4096(位VLAN ID) 擴展為 1600 萬(位VN·ID)個邏輯網絡。

這種工作在overlay模型下典型的有flannel與calico中的的VxLAN,IPIP模式。

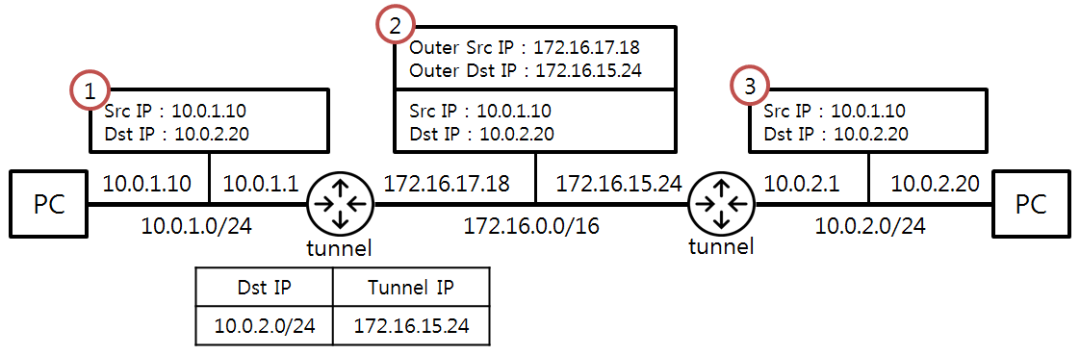

IPIP

IP in IP也是一種隧道協議,與VxLAN類似的是,IPIP的實現也是通過 Linux 內核功能進行的封裝。IPIP需要內核模塊ipip.ko使用命令查看內核是否加載 IPIP 模塊lsmod | grep ipip;使用命令modprobe ipip加載。

A simple IPIP network workflow

A simple IPIP network workflow

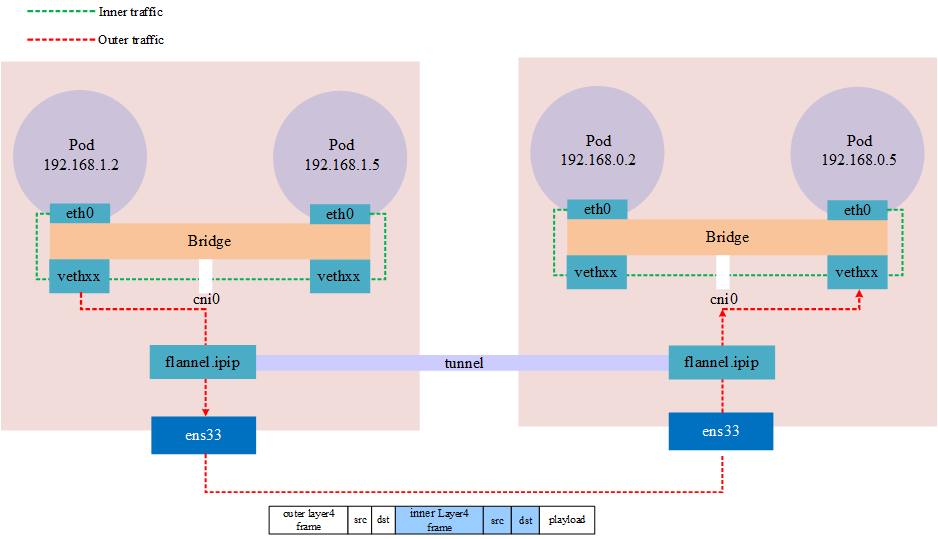

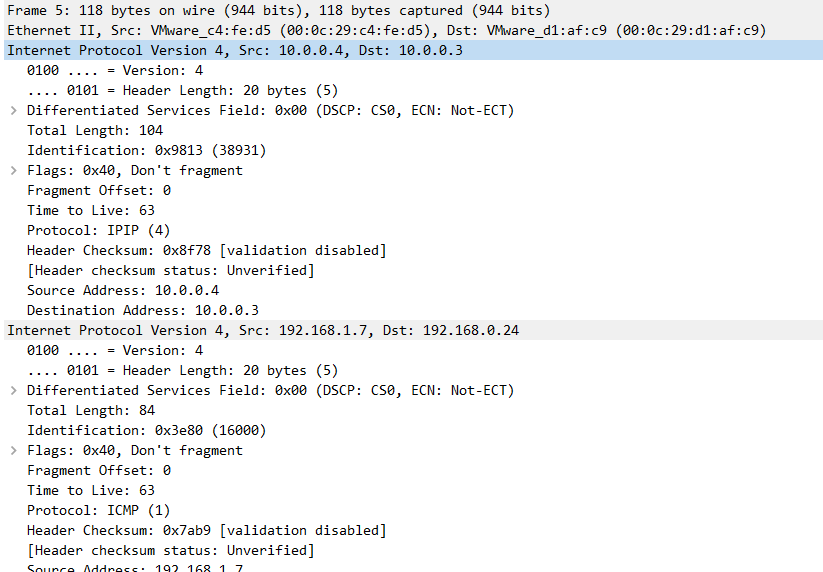

Kubernetes 中IPIP與VxLAN類似,也是通過網絡隧道技術實現的。與VxLAN差別就是,VxLAN本質上是一個 UDP 包,而IPIP則是將包封裝在本身的報文包上。

IPIP in kubernetes

IPIP in kubernetes IPIP packet with wireshark unpack

IPIP packet with wireshark unpackNotes:公有云可能不允許 IPIP 流量,例如 Azure

VxLAN

kubernetes 中不管是flannel還是calicoVxLAN 的實現都是使用 Linux 內核功能進行的封裝,Linux 對 vxlan 協議的支持時間并不久,2012 年 Stephen Hemminger 才把相關的工作合并到 kernel 中,并最終出現在 kernel 3.7.0 版本。為了穩定性和很多的功能,你可以會看到某些軟件推薦在 3.9.0 或者 3.10.0 以后版本的 kernel 上使用VxLAN。

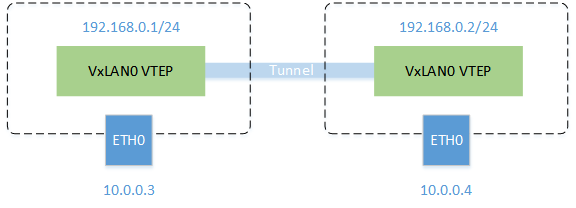

A simple VxLAN network topology

A simple VxLAN network topology

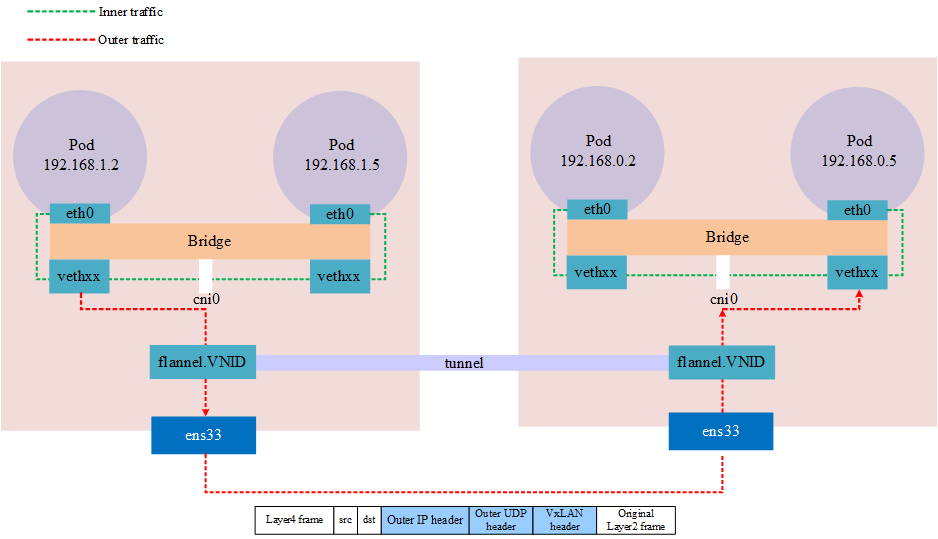

在 kubernetes 中 vxlan 網絡,例如flannel,守護進程會根據 kubernetes 的 Node 而維護VxLAN,名稱為flannel.1這是VNID,并維護這個網絡的路由,當發生跨節點的流量時,本地會維護對端VxLAN設備的 MAC 地址,通過這個地址可以知道發送的目的端,這樣就可以封包發送到對端,收到包的對端 VxLAN 設備flannel.1解包后得到真實的目的地址。

查看Forwarding database列表

$bridgefdb

268791:fcdevflannel.1dst10.0.0.3selfpermanent

VxLAN in kubernetes

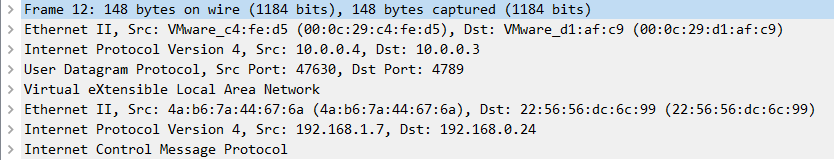

VxLAN in kubernetes VxLAN packet with wireshark unpack

VxLAN packet with wireshark unpackNotes:VxLAN 使用的 4789 端口,wireshark 應該是根據端口進行分析協議的,而 flannel 在 linux 中默認端口是 8472,此時抓包僅能看到是一個 UDP 包。

通過上述的架構可以看出,隧道實際上是一個抽象的概念,并不是建立的真實的兩端的隧道,而是通過將數據包封裝成另一個數據包,通過物理設備傳輸后,經由相同的設備(網絡隧道)進行解包實現網絡的疊加。

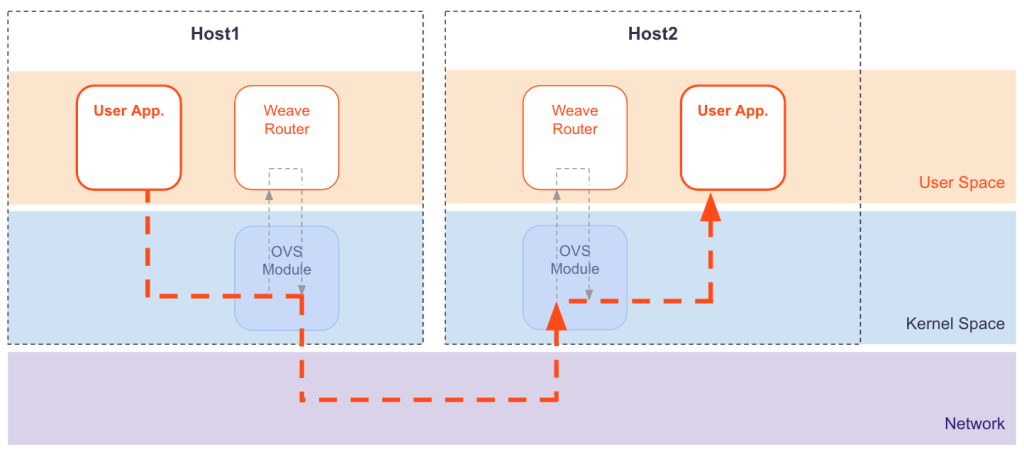

weave vxlan

weave 也是使用了VxLAN技術完成的包的封裝,這個技術在weave中稱之為fastdp (fast data path),與calico和flannel中用到的技術不同的,這里使用的是 Linux 內核中的openvswitch datapath module,并且 weave 對網絡流量進行了加密。

weave fastdp network topology

weave fastdp network topologyNotes:fastdp 工作在 Linux 內核版本 3.12 及更高版本,如果低于此版本的例如 CentOS7,weave 將工作在用戶空間,weave 中稱之為

sleeve mode

審核編輯 :李倩

-

以太網

+關注

關注

41文章

5997瀏覽量

180797 -

Linux

+關注

關注

88文章

11758瀏覽量

219006

原文標題:【硬核系列】看看人家圖解K8S網絡,那叫通透易懂!

文章出處:【微信號:浩道linux,微信公眾號:浩道linux】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

KubePi:開源Kubernetes可視化管理面板,讓集群管理如此簡單

Kubernetes kubectl命令行工具詳解

構建CNN網絡模型并優化的一般化建議

在Ubuntu20.04系統中訓練神經網絡模型的一些經驗

香港服務器支持Docker和Kubernetes嗎?

Kubernetes安全加固的核心技術

高效管理Kubernetes集群的實用技巧

基于eBPF的Kubernetes網絡異常檢測系統

生產環境中Kubernetes容器安全的最佳實踐

詳解Kubernetes中的Pod調度親和性

Kubernetes中部署MySQL集群

Kubernetes中的網絡模型

Kubernetes中的網絡模型

評論