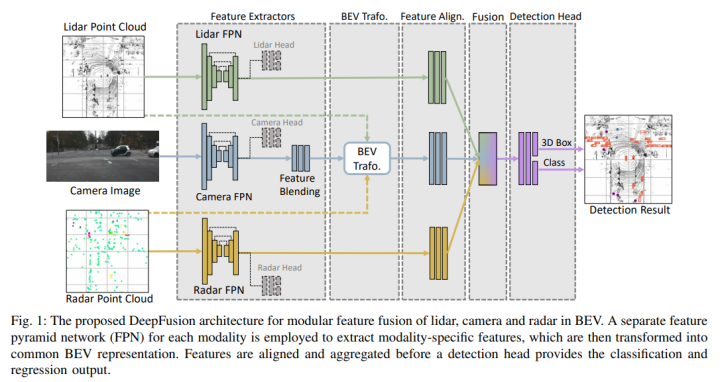

作者提出了DeepFusion,這是一種模塊化多模式架構,可將激光雷達、相機和radar以不同的組合融合在一起,用于3D目標檢測。專有的特征提取器利用了每種模式,并且可以輕松地交換,使得方法簡單靈活,提取的特征被轉換為鳥瞰圖,作為融合的通用表示,并在特征空間中融合模態之前執行空間和語義對齊。

最后,檢測頭利用豐富的多模態特征來提高3D檢測性能。激光雷達相機、激光雷達相機雷達和相機雷達融合的實驗結果表明了該融合方法的靈活性和有效性,在這個過程中,作者還研究了遠至225米遠的車輛檢測這一基本上未被探索的任務,展示了本文的激光雷達聚變的好處。此外還研究了3D目標檢測所需的激光雷達點密度,并舉例說明了對不利天氣條件的魯棒性,對相機雷達融合的消融研究突出了精確深度估計的重要性。

領域背景

安全準確的3D目標檢測是自主駕駛的核心技術,所有后續組件(如跟蹤、預測和規劃)在很大程度上取決于檢測性能,其它交通參與者的感知錯誤可能會通過系統傳播,導致自動駕駛車輛嚴重故障。為了防止這種錯誤,感知系統需要仔細設計,這仍然是一個具有挑戰性的研究問題。多個傳感器和不同的模態,主要是激光雷達、RGB相機和雷達,通常用于應對這一目標檢測挑戰。

多個傳感器提高了系統冗余度,但不同的模態提高了檢測魯棒性,因為它們的互補物理特性可用于克服單一模態失效的不同駕駛場景。例如,激光雷達和相機在多霧天氣條件下會嚴重退化,而雷達則相對不受影響。另一方面,雷達和單目相機存在稀疏或不精確的深度估計,這可以通過密集和精確的激光雷達點云進行補償。

在過去的幾年中,利用激光雷達、camera、雷達進行3D目標檢測的任務取得了巨大進展,這一趨勢由公共大規模多模態數據集推動,如nuScenes和Waymo開放數據集。然而,研究界主要關注距離達75米的近距離3D物體檢測,本問主要強調遠距離物體檢測的重要性,因為對其他交通參與者及其行為的早期檢測可以實現更安全、更快、更平穩的整體系統反應,尤其是在高速公路場景中。

因此,本文的目標是一種可擴展到200米范圍以上的目標檢測器設計,使用多個傳感器和模態的主要挑戰是融合大量冗余和互補的傳感器數據,在多個傳感器與感知輸出的接口處,融合對整個系統的性能有著重要的影響。大多數現有的工作集中在融合激光雷達和RGB相機傳感器用于3D目標檢測[8]、[17]–[24]。

較少探索的是相機雷達融合[25]–[27]和激光雷達雷達融合[28]、[29],后者分別用于語義熱圖預測和2D目標檢測。作者認為有必要為3D目標檢測開發一個簡單而靈活的激光雷達-camera-radar融合網絡,因為雷達傳感器在測量原理上與激光雷達和camera互補,雷達技術隨著市場需求的增長而迅速發展。

作者提出了一種模塊化網絡架構,用于融合激光雷達、相機和雷達,以實現精確、穩健和遠距離的3D物體檢測。該方法采用可交換的特征提取器,以產生單模態檢測器的良好優化架構。提取出的每種模態的豐富特征然后被轉換為一個共同的鳥瞰圖表示,以便在共享的潛在空間中進行方便的融合。這種網絡設計使我們能夠輕松地研究不同模態組合的融合,重點是激光雷達相機、激光雷達相機雷達和相機雷達融合。

多模態融合的方法

RGB相機圖像捕捉物體的詳細紋理信息,廣泛應用于物體分類,然而,camera不能直接提供深度信息,這使得3D視覺任務具有挑戰性,尤其是在單攝像機設置下。雷達點提供方位角速度和徑向距離,這有助于定位動態目標。雷達對各種照明和天氣條件也具有魯棒性,然而,使用雷達的3D目標檢測受到低分辨率和錯誤的高程估計的限制。

激光雷達點提供了周圍環境的準確深度信息,與分別具有錯誤深度估計或稀疏度的相機圖像或雷達點相比,激光雷達點在3D空間中具有更高的目標細節分辨率。因此,許多3D目標檢測benchmark(如KITTI或nuScenes)都由基于激光雷達的解決方案。

RGB相機和激光雷達是文獻中最常見的融合傳感器,此外,[35]將RGB圖像與熱圖像相結合,[36]將激光雷達點云與高清地圖相結合,最近越來越多的作品將RGB相機圖像與雷達相結合[25]–[27],只有[28]提出了融合激光雷達、雷達和RGB圖像的通用框架。最先進的融合網絡遵循兩級([8],[17]–[19],[21],[24],[36])或一級目標檢測pipeline([20],[22],[25],[37])。

例如,MV3D提出了一種具有RGB圖像和激光雷達點的兩級目標檢測器,在第一階段,相機圖像和激光雷達點由傳感器專用網絡處理,以提取高級特征。激光雷達分支還生成region proposal,以便裁剪激光雷達和相機特征圖。在第二階段,通過一個小檢測頭融合裁剪的特征。AVOD通過融合第一和第二階段的特征來擴展MV3D,3DCVF[23]應用選通機制來學習每個模態的權重,MMF[36]向融合管道添加了額外的任務,例如圖像深度補全和地面估計。

Frustum PointNet使用預先訓練的圖像檢測器在3D空間中生成2D目標proposal和截頭體,并應用PointNet使用截頭體內的激光雷達點進行目標檢測。在一級pipelines中,傳感器可以在一個特定層[22]、[25]或多個層[20]、[37]處融合。例如,PointPainting[22]應用預先訓練的語義分割網絡來預測逐像素圖像語義,并將語義得分附加到相應的激光雷達點,以進一步進行3D目標檢測。ContFuse[20]通過連續的融合層逐漸融合相機和激光雷達分支的特征圖!

Deepfusion框架

圖1所示的模塊化和靈活的架構設計基于強大的特征提取器,用于對單模態輸入數據進行豐富的編碼。鳥瞰圖(BEV)轉換模塊將這些特征映射到公共表示空間中。在BEV表示中,目標的大小被很好地保留,具有較小的方差和遮擋,因此非常適合3D目標檢測。接下來,特征對齊模塊在融合模塊聚集之前,對齊模態之間的潛在表示。最后,基于融合特征的檢測頭為3D目標檢測提供分類和回歸輸出。

1) Feature Extractors

對于每種模態(激光雷達、相機和雷達),都有一個單獨的目標檢測器可用于從各自的輸入數據中提取特征。為此,使用了經過充分研究的2D-CNN架構,因為它們的密集2D輸出具有豐富的細節。目標檢測器由提取多尺度特征圖的特征金字塔網絡(FPN)和用于分類和box回歸輸出的檢測頭組成。FPN用作融合的特征提取器,而檢測頭用于預訓練和端到端訓練設置中的 axillary loss。

2)Camera FPN

camera傳感器向camera FPN提供具有高度H和寬度W的形狀(H、W、3)的RGB圖像I作為輸入。首先,FPN提取多尺度特征圖,之后,這些特征圖是線性的 被放大到公共尺度Z、被級聯并由多個卷積層處理以用于多尺度特征混合。輸出為形狀(ZH、ZW、K)的高質量特征FC,其中K為通道數。

3)Lidar/Radar FPN

根據PIXOR[9],激光雷達和雷達點云由鳥瞰圖(BEV)平面上的占用網格圖表示,用于特征提取,網格大小為高度X和寬度Y。FPN通過向下縮放和隨后向上縮放該表示來利用2D卷積處理輸入網格以提取特征。這些BEV特征圖用作各個分支的潛在表示,稍后在特征對齊模塊中進行處理。

4)BEV Transformation

來自特征提取器的潛在表示被轉換為通用空間表示的鳥瞰圖,激光雷達和雷達特征已經在BEV空間中表示,而相機特征需要圖像到BEV的轉換。對于這種轉換,文獻中有不同的方法,可以根據輸入表示進行分類。像OFT[41]和[42]這樣的僅使用相機的方法通過估計深度,將垂直pillar合并到BEV表示中,將圖像投射到3D中。

結果是密集的深度,但由于單相機的深度估計不準確,空間不精確。點云方法[20]、[22]、[36]、[43]需要3D點云(最好是來自激光雷達傳感器)來指導變換,利用已知的激光雷達和攝像機之間的傳感器標定,將每個點投影到相機圖像和BEV網格上,在圖像像素和BEV單元之間建立特征關聯。由于點云的稀疏性,其結果是稀疏的表示,但由于激光雷達測量的深度精度,其空間精確。

DeepFusion使用了[43]中的點云驅動方法,因為空間精度對于3D目標檢測非常重要。此外,任何傳感器模態都可以用于為圖像變換提供點云:激光雷達或者直接使用雷達點進行變換,并且對于相機圖像,使用來自圖像檢測器的目標中心預測作為稀疏偽點。

在融合過程中,來自激光雷達、雷達和攝像機的點云可以被聚合,使得融合對于一種傳感器的故障具有魯棒性。如果將多個相機特征投影到同一BEV網格單元上,可以使用均值池來合并它們。結果,形狀的圖像特征圖被轉換為BEV平面,從而展開具有形狀的特征圖。

5)Feature Alignment

特征對齊模塊的輸入是來自激光雷達和雷達FPN的密集占用BEV特征圖和,以及來自相機的稀疏占用的變換特征圖,因此這些是不同的空間表示。此外,這些特征圖來自不同的模態和FPN主干,并編碼不同的語義表示。在這方面,由幾個卷積層組成的特征對齊模塊分別應用于,以便在空間和語義上對齊各個表示。輸出為特征圖具有相同形狀()。

6)Fusion

融合模塊接收作為分別來自激光雷達、相機和雷達分支的對準特征圖,融合模塊的任務是在潛在空間中組合這些不同的模態。為了得到融合特征圖,融合應用操作ρ,它可以是固定操作,如池化或加權平均,也可以是可學習操作,如注意力。模塊的輸出是形狀()和比例S的融合特征圖F。

7)檢測頭

檢測頭接收融合特征圖F以生成3D邊界框的分類和回歸輸出。由于特征圖F中編碼了豐富的多模態特征,作者發現一個帶有幾個卷積層的小頭部就足以生成比單模態檢測器更精確、更健壯的3D目標。

實驗

作者進行了詳細的實驗來研究每個傳感器模態的特性,并驗證所提出的融合架構。第V-B節比較了傳感器特定檢測器和不同融合組合之間的檢測性能,隨后是第V-C節中的一些定性結果。第V-D節顯示了主要針對LC、LCR和CR融合方案的消融研究,包括天氣條件好/壞、點的數量、探測距離以及225米遠目標的探測性能。最后,第V-E節在具有挑戰性的nuScenes數據集上對本文的融合網絡進行了基準測試。

1)實驗設置

實驗主要是在作者內部的多模態博世數據集上進行的,這些數據集包括來自多個激光雷達、相機和雷達的記錄。數據記錄在歐洲幾個國家(主要城市、農村地區和高速公路)和不同天氣條件(晴天、雨天、多云)。目標被分為17類,并用3D邊界框標記,這項工作使用了博世數據集的一個子集,包括大約10k個訓練幀(訓練集)和3k個驗證幀(驗證集)。

此外還使用公共nuScenes數據集[3]對本文的該方法與其他最先進的目標檢測器相結合。該數據集是在波士頓和新加坡用激光雷達、攝像機和雷達的讀數采集的。遵循nuScenes目標檢測基準,使用標準平均精度(AP)度量來評估3D檢測。AP得分在[0%,100%]范圍內,值越大表示檢測性能越好。

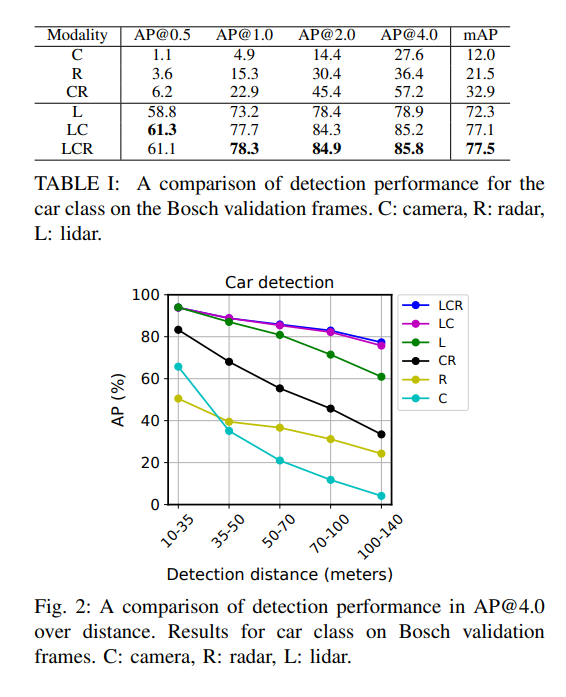

論文報告了具有不同定位閾值的AP及其在所有閾值上的平均值(mAP),定位閾值由檢測與其gt(0.5、1.0、2.0、4.0米)之間的邊界框質心的歐氏距離定義。所有檢測均在140米范圍內進行評估,作者分析了汽車或行人對象的檢測性能,這是自動駕駛研究中的兩個主要目標類別。對于消融研究,使用寬松的定位閾值(4.0米),以便補償不同傳感器中的時間偏差的影響,特別是在遠距離和動態對象中。

2)檢測性能的一般比較

作者比較了幾種傳感器特定檢測器(C、R、L)和具有不同傳感器組合(CR、LC、LCR)的融合網絡的性能。表I顯示了不同位置閾值下車輛等級的AP得分及其平均得分(mAP)。該表顯示了與傳感器專用網絡相比,傳感器融合明顯改善了AP。CR分別比C和R提高了20%和10%以上的mAP,LC提高了5%的mAP。LCR融合了所有傳感器模態,實現了最佳的檢測性能,這些實驗結果驗證了提出的融合架構的有效性。

為了研究每個傳感器模態的特性,圖2顯示了4.0米定位閾值下AP得分相對于檢測范圍的演變。帶有激光雷達點(L、LC、LCR)的檢測器性能優于沒有激光雷達點的檢測器(C、R、CR),且有較大的余量。例如,L在距離100~140米時超過CR 20%AP,顯示了使用激光雷達點進行遠程探測的重要性。

此外,LC在更大的距離上提高了L,接近20%的AP。作者假設這是因為相機圖像提供的目標紋理特征有助于檢測,特別是當激光雷達點在遠距離變得稀疏時。最后,當比較LCR和LC時,作者觀察到1%的AP略微改善,這表明雷達編碼的某些目標特征與相機和激光雷達的目標特征互補,例如速度。

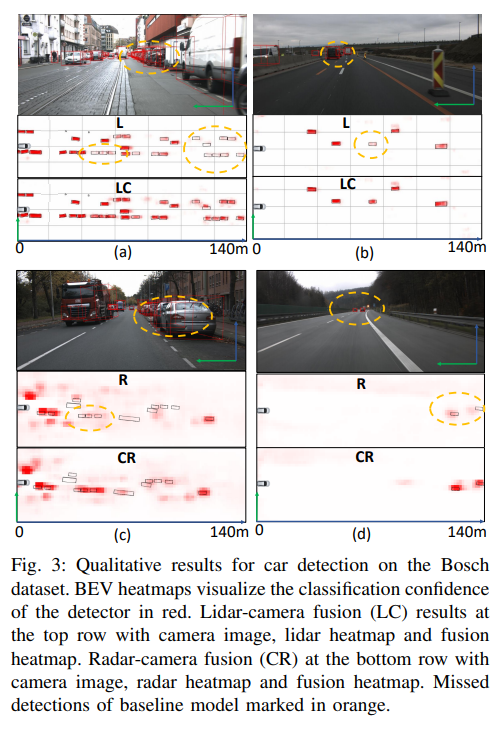

3)定性結果

圖3顯示了論文在Bosch數據集上用于車輛檢測的LC和CR融合模型的定性結果,通過可視化非最大抑制前的目標熱圖,比較了融合和相應的單峰基線模型。紅色表示車輛目標的高度可信度。融合模型能夠可靠地檢測到橙色突出顯示的基線模型遺漏對象。圖3(a)和圖3(b)顯示了帶有相機圖像的LC結果、基線L的熱圖和LC的熱圖。

在(a)中,LC能夠檢測到具有高遮擋水平的停放車輛,這是L模型所缺少的。在(b)中,LC在高速公路上檢測到一輛高度閉塞的汽車,這在僅使用激光雷達的模型中顯示出較低的得分。圖3(c)和圖3(d)顯示了相機圖像的CR融合結果、基線R的熱圖和CR模型的熱圖。在(c)中,沒有檢測到停放的車輛,因為部分遮擋的靜態物體對雷達來說特別困難,而與攝像機融合則能夠檢測到它們,在(d)雷達對遠距離目標的斗爭中,CR融合可靠地檢測到這些目標。

4)詳細分析和消融研究

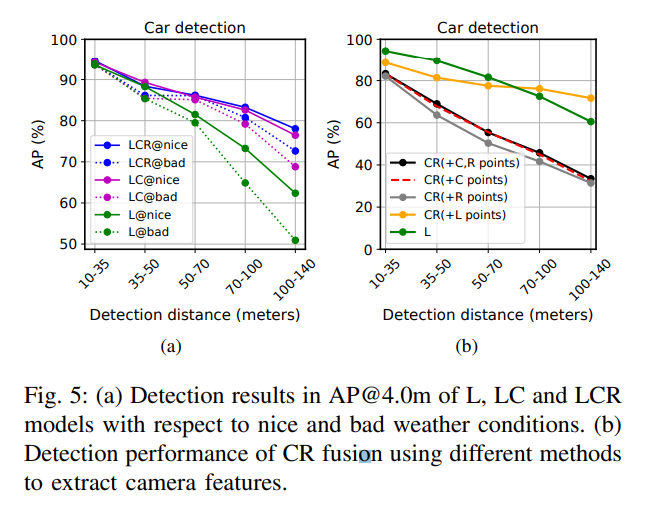

1) LCR融合:作者研究了天氣條件對LCR融合的影響。為此,博世數據集的驗證集被分為晴天集(晴天或陰天,道路干燥)和惡劣天氣集(雨天,道路潮濕)。基于激光雷達的模型L、LC和LCR根據這些分割進行評估。圖5(a)顯示了具有4.0米閾值的汽車等級的AP得分。

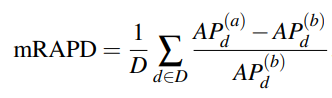

在惡劣的天氣條件下,每種型號的性能都會隨著距離的增加。模型L的性能差距最大,AP下降11%(范圍為100?140米)。為了進一步量化這種nicebad gap,論文使用mRAPD metric作為對壞天氣條件的魯棒性度量。它通過壞天氣相對于好天氣中的差AP平均值在D距離區間上平均計算得出:

使用mRAPD度量,作者發現僅使用激光雷達的模型L在壞天氣下減少7.1%mRAPD。這是因為雨天會降低點云質量,減少每個目標的點數,從而導致“缺失點問題”。由于沒有互補傳感器,模型L無法補償減少激光雷達點的信息損失。在這種情況下,與相機圖像的融合彌補了“缺失點問題”,只減少了4.0%mRAPD、

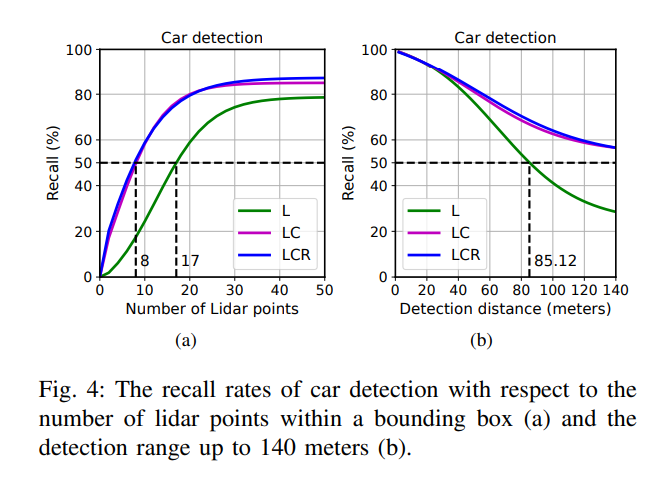

對于LC模型。LCR模型對天氣條件最為穩健減少2.7%mRAPD,因為雷達比激光雷達或相機受雨天影響小,論文進一步研究了LCR融合在激光雷達點密度和檢測距離方面的性能,對L、LC和LCR模型進行了比較,圖4(a)和圖4(b)分別顯示了汽車檢測的召回率與邊界框內激光雷達點的數量和140米內的檢測范圍有關。

與僅使用激光雷達的網絡相比,將激光雷達點與相機圖像融合顯著提高了召回率。盡管L型激光雷達使用17次以上的激光雷達觀測且85米探測范圍內的召回率達到50%以上,但LC型激光雷達只需要8個激光雷達點,即使在140米處,召回率也保持在近60%。在相同的激光雷達密度或探測距離下,LCR略微提高了1%的召回率。

2) CR融合:當執行相機-雷達融合(CR)時,使用雷達觀測(R點)的3D位置和相機分支網絡(C點)預測的3D物體質心來提取相機特征。那些camera特征被重新投影到BEV平面上,以便與雷達特征進行融合,因此,融合性能高度依賴于3D點的“質量”。

本消融研究評估了用于CR融合的3D點的原點的影響,在推理過程中,根據用R點和C點(C,R點)訓練的CR模型,交替使用點類型將相機特征投影到BEV網格上。作者將使用C和R點“CR(+C,R點)”的推理與使用C點“CR”(+C點)或R點“CR+R點”的推理進行比較。

此外還測試了使用激光雷達點位置(L點)提取相機特征時CR融合的性能,稱為“CR(+L點)”,它作為CR融合的上限,假設C和R點可以匹配L點的密度和精度。最后使用激光雷達專用探測器“L”作為基準,結果如圖5(b)所示。從圖中可以看出C點在CR融合中的重要性:“CR(+C點)”比“CR(+R點)”高出5%的AP,并且在C點之外加上R點并不能改善融合,正如“CR(+2點)”和“CR(+3點,R點))”之間的類似性能所示。一個原因可能是C點可以用有用的相機特征捕捉更多的物體位置,而R點的位置不準確或由于測量誤差和遮擋而丟失。

此外,將“CR(+L點)”與其他CR模型進行比較,論文觀察到高達40%AP的顯著性能提升。“CR(+L點)”甚至在距離大于70米的情況下優于僅使用激光雷達的檢測器,盡管它是在沒有任何激光雷達點的情況下訓練的。結果表明,在提取相機特征時,準確和密集的3D位置非常重要。

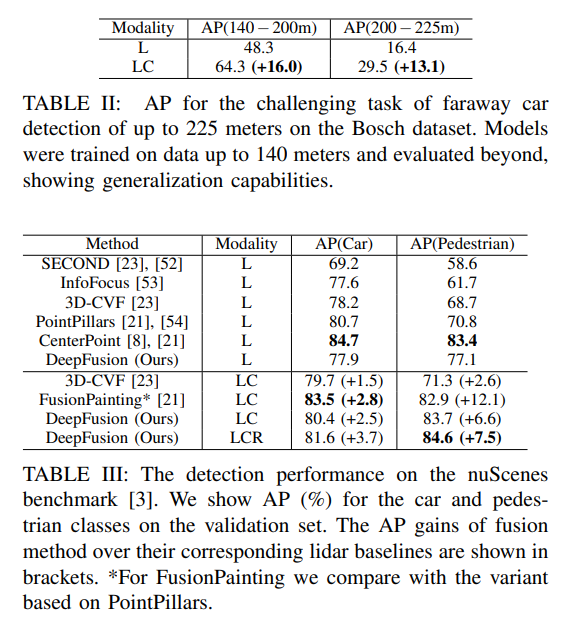

3) 遠距離物體檢測:表II比較了用于遠距離汽車檢測的L和LC模型。盡管這兩個模型的訓練距離都只有140米,但所提出的融合架構不斷改進訓練范圍之外的僅使用激光雷達的檢測器,并在200米以上達到近30%的AP,結果驗證了該模型的長期可擴展性。

4)nuScenes數據集上評估

作者基于具有挑戰性的nuScenes基準對基于激光雷達的模型進行了評估,用于3D目標檢測。由于根據預訓練規則,在COCO上訓練的MaskRCNN網絡不允許出現在nuScenes檢測排行榜中,因此作者使用輕量級的EfficientNetB0架構,并將來自ImageNet的預訓練權重作為camera backbone。

此外,在將輸入圖像輸入到模型中之前,將輸入圖像從原生分辨率1600×900縮小到576×256。論文發現這種分辨率足以在減少推理時間的情況下獲得良好的融合結果。由于激光雷達和雷達點在數據集中非常稀疏,論文遵循nuScenes的常見做法,為論文的模型聚合多達10個激光雷達掃描和多達7個雷達掃描,并進行自我運動補償,聚集的激光雷達掃描用于當前相機圖像的BEV變換。作者還比較了融合方法的激光雷達基線性能,為此,使用了nuScenes驗證分割,因為相關論文報告了它們的激光雷達基線性能。

表III比較了nuScenes驗證集上汽車和行人等級的AP得分,論文將重點放在這兩個最有代表性的層級上,以排除[51]中研究的明顯的層級不平衡問題的影響。憑借77.9和77.1的汽車和行人檢測AP,論文的PointPillar類激光雷達模型(L)提供了堅實的基線。

將激光雷達點與相機圖像(LC模型)融合,分別提高了車輛和行人類別的激光雷達模型(L)的+2.5%AP和+6.6%AP得分,這表明了相機圖像紋理特征的重要性,尤其是在檢測小物體時。激光雷達相機雷達模型(LCR)獲得了最佳結果,與激光雷達模型(L)相比,AP增益分別為+3.7%和+7.5%,驗證了論文的融合設計有效性。

審核編輯:劉清

-

傳感器

+關注

關注

2576文章

55028瀏覽量

791238 -

檢測器

+關注

關注

1文章

931瀏覽量

49933 -

RGB

+關注

關注

4文章

831瀏覽量

61938 -

激光雷達

+關注

關注

979文章

4469瀏覽量

196506

原文標題:超過200米!多傳感器融合新基線DeepFusion:一個魯棒的LiDAR-相機-Radar融合3D檢測器

文章出處:【微信號:3D視覺工坊,微信公眾號:3D視覺工坊】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

LuatOS 系統框架的模塊化設計原理

模塊化高精度銣原子鐘存在的意義

模塊化UPS電源:重塑關鍵供電系統的未來架構

MCU自動測量單元的分布式模塊化設計有什么用?

鼎陽科技推PXIe模塊化示波器、PXIe模塊化矢量網絡分析儀產品組合,構建新一代模塊化、軟件定義的測試平臺

modbus消息幀的模塊化架構介紹

如何配置和管理MCU分布式模塊化自動測量單元

儲能變流升壓一體機:模塊化集成設計,賦能高效可靠儲能系統

鴻蒙5開發寶藏案例分享---模塊化設計案例分享

原理圖模塊化,BOM 物料位號處理

軟硬解耦+模塊化:深度拆解開放架構的“自由”基因

模塊化設計賦能:工控一體機廠家聚徽分享如何通過靈活架構滿足多樣化工業需求?

MCU分布式模塊化自動測量單元:數據傳輸與處理能力如何?

介紹一種模塊化多模式架構DeepFusion

介紹一種模塊化多模式架構DeepFusion

評論