Cerebras公司的技術將在數小時而非數周的時間里完成對這些人工智能系統的訓練。

人工智能計算機初創企業Cerebras Systems的聯合創始人兼首席執行官安德魯?費爾德曼(Andrew Feldman)表示,今天的人工智能效率遠低于它本應能達到的效率。

他和公司的其他聯合創始人一致認為,如今的人工神經網絡在訓練上太過耗時,計算量太大。比如說,要讓一輛自動駕駛汽車識別出它在路上會遇到的所有重要物體,則需要向汽車的神經網絡展示大量有關這些物體的圖像。這個過程發生在數據中心,耗電數十千瓦有時甚至數百千瓦的計算機會專門處理這種常常耗時長達數周的任務。假如生成的網絡能夠以所需精確度執行這項任務,則定義網絡連接強度的多個系數隨后會被下載到汽車的計算機中,然后去執行另一半深度學習工作,即推理。

Cerebras的客戶(該公司已經有一些客戶了,不過在去年夏天還在保密狀態)抱怨說,在當今的計算機上進行大型神經網絡訓練可能需要長達6周的時間。以這樣的速度,他們一年可能只能訓練6個神經網絡。“我們的目的是測試更多的想法,”費爾德曼說,“如果你能在2到3個小時內(訓練1個網絡),那么你就可以運行數千個想法。”

記者參觀Cerebras公司位于加州洛思阿圖斯(Los Altos)的總部時,這些客戶和部分潛在新客戶已經在用有橙色護套的光纜將他們的訓練數據導入4臺CS-1計算機中。這些64厘米高、功率為20千瓦的機器不停地運轉,產生的熱量通過墻上的一個孔洞被排放到了硅谷的街道上。

從外觀來說,CS-1計算機本身并不特別。實際上,每個機箱的3/4都被冷卻系統占據,而另外1/4空間中的內容才具有真正的“變革性”:一臺非常強大的計算機幾乎完全由一塊單一芯片組成。不過這塊芯片的面積超過46255平方毫米,是任何市售處理器芯片面積的50多倍。借助1.2萬億個晶體管、40萬個處理器內核、18千兆字節的靜態隨機存儲器(SRAM)以及每秒可移動100千萬億字節的互連技術,Cerebras的晶圓級引擎(WSE)可輕松秒殺其他系統。

Cerebras引用的統計數據是相當驚人的。該公司稱,一個10機架的TPU2集群(谷歌人工智能計算機產品的第二代)消耗的功率是單臺WSE計算機的5倍,占用的空間是它的30倍,性能卻僅為其1/3。單一巨型芯片是否真的是人工智能界一直在等待的答案,今年將變得明朗起來。“(神經網絡)模型越來越復雜,”加州山景城林利集團(Linley Group)的高級分析師邁克?戴姆勒(Mike Demler)說,“能夠快速訓練或再訓練非常重要。”

芝加哥附近的超級計算機巨頭阿貢國家實驗室等客戶已經在自己的辦公場所安裝了這種機器,如果Cerebras的推測是正確的,那么有出色表現的神經網絡的數量將呈爆炸式增長。

費爾德曼解釋說,Cerebras的創始人們(都是服務器公司Sea Micro的老員工,Sea Micro被超微半導體公司AMD收購)在2015年初次開會時便希望打造一臺完美符合現代人工智能工作量性質的計算機。這些工作量由以下幾點定義:快速移動大量數據,接近處理內核的內存,而且這些內核不需要處理其他內核正在處理的數據。

這立刻給包括首席技術官加里?勞特巴赫(Gary Lauter-bach)在內的資深計算機架構師提供了一些想法。首先,他們可以使用成千上萬個用于進行相關神經網絡計算的小內核,而不是使用更少量的通用內核。其次,這些內核應該與一個低能耗且可以快速移動數據的互連方案連接在一起。最后,所有所需數據應位于處理器芯片中,而不是多個單獨的存儲芯片上。

很大程度上正是在這些內核之間移動數據的需要讓WSE變得獨一無二。在兩個內核之間移動數據最快、能耗最低的方法就是將它們放在同一個硅基板上。數據必須從一塊芯片傳輸到另一塊芯片時,速度和功率方面的代價都很高,因為距離很長,傳輸信號的“電線”必須更粗且密度更小。

通過硅片實現所有通信的欲望,加上對小內核和本地存儲的渴望,都指向制造一塊盡可能大的芯片(也許大如一整塊硅晶圓)。費爾德曼說:“顯然我們做不到這一點,這是肯定的。但這很明顯有很大的好處。”

幾十年來,工程師們一直認為研究晶圓級芯片是一個死胡同。畢竟,出色如已故IBM System/360大型機首席架構師吉恩?阿姆達爾(Gene Amdahl),也在與Trilogy Systems公司合作進行的嘗試中失敗了。不過勞特巴赫和費爾德曼說,任何與阿姆達爾的嘗試進行的比較都很可笑而且過時的。阿姆達爾使用的晶圓只有如今晶圓的1/10大,而在這些晶圓上組成的設備尺寸卻是現今設備的30倍。

更重要的是,Triology無法解決芯片制造過程中不可避免出現的錯誤。在其他條件相同的情況下,芯片越大出現缺陷的可能性就越大。如果芯片和一張信紙一樣大,那么它必然會有不少缺陷。

不過,勞特巴赫找到了架構解決方案。由于他們的目標工作量偏向于采用成千上萬個相同的小內核,所以可以容納足夠多的冗余內核來承擔其中高達1%的缺陷所導致的故障,與此同時仍然能有一塊非常強大、非常大的芯片。

當然,為了制造能容納缺陷的巨型芯片,Cerebras還是需要解決大量制造問題。例如,光刻工具能夠將它們的特征定義圖案刻蝕到相對較小的矩形上,并不斷重復。由于在晶圓不同位置刻蝕不同圖案的成本和難度較高,僅此一項就導致無法將許多系統構建在單個晶圓上。

不過WSE不需要這樣做。它就像一塊充滿了完全相同的芯片的普通標準晶圓一樣。最大的挑戰是找到一種將這些偽芯片連接在一起的方法。芯片制造商在每個芯片周圍留下了一條稱為“劃線”的空白硅窄邊。通常會沿著這些線將晶圓切成小塊。Cerebras與臺灣積體電路制造股份有限公司(TSMC)合作開發了一種跨越劃線實現互連的方式,以便每塊偽芯片中的內核都可以通信。

由于所有通信和內存都在一塊硅片上,數據可以暢通無阻地快速移動,實現每秒1000拍比特的內核到內核帶寬和每秒9拍字節的SRAM到內核帶寬。“這多的可不是一點點。”費爾德曼說,”就是因為我們繼續使用了硅,我們將帶寬提升了4個數量級。”

除了實現跨劃線互連,芯片制造硬件也必須修改。即便是用于電子設計自動化的軟件,也必須定制才能在如此大的芯片上工作。“每一條規則、每一種工具和每一種制造設備的設計都像是挑選一塊普通大小的巧克力餅干。而(我們)提供的是一整塊烤盤大的餅干,”費爾德曼說,“其中的每一步都需要創新。”

晶圓級集成“在過去40年里一直被忽視,當然,總有一天它會得到重視”,他說。現在,既然Cerebras已經這樣做了,大門可能會向其他人敞開。“我們認為,其他公司會尋求與我們合作,以解決人工智能之外的問題。”

確實,伊利諾伊大學和加州大學洛杉磯分校的工程師們認為,Cerebras芯片可以促進他們使用硅互連結構技術推進他們的晶圓級計算工作。“這是對我們所做研究的極大驗證,”伊利諾伊大學的拉凱什?庫馬爾(Rakesh Kumar)說,“我們很高興這種事情有商業利益。”

當然,CS-1不僅僅是WSE芯片,但它也沒有更多內容。這既是出于設計,也是出于必要。被看作主板的,是一個位于芯片上方的電力輸送系統,其下方還有一塊水冷冷板。令人驚訝的是,在這款計算機的開發過程中,最大的挑戰便是這個電力傳輸系統。

WSE有1.2萬億個晶體管,其設計工作電壓約為0.8伏,這是處理器的標準配置,但它們的數量過多,共需要2萬安培的電流。勞特巴赫說:“在沒有明顯電壓下降的情況下,將2萬安培的電流注入晶圓是一個相當艱巨的工程學挑戰,這比冷卻晶圓或解決成品率問題要難得多。”

電力無法從WSE的邊緣傳輸,因為互連中的電阻在電壓到達芯片中間之前早已將其降為零。所以應該自上而下垂直傳輸。Cerebras設計了一塊玻璃纖維電路板,里面裝有數百個用于功率控制的專用芯片。100萬根銅柱將玻璃纖維板與WSE上各個點之間約1毫米的距離連接起來。

以這種方式傳送電力似乎很簡單,但事實并非如此。操作過程中,芯片、電路板和冷板都會預熱到相同的溫度,但在預熱時它們膨脹的量各不相同。銅膨脹最大,硅膨脹最小,玻璃纖維的膨脹介于兩者之間。對正常尺寸的芯片來說,這種不匹配是一個令人頭疼的問題,因為這種變化足以切斷它們與印刷電路板的連接,或者產生足以破壞芯片的應力。對于WSE大小的芯片而言,即使是很小的尺寸變化也會轉化為幾毫米的變化。

勞特巴赫說:“與主板(熱膨脹系數)不匹配是一個殘酷的問題。”Cerebras曾嘗試尋找一種熱膨脹系數介于硅和玻璃纖維之間的材料,只有這樣才能保持百萬個電力輸送柱的連接。不過,最終工程師們不得不自己發明材料,這項工作耗時1年半。

WSE明顯比通常用于神經網絡計算的競爭芯片要大,后者包括英偉達的Tesla V100圖形處理器和谷歌的Tensor處理器,但更大意味著更好嗎?

2018年,谷歌、百度和一些頂級學術團體開始研究基準,以便在系統之間進行同類比較。結果是他們于2018年5月發布了訓練基準MLPerf。

根據這些基準,神經網絡訓練技術在過去幾年里取得了巨大進步。英偉達DGXSuperPOD(本質上是一臺1500-GPU的超級計算機)用了80秒便解決了ResNet-50圖像分類問題,而使用英偉達DGX-1機器(大概在2017年)需要8小時,使用該公司2015年的K80則需要25天。

Cerebras還沒有發布MLPerf結果或任何其他可獨立驗證的同類比較結果。相反,該公司更愿意讓客戶使用自己的神經網絡和數據來測試CS-1。

分析人士稱這種做法并不罕見。“每個人都有為自己的業務開發的模型,”Moor Insights的人工智能分析師卡爾?弗洛因德(Karl Freund)說,“對買家來說,這是唯一重要的。”

例如,早期客戶阿貢國家實驗室就有一些相當強烈的需求。在訓練神經網絡以實時識別不同類型的引力波事件時,科學家們最近使用了阿貢功率為百萬瓦特的Theta超級計算機1/4的資源,該超級計算機的計算能力在全球排名第28位。

把功耗降低到千瓦級似乎是超級計算的一個重要益處,勞特巴赫懷疑這項功能是否會成為數據中心的一大賣點。“雖然很多數據中心都在說(節約)能源的問題,但歸根結底……他們并不在乎,”他說,“他們想要的是性能。”而這是一個約餐盤大小的處理器完全可以提供的。

審核編輯 :李倩

-

芯片

+關注

關注

463文章

54010瀏覽量

466040 -

人工智能

+關注

關注

1817文章

50098瀏覽量

265358 -

深度學習

+關注

關注

73文章

5599瀏覽量

124398

原文標題:大型芯片將打破深度學習的速度壁壘

文章出處:【微信號:HXSLH1010101010,微信公眾號:FPGA技術江湖】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

【團購】獨家全套珍藏!龍哥LabVIEW視覺深度學習實戰課(11大系列課程,共5000+分鐘)

【團購】獨家全套珍藏!龍哥LabVIEW視覺深度學習實戰課程(11大系列課程,共5000+分鐘)

如何深度學習機器視覺的應用場景

打破智能家居生態壁壘,樂鑫一站式Matter解決方案實現無縫互聯

打破智能家居壁壘,Matter協議引領無縫互聯新時代

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+第二章 實現深度學習AI芯片的創新方法與架構

如何在機器視覺中部署深度學習神經網絡

深度學習對工業物聯網有哪些幫助

自動駕駛中Transformer大模型會取代深度學習嗎?

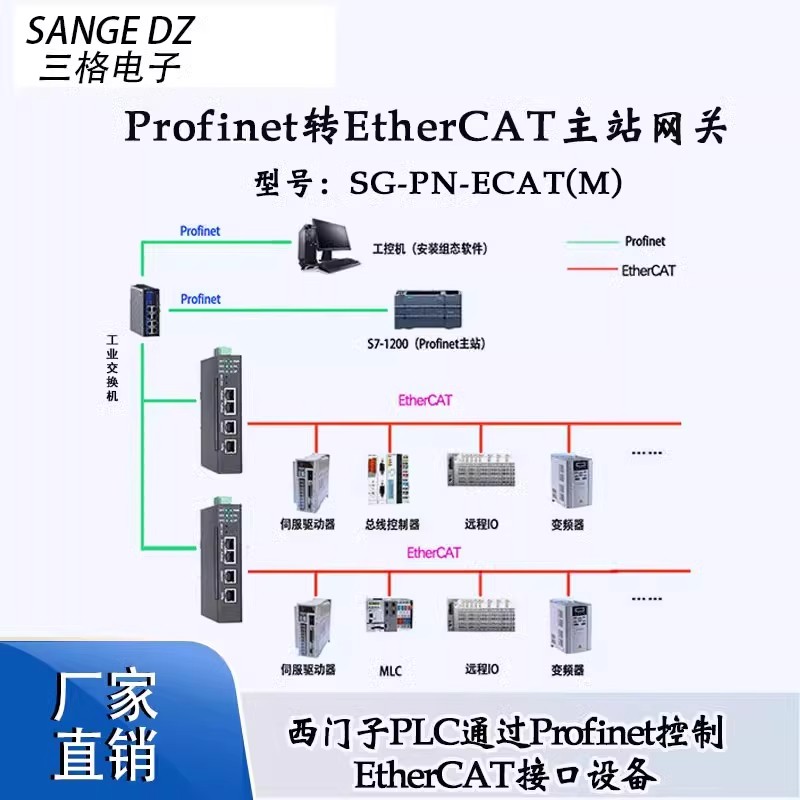

打破協議壁壘!三格電子Profinet轉EtherCAT主站網關,讓工業設備自由對話

PROFINET轉EtherCAT網關模塊:打破工業通訊協議壁壘的利刃

用樹莓派搞深度學習?TensorFlow啟動!

廠家芯資訊|WTK6900系列語音識別芯片自學習功能深度答疑

大型芯片將打破深度學習的速度壁壘

大型芯片將打破深度學習的速度壁壘

評論