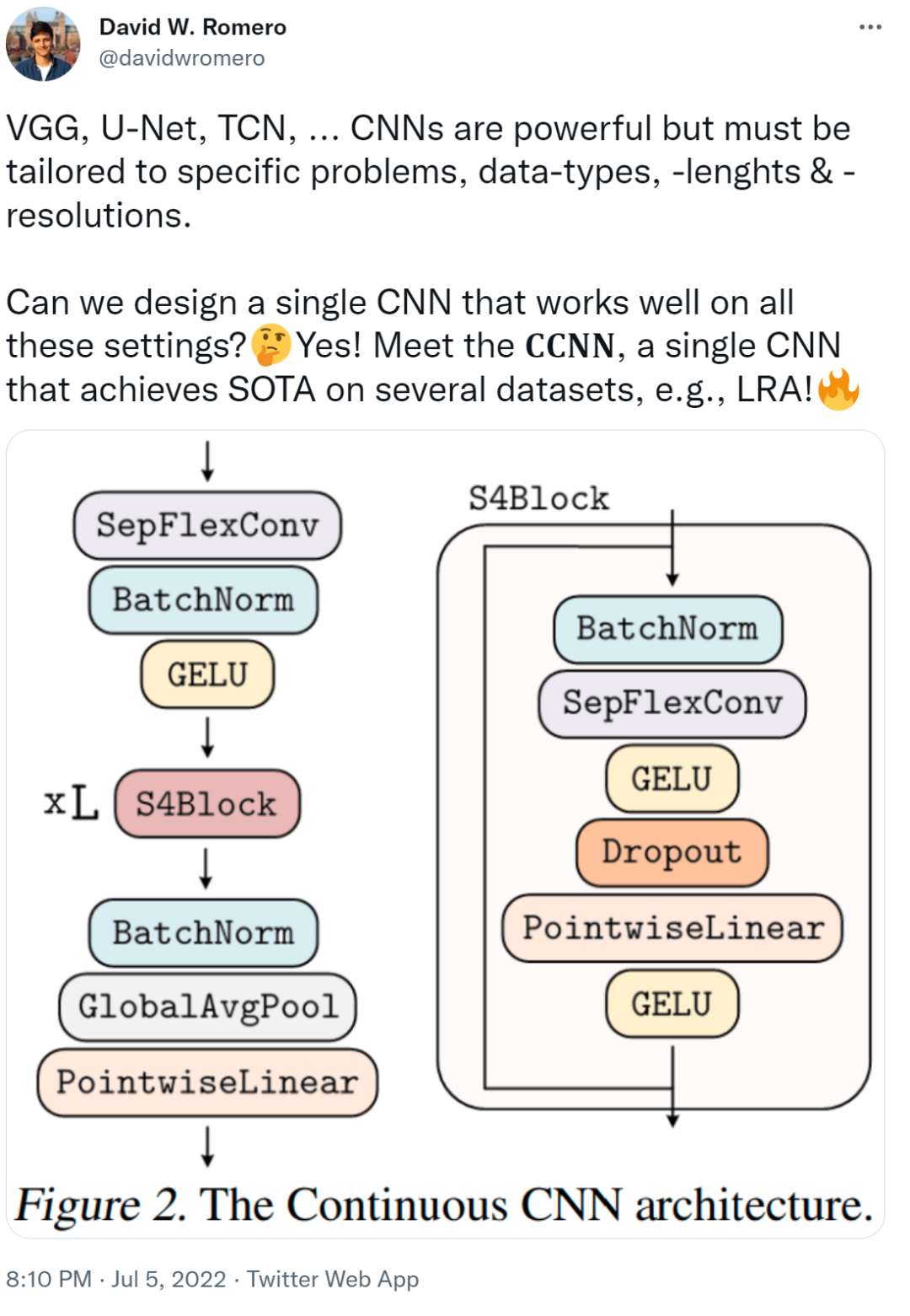

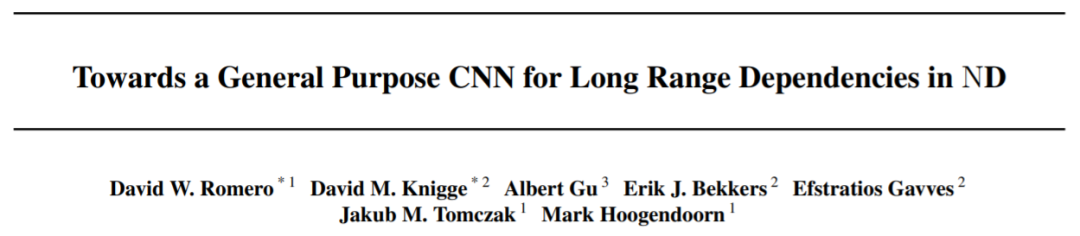

在 VGG、U-Net、TCN 網(wǎng)絡(luò)中... CNN 雖然功能強(qiáng)大,但必須針對特定問題、數(shù)據(jù)類型、長度和分辨率進(jìn)行定制,才能發(fā)揮其作用。我們不禁會問,可以設(shè)計出一個在所有這些網(wǎng)絡(luò)中都運(yùn)行良好的單一 CNN 嗎? 本文中,來自阿姆斯特丹自由大學(xué)、阿姆斯特丹大學(xué)、斯坦福大學(xué)的研究者提出了 CCNN,單個 CNN 就能夠在多個數(shù)據(jù)集(例如 LRA)上實(shí)現(xiàn) SOTA !

- 論文地址:https://arxiv.org/pdf/2206.03398.pdf

- 代碼地址:https://github.com/david-knigge/ccnn

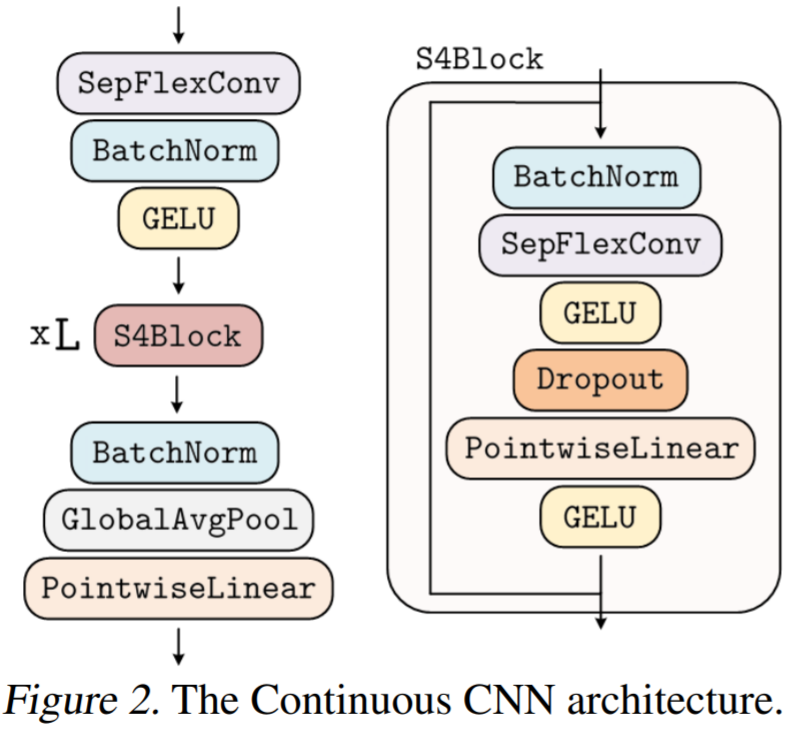

- 該研究提出 Continuous CNN(CCNN):一個簡單、通用的 CNN,可以跨數(shù)據(jù)分辨率和維度使用,而不需要結(jié)構(gòu)修改。CCNN 在序列 (1D)、視覺 (2D) 任務(wù)、以及不規(guī)則采樣數(shù)據(jù)和測試時間分辨率變化的任務(wù)上超過 SOTA;

- 該研究對現(xiàn)有的 CCNN 方法提供了幾種改進(jìn),使它們能夠匹配當(dāng)前 SOTA 方法,例如 S4。主要改進(jìn)包括核生成器網(wǎng)絡(luò)的初始化、卷積層修改以及 CNN 的整體結(jié)構(gòu)。

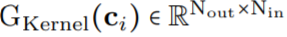

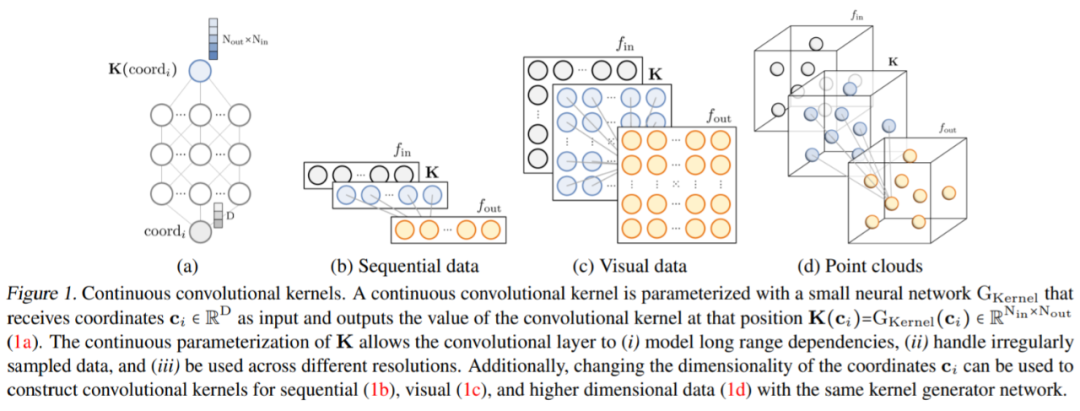

作為核生成器網(wǎng)絡(luò),同時將卷積核參數(shù)化為連續(xù)函數(shù)。該網(wǎng)絡(luò)將坐標(biāo)

作為核生成器網(wǎng)絡(luò),同時將卷積核參數(shù)化為連續(xù)函數(shù)。該網(wǎng)絡(luò)將坐標(biāo) 映射到該位置的卷積核值:

映射到該位置的卷積核值: (圖 1a)。通過將 K 個坐標(biāo)

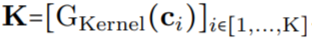

(圖 1a)。通過將 K 個坐標(biāo) 的向量通過 G_Kernel,可以構(gòu)造一個大小相等的卷積核 K,即

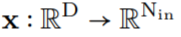

的向量通過 G_Kernel,可以構(gòu)造一個大小相等的卷積核 K,即 。隨后,在輸入信號

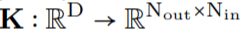

。隨后,在輸入信號 和生成的卷積核

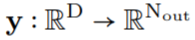

和生成的卷積核 之間進(jìn)行卷積運(yùn)算,以構(gòu)造輸出特征表示

之間進(jìn)行卷積運(yùn)算,以構(gòu)造輸出特征表示 ,即

,即 。

。

任意數(shù)據(jù)維度的一般操作。通過改變輸入坐標(biāo) c_i 的維數(shù) D,核生成器網(wǎng)絡(luò) G_Kernel 可用于構(gòu)造任意維數(shù)的卷積核。因此可以使用相同的操作來處理序列 D=1、視覺 D=2 和更高維數(shù)據(jù) D≥3。 不同輸入分辨率的等效響應(yīng)。如果輸入信號 x 有分辨率變化,例如最初在 8KHz 觀察到的音頻現(xiàn)在在 16KHz 觀察到,則與離散卷積核進(jìn)行卷積以產(chǎn)生不同的響應(yīng),因?yàn)楹藢⒃诿總€分辨率下覆蓋不同的輸入子集。另一方面,連續(xù)核是分辨率無關(guān)的,因此無論輸入的分辨率如何,它都能夠識別輸入。 當(dāng)以不同的分辨率(例如更高的分辨率)呈現(xiàn)輸入時,通過核生成器網(wǎng)絡(luò)傳遞更精細(xì)的坐標(biāo)網(wǎng)格就足夠了,以便以相應(yīng)的分辨率構(gòu)造相同的核。對于以分辨率 r (1) 和 r (2) 采樣的信號 x 和連續(xù)卷積核 K,兩種分辨率下的卷積大約等于與分辨率變化成比例的因子:

生成的核計算的,之后是從 N_in 到 N_out 進(jìn)行逐點(diǎn)卷積。這種變化允許構(gòu)建更廣泛的 CCNN—— 從 30 到 110 個隱藏通道,而不會增加網(wǎng)絡(luò)參數(shù)或計算復(fù)雜度。

生成的核計算的,之后是從 N_in 到 N_out 進(jìn)行逐點(diǎn)卷積。這種變化允許構(gòu)建更廣泛的 CCNN—— 從 30 到 110 個隱藏通道,而不會增加網(wǎng)絡(luò)參數(shù)或計算復(fù)雜度。正確初始化核生成器網(wǎng)絡(luò) G_Kernel。該研究觀察到,在以前的研究中核生成器網(wǎng)絡(luò)沒有正確初始化。在初始化前,人們希望卷積層的輸入和輸出的方差保持相等,以避免梯度爆炸和消失,即 Var (x)=Var (y)。因此,卷積核被初始化為具有方差 Var (K)=gain^2 /(in channels ? kernel size) 的形式,其增益取決于所使用的非線性。 然而,神經(jīng)網(wǎng)絡(luò)的初始化使輸入的 unitary 方差保留在輸出。因此,當(dāng)用作核生成器網(wǎng)絡(luò)時,標(biāo)準(zhǔn)初始化方法導(dǎo)致核具有 unitary 方差,即 Var (K)=1。結(jié)果,使用神經(jīng)網(wǎng)絡(luò)作為核生成器網(wǎng)絡(luò)的 CNN 經(jīng)歷了與通道?內(nèi)核大小成比例的特征表示方差的逐層增長。例如,研究者觀察到 CKCNNs 和 FlexNets 在初始化時的 logits 大約為 1e^19。這是不可取的,這可能導(dǎo)致訓(xùn)練不穩(wěn)定和需要低學(xué)習(xí)率。 為了解決這個問題,該研究要求 G_Kernel 輸出方差等于 gain^2 /(in_channels?kernel_size)而不是 1。他們通過、

重新加權(quán)核生成器網(wǎng)絡(luò)的最后一層。因此,核生成器網(wǎng)絡(luò)輸出的方差遵循傳統(tǒng)卷積核的初始化,而 CCNN 的 logits 在初始化時呈現(xiàn)單一方差。

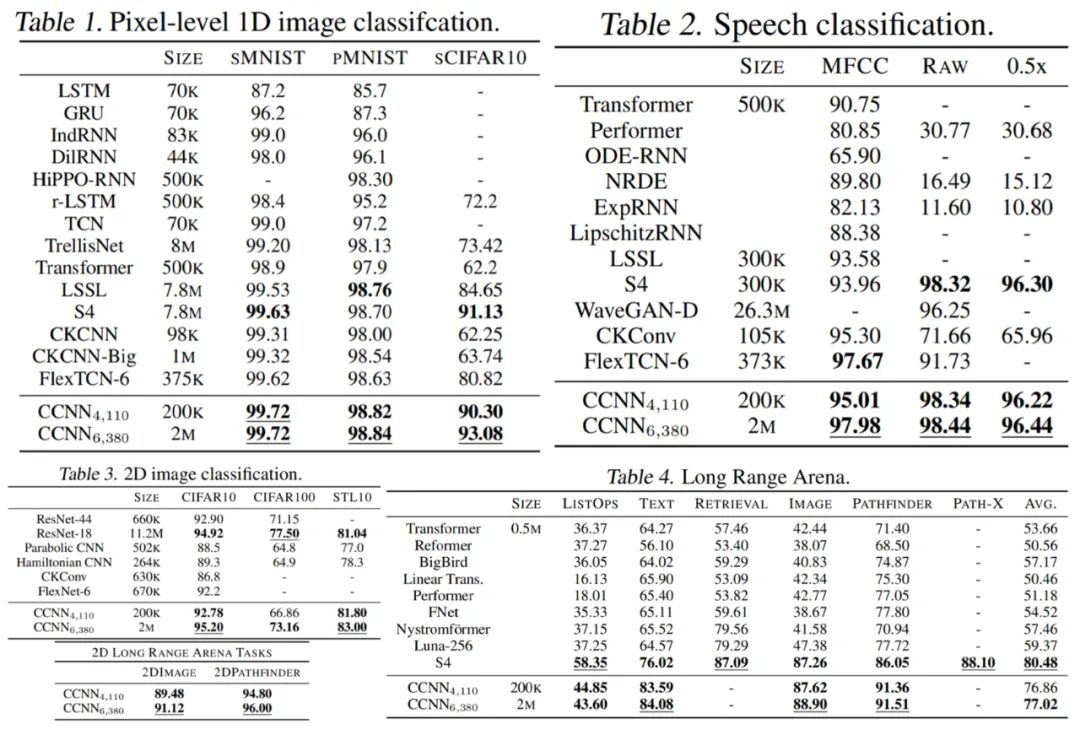

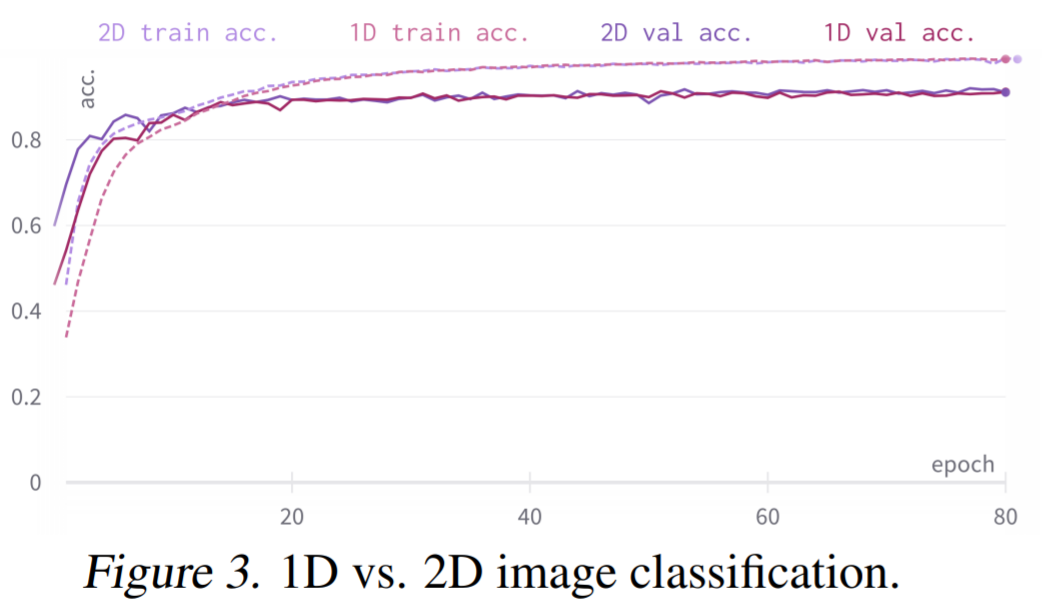

重新加權(quán)核生成器網(wǎng)絡(luò)的最后一層。因此,核生成器網(wǎng)絡(luò)輸出的方差遵循傳統(tǒng)卷積核的初始化,而 CCNN 的 logits 在初始化時呈現(xiàn)單一方差。實(shí)驗(yàn)結(jié)果 如下表 1-4 所示,CCNN 模型在所有任務(wù)中都表現(xiàn)良好。 首先是 1D 圖像分類 CCNN 在多個連續(xù)基準(zhǔn)上獲得 SOTA,例如 Long Range Arena、語音識別、1D 圖像分類,所有這些都在單一架構(gòu)中實(shí)現(xiàn)的。CCNN 通常比其他方法模型更小架構(gòu)更簡單。 然后是 2D 圖像分類:通過單一架構(gòu),CCNN 可以匹配并超越更深的 CNN。

聲明:本文內(nèi)容及配圖由入駐作者撰寫或者入駐合作網(wǎng)站授權(quán)轉(zhuǎn)載。文章觀點(diǎn)僅代表作者本人,不代表電子發(fā)燒友網(wǎng)立場。文章及其配圖僅供工程師學(xué)習(xí)之用,如有內(nèi)容侵權(quán)或者其他違規(guī)問題,請聯(lián)系本站處理。

舉報投訴

-

架構(gòu)

+關(guān)注

關(guān)注

1文章

532瀏覽量

26590 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5599瀏覽量

124398 -

cnn

+關(guān)注

關(guān)注

3文章

355瀏覽量

23422

原文標(biāo)題:解決CNN固有缺陷, CCNN憑借單一架構(gòu),實(shí)現(xiàn)多項(xiàng)SOTA

文章出處:【微信號:CVSCHOOL,微信公眾號:OpenCV學(xué)堂】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

熱點(diǎn)推薦

CNN卷積神經(jīng)網(wǎng)絡(luò)設(shè)計原理及在MCU200T上仿真測試

數(shù)的提出很大程度的解決了BP算法在優(yōu)化深層神經(jīng)網(wǎng)絡(luò)時的梯度耗散問題。當(dāng)x>0 時,梯度恒為1,無梯度耗散問題,收斂快;當(dāng)x<0 時,該層的輸出為0。

CNN

發(fā)表于 10-29 07:49

構(gòu)建CNN網(wǎng)絡(luò)模型并優(yōu)化的一般化建議

整個模型非常巨大。所以要想實(shí)現(xiàn)輕量級的CNN神經(jīng)網(wǎng)絡(luò)模型,首先應(yīng)該避免嘗試單層神經(jīng)網(wǎng)絡(luò)。

2)減少卷積核的大小:CNN神經(jīng)網(wǎng)絡(luò)是通過權(quán)值共享的方式,利用卷積運(yùn)算從圖像中提取線性紋理。在

發(fā)表于 10-28 08:02

卷積運(yùn)算分析

的數(shù)據(jù),故設(shè)計了ConvUnit模塊實(shí)現(xiàn)單個感受域規(guī)模的卷積運(yùn)算.

卷積運(yùn)算:不同于數(shù)學(xué)當(dāng)中提及到的卷積概念,CNN神經(jīng)網(wǎng)絡(luò)中的卷積嚴(yán)格意義上

發(fā)表于 10-28 07:31

蜂鳥E203的浮點(diǎn)指令集F的一些實(shí)現(xiàn)細(xì)節(jié)

蜂鳥E203的浮點(diǎn)指令集F的一些實(shí)現(xiàn)細(xì)節(jié)

既然E203不是多發(fā)射,且為了節(jié)省面積,一些指令使用FPU內(nèi)的同一個子模塊來執(zhí)行,即FPU同時只能進(jìn)行一種計算,我們只在FPU內(nèi)部署了11個子模塊,每種

發(fā)表于 10-24 08:57

用于RISCV的F指令集實(shí)現(xiàn)的浮點(diǎn)計算單元(FPU)設(shè)計方案

fclass.s

e203_exu_fpu_fmvwx_fmvxw 實(shí)現(xiàn)指令fmv.w.x fmv.x.w

結(jié)構(gòu)和控制信號設(shè)計

如上一節(jié),實(shí)際上的模塊數(shù)量小于26,復(fù)用一些模塊使單個模塊

發(fā)表于 10-24 07:43

指令集P擴(kuò)展的主要內(nèi)容

;SIMD指令擴(kuò)展,SIMD指令可以在單個指令中執(zhí)行多個相同或類似的操作,可以提高處理器的運(yùn)算速度,通過添加SIMD指令,可以提高處理器的計算能力。

2. 指令集P擴(kuò)展的主要代碼

/

發(fā)表于 10-21 10:50

宏集HMI-4G套裝,輕松搞定“數(shù)據(jù)上云+異地遠(yuǎn)程運(yùn)維”

工業(yè)現(xiàn)場設(shè)備分散、環(huán)境復(fù)雜、網(wǎng)絡(luò)難部署?宏集 HMI-4G 套裝一站搞定!輕松打破數(shù)據(jù)孤島,實(shí)現(xiàn)數(shù)據(jù)上云與遠(yuǎn)程運(yùn)維。文末附有真實(shí)客戶案例,歡

AURIX tc367通過 MCU SOTA 更新邏輯 IC 閃存是否可行?

你好專家:我的用例是 MCU 通過 SPI 連接到邏輯 IC,邏輯 IC 連接到 8MB 閃存,但 MCU PFLASH 大小為 2MB,通過 MCU SOTA 更新邏輯 IC 閃存是否可行?

發(fā)表于 08-11 06:36

求助,關(guān)于TC387使能以及配置SOTA 中一些問題求解

設(shè)置寫保護(hù)密碼, 而設(shè)置為CONFIRMED則必須有密碼,設(shè)置密碼后,后續(xù)對UCB的操作是否每次都要有解鎖操作 ,

問題3:

在調(diào)試UCB去使能SOTA的過程中,出現(xiàn)debug口無法調(diào)試刷寫

發(fā)表于 08-08 07:31

東集RFID讀寫器有什么用

,利用RFID讀寫器自動識別和記錄貨物的入庫、出庫和流轉(zhuǎn),能夠顯著提高管理的精準(zhǔn)度。2. 零售業(yè)RFID技術(shù)在零售行業(yè)也展現(xiàn)出極大的潛力。商家可以在商品上貼上RFID標(biāo)簽,不僅能加快結(jié)

發(fā)表于 06-20 10:36

數(shù)據(jù)集下載失敗的原因?

數(shù)據(jù)集下載失敗什么原因太大了嗎,小的可以下載,想把大的下載去本地訓(xùn)練報錯網(wǎng)絡(luò)錯誤

大的數(shù)據(jù)集多大?數(shù)據(jù)量有多少?

發(fā)表于 06-18 07:04

【高云GW5AT-LV60 開發(fā)套件試用體驗(yàn)】基于開發(fā)板進(jìn)行深度學(xué)習(xí)實(shí)踐,并盡量實(shí)現(xiàn)皮膚病理圖片的識別

可以多看看。*附件:fpga_cnn.rar

相關(guān)文件都在里面了

探索了一陣子cnn,并且也跟著網(wǎng)上的一些開源的方案學(xué)習(xí)一些

比如這里的:# 一起學(xué)習(xí)用Verilog在FPGA上

發(fā)表于 06-11 22:35

如何在FX3和FX10芯片上運(yùn)行/實(shí)現(xiàn)USB 3.0批量流?

我們正在嘗試在 FX3 和 FX10 芯片上運(yùn)行/實(shí)現(xiàn) USB 3.0 批量流(單個 IN 端點(diǎn)上的多個

發(fā)表于 05-09 06:10

STM32H747I DSI模塊采用一個數(shù)據(jù)通道無法顯示圖片怎么解決?

,但是顯示屏黑屏。可以確定的是D0P/D0N有數(shù)據(jù)輸出,但是無法在顯示屏上顯示。

下面是我在官方例程中修改的地方,其實(shí)就是把兩個數(shù)據(jù)通道改為

發(fā)表于 03-07 08:11

單個CNN就能夠在多個數(shù)據(jù)集上實(shí)現(xiàn)SOTA

單個CNN就能夠在多個數(shù)據(jù)集上實(shí)現(xiàn)SOTA

評論