本次將分享ICLR2021中的三篇投遞文章,涉及知識(shí)圖譜與訓(xùn)練模型相結(jié)合和命名實(shí)體識(shí)別(NER)的研究工作。

文章概覽

知識(shí)圖譜和語(yǔ)言理解的聯(lián)合預(yù)訓(xùn)練(JAKET: Joint Pre-training of Knowledge Graph and Language Understanding)。該論文提出了知識(shí)圖譜和文本的聯(lián)合訓(xùn)練框架,通過(guò)將RoBERTa作為語(yǔ)言模型將上下文編碼信息傳遞給知識(shí)圖譜,同時(shí)借助圖注意力模型將知識(shí)圖譜的結(jié)構(gòu)化信息反饋給語(yǔ)言模型,從而實(shí)現(xiàn)知識(shí)圖譜模型和語(yǔ)言模型的循環(huán)交替訓(xùn)練,使得在知識(shí)圖譜指導(dǎo)下的預(yù)訓(xùn)練模型能夠快速適應(yīng)新領(lǐng)域知識(shí)。

語(yǔ)言模型是開(kāi)放知識(shí)圖譜(Language Models are Open Knowledge Graphs)。該論文提出了能夠自動(dòng)化構(gòu)建知識(shí)圖譜的Match and Map(MAMA)模型,借助預(yù)先訓(xùn)練好的語(yǔ)言模型中的注意力權(quán)重來(lái)提取語(yǔ)料中的實(shí)體間關(guān)系,并基于已有的schema框架自動(dòng)化構(gòu)建開(kāi)放性知識(shí)圖譜。

命名實(shí)體識(shí)別中未標(biāo)記實(shí)體問(wèn)題的研究(Empirical Analysis of Unlabeled Entity Problem in Named Entity Recognition)。論文探究了未標(biāo)注實(shí)體問(wèn)題對(duì)NER實(shí)驗(yàn)指標(biāo)的影響,并提出了一種負(fù)采樣策略,通過(guò)改進(jìn)損失函數(shù),將為標(biāo)注實(shí)體當(dāng)作負(fù)樣本訓(xùn)練,從而極大改善了未標(biāo)注實(shí)體問(wèn)題對(duì)NER實(shí)驗(yàn)指標(biāo)的影響。

論文細(xì)節(jié)

1

論文動(dòng)機(jī)

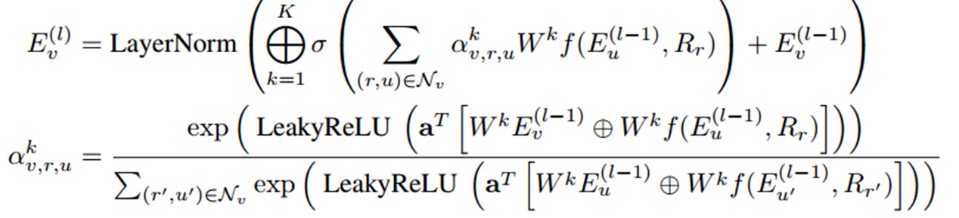

現(xiàn)有的將知識(shí)圖譜與預(yù)訓(xùn)練模型相結(jié)合的研究工作還存在挑戰(zhàn):當(dāng)預(yù)先訓(xùn)練好的模型與新領(lǐng)域中的知識(shí)圖譜結(jié)合微調(diào)時(shí),語(yǔ)言模型難以高效學(xué)習(xí)到結(jié)構(gòu)化的實(shí)體關(guān)系語(yǔ)義信息。同時(shí)知識(shí)圖譜的理解推理能力也需要上下文的輔助。基于此,論文提出了一個(gè)聯(lián)合預(yù)訓(xùn)練框架:JAKET,通過(guò)同時(shí)對(duì)知識(shí)圖譜和語(yǔ)言建模,實(shí)現(xiàn)兩個(gè)模型之間的信息互補(bǔ)和交替訓(xùn)練。方法1. 知識(shí)模塊(Knowledge Module,KM)知識(shí)模塊主要是對(duì)知識(shí)圖譜進(jìn)行建模,生成含有結(jié)構(gòu)化信息的實(shí)體表示。采用圖注意力模型和組合算子思想來(lái)聚合實(shí)體嵌入和關(guān)系嵌入信息。在第L層的實(shí)體V的嵌入信息傳播公式為:

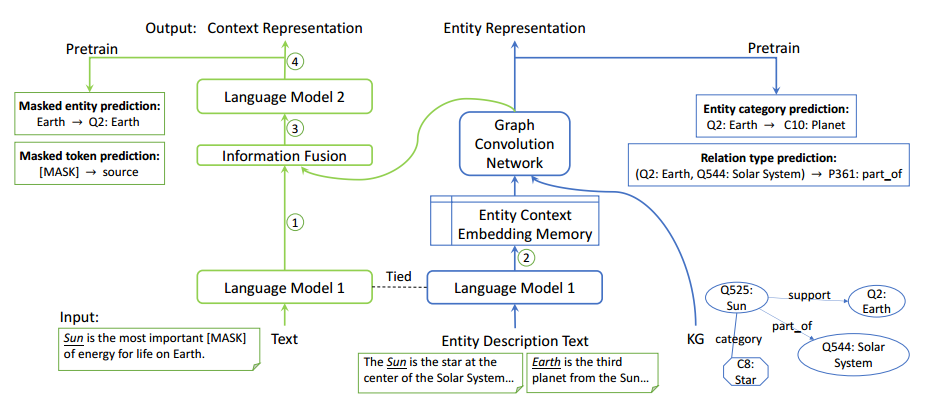

考慮到計(jì)算過(guò)程中可能會(huì)出現(xiàn)的實(shí)體數(shù)爆炸問(wèn)題,實(shí)驗(yàn)采用了設(shè)置minibatch領(lǐng)域采樣的方法獲取多跳鄰居集合。2. 語(yǔ)言模塊(Language Module,LM)語(yǔ)言模塊主要是對(duì)文本建模,學(xué)習(xí)文本的嵌入表示。采用RoBERT-base作為預(yù)訓(xùn)練模型。3.解決循環(huán)依賴問(wèn)題(Solve the syclic dependency)由于LM和KM是互相傳遞信息的,訓(xùn)練過(guò)程存在循環(huán)依賴問(wèn)題,不便于后續(xù)計(jì)算優(yōu)化。論文提出了分解語(yǔ)言模型解決此問(wèn)題,即將LM分解為L(zhǎng)M1和LM2子模塊,將RoBERT的前6層和后6層分別作為L(zhǎng)M1和LM2,實(shí)現(xiàn)LM1,KM和LM2的聯(lián)合訓(xùn)練。整體框架如下圖所示。

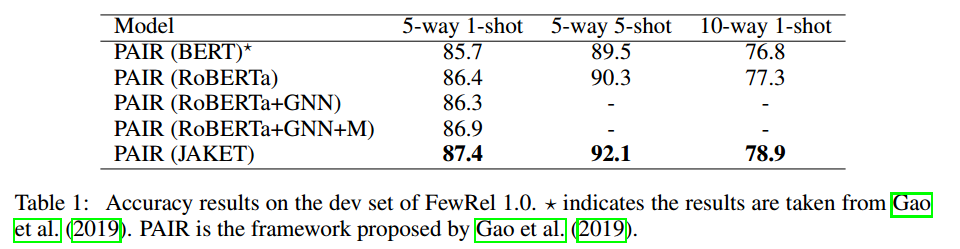

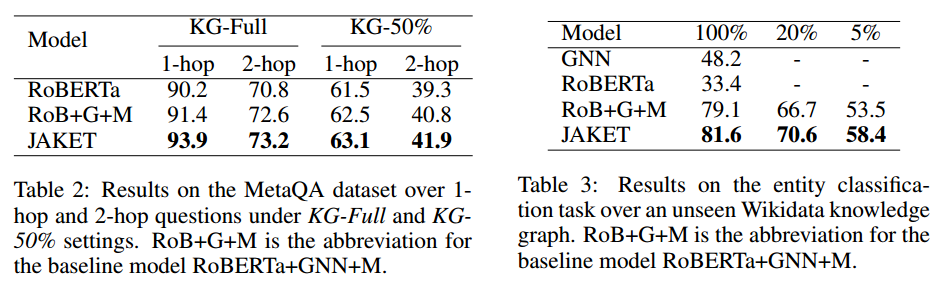

實(shí)驗(yàn)結(jié)果論文在實(shí)體類別預(yù)測(cè)、關(guān)系類別預(yù)測(cè)、詞塊掩碼預(yù)測(cè)、實(shí)體掩碼預(yù)測(cè)4個(gè)任務(wù)上進(jìn)行預(yù)訓(xùn)練,并在小樣本關(guān)系分類、KGQA和實(shí)體分類這3個(gè)下游任務(wù)上進(jìn)行實(shí)驗(yàn)。實(shí)驗(yàn)結(jié)果分別如下圖所示:

由實(shí)驗(yàn)結(jié)果可知,在3個(gè)任務(wù)中論文提出的JAKET都可以進(jìn)一步提高性能,并且聯(lián)合預(yù)訓(xùn)練可以有效減少模型對(duì)下游訓(xùn)練數(shù)據(jù)的依賴。

2

論文動(dòng)機(jī)

知識(shí)圖譜的構(gòu)建方法通常需要人工輔助參與,但是人力成本太高;

同時(shí)BERT等預(yù)訓(xùn)練模型通常在非常大規(guī)模的語(yǔ)料上訓(xùn)練,訓(xùn)練好的模型本身包含常識(shí)知識(shí),這些知識(shí)可以促進(jìn)上層的其他應(yīng)用。

所以本論文提出了一種無(wú)監(jiān)督的Match and Map(MAMA)模型,來(lái)將預(yù)訓(xùn)練語(yǔ)言模型中包含的知識(shí)轉(zhuǎn)換為知識(shí)圖譜。

方法

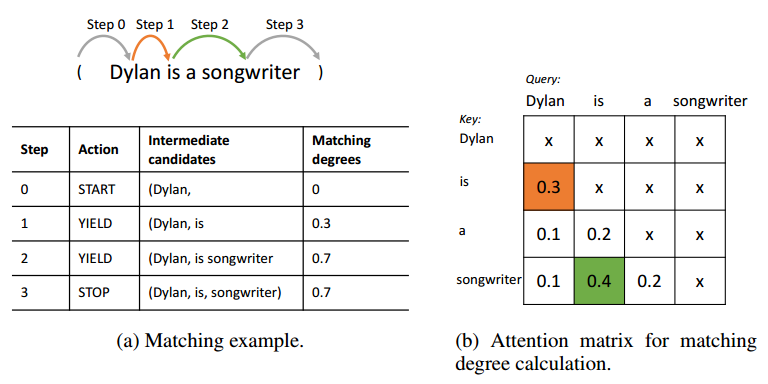

1. 匹配(Match)

Match階段主要是自動(dòng)抽取三元組。對(duì)于輸入的文本,使用開(kāi)源工具抽取出實(shí)體,并將實(shí)體兩兩配對(duì)為頭實(shí)體和尾實(shí)體,利用預(yù)訓(xùn)練模型的注意力權(quán)重來(lái)提取實(shí)體對(duì)的關(guān)系。通過(guò)beam search的方法搜索多條從頭實(shí)體到尾實(shí)體的路徑,從而獲取多個(gè)候選的三元組。再通過(guò)設(shè)置一些限制規(guī)則過(guò)濾掉不符常理的三元組,即得到用于構(gòu)建知識(shí)圖譜的三元組。

2. 映射(Map)

Map階段主要是將Match階段抽取到的三元組映射到知識(shí)圖譜中去。利用成熟的實(shí)體鏈接和關(guān)系映射技術(shù),將三元組映射到已有的固定schema圖譜中。對(duì)于部分映射或完全不匹配的三元組,就構(gòu)建開(kāi)放schema的知識(shí)圖譜,并最后將這兩類知識(shí)圖譜融合,得到一個(gè)靈活的開(kāi)放性知識(shí)圖譜。

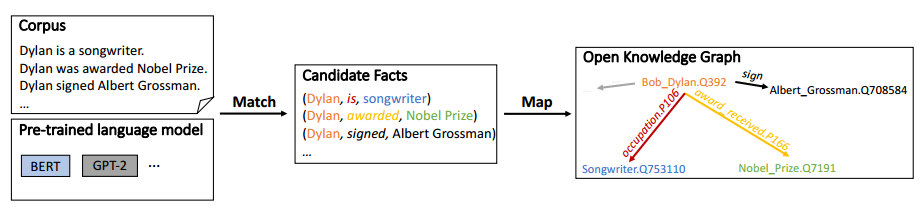

整體框架如下:

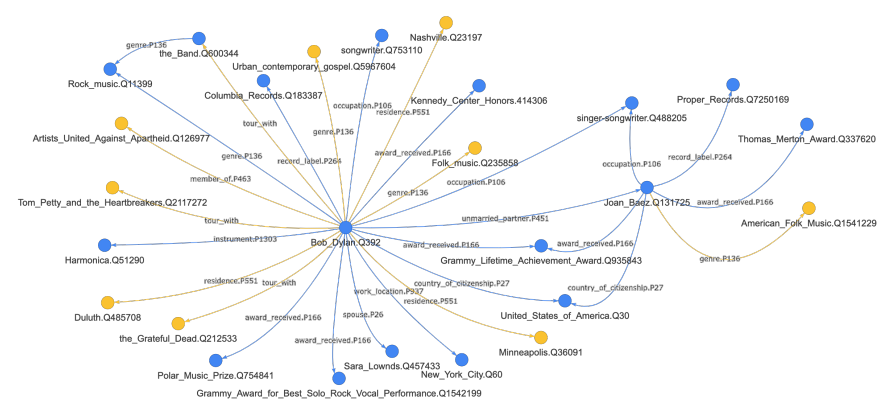

論文中使用BERT-large對(duì)Wikipedia語(yǔ)料進(jìn)行自動(dòng)化構(gòu)建知識(shí)圖譜,圖譜效果如下:

實(shí)驗(yàn)結(jié)果

論文在TAC KBP和Wikidata數(shù)據(jù)集上進(jìn)行槽填充任務(wù)實(shí)驗(yàn)。

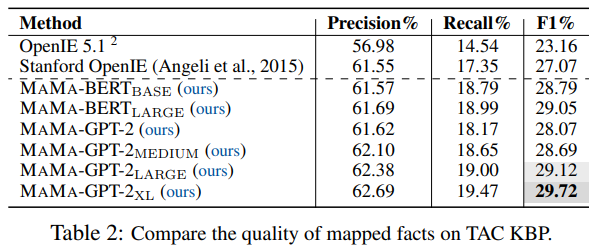

在TAC KBP數(shù)據(jù)集上的結(jié)果如下表:

基于TAC KBP數(shù)據(jù)集的實(shí)驗(yàn)結(jié)果主要有兩點(diǎn):一是MAMA模型能夠提升知識(shí)圖譜的槽填充效果;二是更大/更深的語(yǔ)言模型能夠抽取出更高質(zhì)量的知識(shí)圖譜。

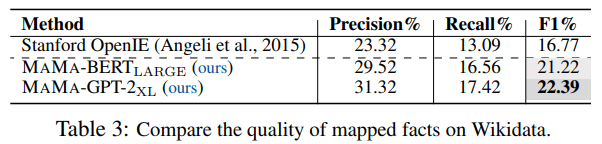

在Wikidata數(shù)據(jù)集上的結(jié)果如下表:

基于Wikidata數(shù)據(jù)集的實(shí)驗(yàn)結(jié)論一方面說(shuō)明MAMA可擴(kuò)展到更大的語(yǔ)料庫(kù),另一方面說(shuō)明MAMA能從更大規(guī)模的語(yǔ)料庫(kù)中抽取出更完整的知識(shí)圖譜。

3

論文動(dòng)機(jī)

實(shí)體未標(biāo)注問(wèn)題是命名實(shí)體識(shí)別(NER)任務(wù)中的常見(jiàn)問(wèn)題,且該問(wèn)題在實(shí)際情況中無(wú)法完全避免。既然無(wú)法徹底解決實(shí)體未標(biāo)注問(wèn)題,那么該問(wèn)題是否會(huì)對(duì)NER模型產(chǎn)生影響呢?若產(chǎn)生較大影響,如何將這種消極影響盡量降低?

基于上述問(wèn)題,論文分析了未標(biāo)注實(shí)體問(wèn)題對(duì)NER實(shí)驗(yàn)指標(biāo)的影響及其原因,并提出了一種具有魯棒性的負(fù)采樣策略,使得模型能夠保持在未標(biāo)注實(shí)體概率極低的狀態(tài)下訓(xùn)練,從而提升實(shí)體標(biāo)注效果。

方法

1.合成數(shù)據(jù)集(Synthetic Datasets)

通過(guò)在標(biāo)注完善的CoNLL-2003和OntoNotes5.0數(shù)據(jù)集按照一定概率隨機(jī)掩蓋標(biāo)注出的實(shí)體,獲取人工合成的欠完善標(biāo)注數(shù)據(jù)集。

2.衡量指標(biāo)(Metrics)

文章中設(shè)計(jì)了侵蝕率(erosion rate)和誤導(dǎo)率(misguidance rate)2種指標(biāo)來(lái)測(cè)算NER中未標(biāo)注實(shí)體問(wèn)題的影響。

侵蝕率代表實(shí)體標(biāo)注量減少對(duì)NER指標(biāo)下降的影響程度。

誤導(dǎo)率代表未標(biāo)注實(shí)體對(duì)當(dāng)作負(fù)樣本時(shí)對(duì)NER指標(biāo)下降的影響程度。

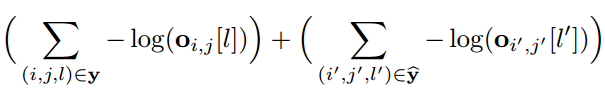

3.負(fù)采樣(Negative Sampling)

文章采用負(fù)采樣的方式進(jìn)行降噪,對(duì)所有的非實(shí)體進(jìn)行負(fù)采樣,采樣負(fù)樣本進(jìn)行損失函數(shù)的計(jì)算。改進(jìn)后的損失函數(shù)如下所示:

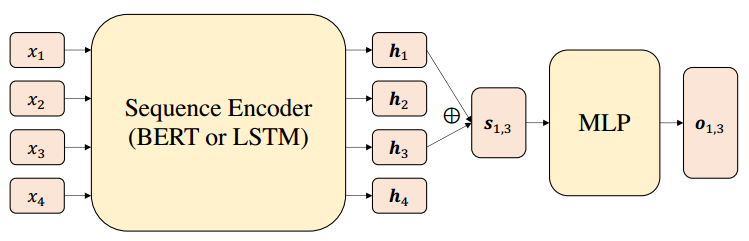

其中前半部分表示標(biāo)注實(shí)體集合的損失,后半部分則是負(fù)采樣實(shí)體集合的損失。文章的整體模型框架如下圖所示,總體就是BERT/LSTM編碼+softmax的思路。

實(shí)驗(yàn)結(jié)果

文章在合成數(shù)據(jù)集上進(jìn)行NER任務(wù)實(shí)驗(yàn),分析未標(biāo)注問(wèn)題的影響和負(fù)采樣的訓(xùn)練效果。

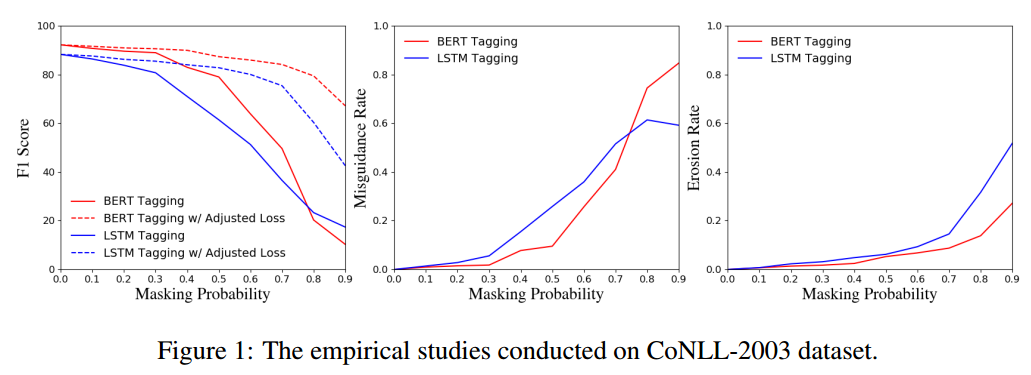

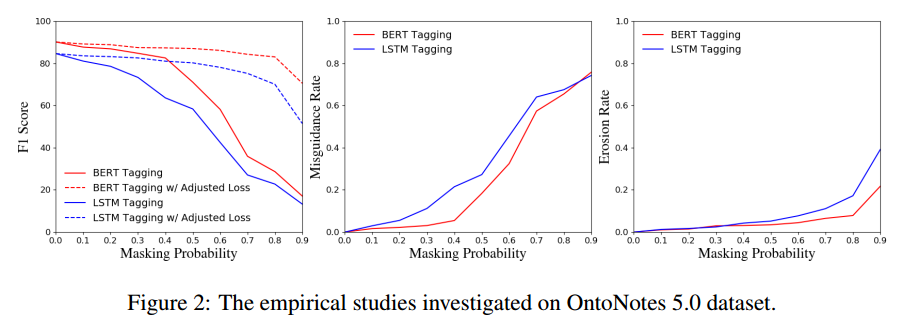

首先是分別基于CoNLL-2003和OntoNotes5.0合成數(shù)據(jù)集進(jìn)行的實(shí)驗(yàn)結(jié)果:

由圖可知:隨著實(shí)體掩蓋概率p增大,即未標(biāo)注實(shí)體數(shù)量增多,NER指標(biāo)下降明顯;在p很低的時(shí)候,誤導(dǎo)率就較高了,而侵蝕率受影響較小,說(shuō)明把未標(biāo)注實(shí)體當(dāng)作負(fù)樣本訓(xùn)練、對(duì)NER指標(biāo)下降的影響程度很大,實(shí)體標(biāo)注量減少對(duì)指標(biāo)下降的影響較小

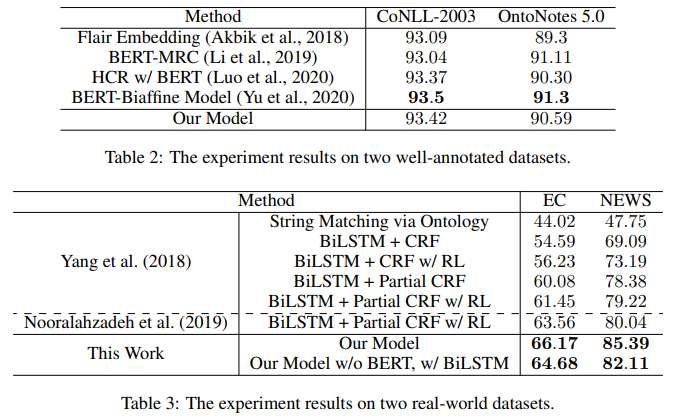

其次將文章提出的負(fù)采樣訓(xùn)練模型與其他SOTA模型分別在完全標(biāo)注數(shù)據(jù)集和真實(shí)數(shù)據(jù)集上做對(duì)比,實(shí)驗(yàn)結(jié)果如下:

結(jié)果表明本模型在完全標(biāo)注數(shù)據(jù)集上的效果和其他模型相差不大,并且真實(shí)世界數(shù)據(jù)集上的效果遠(yuǎn)優(yōu)于其他的模型,所以本文模型的綜合效果最好。

總結(jié)

此次解讀的三篇論文圍繞知識(shí)建模和信息抽取的研究點(diǎn)展開(kāi)。感覺(jué)知識(shí)圖譜結(jié)合語(yǔ)言模型的相關(guān)研究的趨勢(shì)是嘗試使用同一套編碼系統(tǒng),同時(shí)對(duì)語(yǔ)言模型中的上下文信息和知識(shí)圖譜中的結(jié)構(gòu)化語(yǔ)義信息進(jìn)行編碼和訓(xùn)練,從而實(shí)現(xiàn)知識(shí)融合或知識(shí)挖掘。此外,第三篇文章主要想給廣大做知識(shí)圖譜方向的研究者分享一個(gè)命名實(shí)體識(shí)別的技巧思路,當(dāng)面對(duì)標(biāo)注質(zhì)量不那么高的數(shù)據(jù)集時(shí),或許可以嘗試一下負(fù)采樣的方法。

以上就是Fudan DISC本期的論文分享內(nèi)容,歡迎大家的批評(píng)和交流。

原文標(biāo)題:【論文解讀】ICLR2021 知識(shí)建模與信息抽取

文章出處:【微信公眾號(hào):深度學(xué)習(xí)自然語(yǔ)言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

責(zé)任編輯:haq

-

模型

+關(guān)注

關(guān)注

1文章

3752瀏覽量

52104 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5599瀏覽量

124398

原文標(biāo)題:【論文解讀】ICLR2021 知識(shí)建模與信息抽取

文章出處:【微信號(hào):zenRRan,微信公眾號(hào):深度學(xué)習(xí)自然語(yǔ)言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

實(shí)力認(rèn)證!行云創(chuàng)新入圍《AI 中國(guó)生態(tài)圖譜 2025》大模型開(kāi)放平臺(tái)板塊

潤(rùn)和軟件入選大模型一體機(jī)產(chǎn)業(yè)圖譜

如何精準(zhǔn)驅(qū)動(dòng)菜品識(shí)別模型--基于米爾瑞芯微RK3576邊緣計(jì)算盒

在Ubuntu20.04系統(tǒng)中訓(xùn)練神經(jīng)網(wǎng)絡(luò)模型的一些經(jīng)驗(yàn)

【「AI芯片:科技探索與AGI愿景」閱讀體驗(yàn)】+AI的未來(lái):提升算力還是智力

模板驅(qū)動(dòng) 無(wú)需訓(xùn)練數(shù)據(jù) SmartDP解決小樣本AI算法模型開(kāi)發(fā)難題

知識(shí)圖譜與訓(xùn)練模型相結(jié)合和命名實(shí)體識(shí)別的研究工作

知識(shí)圖譜與訓(xùn)練模型相結(jié)合和命名實(shí)體識(shí)別的研究工作

評(píng)論