簡化復雜的算法

動機

盡管大多數的Kaggle競賽的獲勝者使用了多個模型的集成,這些集成的模型中,有一個必定是各種變體的梯度提升算法。舉個例子,Kaggle競賽:Safe Driver Prediction:https://www.kaggle.com/c/porto-seguro-safe-driver-prediction/discussion/44629#250927,Michael Jahrer的方案,使用了表示學習,使用了6個模型的綜合。1個LightGBM和5個神經網絡。盡管他的成功歸功他使用了結構化的數據進行了半監督學習,梯度提升算法也實現了非常重要的部分。

盡管GBM使用的非常廣泛,許多使用者仍然把這個東西當做一個黑盒子算法,只是使用預編譯好的庫跑一跑。寫這篇文章的目的是簡化復雜的算法,幫助讀者可以直觀的理解算法。我會解釋原汁原味的梯度提升算法,然后分享一些變種的鏈接。我基于fast.ai的庫做了一個決策樹的代碼,然后構建了一個自己的簡單的基礎的梯度提升模型。

Ensemble, Bagging, Boosting的簡單描述

當我們使用一個機器學習技術來預測目標變量的時候,造成實際值和預測值之間的差別的原因有噪聲,方差和偏差。集成方法能夠幫助減少這些因素(除了噪聲,不可約誤差)。

Ensemble是幾個預測器在一起(比如求平均),給出一個最終的結果。使用ensemble的原因是許多不同的預測器預測同一個目標會比單個預測器的效果要好。Ensemble技術又可以分成Bagging和Boosting。

Bagging是一個簡單的ensemble的技術,我們構建許多獨立的預測器/模型/學習器,通過模型平均的方式來組合使用。(如權值的平均,投票或者歸一化平均)

我們為每個模型使用隨機抽樣,所以每個模型都不太一樣。每個模型的輸入使用有放回的抽樣,所以模型的訓練樣本各不相同。因為這個技術使用了許多個不相關的學習器來進行最終的預測,它通過減少方差來減小誤差。bagging的一個例子是隨機森林模型。

Boosting在對模型進行ensemble的時候,不是獨立的,而是串行的。

這個技術使用了這樣的邏輯,后面的預測器學習的是前面的預測器的誤差。因此,觀測數據出現在后面模型中的概率是不一樣的,誤差越大,出現的概率越高。(所以觀測數據不是基于隨機又放回抽樣bootstrap的方式,而是基于誤差)。預測器可以從決策樹,回歸器,分類器中選取。因為新的預測器是從前面的預測器的誤差中學習的,接近實際的預測只需要更少的時間和迭代次數。但是我們不得不選擇嚴格的停止策略,否則可能會出現過擬合。梯度提升算法就是提升算法的一個例子。

Fig 1.Ensembling

Fig 2.Bagging (independent models) & Boosting (sequential models).Reference:https://quantdare.com/what-is-the-difference-between-bagging-and-boosting/

梯度提升算法

梯度提升是一個機器學習技術,用來做回歸和分類的問題,通過組合弱預測模型如決策樹,來得到一個強預測模型。(維基百科定義)

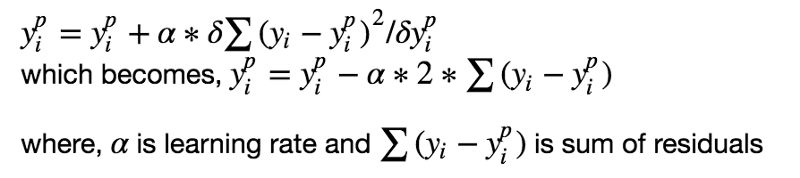

監督學習算法的目標是定義一個損失函數,然后最小化它。我們來看看,數學上梯度提升算法是怎么工作的。比如我們使用均方誤差(MSE)作為損失函數:

我們希望我們的預測讓我們的損失函數最小。通過使用梯度提升算法,基于一個學習率來更新我們的預測,我們會發現一個讓MSE最小的值。

所以,我們基本上是在更新預測,讓殘差的和接近于0(或者最小),這樣預測的值就和實際的值足夠的接近了。

梯度提升背后的直覺

梯度提升背后的邏輯很簡單,(可以很直觀的理解,不用數據公式)。我希望讀這篇文章的人能夠熟悉一下簡單的線性回歸模型。

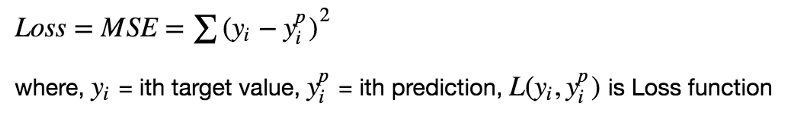

線性回歸模型的一個基本的假設是殘差是0,也就是說,參數應該在0的周圍分散。

現在,把這些殘差作為誤差提交到我們的預測模型中。盡管,基于樹的模型(將決策樹作為梯度提升的基礎模型)不是基于這個假設,但是如果我們對這個假設進行邏輯思考,我們也許能提出,如果我們能發現在0的周圍的殘差一些模式,我們可以利用這個模式來擬合模型。

所以,梯度提升背后的直覺就是重復的利用殘差中的模式利用弱預測器來加強模型,讓模型變得更好。一旦我們到了一個階段,殘差不具有任何的模式,無法進行建模,我們就可以停止了(否則會導致過擬合)。從算法的角度講,我們在最小化損失函數,直到測試損失達到最小。

總結一下:

我們首先使用一個簡單的模型對數據進行建模,分析數據的誤差。

這些誤差表示數據點使用簡單的模型很難進行擬合。

然后對于接下來的模型,我們特別的專注于將那些難于擬合的數據,把這些數據預測正確。

最后,我們將所有的預測器組合起來,對于每個預測器給定一個權重。

擬合梯度提升模型的步驟

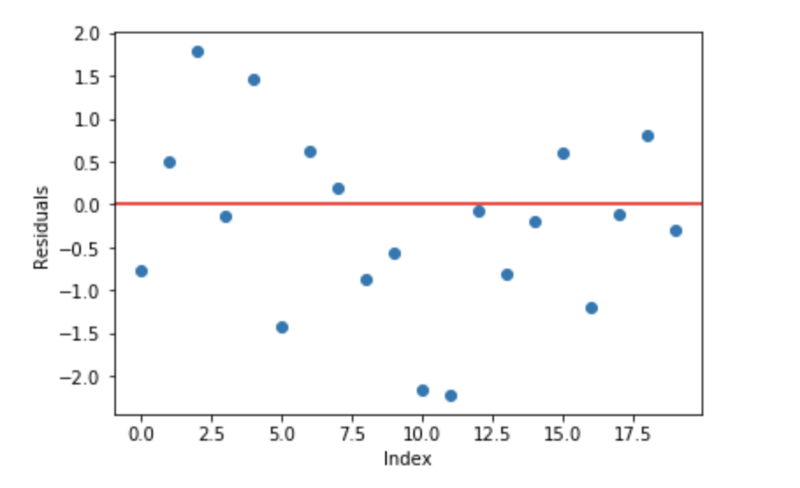

我們來模擬一些數據,如下面的散點圖所示,一個輸入,一個輸出。

上面的數據是通過下面的python代碼生成的。

x = np.arange(0,50) x = pd.DataFrame({'x':x}) # just random uniform distributions in differnt range y1 = np.random.uniform(10,15,10) y2 = np.random.uniform(20,25,10) y3 = np.random.uniform(0,5,10) y4 = np.random.uniform(30,32,10) y5 = np.random.uniform(13,17,10) y = np.concatenate((y1,y2,y3,y4,y5)) y = y[:,None]

1.擬合一個簡單的線性回歸模型或者決策樹模型(在我的代碼中選擇了決策樹)[x作為輸入,y作為輸出]

xi = x # initialization of input yi = y # initialization of target # x,y --> use where no need to change original y ei = 0 # initialization of error n = len(yi) # number of rows predf = 0 # initial prediction 0 for i in range(30): # loop will make 30 trees (n_estimators). tree = DecisionTree(xi,yi) # DecisionTree scratch code can be found in shared github/kaggle link. # It just create a single decision tree with provided min. sample leaf tree.find_better_split(0) # For selected input variable, this splits (

2.計算誤差,實際的目標值,最小化預測目標值[e1= y - y_predicted1 ]

3.把誤差作為目標值,擬合新的模型,使用同樣的輸入數據[叫做e1_predicted]

4.將預測的誤差加到之前的預測之中[y_predicted2 = y_predicted1 + e1_predicted]

5.在剩下的殘差上擬合另一個模型,[e2 = y - y_predicted2],重復第2到第5步,直到開始過擬合,或者殘差的和開始不怎么變換。過擬合可以通過驗證數據上的準確率來發現。

# predictions by ith decisision tree predi = np.zeros(n) np.put(predi, left_idx, np.repeat(np.mean(yi[left_idx]), r)) # replace left side mean y np.put(predi, right_idx, np.repeat(np.mean(yi[right_idx]), n-r)) # right side mean y predi = predi[:,None] # make long vector (nx1) in compatible with y predf = predf + predi # final prediction will be previous prediction value + new prediction of residual ei = y - predf # needed originl y here as residual always from original y yi = ei # update yi as residual to reloop

為了幫助理解劃線部分的概念,這里有個鏈接,有完整的梯度提升模型的實現 [[Link: Gradient Boosting from scratch]](https://www.kaggle.com/grroverpr/gradient-boosting-simplified/)。????????????

梯度提升樹的可視化工作

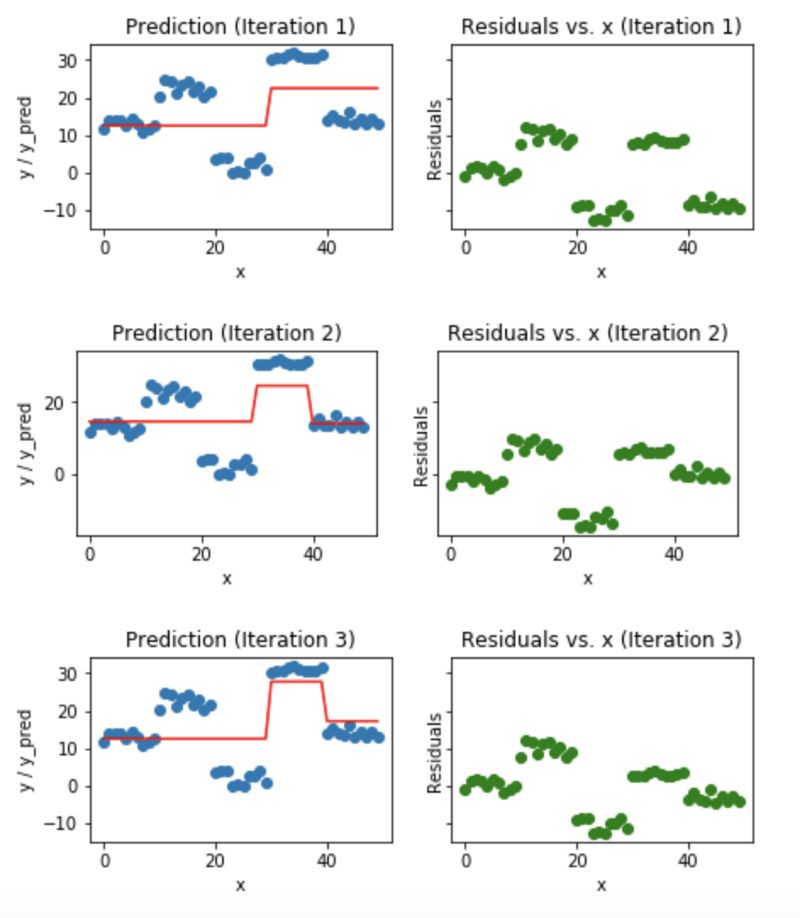

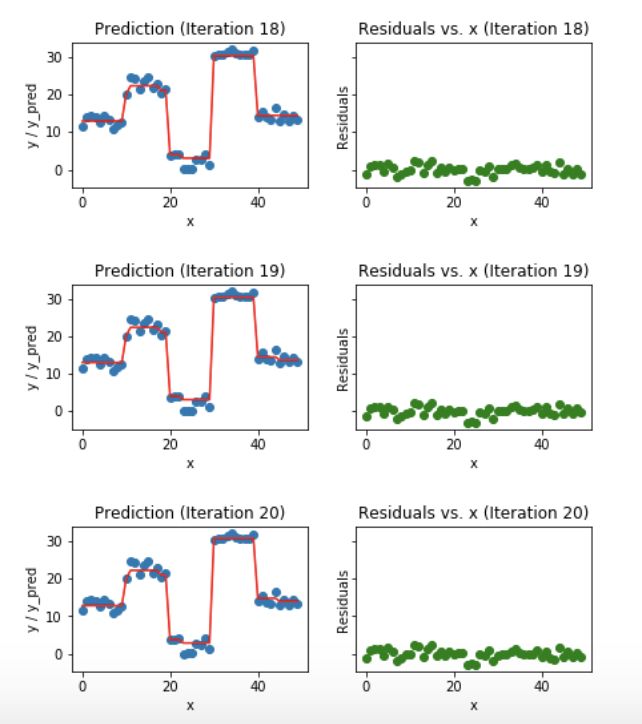

藍色的點(左邊)是輸入(x),紅色的線(左邊)是輸出(y)顯示了決策樹的預測值,綠色的點(右邊)顯示了第i次迭代的殘差vs.輸入(x),迭代表示擬合梯度提升樹的了序列的順序。

Fig 5.Visualization of gradient boosting predictions (First 4 iterations)

Fig 6.Visualization of gradient boosting predictions (18th to 20th iterations)

我們發現過了20個迭代,殘差變成了0附近的隨機分布(我不會說是隨機正態分布),我們的預測也非常接近于實際值。這時可以停止訓練模型了,否則要開始過擬合了。

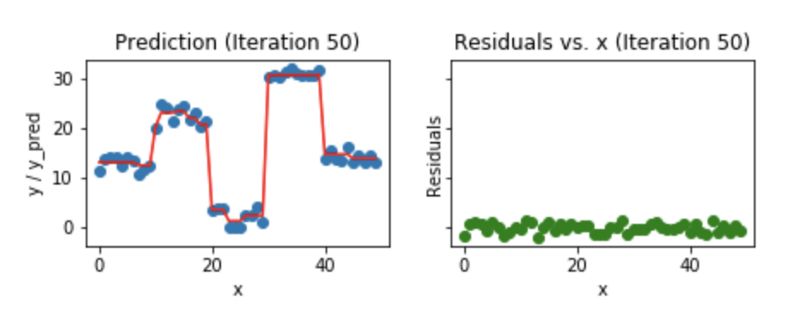

我們來看看,50個迭代之后的樣子:

Fig 7. Visualization of gradient boosting prediction (iteration 50th)

我們發現,即使是50個迭代之后,殘差vs. x的圖和我們看到的20個迭代的圖也沒太大區別。但是模型正在變的越來越復雜,預測結果在訓練數據上出現了過擬合。所以,最好是在20個迭代的時候就停止。

用來畫圖的python代碼。

# plotting after prediction xa = np.array(x.x) # column name of x is x order = np.argsort(xa) xs = np.array(xa)[order] ys = np.array(predf)[order] #epreds = np.array(epred[:,None])[order] f, (ax1, ax2) = plt.subplots(1, 2, sharey=True, figsize = (13,2.5)) ax1.plot(x,y, 'o') ax1.plot(xs, ys, 'r') ax1.set_title(f'Prediction (Iteration {i+1})') ax1.set_xlabel('x') ax1.set_ylabel('y / y_pred') ax2.plot(x, ei, 'go') ax2.set_title(f'Residuals vs. x (Iteration {i+1})') ax2.set_xlabel('x') ax2.set_ylabel('Residuals')

我希望這個博客可以幫助你對梯度提升算法的工作有一個基本的直覺。為了理解梯度提升回歸算法的細節,我強烈建議你讀一讀下面這些文章。

更多有用的資源

我的github倉庫和kaggle的kernel的鏈接,從頭開始GBM

https://www.kaggle.com/grroverpr/gradient-boosting-simplified/https://nbviewer.jupyter.org/github/groverpr/Machine-Learning/blob/master/notebooks/01_Gradient_Boosting_Scratch.ipynb

一個直觀和細致的梯度提升算法的解釋

http://explained.ai/gradient-boosting/index.html

Fast.ai的github倉庫鏈接,從頭開始做決策樹

https://github.com/fastai/fastai

Alexander Ihler的視頻,這視頻幫我理解了很多。

https://youtu.be/sRktKszFmSk

最常用的GBM算法

XGBoost || Lightgbm || Catboost || sklearn.ensemble.GradientBoostingClassifier

責任編輯:lq

-

神經網絡

+關注

關注

42文章

4838瀏覽量

107791 -

算法

+關注

關注

23文章

4784瀏覽量

98064 -

機器學習

+關注

關注

66文章

8553瀏覽量

136954

原文標題:【算法理解】從頭開始理解梯度提升算法

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

算法工程師需要具備哪些技能?

SM4算法實現分享(一)算法原理

CNN卷積神經網絡設計原理及在MCU200T上仿真測試

梯度科技亮相第27屆中國軟博會

信號發生器如何與波束賦形算法配合優化?

梯度結構聚氨酯研磨墊的制備及其對晶圓 TTV 均勻性的提升

梯度科技亮相2025可信云大會

梯度科技亮相廣西科技成果展示活動

基于進給量梯度調節的碳化硅襯底切割厚度均勻性提升技術

交流充電樁負載能效提升技術

梯度科技參編兩項重磅標準正式發布

鈣鈦礦/硅疊層電池效率達30.74%,梯度折射率IZrO/IZO多層透明電極的應用突破

梯度科技助力客戶破解算力調度難題

智慧路燈智能控制算法優化的探討

梯度提升算法

梯度提升算法

評論