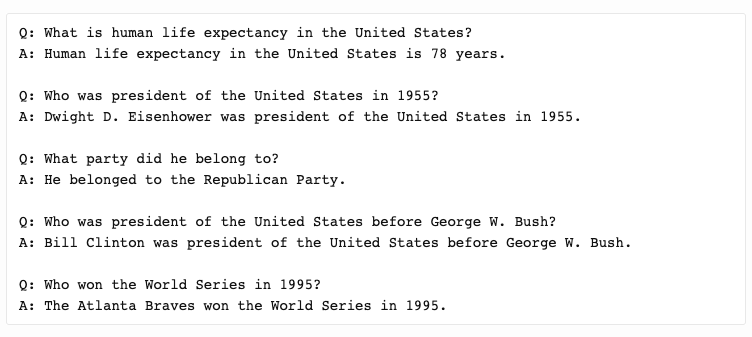

最近,GPT-3火了!相信你已經(jīng)在網(wǎng)上看到各種有關(guān)GPT-3的演示。這個由OpenAI創(chuàng)建的大型機(jī)器學(xué)習(xí)模型,它不僅可以自己寫論文,還會寫詩歌,就連你寫的代碼都能幫你寫了。 下面還是先讓你看看GPT-3的威力吧,首先來看看GPT3在問答任務(wù)上的表現(xiàn):

無論你的問題是天馬行空的腦筋急轉(zhuǎn)彎,還是有邏輯性極強(qiáng)的數(shù)學(xué)問題,它都能對答如流。 開發(fā)者Sharif Shameem用GPT-3做了一個生成器,你只要輸入你所需的布局,它就能為你生成JSX代碼。如下視頻所示:

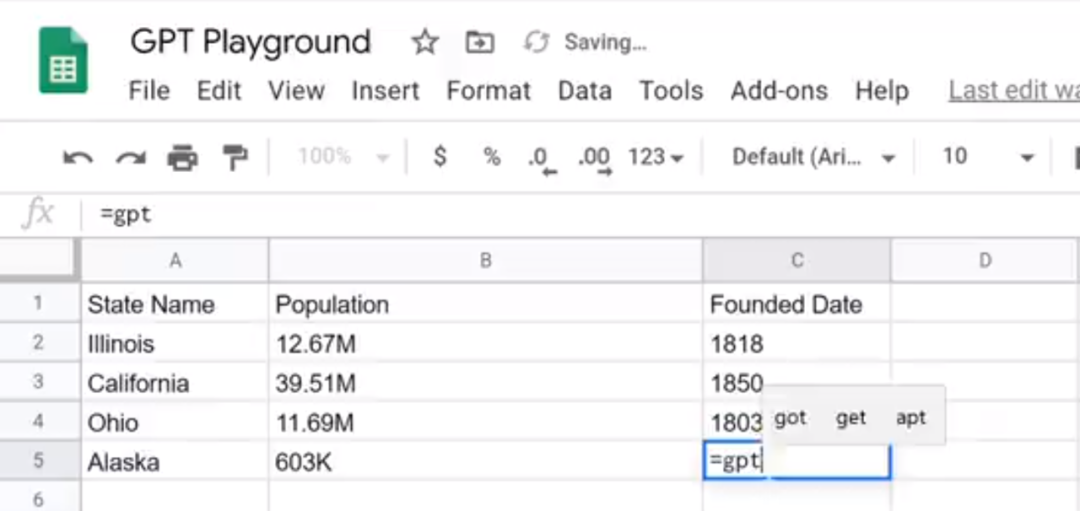

還有人在 Google 表格里開發(fā)了一個新的 GPT3 函數(shù),除了簡單的數(shù)學(xué)運算之外,它還可以自動查找美國各州的人口以及創(chuàng)建年份:

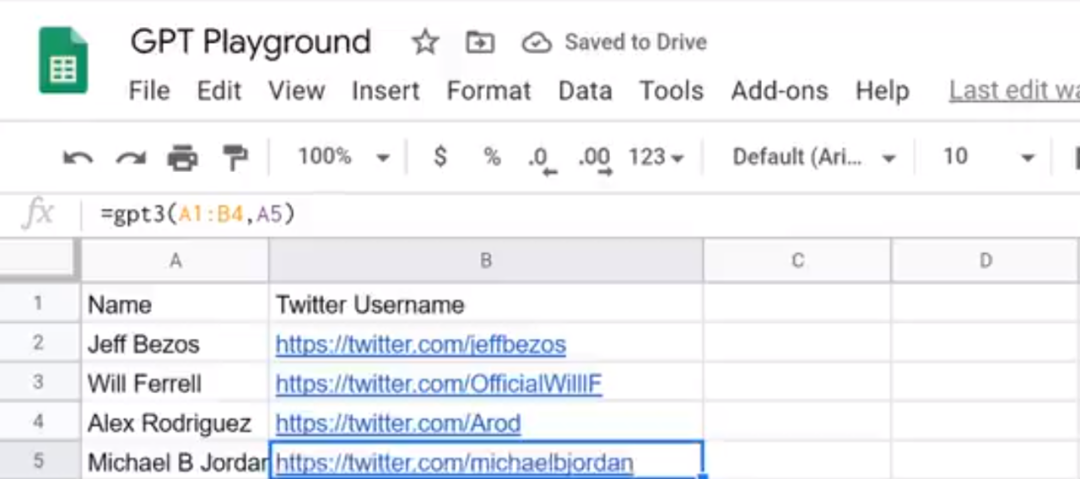

除此之外,它還能查到Twitter賬號:

遺憾的是,如果你想試用GPT-3,你得先拿到體驗資格才行,但是此模型創(chuàng)建的應(yīng)用程序似乎有無限可能,通過它你可以使用純英語查詢SQL數(shù)據(jù)庫,自動注釋代碼,自動生成代碼,編寫熱門文章標(biāo)題,甚至幫助猿妹我寫出一篇爆文。 GPT-3是什么? GPT-3是一種神經(jīng)網(wǎng)絡(luò)驅(qū)動的語言模型。與大多數(shù)語言模型一樣,GPT-3在未標(biāo)記的文本數(shù)據(jù)集上進(jìn)行了大量的訓(xùn)練(訓(xùn)練數(shù)據(jù)包括Common Crawl和Wikipedia),從文本中隨機(jī)刪除單詞或短語,并且模型必須學(xué)會僅使用周圍的單詞作為上下文來填充單詞或短語。這是一個簡單的培訓(xùn)任務(wù),可以產(chǎn)生功能強(qiáng)大且可推廣的模型。 GPT-3模型架構(gòu)本身就是一個基于單向transformer語言模型。這種架構(gòu)在2-3年前開始流行,流行的NLP模型BERT和GPT-3的前身GPT-2都是基于transformer構(gòu)建。從架構(gòu)的角度來看,GPT-3實際上并不是很新穎!

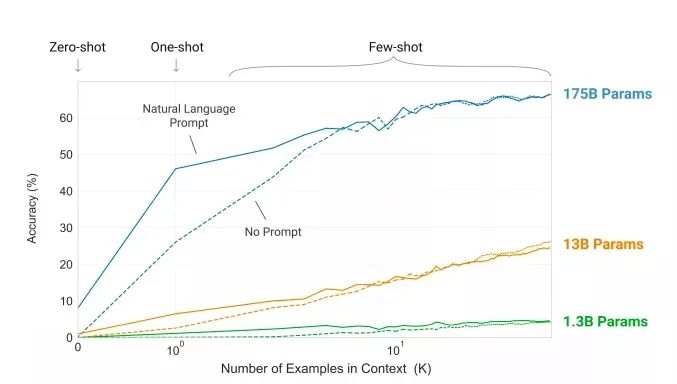

它之所以會這么火,是因為GPT-3的模型尺寸增大到了1750億,并且使用45TB數(shù)據(jù)進(jìn)行訓(xùn)練,是有史以來創(chuàng)建的最大語言模型。源于它的參數(shù)模型巨大,因此可以完成許多其他模型無法完成的事情,就像前面所說的,你可以讓它成為一名翻譯家、作家、詩人、程序員等。 如果你對GPT-3的模型參數(shù)1750億感到有些抽象,那么,我舉個例子,你應(yīng)該就懂了:

BERT模型有3億參數(shù)

GPT-3模型的前身GPT-2有15億個參數(shù)

英偉達(dá)的Megatron-BERT有80億參數(shù)

微軟Turing NLP,有170億參數(shù)

就連排名第二的微軟Turing NLP的數(shù)據(jù)參數(shù)和GPT-3都不是一個量級的。

值得一提的是,這次的GPT-3論文作者足足有31位,論文體量更是高達(dá)72頁,網(wǎng)友都驚呼,現(xiàn)在PTM的工作是要開始pk論文頁數(shù)了嗎?

和往常一樣,GPT-3立即放出了GitHub項目頁面,你可以在上面找到各種各樣有趣的demo,最后附上Github地址:https://github.com/openai/gpt-3。推薦↓↓↓

原文標(biāo)題:敲代碼、作詩、寫論文無所不能!史上最大AI模型GPT-3強(qiáng)勢霸榜Github

文章出處:【微信公眾號:人工智能與大數(shù)據(jù)技術(shù)】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

責(zé)任編輯:haq

-

AI

+關(guān)注

關(guān)注

91文章

39793瀏覽量

301424 -

機(jī)器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8553瀏覽量

136953

原文標(biāo)題:敲代碼、作詩、寫論文無所不能!史上最大AI模型GPT-3強(qiáng)勢霸榜Github

文章出處:【微信號:TheBigData1024,微信公眾號:人工智能與大數(shù)據(jù)技術(shù)】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

GPT-5震撼發(fā)布:AI領(lǐng)域的重大飛躍

大模型 ai coding 比較

Transformer 入門:從零理解 AI 大模型的核心原理

AI端側(cè)部署開發(fā)(SC171開發(fā)套件V3)2026版

安霸推出開發(fā)者社區(qū)以助力部署端側(cè)AI應(yīng)用

云知聲入選甲子光年2025中國AI大模型領(lǐng)域最具商業(yè)潛力榜

日均省電超82萬度!事關(guān)AI服務(wù)器GaN電源模塊

GPT-5.1發(fā)布 OpenAI開始拼情商

什么是AI模型的推理能力

NVIDIA從云到邊緣加速OpenAI gpt-oss模型部署,實現(xiàn)150萬TPS推理

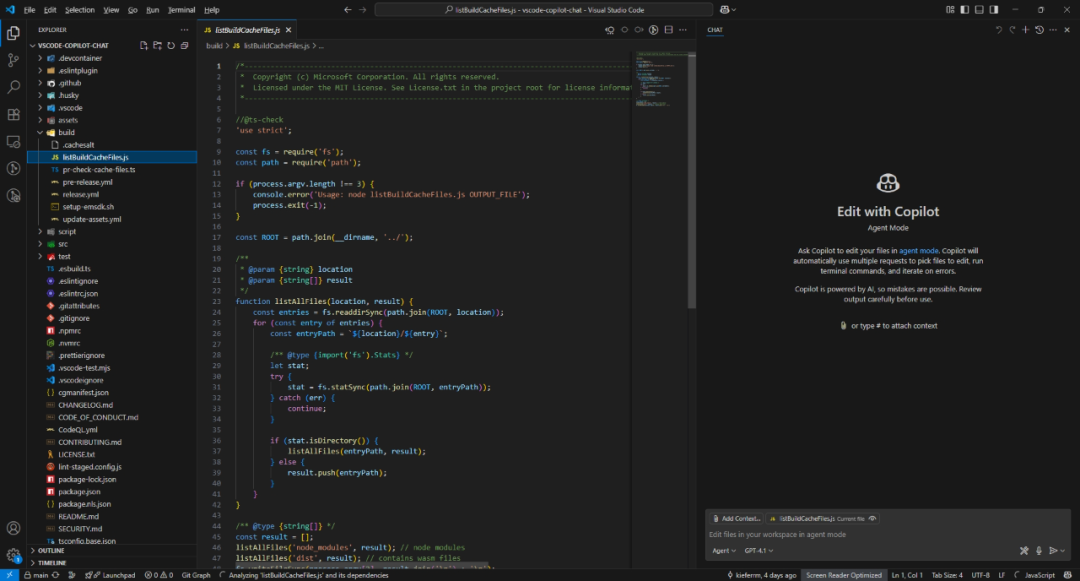

微軟開源GitHub Copilot Chat,AI編程迎來新突破

AI端側(cè)部署開發(fā)(SC171開發(fā)套件V3)

首創(chuàng)開源架構(gòu),天璣AI開發(fā)套件讓端側(cè)AI模型接入得心應(yīng)手

低至¥2.27/h!就能使用全球最強(qiáng)開元模型——千問 QwQ-32B

史上最大AI模型GPT-3強(qiáng)勢霸榜Github

史上最大AI模型GPT-3強(qiáng)勢霸榜Github

評論