“不管是在今天 GPU 能夠做的事情上,還是 GPU 不能做的事情上,IPU 都有它的價值點和價值定位。” 日前,在英國 AI 芯片初創公司 Graphcore 中國區的媒體溝通會上,Graphcore 高級副總經理兼中國區總經理盧濤和 Graphcore 中國工程總負責人、AI 算法科學家金琛,就 Graphcore 的新產品性能以及該公司在中國的落地策略向 DeepTech 等媒體進行了同步。

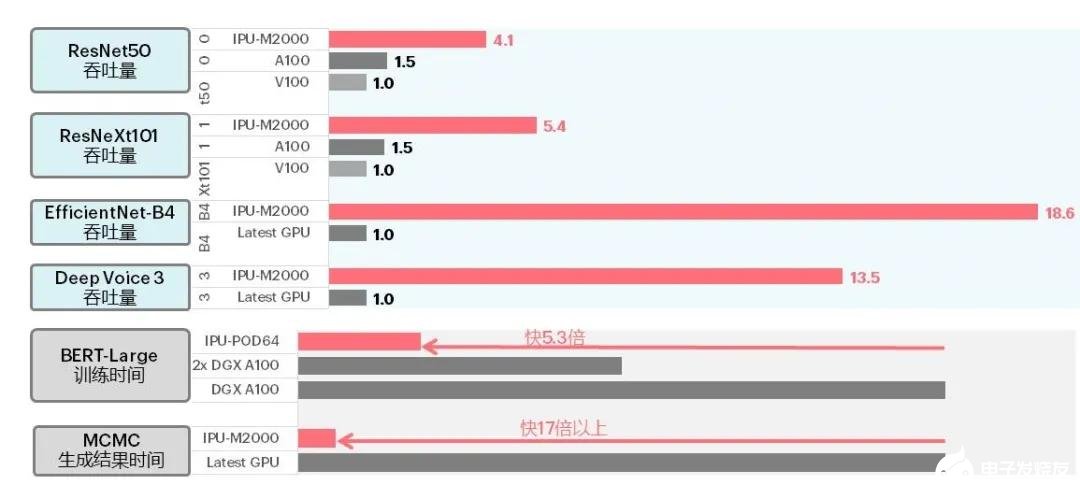

溝通會上,Graphcore 解讀了其于本月公布的大規模系統級產品 IPU-M2000 的應用測試數據。公布數據顯示,在典型 CV 模型 ResNet、基于分組卷積的 ResNeXt、EfficientNet、語音模型、BERT-Large 等自然語言處理模型以及 MCMC 等傳統機器學習模型中,IPU-M2000 在吞吐量、訓練時間和學習結果生成時間方面都有較好表現。比如,在 IPU-M2000 上 EfficientNet 的吞吐量達到 A100 的 18 倍。

圖 | IPU-M2000 與 GPU 的吞吐量、訓練及結果生成時間對比(來源:Graphcore)

此前,IPU-M2000 與 Graphcore 第二代 IPU 處理器 GC200 已于今年 7 月 15 日發布。據介紹,GC200 芯片基于臺積電的 7nm 工藝制造,集成 250 TFlops AI-Float 算力和 900MB 處理器內存,相較第一代產品性能提升 8 倍。而對于第三代 IPU,盧濤在此次溝通會上并未透露發布的具體時間表,不過他表示下一代產品正在研發中,將依舊重點解決存儲問題。

支持 PyTorch、TensorFlow,在 IPU 與 GPU 間無縫銜接

另外,Graphcore 還發布了 Poplar SDK 1.4 版本和 PyTorch 的 IPU 版本。

Graphcore 對 Poplar SDK 1.4 版本在易用性和速度上進行了優化,能夠支持模型和數據并行,同時能夠實現模型的橫向擴展 —— 從 1 個 IPU 橫向擴展到 64 個 IPU。金琛表示,下一版本的 Poplar SDK 有望實現橫向擴展到 128 個 IPU。

值得關注的是,除支持 Graphcore 的自研框架 PopART 外,Poplar SDK 1.4 還支持 Facebook 的 PyTorch 框架、以及 Google 的 TensorFlow 框架。

據金琛介紹,Graphcore 在 PyTorch 代碼中引入了 PopTorch 輕量級接口,通過這一接口,用戶可基于當前的 PyTorch 模型進行封裝,以實現 IPU 和 CPU 之間的無障礙銜接。

對于實現這一功能的核心技術,金琛做進一步解釋說,Graphcore 采用 PyTorch 里的 jit.trace 機制對計算圖進行編譯,轉化為 IPU 和 PyTorch 兼容的表達格式,最后用 Graphcore 自研框架 PopART 后端的 audiff 功能自動生成反向圖,便可以實現同一個模型在不同平臺的無差別運行。

目前,PyTorch 因其直觀易懂、靈活易用等優勢受到開發者的廣泛喜愛和應用。Poplar SDK 1.4 增加了對 PyTorch 的支持,策略上是希望用戶在 IPU 上也能體驗 PyTorch,讓用戶多一個轉戰 IPU 的理由。不過目前英偉達的 GPU 已經在 AI 計算領域占據大部分市場,此時 IPU 能夠提供的價值、轉場到 IPU 的成本等,都是用戶所要考慮的問題。

在遷移成本上,盧濤表示,經過幾年來對 Poplar SDK 的打磨,現在從 GPU 到 IPU 的軟硬件遷移難度已經比大家認為的小得多。

金琛補充道,在訓練上,針對一個不太復雜的模型,一般一周可以遷移完成,對于復雜的模型大概需要兩周;在推理上,基本上是 1-2 天的工作量。

談及性能,盧濤表示:“IPU 在訓練推理、語音、圖像模型處理上基本全面超越 GPU。” 不過他也坦言:“不能說 100% 超越了 GPU,因為算法模型確實非常多,比如說語音有不同的語音模型、圖像也是有不同的圖像模型。”

未來:持續優化性能,進一步壓縮遷移成本

IPU 在機器學習性能上的明顯優勢是不可否認的,但前有身強體壯且努力奔跑的巨頭英偉達,Graphcore 更是一刻也不容懈怠。盧濤在溝通會上也多次提到,“目前 Graphcore 面對的壓力最主要還是來自英偉達”。

“重壓” 之下,Graphcore 短期內的計劃是聚焦在數據中心高性能訓練和推理市場上,持續打磨 IPU 和軟件平臺,持續優化性能和提高可用性。盧濤說,“只有在我們聚焦的領域跑得更快,Graphcore 和英偉達之間的距離才會越來越短,甚至在某些領域超過英偉達”。

他還表示,Graphcore 希望未來數年內,能在數據中心的 AI 訓練、推理批量部署、以及發貨和體量上做到除英偉達以外的另一個頭部地位。

為實現該目標,Graphcore 也將從增加 AI 框架支持、以及模型覆蓋兩個維度著手,以期進一步減少用戶的遷移成本。此外,除目前 AI 應用最廣泛的互聯網和云計算兩個場景外,盧濤表示公司明年還將在金融、汽車、智慧醫療、智慧教育、智慧城市和政府服務等領域,至少突破一到兩個比較主流的領域。

責任編輯:PSY

-

gpu

+關注

關注

28文章

5194瀏覽量

135460 -

數據中心

+關注

關注

18文章

5651瀏覽量

75021 -

IPU

+關注

關注

0文章

35瀏覽量

15962

發布評論請先 登錄

數據中心缺電,英偉達又有新動作!

高通挑戰英偉達,發布768GB內存AI推理芯片,“出征”AI數據中心

高通挑戰英偉達!發布768GB內存AI推理芯片,“出征”AI數據中心

IPU 與 GPU 間無縫銜接,未來聚焦數據中心的AI訓練和推理部署

IPU 與 GPU 間無縫銜接,未來聚焦數據中心的AI訓練和推理部署

評論