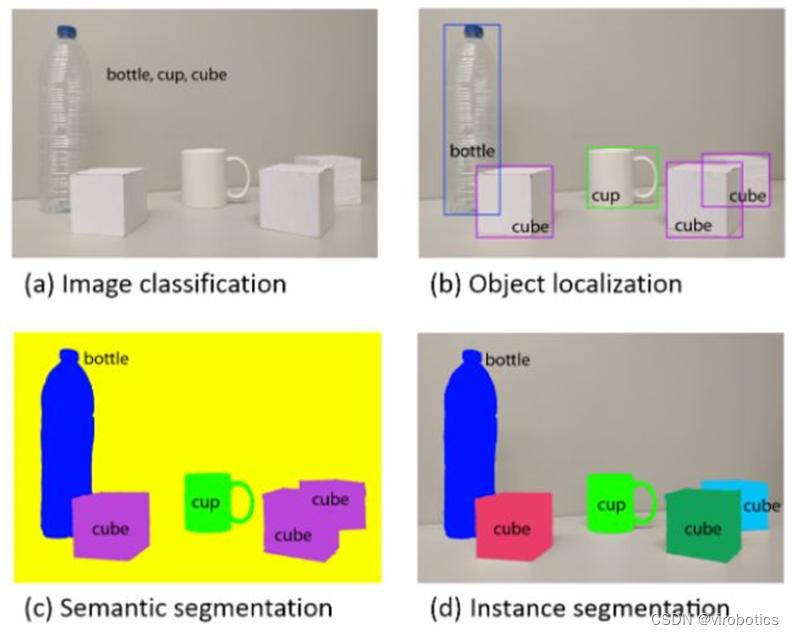

隨著計(jì)算機(jī)視覺的發(fā)展,2D目標(biāo)檢測(cè)在精度和速度方面已經(jīng)得到了巨大的提升,并在各個(gè)領(lǐng)域取得了令人矚目的成績(jī)。但2D檢測(cè)卻忽視了物體的三維信息。目前的3D形狀預(yù)測(cè)研究主要基于合成數(shù)據(jù)集和當(dāng)個(gè)目標(biāo)的預(yù)測(cè)。

為了解決這一問題,來自Facebook的研究人員提出了Mesh R-CNN模型,可以從單張輸入圖像中檢測(cè)不同物體,并預(yù)測(cè)出每個(gè)物體對(duì)應(yīng)的三角網(wǎng)格,將二維目標(biāo)檢測(cè)的能力成功地拓展到了三維目標(biāo)檢測(cè)和形狀預(yù)測(cè)。

三維目標(biāo)檢測(cè)與形狀預(yù)測(cè)

近年來深度學(xué)習(xí)在三維形狀理解領(lǐng)域有了很大的提升,研究人員們利用神經(jīng)網(wǎng)絡(luò)對(duì)體素、點(diǎn)云、網(wǎng)格等三維表示進(jìn)行學(xué)習(xí),推進(jìn)了三維世界表示和理解的發(fā)展。但這些技術(shù)主要基于合成數(shù)據(jù)集進(jìn)行開發(fā)和研究,缺乏復(fù)雜的形狀和條件,相比二維圖像的大型數(shù)據(jù)集還遠(yuǎn)遠(yuǎn)不夠。研究人員認(rèn)為三維研究領(lǐng)域需要開發(fā)新的識(shí)別與理解系統(tǒng),可以在非限制環(huán)境、復(fù)雜形狀、多物體以及光照條件變化的情境下穩(wěn)定運(yùn)行。

為了實(shí)現(xiàn)這一目標(biāo),研究人員開發(fā)了2D感知和3D形狀預(yù)測(cè)的方法,可以在單張RGB輸入的情況下實(shí)現(xiàn)目標(biāo)檢測(cè)、實(shí)例分割以及目標(biāo)3D三角網(wǎng)格預(yù)測(cè)的功能。這一方法基于Mask R-CNN改進(jìn)而來,增加了網(wǎng)格預(yù)測(cè)分支來輸出高分辨的目標(biāo)三角網(wǎng)格。這種方法預(yù)測(cè)出的網(wǎng)格不僅能夠捕捉不同的3D結(jié)構(gòu)中,同時(shí)可以適用于不同的幾何復(fù)雜度。Mesh R-CNN克服了先前固定網(wǎng)格模板的形態(tài)預(yù)測(cè)方法,利用多種三維表示方法完成預(yù)測(cè)。

Mesh R-CNN首先預(yù)測(cè)出目標(biāo)粗糙的體素、隨后轉(zhuǎn)換為網(wǎng)格并利用精確的網(wǎng)格預(yù)測(cè)分支進(jìn)行優(yōu)化,最后實(shí)現(xiàn)了對(duì)于任意幾何結(jié)構(gòu)的精細(xì)預(yù)測(cè)。

Mesh R-CNN

這一研究的目標(biāo)是通過單張圖像輸入,對(duì)圖像中的物體進(jìn)行檢測(cè)、獲取不同物體的類別、掩膜和對(duì)應(yīng)的三維網(wǎng)格,并對(duì)真實(shí)世界中的復(fù)雜模型進(jìn)行有效處理。在2D深度網(wǎng)絡(luò)的基礎(chǔ)上,研究人員改進(jìn)并提出了新的架構(gòu)。

這一模型主要分為三個(gè)部分,包括了預(yù)測(cè)box和mask的檢測(cè)分支、預(yù)測(cè)體素的分支和mesh優(yōu)化分支。受到RoIAlign的啟發(fā),研究人員在網(wǎng)格預(yù)測(cè)中加入了VertAlign將輸入圖像與特征進(jìn)行對(duì)應(yīng)。

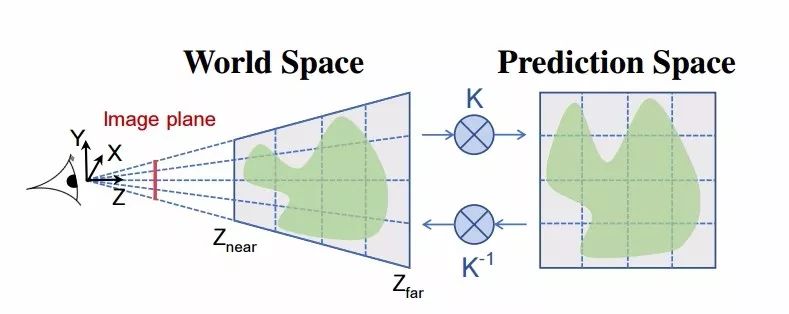

體素預(yù)測(cè)分支與box/mask預(yù)測(cè)分支的輸入相同,都使用了與圖像對(duì)齊的特征。模型最后將目標(biāo)檢測(cè)、語義分割損失與網(wǎng)格預(yù)測(cè)損失結(jié)合起一同對(duì)網(wǎng)絡(luò)進(jìn)行端到端的訓(xùn)練和優(yōu)化。Mesh R-CNN的核心是網(wǎng)格預(yù)測(cè)器,它將對(duì)齊的圖像特征進(jìn)行輸入,并輸出目標(biāo)的三維網(wǎng)格。與二維圖像的處理相似,研究人員同時(shí)也維護(hù)了特征在不同階段的對(duì)齊,包括區(qū)域和體素對(duì)應(yīng)的對(duì)齊操作(RoIAlign和VertAlign),并捕捉圖像中所有實(shí)例的3D形狀。

這意味著每一個(gè)預(yù)測(cè)出的網(wǎng)格都具有自己的拓?fù)浣Y(jié)構(gòu)(包括網(wǎng)格種類、一定數(shù)量的頂點(diǎn)、邊和面)以及幾何形狀。這一模型可以預(yù)測(cè)不同形狀和拓?fù)浣Y(jié)構(gòu)的網(wǎng)格。

模型的體素分支將針對(duì)每一個(gè)檢測(cè)到的物體預(yù)測(cè)柵格在空間中的占據(jù)概率,并得到三維模型最終的形狀結(jié)果。可以將其視為3D版的Mask R-CNN,利用GxGxG的柵格在三維空間中預(yù)測(cè)出目標(biāo)的外形。

同樣和Mask R-CNN類似的是,對(duì)于體素的預(yù)測(cè)同樣適用了來自RoIAlign的特征,并得到G個(gè)通道特征,其中的體素表示了輸入位置的占據(jù)分?jǐn)?shù),在實(shí)驗(yàn)中研究人員使用了24x24x24大小的體素表示。

隨后立方體化方法(Cubify)將3D體素的占據(jù)概率轉(zhuǎn)換為三角網(wǎng)格模型。它將輸入的占據(jù)概率二進(jìn)制輸出,每一個(gè)體素占據(jù)點(diǎn)被一個(gè)立方體的三角網(wǎng)格代替,包含了8個(gè)頂點(diǎn)、18條邊和12個(gè)面。相鄰立方體共享邊,緊鄰的面被消除,最終得到與體素形態(tài)學(xué)相同的網(wǎng)格表示。

最后需要將得到的網(wǎng)格進(jìn)一步優(yōu)化以獲取更為精確的結(jié)果。與很多體素/網(wǎng)格的優(yōu)化方法相同,首先需要將頂點(diǎn)與圖像特征對(duì)齊,隨后利用圖網(wǎng)絡(luò)卷積的方法在每一條mesh邊上對(duì)信息進(jìn)行傳播,最后將得到的結(jié)果用于更新每一個(gè)頂點(diǎn)的位置。

上面三個(gè)步驟在優(yōu)化過程中不斷進(jìn)行。最后為了給mesh優(yōu)化分支建立損失,研究人員在網(wǎng)格表面進(jìn)行稠密的采樣得到點(diǎn)云來計(jì)算網(wǎng)格優(yōu)化分支的損失。

結(jié)果

最終研究人員在ShapeNet 數(shù)據(jù)集和Pix3D數(shù)據(jù)集上驗(yàn)證了這種方法的有效性。可以看到新提出的方法可以有效地預(yù)測(cè)帶有孔洞的物體。

同時(shí)對(duì)于復(fù)雜環(huán)境中的三維物體也有良好的預(yù)測(cè)效果:

文章附錄里給出了包括立方體化、網(wǎng)格采樣、消融性分析以及與各種方法的比較,如果想要了解更多的實(shí)現(xiàn)細(xì)節(jié),請(qǐng)參看:

https://arxiv.org/pdf/1906.02739.pdf

ref:

paper:https://arxiv.org/pdf/1906.02739.pdf

logopicture:https://dribbble.com/shots/1143435-Pikachu-Polymon

-

圖像

+關(guān)注

關(guān)注

2文章

1096瀏覽量

42367 -

Facebook

+關(guān)注

關(guān)注

3文章

1432瀏覽量

59050 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1238瀏覽量

26229

原文標(biāo)題:Facebook研究員提出Mesh R-CNN,向三維進(jìn)擊的目標(biāo)檢測(cè)!

文章出處:【微信號(hào):thejiangmen,微信公眾號(hào):將門創(chuàng)投】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

介紹目標(biāo)檢測(cè)工具Faster R-CNN,包括它的構(gòu)造及實(shí)現(xiàn)原理

Mask R-CNN:自動(dòng)從視頻中制作目標(biāo)物體的GIF動(dòng)圖

什么是Mask R-CNN?Mask R-CNN的工作原理

手把手教你操作Faster R-CNN和Mask R-CNN

研究人員們提出了一系列新的點(diǎn)云處理模塊

JD和OPPO的研究人員們提出了一種姿勢(shì)引導(dǎo)的時(shí)尚圖像生成模型

研究人員提出了一個(gè)名為CommPlan的框架

Facebook向研究人員發(fā)布友誼數(shù)據(jù)

基于改進(jìn)Faster R-CNN的目標(biāo)檢測(cè)方法

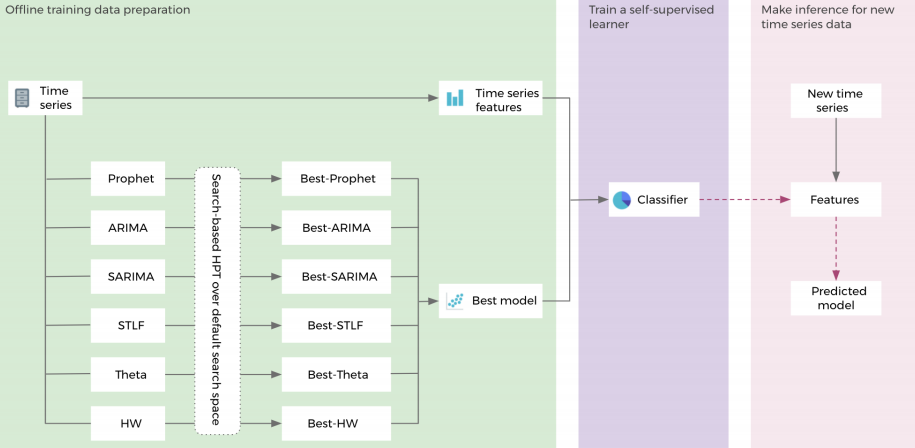

華裔女博士提出:Facebook提出用于超參數(shù)調(diào)整的自我監(jiān)督學(xué)習(xí)框架

基于Mask R-CNN的遙感圖像處理技術(shù)綜述

用于實(shí)例分割的Mask R-CNN框架

PyTorch教程14.8之基于區(qū)域的CNN(R-CNN)

Facebook的研究人員提出了Mesh R-CNN模型

Facebook的研究人員提出了Mesh R-CNN模型

評(píng)論