我們可以通過視覺、聽覺和觸覺來感知物體,而且這幾種感知是可以同時進行且互相感受的。但是機器人卻很難做到這一點,它也許能“看”,也可以“觸摸”,但是這些感知信息卻無法交換。

最近,來自MIT CSAIL的博士、曾經的北大學神李昀燭(一作)聯合朱俊彥(二作)等人提出一種預測性的人工智能,使機器人能夠通過觸摸來“看”物體,并且反過來通過視覺圖像來預測觸摸的感受。

加拿大作家瑪格麗特?阿特伍德曾在小說《盲刺客》中寫道:「觸覺先于視覺,先于語言。它是第一語言,也是最后的語言,它不會騙人。」

的確,有時候眼見未必為真,耳聽也未必為實。但你用手去觸摸的感知總不會騙人。

不過,雖然觸覺讓我們可以直接感受物理世界,但眼睛卻可以幫助我們立即理解這些觸覺信號的全貌,讓我們快速獲得關于物體的認知。

但對我們來說很簡單的一件事,對機器人來說卻并不容易。帶有攝像頭的機器人可以直接看世界,帶有觸覺系統的機器人可以直接感知。但具有觸覺或視覺的機器人無法互換這些信號。

為了縮小這種感官差距,麻省理工計算機視覺和人工智能實驗室的研究人員提出了一種預測性的人工智能,可以通過觸覺來「看」世界,再通過「看」來感受。

下面,我們來看一下具體研究(先上動圖感受下):

綠色:真實結果;紅色:預測結果

這篇論文到底做了什么?

人類感知世界的方式有很多種,包括視覺、聽覺和觸覺。在這項研究中,研究人員探索了視覺和觸覺之間的跨模態聯系。

這項跨域建模任務的主要挑戰在于兩者之間顯著的比例差異:當我們的眼睛同時感知整個視覺場景時,只能感受到物體的一小部分。

為了將視覺和觸覺聯系起來,研究人員引入了兩個跨模態任務:1)從視覺輸入中合成可信的觸覺信號,2)從視覺輸入中直接預測哪個物體和哪個部分正在被觸摸。

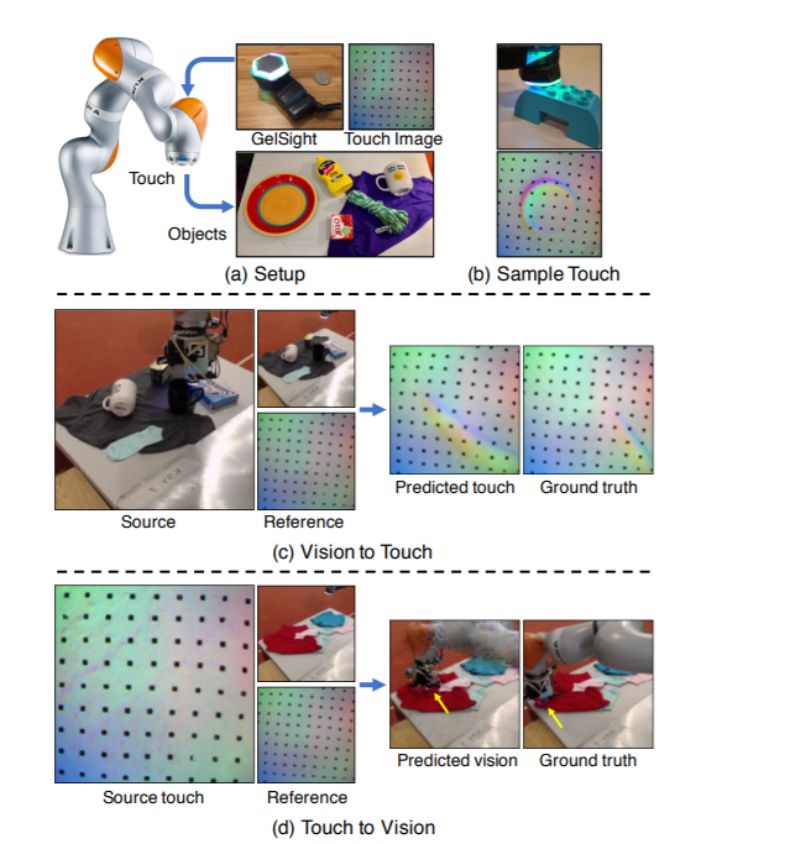

為了完成此目標,研究人員構建了一個機器人系統來自動化收集大規模視覺-觸覺對的過程。如圖 1a 所示,機器人手臂裝有一個觸覺傳感器,稱為 GelSight。

他們還設置了獨立的網絡攝像機來記錄物體和機械臂的視覺信息。研究人員總共記錄了對 195 個不同物體的 12000 次觸摸。每個觸摸動作包含 250 幀的視頻序列,最后產生了 300 萬個視覺和觸覺對圖像。

為了縮小圖像數據和觸摸數據之間的數據量比例差距,他們提出了新的條件對抗模型,該模型結合了觸覺的比例和位置信息。人類的感知研究表明,該模型可以根據觸覺數據生成逼真的視覺圖像,反之亦然,即它也可以根據視覺數據生成觸覺感知。

最后,研究人員給出了關于不同系統設計的定性和定量實驗結果,并可視化了模型學習到的表征,以幫助我們理解它捕捉到的東西。

這項研究可以幫助機器人更好的理解物體的性質,而相關的拓展甚至可以協助盲人更好的通過觸摸感知環境。

機器人如何通過觸覺來「看」世界,或者通過視覺圖像來「想象」觸覺

在模型層面,研究人員構建了一個跨模型的預測系統,以根據觸覺預測視覺,反之亦然。他們首先將觸覺中的程度、規模、范圍和位置信息結合在模型中。然后,使用數據平衡的方法多樣化其結果。最后,通過考慮時間信息的方法進一步提高準確性。

研究中的模型基于 pix2pix 方法,是一個用于圖像到圖像任務的條件 GAN 框架。

在任務中,生成器接受視覺圖像或觸覺圖像作為輸入,并生成一個對應的觸覺或視覺圖像。而判別器觀察輸入的圖像和輸出的圖像。

在訓練中,判別器分辨輸出和真實圖像的區別,同時生成器生成真實的,可以迷惑判別器的圖像。

在實驗中,研究人員使用視覺-觸覺圖像對來訓練模型。在從觸覺還原視覺的任務中,輸入觸覺圖像,而輸出是對應的視覺圖像。而在視覺預測觸覺的任務中,則輸入和輸出對調。

模型

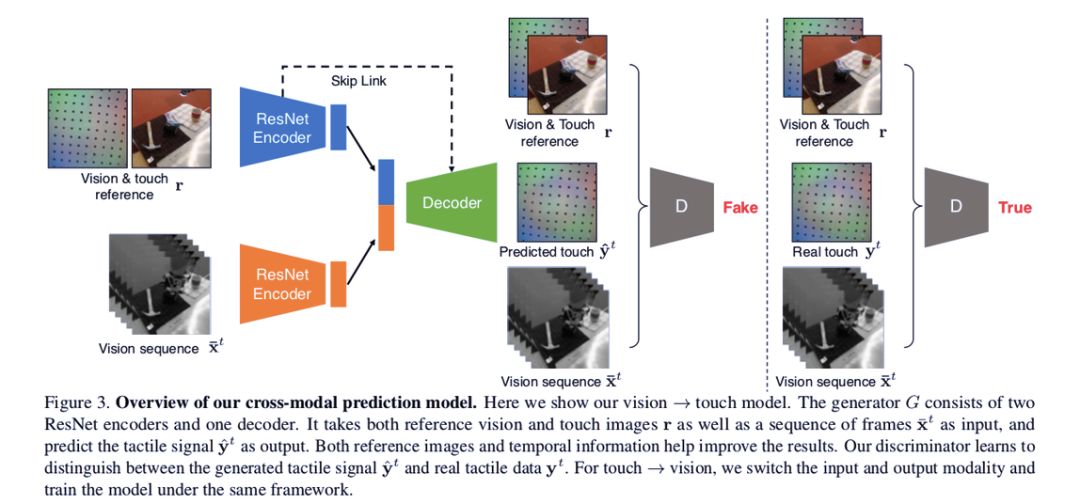

圖 3:視覺-觸覺的模型結構。生成器包括編碼器和解碼器兩個部分。輸入使用了視覺圖像和參考視覺-觸覺圖像一起編碼,并產生觸覺圖像作為輸出。對觸覺-視覺的任務上,使用同樣的結構,但是交換視覺圖像和觸覺圖像的輸入輸出位置。

模型使用編碼器-解碼器架構用于生成任務。在編碼器上分別使用兩個 ResNet-18 模型用于輸入圖像(視覺或觸覺圖像)和參考的視覺-觸覺圖像。

將來自編碼器的兩個向量合并后,研究人員將其輸入解碼器。解碼器包括五層標準的卷積神經網絡,因為輸出和一些參考圖像相似,研究人員在編碼器和解碼器之間其中加入了一些跨層連接。對于判別器,研究人員使用了 ConvNet。

為防止模式崩塌,研究人員采取數據重均衡策略來幫助生成器生成不同的模式。評估包括關于結果真實感的人類感知研究以及觸摸位置的準確性和 GelSight 圖像中變形量等客觀度量。

機器人設置

研究人員使用 KUKA LBR iiwa 工業機械臂來實現數據收集過程的自動化。機械臂上安裝的 GelSight 傳感器用以收集原始觸覺圖像。

他們還在機械臂背面的三腳架上安裝了一個網絡攝像頭,以捕捉機械臂觸摸物體的場景視頻。此外,研究人員還利用時間戳記錄來同步視覺和觸覺圖像。

數據集和方法

圖 2: 參與實驗的物品集合。使用了很多日用品和食品。

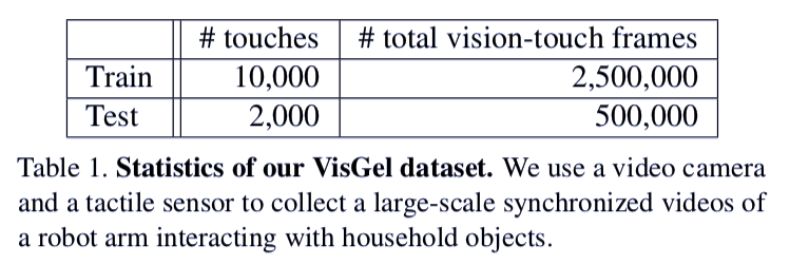

表 1: 數據集的劃分。

研究的數據集是 YCB(Yale-CMU-Berkeley)數據集,一個標準的日用品數據集,被廣泛用于機器人操作研究。研究人員在研究中使用了 195 個物品,其中 165 個作為訓練集,并使用 30 個已訓練的和 30 個模型未見過的物品進行測試。

訓練

模型使用 Adam 學習器,學習率 0.0002。L1 loss 的λ為 10。使用 LSGAN 而非標準 GAN 的損失函數。同時對圖像采用了一些數據增強機制,如隨機剪裁,或圖像亮度、對比度、飽和度和色調微調。

實驗創新

為了提高模型的表現,研究人員在實驗上采取了一些創新措施:

使用參考觸覺-視覺圖像,幫助機器人定位觸摸位置,減少從視覺到觸覺任務中需要判斷觸摸位置的困難。

平衡大量的沒有材質和起伏的平面觸覺數據,避免模型崩潰而使機器人在空氣中做無謂的物體觸摸動作。

考慮時間信息(何時觸摸了物體表面),避免輸入和輸出序列不同步。

實驗結果

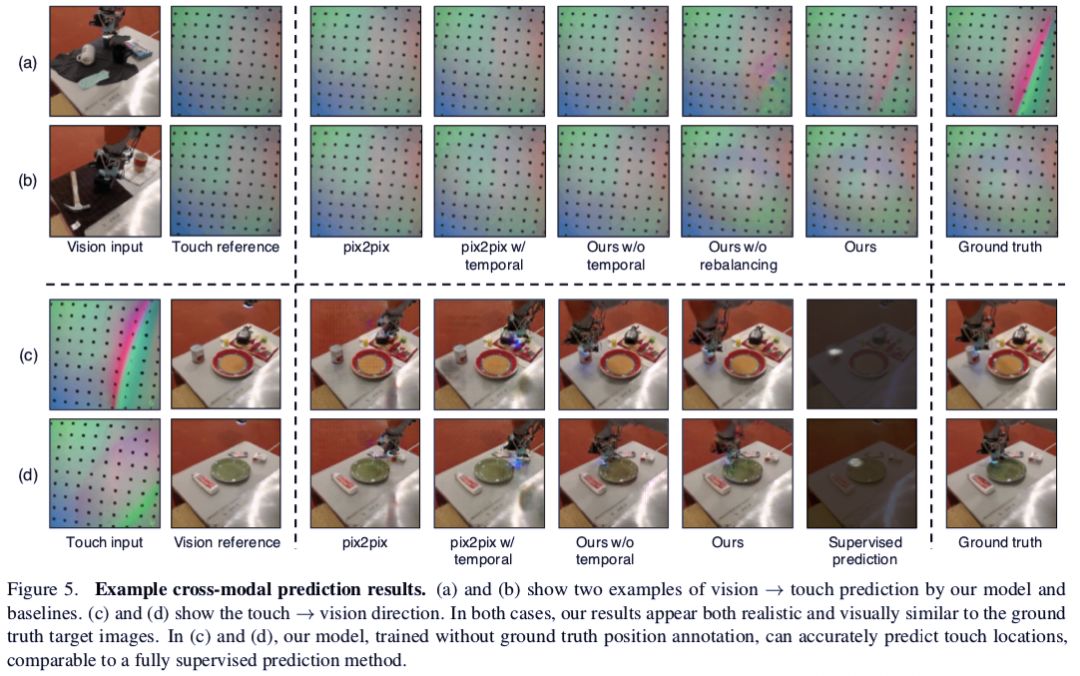

圖 5:模型和其他基線結果的可視化對比。模型可以更好地根據視覺圖像預測物體表面的觸覺信息,也能夠更好地根據觸覺信息還原圖像表面。

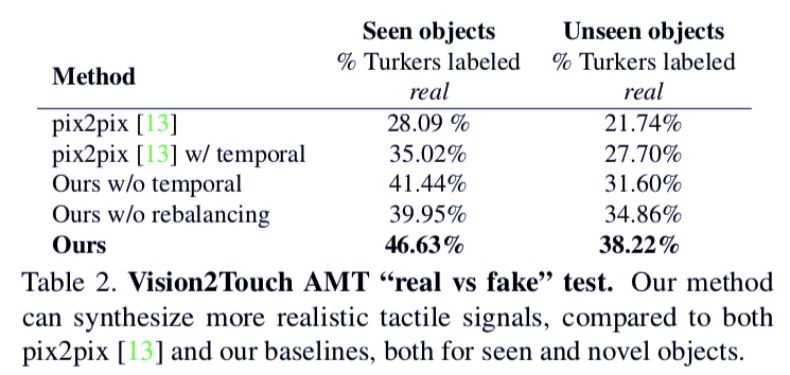

表 2:真假測試中的模型表現。模型可以更好地分辨真實和虛假的觸覺信號,不管是對已知的物體還是未知的物體。

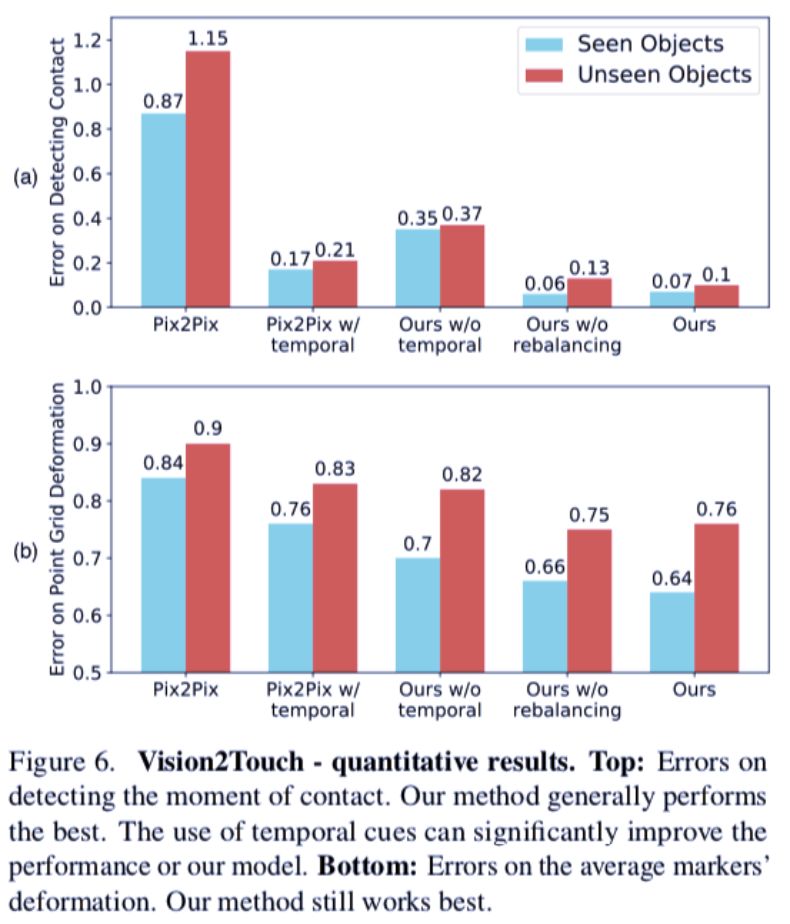

圖 6:從視覺到觸覺的量化評測結果。上圖:測試機器人是否已經認知到觸摸了物體表面的錯誤數。下圖:根據圖像還原觸覺點位置的失真錯誤情況。實驗模型表現基本上比其它模型好。

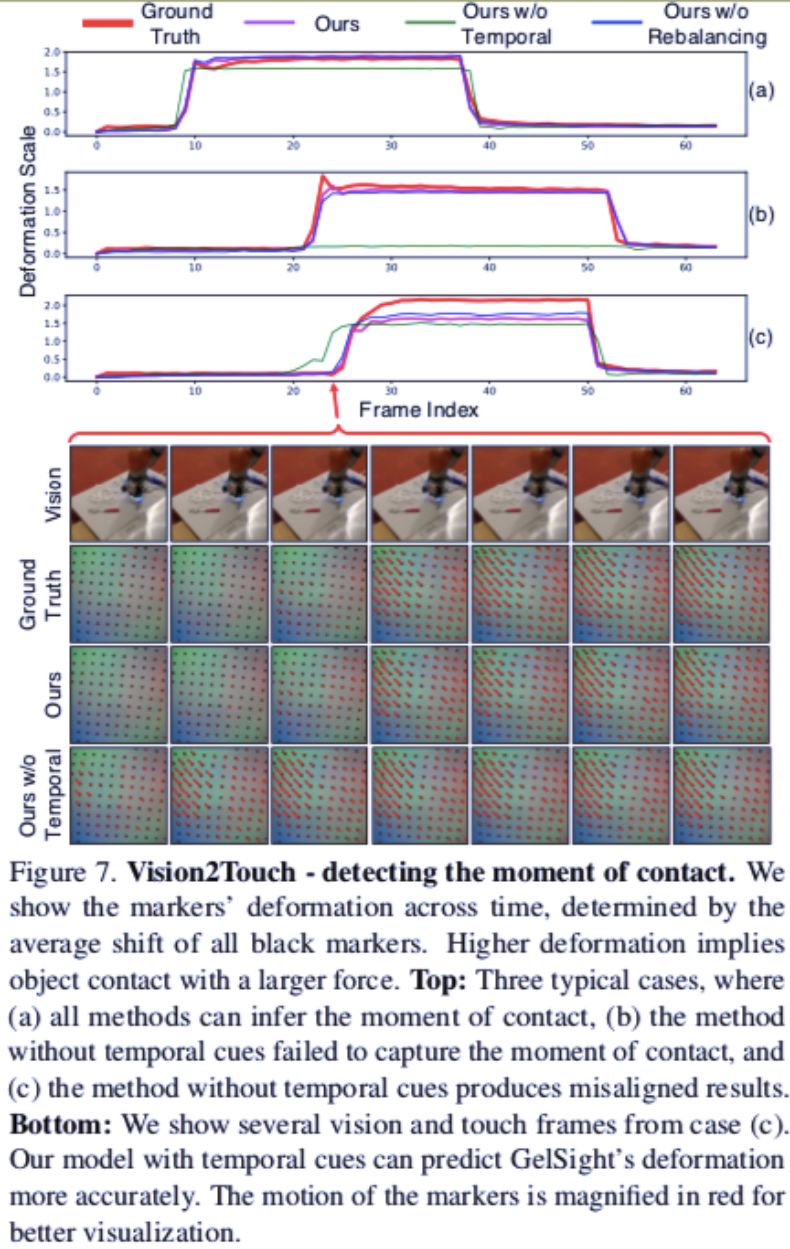

圖 7:從視覺還原觸覺的情況。上圖:模型是否能夠及時檢測到已經觸摸了物體表面的曲線。下圖:根據圖像還原的觸覺點陣信息。

-

機器人

+關注

關注

213文章

31080瀏覽量

222292 -

人工智能

+關注

關注

1817文章

50099瀏覽量

265438

原文標題:看一眼就知手感,北大學神聯手朱俊彥讓機器人「想象」觸感

文章出處:【微信號:cas-ciomp,微信公眾號:中科院長春光機所】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

大曉機器人發布開悟3.0,國產世界模型讓機器人擁有“超級大腦”

天太機器人與廣州大學共建“機器人研發實驗室”,產學研協同開新篇章

東北大學開源鴻蒙技術俱樂部正式揭牌成立

RK3576機器人核心:三屏異顯+八路攝像頭,重塑機器人交互與感知

小蘿卜機器人的故事

機器人競技幕后:磁傳感器芯片激活 “精準感知力”

工業機器人的特點

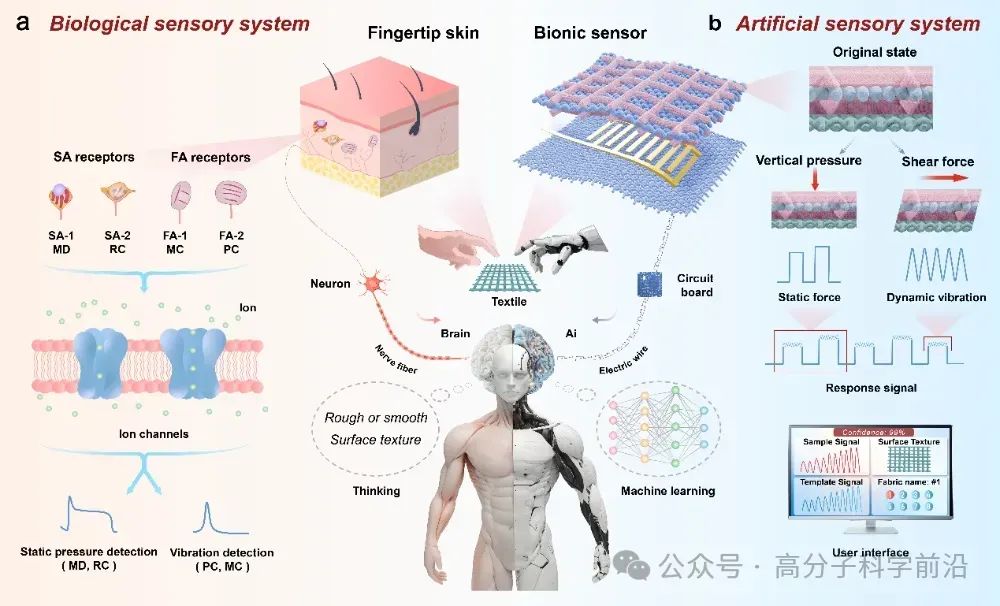

南京工業大學:仿生觸覺傳感系統讓機器人擁有“人類指尖”般的細膩感知

工業通信界的“月老”:CC\\-Link IE和DeviceNet如何牽起機器人的“紅線”

明遠智睿SSD2351開發板:語音機器人領域的變革力量

盤點#機器人開發平臺

【「# ROS 2智能機器人開發實踐」閱讀體驗】視覺實現的基礎算法的應用

【「# ROS 2智能機器人開發實踐」閱讀體驗】機器人入門的引路書

【「# ROS 2智能機器人開發實踐」閱讀體驗】+內容初識

面向大學的樹莓派 RemoteLab 機器人開發!

北大學神聯手朱俊彥讓機器人「想象」觸感

北大學神聯手朱俊彥讓機器人「想象」觸感

評論