在沒(méi)有災(zāi)難性遺忘的情況下,實(shí)現(xiàn)深度強(qiáng)化學(xué)習(xí)的偽排練

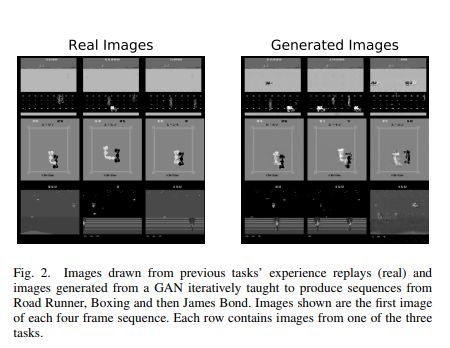

該新模型集成了偽排練,深度生成模型和雙重內(nèi)存方案,從而實(shí)現(xiàn)了一種高效的方法,即使任務(wù)數(shù)量增加,也不需要額外的存儲(chǔ)要求。通過(guò)迭代,該模型學(xué)習(xí)了三個(gè)Atari游戲,并在這三個(gè)游戲中保持了高于人類水平的表現(xiàn),高效程度不亞于經(jīng)過(guò)單獨(dú)訓(xùn)練的一組網(wǎng)絡(luò)。

所有這些都是在不訪問(wèn)以前的任務(wù)數(shù)據(jù)的情況下實(shí)現(xiàn)的。與現(xiàn)有的深度增強(qiáng)任務(wù)算法相比,新模型已經(jīng)表明它們不會(huì)像傳統(tǒng)的模型一樣忘記之前的任務(wù)。

潛在應(yīng)用與效果

研究人員和人工智能社區(qū)可以利用新模型進(jìn)一步改進(jìn)研究工作,并將模型應(yīng)用于前沿的電子游戲、自動(dòng)駕駛汽車和機(jī)器人中。如果有足夠大的網(wǎng)絡(luò),也許會(huì)誕生能處理多種任務(wù)的機(jī)器人特工。

原文:

https://arxiv.org/abs/1812.02464v2

雙注意網(wǎng)絡(luò)(DAN)用于改進(jìn)視覺(jué)參考分辨率

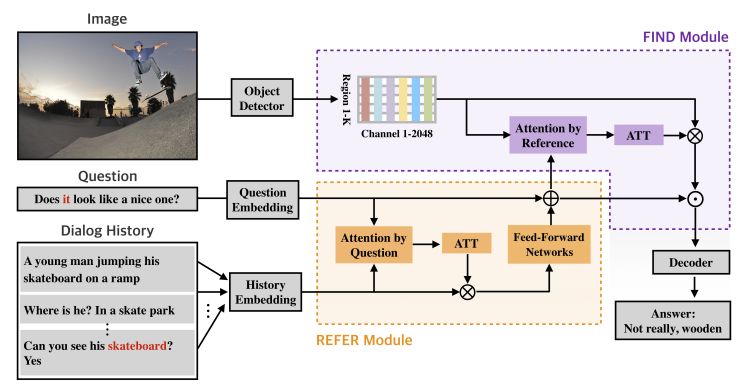

最近,研究人員通過(guò)提出DAN增強(qiáng)了視覺(jué)參考分辨率,為解決視覺(jué)參考分辨率問(wèn)題奠定了基礎(chǔ)。DAN實(shí)現(xiàn)了兩種類型的關(guān)注網(wǎng)絡(luò),包括REFER和FIND。REFER專門用于通過(guò)自我關(guān)注方法來(lái)學(xué)習(xí)查詢和對(duì)話歷史之間的關(guān)系。

相反,F(xiàn)IND采用圖像特征和參考感知表示輸入(REFER模塊的輸出),并通過(guò)實(shí)施自下而上的注意技術(shù)實(shí)現(xiàn)視覺(jué)接地。在VisDial v1.0和v0.9數(shù)據(jù)集上對(duì)DAN的定量和定性評(píng)估表明,它在很大程度上優(yōu)于現(xiàn)有的可視對(duì)話模型。

潛在應(yīng)用與效果

AI社區(qū)可以使用DAN來(lái)實(shí)現(xiàn)各種視覺(jué)對(duì)話任務(wù)的視覺(jué)參考分辨率,比如協(xié)作對(duì)話系統(tǒng)。因?yàn)樗灰蕾囉谥暗囊曈X(jué)注意力圖,所以DAN可以通過(guò)實(shí)施REFER組件來(lái)解決不清晰的視覺(jué)效果,并使用FIND模型組件對(duì)可視圖像進(jìn)行地面解析參考。

原文:

https://arxiv.org/abs/1902.09368v1

用于增強(qiáng)邊緣檢測(cè)的動(dòng)態(tài)特征融合(DFF)方法

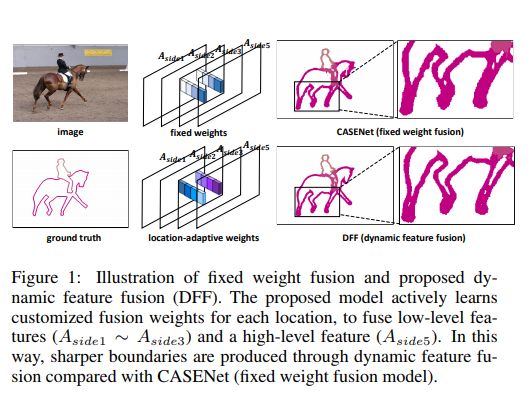

來(lái)自中國(guó)的研究人員通過(guò)提出一種新的動(dòng)態(tài)特征融合(DFF)策略來(lái)管理動(dòng)態(tài)特征融合,該策略為不同的圖像和位置分配不同的融合權(quán)重。DFF包括兩個(gè)模塊,特征提取器和自適應(yīng)權(quán)重融合組件。該模型通過(guò)實(shí)施權(quán)重模型來(lái)實(shí)現(xiàn)動(dòng)態(tài)特征融合,從而能夠針對(duì)輸入特征圖中的每一單個(gè)位置推斷多級(jí)特征上的適當(dāng)融合權(quán)重。

在對(duì)標(biāo)準(zhǔn)基準(zhǔn)數(shù)據(jù)集(如Cityscapes和SBD)進(jìn)行實(shí)驗(yàn)后,DFF證明了它可以通過(guò)更精確地定位對(duì)象邊緣和抑制不重要的邊緣響應(yīng)來(lái)大大提高模型性能。

潛在應(yīng)用與效果

語(yǔ)義邊緣檢測(cè)旨在聯(lián)合提取邊緣及其類別信息,以實(shí)現(xiàn)領(lǐng)域中的高端應(yīng)用,包括語(yǔ)義分割,對(duì)象識(shí)別等。DFF是第一個(gè)旨在學(xué)習(xí)自適應(yīng)融合權(quán)重的研究工作,它以輸入數(shù)據(jù)為條件,在SED研究中融合多層次特征,以促進(jìn)和實(shí)現(xiàn)SED任務(wù)的最新技術(shù)。通過(guò)考慮高級(jí)和低級(jí)主干特征映射,可以改善位置自適應(yīng)權(quán)重學(xué)習(xí)器。

原文:

https://arxiv.org/abs/1902.09104v1

用于自動(dòng)駕駛的離線和在線角落案例檢測(cè)框架

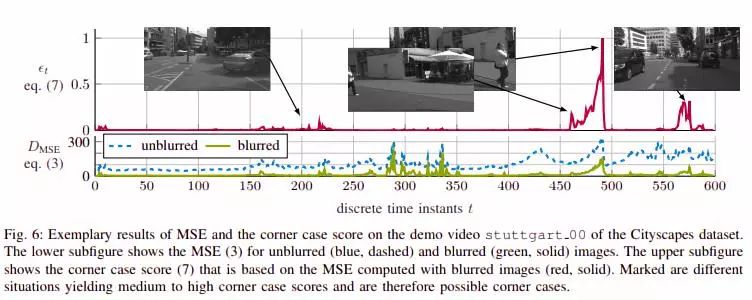

這項(xiàng)新研究定義了角落案例檢測(cè),并提出了一個(gè)框架,可以處理來(lái)自移動(dòng)車輛的前置攝像頭的視頻信號(hào),并為在線和離線用例生成角落案例分?jǐn)?shù)。根據(jù)該系統(tǒng)框架背后的研究人員所說(shuō),角落案例檢測(cè)系統(tǒng)可用作備用警告系統(tǒng),以提供有關(guān)自動(dòng)駕駛系統(tǒng)的異常場(chǎng)景的信息。另外,關(guān)于離線模式,角落情況檢測(cè)框架可用于分析大量視頻數(shù)據(jù)以返回異常數(shù)據(jù)。

角落案例檢測(cè)框架針對(duì)Cityscapes數(shù)據(jù)集的分段和圖像預(yù)測(cè)進(jìn)行了訓(xùn)練,該數(shù)據(jù)集包含來(lái)自50個(gè)城市的各種街道圖像。

潛在應(yīng)用與效果

自動(dòng)駕駛汽車研究人員和工程師可以實(shí)施角落案例框架,為自動(dòng)駕駛系統(tǒng)開發(fā)更集中的訓(xùn)練,因?yàn)樗兄诮鉀Q代表性不足的關(guān)鍵訓(xùn)練數(shù)據(jù)問(wèn)題。該系統(tǒng)還有助于選擇用于存儲(chǔ)和(重新)訓(xùn)練AI模型的相關(guān)場(chǎng)景。

此外,此次提出的角落案例檢測(cè)框架對(duì)于實(shí)現(xiàn)運(yùn)動(dòng)檢測(cè),圖像注冊(cè),視頻跟蹤,圖像鑲嵌,3D建模,全景拼接,對(duì)象識(shí)別等方面的進(jìn)一步開發(fā)是有效的。

原文:

https://arxiv.org/abs/1902.09184v1

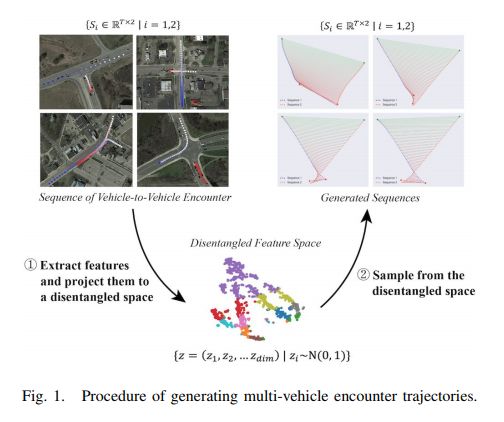

車輛相遇情況的數(shù)據(jù)集生成器

訓(xùn)練數(shù)據(jù)的缺乏大大減緩了自動(dòng)駕駛技術(shù)的發(fā)展速度。而近日發(fā)布的一種模擬模型,通過(guò)提供大量數(shù)據(jù)和資源,從而幫助工程師實(shí)現(xiàn)有效的自動(dòng)車輛開發(fā)測(cè)試,正逐步消除這一限制。

多車輛軌跡生成器(MTG)可以將多車輛場(chǎng)景(駕駛相遇數(shù)據(jù))編碼成可用于產(chǎn)生新的高質(zhì)量駕駛相遇數(shù)據(jù)的刻度表達(dá)。這種發(fā)生器模型包括雙向變分自動(dòng)編碼器和多分支解碼器兩大部分。

該研究還提出了一種新的解開度量指標(biāo),該指標(biāo)具有綜合分析模擬出的軌跡及駕駛場(chǎng)景模型穩(wěn)健度的可能性。與現(xiàn)有的VAE和infoGAN模型相比,這種新型生成器模型在生成高質(zhì)量的駕駛場(chǎng)景信息方面更占優(yōu)勢(shì)。

潛在應(yīng)用與效果

多車輛軌跡生成器是自動(dòng)駕駛開發(fā)中的一大進(jìn)步。不僅是自動(dòng)駕駛技術(shù)能因此獲益而加速發(fā)展,這一方法同樣可以擴(kuò)展到有類似數(shù)據(jù)短缺問(wèn)題的深度學(xué)習(xí)其他研究領(lǐng)域。

原文:

https://arxiv.org/abs/1809.05680v5

用于高分辨率人體姿態(tài)估計(jì)的高分辨率網(wǎng)絡(luò)(HRNet)

與以串聯(lián)方式連接子網(wǎng)絡(luò)的傳統(tǒng)方法不同,新的HRNet方法以并聯(lián)方式連接高分辨率子網(wǎng)絡(luò),從而可以保持高分辨率,并實(shí)現(xiàn)準(zhǔn)確的關(guān)鍵點(diǎn)預(yù)測(cè)。此外,許多現(xiàn)有的融合型方案結(jié)合了低級(jí)和高級(jí)表示,而HRNet執(zhí)行重復(fù)的多尺度融合以增強(qiáng)高分辨率表示,這對(duì)于高質(zhì)量的姿態(tài)估計(jì)是必不可少的。

在COCO關(guān)鍵點(diǎn)檢測(cè)和MPII人類姿勢(shì)數(shù)據(jù)集中進(jìn)行的實(shí)驗(yàn)表明,HRNet較于傳統(tǒng)方式更加有效。此外,HRNet在PoseTrack數(shù)據(jù)集上進(jìn)行測(cè)試上也表現(xiàn)出了在姿勢(shì)跟蹤方面的優(yōu)勢(shì)。所有模型和代碼均可在此鏈接上公開獲取。

潛在應(yīng)用與效果

研究人員和開發(fā)人員可以將HRNet應(yīng)用于高級(jí)對(duì)象檢測(cè),動(dòng)態(tài)識(shí)別,語(yǔ)義分割,人機(jī)交互(HCI),虛擬現(xiàn)實(shí),增強(qiáng)現(xiàn)實(shí),人臉識(shí)別及比對(duì),圖像識(shí)別及分類,翻譯以及其他依賴跟蹤和識(shí)別人類活動(dòng)而實(shí)現(xiàn)服務(wù)的應(yīng)用,例如Amazon Go。我很期待有一天我的智能手機(jī)可以告訴我我的舉重姿勢(shì)是否正確。

原文:

https://arxiv.org/abs/1902.09212v1

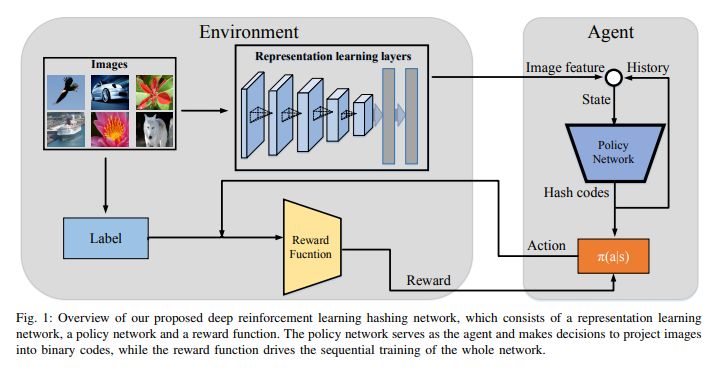

用于圖像復(fù)刻的深度強(qiáng)化學(xué)習(xí)方法(DRLIH)

DRLIH是第一個(gè)從深度強(qiáng)化學(xué)習(xí)角度去解決圖像復(fù)刻挑戰(zhàn)的研究項(xiàng)目。

這種深度學(xué)習(xí)網(wǎng)絡(luò)包括特征表示網(wǎng)絡(luò)和策略網(wǎng)絡(luò)。策略網(wǎng)絡(luò)利用遞歸神經(jīng)網(wǎng)絡(luò)(RNN)作為代理,按時(shí)間順序?qū)D像投影為二進(jìn)制代碼。

這樣的網(wǎng)絡(luò)設(shè)計(jì)有助于生成圖像并將其投影到復(fù)刻代碼1中,并計(jì)算復(fù)刻代碼0的概率。研究人員還提出了一種順序?qū)W習(xí)策略,通過(guò)糾正先前函數(shù)的錯(cuò)誤來(lái)提高檢索準(zhǔn)確性,從而學(xué)習(xí)復(fù)刻函數(shù)。DRLIH方法已經(jīng)在三個(gè)標(biāo)準(zhǔn)數(shù)據(jù)集上進(jìn)行了測(cè)試,結(jié)果證明它比傳統(tǒng)圖像復(fù)刻方法有效。

潛在應(yīng)用與效果

DRLIH 技術(shù)可以準(zhǔn)確地表示,索引,檢索和自動(dòng)識(shí)別圖像。通過(guò)查詢圖像是否為原始圖像的構(gòu)造或副本,它可用于圖像有效性的驗(yàn)證。DRLIH還可用于本地存儲(chǔ)或緩存的有效性驗(yàn)證,防止照片重新傳輸或重復(fù)存儲(chǔ),以及目前通過(guò)水印實(shí)現(xiàn)的版權(quán)保護(hù)等。

原文:

https://arxiv.org/abs/1802.02904v2

語(yǔ)境嵌入改進(jìn)臨床概念提取

新的研究提出了一種處理這一長(zhǎng)期挑戰(zhàn)的新方法。研究人員評(píng)估了各種嵌入方法,包括word2vec,GloVe fastText,ELMo和BERT。他們還進(jìn)行了涵蓋四個(gè)臨床概念語(yǔ)料庫(kù)的分析,以證明上述每種技術(shù)的普遍性。

更重要的是,他們使用大型臨床語(yǔ)料庫(kù)開發(fā)預(yù)訓(xùn)練的情境化嵌入,并將性能與預(yù)訓(xùn)練模型進(jìn)行了比較。

最后,他們的論文詳述了與開放領(lǐng)域語(yǔ)料庫(kù)相比,預(yù)訓(xùn)練對(duì)臨床語(yǔ)料庫(kù)影響的詳細(xì)分析,并總結(jié)報(bào)告了臨床概念提取的性能提升:該提取在所有測(cè)試語(yǔ)料庫(kù)中實(shí)現(xiàn)了最先進(jìn)的結(jié)果。研究結(jié)果顯示出語(yǔ)境嵌入在臨床文本語(yǔ)料庫(kù)中的優(yōu)勢(shì),其在各類任務(wù)的完成上都優(yōu)于傳統(tǒng)模型。

潛在應(yīng)用與效果

對(duì)于臨床概念提取,上下文嵌入有大幅度改善自動(dòng)文本處理的潛力。

此外,它還使研究人員對(duì)臨床文本的訪問(wèn)更加無(wú)障礙,從而進(jìn)一步推動(dòng)該領(lǐng)域的信息管理和非結(jié)構(gòu)化臨床文本的數(shù)據(jù)挖掘。

-

人工智能

+關(guān)注

關(guān)注

1817文章

50098瀏覽量

265331 -

自動(dòng)駕駛

+關(guān)注

關(guān)注

793文章

14882瀏覽量

179817 -

強(qiáng)化學(xué)習(xí)

+關(guān)注

關(guān)注

4文章

270瀏覽量

11969

原文標(biāo)題:DAN改進(jìn)視覺(jué)參考分辨率,DRLIH實(shí)現(xiàn)圖像復(fù)刻 | AI一周學(xué)術(shù)

文章出處:【微信號(hào):BigDataDigest,微信公眾號(hào):大數(shù)據(jù)文摘】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

什么是深度強(qiáng)化學(xué)習(xí)?深度強(qiáng)化學(xué)習(xí)算法應(yīng)用分析

*** 災(zāi)難性故障,求救,經(jīng)驗(yàn)分享

***災(zāi)難性故障

深度強(qiáng)化學(xué)習(xí)實(shí)戰(zhàn)

將深度學(xué)習(xí)和強(qiáng)化學(xué)習(xí)相結(jié)合的深度強(qiáng)化學(xué)習(xí)DRL

薩頓科普了強(qiáng)化學(xué)習(xí)、深度強(qiáng)化學(xué)習(xí),并談到了這項(xiàng)技術(shù)的潛力和發(fā)展方向

強(qiáng)化學(xué)習(xí)和監(jiān)督式學(xué)習(xí), 非監(jiān)督式學(xué)習(xí)的區(qū)別

DeepMind徹底解決人工智能災(zāi)難性遺忘問(wèn)題

Batch的大小、災(zāi)難性遺忘將如何影響學(xué)習(xí)速率

基于深度強(qiáng)化學(xué)習(xí)的無(wú)人機(jī)控制律設(shè)計(jì)方法

《自動(dòng)化學(xué)報(bào)》—多Agent深度強(qiáng)化學(xué)習(xí)綜述

強(qiáng)化學(xué)習(xí)的基礎(chǔ)知識(shí)和6種基本算法解釋

ESP32上的深度強(qiáng)化學(xué)習(xí)

強(qiáng)化學(xué)習(xí)的基礎(chǔ)知識(shí)和6種基本算法解釋

模擬矩陣在深度強(qiáng)化學(xué)習(xí)智能控制系統(tǒng)中的應(yīng)用

在沒(méi)有災(zāi)難性遺忘的情況下,實(shí)現(xiàn)深度強(qiáng)化學(xué)習(xí)的偽排練

在沒(méi)有災(zāi)難性遺忘的情況下,實(shí)現(xiàn)深度強(qiáng)化學(xué)習(xí)的偽排練

評(píng)論