2018 年,由美國國家能源研究科學(xué)計算中心 (NERSC) 與 NVIDIA組成的聯(lián)合團隊取得了一項突破性成就。他們成功將一種科學(xué)嚴謹?shù)?a target="_blank">深度學(xué)習(xí)應(yīng)用擴展至 27000 多個NVIDIA V100Tensor 核心 GPU,攻克了此過程中百億億次運算的難關(guān)。憑借該項成就,研究團隊由此斬獲高性能計算領(lǐng)域的最高獎項ACM 戈登貝爾獎。除 2018 年的技術(shù)論文與新聞稿之外,我們還將在本文中探討這項成就對 AI 領(lǐng)域產(chǎn)生的深遠影響,以及未來面臨的開放性挑戰(zhàn)。

由伯克利實驗室與橡樹嶺國家實驗室各自領(lǐng)導(dǎo)的兩個研究團隊共享 2018 年 ACM 戈登貝爾獎

深度學(xué)習(xí)軟件:性能與生產(chǎn)力

低級工具能為開發(fā)者帶來精確度,高級工具則可提高工作效率,這二者之間總存在一個折衷點。我們已為此找到解決方案。在本次項目中,我們用高效的 Python 和 TensorFlow 表示網(wǎng)絡(luò)架構(gòu)與整體的應(yīng)用工作流。TensorFlow 反過來會利用在 C 和 C++ 環(huán)境中實施的例程來實現(xiàn)高性能,提供精確度,并解放開發(fā)者以提高其工作效率。因此,在 8 個月的時間里,我們的團隊從頭開始構(gòu)建網(wǎng)絡(luò)原型,并在全球最大的高性能計算 (HPC) 系統(tǒng) Summit 上對其性能與擴展作出了優(yōu)化。

我們相信,此項目能夠展示出研究人員長期推測的 HPC 與 AI 軟件堆棧的實際融合效果,即以 C/C++ 編寫的高性能庫 (CuDNN) 和框架 (TensorFlow),以及通過 Python 公開的高效接口。同理,我們還在 NCCL 和 MPI 中實施經(jīng)高度優(yōu)化且基于拓撲感知的通信集合,但通過簡單高效的 Horovod 接口實現(xiàn)公開。展望未來,我們相信,在助力科學(xué)家及更廣泛的研究社區(qū)探索更復(fù)雜架構(gòu)的過程中,為混合并行模式(數(shù)據(jù)、模型、流水線)提供透明支持將至關(guān)重要。

深度學(xué)習(xí)硬件:GPU 和混合精度

本次項目利用 NVIDIA Volta GPU 來訓(xùn)練 DeepLabv3+ 分割網(wǎng)絡(luò)。在混合精度模式下,Volta 上可達到的峰值性能為 125 萬億次浮點運算。該模式由 NVIDIA 通過 Tensor 核心 GPU 架構(gòu)推出,可執(zhí)行 FP16 精度計算并能以 FP32 精度模式累積結(jié)果。在本項目開展之前,該領(lǐng)域存在一個仍待解決的問題,即現(xiàn)實的科學(xué)應(yīng)用能否利用 FP16(不損失精確度)并獲得較高的峰值性能。我們的研究最終證明,對于科學(xué)領(lǐng)域的模式識別問題,16 位精度可能足以滿足相關(guān)需求。此外,對于擁有 4000 多個計算核心的復(fù)雜應(yīng)用而言,極高的峰值亦有可能實現(xiàn):在規(guī)模龐大的 GPU 集群上,我們的應(yīng)用實現(xiàn)了每塊 GPU 大約 40 萬億次浮點運算的峰值性能。

我們相信,這些結(jié)果為科學(xué)應(yīng)用打開了通往低精度加速器的一扇大門。雖然原始數(shù)據(jù)集可能具有高精度(64 位或 32 位),但我們或許仍可以在不損失收斂或穩(wěn)定性的前提下,以低精度模式執(zhí)行模式識別任務(wù)。

開放性挑戰(zhàn)

如要在當代的 HPC 系統(tǒng)上實現(xiàn)百億億級的性能,我們需對所有組件仔細調(diào)優(yōu),包括硬件(CPU、GPU、NVLink、文件系統(tǒng)、網(wǎng)絡(luò)互連)和軟件。雖然我們的項目成功實現(xiàn)了大幅調(diào)優(yōu)、優(yōu)化和擴展,但我們想指出兩項挑戰(zhàn),以便向行業(yè)及研究社區(qū)征求更多意見。

大規(guī)模數(shù)據(jù)管理

得益于 GPU 架構(gòu)在加快計算方面取得的進展,我們現(xiàn)已能在單個硅處理器上暢享高于 100 萬億次浮點運算級的性能。隨著 GPU 速度越來越快,向其輸送數(shù)據(jù)的能力會逐漸限制性能。本次項目中,我們對 20 太字節(jié)的數(shù)據(jù)集展開分析,這實際上需要整個 Summit 系統(tǒng)保持每秒大約 4 太字節(jié)的 I/O 速率。Summit 上的 GPFS 文件系統(tǒng)根本無法勝任該項任務(wù),在 NERSC Cori 系統(tǒng)的 Lustre 文件系統(tǒng)上執(zhí)行的類似實驗也以徹底失敗而告終。對于這兩種情況,在節(jié)點本地 NVMe上暫存數(shù)據(jù)和突發(fā)緩沖區(qū)技術(shù)便顯得至關(guān)重要。

傳統(tǒng)的 HPC 文件系統(tǒng)主要用于支持以寫入為主的工作負載;而深度學(xué)習(xí)工作負載則屬于讀取密集型負載,對數(shù)據(jù)帶寬和元數(shù)據(jù)操作速率要求頗高。如要支持大規(guī)模深度學(xué)習(xí)工作負載,我們可能必須先對緩存分層、分片和混編操作提供透明支持。

大規(guī)模收斂

提供深度學(xué)習(xí)解決方案的時間由兩部分構(gòu)成:計算擴展效率和統(tǒng)計擴展效率。我們的研究已經(jīng)展示出卓越的計算擴展性能,并且提供了許多有關(guān)系統(tǒng)級注意事項的建議。一個未解決的問題是,如何使用 SGD(隨機梯度下降)的其中一個收斂屬性取代大批量(在本項目中,批量大小高于 27000)。

在 HPC 資源上提供高度并行性具有正反兩方面作用。如要以超高并發(fā)級別在大規(guī)模資源上運行,我們需在短時間內(nèi)對超參數(shù)進行調(diào)優(yōu)。有關(guān)收斂算法行為的啟發(fā)式方法可能會或不會繼承自較小規(guī)模的運行。盡管目前對于選擇各類超參數(shù)所產(chǎn)生效果的實證評估都很合理,但我們預(yù)計,科學(xué)界將需要更好的指導(dǎo)原則,以及用于解決新問題的收斂保證。

我們相信,在解決收斂問題的過程中,進一步開發(fā) LARS 與 LARC 等新算法和潛在的高階優(yōu)化方法將是至關(guān)重要的一環(huán)。

-

gpu

+關(guān)注

關(guān)注

28文章

5194瀏覽量

135468 -

人工智能

+關(guān)注

關(guān)注

1817文章

50098瀏覽量

265414 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5599瀏覽量

124398

原文標題:攀登百億億級深度學(xué)習(xí)之巔

文章出處:【微信號:tensorflowers,微信公眾號:Tensorflowers】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

人工智能與機器學(xué)習(xí)在這些行業(yè)的深度應(yīng)用

低功耗高性能之選:LTC6256運放深度剖析

AI服務(wù)器電源測試解決方案:為算力巨擘注入穩(wěn)定之魂

華為數(shù)字技術(shù)推動交通高質(zhì)量發(fā)展

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+第二章 實現(xiàn)深度學(xué)習(xí)AI芯片的創(chuàng)新方法與架構(gòu)

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+內(nèi)容總覽

【Sipeed MaixCAM Pro開發(fā)板試用體驗】基于MaixCAM-Pro的AI生成圖像鑒別系統(tǒng)

AI 芯片浪潮下,職場晉升新契機?

自動駕駛中Transformer大模型會取代深度學(xué)習(xí)嗎?

NVIDIA全棧加速代理式AI應(yīng)用落地

任正非說 AI已經(jīng)確定是第四次工業(yè)革命 那么如何從容地加入進來呢?

Nordic收購 Neuton.AI 關(guān)于產(chǎn)品技術(shù)的分析

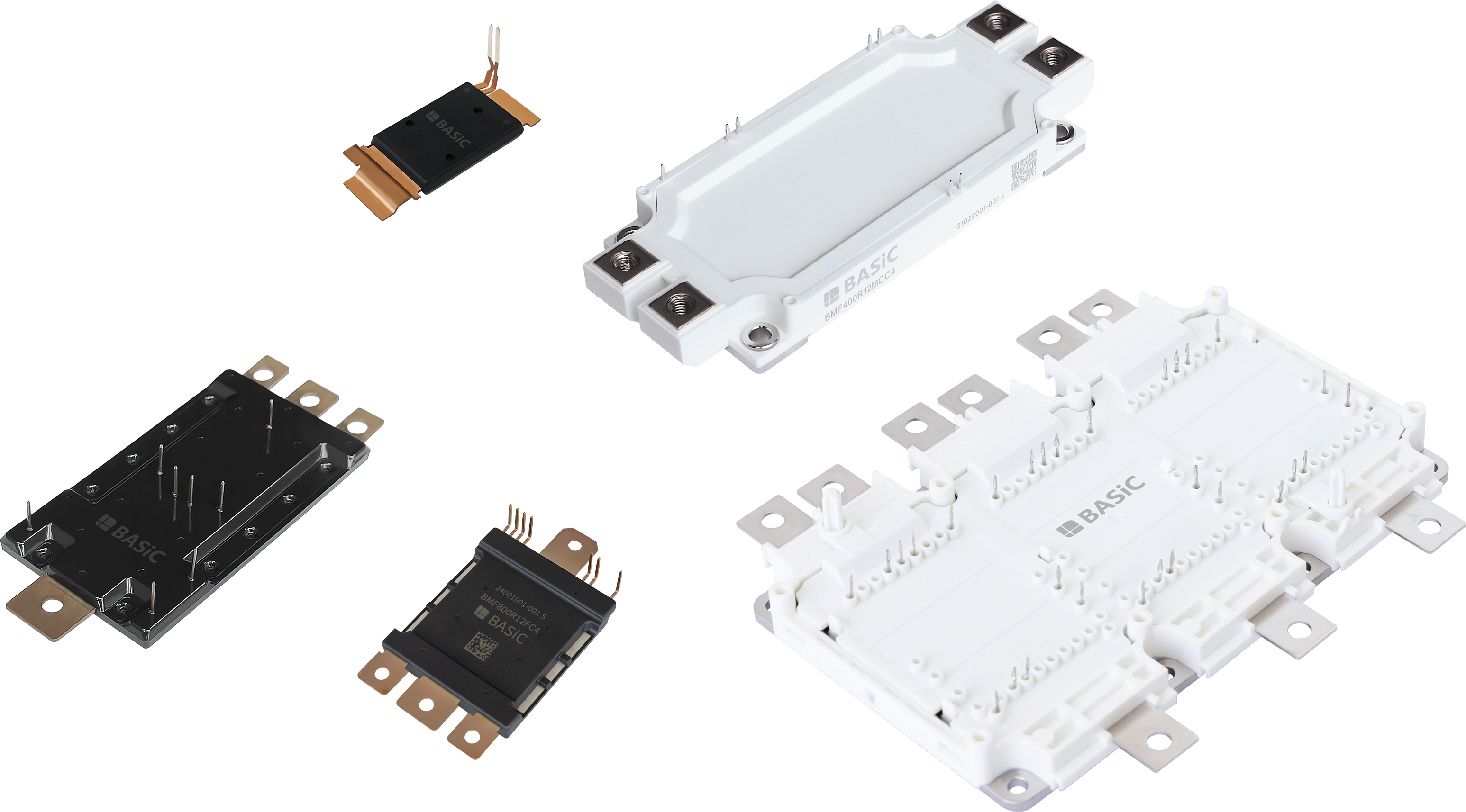

部分外資廠商IGBT模塊失效報告作假對中國功率模塊市場的深遠影響

攀登深度學(xué)習(xí)之巔 對AI領(lǐng)域會產(chǎn)生什么深遠影響

攀登深度學(xué)習(xí)之巔 對AI領(lǐng)域會產(chǎn)生什么深遠影響

評論