隨著數據中心為滿足日益增長的工作負載需求而在單位面積內集成更多計算能力,如何為各類IT設備、冷卻技術及其他建筑系統供電,正逐漸成為制約其發展的關鍵因素。麥肯錫預測,2023年至2030年間全球數據中心容量需求將以每年19%至22%的速度增長,達到171至219千兆瓦的規模。

這種激增主要由人工智能工作負載驅動。相比傳統應用,AI工作負載的能耗明顯更高,從而加速了對熱效應緩解方案的需求——因為在更有限的空間內部署更高功率,必然會帶來更嚴峻的散熱挑戰。電力分配、備用系統及熱管理領域的新進展,展現了新興工程解決方案應對日益增長電力需求的能力。在本文中,我們將探討提升現代數據中心能效與散熱效率的新方法和解決方案。

01基于ORV3的供電分配革新

由開放式計算項目(OCP)制定的ORV3規范正重塑數據中心的供電架構。該規范通過定義可擴展且高度適配的機架供電架構,推動了從12V直流向48V直流供電的演進。更高的電壓在提升效率的同時,也增加了數據中心單位面積的功率密度,從而緩解了空間限制對數據中心設計造成的困擾。

在這一轉變下,機架內采用48V母線進行電力分配,服務器直接從母線取電。通過消除12V轉換環節,設施整體效率得以提升,傳輸過程中的能量損耗也相應減少。通過省去為每臺服務器配備獨立電源,該架構釋放了機內空間,使服務器能夠直接由48V母線供電。這種整合減少了組件數量,簡化了維護工作,并提高了每臺機架內的功率密度。

此外,向48V直流供電的轉變不僅僅是能源效率的漸進式提升,更由于電壓提升,在相同功率輸出下可降低電流需求,進而減小導線尺寸并降低電阻損耗。對于企業級規模的設施而言,這些效率提升將在數千個機架中產生累積效應。ORV3規范提供了一個標準化框架,既保障供應商間的互操作性,又為運營商提供靈活的系統配置空間。Molex PowerPlane母線連接器以及PowerPlane OCP ORV3線纜組件作為組件創新的前沿成果,專為滿足此類架構需求而設計。

02計可靠的備用電源系統

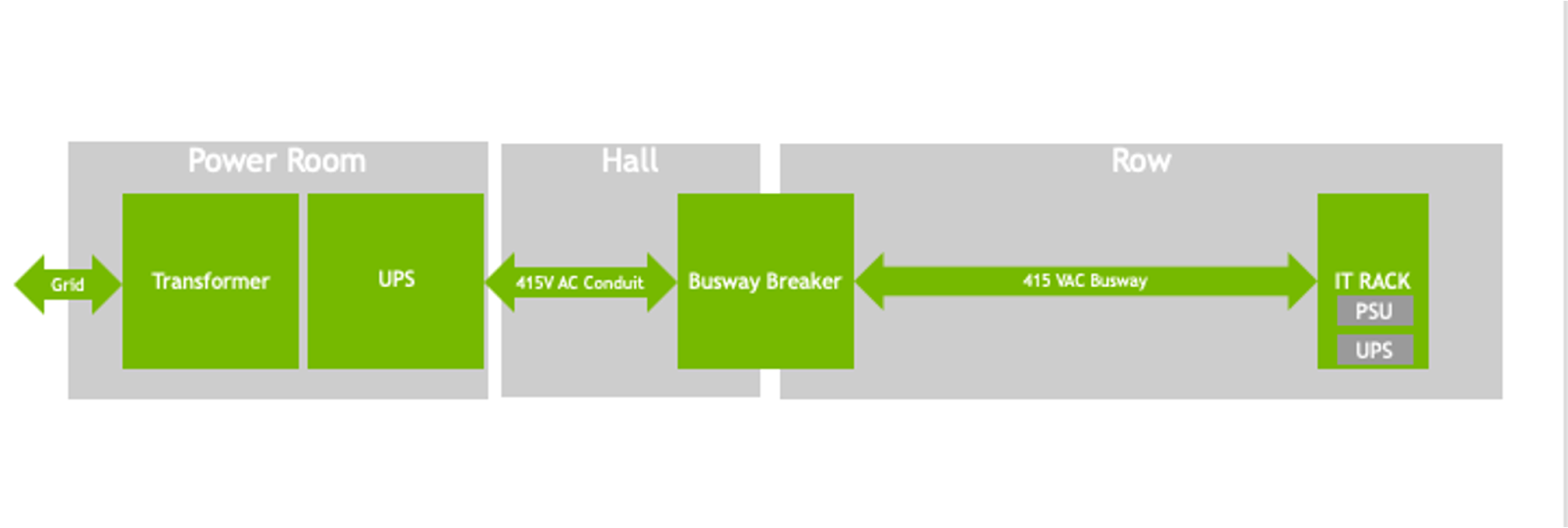

將電網電力輸送至服務器是一項挑戰,而構建電網故障冗余方案則創造了新的工程機遇。當電網斷電時,不間斷電源(UPS)必須調用電池組和發電機填補缺口,且切換過程需無縫銜接以避免服務中斷。因為對于數據中心來說,持續運行始終是首要任務。

在線雙變換式UPS系統因能提供瞬時、純凈且穩定的電力,目前成為首選拓撲結構。這類系統持續將輸入的交流電轉換為直流電用于電池充電和系統運行,隨后再將直流電逆變為交流電輸出。該雙重轉換技術能夠隔離負載與電網干擾,并在斷電情況下實現零轉換時間。

UPS的性能在很大程度上取決于每個連接點的電阻值。降低接觸電阻可減少熱損耗和電壓損耗,從而提升可靠性和能效。根據Molex 2023年《電力現狀》調查報告顯示,40%的數據中心工程師將電源管理(包括電路保護、開關設備和電池系統)列為極嚴峻的設計挑戰。

2023年調查中關于電力系統設計或實施面臨極大挑戰的工業應用領域的受訪者反饋(圖源:Molex)

為高電流密度和低接觸電阻而設計的組件,通過確保在不同負載條件下實現可靠的電力傳輸,解決了這一問題。Molex推出創新型電源管理解決方案,將這些電氣參數作為核心規格進行設計,助力數據中心實現峰值效率與可靠性。

03應對冷卻挑戰

數據中心約40%的用電量用于冷卻,因此熱管理成為了設施運營中的一項重要成本支出。面對如此巨大的功耗,工程師與流體化學家正著力提升冷卻效率,以減少能源成本和環境影響。

浸沒冷卻技術作為新興解決方案,與傳統的空氣冷卻系統相比,不僅提高了能源效率,還減少了冷卻設備的占地面積。該技術通過將服務器浸沒于介電液體中直接吸收組件熱量,消除了對空氣處理設備的需求,使系統在進行熱量轉移時無需高負荷運行,從而降低能耗,并在相同占地面積內實現更高效的散熱。

此外還有單相和雙相浸沒冷卻方案,以及直接芯片液冷(DTC)技術。這些液體冷卻方法可將數據中心的能效比(PUE)提升至1.03至1.2之間,而風冷系統的能效比則維持在1.2至2.0之間。PUE指標通過對比設施總功耗與IT設備功耗來衡量能效,數值越低代表能效越高。理論上,PUE值為1.0表示極佳的能效狀態,但由于系統運行過程中不可避免的能量損耗,這一理想狀態難以實現。例如,將PUE從2.0降至1.2,可實現40%的設施能耗削減。

無論采用何種冷卻方式——空氣冷卻、DTC或浸沒冷卻——用于冷卻硬件的連接器都必須滿足嚴格的環境要求。這些連接器必須能在惡劣條件下使用,并密封防潮,以防止腐蝕和電氣故障。高功率和高溫使得可靠性成為持續關注的問題。若連接器無法承受溫度或濕度變化,即使是微小的故障也可能迅速蔓延至整個系統。

04規模化高效設計

數據中心工程師們正在探索新的效率提升途徑——不是通過調整現有系統,而是從根本上重新構思電力、備用電源和冷卻系統的整體架構。這種新思路的核心包括:采用48V直流供電系統以降低轉換損耗;配備低接觸電阻連接器的在線雙變換式UPS系統,以確保電源轉換過程中的供電質量;以及采用浸沒式冷卻技術,從而降低熱管理帶來的能耗負擔。

當下踐行這些設計理念的工程師,將能同時滿足當前效率目標和未來增長需求。每次技術進步都在更嚴格的功耗和熱量限制下提升了計算能力。隨著工作負載需求的持續增長,特別是人工智能應用的快速擴展,這些解決方案正不斷拓展可能實現的技術邊界。

-

供電

+關注

關注

1文章

399瀏覽量

24724 -

散熱

+關注

關注

3文章

603瀏覽量

33327 -

數據中心

+關注

關注

18文章

5695瀏覽量

75144

原文標題:算力狂飆,供電冷卻如何跟上?解讀面向未來的數據中心智能策略

文章出處:【微信號:貿澤電子,微信公眾號:貿澤電子】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

數據中心發展的三大驅動力

NVIDIA Jetson系列開發者套件助力打造面向未來的智能機器人

人工智能數據中心的光纖布線策略

未來的數據中心需要怎樣的布線方案

物聯網數據中心是什么?有什么功能?

中汽中心智能網聯科技創新基地落戶天津

賦能人工智能未來:ADI宣布支持800 VDC數據中心架構

睿海光電以高效交付與廣泛兼容助力AI數據中心800G光模塊升級

加速AI未來,睿海光電800G OSFP光模塊重構數據中心互聯標準

華為面向拉美地區發布全新星河AI數據中心網絡方案

中型數據中心中的差分晶體振蕩器應用與匹配方案

華為面向亞太地區發布全新星河AI數據中心網絡方案

NVIDIA 800V HVDC 架構賦能新一代AI數據中心 挑戰傳統機架電源系統極限

解讀面向未來的數據中心智能策略

解讀面向未來的數據中心智能策略

評論