編者按:《GANs in Action》作者Jakub Langr簡述了對抗生成網(wǎng)絡(luò)原理及其在半監(jiān)督學(xué)習(xí)中的意義。

在許多研究人員和我的朋友看來,對抗生成學(xué)習(xí)/網(wǎng)絡(luò)(Generative Adverserial Learning/Networks,GANs)很可能是AI的未來發(fā)展方向之一。GAN在商業(yè)上有很清晰的吸引力:可以基于較少的數(shù)據(jù)訓(xùn)練,可以創(chuàng)建迷人的應(yīng)用(例如3D模型生成),有大量研究潛力。

本文包括一定的技術(shù)內(nèi)容,也有一些高層的偽代碼,但我將盡力讓這篇文章容易理解,也希望這篇文章不會太枯燥。

你想擠上AI這趟車嗎?

GAN這一切都是最前沿的內(nèi)容,本文提到的一些內(nèi)容甚至是一兩年前剛在學(xué)術(shù)期刊上發(fā)布的內(nèi)容。所以,除非你是這方面的博后,初次接觸GAN可能會讓你覺得不同尋常(至少對我來說是這樣的)。同時這也意味著其中有一些研究沒有對應(yīng)的理論,你需要應(yīng)對一些超奇怪的bug. 不過因為我最近完成了(好吧,我真的很喜歡上MOOC)Parag Mital開設(shè)的非常棒的Creative Applications of Deep Learning with TensorFlow(基于TensorFlow的深度學(xué)習(xí)創(chuàng)意應(yīng)用)課程,我決定分享一些我學(xué)到的東西。

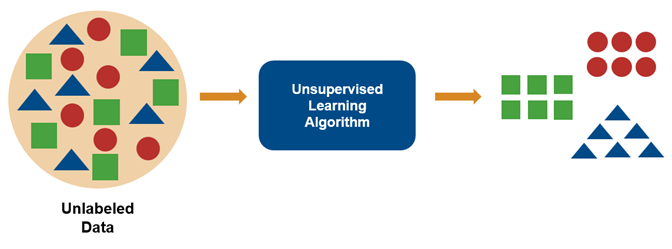

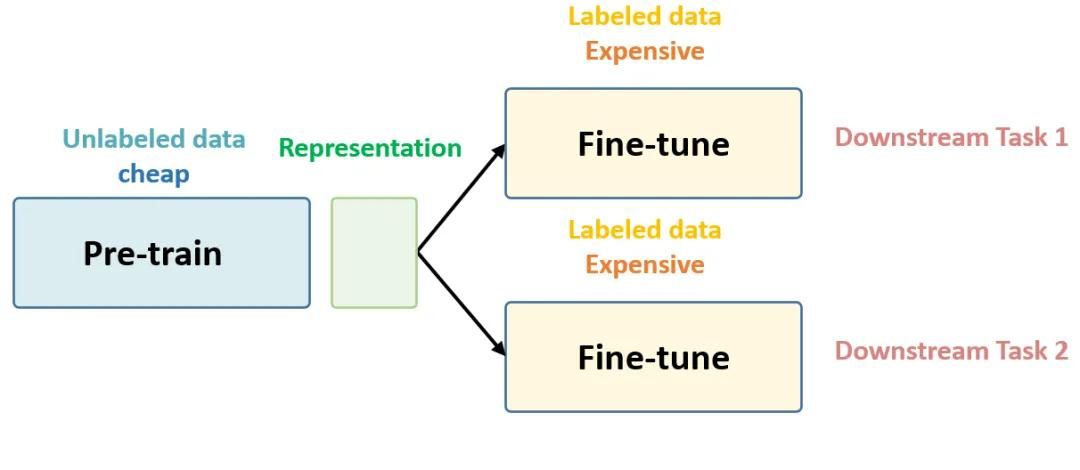

半監(jiān)督學(xué)習(xí)大致上指在訓(xùn)練中同時使用標注過的(監(jiān)督)和未標注過的(無監(jiān)督)樣本,這是一個比較老的概念了。它的核心思想意義很大:在典型的監(jiān)督設(shè)定下,我們有大量沒有使用的數(shù)據(jù)。例如,在房價(標注)數(shù)據(jù)上的線性回歸。我們都明白線性回歸可以生成房價,但大多數(shù)房子沒有出售,然而我們也許仍然能取得相關(guān)數(shù)據(jù),比如從城市規(guī)劃數(shù)據(jù)中獲取。這些數(shù)據(jù)可以給我們提供更多的信息,例如對比不同區(qū)域,哪里的房子相對而言供不應(yīng)求,哪里大面積的房子更多。不以某種形式利用這些數(shù)據(jù)很蠢,但傳統(tǒng)的算法沒法使用它們。

因此,半監(jiān)督學(xué)習(xí)(SSL)意味著使用不同技術(shù)以某種方式在機器學(xué)習(xí)(ML)模型的訓(xùn)練中添加這些數(shù)據(jù)。這并非微不足道:如果把訓(xùn)練ML想象出創(chuàng)建一棵決策樹,接著通過檢查是否得出正確答案評估決策樹的表現(xiàn)。那么,很不幸,在未標注數(shù)據(jù)上,沒有正確答案(因為在數(shù)據(jù)收集期間房子未曾出售),所以沒法進行學(xué)習(xí),因為ML算法無法連接正確答案(因此無法計算損失)。在這篇文章中,我希望集中討論其中一種稱為對抗生成網(wǎng)絡(luò)的SSL技術(shù)。

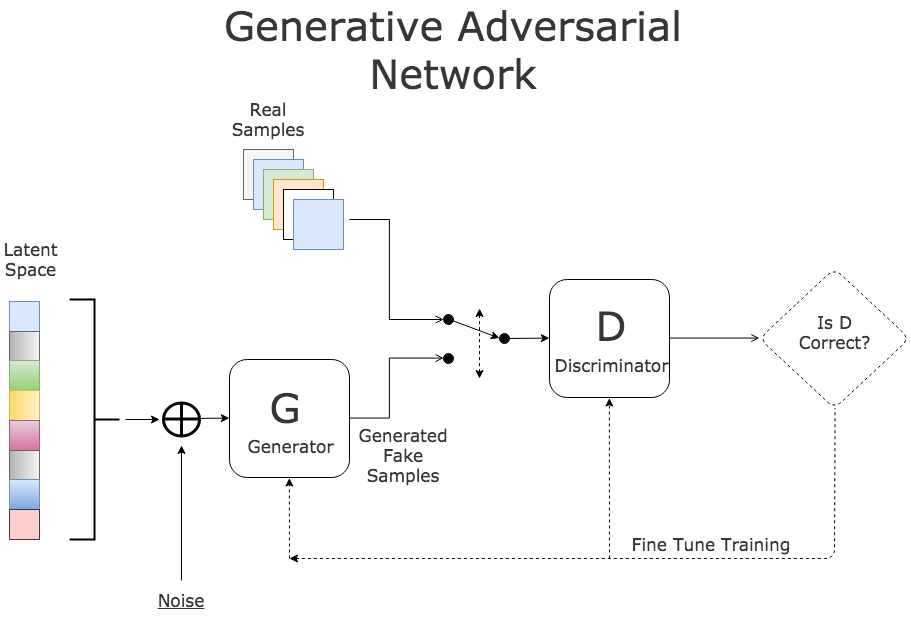

GAN有兩個網(wǎng)絡(luò)組成。第一個網(wǎng)絡(luò)創(chuàng)建世界的內(nèi)在版本(即通常房子是什么樣的):這稱為生成模型(G),基本上它基于一切數(shù)據(jù)學(xué)習(xí),因為它不需要標簽,只需要數(shù)據(jù)集中典型房屋的所有特征。第二個網(wǎng)絡(luò),稱為判別器(D),和G對抗,同時從真實數(shù)據(jù)集和生成器生成的房屋樣本中取樣,決定數(shù)據(jù)看起來是不是真的。

換句話說,想象我們正在嘗試標注貓或狗,在這一情形下,G將學(xué)習(xí)如何生成圖像,并逐漸使生成的圖像越來越像貓或狗。

接著,我們大致上讓G和D互相競爭,以產(chǎn)生最好的結(jié)果:我們希望每次G變得更好時,D也能變得更好,相互匹配(我們需要確保G或D沒有勝出對方太多)。這也正是驅(qū)動AlphaGo的核心原則之一。基本上,我們讓G生成圖像,讓D對此加以評判。所以G會傳遞一組圖像給D,而D會輸出0或1(代表真假)并傳回G。接著G會根據(jù)哪些圖像騙過了D、哪些沒騙過而努力生成更好的樣本。

來源:KDNuggets.com

所以我希望你明白了上面的過程,我們可以基于大量未標注數(shù)據(jù)構(gòu)建一個生成器,并讓它學(xué)習(xí)數(shù)據(jù)的某些結(jié)構(gòu)(即,典型樣本看起來是什么樣的),接著讓它在競爭中使生成數(shù)據(jù)盡可能接近真實數(shù)據(jù)。經(jīng)過這一過程,我們可能得到一些看起來相當(dāng)不錯的合成數(shù)據(jù),這些合成數(shù)據(jù)的數(shù)量幾乎是無限的。另外,我想指出(省略大量說明):生成器只能生成和之前見過的數(shù)據(jù)相似的數(shù)據(jù)。人們很容易忘記這點,沒有魔法。

請會拉丁語的同學(xué)諒解 ;-)

從最高層的抽象看,這一切大概是這樣的:

# 獲取數(shù)據(jù)

real_data = pd.read('real_data.csv') # 形狀 (n樣本, n特征加標簽)

unlabelled_data = pd.read('unlabelled_data.csv') # 形狀 (n樣本, n特征)

# 創(chuàng)建兩個對象

generator = GeneratorClass()

discriminator = DiscriminatorClass()

# 預(yù)訓(xùn)練生成器

generator.train(unlabelled_data)

# 獲取合成數(shù)據(jù)

synthetic_data = make_compete(generator, discriminator, real_data)

# 形狀 (任意數(shù)量, n特征)

好吧,細心的讀者可能會注意到我們沒有描述如何標記生成樣本。理想情況下,我們想要生成標注數(shù)據(jù)(例如,附帶價格的房屋,或者附帶物體描述的圖像)。感謝大量的訓(xùn)練實例,我們有辦法做到這點。如果你回頭看看之前的示意圖,你會看到其中提到了稱為“潛空間”的東西。潛空間是一種控制生成什么樣的圖像的方法。如果我們訓(xùn)練貓狗生成器,其中一個維度將控制圖像有多像貓/狗。它也允許我們獲取兩者之間的中間值,所以我們可以得到狗貓或者七分貓三分狗。換句話說,潛空間可以看成某種種子因素——為G提供一些初始輸入免得它總是生成一樣的東西,但是事實上這一種子因素具備一致的潛(“隱藏”)性質(zhì),特定的維度對應(yīng)某種意義的。

簡單修改上面的偽代碼,以清楚地表明這一點:

# 形狀 (任意數(shù)量, n特征)

synthetic_cats = make_compete(generator, discriminator,

real_data, input_noise=latent_feature_space.cat)

# 形狀 (任意數(shù)量, n特征)

synthetic_dogs = make_compete(generator, discriminator,

real_data, input_noise=latent_feature_space.dog)

最棒的地方在于,理論上,我們甚至不需要有為當(dāng)前任務(wù)標注的數(shù)據(jù)就可以生成相應(yīng)樣本(不過有標注數(shù)據(jù)會有很大幫助)。例如,我們可能有打上了好孩子和壞孩子的數(shù)據(jù),然后我們可以訓(xùn)練G生成貓或狗的新樣本(根據(jù)潛空間的一個參數(shù)決定是貓是狗),其中既有好孩子,也有壞孩子(基于潛空間的另一個參數(shù)決定)。比方說,我們可以基于圖像判斷狗的好壞(例如,如果我們看到狗破壞財物就標記為壞孩子,否則就標記為好孩子)。那么我們就可以在潛空間中發(fā)現(xiàn)對應(yīng)這些特征的參數(shù),然后通過插值生成貓狗或者狗貓。

再舉一個例子,我們可以下載大量未標注的名人面部圖像,然后讓G生成面部,并通過操作潛空間得到明確的雄性樣本或雌性樣本,接著據(jù)此訓(xùn)練另一個識別雄性或雌性圖像的分類器(無需標注過的數(shù)據(jù)!)這正是我曾經(jīng)做過的項目。你可能想要知道“我們?nèi)绾蔚玫讲煌瑢傩缘臐摽臻g表示?”很不幸,這個問題的答案超出了本文的范圍。

唷,時候不早了:我希望給出一些可以實際運行的代碼,這樣讀者可以自行試驗。不過,我覺得這篇博客文章已經(jīng)夠長了,所以,對實際代碼感興趣的讀者,請訪問我的另一篇博客文章:http://jakublangr.com/gans-code.html

想要加入對話?歡迎在jakublangr.com上評論,或者發(fā)推給我(langrjakub)。我正在撰寫一本關(guān)于對抗生成網(wǎng)絡(luò)的書,這里有一些樣章:www.manning.com/books/gans-in-action

-

圖像

+關(guān)注

關(guān)注

2文章

1096瀏覽量

42329 -

GaN

+關(guān)注

關(guān)注

21文章

2366瀏覽量

82328 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5599瀏覽量

124398

原文標題:半監(jiān)督學(xué)習(xí)背景下的對抗生成網(wǎng)絡(luò)

文章出處:【微信號:jqr_AI,微信公眾號:論智】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

使用MATLAB進行無監(jiān)督學(xué)習(xí)

基于半監(jiān)督學(xué)習(xí)的跌倒檢測系統(tǒng)設(shè)計_李仲年

基于半監(jiān)督學(xué)習(xí)框架的識別算法

如何用Python進行無監(jiān)督學(xué)習(xí)

谷歌:半監(jiān)督學(xué)習(xí)其實正在悄然的進化

聚焦 | 新技術(shù)“紅”不過十年?半監(jiān)督學(xué)習(xí)卻成例外?

機器學(xué)習(xí)算法中有監(jiān)督和無監(jiān)督學(xué)習(xí)的區(qū)別

最基礎(chǔ)的半監(jiān)督學(xué)習(xí)

半監(jiān)督學(xué)習(xí)最基礎(chǔ)的3個概念

為什么半監(jiān)督學(xué)習(xí)是機器學(xué)習(xí)的未來?

半監(jiān)督學(xué)習(xí):比監(jiān)督學(xué)習(xí)做的更好

機器學(xué)習(xí)中的無監(jiān)督學(xué)習(xí)應(yīng)用在哪些領(lǐng)域

GAN原理及其在半監(jiān)督學(xué)習(xí)中的意義

GAN原理及其在半監(jiān)督學(xué)習(xí)中的意義

評論