在電能質量在線監測裝置的數據管理平臺(以下簡稱 “平臺”)中,壓力測試的核心目標是驗證平臺在高負載(如海量數據接入、高并發查詢、峰值業務流量)下的穩定性、性能瓶頸及容錯能力,確保其滿足實際運行中的實時性、可靠性要求。由于平臺需處理 “實時數據采集 - 存儲 - 分析 - 展示” 全鏈路業務,壓力測試需結合其業務特性設計,具體實施步驟可分為以下 5 個階段:

一、階段 1:明確測試目標與范圍(避免無目的測試)

首先需錨定測試核心訴求,避免覆蓋無關場景導致資源浪費。需結合平臺的設計指標(如廠商給出的 “支持 10 萬點監測裝置接入”“并發查詢響應時間≤1s”),明確以下內容:

1. 核心測試目標

性能指標驗證:如 “單節點每秒最大數據寫入量(TPS)”“1000 并發用戶查詢歷史數據的平均響應時間”“24 小時高負載下內存 / CPU 使用率峰值”。

穩定性驗證:高負載持續運行(如 24/72 小時)時,是否出現內存泄漏、連接池耗盡、數據丟失 / 錯亂等問題。

瓶頸定位:定位全鏈路中的性能短板(如 “數據接收模塊吞吐量不足”“數據庫寫入瓶頸”“前端渲染卡頓”)。

容錯能力驗證:高負載下模擬故障(如某采集節點斷連、數據庫主從切換),驗證平臺是否能降級運行、快速恢復。

2. 測試范圍界定

需聚焦平臺核心業務鏈路,避免冗余測試,重點覆蓋:

數據接入層:驗證平臺接收監測裝置數據(如通過 IEC 61850、Modbus 協議)的最大并發能力。

數據存儲層:驗證數據庫(如時序數據庫 InfluxDB、TimescaleDB,或關系庫 MySQL)在高寫入 / 查詢負載下的性能。

數據處理層:驗證實時分析模塊(如諧波計算、電壓暫降識別)在海量數據下的處理延遲。

應用服務層:驗證 API 接口(如用戶查詢、報表生成)的高并發承載能力。

前端展示層:驗證多用戶同時查看實時監控畫面、導出報表時的頁面響應速度。

二、階段 2:準備測試環境與資源(模擬真實生產場景)

壓力測試的有效性依賴于環境與數據的真實性,需盡量復刻生產環境的硬件、網絡、數據特征,避免因環境差異導致測試結果失真。

1. 搭建 “等效生產環境”

需保持測試環境與生產環境的核心配置一致,關鍵參數如下表:

| 環境層級 | 配置要求 |

|---|---|

| 硬件服務器 | 與生產一致的 CPU 核數(如 32 核)、內存(如 128GB)、硬盤類型(如 SSD/HDD)、網卡帶寬(如 10Gbps)。 |

| 軟件棧 | 操作系統(如 CentOS 7)、數據庫版本(如 InfluxDB 2.7)、中間件(如 Kafka 3.0,用于數據緩存)、Web 服務器(如 Nginx)。 |

| 網絡環境 | 模擬生產中的網絡延遲(如監測裝置與平臺的跨區域通信延遲≤50ms)、帶寬限制(如單節點上行帶寬 100Mbps),可通過工具(如tc命令)模擬網絡丟包(如 0.1%)。 |

2. 準備 “真實測試數據”

電能質量數據具有 “時序性、周期性、突發性” 特征(如用電高峰數據量激增、偶發電壓暫降事件),測試數據需滿足以下要求:

數據格式匹配:生成與監測裝置一致的數據包(如包含電壓、電流、諧波次數、事件類型等字段),遵循平臺協議(如 IEC 61850 MMS 報文)。

數據量與分布:

基礎數據:生成 “正常負載” 數據(如每秒 1000 條監測數據),用于基準測試;

峰值數據:模擬用電高峰(如夏季用電期)的突發流量(如每秒 5000 條數據);

異常數據:包含電能質量事件(如電壓暫升 / 暫降、諧波超標),測試平臺在混合數據下的處理能力。

數據來源:可通過 “歷史生產數據脫敏復用” 或 “工具生成仿真數據”(如用 Python 腳本按協議格式生成批量數據)。

3. 選擇適配的測試工具

需根據平臺技術棧選擇支持 “時序數據、實時協議、分布式負載” 的工具,常用工具組合如下:

| 測試場景 | 推薦工具 | 核心用途 |

|---|---|---|

| 數據接入層(協議模擬) | JMeter(配 IEC 61850 插件)、PacketStorm | 模擬 thousands 級監測裝置同時向平臺發送協議數據,測試接入層吞吐量。 |

| 數據庫壓力測試 | TSBS(Time Series Benchmark Suite)、pgBench(針對 PostgreSQL) | 專門用于時序數據庫的高寫入 / 查詢測試,生成符合時序特征的負載。 |

| 應用層并發測試 | Gatling、LoadRunner | 模擬高并發用戶調用 API 接口(如查詢歷史數據、生成報表),統計響應時間、成功率。 |

| 全鏈路監控 | Prometheus+Grafana、nmon、Wireshark | 實時監控 CPU、內存、磁盤 IO、網絡帶寬、數據庫連接數、接口響應時間等指標。 |

三、階段 3:設計針對性測試場景(覆蓋核心高負載場景)

平臺的負載特征與 “電能質量監測業務” 強相關,需設計貼近實際運行的場景,避免通用場景的無效測試。以下為核心測試場景設計:

1. 場景 1:數據接入峰值測試(驗證 “入口” 承載能力)

場景描述:模擬用電高峰時段,大量監測裝置(如 1 萬 / 10 萬臺)同時向平臺推送實時數據,測試接入層的最大吞吐量。

測試步驟:

從 “1000 臺裝置” 開始,按每 5 分鐘增加 1000 臺的梯度加壓,記錄每級負載下的 “數據接收成功率”“接入延遲”;

當 “接收成功率<99.9%” 或 “延遲>100ms” 時,停止加壓,確定接入層最大承載量;

持續該峰值負載 1 小時,觀察是否出現 “連接超時”“數據丟棄”。

核心監控指標:接入層 TPS(每秒處理數據量)、TCP 連接數、網絡丟包率、數據丟棄數。

2. 場景 2:數據存儲壓力測試(驗證 “持久化” 能力)

場景描述:平臺需將海量實時數據寫入數據庫(時序庫為主),同時支撐歷史數據查詢,需測試存儲層的寫入與查詢性能。

測試步驟:

寫入測試:以 “接入層最大 TPS” 持續向數據庫寫入數據 24 小時,監控數據庫 “寫入延遲”“磁盤 IO 利用率”“索引構建耗時”;

查詢測試:在寫入高負載的同時,模擬 100/500/1000 并發用戶執行 “多維度查詢”(如 “查詢某區域 3 天內的電壓暫降事件”“統計某裝置的諧波平均值”),記錄查詢響應時間、SQL 執行效率;

邊界測試:模擬 “單表數據量達 1 億條” 時的查詢性能,驗證數據庫分區、索引優化是否生效。

核心監控指標:數據庫 TPS(寫入)、查詢響應時間(P95/P99 值)、磁盤使用率、鎖等待次數。

3. 場景 3:應用層高并發測試(驗證 “業務處理” 能力)

場景描述:模擬多用戶同時操作平臺核心功能(如登錄、實時監控、報表導出、事件告警),測試應用服務的并發承載能力。

測試步驟:

模擬 “500 并發用戶登錄”,記錄登錄響應時間、會話創建成功率;

保持登錄狀態,模擬 “300 用戶同時查看實時監測畫面”“200 用戶同時導出月度電能質量報表”,監控前端頁面加載時間、后端 API 成功率;

加壓至 “API 成功率<99.5%” 或 “響應時間>3s”,定位瓶頸(如是否為后端計算邏輯耗時、前端渲染卡頓)。

核心監控指標:API 響應時間(P95)、API 成功率、應用服務器 CPU / 內存使用率、前端頁面加載時間。

4. 場景 4:穩定性與故障注入測試(驗證 “容錯” 能力)

場景描述:在高負載下模擬 “硬件故障”“網絡中斷”“服務異常”,驗證平臺是否能穩定運行或快速恢復,避免單點故障導致整體崩潰。

測試步驟:

穩定性測試:在 “80% 最大負載” 下持續運行 72 小時,監控是否出現 “內存泄漏”(如內存使用率持續上升不下降)、“連接池耗盡”(如數據庫連接數達上限);

故障注入:

模擬 “某采集節點斷連 10 分鐘后恢復”,驗證平臺是否能自動重連、補傳斷連期間的數據;

模擬 “數據庫主從切換”,驗證切換過程中數據寫入 / 查詢是否中斷;

模擬 “應用服務器宕機 1 臺”(若為集群部署),驗證負載均衡是否自動將流量分配到其他節點。

核心監控指標:服務恢復時間、數據補傳成功率、故障期間業務中斷時長。

四、階段 4:執行測試與數據采集(確保數據可追溯)

執行過程需遵循 “梯度加壓、持續監控、數據留痕” 原則,避免一次性滿負載導致平臺直接崩潰,無法定位瓶頸。

1. 執行流程

基準測試:先在 “低負載”(如設計負載的 20%)下運行,獲取基準指標(如響應時間、資源使用率),作為后續對比依據;

梯度加壓:按 “20%→40%→60%→80%→100%→120%” 的設計負載梯度加壓,每級負載穩定運行 10-30 分鐘(確保數據穩定),再進入下一級;

異常記錄:若某級負載出現 “響應時間突增”“成功率下降”“報錯日志增多”,立即暫停加壓,記錄當前負載、異常現象(如 “500 并發時,報表導出 API 響應時間從 1s 增至 10s”);

故障注入觸發:在 “80% 負載” 穩定后,執行故障注入場景,記錄故障發生 - 恢復的全鏈路數據。

2. 關鍵數據采集

需通過監控工具采集 “全鏈路指標”,避免僅關注單一環節導致瓶頸遺漏,核心采集項如下:

基礎設施層:服務器 CPU 使用率(單核心 / 整體)、內存使用率、Swap 分區使用率、磁盤 IOPS / 吞吐量、網絡帶寬(流入 / 流出)、網絡丟包率;

中間件 / 數據庫層:Kafka 隊列堆積量、數據庫連接數、數據庫寫入延遲、索引查詢耗時、緩存命中率(如 Redis);

應用服務層:API 響應時間(P50/P95/P99)、API 失敗率、線程池活躍數、請求排隊數;

業務層:實時數據處理延遲(從采集到展示的耗時)、報表生成耗時、數據丟失率。

五、階段 5:分析瓶頸與優化回歸(形成閉環)

測試的最終目的是解決問題,需通過數據定位瓶頸,并驗證優化效果,形成 “測試 - 分析 - 優化 - 回歸” 的閉環。

1. 瓶頸定位方法

指標關聯分析:若 “API 響應時間長” 且 “數據庫查詢耗時高”,則瓶頸在數據庫;若 “數據接入延遲高” 且 “網絡丟包率達 5%”,則瓶頸在網絡;

日志分析:查看應用日志(如 Java 的 GC 日志)、數據庫日志(如慢查詢日志),定位具體問題(如 “GC 頻繁導致 CPU 飆升”“某 SQL 未走索引導致查詢慢”);

工具輔助:用jstack分析 Java 線程死鎖,用perf分析 CPU 熱點函數,用數據庫慢查詢工具(如 MySQL 的 Slow Query Log)定位低效 SQL。

2. 常見瓶頸與優化方案

| 瓶頸類型 | 典型問題 | 優化方案 |

|---|---|---|

| 數據接入層 | 網絡帶寬不足、協議解析效率低 | 升級網絡帶寬、優化協議解析代碼(如用 C++ 替代 Java)、增加接入節點集群化部署 |

| 數據庫層 | 寫入吞吐量低、查詢慢 | 時序數據庫分庫分表、增加索引、開啟緩存(如 Redis)、優化 SQL 語句 |

| 應用服務層 | 線程池耗盡、GC 頻繁、計算邏輯耗時 | 調整線程池參數、優化代碼減少對象創建(降低 GC)、復雜計算異步化 / 分布式處理 |

| 前端層 | 頁面渲染慢、請求過多 | 前端資源壓縮(JS/CSS)、懶加載、接口合并(減少請求數)、使用 CDN 加速 |

3. 回歸測試

優化后需重新執行相同的壓力測試場景,驗證:

原瓶頸是否解決(如 “數據庫查詢耗時從 500ms 降至 50ms”);

優化是否引入新問題(如 “增加緩存后是否出現數據一致性問題”);

整體性能是否達標(如 “1000 并發下 API 響應時間≤1s”)。

關鍵注意事項(針對電能質量平臺特性)

時序數據特殊性:時序數據庫(如 InfluxDB)的性能優化需符合其特性(如按時間分區),避免用關系庫的優化思路套用;

實時性要求:電能質量監測需 “實時告警”,測試時需重點關注 “數據處理延遲”,確保≤設計閾值(如 500ms);

數據安全性:壓力測試中若使用真實脫敏數據,需確保數據不泄露,測試環境與生產環境物理隔離;

集群兼容性:若平臺為集群部署,需測試 “負載均衡有效性”“節點故障后的容災能力”,避免集群淪為 “單點”。

通過以上步驟,可全面驗證數據管理平臺在高負載下的穩定性,確保其在電能質量監測的實際應用中,能應對海量數據、高并發業務的挑戰,保障數據不丟失、服務不中斷。

審核編輯 黃宇

-

數據管理

+關注

關注

1文章

343瀏覽量

20614

發布評論請先 登錄

AI HOME智能體:當存儲遇上智能體,開啟數據管理新紀元?

電能質量在線監測裝置的暫態事件臺賬存儲容量有限,如何進行數據管理?

FLIR Assetlink數據管理平臺開啟工業檢測新體驗

怎樣確保數據管理平臺的軟件系統穩定性?

如何確保電能質量在線監測裝置的數據管理平臺的硬件冗余設計有效?

電能質量在線監測裝置的數據管理平臺應該具備哪些功能?

電能質量在線監測裝置的數據管理需要哪些技術支持?

簡形電力|從本地到云端:變壓器測試數據管理的智能化升級方案

PLC物聯網平臺是什么?有什么功能?

智慧環保大數據管理平臺有什么功能

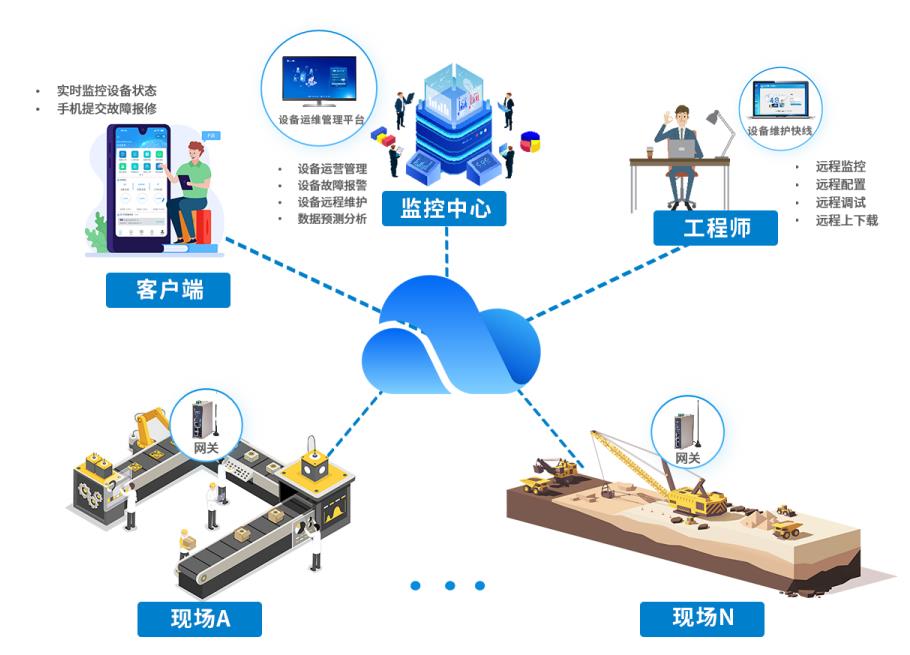

工業設備運行數據采集管理平臺是什么

可視化組態數據管理平臺是什么

污染源自動監測數據管理系統物聯網解決方案

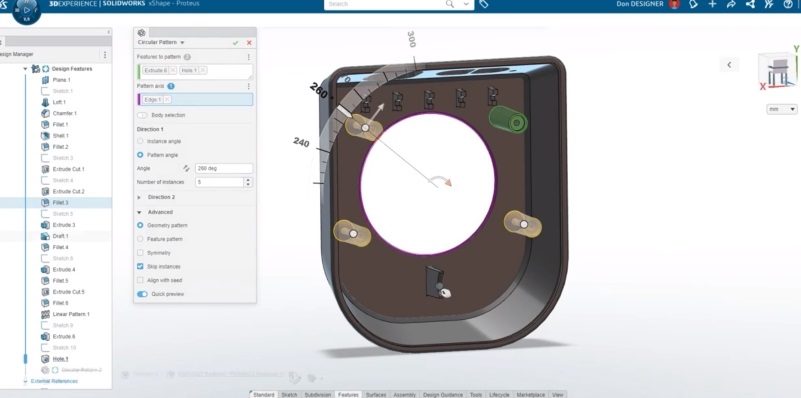

SOLIDWORKS 2025教育版有效的數據管理與團隊協作

怎樣進行數據管理平臺的壓力測試?

怎樣進行數據管理平臺的壓力測試?

評論