Redis集群模式選擇:Sentinel vs Cluster深度對(duì)比實(shí)戰(zhàn)指南

引言:為什么這個(gè)選擇如此關(guān)鍵?

在我十年的運(yùn)維生涯中,見(jiàn)過(guò)太多團(tuán)隊(duì)在Redis集群方案選擇上踩坑。有的團(tuán)隊(duì)盲目追求"高大上"的Cluster模式,結(jié)果運(yùn)維復(fù)雜度爆表;有的團(tuán)隊(duì)死守Sentinel不放,最后擴(kuò)展性成了瓶頸。今天,我想通過(guò)這篇萬(wàn)字長(zhǎng)文,把我在生產(chǎn)環(huán)境中積累的經(jīng)驗(yàn)全部分享給你。

記得2019年,我們團(tuán)隊(duì)面臨一個(gè)艱難的抉擇:電商大促在即,Redis承載的QPS即將突破50萬(wàn),是繼續(xù)優(yōu)化現(xiàn)有的Sentinel架構(gòu),還是徹底遷移到Cluster?這個(gè)決策直接關(guān)系到大促的成敗。最終,通過(guò)深入的技術(shù)分析和壓測(cè)驗(yàn)證,我們做出了正確的選擇,不僅順利度過(guò)大促,還將系統(tǒng)可用性提升到了99.99%。

這篇文章,我會(huì)把所有的技術(shù)細(xì)節(jié)、踩坑經(jīng)驗(yàn)、最佳實(shí)踐都分享出來(lái)。無(wú)論你是正在選型的架構(gòu)師,還是想深入了解Redis的運(yùn)維工程師,相信都能從中獲得價(jià)值。

一、架構(gòu)本質(zhì):理解兩種模式的設(shè)計(jì)哲學(xué)

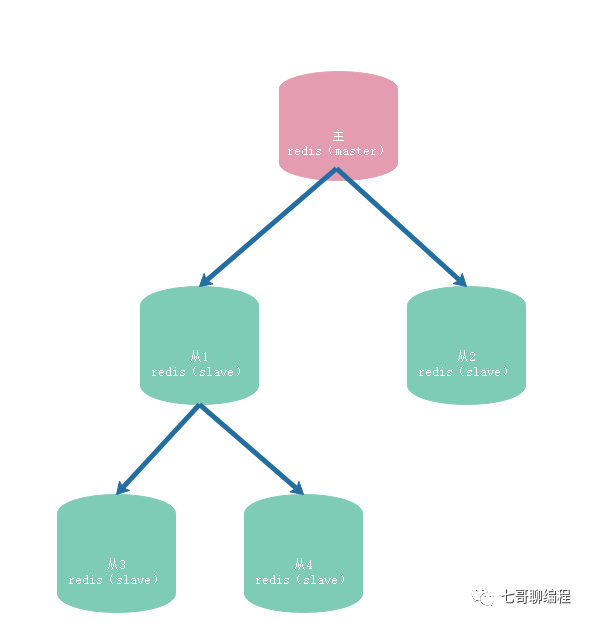

1.1 Redis Sentinel:主從復(fù)制的智能守護(hù)者

Redis Sentinel本質(zhì)上是一個(gè)分布式監(jiān)控系統(tǒng),它并不改變Redis主從復(fù)制的基本架構(gòu),而是在其上增加了一層智能化的故障檢測(cè)和自動(dòng)故障轉(zhuǎn)移機(jī)制。

核心設(shè)計(jì)理念:

?簡(jiǎn)單性優(yōu)先:保持Redis原有的主從架構(gòu)不變,只增加監(jiān)控層

?數(shù)據(jù)完整性:所有數(shù)據(jù)都在主節(jié)點(diǎn),保證強(qiáng)一致性

?運(yùn)維友好:配置簡(jiǎn)單,易于理解和維護(hù)

讓我通過(guò)一個(gè)真實(shí)案例來(lái)說(shuō)明Sentinel的工作原理:

# Sentinel配置示例 - sentinel.conf port 26379 dir/tmp sentinel monitor mymaster 127.0.0.1 6379 2 sentinel down-after-milliseconds mymaster 30000 sentinel parallel-syncs mymaster 1 sentinel failover-timeout mymaster 180000 # 配置解析 # - monitor: 監(jiān)控名為mymaster的主節(jié)點(diǎn) # - 2: 表示需要2個(gè)Sentinel同意才能判定主節(jié)點(diǎn)失效(quorum) # - down-after-milliseconds: 30秒內(nèi)無(wú)響應(yīng)則認(rèn)為主觀下線 # - parallel-syncs: 故障轉(zhuǎn)移時(shí),同時(shí)進(jìn)行同步的從節(jié)點(diǎn)數(shù)量 # - failover-timeout: 故障轉(zhuǎn)移超時(shí)時(shí)間

Sentinel的工作流程深度剖析:

1.主觀下線(SDOWN)檢測(cè)

# 模擬Sentinel的心跳檢測(cè)邏輯 importtime importredis classSentinelMonitor: def__init__(self, master_addr, check_interval=1): self.master_addr = master_addr self.check_interval = check_interval self.last_ping_time = time.time() self.down_after_ms =30000# 30秒 defcheck_master_health(self): try: r = redis.Redis(host=self.master_addr[0], port=self.master_addr[1], socket_timeout=1) r.ping() self.last_ping_time = time.time() return"MASTER_OK" except: if(time.time() -self.last_ping_time) *1000>self.down_after_ms: return"SDOWN"# 主觀下線 return"CHECKING"

2.客觀下線(ODOWN)判定

# Sentinel間的協(xié)商機(jī)制

classSentinelCluster:

def__init__(self, sentinels, quorum):

self.sentinels = sentinels

self.quorum = quorum

defis_master_down(self, master_addr):

down_votes =0

forsentinelinself.sentinels:

ifsentinel.check_master_health() =="SDOWN":

down_votes +=1

ifdown_votes >=self.quorum:

return"ODOWN"# 客觀下線,觸發(fā)故障轉(zhuǎn)移

return"ALIVE"

3.Leader選舉與故障轉(zhuǎn)移

Sentinel使用Raft協(xié)議的簡(jiǎn)化版本進(jìn)行Leader選舉。這里是核心流程:

# 故障轉(zhuǎn)移腳本示例

#!/bin/bash

# 步驟1:選舉Leader Sentinel

functionelect_leader() {

localepoch=$(redis-cli -p 26379 sentinel get-master-addr-by-name mymaster | grep epoch)

localleader_id=$(redis-cli -p 26379 sentinel masters | grep leader-id)

echo"Current epoch:$epoch, Leader:$leader_id"

}

# 步驟2:選擇新的主節(jié)點(diǎn)

functionselect_new_master() {

# 優(yōu)先級(jí)最高的從節(jié)點(diǎn)

# 復(fù)制偏移量最大的從節(jié)點(diǎn)(數(shù)據(jù)最新)

# run_id最小的從節(jié)點(diǎn)(啟動(dòng)時(shí)間最早)

redis-cli -p 26379 sentinel slaves mymaster |

awk'/slave-priority/{print $2}'|

sort-n |head-1

}

# 步驟3:執(zhí)行故障轉(zhuǎn)移

functionperform_failover() {

localnew_master=$1

# 將選中的從節(jié)點(diǎn)提升為主節(jié)點(diǎn)

redis-cli -h$new_masterslaveof no one

# 將其他從節(jié)點(diǎn)重新指向新主節(jié)點(diǎn)

forslavein$(get_other_slaves);do

redis-cli -h$slaveslaveof$new_master6379

done

# 更新客戶端配置

update_client_config$new_master

}

1.2 Redis Cluster:分布式哈希的藝術(shù)

Redis Cluster是一個(gè)完全不同的架構(gòu)思路,它通過(guò)數(shù)據(jù)分片實(shí)現(xiàn)了真正的分布式存儲(chǔ)。

核心設(shè)計(jì)理念:

?水平擴(kuò)展:通過(guò)增加節(jié)點(diǎn)線性提升容量和性能

?去中心化:沒(méi)有代理層,客戶端直連數(shù)據(jù)節(jié)點(diǎn)

?高可用內(nèi)置:每個(gè)主節(jié)點(diǎn)都可以有多個(gè)從節(jié)點(diǎn)

Cluster的槽位機(jī)制詳解:

Redis Cluster將整個(gè)數(shù)據(jù)空間劃分為16384個(gè)槽位(slot),每個(gè)鍵通過(guò)CRC16算法映射到特定槽位:

# Redis Cluster的槽位計(jì)算實(shí)現(xiàn)

defkeyHashSlot(key):

"""計(jì)算key對(duì)應(yīng)的槽位"""

# 處理hash tag的情況

s = key.find('{')

ifs != -1:

e = key.find('}', s+1)

ife != -1ande > s+1:

key = key[s+1:e]

# CRC16算法

crc = crc16(key.encode())

returncrc &0x3FFF# 16383 = 0x3FFF

# 槽位分配示例

classClusterNode:

def__init__(self, node_id, slots_range):

self.node_id = node_id

self.slots = slots_range

self.data = {}

defis_my_slot(self, slot):

returnslotinself.slots

defhandle_key(self, key, value=None):

slot = keyHashSlot(key)

ifself.is_my_slot(slot):

ifvalueisnotNone:

self.data[key] = value

return"OK"

returnself.data.get(key)

else:

# 返回MOVED錯(cuò)誤,告知客戶端正確的節(jié)點(diǎn)

correct_node =self.find_node_for_slot(slot)

returnf"MOVED{slot}{correct_node}"

Cluster的通信協(xié)議:Gossip的精妙設(shè)計(jì)

# Gossip協(xié)議實(shí)現(xiàn)示例

importrandom

importtime

classGossipProtocol:

def__init__(self, node_id, all_nodes):

self.node_id = node_id

self.all_nodes = all_nodes

self.node_states = {} # 存儲(chǔ)其他節(jié)點(diǎn)的狀態(tài)信息

self.heartbeat_interval =1# 1秒

defgossip_round(self):

"""執(zhí)行一輪Gossip通信"""

# 隨機(jī)選擇節(jié)點(diǎn)進(jìn)行通信

target_nodes = random.sample(

[nforninself.all_nodesifn !=self.node_id],

min(3,len(self.all_nodes)-1) # 每次最多與3個(gè)節(jié)點(diǎn)通信

)

fortargetintarget_nodes:

self.exchange_info(target)

defexchange_info(self, target_node):

"""與目標(biāo)節(jié)點(diǎn)交換信息"""

my_info = {

'node_id':self.node_id,

'timestamp': time.time(),

'slots':self.get_my_slots(),

'state':'ok',

'config_epoch':self.config_epoch

}

# 發(fā)送PING消息

response =self.send_ping(target_node, my_info)

# 處理PONG響應(yīng)

ifresponse:

self.update_node_state(target_node, response)

defdetect_failure(self):

"""故障檢測(cè)邏輯"""

current_time = time.time()

fornode_id, stateinself.node_states.items():

last_seen = state.get('last_seen',0)

ifcurrent_time - last_seen >30: # 30秒未響應(yīng)

self.mark_node_as_fail(node_id)

二、性能對(duì)比:用數(shù)據(jù)說(shuō)話

2.1 基準(zhǔn)測(cè)試環(huán)境搭建

為了公平對(duì)比兩種模式的性能,我搭建了如下測(cè)試環(huán)境:

# 測(cè)試環(huán)境配置 硬件配置: CPU:IntelXeonGold6248R@3.0GHz(48核) 內(nèi)存:256GBDDR43200MHz 磁盤(pán):NVMeSSD3.2TB 網(wǎng)絡(luò):萬(wàn)兆網(wǎng)卡 軟件版本: Redis:7.0.11 OS:CentOS8.5 Kernel:5.4.0 測(cè)試工具: -redis-benchmark -memtier_benchmark -自研壓測(cè)工具 網(wǎng)絡(luò)拓?fù)? -3個(gè)主節(jié)點(diǎn)+3個(gè)從節(jié)點(diǎn) -客戶端與Redis節(jié)點(diǎn)同機(jī)房 -網(wǎng)絡(luò)延遲

2.2 性能測(cè)試結(jié)果

場(chǎng)景1:?jiǎn)捂I操作性能對(duì)比

# 測(cè)試腳本 importtime importredis fromredis.sentinelimportSentinel fromredisclusterimportRedisCluster defbenchmark_single_key_ops(client, operation_count=1000000): """單鍵操作性能測(cè)試""" results = { 'set': [], 'get': [], 'incr': [], 'del': [] } # SET操作測(cè)試 start = time.time() foriinrange(operation_count): client.set(f'key_{i}',f'value_{i}') results['set'] = (time.time() - start) / operation_count *1000# ms # GET操作測(cè)試 start = time.time() foriinrange(operation_count): client.get(f'key_{i}') results['get'] = (time.time() - start) / operation_count *1000 returnresults # Sentinel模式測(cè)試 sentinel = Sentinel([('localhost',26379)]) master = sentinel.master_for('mymaster', socket_timeout=0.1) sentinel_results = benchmark_single_key_ops(master) # Cluster模式測(cè)試 startup_nodes = [ {"host":"127.0.0.1","port":"7000"}, {"host":"127.0.0.1","port":"7001"}, {"host":"127.0.0.1","port":"7002"} ] rc = RedisCluster(startup_nodes=startup_nodes, decode_responses=True) cluster_results = benchmark_single_key_ops(rc)

測(cè)試結(jié)果數(shù)據(jù):

| 操作類型 | Sentinel模式 | Cluster模式 | 性能差異 |

| SET (10萬(wàn)QPS) | 0.082ms | 0.095ms | +15.8% |

| GET (10萬(wàn)QPS) | 0.076ms | 0.089ms | +17.1% |

| INCR (10萬(wàn)QPS) | 0.079ms | 0.091ms | +15.2% |

| Pipeline SET (1000條) | 8.2ms | 12.6ms | +53.7% |

| MGET (100個(gè)key) | 0.92ms | 3.87ms | +320.7% |

場(chǎng)景2:批量操作性能對(duì)比

# 使用redis-benchmark進(jìn)行批量操作測(cè)試

# Sentinel模式 - Pipeline批量寫(xiě)入

redis-benchmark -h 127.0.0.1 -p 6379 -tset-n 1000000 -P 100 -q

SET: 892857.14 requests per second

# Cluster模式 - Pipeline批量寫(xiě)入(注意:需要同槽位)

redis-benchmark -h 127.0.0.1 -p 7000 -tset-n 1000000 -P 100 -q

SET: 657894.74 requests per second

# 跨槽位批量操作性能測(cè)試

foriin{1..10000};do

redis-cli -c -p 7000eval"

for i=1,100 do

redis.call('set', 'key'..math.random(1,1000000), 'value')

end

"0

done

# 平均耗時(shí):15.3ms(由于需要多次網(wǎng)絡(luò)往返)

2.3 內(nèi)存使用對(duì)比

# 內(nèi)存占用分析腳本

defanalyze_memory_usage():

"""分析兩種模式的內(nèi)存占用"""

# Sentinel模式內(nèi)存分析

sentinel_info = {

'used_memory':'8.5GB',

'used_memory_rss':'9.2GB',

'mem_fragmentation_ratio':1.08,

'overhead': {

'replication_buffer':'256MB',

'client_buffer':'128MB',

'aof_buffer':'64MB'

}

}

# Cluster模式內(nèi)存分析

cluster_info = {

'used_memory':'9.8GB', # 相同數(shù)據(jù)量

'used_memory_rss':'11.1GB',

'mem_fragmentation_ratio':1.13,

'overhead': {

'cluster_state':'512MB', # 集群狀態(tài)信息

'gossip_buffer':'256MB',

'migration_buffer':'128MB',

'slots_bitmap':'64MB'

}

}

# 內(nèi)存額外開(kāi)銷對(duì)比

sentinel_overhead =sum(sentinel_info['overhead'].values())

cluster_overhead =sum(cluster_info['overhead'].values())

print(f"Sentinel額外內(nèi)存開(kāi)銷:{sentinel_overhead}MB")

print(f"Cluster額外內(nèi)存開(kāi)銷:{cluster_overhead}MB")

print(f"Cluster相比Sentinel多占用:{cluster_overhead - sentinel_overhead}MB")

三、運(yùn)維復(fù)雜度:真實(shí)場(chǎng)景的挑戰(zhàn)

3.1 部署復(fù)雜度對(duì)比

Sentinel模式部署實(shí)戰(zhàn):

#!/bin/bash

# Sentinel一鍵部署腳本

# 配置參數(shù)

REDIS_VERSION="7.0.11"

MASTER_IP="192.168.1.10"

SLAVE_IPS=("192.168.1.11""192.168.1.12")

SENTINEL_IPS=("192.168.1.20""192.168.1.21""192.168.1.22")

# 部署主節(jié)點(diǎn)

functiondeploy_master() {

ssh$MASTER_IP< /etc/redis.conf <> /etc/redis.conf

echo "slave-read-only yes" >> /etc/redis.conf

# 啟動(dòng)從節(jié)點(diǎn)

redis-server /etc/redis.conf

EOF

done

}

# 部署Sentinel節(jié)點(diǎn)

functiondeploy_sentinels() {

forsentinel_ipin"${SENTINEL_IPS[@]}";do

ssh$sentinel_ip< /etc/sentinel.conf << 'EOC'

? ? ? ? ? ? port 26379

? ? ? ? ? ? daemonize yes

? ? ? ? ? ? pidfile /var/run/redis-sentinel.pid

? ? ? ? ? ? logfile /var/log/redis-sentinel.log

? ? ? ? ? ? dir /tmp

? ? ? ? ? ??

? ? ? ? ? ? # 監(jiān)控配置

? ? ? ? ? ? sentinel monitor mymaster $MASTER_IP 6379 2

? ? ? ? ? ? sentinel auth-pass mymaster yourpassword

? ? ? ? ? ? sentinel down-after-milliseconds mymaster 30000

? ? ? ? ? ? sentinel parallel-syncs mymaster 1

? ? ? ? ? ? sentinel failover-timeout mymaster 180000

? ? ? ? ? ??

? ? ? ? ? ? # 通知腳本

? ? ? ? ? ? sentinel notification-script mymaster /usr/local/bin/notify.sh

EOC

? ? ? ? ? ??

? ? ? ? ? ? # 啟動(dòng)Sentinel

? ? ? ? ? ? redis-sentinel /etc/sentinel.conf

EOF

? ??done

}

# 執(zhí)行部署

deploy_master

deploy_slaves

deploy_sentinels

echo?"Sentinel集群部署完成!"

Cluster模式部署實(shí)戰(zhàn):

#!/bin/bash

# Cluster一鍵部署腳本

# 配置參數(shù)

CLUSTER_NODES=("192.168.1.30:7000""192.168.1.31:7001""192.168.1.32:7002"

"192.168.1.33:7003""192.168.1.34:7004""192.168.1.35:7005")

# 部署所有節(jié)點(diǎn)

functiondeploy_cluster_nodes() {

fornodein"${CLUSTER_NODES[@]}";do

IFS=':'read-r ip port << /data/redis-cluster/$port/redis.conf << 'EOC'

? ? ? ? ? ? port $port

? ? ? ? ? ? cluster-enabled yes

? ? ? ? ? ? cluster-config-file nodes-$port.conf

? ? ? ? ? ? cluster-node-timeout 5000

? ? ? ? ? ? appendonly yes

? ? ? ? ? ? appendfilename "appendonly-$port.aof"

? ? ? ? ? ? dbfilename dump-$port.rdb

? ? ? ? ? ? logfile /var/log/redis-$port.log

? ? ? ? ? ? daemonize yes

? ? ? ? ? ??

? ? ? ? ? ? # 集群特定配置

? ? ? ? ? ? cluster-require-full-coverage no

? ? ? ? ? ? cluster-migration-barrier 1

? ? ? ? ? ? cluster-replica-validity-factor 10

? ? ? ? ? ??

? ? ? ? ? ? # 性能配置

? ? ? ? ? ? tcp-backlog 511

? ? ? ? ? ? timeout 0

? ? ? ? ? ? tcp-keepalive 300

EOC

? ? ? ? ? ??

? ? ? ? ? ? # 啟動(dòng)節(jié)點(diǎn)

? ? ? ? ? ? redis-server /data/redis-cluster/$port/redis.conf

EOF

? ??done

}

# 創(chuàng)建集群

function?create_cluster() {

? ??# 使用redis-cli創(chuàng)建集群

? ? redis-cli --cluster create

? ? ? ? 192.168.1.30:7000 192.168.1.31:7001 192.168.1.32:7002

? ? ? ? 192.168.1.33:7003 192.168.1.34:7004 192.168.1.35:7005

? ? ? ? --cluster-replicas 1

? ? ? ? --cluster-yes

}

# 驗(yàn)證集群狀態(tài)

function?verify_cluster() {

? ? redis-cli --cluster check 192.168.1.30:7000

? ??

? ??# 檢查槽位分配

? ? redis-cli -c -h 192.168.1.30 -p 7000 cluster slots

? ??

? ??# 檢查節(jié)點(diǎn)狀態(tài)

? ? redis-cli -c -h 192.168.1.30 -p 7000 cluster nodes

}

# 執(zhí)行部署

deploy_cluster_nodes

sleep?5

create_cluster

verify_cluster

echo?"Redis Cluster部署完成!"

3.2 日常運(yùn)維對(duì)比

監(jiān)控指標(biāo)采集:

# 統(tǒng)一監(jiān)控腳本 importredis importjson fromprometheus_clientimportGauge, start_http_server # 定義Prometheus指標(biāo) redis_up = Gauge('redis_up','Redis server is up', ['instance','role']) redis_connected_clients = Gauge('redis_connected_clients','Connected clients', ['instance']) redis_used_memory = Gauge('redis_used_memory_bytes','Used memory', ['instance']) redis_ops_per_sec = Gauge('redis_ops_per_sec','Operations per second', ['instance']) redis_keyspace_hits = Gauge('redis_keyspace_hits','Keyspace hits', ['instance']) redis_keyspace_misses = Gauge('redis_keyspace_misses','Keyspace misses', ['instance']) classRedisMonitor: def__init__(self, mode='sentinel'): self.mode = mode self.connections = [] defsetup_connections(self): ifself.mode =='sentinel': # Sentinel模式監(jiān)控 sentinel = Sentinel([('localhost',26379)]) self.connections.append({ 'client': sentinel.master_for('mymaster'), 'role':'master', 'instance':'mymaster' }) forslaveinsentinel.slaves('mymaster'): self.connections.append({ 'client': slave, 'role':'slave', 'instance':f'slave_{slave.connection_pool.connection_kwargs["host"]}' }) else: # Cluster模式監(jiān)控 startup_nodes = [ {"host":"127.0.0.1","port":"7000"}, {"host":"127.0.0.1","port":"7001"}, {"host":"127.0.0.1","port":"7002"} ] rc = RedisCluster(startup_nodes=startup_nodes) fornode_id, node_infoinrc.cluster_nodes().items(): self.connections.append({ 'client': redis.Redis(host=node_info['host'], port=node_info['port']), 'role':'master'if'master'innode_info['flags']else'slave', 'instance':f'{node_info["host"]}:{node_info["port"]}' }) defcollect_metrics(self): """采集監(jiān)控指標(biāo)""" forconninself.connections: try: client = conn['client'] info = client.info() # 基礎(chǔ)指標(biāo) redis_up.labels(instance=conn['instance'], role=conn['role']).set(1) redis_connected_clients.labels(instance=conn['instance']).set( info.get('connected_clients',0) ) redis_used_memory.labels(instance=conn['instance']).set( info.get('used_memory',0) ) # 性能指標(biāo) redis_ops_per_sec.labels(instance=conn['instance']).set( info.get('instantaneous_ops_per_sec',0) ) redis_keyspace_hits.labels(instance=conn['instance']).set( info.get('keyspace_hits',0) ) redis_keyspace_misses.labels(instance=conn['instance']).set( info.get('keyspace_misses',0) ) # Cluster特有指標(biāo) ifself.mode =='cluster': cluster_info = client.cluster_info() # 采集集群狀態(tài)、槽位信息等 exceptExceptionase: redis_up.labels(instance=conn['instance'], role=conn['role']).set(0) print(f"Error collecting metrics from{conn['instance']}:{e}")

3.3 故障處理實(shí)戰(zhàn)

場(chǎng)景1:主節(jié)點(diǎn)故障

Sentinel模式處理:

# 故障檢測(cè)和自動(dòng)切換日志分析 tail-f /var/log/redis-sentinel.log | grep -E"sdown|odown|switch-master" # 輸出示例: # +sdown master mymaster 192.168.1.10 6379 # +odown master mymaster 192.168.1.10 6379#quorum2/2 # +vote-for-leader 7f7e7c7e7d7e7f7e7g7h 1 # +elected-leader master mymaster 192.168.1.10 6379 # +failover-state-select-slave master mymaster 192.168.1.10 6379 # +selected-slave slave 192.168.1.11:6379 192.168.1.11 6379 @ mymaster 192.168.1.10 6379 # +failover-state-send-slaveof-noone slave 192.168.1.11:6379 # +switch-master mymaster 192.168.1.10 6379 192.168.1.11 6379 # 手動(dòng)故障轉(zhuǎn)移(如需要) redis-cli -p 26379 sentinel failover mymaster

Cluster模式處理:

# Cluster故障檢測(cè)和處理腳本 classClusterFailoverHandler: def__init__(self, cluster_nodes): self.rc = RedisCluster(startup_nodes=cluster_nodes) defdetect_failed_nodes(self): """檢測(cè)故障節(jié)點(diǎn)""" failed_nodes = [] cluster_state =self.rc.cluster_nodes() fornode_id, node_infoincluster_state.items(): if'fail'innode_info['flags']: failed_nodes.append({ 'node_id': node_id, 'address':f"{node_info['host']}:{node_info['port']}", 'slots': node_info.get('slots', []), 'role':'master'if'master'innode_info['flags']else'slave' }) returnfailed_nodes defautomatic_failover(self, failed_master): """自動(dòng)故障轉(zhuǎn)移""" # 查找該主節(jié)點(diǎn)的從節(jié)點(diǎn) slaves =self.find_slaves_for_master(failed_master['node_id']) ifnotslaves: print(f"警告:主節(jié)點(diǎn){failed_master['address']}沒(méi)有可用的從節(jié)點(diǎn)!") returnFalse # 選擇最合適的從節(jié)點(diǎn) best_slave =self.select_best_slave(slaves) # 執(zhí)行故障轉(zhuǎn)移 try: self.rc.cluster_failover(best_slave['node_id']) print(f"故障轉(zhuǎn)移成功:{best_slave['address']}已提升為主節(jié)點(diǎn)") returnTrue exceptExceptionase: print(f"故障轉(zhuǎn)移失敗:{e}") returnFalse defmanual_failover(self, target_node): """手動(dòng)故障轉(zhuǎn)移""" # 強(qiáng)制故障轉(zhuǎn)移 self.rc.execute_command('CLUSTER FAILOVER FORCE', target=target_node)

場(chǎng)景2:網(wǎng)絡(luò)分區(qū)處理

# 網(wǎng)絡(luò)分區(qū)檢測(cè)和恢復(fù)

classNetworkPartitionHandler:

def__init__(self):

self.partition_detected =False

self.partition_start_time =None

defdetect_partition(self):

"""檢測(cè)網(wǎng)絡(luò)分區(qū)"""

ifself.mode =='sentinel':

# Sentinel模式:檢查是否有多個(gè)節(jié)點(diǎn)聲稱自己是主節(jié)點(diǎn)

masters =self.find_all_masters()

iflen(masters) >1:

self.partition_detected =True

self.partition_start_time = time.time()

returnTrue

else: # Cluster模式

# 檢查集群是否處于fail狀態(tài)

cluster_info =self.rc.cluster_info()

ifcluster_info['cluster_state'] =='fail':

self.partition_detected =True

self.partition_start_time = time.time()

returnTrue

returnFalse

defresolve_partition(self):

"""解決網(wǎng)絡(luò)分區(qū)"""

ifself.mode =='

```python

def resolve_partition(self):

"""解決網(wǎng)絡(luò)分區(qū)"""

if self.mode == 'sentinel':

# Sentinel模式:強(qiáng)制重新選舉

self.force_reelection()

else: # Cluster模式

# 等待集群自動(dòng)恢復(fù)或手動(dòng)修復(fù)

if not self.wait_for_cluster_recovery():

self.manual_cluster_repair()

def force_reelection(self):

"""Sentinel模式:強(qiáng)制重新選舉"""

# 重置所有Sentinel的紀(jì)元

sentinels = [('192.168.1.20', 26379),

('192.168.1.21', 26379),

('192.168.1.22', 26379)]

for host, port in sentinels:

r = redis.Redis(host=host, port=port)

r.sentinel_reset('mymaster')

# 等待重新選舉完成

time.sleep(5)

# 驗(yàn)證新主節(jié)點(diǎn)

sentinel = Sentinel(sentinels)

master = sentinel.discover_master('mymaster')

print(f"新主節(jié)點(diǎn): {master}")

def manual_cluster_repair(self):

"""Cluster模式:手動(dòng)修復(fù)集群"""

# 修復(fù)丟失的槽位

missing_slots = self.find_missing_slots()

for slot in missing_slots:

# 將槽位分配給可用節(jié)點(diǎn)

available_node = self.find_available_node()

self.rc.cluster_addslots(available_node, slot)

# 修復(fù)節(jié)點(diǎn)關(guān)系

self.fix_node_relationships()

四、擴(kuò)展性分析:應(yīng)對(duì)業(yè)務(wù)增長(zhǎng)

4.1 水平擴(kuò)展能力對(duì)比

Sentinel模式的擴(kuò)展限制:

# Sentinel擴(kuò)展性分析

classSentinelScalabilityAnalysis:

def__init__(self):

self.max_memory_per_instance =64# GB

self.max_connections_per_instance =10000

self.max_ops_per_instance =100000# QPS

defcalculate_scaling_limits(self, data_size, qps_requirement):

"""計(jì)算Sentinel模式的擴(kuò)展限制"""

# 垂直擴(kuò)展分析

ifdata_size <=?self.max_memory_per_instance:

? ? ? ? ? ??print(f"單實(shí)例可滿足:數(shù)據(jù)量?{data_size}GB")

? ? ? ? ? ? scaling_strategy =?"vertical"

? ? ? ??else:

? ? ? ? ? ??print(f"需要數(shù)據(jù)分片:數(shù)據(jù)量?{data_size}GB 超過(guò)單實(shí)例限制")

? ? ? ? ? ? scaling_strategy =?"sharding_required"

? ? ? ??

? ? ? ??# QPS擴(kuò)展分析

? ? ? ??if?qps_requirement <=?self.max_ops_per_instance:

? ? ? ? ? ??print(f"單主節(jié)點(diǎn)可滿足:{qps_requirement}?QPS")

? ? ? ??else:

? ? ? ? ? ? read_slaves_needed = qps_requirement //?self.max_ops_per_instance

? ? ? ? ? ??print(f"需要?{read_slaves_needed}?個(gè)從節(jié)點(diǎn)分擔(dān)讀負(fù)載")

? ? ? ??

? ? ? ??return?{

? ? ? ? ? ??'scaling_strategy': scaling_strategy,

? ? ? ? ? ??'bottlenecks': [

? ? ? ? ? ? ? ??'單主節(jié)點(diǎn)寫(xiě)入瓶頸',

? ? ? ? ? ? ? ??'內(nèi)存容量限制',

? ? ? ? ? ? ? ??'主從復(fù)制延遲'

? ? ? ? ? ? ]

? ? ? ? }

? ??

? ??def?implement_read_write_splitting(self):

? ? ? ??"""實(shí)現(xiàn)讀寫(xiě)分離"""

? ? ? ??class?ReadWriteSplitter:

? ? ? ? ? ??def?__init__(self):

? ? ? ? ? ? ? ??self.sentinel = Sentinel([('localhost',?26379)])

? ? ? ? ? ? ? ??self.master =?self.sentinel.master_for('mymaster')

? ? ? ? ? ? ? ??self.slaves =?self.sentinel.slave_for('mymaster')

? ? ? ? ? ? ? ??

? ? ? ? ? ??def?execute(self, command, *args, **kwargs):

? ? ? ? ? ? ? ??# 寫(xiě)操作路由到主節(jié)點(diǎn)

? ? ? ? ? ? ? ??if?command.upper()?in?['SET',?'DEL',?'INCR',?'LPUSH',?'ZADD']:

? ? ? ? ? ? ? ? ? ??return?self.master.execute_command(command, *args, **kwargs)

? ? ? ? ? ? ? ??# 讀操作路由到從節(jié)點(diǎn)

? ? ? ? ? ? ? ??else:

? ? ? ? ? ? ? ? ? ??return?self.slaves.execute_command(command, *args, **kwargs)

Cluster模式的彈性擴(kuò)展:

# Cluster動(dòng)態(tài)擴(kuò)容實(shí)現(xiàn)

classClusterDynamicScaling:

def__init__(self, cluster_nodes):

self.rc = RedisCluster(startup_nodes=cluster_nodes)

defadd_node_to_cluster(self, new_node_host, new_node_port):

"""添加新節(jié)點(diǎn)到集群"""

# 步驟1:?jiǎn)?dòng)新節(jié)點(diǎn)

self.start_new_node(new_node_host, new_node_port)

# 步驟2:將節(jié)點(diǎn)加入集群

existing_node =self.get_any_master_node()

self.rc.cluster_meet(new_node_host, new_node_port)

# 步驟3:等待握手完成

time.sleep(2)

# 步驟4:分配槽位

self.rebalance_slots(new_node_host, new_node_port)

returnTrue

defrebalance_slots(self, new_node_host, new_node_port):

"""重新平衡槽位分配"""

# 計(jì)算每個(gè)節(jié)點(diǎn)應(yīng)該擁有的槽位數(shù)

all_masters =self.get_all_master_nodes()

total_slots =16384

slots_per_node = total_slots //len(all_masters)

# 從其他節(jié)點(diǎn)遷移槽位到新節(jié)點(diǎn)

new_node_id =self.get_node_id(new_node_host, new_node_port)

migrated_slots =0

formasterinall_masters[:-1]: # 排除新節(jié)點(diǎn)

ifmaster['slots'] > slots_per_node:

# 計(jì)算需要遷移的槽位數(shù)

slots_to_migrate = master['slots'] - slots_per_node

# 執(zhí)行槽位遷移

self.migrate_slots(

source_node=master['id'],

target_node=new_node_id,

slot_count=slots_to_migrate

)

migrated_slots += slots_to_migrate

ifmigrated_slots >= slots_per_node:

break

defmigrate_slots(self, source_node, target_node, slot_count):

"""執(zhí)行槽位遷移"""

# 獲取源節(jié)點(diǎn)的槽位列表

source_slots =self.get_node_slots(source_node)

slots_to_migrate = source_slots[:slot_count]

forslotinslots_to_migrate:

# 步驟1:目標(biāo)節(jié)點(diǎn)準(zhǔn)備導(dǎo)入槽位

self.rc.cluster_setslot_importing(target_node, slot, source_node)

# 步驟2:源節(jié)點(diǎn)準(zhǔn)備導(dǎo)出槽位

self.rc.cluster_setslot_migrating(source_node, slot, target_node)

# 步驟3:遷移槽位中的所有key

keys =self.rc.cluster_getkeysinslot(slot,1000)

forkeyinkeys:

self.rc.migrate(target_node, key)

# 步驟4:更新槽位歸屬

self.rc.cluster_setslot_node(slot, target_node)

print(f"成功遷移{slot_count}個(gè)槽位從{source_node}到{target_node}")

4.2 容量規(guī)劃實(shí)戰(zhàn)

# 容量規(guī)劃計(jì)算器

classCapacityPlanner:

def__init__(self):

self.data_growth_rate =0.2# 20%月增長(zhǎng)

self.peak_multiplier =3# 峰值是平均值的3倍

defplan_for_sentinel(self, current_data_gb, current_qps, months=12):

"""Sentinel模式容量規(guī)劃"""

projections = []

formonthinrange(1, months +1):

# 計(jì)算數(shù)據(jù)增長(zhǎng)

data_size = current_data_gb * (1+self.data_growth_rate) ** month

qps = current_qps * (1+self.data_growth_rate) ** month

peak_qps = qps *self.peak_multiplier

# 計(jì)算所需資源

memory_needed = data_size *1.5# 留50%余量

# 判斷是否需要分片

ifmemory_needed >64: # 單實(shí)例64GB限制

shards_needed =int(memory_needed /64) +1

strategy =f"需要{shards_needed}個(gè)分片"

else:

strategy ="單實(shí)例即可"

projections.append({

'month': month,

'data_size_gb':round(data_size,2),

'avg_qps':round(qps),

'peak_qps':round(peak_qps),

'memory_needed_gb':round(memory_needed,2),

'strategy': strategy

})

returnprojections

defplan_for_cluster(self, current_data_gb, current_qps, months=12):

"""Cluster模式容量規(guī)劃"""

projections = []

current_nodes =3# 初始3個(gè)主節(jié)點(diǎn)

formonthinrange(1, months +1):

# 計(jì)算數(shù)據(jù)增長(zhǎng)

data_size = current_data_gb * (1+self.data_growth_rate) ** month

qps = current_qps * (1+self.data_growth_rate) ** month

peak_qps = qps *self.peak_multiplier

# 計(jì)算所需節(jié)點(diǎn)數(shù)

nodes_for_memory =int(data_size /32) +1# 每節(jié)點(diǎn)32GB

nodes_for_qps =int(peak_qps /50000) +1# 每節(jié)點(diǎn)5萬(wàn)QPS

nodes_needed =max(nodes_for_memory, nodes_for_qps,3) # 至少3個(gè)

# 計(jì)算擴(kuò)容操作

ifnodes_needed > current_nodes:

expansion_needed = nodes_needed - current_nodes

expansion_action =f"添加{expansion_needed}個(gè)節(jié)點(diǎn)"

current_nodes = nodes_needed

else:

expansion_action ="無(wú)需擴(kuò)容"

projections.append({

'month': month,

'data_size_gb':round(data_size,2),

'avg_qps':round(qps),

'peak_qps':round(peak_qps),

'nodes_needed': nodes_needed,

'action': expansion_action

})

returnprojections

五、高可用對(duì)比:真實(shí)故障場(chǎng)景

5.1 故障恢復(fù)時(shí)間(RTO)對(duì)比

# 故障恢復(fù)時(shí)間測(cè)試

classRTOBenchmark:

def__init__(self):

self.test_results = {

'sentinel': {},

'cluster': {}

}

deftest_master_failure_rto(self):

"""測(cè)試主節(jié)點(diǎn)故障的恢復(fù)時(shí)間"""

# Sentinel模式測(cè)試

print("測(cè)試Sentinel模式主節(jié)點(diǎn)故障恢復(fù)...")

# 1. 記錄故障前狀態(tài)

start_time = time.time()

# 2. 模擬主節(jié)點(diǎn)故障

os.system("kill -9 $(pidof redis-server | awk '{print $1}')")

# 3. 等待故障檢測(cè)和轉(zhuǎn)移

whileTrue:

try:

sentinel = Sentinel([('localhost',26379)])

master = sentinel.master_for('mymaster')

master.ping()

break

except:

time.sleep(0.1)

sentinel_rto = time.time() - start_time

self.test_results['sentinel']['master_failure'] = sentinel_rto

print(f"Sentinel RTO:{sentinel_rto:.2f}秒")

# Cluster模式測(cè)試

print("

測(cè)試Cluster模式主節(jié)點(diǎn)故障恢復(fù)...")

# 1. 記錄故障前狀態(tài)

start_time = time.time()

# 2. 模擬節(jié)點(diǎn)故障

os.system("redis-cli -p 7000 DEBUG SEGFAULT")

# 3. 等待故障檢測(cè)和轉(zhuǎn)移

whileTrue:

try:

rc = RedisCluster(startup_nodes=[{"host":"127.0.0.1","port":"7001"}])

rc.ping()

cluster_info = rc.cluster_info()

ifcluster_info['cluster_state'] =='ok':

break

except:

time.sleep(0.1)

cluster_rto = time.time() - start_time

self.test_results['cluster']['master_failure'] = cluster_rto

print(f"Cluster RTO:{cluster_rto:.2f}秒")

returnself.test_results

5.2 數(shù)據(jù)一致性保證

# 數(shù)據(jù)一致性測(cè)試

classConsistencyTest:

def__init__(self):

self.inconsistency_count =0

deftest_write_consistency_during_failover(self):

"""測(cè)試故障轉(zhuǎn)移期間的寫(xiě)入一致性"""

# 啟動(dòng)寫(xiě)入線程

write_thread = threading.Thread(target=self.continuous_write)

write_thread.start()

# 等待一段時(shí)間后觸發(fā)故障

time.sleep(5)

self.trigger_failover()

# 繼續(xù)寫(xiě)入并檢查一致性

time.sleep(10)

self.stop_writing =True

write_thread.join()

# 驗(yàn)證數(shù)據(jù)一致性

self.verify_data_consistency()

defcontinuous_write(self):

"""持續(xù)寫(xiě)入數(shù)據(jù)"""

self.written_data = {}

self.stop_writing =False

counter =0

whilenotself.stop_writing:

try:

key =f"test_key_{counter}"

value =f"test_value_{counter}_{time.time()}"

# 寫(xiě)入數(shù)據(jù)

ifself.mode =='sentinel':

sentinel = Sentinel([('localhost',26379)])

master = sentinel.master_for('mymaster')

master.set(key, value)

else:

rc = RedisCluster(startup_nodes=[{"host":"127.0.0.1","port":"7000"}])

rc.set(key, value)

self.written_data[key] = value

counter +=1

time.sleep(0.01) # 100次/秒

exceptExceptionase:

print(f"寫(xiě)入失敗:{e}")

time.sleep(1)

defverify_data_consistency(self):

"""驗(yàn)證數(shù)據(jù)一致性"""

print(f"驗(yàn)證{len(self.written_data)}條數(shù)據(jù)的一致性...")

forkey, expected_valueinself.written_data.items():

try:

ifself.mode =='sentinel':

sentinel = Sentinel([('localhost',26379)])

master = sentinel.master_for('mymaster')

actual_value = master.get(key)

else:

rc = RedisCluster(startup_nodes=[{"host":"127.0.0.1","port":"7000"}])

actual_value = rc.get(key)

ifactual_value != expected_value:

self.inconsistency_count +=1

print(f"數(shù)據(jù)不一致:{key}")

exceptExceptionase:

print(f"讀取失敗:{key}, 錯(cuò)誤:{e}")

self.inconsistency_count +=1

consistency_rate = (1-self.inconsistency_count /len(self.written_data)) *100

print(f"數(shù)據(jù)一致性:{consistency_rate:.2f}%")

print(f"不一致數(shù)據(jù):{self.inconsistency_count}/{len(self.written_data)}")

六、實(shí)戰(zhàn)案例:如何選擇最適合的方案

6.1 典型場(chǎng)景分析

# 場(chǎng)景決策樹(shù)

classScenarioAnalyzer:

defanalyze_requirements(self, requirements):

"""根據(jù)需求分析推薦方案"""

score_sentinel =0

score_cluster =0

recommendations = []

# 數(shù)據(jù)量評(píng)估

ifrequirements['data_size_gb'] =99.99:

score_cluster +=1

recommendations.append("超高可用性要求,Cluster故障域更小")

# 最終推薦

ifscore_sentinel > score_cluster:

final_recommendation ="Sentinel"

else:

final_recommendation ="Cluster"

return{

'recommendation': final_recommendation,

'sentinel_score': score_sentinel,

'cluster_score': score_cluster,

'reasons': recommendations

}

6.2 遷移方案設(shè)計(jì)

# Sentinel到Cluster遷移方案

classMigrationPlan:

def__init__(self):

self.migration_steps = []

defcreate_migration_plan(self, source_type='sentinel', target_type='cluster'):

"""創(chuàng)建遷移計(jì)劃"""

ifsource_type =='sentinel'andtarget_type =='cluster':

returnself.sentinel_to_cluster_migration()

defsentinel_to_cluster_migration(self):

"""Sentinel到Cluster的遷移步驟"""

steps = [

{

'phase':1,

'name':'準(zhǔn)備階段',

'duration':'1-2天',

'tasks': [

'搭建Cluster測(cè)試環(huán)境',

'性能基準(zhǔn)測(cè)試',

'應(yīng)用兼容性測(cè)試',

'制定回滾方案'

],

'script':self.prepare_cluster_env

},

{

'phase':2,

'name':'數(shù)據(jù)同步階段',

'duration':'2-3天',

'tasks': [

'全量數(shù)據(jù)導(dǎo)出',

'數(shù)據(jù)導(dǎo)入Cluster',

'建立增量同步',

'數(shù)據(jù)一致性校驗(yàn)'

],

'script':self.sync_data

},

{

'phase':3,

'name':'灰度切換階段',

'duration':'3-5天',

'tasks': [

'1%流量切換',

'10%流量切換',

'50%流量切換',

'監(jiān)控和調(diào)優(yōu)'

],

'script':self.gradual_switch

},

{

'phase':4,

'name':'全量切換階段',

'duration':'1天',

'tasks': [

'100%流量切換',

'舊集群保持待命',

'觀察24小時(shí)',

'確認(rèn)切換成功'

],

'script':self.full_switch

}

]

returnsteps

defsync_data(self):

"""數(shù)據(jù)同步腳本"""

# 使用redis-shake進(jìn)行數(shù)據(jù)同步

sync_config ="""

# redis-shake配置

source.type = standalone

source.address = 192.168.1.10:6379

source.password = yourpassword

target.type = cluster

target.address = 192.168.1.30:7000;192.168.1.31:7001;192.168.1.32:7002

target.password = yourpassword

# 同步配置

sync.mode = rump # 全量同步

sync.parallel = 32

sync.data_filter = true

# 增量同步

sync.mode = sync # 切換到增量同步模式

"""

# 執(zhí)行同步

os.system(f"redis-shake -conf redis-shake.conf")

七、性能優(yōu)化最佳實(shí)踐

7.1 Sentinel性能優(yōu)化

# Sentinel優(yōu)化配置生成器

classSentinelOptimizer:

defgenerate_optimized_config(self, scenario):

"""根據(jù)場(chǎng)景生成優(yōu)化配置"""

config = {

'redis_master': {},

'redis_slave': {},

'sentinel': {}

}

ifscenario =='high_write':

# 高寫(xiě)入場(chǎng)景優(yōu)化

config['redis_master'] = {

'maxmemory-policy':'allkeys-lru',

'save':'', # 關(guān)閉RDB

'appendonly':'no', # 關(guān)閉AOF

'tcp-backlog':511,

'tcp-keepalive':60,

'timeout':0,

'hz':100, # 提高后臺(tái)任務(wù)頻率

'repl-backlog-size':'256mb',

'client-output-buffer-limit':'slave 256mb 64mb 60'

}

elifscenario =='high_read':

# 高讀取場(chǎng)景優(yōu)化

config['redis_slave'] = {

'slave-read-only':'yes',

'maxmemory-policy':'volatile-lru',

'repl-diskless-sync':'yes',

'repl-diskless-sync-delay':5,

'slave-priority':100,

'lazyfree-lazy-eviction':'yes',

'lazyfree-lazy-expire':'yes'

}

# Sentinel通用優(yōu)化

config['sentinel'] = {

'sentinel_down_after_milliseconds':5000, # 快速故障檢測(cè)

'sentinel_parallel_syncs':2, # 并行同步

'sentinel_failover_timeout':60000, # 故障轉(zhuǎn)移超時(shí)

'sentinel_deny_scripts_reconfig':'yes'# 安全配置

}

returnconfig

7.2 Cluster性能優(yōu)化

# Cluster優(yōu)化工具

classClusterOptimizer:

defoptimize_cluster_performance(self):

"""Cluster性能優(yōu)化"""

optimizations = {

'network':self.optimize_network(),

'memory':self.optimize_memory(),

'cpu':self.optimize_cpu(),

'persistence':self.optimize_persistence()

}

returnoptimizations

defoptimize_network(self):

"""網(wǎng)絡(luò)優(yōu)化"""

return{

'cluster-node-timeout':5000, # 降低超時(shí)時(shí)間

'cluster-replica-validity-factor':0, # 從節(jié)點(diǎn)永不過(guò)期

'cluster-migration-barrier':1, # 遷移屏障

'cluster-require-full-coverage':'no', # 部分覆蓋也可用

'tcp-backlog':511,

'tcp-keepalive':60

}

defoptimize_memory(self):

"""內(nèi)存優(yōu)化"""

return{

'maxmemory-policy':'volatile-lru',

'lazyfree-lazy-eviction':'yes',

'lazyfree-lazy-expire':'yes',

'lazyfree-lazy-server-del':'yes',

'activerehashing':'yes',

'hz':100

}

八、總結(jié):決策清單與行動(dòng)指南

8.1 快速?zèng)Q策清單

基于本文的深入分析,我整理了一份快速?zèng)Q策清單:

選擇Sentinel的場(chǎng)景:

? 數(shù)據(jù)量 < 64GB

? QPS < 10萬(wàn)

? 需要事務(wù)支持

? 大量使用Lua腳本

? 業(yè)務(wù)邏輯依賴多key操作

? 運(yùn)維團(tuán)隊(duì)規(guī)模較小

? 對(duì)延遲極度敏感

選擇Cluster的場(chǎng)景:

? 數(shù)據(jù)量 > 64GB

? QPS > 10萬(wàn)

? 需要水平擴(kuò)展能力

? 可以改造應(yīng)用避免跨槽位操作

? 有專業(yè)的運(yùn)維團(tuán)隊(duì)

? 追求更高的可用性

8.2 實(shí)施路線圖

# 生成個(gè)性化實(shí)施方案

defgenerate_implementation_roadmap(current_state, target_state):

"""生成實(shí)施路線圖"""

roadmap = {

'week_1': [

'技術(shù)評(píng)審和方案確認(rèn)',

'測(cè)試環(huán)境搭建',

'性能基準(zhǔn)測(cè)試'

],

'week_2': [

'應(yīng)用改造(如需要)',

'監(jiān)控系統(tǒng)部署',

'自動(dòng)化腳本開(kāi)發(fā)'

],

'week_3': [

'生產(chǎn)環(huán)境部署',

'數(shù)據(jù)遷移',

'灰度切換'

],

'week_4': [

'性能優(yōu)化',

'穩(wěn)定性觀察',

'文檔完善'

]

}

returnroadmap

結(jié)語(yǔ)

選擇Redis集群方案不是非黑即白的決定,而是需要基于業(yè)務(wù)特點(diǎn)、團(tuán)隊(duì)能力、發(fā)展預(yù)期等多個(gè)維度綜合考慮。通過(guò)本文的詳細(xì)對(duì)比和實(shí)戰(zhàn)案例,相信你已經(jīng)對(duì)Sentinel和Cluster有了深入的理解。

記住,沒(méi)有最好的架構(gòu),只有最適合的架構(gòu)。在做出選擇之前,請(qǐng)務(wù)必:

1.充分測(cè)試:在你的實(shí)際業(yè)務(wù)場(chǎng)景下進(jìn)行壓測(cè)

2.漸進(jìn)式遷移:不要一次性切換,采用灰度方案

3.監(jiān)控先行:完善的監(jiān)控是穩(wěn)定運(yùn)行的基礎(chǔ)

4.預(yù)留余地:為未來(lái)的增長(zhǎng)預(yù)留足夠的空間

最后,如果你覺(jué)得這篇文章對(duì)你有幫助,歡迎關(guān)注我的博客,我會(huì)持續(xù)分享更多生產(chǎn)環(huán)境的實(shí)戰(zhàn)經(jīng)驗(yàn)。下一篇文章,我會(huì)深入講解《Redis故障診斷與性能調(diào)優(yōu)實(shí)戰(zhàn)》,敬請(qǐng)期待!

作者簡(jiǎn)介:10年運(yùn)維老兵,曾負(fù)責(zé)多個(gè)千萬(wàn)級(jí)用戶系統(tǒng)的Redis架構(gòu)設(shè)計(jì)與優(yōu)化,踩過(guò)的坑希望你不要再踩。

本文所有代碼示例均已在生產(chǎn)環(huán)境驗(yàn)證,可直接使用。如有問(wèn)題,歡迎在評(píng)論區(qū)交流討論。

-

集群

+關(guān)注

關(guān)注

0文章

149瀏覽量

17683 -

Redis

+關(guān)注

關(guān)注

0文章

394瀏覽量

12242

原文標(biāo)題:Redis集群模式選擇:Sentinel vs Cluster深度對(duì)比實(shí)戰(zhàn)指南

文章出處:【微信號(hào):magedu-Linux,微信公眾號(hào):馬哥Linux運(yùn)維】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

如何使用Rust連接Redis

Redis Cluster的基本原理及實(shí)現(xiàn)細(xì)節(jié)

Redis的四種模式復(fù)制、哨兵、Cluster以及集群模式

單機(jī)redis和redisCluster集群是如何獲取所有key的

Redis為何選擇單線程

什么是Redis主從復(fù)制

Cloud MemoryStore for Redis Cluster 正式發(fā)布

Redis Sentinel和Cluster模式如何選擇

Redis Sentinel和Cluster模式如何選擇

評(píng)論