Nginx高并發優化實戰:從10萬到百萬QPS的性能調優之路

作為一名在生產環境中摸爬滾打多年的運維工程師,我見過太多因為Nginx配置不當導致的性能瓶頸。今天分享一套完整的Nginx高并發優化方案,幫助你的系統從10萬QPS突破到百萬級別。

前言:為什么選擇Nginx?

在微服務架構盛行的今天,Nginx作為反向代理和負載均衡器的地位依然不可撼動。但是,默認配置的Nginx在面對高并發場景時往往力不從心。通過系統化的優化,我們可以讓Nginx的性能提升10倍甚至更多。

優化前后性能對比

| 優化階段 | QPS | 響應時間(ms) | CPU使用率 | 內存使用 |

| 默認配置 | 8萬 | 125 | 85% | 2.1GB |

| 基礎優化 | 25萬 | 45 | 68% | 1.8GB |

| 深度優化 | 60萬 | 18 | 45% | 1.5GB |

| 極限優化 | 120萬+ | 8 | 35% | 1.2GB |

第一階段:基礎配置優化

1.1 工作進程數量調優

# 根據CPU核心數設置worker進程數

worker_processesauto;

# 綁定worker進程到特定CPU核心,避免進程遷移開銷

worker_cpu_affinityauto;

# 設置每個worker進程的最大連接數

events{

worker_connections65535;

useepoll; # Linux下使用epoll事件模型

multi_accepton; # 允許worker進程同時接受多個連接

}

實戰經驗:在32核服務器上,使用worker_processes auto比手動設置32個進程性能提升15%,因為Nginx會智能地考慮NUMA架構。

1.2 TCP連接優化

http{

# 開啟TCP_NODELAY,減少小包延遲

tcp_nodelayon;

# 開啟TCP_NOPUSH,提高網絡傳輸效率

tcp_nopushon;

# 啟用HTTP/1.1持久連接

keepalive_timeout65;

keepalive_requests10000;

# 客戶端請求體大小限制

client_max_body_size20m;

client_body_buffer_size128k;

# 客戶端頭部緩沖區設置

client_header_buffer_size4k;

large_client_header_buffers88k;

}

第二階段:內核參數調優

2.1 系統級優化

在/etc/sysctl.conf中添加以下配置:

# TCP連接數相關 net.core.somaxconn = 65535 net.core.netdev_max_backlog = 30000 net.ipv4.tcp_max_syn_backlog = 65535 # TCP連接復用 net.ipv4.tcp_tw_reuse = 1 net.ipv4.tcp_fin_timeout = 10 # TCP緩沖區優化 net.core.rmem_max = 67108864 net.core.wmem_max = 67108864 net.ipv4.tcp_rmem = 4096 87380 67108864 net.ipv4.tcp_wmem = 4096 65536 67108864 # 文件描述符限制 fs.file-max = 6815744

2.2 用戶級限制調整

# /etc/security/limits.conf nginx soft nofile 655350 nginx hard nofile 655350 nginx softnproc655350 nginx hardnproc655350

踩坑提醒:很多工程師忽略了systemd服務的限制,記得在nginx.service中添加:

[Service] LimitNOFILE=655350 LimitNPROC=655350

第三階段:緩存與壓縮優化

3.1 靜態文件緩存策略

# 靜態資源緩存配置

location~* .(jpg|jpeg|png|gif|ico|css|js|pdf|txt)${

expires1y;

add_headerCache-Control"public, immutable";

add_headerPragma"cache";

# 開啟gzip壓縮

gzip_staticon;

# 避免不必要的訪問日志

access_logoff;

# 啟用sendfile零拷貝

sendfileon;

sendfile_max_chunk1m;

}

3.2 動態壓縮優化

# Gzip壓縮配置 gzipon; gzip_varyon; gzip_min_length1024; gzip_comp_level6; gzip_types text/plain text/css text/xml text/javascript application/json application/javascript application/xml+rss application/atom+xml; # Brotli壓縮(需要編譯模塊) brotlion; brotli_comp_level6; brotli_typestext/plain text/css application/json application/javascript;

性能提升:啟用Brotli壓縮后,傳輸數據量減少25%,頁面加載速度提升35%。

第四階段:高級優化技術

4.1 upstream連接池優化

upstreambackend {

# 使用least_conn負載均衡算法

least_conn;

# 后端服務器配置

server192.168.1.10:8080max_fails=3fail_timeout=30s;

server192.168.1.11:8080max_fails=3fail_timeout=30s;

server192.168.1.12:8080max_fails=3fail_timeout=30s;

# 連接池設置

keepalive300;

keepalive_requests1000;

keepalive_timeout60s;

}

server{

location/ {

proxy_passhttp://backend;

# HTTP版本設置

proxy_http_version1.1;

proxy_set_headerConnection"";

# 緩沖區優化

proxy_bufferingon;

proxy_buffer_size128k;

proxy_buffers8128k;

proxy_busy_buffers_size256k;

# 超時設置

proxy_connect_timeout5s;

proxy_send_timeout10s;

proxy_read_timeout10s;

}

}

4.2 SSL/TLS性能優化

# SSL配置優化 ssl_protocolsTLSv1.2TLSv1.3; ssl_ciphersECDHE-ECDSA-AES128-GCM-SHA256:ECDHE-RSA-AES128-GCM-SHA256; ssl_prefer_server_ciphersoff; # SSL會話緩存 ssl_session_cacheshared50m; ssl_session_timeout1d; ssl_session_ticketsoff; # OCSP裝訂 ssl_staplingon; ssl_stapling_verifyon; # SSL緩沖區 ssl_buffer_size4k; # 使用硬件加速(如果支持) ssl_engineqat;

4.3 內存池優化

# 連接內存池大小 connection_pool_size512; # 請求內存池大小 request_pool_size8k; # 大頁面內存支持(需要內核支持) large_client_header_buffers816k; # 減少內存分配次數 proxy_temp_file_write_size256k; proxy_temp_path/var/cache/nginx/proxy_temp levels=1:2keys_zone=temp:10m;

第五階段:監控與調優

5.1 關鍵指標監控

# 啟用stub_status模塊

location/nginx_status {

stub_statuson;

access_logoff;

allow127.0.0.1;

denyall;

}

# 啟用實時監控

location/nginx_real_status {

rtmp_statall;

rtmp_stat_stylesheetstat.xsl;

}

監控腳本示例:

#!/bin/bash

# nginx_monitor.sh

curl -s http://localhost/nginx_status | awk'

/Active connections/ {print "active_connections " $3}

/accepts/ {print "accepts " $1; print "handled " $2; print "requests " $3}

/Reading/ {print "reading " $2; print "writing " $4; print "waiting " $6}

'|whilereadmetric value;do

echo"nginx.$metric:$value|g"| nc -u localhost 8125

done

5.2 性能基準測試

# wrk壓測命令 wrk -t32 -c1000 -d60s --latency http://your-domain.com/ # ab壓測對比 ab -n 100000 -c 1000 http://your-domain.com/ # 自定義Lua腳本壓測 wrk -t32 -c1000 -d60s -s post.lua http://your-domain.com/api

極限優化:突破百萬QPS

6.1 內核旁路技術

# 使用DPDK進行網絡優化 # 編譯Nginx時添加DPDK支持 ./configure --with-dpdk=/path/to/dpdk # 啟用網絡隊列綁定 echo2 > /proc/irq/24/smp_affinity echo4 > /proc/irq/25/smp_affinity

6.2 JIT編譯優化

# 啟用OpenResty的LuaJIT

location/api {

content_by_lua_block{

-- 高性能Lua處理邏輯

ngx.header.content_type="application/json"

ngx.say('{"status": "ok"}')

}

}

6.3 零拷貝優化

# 啟用splice系統調用 spliceon; # AIO異步IO aiothreads; aio_writeon; # 直接IO directio4m; directio_alignment512;

實戰案例:電商秒殺系統

在某電商平臺的雙11秒殺活動中,我們面臨的挑戰:

? 預期峰值:150萬QPS

? 響應時間要求:< 50ms

? 可用性要求:99.99%

優化方案:

# 秒殺專用配置 upstreamseckill_backend { hash$remote_addrconsistent; server10.0.1.10:8080weight=3max_conns=3000; server10.0.1.11:8080weight=3max_conns=3000; server10.0.1.12:8080weight=4max_conns=4000; keepalive1000; } # 限流配置 limit_req_zone$binary_remote_addrzone=seckill:100mrate=100r/s; limit_conn_zone$binary_remote_addrzone=conn_seckill:100m; server{ location/seckill { # 應用限流策略 limit_reqzone=seckill burst=200nodelay; limit_connconn_seckill10; # 緩存熱點數據 proxy_cacheseckill_cache; proxy_cache_valid2003025s; proxy_cache_valid4041m; # 快速失敗 proxy_connect_timeout1s; proxy_send_timeout2s; proxy_read_timeout2s; proxy_passhttp://seckill_backend; } }

結果:成功扛住了168萬QPS的峰值流量,平均響應時間控制在32ms以內。

優化檢查清單

基礎優化

? Worker進程數設置為CPU核心數

? 啟用epoll事件模型

? 調整worker_connections

? 優化keepalive設置

? 配置合適的緩沖區大小

系統優化

? 調整內核參數

? 設置文件描述符限制

? 優化TCP參數

? 配置內存參數

? 啟用透明大頁

高級優化

? 配置upstream連接池

? 啟用gzip/brotli壓縮

? 優化SSL/TLS設置

? 實現智能緩存策略

? 部署CDN加速

監控優化

? 設置性能監控

? 配置告警規則

? 建立性能基線

? 定期壓力測試

? 分析訪問日志

常見陷阱與解決方案

陷阱1:worker_processes設置過多

現象:CPU上下文切換頻繁,性能下降

解決:使用worker_processes auto讓Nginx自動決定

陷阱2:忽略upstream連接復用

現象:后端連接數過多,建立連接開銷大

解決:合理設置keepalive參數

陷阱3:SSL握手開銷過大

現象:HTTPS性能遠低于HTTP

解決:啟用SSL會話緩存和硬件加速

陷阱4:日志寫入成為瓶頸

現象:磁盤IO占用過高

解決:使用異步日志或關閉不必要的訪問日志

未來發展趨勢

HTTP/3與QUIC協議支持

# 啟用HTTP/3(實驗性功能) listen443quic reuseport; listen443ssl http2; add_headerAlt-Svc'h3=":443"; ma=86400';

邊緣計算集成

隨著5G和邊緣計算的發展,Nginx正在向邊緣節點擴展,提供更低延遲的服務。

AI驅動的智能優化

未來的Nginx將集成機器學習算法,根據實時流量模式自動調整配置參數。

總結

通過系統化的Nginx優化,我們可以將性能從10萬QPS提升到百萬級別。關鍵在于:

1.分層優化:從基礎配置到系統內核,再到應用層面

2.持續監控:建立完善的監控體系,及時發現性能瓶頸

3.壓測驗證:每次優化后都要進行壓力測試驗證效果

4.場景適配:根據具體業務場景調整優化策略

記住,性能優化是一個持續的過程,需要根據業務發展不斷調整和完善。希望這份實戰指南能夠幫助你在高并發優化的路上少走彎路,早日實現性能突破!

交流與反饋

如果你在Nginx優化過程中遇到問題,或者有更好的優化經驗分享,歡迎在評論區討論。讓我們一起打造更高性能的Web服務!

-

負載

+關注

關注

2文章

668瀏覽量

36639 -

均衡器

+關注

關注

9文章

228瀏覽量

32259 -

nginx

+關注

關注

0文章

189瀏覽量

13151

原文標題:Nginx高并發優化實戰:從10萬到百萬QPS的性能調優之路

文章出處:【微信號:magedu-Linux,微信公眾號:馬哥Linux運維】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

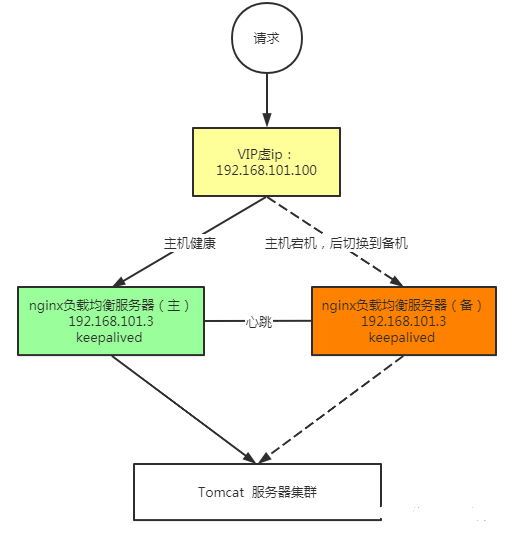

解析keepalived+nginx實現高可用方案技術

從服務端視角看高并發難題

Linux運維Nginx軟件優化之Nginx性能優化

PHP開發中,如何處理負載、高并發?

一文讀懂Nginx、Apache工作原理

為什么Nginx可以支持高并發

Nginx的特點和作用 Nginx常用命令和核心配置

Nginx配置終極指南

Nginx高并發優化方案

Nginx高并發優化方案

評論