[首發于智駕最前沿微信公眾號]自動駕駛車輛要在復雜多變的道路環境中安全行駛,不僅需要“看見”前方的車輛、行人和路面標志,還需要“讀懂”交通標識上的文字提示、施工告示牌和乘客的語言指令。之前和大家討論過VLA,了解到視覺-語言-動作模型,但在很多場景中,大家還會提到VLM,看起來與VLA非常類似,那VLM又是個啥?與VLA(Vision-Language-Action,視覺-語言-動作)又有什么區別?

什么是VLM?

VLM即視覺-語言模型(Vision–Language Model),是一類讓計算機“看懂”圖像和“讀懂”文字能力合二為一的人工智能系統,它通過在同一個模型中聯合處理視覺特征和語言信息,實現對圖片或視頻內容的深度理解與自然語言互動。VLM可以抽取圖像中的物體形狀、顏色、位置甚至動作,然后將這些視覺嵌入與文本嵌入在多模態 Transformer 中融合,讓模型學會把“畫面”映射成語義概念,再通過語言解碼器生成符合人類表達習慣的文字描述、回答問題或創作故事。通俗來說,VLM 就像擁有視覺和語言雙重感官的“大腦”,能夠在看到一張照片后,不僅識別出里面的貓狗、車輛或建筑,還能用一句話或一段話把它們生動地說出來,大大提升了 AI 在圖文檢索、輔助寫作、智能客服和機器人導航等場景中的實用價值。

如何讓VLM高效工作?

VLM可以將一幀原始的道路圖像轉換為計算機能處理的特征表示。這一過程通常由視覺編碼器完成,主流方案包括卷積神經網絡(CNN)和近年來興起的視覺Transformer(ViT)。它們會對圖像進行分層處理,提取出道路紋理、車輛輪廓、行人形狀以及路牌文字等多種視覺特征,并將它們編碼為向量形式。語言編碼器和語言解碼器則負責處理自然語言的輸入與輸出,也采用基于Transformer的架構,將文字拆分為Token,然后學習各個Token之間的語義關聯,并能夠根據給定的向量特征生成連貫的語言描述。

將視覺編碼器得到的圖像特征和語言模塊進行對齊是VLM的關鍵所在。常見的做法是通過跨模態注意力(cross-attention)機制,讓語言解碼器在生成每個文字Token時,能夠自動關注到圖像中與該文字最相關的區域。比如在識別“前方施工,請減速慢行”這句話時,模型會在圖像中著重關注黃色施工標志、交通錐或挖掘機等顯著區域,從而保證生成的文字與實際場景高度一致。整個系統可以端到端聯合訓練,也就是說模型的損失函數會同時考慮視覺特征提取的準確性和語言生成的流暢性,通過不斷迭代,將兩者的性能共同提升。

為了讓VLM更好地適應自動駕駛的特殊場景,訓練過程通常分為預訓練和微調兩個階段。在預訓練階段,會利用海量的網絡圖文,比如從互聯網收集的大規模圖片和對應的標題、說明文字,讓模型先掌握通用的視覺-語言對應關系。這一階段的目標是讓模型具備跨領域的基本能力,能識別多種物體、理解常見場景、生成自然表達。隨后,進入微調階段,需要采集自動駕駛專屬的數據集,這其中包括各種道路類型(城市道路、高速公路、鄉村公路)、多種天氣條件(晴天、雨雪、夜晚)、不同交通設施(施工區域、隧道、十字路口)等場景下的圖像,并配以專業標注的文字描述。通過這種有針對性的訓練,模型才能在實際行駛中精準識別交通標志上的文字信息,并及時生成符合交通法規和行駛安全的提示語。

在實際應用中,VLM能夠支持多種智能化功能。首先是實時場景提示。當車輛行駛在突遇施工、積水、落石等危險區域時,VLM會識別路面狀況,結合圖像中出現的施工標志、警示牌或水坑輪廓,自動生成“前方道路施工,請提前減速”或“前方積水較深,請繞行”的自然語言提示,并將該提示通過儀表盤或車載語音播報給駕駛員。其次是交互式語義問答。乘客可通過語音助手詢問“前方哪條車道最快?”、“我還能在下一個路口右轉嗎?”等問題,系統會將語音轉文字后,結合當前圖像和地圖數據,利用VLM回答“從左側車道行駛可避開前方擁堵,請注意車距”或“前方禁止右轉,請繼續直行”之類的文字回復。再者,VLM還可對路標與路牌文字識別,它不僅對交通標志的圖形進行分類,還能識別標志牌上的文字信息,將“限高3.5米”“禁止掉頭”“施工中”等信息結構化地傳遞給決策模塊。

為了讓VLM在車載環境中實時運行,通常會采用“邊緣-云協同”架構。在云端完成大規模預訓練和定期微調,將性能最優的模型權重通過OTA(Over-The-Air)下發到車載單元;車載單元部署經過剪枝、量化和蒸餾等技術優化后的輕量級推理模型,依托車載GPU或NPU在毫秒級別內完成圖像與語言的聯合推理。對于對時延要求極高的安全提示,優先使用本地推理結果;對于更加復雜的非安全場景分析,如行程總結或高級報告,則可異步將數據上傳云端進行深度處理。

數據標注與質量保障是VLM部署的另一大關鍵。標注團隊需要在不同光照、天氣、道路類型條件下采集多視角、多樣本圖像,并為每張圖像配備詳盡的文字描述。如對一張高速路施工場景的圖像,不僅要框選出施工車輛、路障和交通錐,還要撰寫“前方高速公路正在施工,左側車道封閉,請向右變道并減速至60公里/小時以內”的自然語言說明。為了保證標注一致性,通常會進行多輪審核和校驗,并引入弱監督策略對大量未標注圖像生成偽標簽,降低人工成本的同時保持數據多樣性與標注質量。

安全性與魯棒性是自動駕駛的核心要求。當VLM在雨雪、霧霾或復雜光照條件下出現識別錯誤時,系統必須迅速評估其不確定性,并及時采取冗余措施。常見做法有利用模型集成(Ensemble)或貝葉斯深度學習(BayesianDL)計算輸出置信度,當置信度低于閾值時,系統退回至傳統多傳感器融合感知結果,或提示駕駛員手動接管。與此同時,跨模態注意力的可解釋性工具能夠幫助在事故復盤時追蹤模型的決策過程,明確模型為何在某一幀圖像中生成特定提示,從而為系統迭代和責任認定提供依據。

隨著大語言模型(LLM)和大視覺模型(LVM)的持續發展,VLM將在多模態融合、知識更新和人機協同方面取得更大突破。系統不僅能處理攝像頭圖像,還會整合雷達、LiDAR和V2X(Vehicle-to-Everything)數據,使得對車輛周邊環境的感知更為全面;同時將實時獲取的交通法規更新、路政公告和氣象預報輸入語言模型,為車輛決策和提示提供最新背景知識;在交互方式上,乘客可通過語音、手勢和觸摸屏多模態聯合輸入,獲取更加自然、有效的行駛建議。

VLA與VLM有何差別?

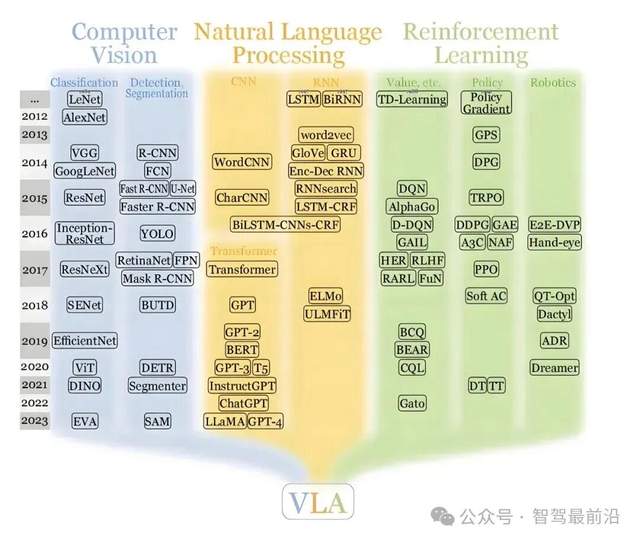

VLA與VLM都是大模型的重要技術,那兩者又有何區別?VLA和VLM雖然都屬于多模態大模型體系,但在模型架構、目標任務、輸出類型和應用場景上其實存在根本差異。VLM主要解決的是圖像與語言之間的關聯問題,其核心能力是對圖像進行語義理解,并通過語言表達這種理解,輸出形式通常是自然語言,例如圖像描述、視覺問答、圖文匹配、圖文生成等,代表任務包括“這張圖里有什么?”“這個圖和這段話是否匹配?”等,廣泛應用于AI助手、搜索引擎、內容生成和信息提取等領域。

VLA則是VLM的進一步擴展,它不僅需要理解圖像中的視覺信息和語言指令,還要將兩者融合后生成可執行的動作決策,輸出不再是文本,而是物理控制信號或動作計劃,例如加速、剎車、轉彎等。因此,VLA模型不僅承擔感知和理解任務,還需要完成行為決策和動作控制,是面向真實世界“感知—認知—執行”閉環系統的關鍵技術,其典型應用包括自動駕駛、機器人導航、智能操作臂等。可以說,VLM是“看懂+說清楚”,而VLA是“看懂+聽懂+做對”,前者更偏向信息理解與表達,后者則更聚焦智能體的自主行為能力和決策執行能力。

最后的話

視覺-語言模型通過將圖像感知與自然語言處理相結合,為自動駕駛系統提供了更豐富、更靈活的語義層面支持。它不僅能幫助車輛“看懂”復雜的道路場景,還能用“看得懂”的自然語言與人類駕駛員或乘客進行高效交互。盡管在模型體積、實時性、數據標注與安全保障等方面仍面臨挑戰,但隨著算法優化、邊緣計算與車聯網技術的不斷進步,VLM定將成為推動智能駕駛進入“感知-理解-決策”一體化時代的關鍵引擎,為未來出行帶來更高的安全性和舒適性。

審核編輯 黃宇

-

自動駕駛

+關注

關注

793文章

14883瀏覽量

179899

發布評論請先 登錄

已有VLM,自動駕駛為什么還要探索VLA?

VLA能解決自動駕駛中的哪些問題?

大模型中常提的快慢思考會對自動駕駛產生什么影響?

自動駕駛上常提的VLA與世界模型有什么區別?

自動駕駛中常提的“專家數據”是個啥?

自動駕駛中常提的ODD是個啥?

自動駕駛中常提的硬件在環是個啥?

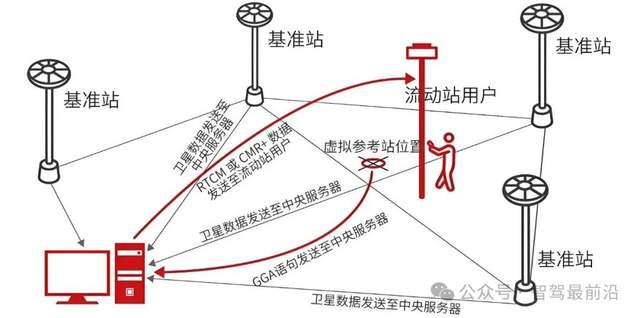

自動駕駛中常提的RTK是個啥?

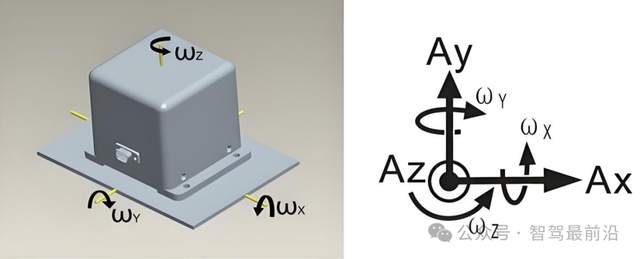

自動駕駛中常提的慣性導航系統是個啥?可以不用嗎?

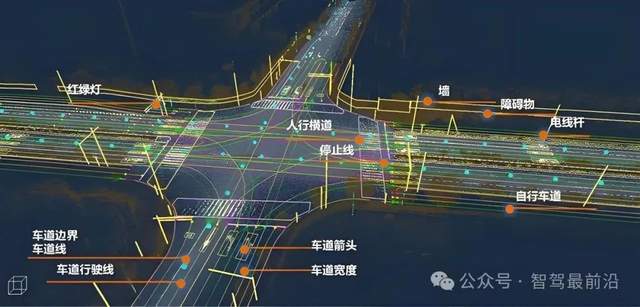

自動駕駛中常提的高精度地圖是個啥?有何審查要求?

自動駕駛中常提的世界模型是個啥?

自動駕駛中常提的HMI是個啥?

自動駕駛中常提的“NOA”是個啥?

自動駕駛中常提的VLM是個啥?與VLA有什么區別?

自動駕駛中常提的VLM是個啥?與VLA有什么區別?

評論