1. 基本概念

大型語言模型(LLM):

大型語言模型是一種基于深度學習的自然語言處理(NLP)技術,它通過訓練大量的文本數據來理解和生成自然語言。這些模型通常具有數十億甚至數千億個參數,能夠捕捉語言的復雜性和多樣性。

傳統機器學習算法:

傳統機器學習算法是指那些不依賴于深度學習的技術,如決策樹、支持向量機(SVM)、隨機森林等。這些算法通常用于解決分類、回歸、聚類等機器學習問題。

2. 工作原理

大型語言模型:

LLM的工作原理基于神經網絡,特別是變換器(Transformer)架構。它們通過自注意力機制(self-attention)來理解文本中的長距離依賴關系。在訓練過程中,模型學習到的參數能夠捕捉語言的統計規律和語義信息。

傳統機器學習算法:

傳統機器學習算法的工作原理各不相同,但它們通常依賴于特征工程和模型選擇。例如,決策樹通過遞歸地分割數據來構建模型,而SVM通過找到最優的超平面來區分不同類別的數據。

3. 訓練數據

大型語言模型:

LLM需要大量的文本數據進行訓練,這些數據可以是書籍、文章、網頁等。訓練數據的質量和多樣性直接影響模型的性能。

傳統機器學習算法:

傳統機器學習算法的訓練數據可以是任何類型的數據,如圖像、音頻、文本等。數據的質量和特征工程的質量對模型性能有重要影響。

4. 應用場景

大型語言模型:

LLM廣泛應用于文本生成、翻譯、問答系統、情感分析等領域。它們能夠理解和生成自然語言,因此在NLP領域有著廣泛的應用。

傳統機器學習算法:

傳統機器學習算法的應用場景非常廣泛,包括圖像識別、語音識別、推薦系統、異常檢測等。它們適用于各種類型的數據和問題。

5. 優缺點

大型語言模型:

- 優點:

- 能夠理解和生成復雜的自然語言。

- 在NLP領域有著廣泛的應用。

- 能夠捕捉語言的統計規律和語義信息。

- 缺點:

- 需要大量的計算資源和訓練數據。

- 模型的解釋性較差。

- 可能存在偏見和歧視問題。

傳統機器學習算法:

- 優點:

- 適用于各種類型的數據和問題。

- 模型的解釋性較好。

- 計算資源需求相對較低。

- 缺點:

- 在處理復雜的自然語言問題時可能不如LLM。

- 對特征工程的依賴性較高。

- 在某些領域可能不如深度學習方法有效。

6. 未來趨勢

隨著技術的發展,LLM和傳統機器學習算法都在不斷地進步。LLM正在變得更加強大和靈活,而傳統機器學習算法也在不斷優化和改進。未來,我們可能會看到這兩種技術在某些領域的融合,以及新的算法和技術的出現。

-

機器學習

+關注

關注

66文章

8554瀏覽量

136996 -

深度學習

+關注

關注

73文章

5599瀏覽量

124418 -

LLM

+關注

關注

1文章

346瀏覽量

1337

發布評論請先 登錄

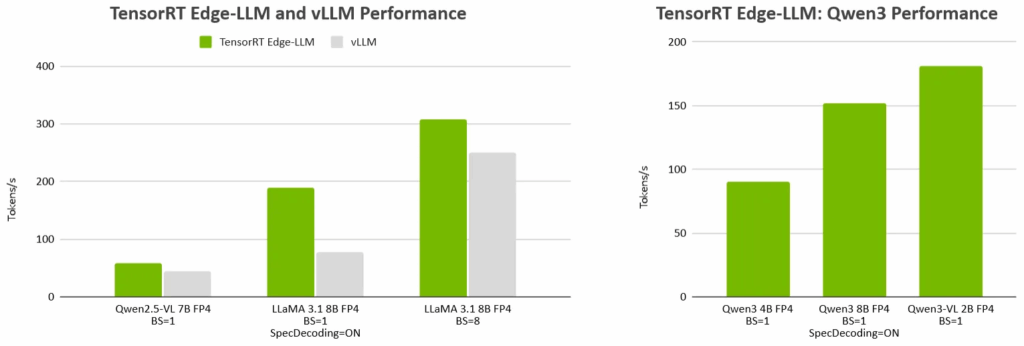

NVIDIA TensorRT Edge-LLM在汽車與機器人行業的落地應用

如何深度學習機器視覺的應用場景

NVIDIA TensorRT LLM 1.0推理框架正式上線

AI 驅動三維逆向:點云降噪算法工具與機器學習建模能力的前沿應用

FPGA在機器學習中的具體應用

如何在魔搭社區使用TensorRT-LLM加速優化Qwen3系列模型推理部署

使用 llm-agent-rag-llamaindex 筆記本時收到的 NPU 錯誤怎么解決?

【「# ROS 2智能機器人開發實踐」閱讀體驗】視覺實現的基礎算法的應用

小白學大模型:從零實現 LLM語言模型

詳解 LLM 推理模型的現狀

十大鮮為人知卻功能強大的機器學習模型

LLM與傳統機器學習算法的區別

LLM與傳統機器學習算法的區別

評論