為了更清晰地學習Pytorch中的激活函數,并對比它們之間的不同,這里對最新版本的Pytorch中的激活函數進行了匯總,主要介紹激活函數的公式、圖像以及使用方法,具體細節可查看官方文檔。

1、ELU

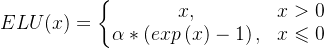

公式:

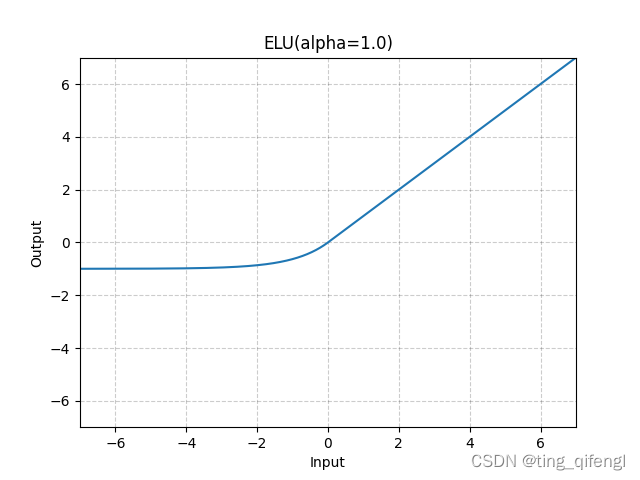

圖像:

示例:

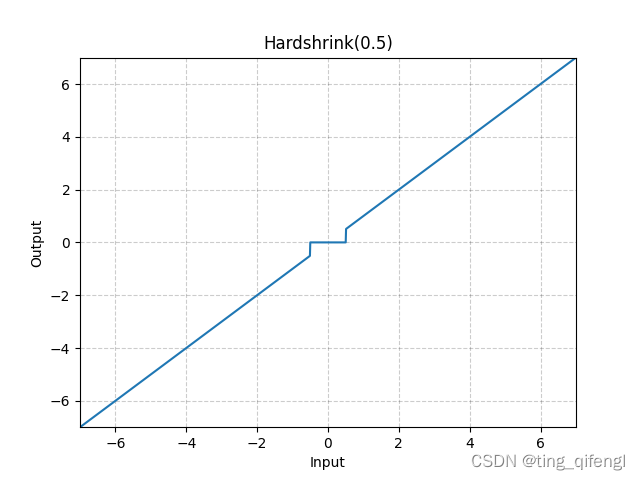

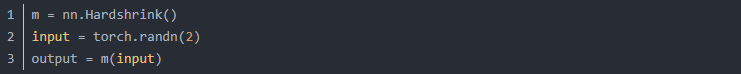

2、Hardshrink

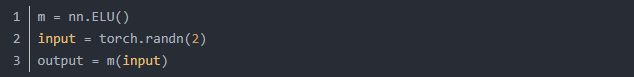

公式:

圖像:

示例:

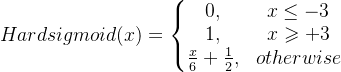

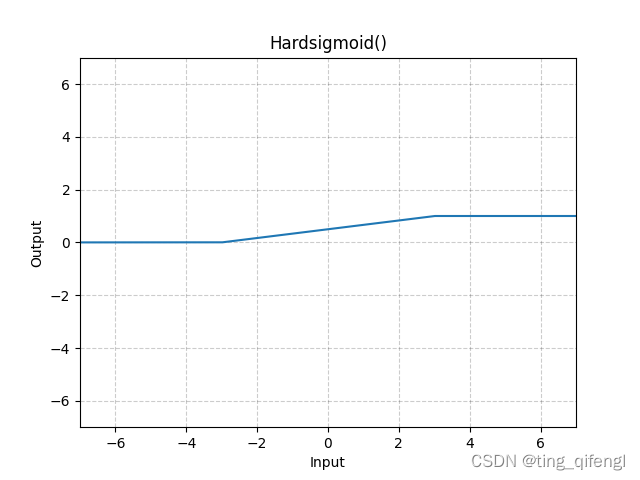

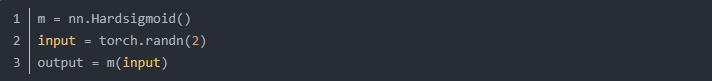

3、Hardsigmoid

公式:

圖像:

示例:

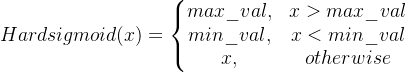

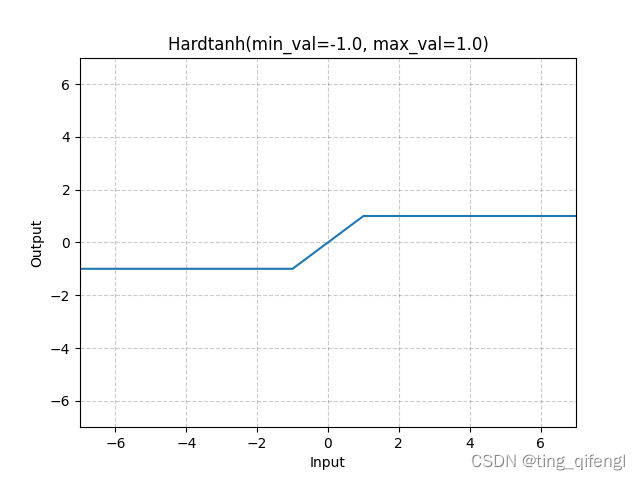

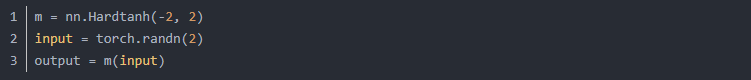

4、Hardtanh

公式:

圖像:

示例:

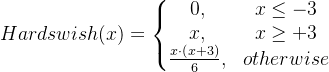

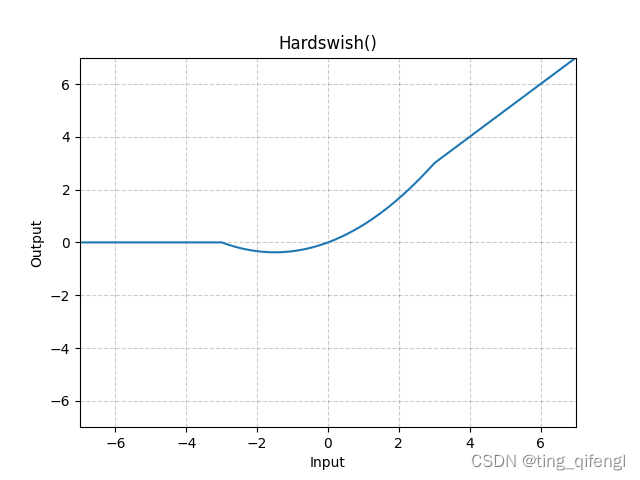

5、Hardswish

公式:

圖像:

示例:

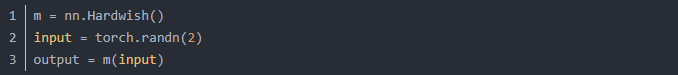

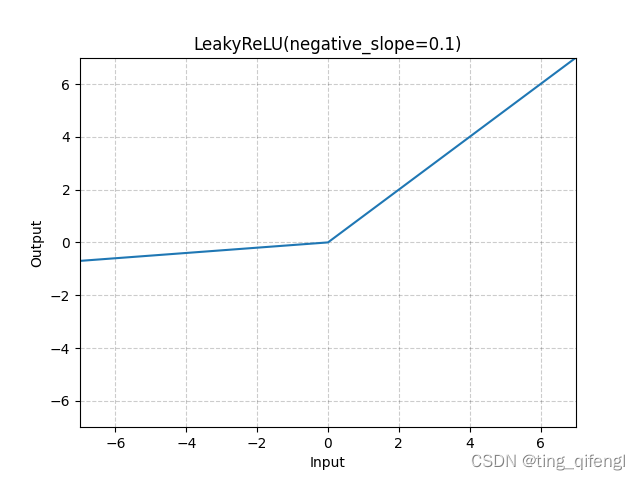

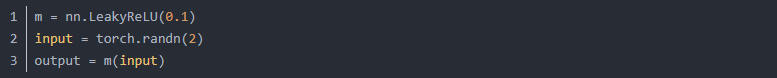

6、LeakyReLU

公式:

圖像:

示例:

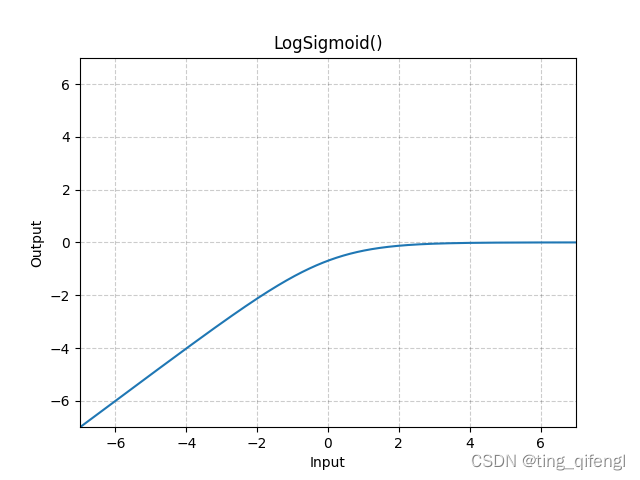

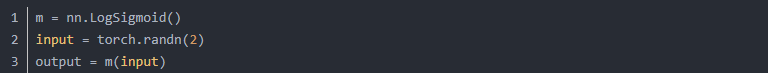

7、LogSigmoid

公式:

圖像:

示例;

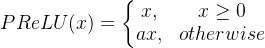

8、PReLU

公式:

其中,a是可學習的參數。

圖像:

示例:

m = nn.PReLU()

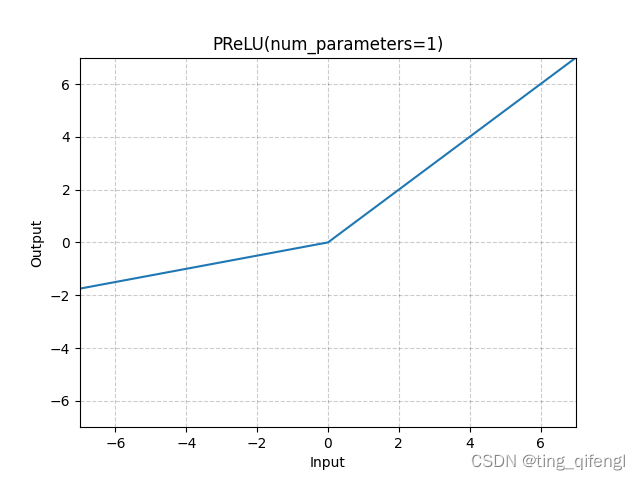

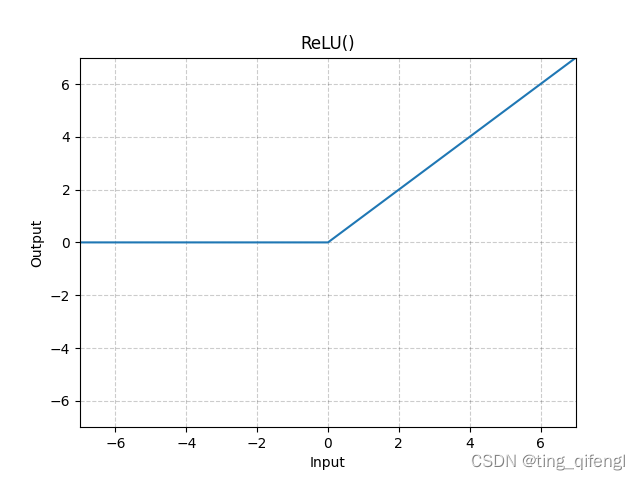

9、ReLU

公式:

圖像:

示例:

m = nn.ReLU()

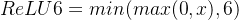

10、ReLU6

公式:

圖像:

示例:

m = nn.ReLU6()

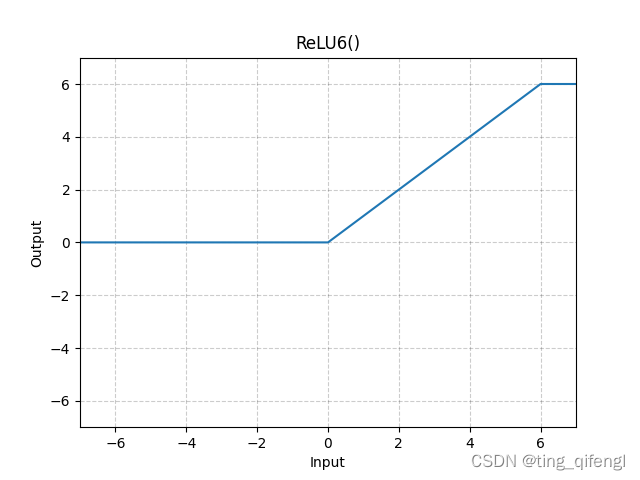

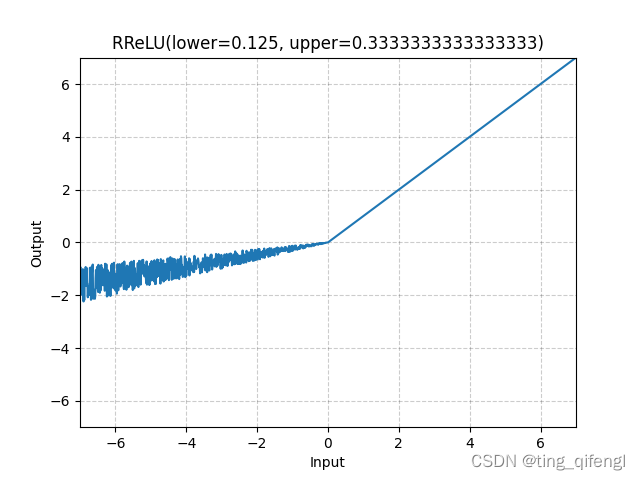

11、RReLU

公式:

其中,a從均勻分布U(lower,upper)隨機采樣得到。

圖像:

示例:

m = nn.RReLU(0.1, 0.3)

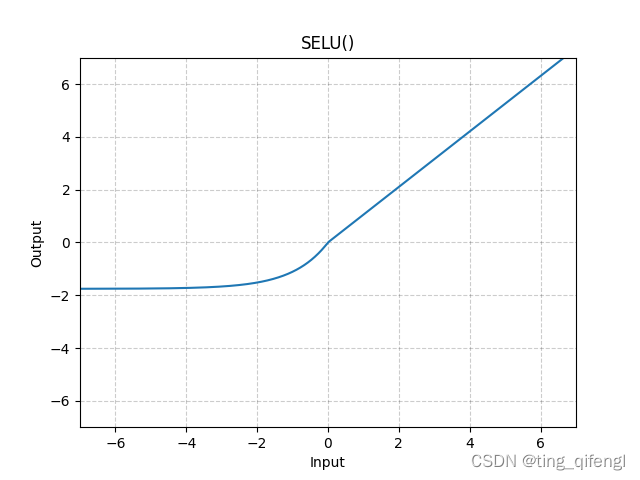

12、SELU

公式:

其中,a=1.6732632423543772848170429916717,scale=1.0507009873554804934193349852946。

圖像:

示例:

m = nn.SELU()

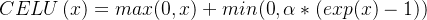

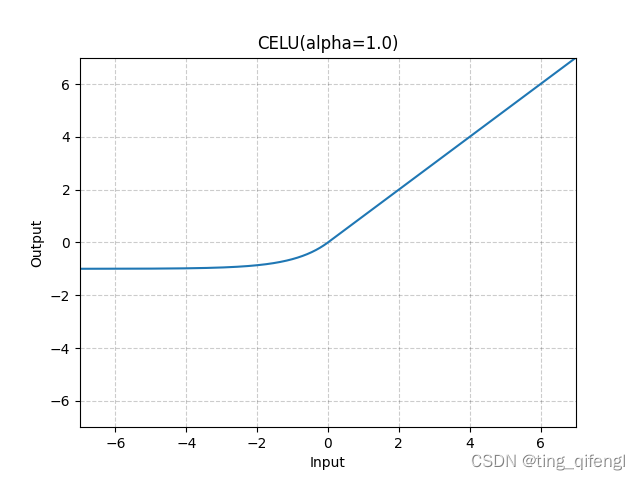

13、CELU

公式:

圖像:

示例:

m = nn.CELU()

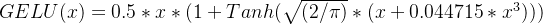

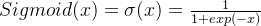

14、GELU

公式:

圖像:

示例:

m = nn.GELU()

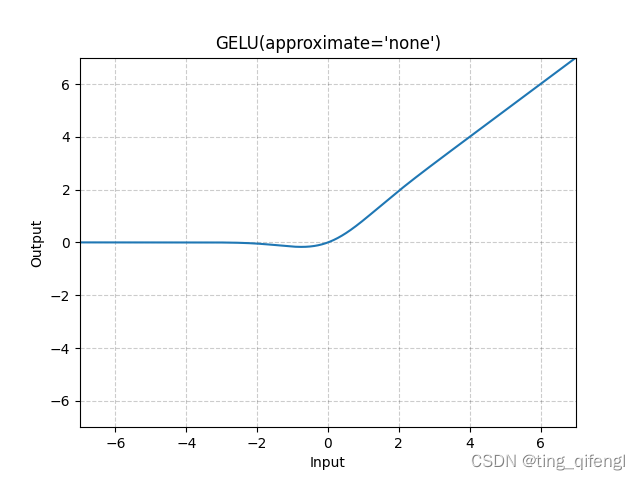

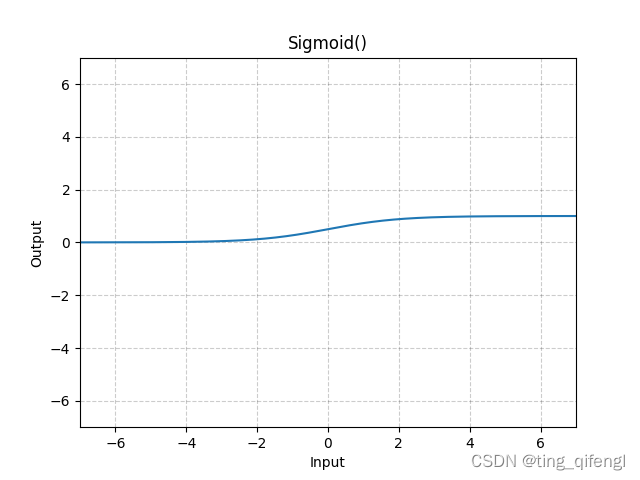

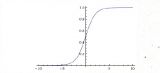

15、Sigmoid

公式:

圖像:

示例:

m = nn. Sigmoid()

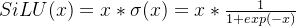

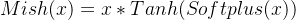

16、SiLU

公式:

圖像:

示例:

m = nn.SiLU()

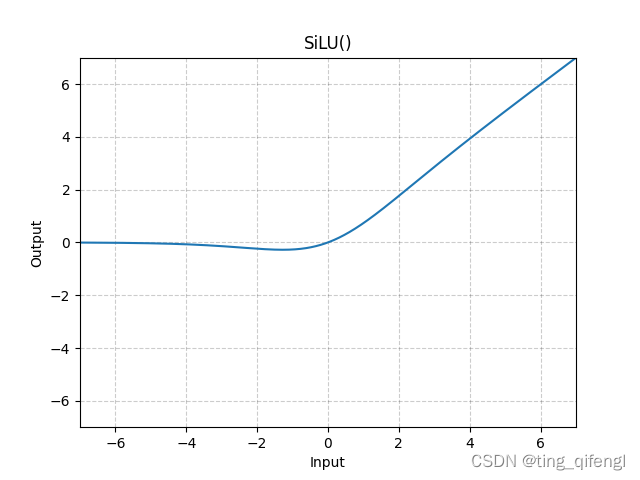

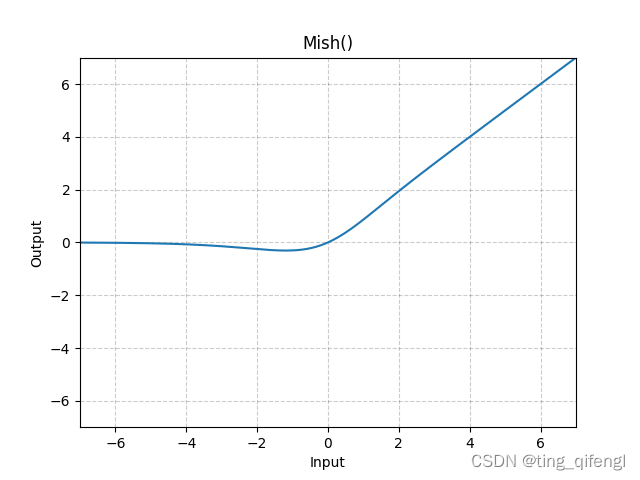

17、Mish

公式:

圖像:

示例:

m = nn.Mish()

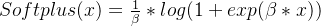

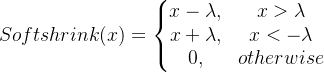

18、Softplus

公式:

對于數值穩定性,當 時,恢復到線性函數。

時,恢復到線性函數。

圖像:

示例:

m = nn.Softplus()

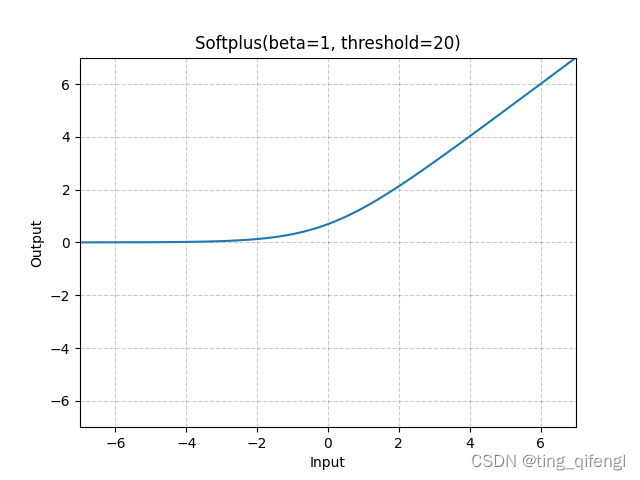

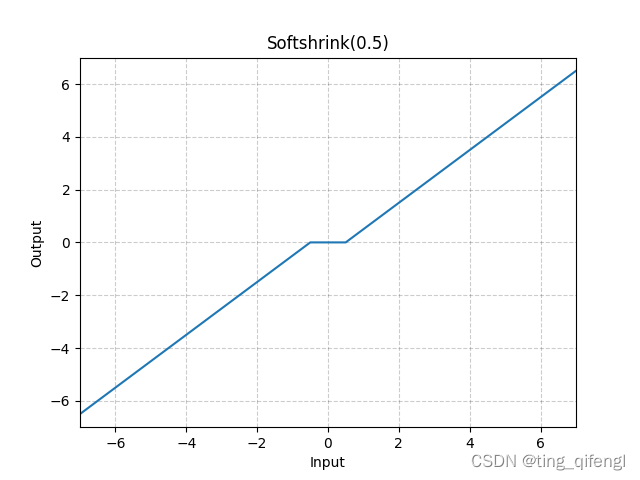

19、Softshrink

公式:

圖像:

示例:

m = nn.Softshrink()

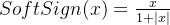

20、Softsign

公式:

圖像:

示例:

m = nn.Softsign()

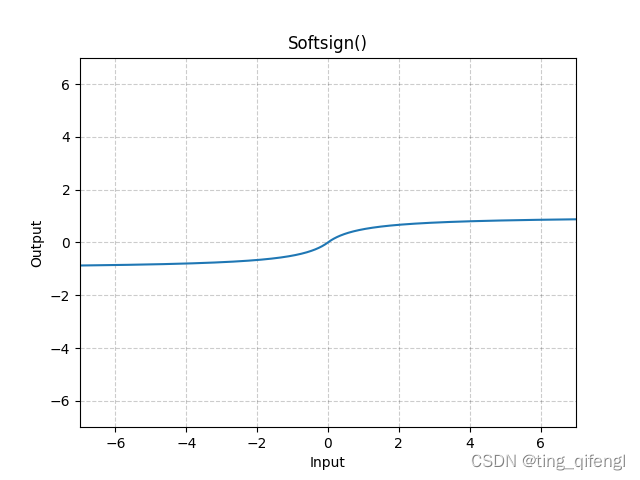

21、Tanh

公式:

圖像:

示例:

m = nn.Tanh()

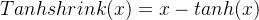

22、Tanhshrink

公式:

圖像:

示例:

m = nn.Tanhshrink()

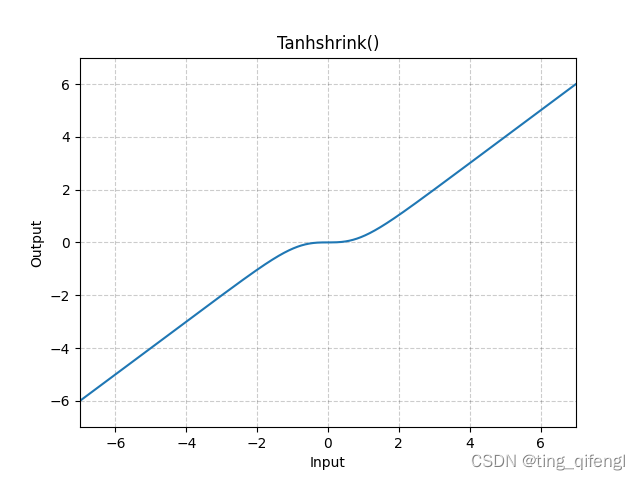

23、Threshold

公式:

示例:

m = nn.Threshold(0.1, 20)

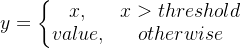

24、GLU

公式:

其中,a是輸入矩陣的前半部分,b是后半部分。

示例:

m = nn.GLU()

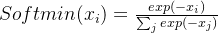

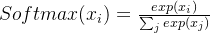

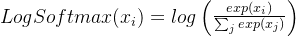

25、Softmin

公式:

示例:

m = nn.Softmin(dim=1)

26、Softmax

公式:

示例:

m = nn.Softmax(dim=1)

27、LogSoftmax

公式:

示例:

m = nn.LogSoftmiax(dim=1)

28、其它

還有MultiheadAttention、Softmax2d、AdaptiveLogSoftmaxWithLoss相對復雜一些沒有添加,可去官網文檔查看.

審核編輯:黃飛

-

函數

+關注

關注

3文章

4419瀏覽量

67736 -

pytorch

+關注

關注

2文章

813瀏覽量

14903

原文標題:Pytorch激活函數最全匯總

文章出處:【微信號:vision263com,微信公眾號:新機器視覺】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

PyTorch中激活函數的全面概覽

PyTorch中激活函數的全面概覽

評論