很高興跟大家分享我們最新的文生圖模型 —— SDXL-Lightning,它實(shí)現(xiàn)了前所未有的速度和質(zhì)量,并且已經(jīng)向社區(qū)開(kāi)放。

閃電般的圖片生成

生成式 AI 正憑借其根據(jù)文本提示(text prompts)創(chuàng)造出驚艷圖像乃至視頻的能力,贏得全球的矚目。當(dāng)前最先進(jìn)的生成模型依賴于擴(kuò)散過(guò)程(diffusion),這是一個(gè)將噪聲逐步轉(zhuǎn)化為圖像樣本的迭代過(guò)程。這個(gè)過(guò)程需要耗費(fèi)巨大的計(jì)算資源并且速度較慢,在生成高質(zhì)量圖像樣本的過(guò)程中,單張圖像的處理時(shí)間約為 5 秒,其中通常需要多次(20 到 40 次)調(diào)用龐大的神經(jīng)網(wǎng)絡(luò)。這樣的速度限制了有快速、實(shí)時(shí)生成需求的應(yīng)用場(chǎng)景。如何在提升生成質(zhì)量的同時(shí)加快速度,是當(dāng)前研究的熱點(diǎn)領(lǐng)域,也是我們工作的核心目標(biāo)。

SDXL-Lightning 通過(guò)一種創(chuàng)新技術(shù)——漸進(jìn)式對(duì)抗蒸餾(Progressive Adversarial Distillation)——突破了這一障礙,實(shí)現(xiàn)了前所未有的生成速度。該模型能夠在短短 2 步或 4 步內(nèi)生成極高質(zhì)量和分辨率的圖像,將計(jì)算成本和時(shí)間降低十倍。我們的方法甚至可以在 1 步內(nèi)為超時(shí)敏感的應(yīng)用生成圖像,雖然可能會(huì)稍微犧牲一些質(zhì)量。

除了速度優(yōu)勢(shì),SDXL-Lightning 在圖像質(zhì)量上也有顯著表現(xiàn),并在評(píng)估中超越了以往的加速技術(shù)。在實(shí)現(xiàn)更高分辨率和更佳細(xì)節(jié)的同時(shí)保持良好的多樣性和圖文匹配度。

速度對(duì)比示意

原始模型(20 步),SDXL-Lightning 模型(2 步)

模型效果

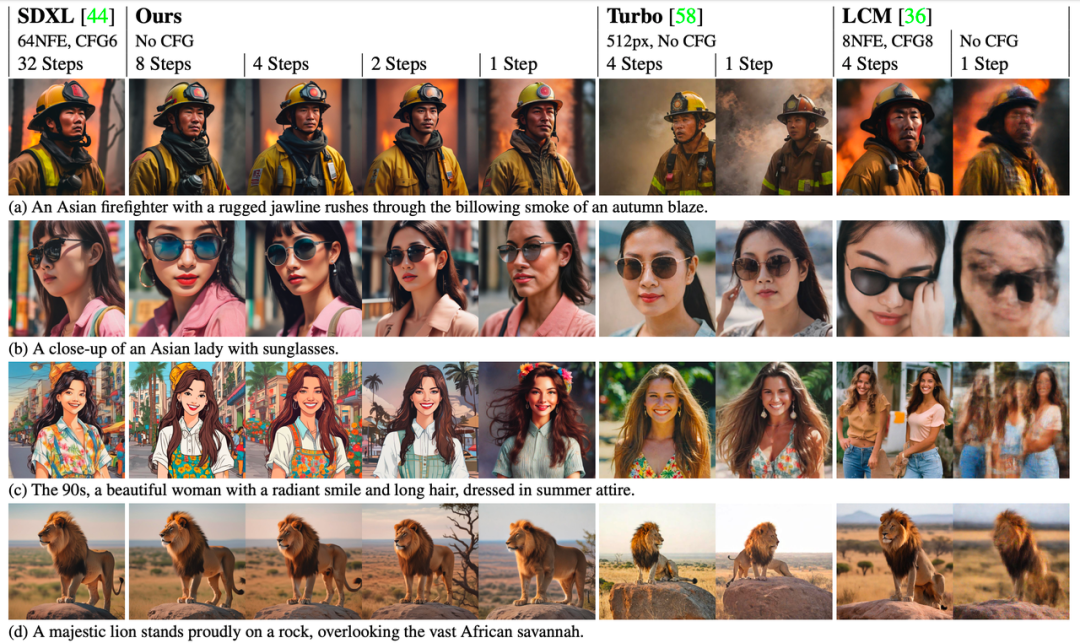

SDXL-Lightning 模型可以通過(guò) 1 步、2 步、4 步和 8 步來(lái)生成圖像。推理步驟越多,圖像質(zhì)量越好。

以下是 4 步生成結(jié)果——

以下是 2 步生成結(jié)果—— 與以前的方法(Turbo 和 LCM)相比,我們的方法生成的圖像在細(xì)節(jié)上有顯著改進(jìn),并且更忠實(shí)于原始生成模型的風(fēng)格和布局。

回饋社區(qū),開(kāi)放模型

開(kāi)源開(kāi)放的浪潮已經(jīng)成為推動(dòng)人工智能迅猛發(fā)展的關(guān)鍵力量,字節(jié)跳動(dòng)也自豪地成為這股浪潮的一部分。我們的模型基于目前最流行的文字生成圖像開(kāi)放模型 SDXL,該模型已經(jīng)擁有一個(gè)繁榮的生態(tài)系統(tǒng)。現(xiàn)在,我們決定將 SDXL-Lightning 開(kāi)放給全球的開(kāi)發(fā)者、研究人員和創(chuàng)意從業(yè)者,以便他們能訪問(wèn)并運(yùn)用這一模型,進(jìn)一步推動(dòng)整個(gè)行業(yè)的創(chuàng)新和協(xié)作。

在設(shè)計(jì) SDXL-Lightning 時(shí),我們就考慮到與開(kāi)放模型社區(qū)的兼容。社區(qū)中已有眾多藝術(shù)家和開(kāi)發(fā)者創(chuàng)建了各種各樣的風(fēng)格化圖像生成模型,例如卡通和動(dòng)漫風(fēng)格等。為了支持這些模型,我們提供 SDXL-Lightning 作為一個(gè)增速插件,它可以無(wú)縫地整合到這些多樣風(fēng)格的 SDXL 模型中,為各種不同模型加快圖像生成的速度。

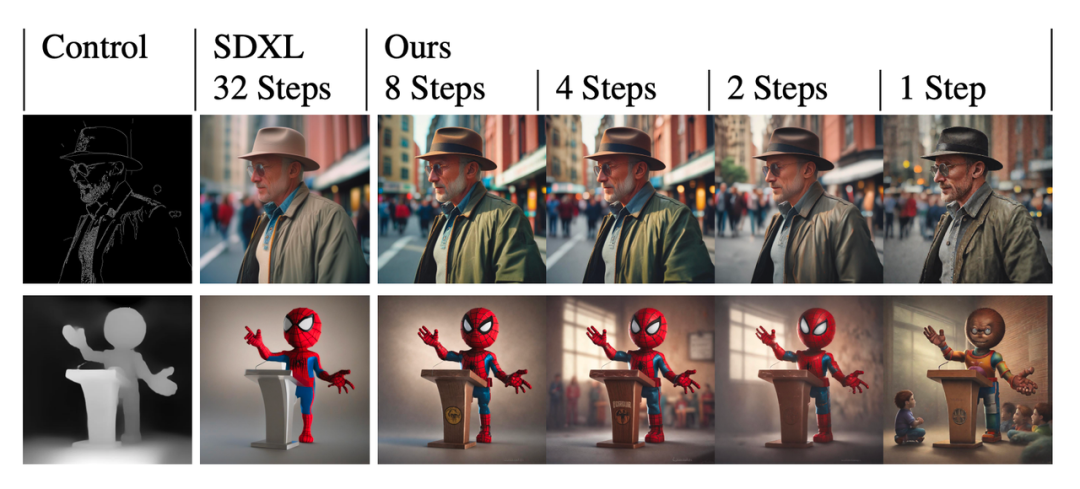

SDXL-Lightning 模型也可以和目前非常流行的控制插件 ControlNet 相結(jié)合,實(shí)現(xiàn)極速可控的圖片生成。

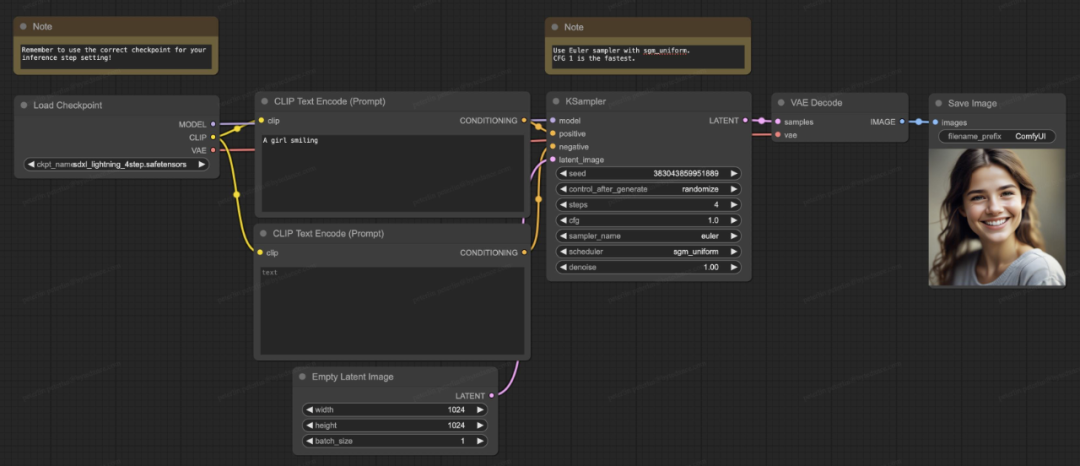

SDXL-Lightning 模型也支持開(kāi)源社區(qū)里目前最流行的生成軟件 ComfyUI,模型可以被直接加載來(lái)使用:

關(guān)于技術(shù)細(xì)節(jié)

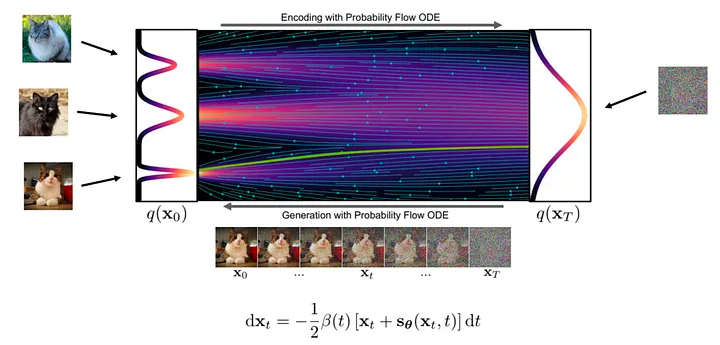

從理論上來(lái)說(shuō),圖像生成是一個(gè)由噪聲到清晰圖像的逐步轉(zhuǎn)化過(guò)程。在這一過(guò)程中,神經(jīng)網(wǎng)絡(luò)學(xué)習(xí)在這個(gè)轉(zhuǎn)化流(flow)中各個(gè)位置上的梯度。

生成圖像的具體步驟是這樣的:

首先我們?cè)诹鞯钠瘘c(diǎn),隨機(jī)采樣一個(gè)噪聲樣本,接著用神經(jīng)網(wǎng)絡(luò)計(jì)算出梯度。根據(jù)當(dāng)前位置上的梯度,我們對(duì)樣本進(jìn)行微小的調(diào)整,然后不斷重復(fù)這一過(guò)程。每一次迭代,樣本都會(huì)更接近最終的圖像分布,直至獲得一張清晰的圖像。

圖:生成流程(來(lái)自:https://arxiv.org/abs/2011.13456)

由于生成流復(fù)雜且非直線,生成過(guò)程必須一次只走一小步以減少梯度誤差累積,所以需要神經(jīng)網(wǎng)絡(luò)的頻繁計(jì)算,這就是計(jì)算量大的原因。

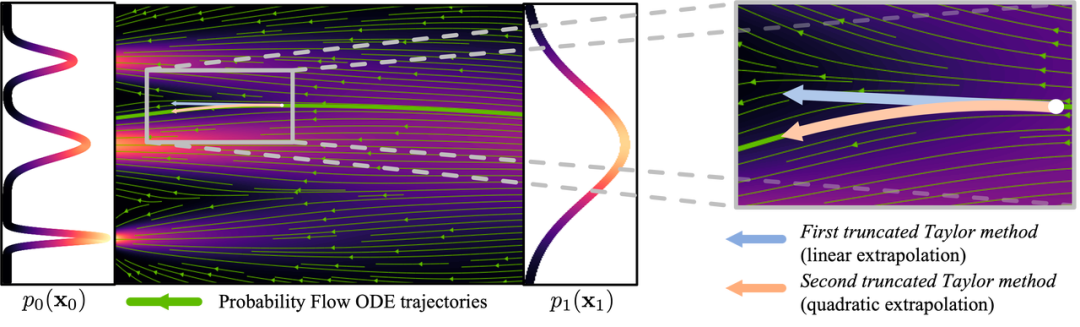

圖:曲線流程(圖片來(lái)自:https://arxiv.org/abs/2210.05475)

為了減少生成圖像所需的步驟數(shù)量,許多研究致力于尋找解決方案。一些研究提出了能減少誤差的采樣方法,而其他研究則試圖使生成流更加直線化。盡管這些方法有所進(jìn)展,但它們?nèi)匀恍枰^(guò) 10 個(gè)推理步驟來(lái)生成圖像。

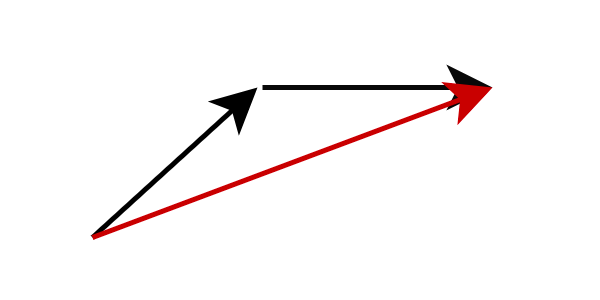

另一種方法是模型蒸餾,它能夠在少于 10 個(gè)推理步驟的情況下生成高質(zhì)量圖像。不同于計(jì)算當(dāng)前流位置下的梯度,模型蒸餾改變模型預(yù)測(cè)的目標(biāo),直接讓其預(yù)測(cè)下一個(gè)更遠(yuǎn)的流位置。具體來(lái)說(shuō),我們訓(xùn)練一個(gè)學(xué)生網(wǎng)絡(luò)直接預(yù)測(cè)老師網(wǎng)絡(luò)完成了多步推理后的結(jié)果。這樣的策略可以大幅減少所需的推理步驟數(shù)量。通過(guò)反復(fù)應(yīng)用這個(gè)過(guò)程,我們可以進(jìn)一步降低推理步驟的數(shù)量。這種方法被先前的研究稱之為漸進(jìn)式蒸餾。

圖:漸進(jìn)式蒸餾,學(xué)生網(wǎng)絡(luò)預(yù)測(cè)老師網(wǎng)絡(luò)多步后的結(jié)果

在實(shí)際操作中,學(xué)生網(wǎng)絡(luò)往往難以精確預(yù)測(cè)未來(lái)的流位置。誤差隨著每一步的累積而放大,導(dǎo)致在少于 8 步推理的情況下,模型產(chǎn)生的圖像開(kāi)始變得模糊不清。

為了解決這個(gè)問(wèn)題,我們的策略是不強(qiáng)求學(xué)生網(wǎng)絡(luò)精確匹配教師網(wǎng)絡(luò)的預(yù)測(cè),而是讓學(xué)生網(wǎng)絡(luò)在概率分布上與教師網(wǎng)絡(luò)保持一致。換言之,學(xué)生網(wǎng)絡(luò)被訓(xùn)練來(lái)預(yù)測(cè)一個(gè)概率上可能的位置,即使這個(gè)位置并不完全準(zhǔn)確,我們也不會(huì)對(duì)它進(jìn)行懲罰。這個(gè)目標(biāo)是通過(guò)對(duì)抗訓(xùn)練來(lái)實(shí)現(xiàn)的,引入了一個(gè)額外的判別網(wǎng)絡(luò)來(lái)幫助實(shí)現(xiàn)學(xué)生網(wǎng)絡(luò)和教師網(wǎng)絡(luò)輸出的分布匹配。

這是我們研究方法的簡(jiǎn)要概述。在技術(shù)論文(https://arxiv.org/abs/2402.13929)中,我們提供了更深入的理論分析、訓(xùn)練策略以及模型的具體公式化細(xì)節(jié)。

SDXL-Lightning 之外

盡管本研究主要探討了如何利用 SDXL-Lightning 技術(shù)進(jìn)行圖像生成,但我們所提出的漸進(jìn)式對(duì)抗蒸餾方法的應(yīng)用潛力不局限于靜態(tài)圖像的范疇。這一創(chuàng)新技術(shù)也可以被運(yùn)用于快速且高質(zhì)量生成視頻、音頻以及其他多模態(tài)內(nèi)容。我們誠(chéng)摯邀請(qǐng)您在 HuggingFace 平臺(tái)上體驗(yàn) SDXL-Lightning,并期待您寶貴的意見(jiàn)和反饋。

審核編輯:劉清

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4839瀏覽量

108051 -

LCM

+關(guān)注

關(guān)注

6文章

60瀏覽量

35524 -

字節(jié)跳動(dòng)

+關(guān)注

關(guān)注

0文章

352瀏覽量

10118 -

生成式AI

+關(guān)注

關(guān)注

0文章

538瀏覽量

1123

原文標(biāo)題:就是“快”!字節(jié)跳動(dòng)發(fā)布文生圖開(kāi)放模型,迅速?zèng)_上Hugging Face Spaces 熱榜

文章出處:【微信號(hào):AI前線,微信公眾號(hào):AI前線】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

NVIDIA Alpamayo 1模型在Hugging Face平臺(tái)下載量已突破10萬(wàn)次

惠倫晶體助力字節(jié)豆包AI眼鏡新體驗(yàn)

NVIDIA在CES 2026發(fā)布全新開(kāi)放模型、數(shù)據(jù)和工具

深入解析NVIDIA Nemotron 3系列開(kāi)放模型

百度文心大模型5.0 Preview榮登LMArena文本榜國(guó)內(nèi)第一

NVIDIA 推出 Nemotron 3 系列開(kāi)放模型

利用NVIDIA Cosmos開(kāi)放世界基礎(chǔ)模型加速物理AI開(kāi)發(fā)

面向科學(xué)仿真的開(kāi)放模型系列NVIDIA Apollo正式發(fā)布

NVIDIA開(kāi)源Audio2Face模型及SDK

中科曙光助力紫東太初4.0大模型重磅發(fā)布

什么是AI模型的推理能力

亞馬遜云科技現(xiàn)已上線OpenAI開(kāi)放權(quán)重模型

4K、多模態(tài)、長(zhǎng)視頻:AI視頻生成的下一個(gè)戰(zhàn)場(chǎng),誰(shuí)在領(lǐng)跑?

【「零基礎(chǔ)開(kāi)發(fā)AI Agent」閱讀體驗(yàn)】+Agent開(kāi)發(fā)平臺(tái)

火山引擎2025“大模型+智能硬件”機(jī)智云特邀研討會(huì)圓滿收官 共繪萬(wàn)物智能產(chǎn)業(yè)藍(lán)圖

字節(jié)跳動(dòng)發(fā)布文生圖開(kāi)放模型,迅速?zèng)_上Hugging Face Spaces熱榜

字節(jié)跳動(dòng)發(fā)布文生圖開(kāi)放模型,迅速?zèng)_上Hugging Face Spaces熱榜

評(píng)論