大模型場景微調(diào)里面,最關(guān)鍵地的一個是問題是:

選擇什么樣的數(shù)據(jù)微調(diào)?

大的方向上大家都能把握,大概無非是要注意數(shù)據(jù)的多樣性,要注意數(shù)據(jù)的質(zhì)量,那在實(shí)踐中有哪些技巧呢?

比如我們會經(jīng)常遇到下面幾種情況:

1.數(shù)據(jù)要不要都去標(biāo)注,標(biāo)的比較慢咋辦?

2.我已經(jīng)有一批標(biāo)好的數(shù)據(jù)了,再去選哪些數(shù)據(jù)送標(biāo)注比較好?

3.能不能總結(jié)出一套數(shù)據(jù)構(gòu)造方面自動化的方法?

其實(shí)在大模型之前,就有很多人研究過這樣的問題。在做一個模型時候,比如簡單的文本分類,我不可能一股腦把所有數(shù)據(jù)都扔給標(biāo)注,這樣干存在一個問題,一般情況下我們數(shù)據(jù)的分布都是符合一個長尾分布的。主要的幾個類別數(shù)據(jù)占據(jù)了90%的數(shù)據(jù)量,剩下的90%的類別只有10%的數(shù)據(jù)量。

比如小紅書上,query的意圖識別里,美食,穿搭,旅游攻略類非常多,但是還有一些同學(xué)去搜大模型微調(diào)的數(shù)據(jù)技巧。

如果說我們直接采樣一批線上的圖文文本,直接送給標(biāo)注的話,會存在一個嚴(yán)重的問題:他們標(biāo)注的數(shù)據(jù)大部分都是攻略類,技術(shù)類比較少,標(biāo)了3個月才攢了幾千條大模型技術(shù)文本,但是攻略類已經(jīng)成幾萬了。

這樣搞肯定是不行的,人力成本方面的消耗是在是太大了,并且模型因?yàn)閿?shù)據(jù)平衡的問題也沒有特別好,我們有沒有辦法去優(yōu)化這個過程呢?

在大模型微調(diào)里面對應(yīng)的生成小紅書文案場景,同樣的問題也是爬來的數(shù)據(jù)就可以直接用嗎?

大家都有個直觀的答案,就是去重,那我們再考慮模型上數(shù)據(jù)的迭代呢?如果數(shù)據(jù)是分階段爬去的怎么辦?已經(jīng)有一批人工處理的的高質(zhì)量數(shù)據(jù)怎么辦?

但其實(shí)從監(jiān)督學(xué)習(xí)的演進(jìn)來看,這套東西其實(shí)已經(jīng)被研究的很多了,用一個技術(shù)名詞叫 “主動學(xué)習(xí)”。

主動學(xué)習(xí)有兩個基本原則,在監(jiān)督訓(xùn)練的時候,注意主動發(fā)現(xiàn)數(shù)據(jù)的兩個方面,一個是數(shù)據(jù)多樣性,另外一個是數(shù)據(jù)的不確定性。這樣講是比較抽象的概念,那我們在大模型實(shí)踐中如何體現(xiàn)呢?

第一,數(shù)據(jù)的多樣性。

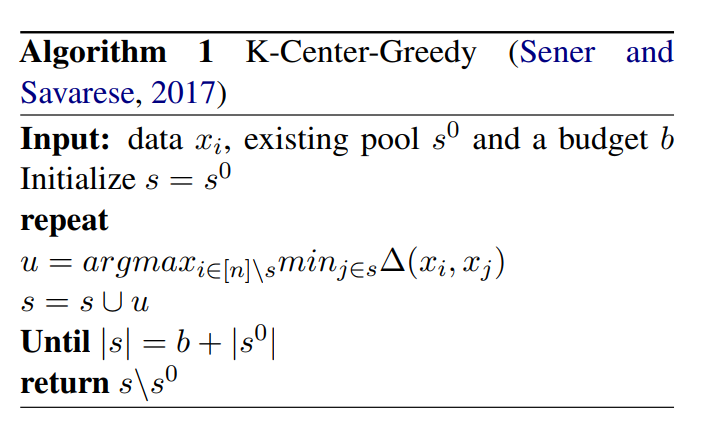

多樣性即為數(shù)據(jù)的去重,去重這件事的核心是相似度度量,現(xiàn)在的相似度度量方法大家用的比較多的是基于對比學(xué)習(xí)構(gòu)造的語義向量這套思路,當(dāng)然簡單的基于詞袋或者tfidf的方案也是可以的。有了核心的相似度度量方法后,我們可以使用簡單的onepass聚類方法進(jìn)行過濾,考慮復(fù)雜一點(diǎn)的話,我們可以使用帶優(yōu)化目標(biāo)的聚類:比如K-Center-Greedy算法,其約束條件是在最大化多樣性的情況下,使指令數(shù)據(jù)集最小。

另外,如果我們已經(jīng)有了一批已經(jīng)去重的人工處理過的高質(zhì)量數(shù)據(jù),那么我們?nèi)绾螌ふ遗c這批數(shù)據(jù)不一樣的數(shù)據(jù)呢?

這里有一個非常簡單實(shí)用的方案,并且這個方案可以用在很多其他的地方。

我們簡單地把已有的數(shù)據(jù)全部當(dāng)成正樣本打上1,然后待篩選的數(shù)據(jù)全部當(dāng)成負(fù)樣本打上0,我們使用deberta等構(gòu)建二分類模型,并進(jìn)行K-fold的交叉驗(yàn)證,在交叉驗(yàn)證過程中,選出每一個fold過程中的測試集合里概率接近于0的樣本。

通過這樣的操作,就能把長得與已有數(shù)據(jù)不一樣的數(shù)據(jù)給選出來了,并且這個過程是半監(jiān)督的。

這套方案也可以用在很多其他地方,比如數(shù)據(jù)質(zhì)量選擇,只要我們有一批已經(jīng)確定標(biāo)簽/結(jié)果/標(biāo)注的種子數(shù)據(jù),就能通過這樣的方法選出與種子數(shù)據(jù)長得比較像的,長得不像的。

第二,數(shù)據(jù)的不確定性。

數(shù)據(jù)的不確定性主要體現(xiàn)數(shù)據(jù)的質(zhì)量篩選上,選取模型學(xué)的不那好的數(shù)據(jù),模型沒有把握的數(shù)據(jù)。

最簡單的,我們可以選出模型對應(yīng)PPL值比較差的那批數(shù)據(jù)。如果是指令數(shù)據(jù)的話,比如大模型做題和對應(yīng)的答案。我們可以把所有選項(xiàng)對應(yīng)的概率之和計(jì)算出來,然后過濾出概率和比較低的那一批數(shù)據(jù),這批數(shù)據(jù)就是模型“不太肯定”的樣本,我們需要加強(qiáng)針對性的訓(xùn)練。

當(dāng)然這樣可能有一個副作用,就是這批數(shù)據(jù)是質(zhì)量比較差而不是模型學(xué)的不太好的。

為此,我們還要借助reward model,這個reward model是廣義的,他是一個質(zhì)量的二分類模型。可以祭出我們的deberta,繼續(xù)用標(biāo)注數(shù)據(jù)進(jìn)行做二分類,進(jìn)行數(shù)據(jù)質(zhì)量的判斷。

有了質(zhì)量打分模型后,我們就可以判斷一些指令數(shù)據(jù)的質(zhì)量高低,并且據(jù)此選出模型真正不確定的數(shù)據(jù)。

這個過程類似于手動的拒絕采樣,核心是選擇“模型不確定”+“數(shù)據(jù)質(zhì)量達(dá)標(biāo)”的那部分?jǐn)?shù)據(jù)。

總結(jié)一下,監(jiān)督學(xué)習(xí)中主動學(xué)習(xí)的兩個基本原則是尋找多樣性的數(shù)據(jù),模型不確定性的數(shù)據(jù),在尋找的過程中,我們使用了一些小技巧,比如聚類去重,對抗半監(jiān)督過濾,自建reward二分類等方法。這幾個小技巧,學(xué)術(shù)上沒有什么高深莫測的東西,都是實(shí)踐中總結(jié)出來的好用的方法。

并且你把上面的過程串聯(lián)起來,其實(shí)就是一套高效率,低成本的數(shù)據(jù)構(gòu)造pipeline了,不僅可以用在大模型的數(shù)據(jù)選擇和構(gòu)造,在所有的監(jiān)督學(xué)習(xí)上,這套思路和方法都是實(shí)適用的。

審核編輯:黃飛

-

半監(jiān)督學(xué)習(xí)

+關(guān)注

關(guān)注

0文章

20瀏覽量

2746 -

大模型

+關(guān)注

關(guān)注

2文章

3650瀏覽量

5183

原文標(biāo)題:大模型微調(diào)數(shù)據(jù)選擇和構(gòu)造技巧

文章出處:【微信號:zenRRan,微信公眾號:深度學(xué)習(xí)自然語言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

亞馬遜云科技擴(kuò)展模型選擇 Amazon Bedrock新增18款開放權(quán)重模型

在以下嵌入式軟件設(shè)計(jì)模型中,屬于數(shù)據(jù)流模型的是,哪里有設(shè)計(jì)模型的介紹?

Vishay Sfernice TS7密封型表面貼裝微調(diào)電位器技術(shù)解析

Vishay Sfernice M61系列金屬陶瓷微調(diào)電位器技術(shù)解析

LLM安全新威脅:為什么幾百個毒樣本就能破壞整個模型

如何在vivadoHLS中使用.TLite模型

NVMe高速傳輸之?dāng)[脫XDMA設(shè)計(jì)27: 橋設(shè)備模型設(shè)計(jì)

Cognizant加速AI模型企業(yè)級開發(fā)

千方科技推出AI大模型公路構(gòu)造物評定系統(tǒng)

明晚開播 |數(shù)據(jù)智能系列講座第7期:面向高泛化能力的視覺感知系統(tǒng)空間建模與微調(diào)學(xué)習(xí)

數(shù)據(jù)標(biāo)注服務(wù)—奠定大模型訓(xùn)練的數(shù)據(jù)基石

標(biāo)貝數(shù)據(jù)標(biāo)注服務(wù):奠定大模型訓(xùn)練的數(shù)據(jù)基石

大模型微調(diào)數(shù)據(jù)選擇和構(gòu)造技巧

大模型微調(diào)數(shù)據(jù)選擇和構(gòu)造技巧

評論