考慮到基于 Transformer 的預(yù)測器的爭議,研究者們正在思考為什么 Transformer 在時(shí)間序列預(yù)測中的表現(xiàn)甚至不如線性模型,而在許多其他領(lǐng)域卻發(fā)揮著主導(dǎo)作用。

近日,來自清華大學(xué)的一篇新論文提出了一個(gè)不同的視角 ——Transformer 的性能不是固有的,而是由于將架構(gòu)不當(dāng)?shù)貞?yīng)用于時(shí)間序列數(shù)據(jù)造成的。

論文地址:https://arxiv.org/pdf/2310.06625.pdf

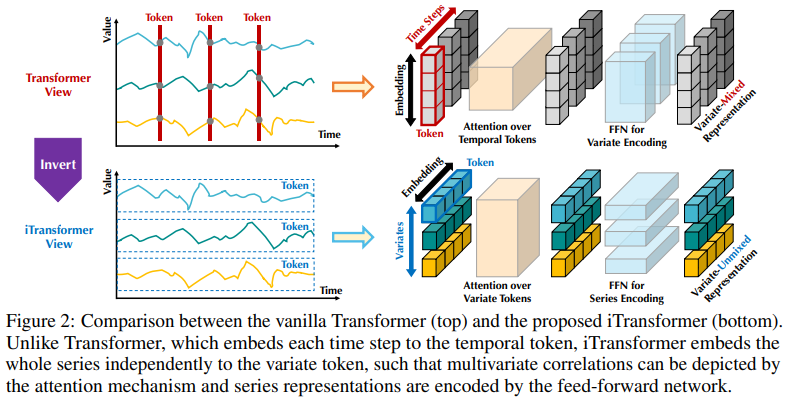

基于 Transformer 的預(yù)測器的現(xiàn)有結(jié)構(gòu)可能并不適合多變量時(shí)間序列預(yù)測。如圖 2 左側(cè)所示,同一時(shí)間步長的點(diǎn)基本上代表了完全不同的物理意義,但測量結(jié)果卻不一致,這些點(diǎn)被嵌入到一個(gè) token 中,多變量相關(guān)性被抹去。而且,在現(xiàn)實(shí)世界中,由于多變量時(shí)間點(diǎn)的局部感受野和時(shí)間戳不對齊,單個(gè)時(shí)間步形成的標(biāo)記很難揭示有益信息。此外,雖然序列變化會受到序列順序的極大影響,但在時(shí)間維度上卻沒有適當(dāng)?shù)夭捎米凅w注意力機(jī)制。因此,Transformer 在捕捉基本序列表征和描繪多元相關(guān)性方面的能力被削弱,限制了其在不同時(shí)間序列數(shù)據(jù)上的能力和泛化能力。

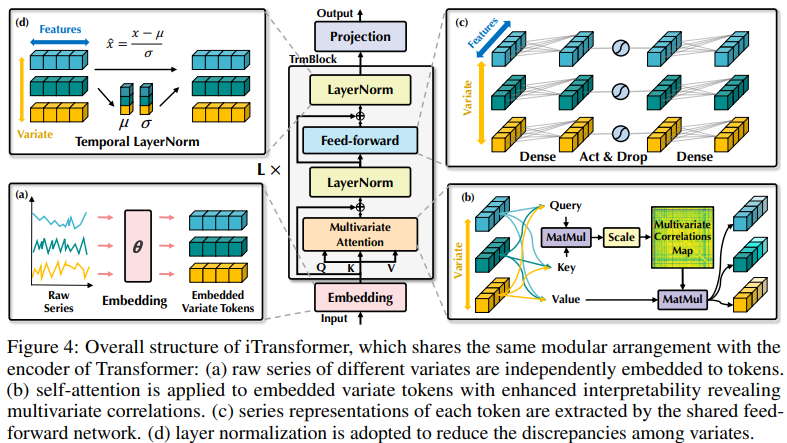

關(guān)于將每個(gè)時(shí)間步的多變量點(diǎn)嵌入一個(gè)(時(shí)間)token 的不合理性,研究者從時(shí)間序列的反向視角出發(fā),將每個(gè)變量的整個(gè)時(shí)間序列獨(dú)立嵌入一個(gè)(變量)token,這是擴(kuò)大局部感受野的 patching 的極端情況。通過倒置,嵌入的 token 聚集了序列的全局表征,可以更加以變量為中心,更好地利用注意力機(jī)制進(jìn)行多變量關(guān)聯(lián)。同時(shí),前饋網(wǎng)絡(luò)可以熟練地學(xué)習(xí)任意回溯序列編碼的不同變量的泛化表征,并解碼以預(yù)測未來序列。

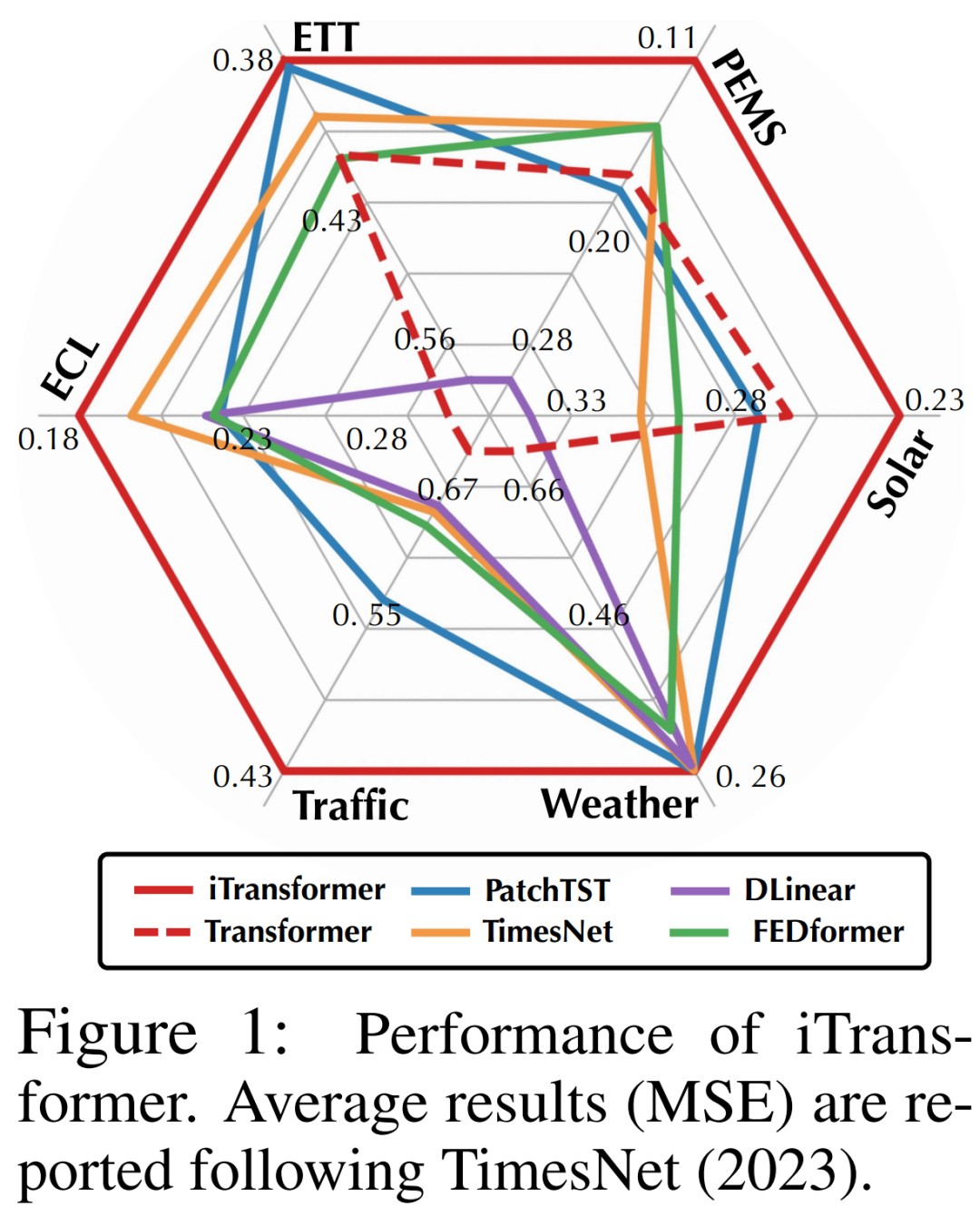

研究者認(rèn)為 Transformer 對時(shí)間序列預(yù)測并非無效,而是使用不當(dāng)。在文中,研究者重新審視了 Transformer 的結(jié)構(gòu),并提倡將 iTransformer 作為時(shí)間序列預(yù)測的基本支柱。他們將每個(gè)時(shí)間序列嵌入為變量 token,采用多變量相關(guān)性關(guān)注,并使用前饋網(wǎng)絡(luò)進(jìn)行序列編碼。實(shí)驗(yàn)結(jié)果表明,本文所提出的 iTransformer 在圖 1 所示的實(shí)際預(yù)測基準(zhǔn)上達(dá)到了 SOTA 水準(zhǔn),并出人意料地解決了基于 Transformer 的預(yù)測器的痛點(diǎn)。

總結(jié)來說,本文的貢獻(xiàn)有以下三點(diǎn):

-

研究者對 Transformer 的架構(gòu)進(jìn)行了反思,發(fā)現(xiàn)原生 Transformer 組件在時(shí)間序列上的能力尚未得到充分開發(fā)。

-

本文提出的 iTransformer 將獨(dú)立時(shí)間序列視為 token,通過自注意力捕捉多變量相關(guān)性,并利用層歸一化和前饋網(wǎng)絡(luò)模塊學(xué)習(xí)更好的序列全局表示法,用于時(shí)間序列預(yù)測。

-

通過實(shí)驗(yàn),iTransformer 在真實(shí)世界的預(yù)測基準(zhǔn)上達(dá)到了 SOTA。研究者分析了反轉(zhuǎn)模塊和架構(gòu)選擇,為未來改進(jìn)基于 Transformer 的預(yù)測器指明了方向。

iTransformer

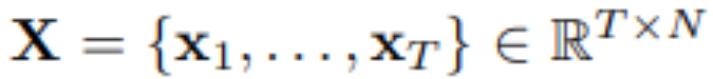

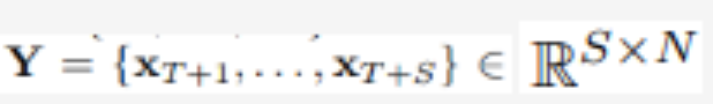

在多變量時(shí)間序列預(yù)測中,給定歷史觀測:

用 T 個(gè)時(shí)間步長和 N 個(gè)變量,研究者預(yù)測未來的 S 個(gè)時(shí)間步長: 。為方便起見,表示為

。為方便起見,表示為 為時(shí)間步 t 同時(shí)記錄的多元變量,

為時(shí)間步 t 同時(shí)記錄的多元變量, 為每個(gè)變量由 n 索引的整個(gè)時(shí)間序列。值得注意的是,在現(xiàn)實(shí)世界中,由于監(jiān)視器的系統(tǒng)延遲和松散組織的數(shù)據(jù)集,

為每個(gè)變量由 n 索引的整個(gè)時(shí)間序列。值得注意的是,在現(xiàn)實(shí)世界中,由于監(jiān)視器的系統(tǒng)延遲和松散組織的數(shù)據(jù)集, 可能不包含本質(zhì)上相同時(shí)間戳的時(shí)間點(diǎn)。

可能不包含本質(zhì)上相同時(shí)間戳的時(shí)間點(diǎn)。

的元素可以在物理測量和統(tǒng)計(jì)分布中彼此不同,變量

的元素可以在物理測量和統(tǒng)計(jì)分布中彼此不同,變量 通常共享這些數(shù)據(jù)。

通常共享這些數(shù)據(jù)。

本文所提出架構(gòu)配備的 Transformer 變體,稱為 iTransformer,基本上沒有對 Transformer 變體提出更具體的要求,只是注意力機(jī)制應(yīng)適用于多元相關(guān)性建模。因此,一組有效的注意力機(jī)制可以作為插件,降低變量數(shù)量增加時(shí)關(guān)聯(lián)的復(fù)雜性。

圖 4 中所示的 iTransformer 利用了更簡單的 Transformer 純編碼器架構(gòu),包括嵌入、投影和 Transformer 塊。

實(shí)驗(yàn)及結(jié)果

研究者在各種時(shí)間序列預(yù)測應(yīng)用中對所提出的 iTransformer 進(jìn)行了全面評估,驗(yàn)證了所提出框架的通用性,并進(jìn)一步深入研究了針對特定時(shí)間序列維度反轉(zhuǎn) Transformer 組件職責(zé)的效果。

研究者在實(shí)驗(yàn)中廣泛納入了 6 個(gè)真實(shí)世界數(shù)據(jù)集,包括 Autoformer 使用的 ETT、天氣、電力、交通數(shù)據(jù)集、LST5 Net 提出的太陽能數(shù)據(jù)集以及 SCINet 評估的 PEMS 數(shù)據(jù)集。更多關(guān)于數(shù)據(jù)集的信息,請閱讀原文。

預(yù)測結(jié)果

如表 1 所示,用紅色表示最優(yōu),下劃線表示最優(yōu)。MSE/MAE 越低,預(yù)測結(jié)果越準(zhǔn)確。本文所提出的 iTransformer 實(shí)現(xiàn)了 SOTA 性能。原生 Transformer 組件可以勝任時(shí)間建模和多元關(guān)聯(lián),所提出的倒排架構(gòu)可以有效解決現(xiàn)實(shí)世界的時(shí)間序列預(yù)測場景。

iTransformer 通用性

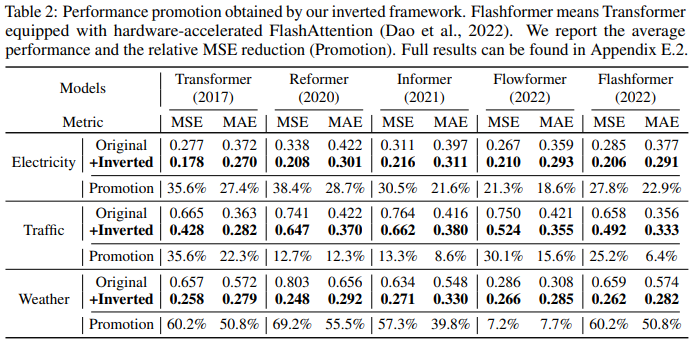

研究者將該框架應(yīng)用于 Transformer 及其變體來評估 iTransformers,這些變體通常解決了 self-attention 機(jī)制的二次復(fù)雜性問題,包括 Reformer、Informer、Flowformer 和 FlashAttention。研究者發(fā)現(xiàn)了簡單的倒置視角可以提高基于 Transformer 的預(yù)測器的性能,從而提高效率、泛化未見變量并更好地利用歷史觀測數(shù)據(jù)。

表 2 對 Transformers 和相應(yīng)的 iTransformers 進(jìn)行了評估。值得注意的是,該框架持續(xù)改進(jìn)了各種 Transformer。總體而言,Transformer 平均提升了 38.9%,Reformer 平均提升了 36.1%,Informer 平均提升了 28.5%,F(xiàn)lowformer 平均提升了 16.8%,F(xiàn)lashformer 平均提升了 32.2%。

此外,由于倒置結(jié)構(gòu)在變量維度上采用了注意力機(jī)制,因此引入具有線性復(fù)雜性的高效注意力從根本上解決了因 6 個(gè)變量而產(chǎn)生的效率問題,這一問題在現(xiàn)實(shí)世界的應(yīng)用中十分普遍,但對于 Channel Independent 來說可能會消耗資源。因此,iTransformer 可廣泛應(yīng)用于基于 Transformer 的預(yù)測器。

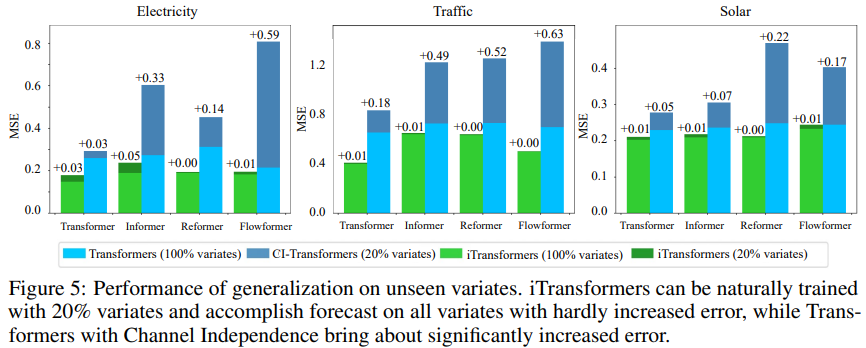

為了驗(yàn)證假設(shè),研究者將 iTransformer 與另一種泛化策略進(jìn)行了比較:Channel Independent 強(qiáng)制采用一個(gè)共享 Transformer 來學(xué)習(xí)所有變體的模式。如圖 5 所示, Channel Independent(CI-Transformers)的泛化誤差可能會大幅增加,而 iTransformer 預(yù)測誤差的增幅要小得多。

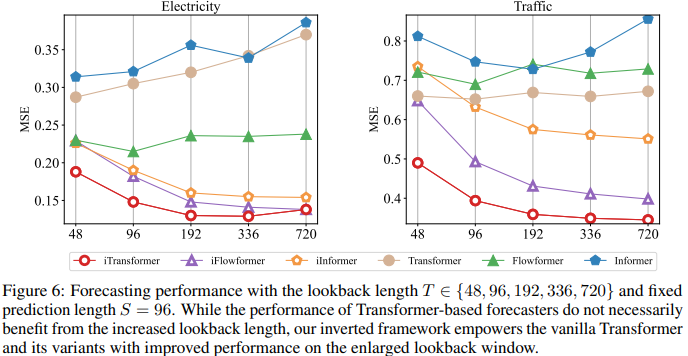

由于注意力和前饋網(wǎng)絡(luò)的職責(zé)是倒置的,圖 6 中評估了隨著回視長度的增加,Transformers 和 iTransformer 的性能。它驗(yàn)證了在時(shí)間維度上利用 MLP 的合理性,即 Transformers 可以從延長的回視窗口中獲益,從而獲得更精確的預(yù)測。

模型分析

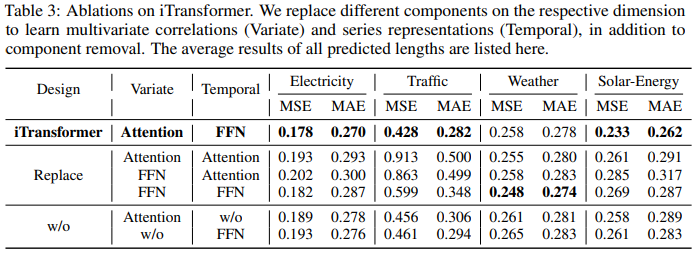

為了驗(yàn)證 Transformer 組件的合理性,研究者進(jìn)行了詳細(xì)的消融實(shí)驗(yàn),包括替換組件(Replace)和移除組件(w/o)實(shí)驗(yàn)。表 3 列出了實(shí)驗(yàn)結(jié)果。

更多詳細(xì)內(nèi)容,請參考原文。

原文標(biāo)題:重新審視Transformer:倒置更有效,真實(shí)世界預(yù)測的新SOTA出現(xiàn)了

文章出處:【微信公眾號:智能感知與物聯(lián)網(wǎng)技術(shù)研究所】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

-

物聯(lián)網(wǎng)

+關(guān)注

關(guān)注

2945文章

47820瀏覽量

415025

原文標(biāo)題:重新審視Transformer:倒置更有效,真實(shí)世界預(yù)測的新SOTA出現(xiàn)了

文章出處:【微信號:tyutcsplab,微信公眾號:智能感知與物聯(lián)網(wǎng)技術(shù)研究所】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

Transformer 入門:從零理解 AI 大模型的核心原理

Transformer如何讓自動駕駛大模型獲得思考能力?

誰更有效?解碼焊球剪切與鍵合點(diǎn)拉力測試的真實(shí)對比

從數(shù)據(jù)到模型:如何預(yù)測細(xì)節(jié)距鍵合的剪切力?

世界模型是讓自動駕駛汽車?yán)斫?b class='flag-5'>世界還是預(yù)測未來?

Transformer如何讓自動駕駛變得更聰明?

【書籍評測活動NO.66】玩轉(zhuǎn)高速電路:基于ANSYS HFSS的無源仿真實(shí)例

基于全局預(yù)測歷史的gshare分支預(yù)測器的實(shí)現(xiàn)細(xì)節(jié)

AURIX tc367通過 MCU SOTA 更新邏輯 IC 閃存是否可行?

求助,關(guān)于TC387使能以及配置SOTA 中一些問題求解

Transformer架構(gòu)中編碼器的工作流程

Transformer架構(gòu)概述

CYPD3177 PD在正常運(yùn)行期間重新初始化怎么解決?

是時(shí)候重新審視“小米模式”了

重新審視Transformer:倒置更有效,真實(shí)世界預(yù)測的新SOTA出現(xiàn)了

重新審視Transformer:倒置更有效,真實(shí)世界預(yù)測的新SOTA出現(xiàn)了

評論