【導(dǎo)讀】工具學(xué)習(xí)的開源時(shí)代來了!

人類具有創(chuàng)造和利用工具的能力,使得我們可以突破身體的限制,探索更廣闊的世界。

人工智能基礎(chǔ)模型也類似,如果僅靠訓(xùn)練階段得到的權(quán)重,使用場(chǎng)景就會(huì)非常受限,而最近提出的工具學(xué)習(xí)(tool learning),將特定領(lǐng)域的專用工具與大規(guī)模基礎(chǔ)模型相結(jié)合,可以實(shí)現(xiàn)更高的效率、性能。

不過目前工具學(xué)習(xí)的相關(guān)研究還不夠深入,也缺乏相關(guān)的開源數(shù)據(jù)和代碼。

最近,清華大學(xué)自然語言處理實(shí)驗(yàn)室等支持的開源社區(qū)OpenBMB (Open Lab for Big Model Base)發(fā)布了ToolBench項(xiàng)目,可以幫助開發(fā)者構(gòu)建開源、大規(guī)模、高質(zhì)量的指令調(diào)優(yōu)數(shù)據(jù),促進(jìn)構(gòu)建具有通用工具使用能力的大型語言模型。

倉(cāng)庫鏈接:https://github.com/OpenBMB/ToolBench

ToolBench倉(cāng)庫中提供了相關(guān)數(shù)據(jù)集、訓(xùn)練和評(píng)估腳本,以及在ToolBench上微調(diào)的功能模型ToolLLaMA,具體特點(diǎn)為:

1. 支持單工具和多工具方案

其中單工具設(shè)置遵循LangChain提示風(fēng)格,多工具設(shè)置遵循AutoGPT的提示風(fēng)格。

2. 模型回復(fù)不僅包括最終答案,還包含模型的思維鏈過程、工具執(zhí)行和工具執(zhí)行結(jié)果

3. 支持真實(shí)世界級(jí)別的復(fù)雜性,支持多步工具調(diào)用

4. 豐富的API,可用于現(xiàn)實(shí)世界中的場(chǎng)景,如天氣信息、搜索、股票更新和PowerPoint自動(dòng)化

5. 所有的數(shù)據(jù)都是由OpenAI API自動(dòng)生成并由開發(fā)團(tuán)隊(duì)進(jìn)行過濾,數(shù)據(jù)的創(chuàng)建過程很容易擴(kuò)展

不過需要注意的是,目前發(fā)布的數(shù)據(jù)還不是最終版本,研究人員仍然在對(duì)數(shù)據(jù)進(jìn)行后處理來提高數(shù)據(jù)質(zhì)量,并增加真實(shí)世界工具的覆蓋范圍。

ToolBench

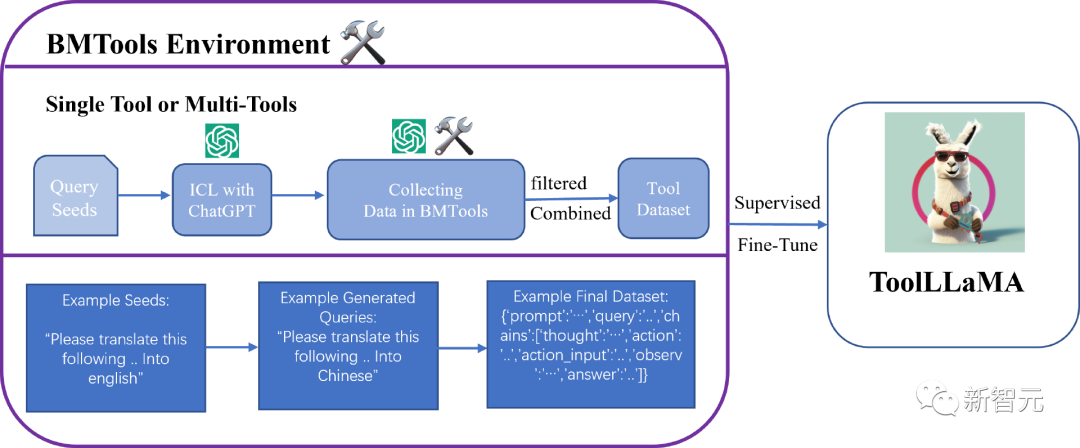

ToolBench的總體思路是基于BMTools,在有監(jiān)督數(shù)據(jù)中訓(xùn)練大型語言模型。

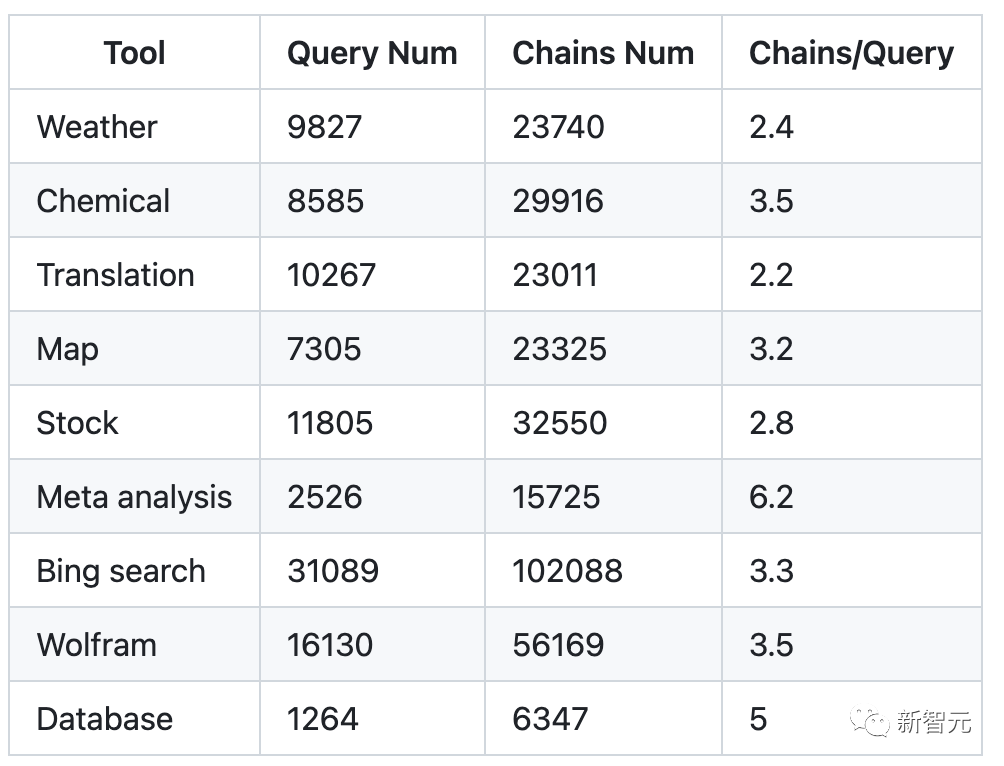

倉(cāng)庫中包含31.2萬次真實(shí)API調(diào)用得到的9800條數(shù)據(jù),涵蓋單工具場(chǎng)景和多工具場(chǎng)景,下面是單工具的統(tǒng)計(jì)信息。

其中每行數(shù)據(jù)都是一個(gè)json dict,包含數(shù)據(jù)創(chuàng)建的提示模板、工具使用的人工指令(查詢)、中間思維/工具執(zhí)行循環(huán)和最終答案。

模型實(shí)驗(yàn)

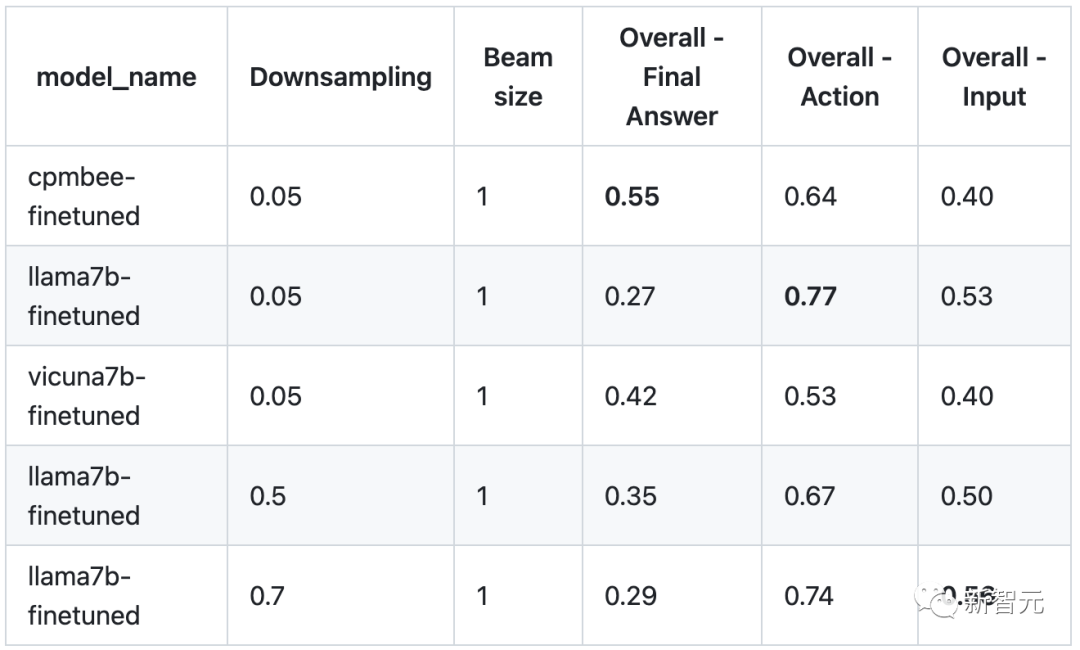

機(jī)器評(píng)估:研究人員對(duì)每個(gè)工具隨機(jī)抽取100個(gè)鏈步(chain steps)來構(gòu)建機(jī)器評(píng)估測(cè)試平臺(tái),平均27個(gè)最終步驟和73個(gè)中間工具調(diào)用步驟,其中最終步驟的評(píng)估使用Rouge-L指標(biāo),中間步驟的評(píng)估使用ExactMatch指標(biāo)進(jìn)行評(píng)估。

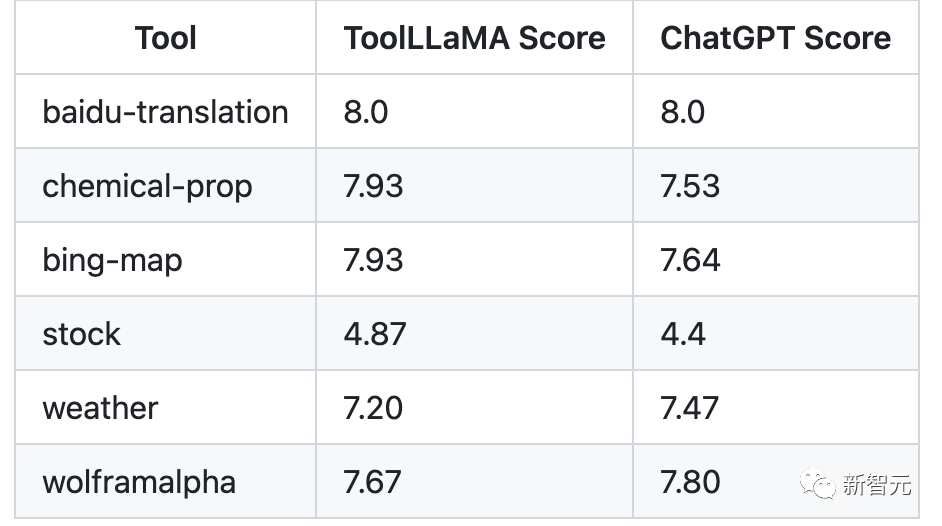

人工評(píng)估:在天氣、地圖、股票、翻譯、化學(xué)和WolframAlpha工具中隨機(jī)抽取10個(gè)query,然后評(píng)估工具調(diào)用過程的通過率、最終答案以及和ChatGPT最終答案的比較。

ChatGPT評(píng)估:通過ChatGPT對(duì)LLaMA和ChatGPT的答案和工具使用鏈進(jìn)行自動(dòng)評(píng)估。

評(píng)估結(jié)果如下(分?jǐn)?shù)越高越好),可以看到ToolLLaMA在不同場(chǎng)景下與ChatGPT的性能相同或更好。

工具學(xué)習(xí)

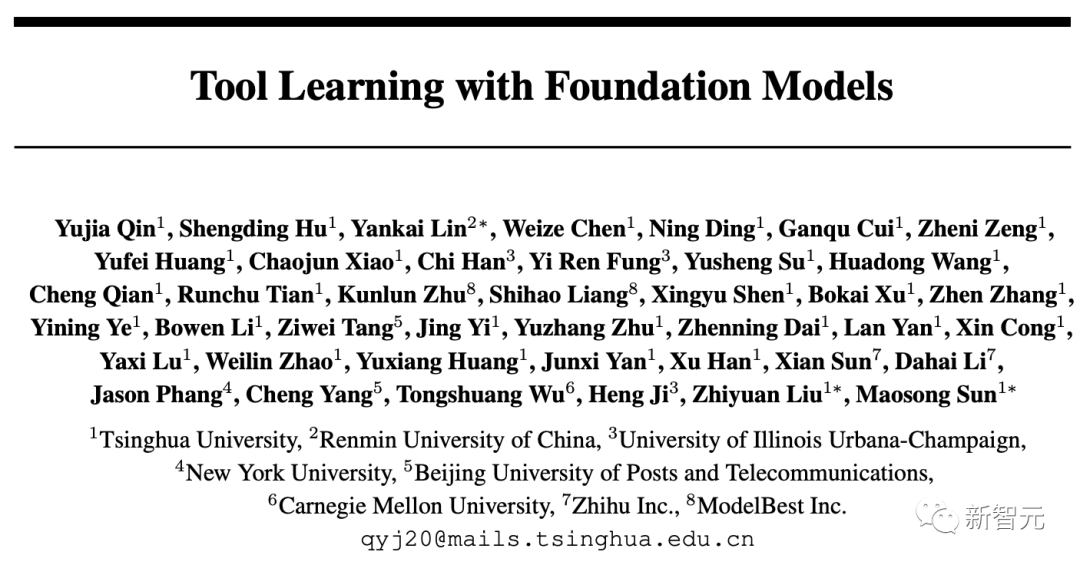

在清華大學(xué)、人民大學(xué)、北京郵電大學(xué)等個(gè)國(guó)內(nèi)外知名高校和大學(xué)聯(lián)合發(fā)布的一篇論文中,對(duì)工具學(xué)習(xí)進(jìn)行了系統(tǒng)的研究,介紹了工具學(xué)習(xí)的背景,包括認(rèn)知起源、基礎(chǔ)模型的范式轉(zhuǎn)變,以及工具和模型的互補(bǔ)作用。

論文鏈接:https://arxiv.org/pdf/2304.08354.pdf

文中還回顧了現(xiàn)有的工具學(xué)習(xí)研究,包括工具增強(qiáng)型和工具導(dǎo)向型學(xué)習(xí),并制定了一個(gè)通用的工具學(xué)習(xí)框架:從理解用戶指令開始,模型應(yīng)該學(xué)會(huì)把一個(gè)復(fù)雜的任務(wù)分解成幾個(gè)子任務(wù),通過推理動(dòng)態(tài)地調(diào)整計(jì)劃,并通過選擇合適的工具有效地征服每個(gè)子任務(wù)。

文中還討論了如何訓(xùn)練模型以提高工具使用能力并促進(jìn)工具學(xué)習(xí)的普及。

考慮到之前的工作中缺乏系統(tǒng)的工具學(xué)習(xí)評(píng)估,研究人員用17種有代表性的工具進(jìn)行了實(shí)驗(yàn),并展示了當(dāng)前基礎(chǔ)模型在熟練利用工具方面的潛力。

論文最后討論了幾個(gè)需要進(jìn)一步研究的工具學(xué)習(xí)的開放性問題,例如確保安全和可信賴的工具使用、用基礎(chǔ)模型實(shí)現(xiàn)工具創(chuàng)建,以及解決個(gè)性化的難題。

-

人工智能

+關(guān)注

關(guān)注

1819文章

50207瀏覽量

266432 -

模型

+關(guān)注

關(guān)注

1文章

3791瀏覽量

52217 -

自然語言處理

+關(guān)注

關(guān)注

1文章

630瀏覽量

14702

原文標(biāo)題:清華等開源「工具學(xué)習(xí)基準(zhǔn)」ToolBench,微調(diào)模型ToolLLaMA性能超越ChatGPT

文章出處:【微信號(hào):AI智勝未來,微信公眾號(hào):AI智勝未來】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

ChatGPT等大模型的發(fā)展,對(duì)GPGPU有怎樣的性能要求?

【「基于大模型的RAG應(yīng)用開發(fā)與優(yōu)化」閱讀體驗(yàn)】+大模型微調(diào)技術(shù)解讀

科技大廠競(jìng)逐AIGC,中國(guó)的ChatGPT在哪?

清華大學(xué)發(fā)布首個(gè)開源自動(dòng)圖學(xué)工具包

ChatGPT開源項(xiàng)目匯總表格

低成本開源聊天機(jī)器人Vicuna:可達(dá)到ChatGPT/Bard 90%以上水平

微軟開源“傻瓜式”類ChatGPT模型訓(xùn)練工具

支持 ChatGPT 的機(jī)器學(xué)習(xí)模型的概況

iPhone都能微調(diào)大模型了嘛

ChatGPT:怎樣打造智能客服體驗(yàn)的重要工具?

OpenAI開放大模型微調(diào)功能 GPT-3.5可以打造專屬ChatGPT

最佳開源模型刷新多項(xiàng)SOTA,首次超越Mixtral Instruct!「開源版GPT-4」家族迎來大爆發(fā)

清華等開源「工具學(xué)習(xí)基準(zhǔn)」ToolBench,微調(diào)模型ToolLLaMA性能超越ChatGPT

清華等開源「工具學(xué)習(xí)基準(zhǔn)」ToolBench,微調(diào)模型ToolLLaMA性能超越ChatGPT

評(píng)論