如需進(jìn)一步精通激光-視覺-IMU-GPS融合SLAM算法,也可以關(guān)注我們下面的課程:

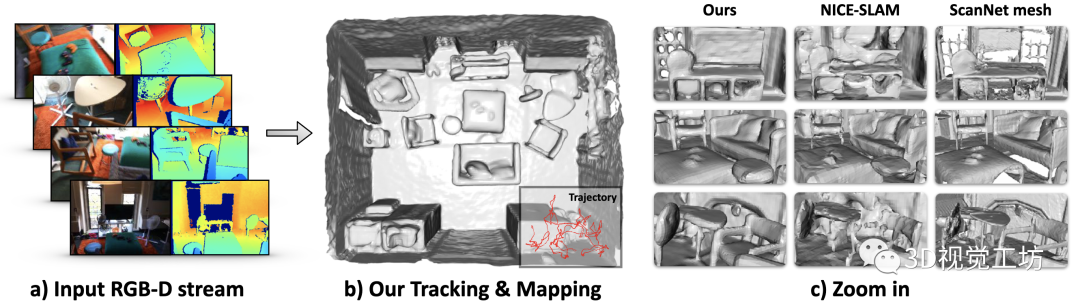

本文提出了Co-SLAM,一種基于混合表示的神經(jīng)RGB-D SLAM系統(tǒng),可以實(shí)時(shí)執(zhí)行魯棒的相機(jī)跟蹤和高保真的表面重建。Co-SLAM將場景表示為多分辨率哈希網(wǎng)格,以利用其高收斂速度和表示高頻局部特征的能力。此外,Co-SLAM結(jié)合了one-blob編碼,以促進(jìn)未觀察區(qū)域的表面一致性和補(bǔ)全。這種聯(lián)合參數(shù)坐標(biāo)編碼通過將快速收斂和表面孔填充這兩方面的優(yōu)點(diǎn)結(jié)合起來,實(shí)現(xiàn)了實(shí)時(shí)性和魯棒性。此外,我們的射線采樣策略允許Co-SLAM在所有關(guān)鍵幀上執(zhí)行全局BA,而不是像其它的神經(jīng)SLAM方法那樣需要關(guān)鍵幀選擇來維持少量活動(dòng)關(guān)鍵幀。實(shí)驗(yàn)結(jié)果表明,Co-SLAM以10-17Hz的頻率運(yùn)行,并在各種數(shù)據(jù)集和基準(zhǔn)(ScanNet, TUM, Replica, Synthetic RGBD)中獲得了最先進(jìn)的場景重建結(jié)果,并具有競爭力的跟蹤性能。

1 引言

聯(lián)合相機(jī)實(shí)時(shí)跟蹤和基于RGB-D傳感器的稠密表面重建是幾十年來計(jì)算機(jī)視覺和機(jī)器人技術(shù)的核心問題。傳統(tǒng)的SLAM解決方案可以穩(wěn)健地跟蹤相機(jī)的位置,同時(shí)將深度和/或顏色測量融合到一個(gè)單一的高保真地圖中。然而,它們依賴于手工的損失項(xiàng),而沒有利用數(shù)據(jù)驅(qū)動(dòng)的先驗(yàn)。

最近,人們的注意力轉(zhuǎn)向了基于學(xué)習(xí)的模型,這種模型可以利用神經(jīng)網(wǎng)絡(luò)架構(gòu)的能力,直接從數(shù)據(jù)中學(xué)習(xí)平滑性和一致性先驗(yàn)。基于坐標(biāo)的網(wǎng)絡(luò)可能已經(jīng)成為最流行的表示方式,因?yàn)樗鼈兛梢酝ㄟ^訓(xùn)練來預(yù)測場景中任何點(diǎn)的幾何和外觀屬性,直接從圖像中進(jìn)行自監(jiān)督。最著名的例子是神經(jīng)輻射場(Neural Radiance Fields, NeRF),它在神經(jīng)網(wǎng)絡(luò)的權(quán)重中編碼場景密度和顏色。與體繪制相結(jié)合,NeRF被訓(xùn)練為重新合成輸入圖像,并具有顯著的泛化到附近未見過的視圖的能力。

基于坐標(biāo)的網(wǎng)絡(luò)將輸入點(diǎn)坐標(biāo)嵌入到高維空間,使用正弦或其他頻率嵌入,使它們能夠捕捉高頻細(xì)節(jié),這對高保真幾何重建至關(guān)重要。平滑性和一致性先驗(yàn)被編碼在MLP權(quán)值中,為序列跟蹤和建圖提供了良好的選擇。然而,基于MLP的方法的缺點(diǎn)是需要很長的訓(xùn)練時(shí)間(有時(shí)是幾個(gè)小時(shí))來學(xué)習(xí)單個(gè)場景。因此,最近建立在具有頻率嵌入的坐標(biāo)網(wǎng)絡(luò)上的具有實(shí)時(shí)能力的SLAM系統(tǒng),如iMAP,需要采用稀疏射線采樣和減少跟蹤迭代的策略來維持交互操作。這是以在重建過程中丟失細(xì)節(jié)(被過度平滑)和在相機(jī)跟蹤中潛在的誤差為代價(jià)的。

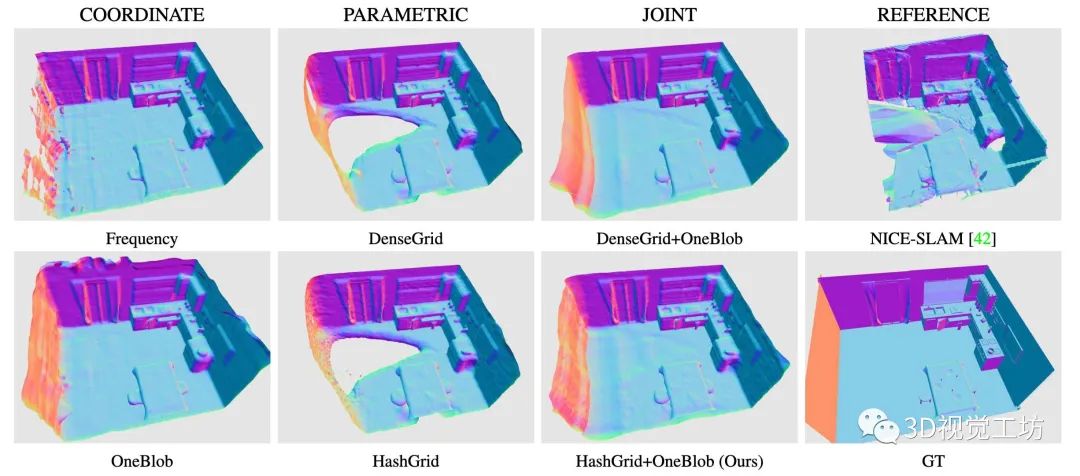

可優(yōu)化的特征網(wǎng)格,也被稱為參數(shù)嵌入,最近已經(jīng)成為單片MLP的一種強(qiáng)大的場景表示替代方案,因?yàn)樗鼈兡軌虮硎靖弑U娴木植刻卣鳎⑶揖哂袠O快的收斂速度(快幾個(gè)數(shù)量級)。最近的研究集中在這些參數(shù)嵌入的稀疏替代方案上,如八叉樹、三平面、哈希網(wǎng)格或稀疏體素網(wǎng)格,以提高稠密網(wǎng)格的存儲(chǔ)效率。雖然這些表示可以快速訓(xùn)練,非常適合實(shí)時(shí)操作,但它們從根本上缺乏MLP固有的平滑性和一致性先驗(yàn),在沒有觀察到的區(qū)域難以填補(bǔ)孔洞。NICE-SLAM是一個(gè)基于多分辨率特征網(wǎng)格的SLAM方法的最新例子。雖然它沒有過于平滑,能捕捉到局部細(xì)節(jié)(如圖2所示),但它不能進(jìn)行補(bǔ)孔,補(bǔ)孔可能會(huì)導(dǎo)致相機(jī)位姿估計(jì)出現(xiàn)漂移。

圖2:不同編碼對補(bǔ)全的影響。基于坐標(biāo)的編碼實(shí)現(xiàn)了空洞填充,但需要較長的訓(xùn)練時(shí)間。參數(shù)編碼允許快速訓(xùn)練,但無法補(bǔ)全未觀察到的區(qū)域。聯(lián)合坐標(biāo)和參數(shù)編碼(Ours)允許流暢地補(bǔ)全場景和快速訓(xùn)練。NICE-SLAM[42]使用稠密參數(shù)編碼。

本文的主要貢獻(xiàn)如下:

為輸入點(diǎn)設(shè)計(jì)一個(gè)聯(lián)合坐標(biāo)和稀疏網(wǎng)格編碼,將兩者的優(yōu)點(diǎn)結(jié)合到實(shí)時(shí)SLAM框架中。一方面,坐標(biāo)編碼提供的平滑性和一致性先驗(yàn)(本文使用one-blob編碼),另一方面,稀疏特征編碼(本文使用哈希網(wǎng)格)的優(yōu)化速度和局部細(xì)節(jié),能得到更魯棒的相機(jī)跟蹤和高保真建圖,更好的補(bǔ)全和孔洞填充。

到目前為止,所有的神經(jīng)SLAM系統(tǒng)都使用從所選關(guān)鍵幀的一個(gè)非常小的子集中采樣的光線來執(zhí)行BA。將優(yōu)化限制在非常少的視點(diǎn)數(shù)量會(huì)降低相機(jī)跟蹤的魯棒性,并由于需要關(guān)鍵幀選擇策略而增加計(jì)算量。相反,Co-SLAM執(zhí)行全局BA,從所有過去的關(guān)鍵幀中采樣光線,這在位姿估計(jì)的魯棒性和性能上得到了重要的提高。此外,我們還證明了我們的BA優(yōu)化需要NICE-SLAM的一小部分迭代就能獲得類似的誤差。在實(shí)踐中,Co-SLAM在保持實(shí)時(shí)性能的前提下,實(shí)現(xiàn)了相機(jī)跟蹤和三維重建的SOTA性能。

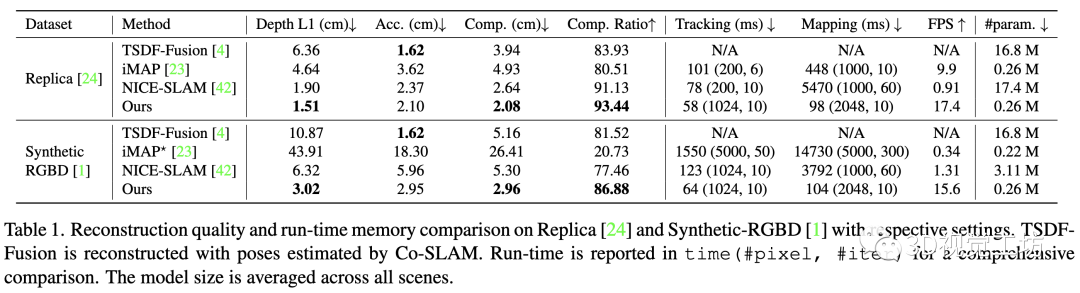

Co-SLAM在Replica和Synthetic RGB-D數(shù)據(jù)集上運(yùn)行速度為15-17Hz,在ScanNet和TUM場景上運(yùn)行速度為12-13Hz,比NICE-SLAM (0.1-1Hz)和iMAP快。我們對各種數(shù)據(jù)集(Replica,Synthetic RGBD,ScanNet,TUM)進(jìn)行了廣泛的評估,在重建方面我們優(yōu)于NICE-SLAM和iMAP,實(shí)現(xiàn)了更好的或至少相當(dāng)?shù)母櫨取?/p>

2 方法

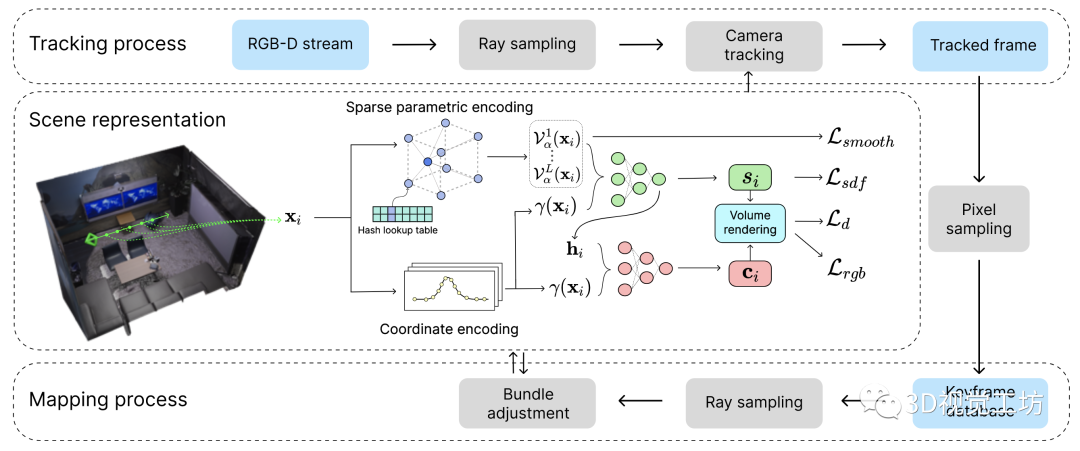

圖3:Co-SLAM概覽。1)場景表示: 使用新的聯(lián)合坐標(biāo)+參數(shù)編碼,輸入坐標(biāo)通過兩個(gè)淺MLP映射到RGB和SDF值。2)跟蹤: 通過最小化損失來優(yōu)化每幀相機(jī)的位姿。3)建圖: 用從所有幀采樣的射線進(jìn)行全局BA,聯(lián)合優(yōu)化場景表示和相機(jī)位姿。

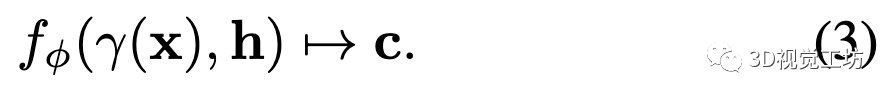

圖3為Co-SLAM的概覽。給定已知相機(jī)內(nèi)參的輸入RGB-D流,通過聯(lián)合優(yōu)化攝像機(jī)姿態(tài)和神經(jīng)場景表示,進(jìn)行稠密建圖和跟蹤。具體來說,我們的隱式表示將世界坐標(biāo)映射為顏色和截?cái)喾柧嚯x(TSDF) 值:

與大多數(shù)SLAM系統(tǒng)類似,該過程分為跟蹤和建圖。

通過在第一幀上運(yùn)行幾個(gè)訓(xùn)練迭代來執(zhí)行初始化。

對于后續(xù)的每一幀,首先優(yōu)化相機(jī)位姿,并使用簡單的恒速運(yùn)動(dòng)模型進(jìn)行初始化。然后對一小部分像素/光線進(jìn)行采樣,并將其復(fù)制到全局像素集。

每次建圖迭代中,對從全局像素集隨機(jī)采樣的一組像素執(zhí)行全局BA,以聯(lián)合優(yōu)化場景表示和所有相機(jī)位姿。

2.1 聯(lián)合坐標(biāo)和參數(shù)編碼

由于MLP固有的一致性和光滑性,基于坐標(biāo)的表示法實(shí)現(xiàn)了高保真場景重建。然而,當(dāng)這些方法在順序設(shè)置中進(jìn)行優(yōu)化時(shí),往往會(huì)遭遇緩慢的收斂和災(zāi)難性的遺忘。相反,基于參數(shù)編碼的方法提高了計(jì)算效率,但在空洞填充和光滑性方面存在不足。由于速度和一致性對于真實(shí)世界的SLAM系統(tǒng)來說都是至關(guān)重要的,我們提出了一種結(jié)合了兩者的優(yōu)點(diǎn)的聯(lián)合坐標(biāo)和參數(shù)編碼:采用坐標(biāo)編碼來表示場景,而使用稀疏參數(shù)編碼來加速訓(xùn)練。

具體地,使用One-blob編碼[16],而不是將空間坐標(biāo)嵌入多個(gè)頻帶。場景表示采用基于多分辨率哈希的特征柵格[15],每個(gè)層次的空間分辨率在最粗分辨率和最細(xì)分辨率之間逐級設(shè)置。通過三線性插值法查詢每個(gè)采樣點(diǎn)處的特征向量。幾何解碼器輸出預(yù)測的SDF值和特征向量:

最后,顏色MLP預(yù)測RGB值:

這里的是可學(xué)習(xí)的參數(shù)。在基于哈希的多分辨率特征網(wǎng)格表示中加入One-blob編碼,可實(shí)現(xiàn)快速收斂、高效的內(nèi)存使用和在線SLAM所需的空洞填充。

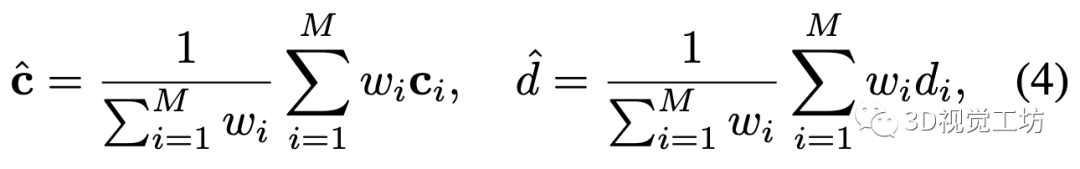

2.2 深度和顏色渲染

和iMAP, NICE-SLAM一樣,我們通過沿采樣光線積分預(yù)測值來渲染深度和顏色。具體地說,給定相機(jī)原點(diǎn)和光線方向,我們均勻采樣個(gè)點(diǎn),深度值為和預(yù)測顏色, 并將顏色和深度渲染為

其中,是沿光線計(jì)算的權(quán)重。

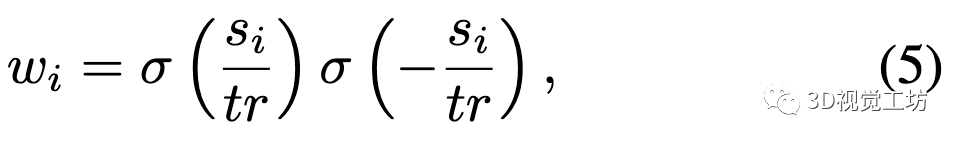

需要轉(zhuǎn)換函數(shù)來將預(yù)測的SDF 轉(zhuǎn)換為權(quán)重。本文不采用NeuS中提出的渲染方程,而是遵循文獻(xiàn)[1]中簡單的鐘形模型,通過將兩個(gè)Sigmoid函數(shù)相乘來直接計(jì)算權(quán)重:

其中,是截?cái)嗑嚯x。

深度引導(dǎo)的采樣:對于沿每條光線的采樣,我們觀察到重要性采樣沒有顯示出顯著的改進(jìn),同時(shí)減慢了跟蹤和建圖的速度。相反,我們使用深度引導(dǎo)的采樣:除了在和邊界之間均勻采樣的點(diǎn)外,對于具有有效深度測量的光線,進(jìn)一步在范圍內(nèi)均勻采樣個(gè)近表面點(diǎn),其中是小的偏移量。

2.3 跟蹤與BA

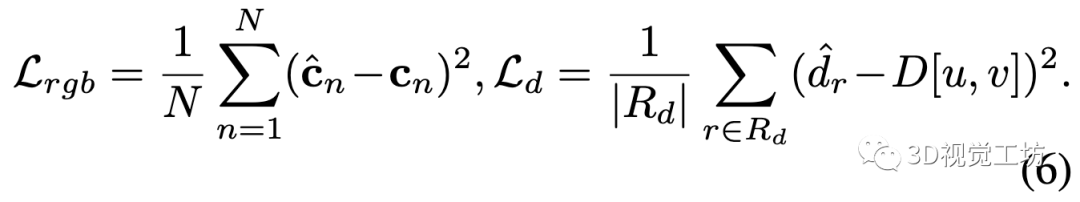

目標(biāo)函數(shù):跟蹤和BA是通過最小化關(guān)于可學(xué)習(xí)參數(shù)和相機(jī)參數(shù)的目標(biāo)函數(shù)進(jìn)行的。顏色和深度的渲染損失是渲染結(jié)果與觀測的2范數(shù)誤差:

其中,是具有有效深度測量的射線集,是圖像平面上的相應(yīng)像素。

為了獲得精確、平滑的細(xì)節(jié)幾何重建,我們還應(yīng)用了近似SDF和特征平滑損失。

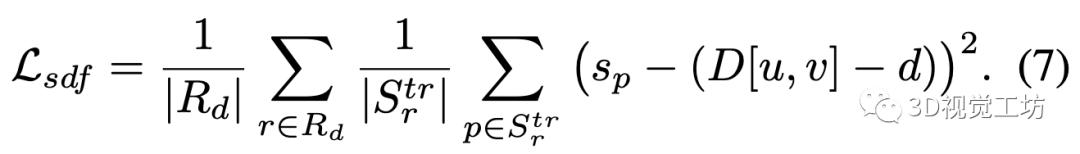

具體地說,對于截?cái)鄥^(qū)域內(nèi)的樣本,即處的點(diǎn),我們使用采樣點(diǎn)與其觀測深度值之間的距離作為用于監(jiān)督的真實(shí)SDF值的近似值:

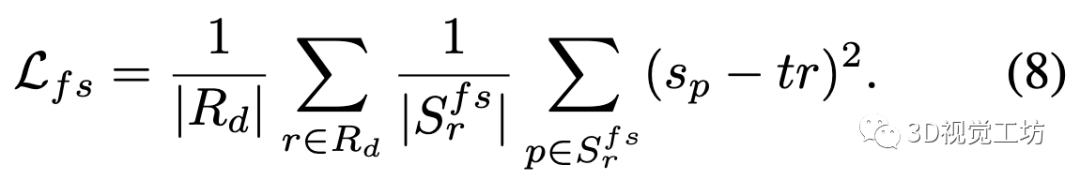

對于遠(yuǎn)離曲面的點(diǎn)(),我們應(yīng)用自由空間損失,強(qiáng)制SDF預(yù)測為截?cái)嗑嚯x:

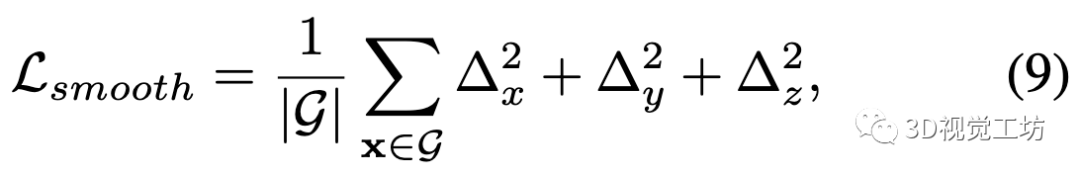

為了防止因未觀察到的自由空間區(qū)域中的哈希沖突而引起噪聲重建,我們對插值的特征執(zhí)行額外的正則化:

其中表示哈希網(wǎng)格上沿三個(gè)維度的相鄰采樣頂點(diǎn)之間的特征度量差。由于在整個(gè)特征網(wǎng)格上進(jìn)行正則化對于實(shí)時(shí)建圖在計(jì)算上是不可行的,所以我們在每次迭代中只在一個(gè)小的隨機(jī)區(qū)域執(zhí)行它。

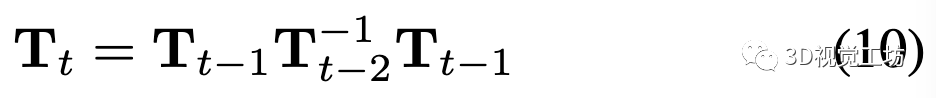

相機(jī)跟蹤:在每一幀跟蹤相機(jī)到世界的變換矩陣。當(dāng)新的幀到來時(shí),首先使用恒速假設(shè)來初始化當(dāng)前幀的位姿:

然后,我們選擇當(dāng)前幀內(nèi)的個(gè)像素,并通過最小化相對于相機(jī)參數(shù)的目標(biāo)函數(shù)來迭代地優(yōu)化位姿。

BA:在神經(jīng)SLAM中,BA通常包括關(guān)鍵幀選擇以及相機(jī)位姿和場景表示的聯(lián)合優(yōu)化。傳統(tǒng)的稠密視覺SLAM方法需要保存關(guān)鍵幀(KF)圖像,因?yàn)閾p失是在所有像素上稠密地構(gòu)建的。相比之下,正如iMAP首次展示的那樣,神經(jīng)SLAM的優(yōu)勢是BA可以處理稀疏的采樣射線集。這是因?yàn)槭褂蒙窠?jīng)網(wǎng)絡(luò)將場景表示為隱式場。然而,iMAP和NICE-SLAM沒有充分利用這一點(diǎn),它們?nèi)匀淮鎯?chǔ)遵循傳統(tǒng)SLAM范式的完整關(guān)鍵幀圖像,并依賴于關(guān)鍵幀選擇(例如信息增益、視覺重疊)來對一小部分關(guān)鍵幀(通常少于10個(gè))執(zhí)行聯(lián)合優(yōu)化。

Co-SLAM更進(jìn)了一步,不再需要存儲(chǔ)完整的關(guān)鍵幀圖像或選擇關(guān)鍵幀。相反,我們只存儲(chǔ)像素的子集(約5%)來表示每個(gè)關(guān)鍵幀。這使我們能夠更頻繁地插入新關(guān)鍵幀,并維護(hù)更大的關(guān)鍵幀數(shù)據(jù)庫。對于聯(lián)合優(yōu)化,我們從全局關(guān)鍵幀列表中隨機(jī)采樣總數(shù)為的光線,以優(yōu)化場景表示和相機(jī)位姿。聯(lián)合優(yōu)化是以交替的方式執(zhí)行的。具體地說,我們首先對場景表示進(jìn)行步優(yōu)化,并使用相機(jī)參數(shù){xi_t}上的累積梯度更新相機(jī)位姿。由于每個(gè)相機(jī)位姿只使用6個(gè)參數(shù),因此該方法可以在幾乎不增加梯度積累的額外計(jì)算量的情況下提高相機(jī)位姿優(yōu)化的魯棒性。

3 實(shí)驗(yàn)

3.1 實(shí)驗(yàn)設(shè)定

數(shù)據(jù)集:我們在四個(gè)不同的數(shù)據(jù)集的各種場景上對Co-SLAM進(jìn)行了評估。在iMAP和NICE-SLAM的基礎(chǔ)上,我們對8個(gè)合成場景的重建質(zhì)量進(jìn)行了定量評估。我們還對NeuralRGBD的7個(gè)合成場景進(jìn)行了評估,其仿真了有噪聲的深度圖。

對于位姿估計(jì),我們評估了ScanNet的6個(gè)場景(真實(shí)位姿從BundleFusion獲得)和TUM RGB-D數(shù)據(jù)集的3個(gè)場景(真實(shí)位姿由運(yùn)動(dòng)捕捉系統(tǒng)提供)的結(jié)果。

評價(jià)指標(biāo):我們使用Depth L1(cm)、Accuracy(cm)、Completion(cm)和Completion ratio(%)來評估重建質(zhì)量,閾值為5cm。遵循NICE-SLAM,我們刪除了任何相機(jī)截錐體之外的未觀察到的區(qū)域。此外,我們還執(zhí)行了額外的網(wǎng)格剔除,以刪除相機(jī)錐體內(nèi)但目標(biāo)場景外的噪聲點(diǎn)。我們觀察到,加上這種網(wǎng)格剔除策略,所有方法都獲得了性能提升(詳見補(bǔ)充資料)。對于相機(jī)跟蹤的評估,采用ATE RMSE(cm)。

基線:我們考慮iMAP和NICE-SLAM作為衡量重建質(zhì)量和相機(jī)跟蹤的主要基準(zhǔn)。為了進(jìn)行公平的比較,使用與Co-SLAM相同的網(wǎng)格剔除策略對iMAP和NICE-SLAM進(jìn)行了評估。請注意,iMAP表示由NICE-SLAM作者發(fā)布的iMAP的重新實(shí)現(xiàn),它比原始實(shí)現(xiàn)慢得多。為了研究真實(shí)數(shù)據(jù)集上精度和幀率之間的權(quán)衡,報(bào)告了我們方法的兩個(gè)版本的結(jié)果:Ours指的是我們提出的方法(實(shí)現(xiàn)實(shí)時(shí)操作),而Ours表明我們的方法運(yùn)行了兩倍的跟蹤迭代。

實(shí)現(xiàn)細(xì)節(jié):我們在配備3.60 GHz Intel Core i7-12700K CPU和NVIDIA RTX 3090ti GPU的臺(tái)式PC上運(yùn)行Co-SLAM。對于默認(rèn)設(shè)置(Ours)在Replica數(shù)據(jù)集上以17FPS運(yùn)行的實(shí)驗(yàn),我們使用像素,10次迭代進(jìn)行跟蹤,并使用每5幀5%的像素進(jìn)行全局BA。我們沿每條相機(jī)光線采樣個(gè)規(guī)則點(diǎn)和個(gè)深度點(diǎn),cm。有關(guān)所有數(shù)據(jù)集的更多具體設(shè)置,請參閱補(bǔ)充資料。

3.2 跟蹤與重建評估

Replica數(shù)據(jù)集

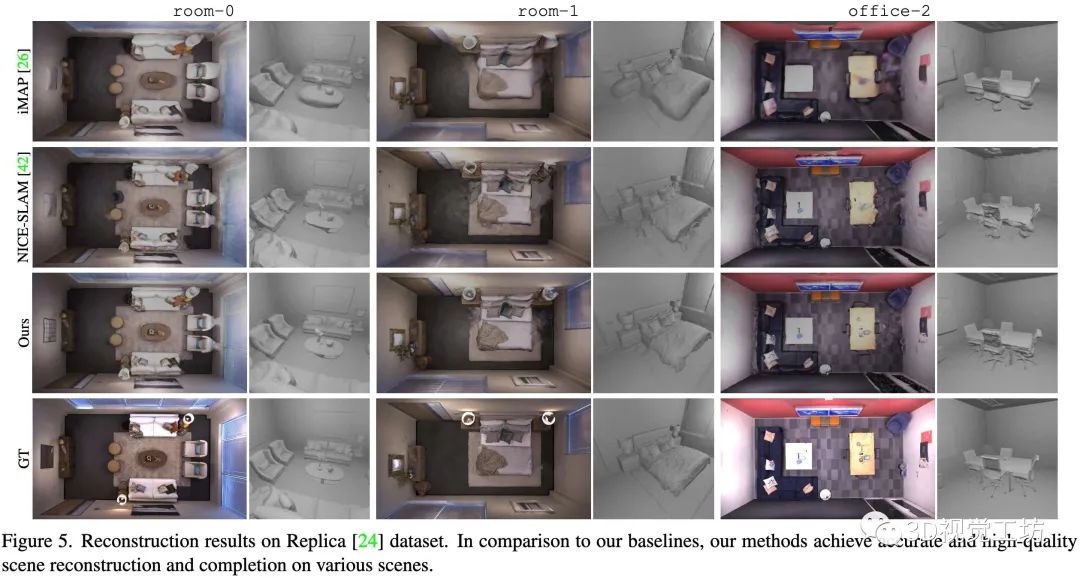

本文的方法實(shí)現(xiàn)了更快更好的重建結(jié)果。iMAP在未觀察到的區(qū)域?qū)崿F(xiàn)了看似合理的補(bǔ)全,但結(jié)果過于平滑,而NICE-SLAM保留了更多的重建細(xì)節(jié),但結(jié)果包含一些偽影(例如床邊的地板、椅子的靠背)。Co-SLAM方法成功地保留了這兩種方法的優(yōu)點(diǎn),實(shí)現(xiàn)了一致的補(bǔ)全和高保真的重建結(jié)果

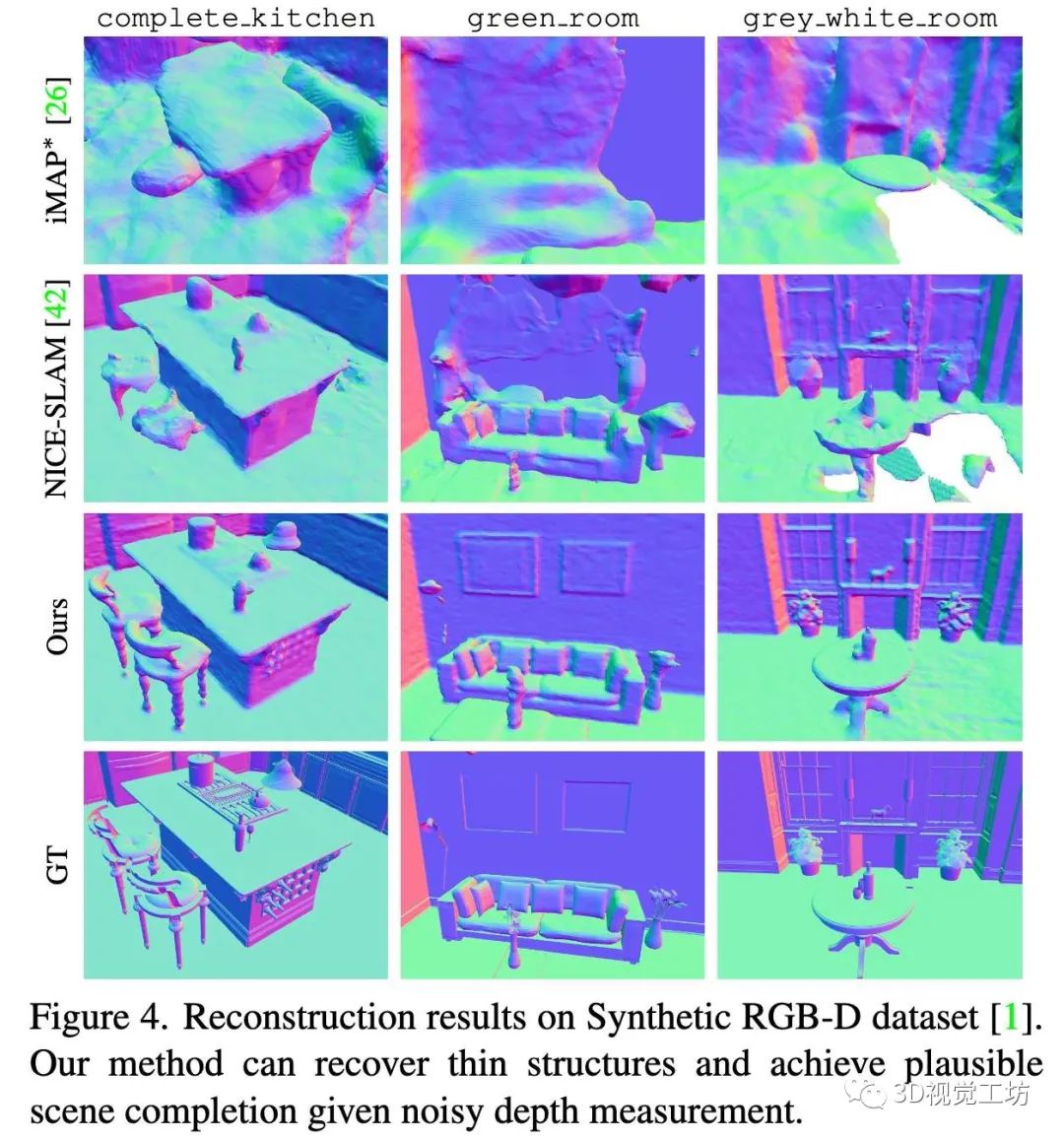

NeuralRGBD中的Synthetic RGBD數(shù)據(jù)集:包含許多薄結(jié)構(gòu),并仿真了實(shí)際深度傳感器測量中存在的噪聲。我們的方法明顯優(yōu)于基線方法(見表1),同時(shí)仍在實(shí)時(shí)運(yùn)行(15FPS)。

總體而言,Co-SLAM可以捕捉到精細(xì)的細(xì)節(jié)(例如酒瓶、椅子腿等)并產(chǎn)生完整而流暢的重建。NICE-SLAM產(chǎn)生的重建細(xì)節(jié)較少且噪音較大,并且無法執(zhí)行空洞填充,而iMAP在某些情況下跟蹤丟失了。

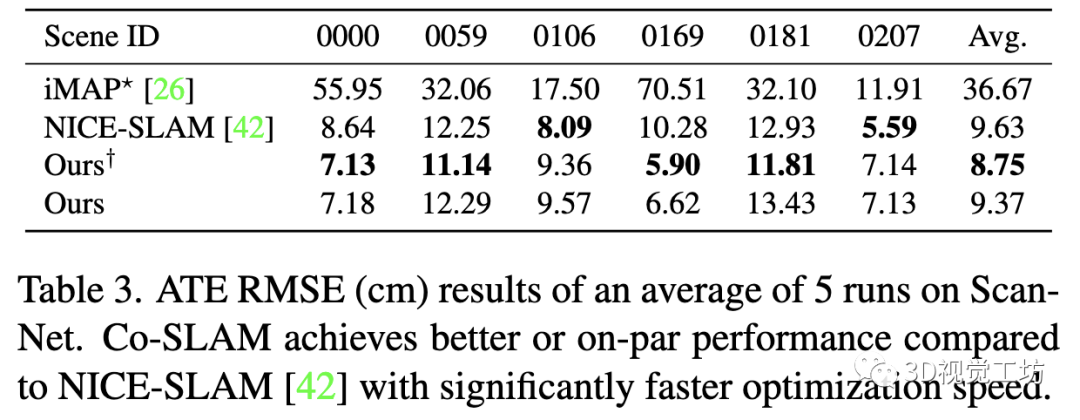

ScanNet數(shù)據(jù)集:在來自ScanNet的6個(gè)真實(shí)序列上評估了Co-SLAM的相機(jī)跟蹤精度。絕對軌跡誤差(ATE)是通過比較預(yù)測軌跡和真實(shí)軌跡(由BundleFusion生成)獲得的。

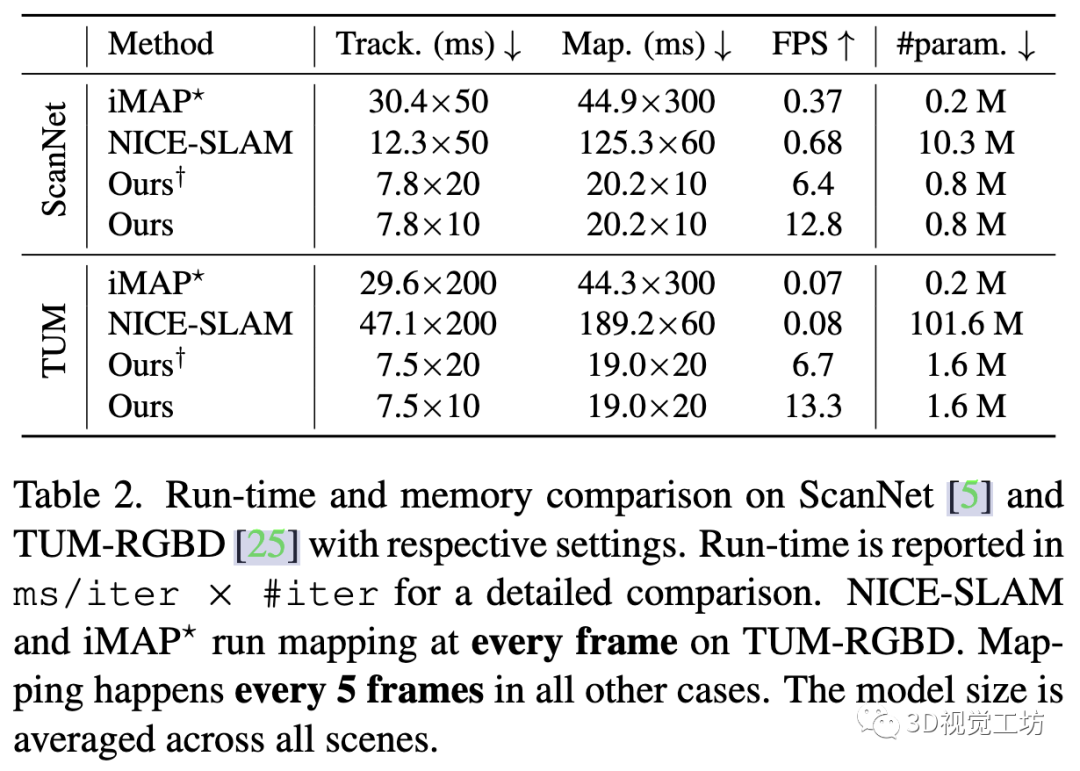

表3表明,與NICE-SLAM相比,在運(yùn)行頻率為6?12 Hz時(shí),我們的方法獲得了更好的跟蹤結(jié)果,跟蹤和建圖迭代次數(shù)更少(見表2)。

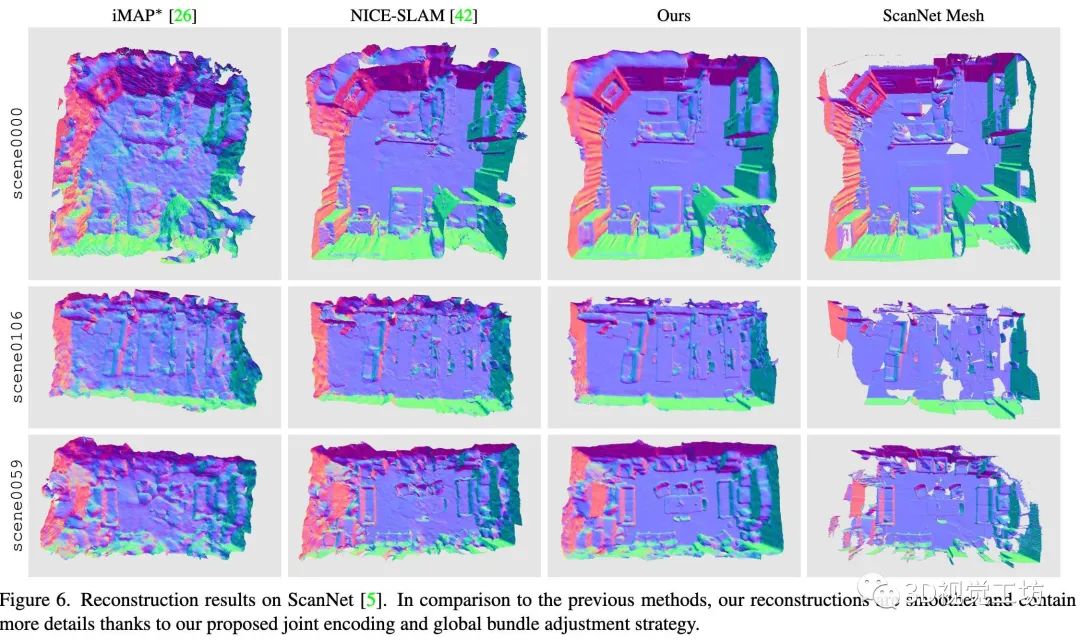

圖6顯示,Co-SLAM以更平滑的結(jié)果和更精細(xì)的細(xì)節(jié)實(shí)現(xiàn)了更好的重建質(zhì)量(例如,自行車)。

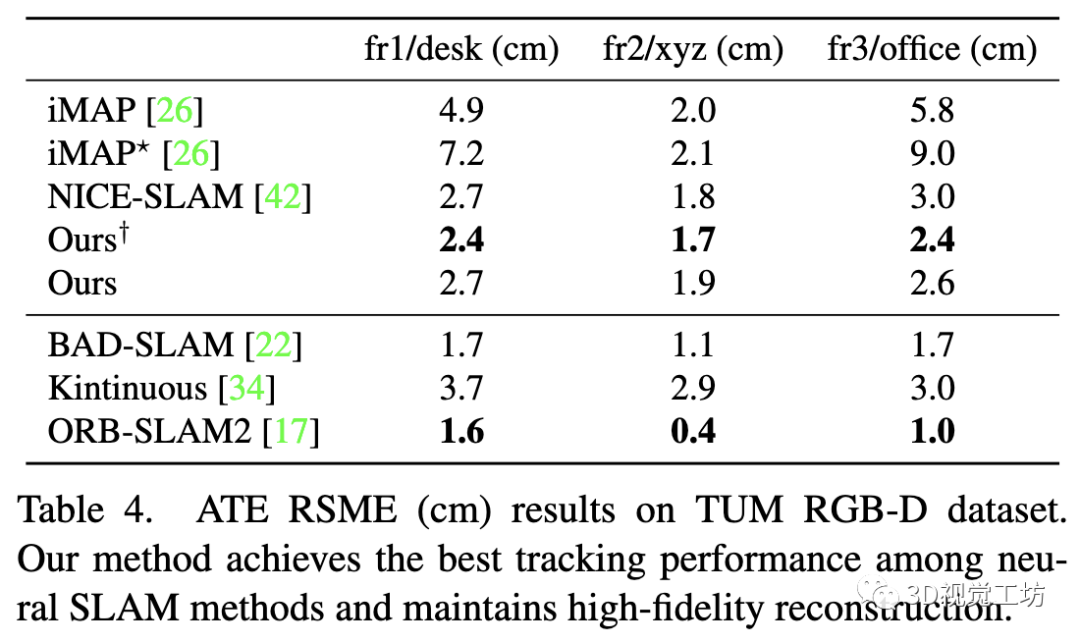

TUM數(shù)據(jù)集:進(jìn)一步評估了在TUM數(shù)據(jù)集上的跟蹤精度。

如表4所示,我們的方法在13FPS下獲得了具有競爭力的跟蹤性能。通過增加跟蹤迭代次數(shù)(Ours),我們的方法在神經(jīng)SLAM方法中獲得了最好的跟蹤性能,速度降為6.7Hz。雖然Co-SLAM算法仍然不能超越傳統(tǒng)的SLAM方法,但它縮小了神經(jīng)網(wǎng)絡(luò)和傳統(tǒng)方法之間的跟蹤性能差距,同時(shí)提高了重建的保真度和完整性。

3.3 性能分析

運(yùn)行時(shí)間和內(nèi)存分析:在我們的默認(rèn)設(shè)置(Ours)下,Co-SLAM可以在配備3.60 GHz Intel Core i7-12700K CPU和NVIDIA RTX 3090ti GPU的臺(tái)式PC上以15Hz以上的頻率運(yùn)行。在更有挑戰(zhàn)性的場景例如ScanNet和TUM數(shù)據(jù)集上,Co-SLAM仍可實(shí)現(xiàn)5?13Hz的運(yùn)行時(shí)間。

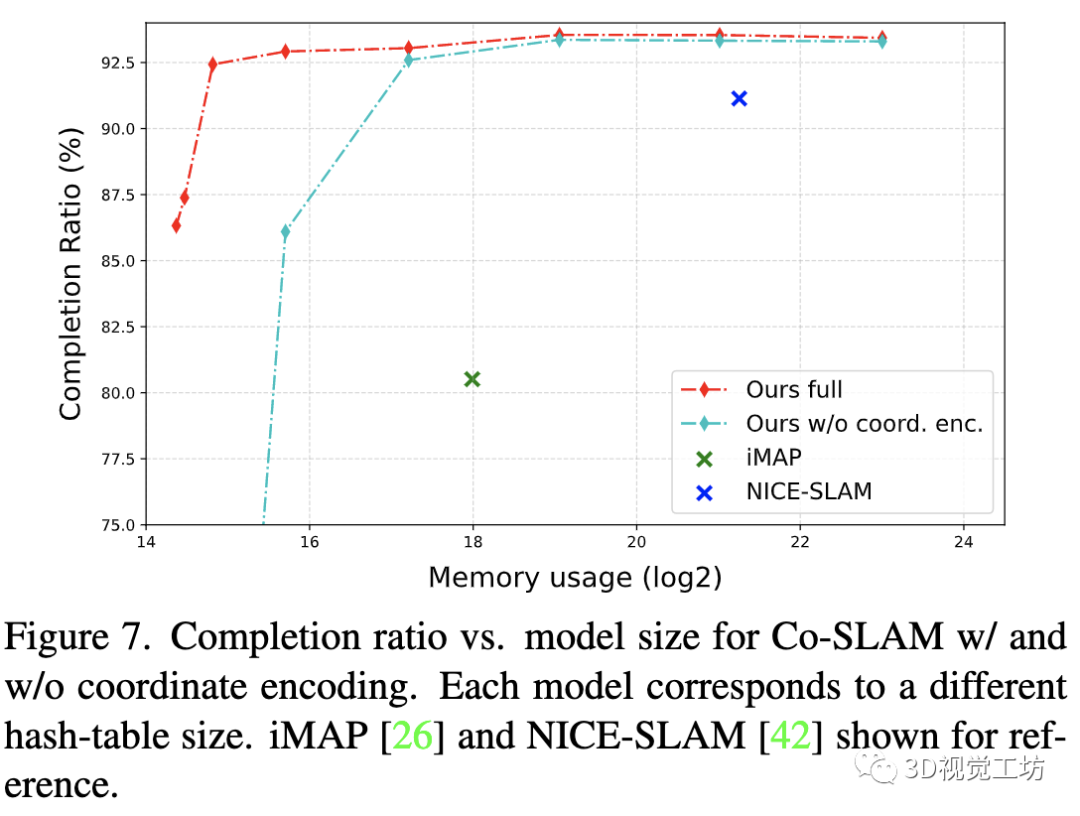

圖7展示了重建質(zhì)量關(guān)于內(nèi)存使用的關(guān)系。由于稀疏的參數(shù)編碼,我們的方法比NICE-SLAM需要顯著更少的內(nèi)存,同時(shí)能實(shí)時(shí)運(yùn)行并獲得準(zhǔn)確的重建結(jié)果。令人驚訝的是,我們發(fā)現(xiàn),在進(jìn)一步壓縮內(nèi)存占用(增加哈希沖突的可能性)的情況下,Co-SLAM的性能仍然優(yōu)于iMAP,這表明我們的聯(lián)合編碼提高了單一編碼的表示能力。請注意,此圖為了說明,我們在整個(gè)哈希編碼中使用相同的空間分辨率。理想情況下,可以進(jìn)一步降低空間分辨率以最小化哈希沖突并獲得更好的重建質(zhì)量。

場景補(bǔ)全:圖2展示了在小場景上使用不同編碼策略的空洞填充的圖示。基于坐標(biāo)編碼的方法以較長的訓(xùn)練時(shí)間為代價(jià)來實(shí)現(xiàn)看似合理的補(bǔ)全,而基于參數(shù)編碼的方法由于其局部性而在空洞填充方面失敗。通過應(yīng)用我們新的聯(lián)合編碼,我們觀察到Co-SLAM可以實(shí)現(xiàn)平滑的空洞填充且保持精細(xì)的結(jié)構(gòu)。

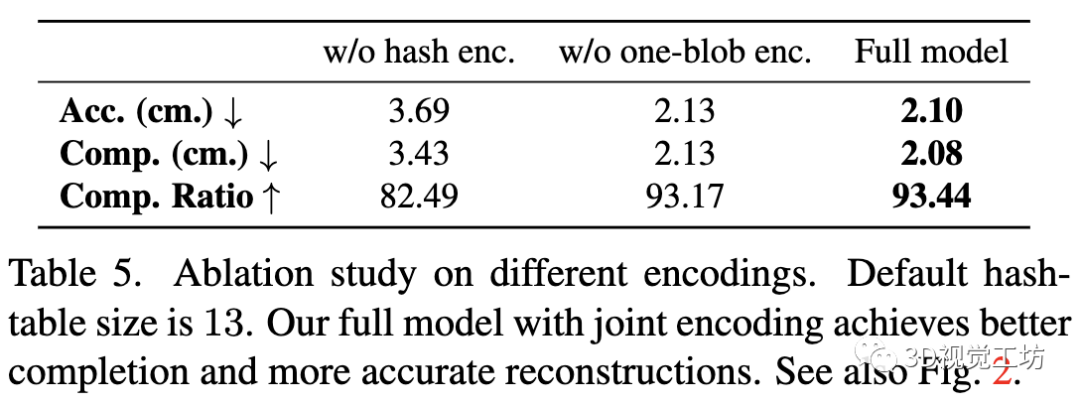

3.4 消融實(shí)驗(yàn)

聯(lián)合坐標(biāo)和參數(shù)編碼的有效性:

我們的完整模型比使用單一編碼(僅使用one-blob或僅使用哈希編碼)具有更高的準(zhǔn)確率和更好的完整性。此外,圖7說明當(dāng)壓縮了哈希查找表的大小時(shí),具有完整編碼的模型比只有哈希編碼的模型更魯棒。

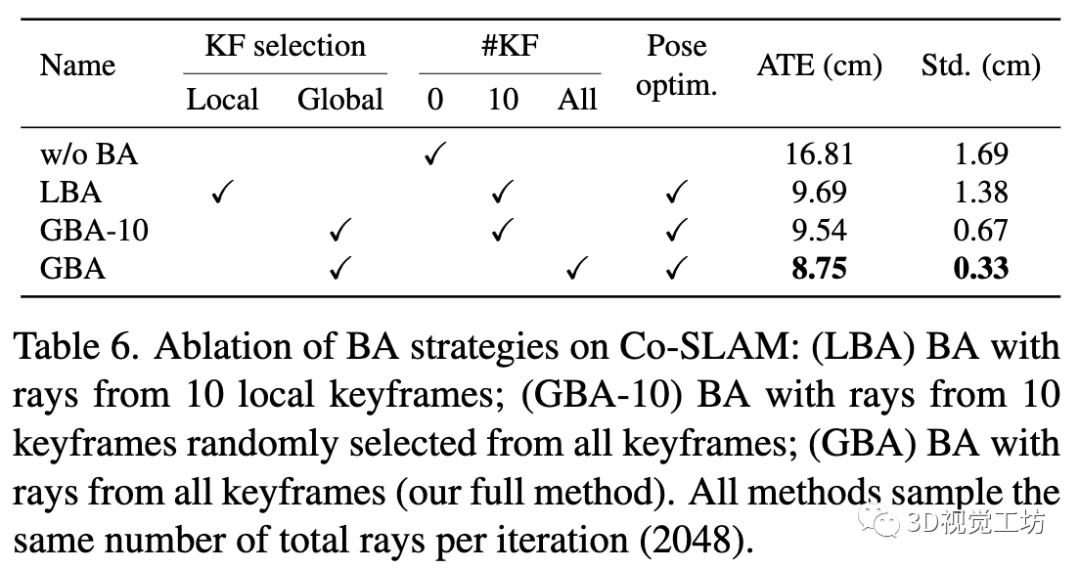

全局BA的有效性:

表6顯示了我們的SLAM方法在使用不同BA策略的6個(gè)ScanNet場景上的平均ATE:

(w/o BA):純跟蹤;

(LBA):使用來自10個(gè)局部關(guān)鍵幀的光線的BA,類似于NICE-SLAM策略;

(GBA-10):僅使用從所有過去關(guān)鍵幀中隨機(jī)選擇的10個(gè)關(guān)鍵幀的光線的BA;

(GBA):Co-SLAM的全局BA策略。我們觀察到,使用來自少量(10)關(guān)鍵幀(LBA和GBA-10)的光線會(huì)導(dǎo)致較高的ATE誤差。但是,當(dāng)從整個(gè)序列(GBA-10)而不是局部(LBA)中選擇關(guān)鍵幀時(shí),標(biāo)準(zhǔn)差會(huì)大大降低。對所有關(guān)鍵幀的光線進(jìn)行采樣(GBA)是整體最佳的策略,即使所有方法對總光線數(shù)(2048)進(jìn)行采樣時(shí)也是如此。

4 總結(jié)

本文提出了一種稠密實(shí)時(shí)神經(jīng)RGB-D SLAM系統(tǒng)Co-SLAM。實(shí)驗(yàn)結(jié)果表明,采用坐標(biāo)和參數(shù)聯(lián)合編碼與微小MLP作為場景表示,并用全局BA進(jìn)行訓(xùn)練,在合理的空洞填充和高效的內(nèi)存使用下,實(shí)現(xiàn)了高保真的建圖和精確的跟蹤。

局限性:Co-SLAM依賴于RGB-D傳感器的輸入,因此對光照變化和不準(zhǔn)確的深度測量很敏感。信息引導(dǎo)的像素采樣策略可以進(jìn)一步減少像素?cái)?shù),提高跟蹤速度,而不是隨機(jī)采樣關(guān)鍵幀像素。引入回環(huán)檢測可能會(huì)帶來進(jìn)一步的改進(jìn)。

審核編輯 :李倩

-

傳感器

+關(guān)注

關(guān)注

2576文章

55041瀏覽量

791383 -

算法

+關(guān)注

關(guān)注

23文章

4784瀏覽量

98076 -

編碼

+關(guān)注

關(guān)注

6文章

1039瀏覽量

56981

原文標(biāo)題:CVPR2023 | Co-SLAM: 聯(lián)合坐標(biāo)和稀疏參數(shù)編碼的神經(jīng)實(shí)時(shí)SLAM

文章出處:【微信號:3D視覺工坊,微信公眾號:3D視覺工坊】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

SLAM技術(shù)的應(yīng)用及發(fā)展現(xiàn)狀

SLAM技術(shù)目前主要應(yīng)用在哪些領(lǐng)域

激光SLAM與視覺SLAM有什么區(qū)別?

SLAM的相關(guān)知識(shí)點(diǎn)分享

高仙SLAM具體的技術(shù)是什么?SLAM2.0有哪些優(yōu)勢?

什么是SLAM技術(shù)?SLAM技術(shù)的工作原理

機(jī)器人主流定位技術(shù):激光SLAM與視覺SLAM誰更勝一籌

SLAM的原理 手持SLAM的優(yōu)缺點(diǎn)講解

用于SLAM的神經(jīng)隱含可擴(kuò)展編碼

用于神經(jīng)場SLAM的矢量化對象建圖

slam技術(shù)研究現(xiàn)狀 SLAM技術(shù)開發(fā)和應(yīng)用挑戰(zhàn)

視覺SLAM是什么?視覺SLAM的工作原理 視覺SLAM框架解讀

自動(dòng)駕駛中如何將稀疏地圖與視覺SLAM相結(jié)合?

Co-SLAM: 聯(lián)合坐標(biāo)和稀疏參數(shù)編碼的神經(jīng)實(shí)時(shí)SLAM

Co-SLAM: 聯(lián)合坐標(biāo)和稀疏參數(shù)編碼的神經(jīng)實(shí)時(shí)SLAM

評論