電子發(fā)燒友網(wǎng)報(bào)道(文/周凱揚(yáng))自研芯片在當(dāng)下似乎已經(jīng)成了一種潮流,無(wú)論是消費(fèi)電子廠商、互聯(lián)網(wǎng)公司還是汽車廠商,都在拿自研芯片做文章。作為時(shí)刻都在與計(jì)算打交道的云端,自然也參與其中,甚至是先進(jìn)工藝自研芯片的主力軍。

自研芯片能省下多少錢?

早在芯片產(chǎn)業(yè)有布局,或者以收購(gòu)來掌握芯片設(shè)計(jì)實(shí)力的云服務(wù)廠商,幾乎都選擇了自研服務(wù)器芯片這條路線,比如亞馬遜、谷歌、阿里巴巴等等。自研芯片的范圍也從網(wǎng)絡(luò)芯片到通用計(jì)算的CPU,再到用于AI計(jì)算的ASIC芯片。

亞馬遜就靠著自研芯片省下了一大筆成本,這也是其他云服務(wù)廠商目前都沒能復(fù)制的成功。首先自研芯片通過架構(gòu)上的創(chuàng)新,為其定制化實(shí)例提供了更高的性能,比如Nitro芯片靠卸載任務(wù)可以多省出兩個(gè)CPU內(nèi)核;其次,對(duì)于某些特定的工作負(fù)載來說,自研芯片帶來了更容易把握的戰(zhàn)略控制以及硬件鎖定;最后,自然也省去了找第三方fabless設(shè)計(jì)公司的成本。

考慮到云服務(wù)廠商在硬件投入上的規(guī)模,以及亞馬遜作為全球第一大云服務(wù)廠商的體量,其中省下的成本還是相當(dāng)龐大的。這也是亞馬遜走自研芯片可行的原因,其他云服務(wù)廠商或許能通過自研把設(shè)計(jì)成本壓下去,但制造成本絕對(duì)沒法像亞馬遜一樣壓這么低,這也是為何AWS過去能做到頻繁降價(jià)。

AI時(shí)代下自研芯片優(yōu)勢(shì)有,但不多

亞馬遜在收購(gòu)后,接連推出了Trainium和Inferentia這兩大訓(xùn)練和推理加速器,并將其集成到自己的云端實(shí)例中去,以優(yōu)異的性能為客戶提供高性價(jià)比的AI硬件方案。但這似乎并沒有為其在最近的AI熱潮中帶來優(yōu)勢(shì),反倒是微軟憑借英偉達(dá)的GPU率先以ChatGPT開啟了這場(chǎng)惡戰(zhàn),谷歌的Bard也緊隨其后。

亞馬遜則選擇了與Hugging Face合作,作為其首選云供應(yīng)商,用戶可以借助AWS上的先進(jìn)工具,比如SageMaker托管服務(wù),以及Trainium和Inferentia硬件,去訓(xùn)練、微調(diào)和部署模型,從而為社區(qū)創(chuàng)造更加開放易用的AI。

但事實(shí)上是,這一合作激起的水花很快就被淹沒在了如傾盆大雨般落地的AI應(yīng)用中。而且對(duì)于Hugging Face來說,他們想要打造的是開放式的生成式AI模型,也就是說其他廠商也都能從中獲益,也就是兩家共同提到的機(jī)器學(xué)習(xí)民主化。

況且在部署上,早在與亞馬遜合作之前,Hugging Face就已經(jīng)在2022年與微軟Azure達(dá)成合作,在Azure的ML終結(jié)點(diǎn)上部署Hugging Face的機(jī)器學(xué)習(xí)推理服務(wù)。所以這次合作即便充分利用了亞馬遜的自研AI芯片,但給其帶來的優(yōu)勢(shì)并不算大。無(wú)論是在性能還是在軟件生態(tài)上,現(xiàn)有的自研芯片都存在如鯁在喉的地方,而這不僅局限于亞馬遜這樣的大廠,不少初創(chuàng)AI芯片公司也都或多或少面臨這樣的困境。

結(jié)語(yǔ)

其實(shí)自研芯片也并非真的毫無(wú)靈活性可言,比如亞馬遜的Graviton和阿里的倚天710,雖說是自研芯片,但用到的畢竟還是Arm的Neoverse公版方案,還有不少第三方方案也是如此,比如英偉達(dá)的Grace、Ampere Computing的Altra等等。

這樣一來其實(shí)開發(fā)靈活性依然很高,比如英偉達(dá)為了給Grace做鋪墊,也對(duì)同類產(chǎn)品的軟件棧提供了支持。比如英偉達(dá)的HPC SDK全面支持AWS的Graviton 3,也支持對(duì)SVE和NEON的自動(dòng)矢量化。而英偉達(dá)推出的Arm HPC開發(fā)套件,也是由Ampere的Altra Q80-30 CPU與A100 GPU組合打造的,與Grace芯片共用同一套軟件環(huán)境。

只不過在AI領(lǐng)域,這樣的自研路線優(yōu)勢(shì)會(huì)更小一點(diǎn),畢竟現(xiàn)在AI模型與算法發(fā)展迅速,自研GPU有著各種難以突破的專利壁壘,自研ASIC又存在迭代適應(yīng)和軟件生態(tài)移植的問題。而這對(duì)于云服務(wù)廠商這種為客戶賦能更快產(chǎn)品上市速度的企業(yè)來說,或許在AI仍在快速演進(jìn)的當(dāng)下,GPU會(huì)是更優(yōu)解,這也是云服務(wù)廠商即便選擇了自研AI芯片,主打的卻依然是GPU實(shí)例的原因。

自研芯片能省下多少錢?

早在芯片產(chǎn)業(yè)有布局,或者以收購(gòu)來掌握芯片設(shè)計(jì)實(shí)力的云服務(wù)廠商,幾乎都選擇了自研服務(wù)器芯片這條路線,比如亞馬遜、谷歌、阿里巴巴等等。自研芯片的范圍也從網(wǎng)絡(luò)芯片到通用計(jì)算的CPU,再到用于AI計(jì)算的ASIC芯片。

亞馬遜就靠著自研芯片省下了一大筆成本,這也是其他云服務(wù)廠商目前都沒能復(fù)制的成功。首先自研芯片通過架構(gòu)上的創(chuàng)新,為其定制化實(shí)例提供了更高的性能,比如Nitro芯片靠卸載任務(wù)可以多省出兩個(gè)CPU內(nèi)核;其次,對(duì)于某些特定的工作負(fù)載來說,自研芯片帶來了更容易把握的戰(zhàn)略控制以及硬件鎖定;最后,自然也省去了找第三方fabless設(shè)計(jì)公司的成本。

考慮到云服務(wù)廠商在硬件投入上的規(guī)模,以及亞馬遜作為全球第一大云服務(wù)廠商的體量,其中省下的成本還是相當(dāng)龐大的。這也是亞馬遜走自研芯片可行的原因,其他云服務(wù)廠商或許能通過自研把設(shè)計(jì)成本壓下去,但制造成本絕對(duì)沒法像亞馬遜一樣壓這么低,這也是為何AWS過去能做到頻繁降價(jià)。

AI時(shí)代下自研芯片優(yōu)勢(shì)有,但不多

亞馬遜在收購(gòu)后,接連推出了Trainium和Inferentia這兩大訓(xùn)練和推理加速器,并將其集成到自己的云端實(shí)例中去,以優(yōu)異的性能為客戶提供高性價(jià)比的AI硬件方案。但這似乎并沒有為其在最近的AI熱潮中帶來優(yōu)勢(shì),反倒是微軟憑借英偉達(dá)的GPU率先以ChatGPT開啟了這場(chǎng)惡戰(zhàn),谷歌的Bard也緊隨其后。

亞馬遜則選擇了與Hugging Face合作,作為其首選云供應(yīng)商,用戶可以借助AWS上的先進(jìn)工具,比如SageMaker托管服務(wù),以及Trainium和Inferentia硬件,去訓(xùn)練、微調(diào)和部署模型,從而為社區(qū)創(chuàng)造更加開放易用的AI。

但事實(shí)上是,這一合作激起的水花很快就被淹沒在了如傾盆大雨般落地的AI應(yīng)用中。而且對(duì)于Hugging Face來說,他們想要打造的是開放式的生成式AI模型,也就是說其他廠商也都能從中獲益,也就是兩家共同提到的機(jī)器學(xué)習(xí)民主化。

況且在部署上,早在與亞馬遜合作之前,Hugging Face就已經(jīng)在2022年與微軟Azure達(dá)成合作,在Azure的ML終結(jié)點(diǎn)上部署Hugging Face的機(jī)器學(xué)習(xí)推理服務(wù)。所以這次合作即便充分利用了亞馬遜的自研AI芯片,但給其帶來的優(yōu)勢(shì)并不算大。無(wú)論是在性能還是在軟件生態(tài)上,現(xiàn)有的自研芯片都存在如鯁在喉的地方,而這不僅局限于亞馬遜這樣的大廠,不少初創(chuàng)AI芯片公司也都或多或少面臨這樣的困境。

結(jié)語(yǔ)

其實(shí)自研芯片也并非真的毫無(wú)靈活性可言,比如亞馬遜的Graviton和阿里的倚天710,雖說是自研芯片,但用到的畢竟還是Arm的Neoverse公版方案,還有不少第三方方案也是如此,比如英偉達(dá)的Grace、Ampere Computing的Altra等等。

這樣一來其實(shí)開發(fā)靈活性依然很高,比如英偉達(dá)為了給Grace做鋪墊,也對(duì)同類產(chǎn)品的軟件棧提供了支持。比如英偉達(dá)的HPC SDK全面支持AWS的Graviton 3,也支持對(duì)SVE和NEON的自動(dòng)矢量化。而英偉達(dá)推出的Arm HPC開發(fā)套件,也是由Ampere的Altra Q80-30 CPU與A100 GPU組合打造的,與Grace芯片共用同一套軟件環(huán)境。

只不過在AI領(lǐng)域,這樣的自研路線優(yōu)勢(shì)會(huì)更小一點(diǎn),畢竟現(xiàn)在AI模型與算法發(fā)展迅速,自研GPU有著各種難以突破的專利壁壘,自研ASIC又存在迭代適應(yīng)和軟件生態(tài)移植的問題。而這對(duì)于云服務(wù)廠商這種為客戶賦能更快產(chǎn)品上市速度的企業(yè)來說,或許在AI仍在快速演進(jìn)的當(dāng)下,GPU會(huì)是更優(yōu)解,這也是云服務(wù)廠商即便選擇了自研AI芯片,主打的卻依然是GPU實(shí)例的原因。

聲明:本文內(nèi)容及配圖由入駐作者撰寫或者入駐合作網(wǎng)站授權(quán)轉(zhuǎn)載。文章觀點(diǎn)僅代表作者本人,不代表電子發(fā)燒友網(wǎng)立場(chǎng)。文章及其配圖僅供工程師學(xué)習(xí)之用,如有內(nèi)容侵權(quán)或者其他違規(guī)問題,請(qǐng)聯(lián)系本站處理。

舉報(bào)投訴

-

服務(wù)器

+關(guān)注

關(guān)注

14文章

10253瀏覽量

91489

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

熱點(diǎn)推薦

賽思分享時(shí)鐘服務(wù)器的解決方案及其優(yōu)勢(shì)

隨著科技的不斷發(fā)展,各種應(yīng)用場(chǎng)景對(duì)于時(shí)間同步和精確性的要求也越來越高。在這種情況下,時(shí)鐘服務(wù)器應(yīng)運(yùn)而生,為各行各業(yè)提供了高效、穩(wěn)定、可靠的時(shí)間同步解決方案。本文將詳細(xì)介紹時(shí)鐘服務(wù)器的解決方案及其優(yōu)勢(shì)

NTP自動(dòng)校時(shí)服務(wù)器的核心優(yōu)勢(shì)介紹

NTP自動(dòng)校時(shí)服務(wù)器是一種基于網(wǎng)絡(luò)的時(shí)間同步設(shè)備,它通過與高精度時(shí)間源(如GPS、原子鐘或國(guó)家授時(shí)中心)進(jìn)行通信,獲取準(zhǔn)確的時(shí)間信息,并將其分發(fā)到網(wǎng)絡(luò)中的各個(gè)設(shè)備。其核心優(yōu)勢(shì)在于能夠?qū)崿F(xiàn)毫秒級(jí)甚至

香港服務(wù)器支持Docker和Kubernetes嗎?

和Kubernetes的部署與運(yùn)行? 答案是肯定的,而且香港服務(wù)器由于其獨(dú)特的優(yōu)勢(shì),往往是部署容器化應(yīng)用的絕佳選擇。 下面,我們將從技術(shù)支持、網(wǎng)絡(luò)優(yōu)勢(shì)、實(shí)踐指南和注意事項(xiàng)等方面,全面解析香港服

什么是服務(wù)器虛擬化?一文讀懂原理、優(yōu)勢(shì)與實(shí)戰(zhàn)部署

什么是服務(wù)器虛擬化?當(dāng)企業(yè)服務(wù)器CPU利用率長(zhǎng)期低于15%,卻仍需不斷采購(gòu)新硬件應(yīng)對(duì)業(yè)務(wù)增長(zhǎng)時(shí),一場(chǎng)基礎(chǔ)設(shè)施領(lǐng)域的革命早已悄然發(fā)生——服務(wù)器虛擬化。這項(xiàng)技術(shù)通過將物理服務(wù)器劃分為多個(gè)獨(dú)

Arm CEO:公司正在自研芯片

據(jù)外媒路透社報(bào)道,Arm CEO Rene Haas透露,Arm正在投資開發(fā)自有芯片,并計(jì)劃將部分利潤(rùn)投資于制造自己的芯片和其他組件。與之對(duì)應(yīng)的是Arm預(yù)測(cè)的下一財(cái)季經(jīng)營(yíng)業(yè)績(jī)也會(huì)因?yàn)?b class='flag-5'>自研

歐洲服務(wù)器免費(fèi)ip地址怎么獲取?#歐洲服務(wù)器 #免費(fèi)IP地址 #服務(wù)器

服務(wù)器

jf_57681485

發(fā)布于 :2025年06月13日 11:15:04

國(guó)外服務(wù)器地址怎么填寫才正確?#國(guó)外服務(wù)器 #國(guó)外服務(wù)器地址 #服務(wù)器

服務(wù)器

jf_57681485

發(fā)布于 :2025年06月11日 14:06:38

歐洲VS美國(guó)服務(wù)器怎么選?1分鐘解析核心差異 #歐洲服務(wù)器 #美國(guó)服務(wù)器 #服務(wù)器

服務(wù)器

jf_57681485

發(fā)布于 :2025年05月22日 13:46:32

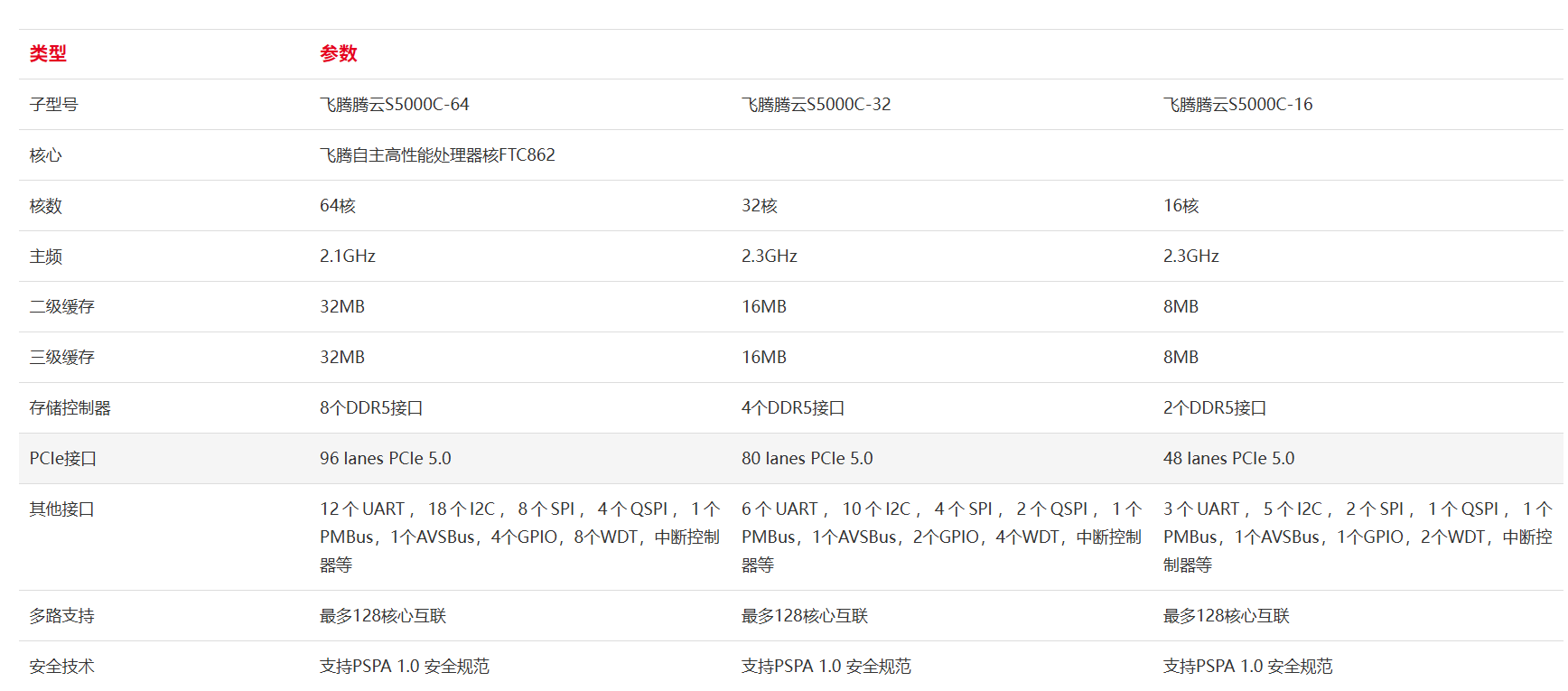

高端芯片自研,服務(wù)器芯片傳來好消息!

電子發(fā)燒友網(wǎng)報(bào)道(文/黃晶晶)當(dāng)前,自研處理器已經(jīng)跨過了能用的階段,逐漸走向好用,但無(wú)論是消費(fèi)級(jí)還是服務(wù)器級(jí)都面臨著如何在性能上接近國(guó)外高端產(chǎn)品,以及生態(tài)上如何更加完善的問題。國(guó)內(nèi)廠商

服務(wù)器數(shù)據(jù)恢復(fù)—服務(wù)器部分?jǐn)?shù)據(jù)目錄項(xiàng)被破壞的數(shù)據(jù)恢復(fù)案例

一臺(tái)安裝linux系統(tǒng)的服務(wù)器意外斷電。管理員重啟服務(wù)器后進(jìn)行檢測(cè),發(fā)現(xiàn)服務(wù)器上部分文件丟失。管理員沒有進(jìn)行任何操作,直接將服務(wù)器正常關(guān)機(jī)并

RAKsmart服務(wù)器SEO優(yōu)化優(yōu)勢(shì)分析

在RAKsmart服務(wù)器上搭建SEO網(wǎng)站,可以借助其基礎(chǔ)設(shè)施和服務(wù)特性,從技術(shù)層面優(yōu)化搜索引擎排名。以下是具體優(yōu)勢(shì)及分析,主機(jī)推薦小編為您整理發(fā)布RAKsmart服務(wù)器SEO優(yōu)化

利用RAKsmart服務(wù)器托管AI模型訓(xùn)練的優(yōu)勢(shì)

AI模型訓(xùn)練需要強(qiáng)大的計(jì)算資源、高效的存儲(chǔ)和穩(wěn)定的網(wǎng)絡(luò)支持,這對(duì)服務(wù)器的性能提出了較高要求。而RAKsmart服務(wù)器憑借其核心優(yōu)勢(shì),成為托管AI模型訓(xùn)練的理想選擇。下面,AI部落小編為您具體分享。

自研服務(wù)器芯片或許沒有那么大優(yōu)勢(shì)

自研服務(wù)器芯片或許沒有那么大優(yōu)勢(shì)

評(píng)論