Colossal-AI的改變:

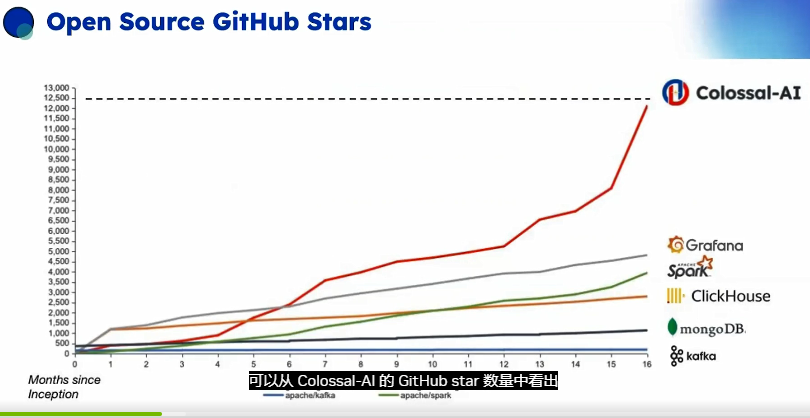

從Colossal-AI的GitHub star數(shù)量中看出,這是衡量其開源社區(qū)的指標。與其它非常流行的開源系統(tǒng)(如Spark、 MongoDB等)相比,在相同時間內(nèi)Colossal-AI使用增長速度是最快的。

世界上37個國家的用戶正在使用Colossal-AI,還有各種其他人工智能生態(tài)系統(tǒng)使用Colsssal-AI。

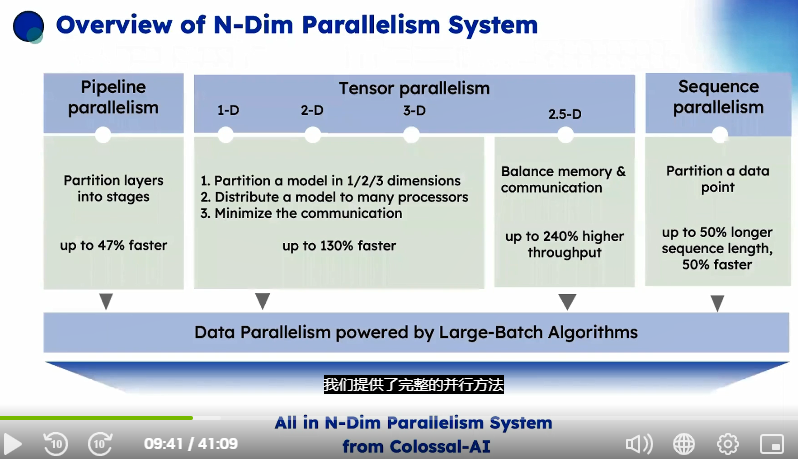

Colsssal-AI的重要功能——N-Dim并行系統(tǒng)

這可以將你的復(fù)雜模型可用硬件上,以便最大化使用并行同時最小化通信。

Colsssal-AI提供了完整的并行方法,包括數(shù)據(jù)并行、張量并行、流水線并行和序列并行,同時還有團隊提出的2維、2.5維和3維張量并行以及序列并行。

其中優(yōu)化了數(shù)據(jù)并行,可以讓你以最小的損失在相當(dāng)大的規(guī)換下訓(xùn)練模型。

大規(guī)模優(yōu)化器如何優(yōu)化數(shù)據(jù)并行

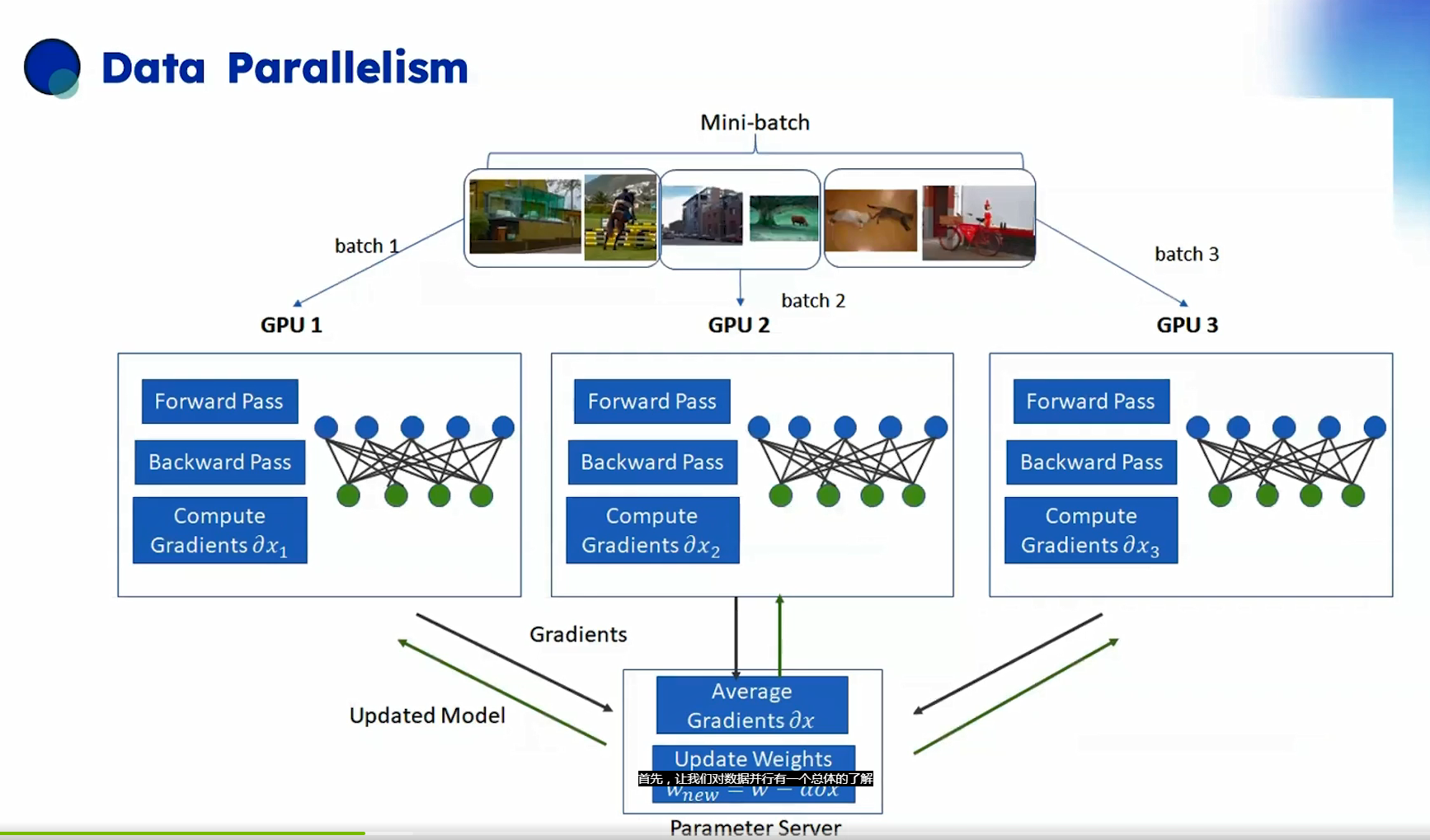

與單個GPU訓(xùn)練相比數(shù)據(jù)并行訓(xùn)練將整個數(shù)據(jù)集分為幾個分區(qū)。

每個GPU擁有1個數(shù)據(jù)集分區(qū),模型在每個GPU上復(fù)制,開在其本地數(shù)據(jù)集分區(qū)進行訓(xùn)練,在反向傳播期間計算的梯度,被平均并用于更新模型副本,可以確保在不同GPU之間同步模型。

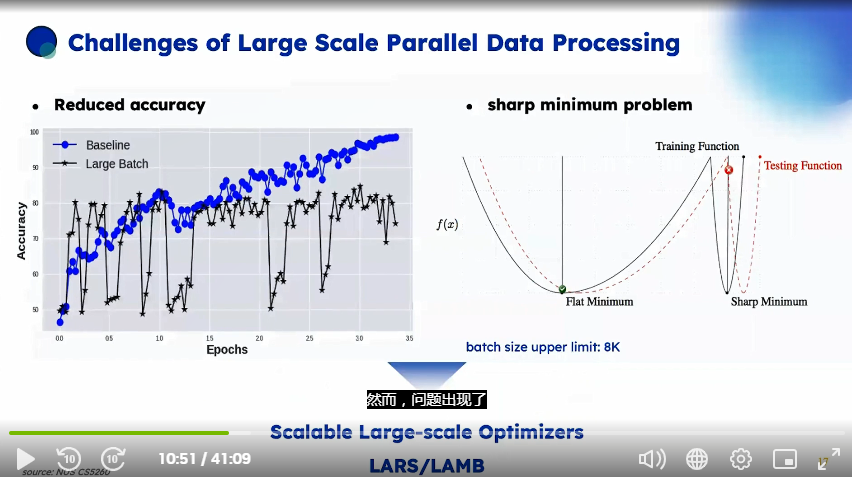

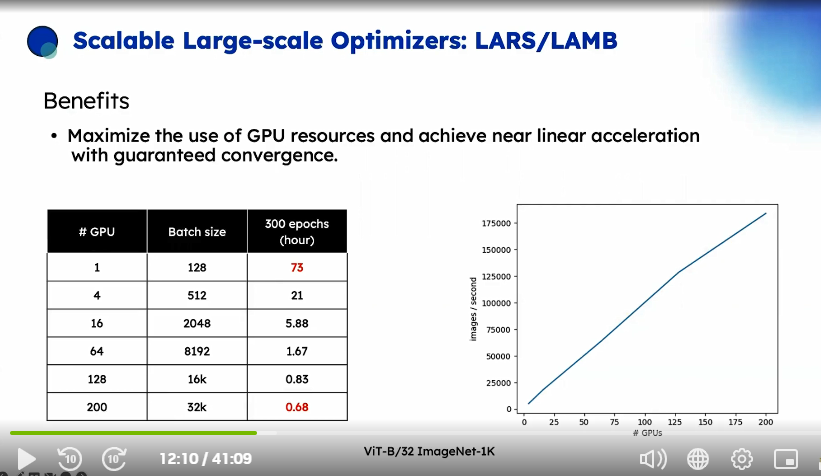

然而,簡單的增加批次大小,通常會導(dǎo)致泛化性能下降并降低計算精度。為了解決這些問題,研究出一種新的方法,可擴展的大規(guī)模優(yōu)化器LARS和LAMB,適合大批量設(shè)置。

在ViT模型和ImageNet數(shù)據(jù)集上對可擴展的大規(guī)模優(yōu)化器LARS和LAMB進行理論分析。他們可最大程度使用GPU資源,將ViT-B/32的訓(xùn)練時間從一個GPU的73小時減少到200個GPU的0.68小時,并實現(xiàn)幾乎線性增加的加速度,并保證收斂。

編輯:黃飛

-

gpu

+關(guān)注

關(guān)注

28文章

5198瀏覽量

135521 -

英偉達

+關(guān)注

關(guān)注

23文章

4090瀏覽量

99237 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5599瀏覽量

124418 -

gtc

+關(guān)注

關(guān)注

0文章

74瀏覽量

4766

發(fā)布評論請先 登錄

一文看懂AI大模型的并行訓(xùn)練方式(DP、PP、TP、EP)

RK3576驅(qū)動高端顯控系統(tǒng)升級:多屏拼控與AI視覺融合解決方案

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+AI的科學(xué)應(yīng)用

【Sipeed MaixCAM Pro開發(fā)板試用體驗】基于MaixCAM-Pro的AI生成圖像鑒別系統(tǒng)

AI 芯片浪潮下,職場晉升新契機?

邊緣AI廣泛應(yīng)用推動并行計算崛起及創(chuàng)新GPU滲透率快速提升

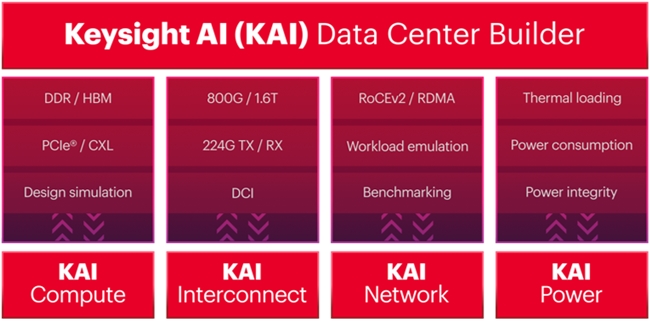

是德科技推出用于大規(guī)模AI數(shù)據(jù)中心的系列解決方案

適用于數(shù)據(jù)中心和AI時代的800G網(wǎng)絡(luò)

研華科技亮相NVIDIA GTC 2025大會

英偉達GTC2025亮點:電信行業(yè)領(lǐng)先企業(yè)啟用代理式AI優(yōu)化網(wǎng)絡(luò)運維

英偉達GTC2025亮點:NVIDIA認證計劃擴展至企業(yè)存儲領(lǐng)域,加速AI工廠部署

英偉達GTC2025亮點:NVIDIA、Alphabet 和谷歌攜手開啟代理式與物理AI的未來

英偉達GTC25亮點:NVIDIA Blackwell Ultra 開啟 AI 推理新時代

NVIDIA GTC 2025精華一文讀完 黃仁勛在GTC上的主題演講

GTC 2023|Colossal-AI系統(tǒng)的數(shù)據(jù)并行優(yōu)化方案

GTC 2023|Colossal-AI系統(tǒng)的數(shù)據(jù)并行優(yōu)化方案

評論