導 讀

本文是 AAAI 2023 Oral 入選論文 Tracking and Reconstructing Hand Object Interactions from Point Cloud Sequences in the Wild 的解讀。本論文由北京大學王鶴研究團隊與北京通用人工智能研究院、弗吉尼亞理工大學、斯坦福大學、清華大學、哥倫比亞大學合作,針對追蹤并重建一段輸入點云序列中的手和物體這一任務進行了研究。

我們首次提出了一個基于點云的手部關節追蹤網絡 HandTrackNet,并設計了一套完整的算法來完成手和物體追蹤與重建這一具有挑戰性的任務。此外,為了獲得更多樣且精準的數據,我們在仿真器中生成了大量手物交互的數據,并模擬了深度相機的拍攝原理,以獲得接近真實世界噪聲分布的深度數據。僅用仿真數據進行訓練,我們的方法可以很好地泛化到未見過的真實場景測試數據上,以較快的速度(9FPS)取得遠超前人工作的精度。

論文鏈接:

http://arxiv.org/abs/2209.12009

項目主頁:

https://pku-epic.github.io/HOtrack

代碼地址:

https://github.com/PKU-EPIC/HOTrack

圖1. HO3D 數據集上的效果展示圖。左起依次為輸入點云,輸出重建結果,另一個視角的輸出,以及輸出與 RGB 疊置的效果。可以看到,我們的算法對手物交互中的遮擋問題有很好的魯棒性。

圖2. DexYCB 數據集上的效果展示圖。

01

引 言

手和物體的交互作為人類與復雜現實場景交互的主要途徑,在現實生活中無處不在。作為感知人類與物體交互的主要方法,位姿追蹤和重建人手與物體是兩個至關重要的研究課題,可以實現廣泛的應用,包括人機交互[1],增強現實[2],以及讓機器人從人類的演示中學習相應技能(如抓取和操縱等[3])。

近年來,隨著深度學習的發展,越來越多基于深度學習的工作涌現出來,研究如何從單幀信息(RGB 圖片[4]或點云[5])中去感知手和物體,重建他們的幾何形狀或是估計他們的位姿,但是這類方法往往無法利用上視頻相鄰幀之間的連續性。另一方面,深度學習非常依賴數據,而對真實場景視頻中的手和物體去準確標注三維幾何形狀及位姿是一件非常困難且成本極大的事情,現有的數據集如 DexYCB[6]和 HO3D[7]都規模不大且包含的物體數量少(不超過20個不同物體),用這樣的數據難以訓練出能夠泛化到未見過的手和物體的模型。

因此,在這個工作中,我們關注于這樣一個非常有挑戰的任務——在不用任何真實數據作訓練的前提下,對自然條件下的點云序列,聯合追蹤并重建人手和物體。我們的任務設定如下所述:給定一個包含已分割的手和物體的深度點云序列,還有初始的手部位姿和物體位姿,我們的算法需要去重建手和物體的幾何形狀,并以一個在線的方式(即對于第幀的預測只能利用當前幀和過去幀的信息,不能利用未來幀的信息)對他們的位姿進行追蹤。我們選擇點云這一模態作為輸入而非圖片是因為他們具有更加準確的三維結構,便于我們感知手和物體的位姿,并且具有更小的歧義性。

為了實現這一目標,首先,為了緩解數據問題,我們提出了一套流程來合成手和物體交互的仿真數據集。該數據集擁有非常高的多樣性,無論是手的形狀、物體的形狀,還是兩者的交互姿勢;此外,得益于仿真環境的優勢,這些數據帶有免費的位姿和形狀標注。為了最小化仿真和現實的領域差異,我們利用 DDS[8]提出的基于結構光的深度傳感器模擬器,生成帶有真實傳感器噪聲的仿真點云。

除此之外,我們首次提出了一個基于點云的手部姿勢跟蹤網絡,HandTrackNet,以追蹤幀間手部關節的運動。HandTrackNet 建立在 PointNet++[9]的基礎上,基于上一幀的預測來估計當前幀手部關節位置的變化。相較于單幀回歸的算法,這樣做壓縮了輸出數據的分布空間,簡化了回歸任務,增強了時序上的連續性。此外,HandTrackNet 會從上一幀的預測中計算手的全局位姿,并利用手的全局位姿來將當前幀的輸入點云變換到一個規范化的坐標系內,這極大地壓縮了輸入數據的分布空間,進一步簡化了回歸任務。在訓練過程中,HandTrackNet 會學習修正隨機的手部關節擾動,因此不會過擬合到任何時序軌跡上。

最后,為了更好的解決手和物體遮擋帶來的歧義性,我們進一步利用基于優化的方法來推理手和物體之間的空間關系,獲取物理上更加真實的預測。我們先將追蹤到的手部關節位置轉化為 MANO[10]這一參數化模型的表示,得到手部幾何的重建,然后根據手和物體交互的先驗構建幾個能量函數,用于進一步調整手的位姿,從而產生更加符合物理規律、更加真實的手部位姿。

通過充分的實驗,我們證明了我們的方法在從未見過的真實世界手和物體交互數據集 HO3D[7]和 DexYCB[6]中的有效性。我們的方法在手和物體的位姿追蹤精度上明顯優于之前的方法,并顯示出良好的追蹤魯棒性和極強的泛化性。整個算法能夠以交互式幀率(約9FPS)進行在線跟蹤和重建。

02

方法簡介

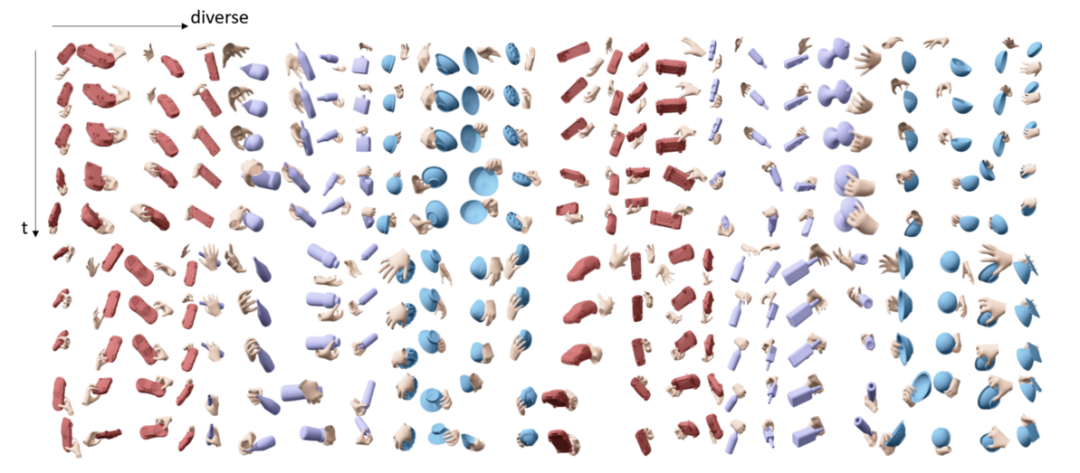

圖3. 我們生成的 SimGrasp 數據集。

首先,為了應對數據不足的問題,我們在仿真環境中造了一個手和物體交互的數據集 SimGrasp,包含超過450個不同的物體和100個不同大小的手,一共生成了1810段視頻,每段視頻有100幀。我們首先使用 GraspIt[11]來生成了一些手和物體呈持握狀態的數據,然后將手往手背方向挪一定距離,并通過對位姿插值的方式獲取動態抓取的視頻。為了減少 Sim2real 的巨大差異,我們重新實現了 DDS 算法[8],基于結構光深度相機的原理,在仿真環境中模擬了真實相機點云會產生的噪聲。

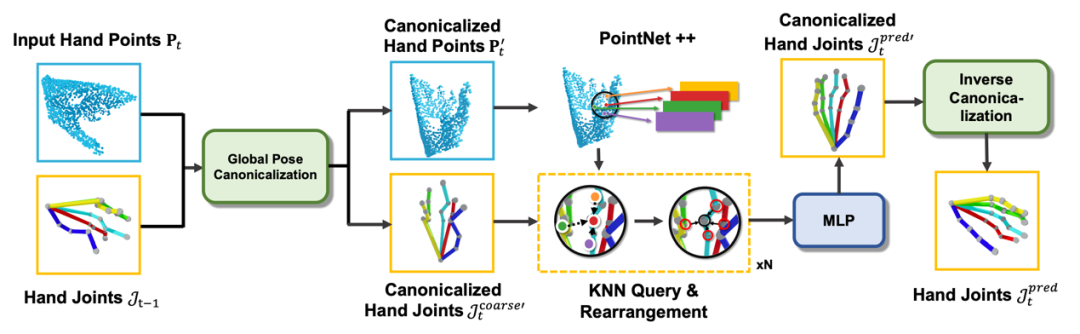

圖4. HandTrackNet 結構示意圖。

在方法上,我們首次提出了一個基于點云的手部關節追蹤網絡 HandTrackNet,該網絡接收當前第幀的手部點云和上一幀預測的手部關節位置作為輸入,并對二者進行全局姿勢規范化處理。然后,它利用 PointNet++[9]從規范化的手部點云中提取特征,并使用每個關節進行近鄰查詢和特征傳遞,最后用一個多層線性感知機來回歸并更新關節位置。

其中,主要的創新部分在于利用上一幀預測的關節位置來進行全局姿勢規范化上。前人的工作[5]發現手的全局位姿的多樣性會給網絡預測關節位置帶來很大的困難,而如果能夠設計比較好的全局位姿規范化方法,使得所有的輸入點云都能被變換到同一個規范位姿下(例如手心朝向軸,指尖指向軸),就能大大降低學習難度,提升泛化能力。注意到,按照之前定義的手部規范位姿,規范化的手部點云的第一特征向量應該平行軸,第二特征向量應該平行軸,因此前人工作[5]中大多使用 PCA 來獲取手部點云的外包圍盒,并利用上述特性進行手的全局姿勢規范化。然而,這樣的做法存在的缺陷是當手被嚴重遮擋時,獲取的外包圍盒無法很好地反應真實手部全局位姿,因此不適用于手和物體交互的場景。

而我們則是注意到,手部指根處的關節點相對位置無論手指怎么動都是基本不變的,因此我們可以用 SVD 求解上一幀指根關節位置相對于預定義的規范位姿下的指根位置的平移和旋轉,結合視頻的連續性,利用這一平移和旋轉去規范化當前幀的手部點云輸入。

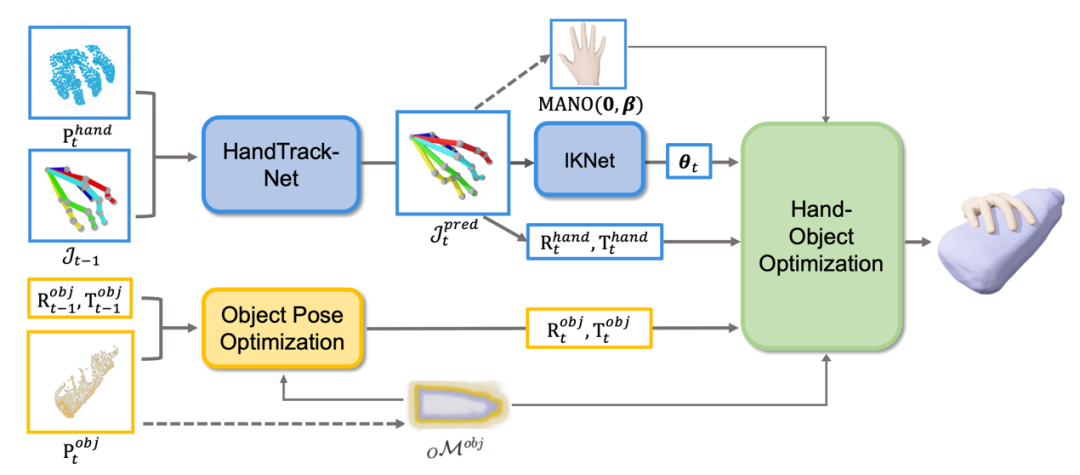

圖5. 完整流程圖。第0幀,我們會重建手和物體的幾何(如虛線所示);后續每一幀,我們會分別預測物體的位姿和手的位姿,并通過優化來進一步修復手的位姿。我們還可以每10幀更新一次手和物體的幾何。

利用 HandTrackNet 獲取手部關節位置后,我們利用一個簡單的多層感知機網絡 IKNet 將手部關節位置轉化成了手部各關節角度,將作為 MANO 這一常用的手部參數化模型的輸入,結合第0幀通過優化獲得的手部形狀參數,就可以得到手的完整三維重建了。而物體這一支,我們在第0幀利用 DeepSDF[12]的技術來根據觀察到的點云去重建類別級未知物體的幾何形狀,并在之后每一幀通過優化的辦法來解算物體位姿。最后,我們還使用了一個聯合優化的模塊,使用手與物體不會互相穿透、手指會貼近物體表面等條件作為能量函數來優化手的位姿,獲取更符合物理規律、更真實的手物交互。我們還可以每隔10幀更新一次手和物體的幾何,降低初始化時的幾何誤差對后續追蹤的影響。

03

實驗結果

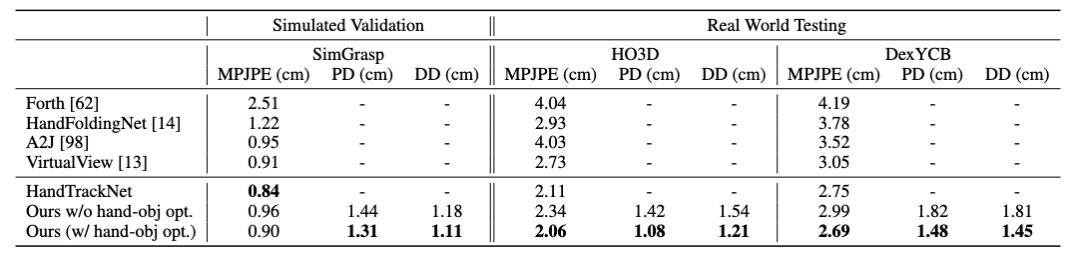

我們僅僅使用我們合成的仿真數據集 SimGrasp 進行訓練,在不使用任何真實數據進一步訓練的情況下,直接在 HO3D[7]和 DexYCB[6]這兩個具有挑戰性的真實數據集上進行測試。相較于之前基于單幀預測的工作HandFoldingNet[13],A2J[14]和 VirtualView[15]以及基于追蹤的工作 Forth[16],我們的方法在平均關節位置誤差這項指標上在兩個數據集中分別能顯著提升6mm 和3mm 以上。

圖6. 手部關節追蹤實驗結果。MPJPE 指平均關節位置誤差,PD 指手和物體最大穿透深度,DD 指手和物體在接觸時手指到物體上最近點的平均距離。

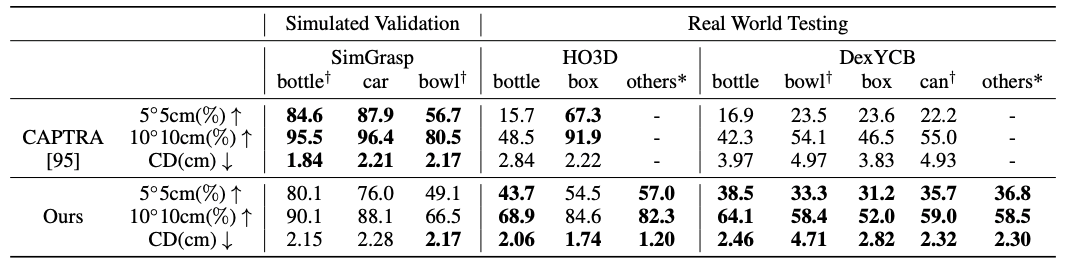

物體追蹤方面,雖然之前的工作 CAPTRA[17]在驗證集上能獲得更好的表現,但是在真實數據的測試集上,我們基于優化的方法能夠一致地超過它,證明了我們方法具有更強的泛化能力。

圖7. 物體追蹤實驗結果。5度5cm 指旋轉誤差小于5度且平移誤差小于5cm 的百分比,10度10cm 同理,CD 指帶位姿的重建物體和標注物體的倒角距離(Chamfer distance)。

審核編輯 :李倩

-

算法

+關注

關注

23文章

4784瀏覽量

98060 -

仿真器

+關注

關注

14文章

1051瀏覽量

87275 -

人工智能

+關注

關注

1817文章

50098瀏覽量

265387 -

點云

+關注

關注

0文章

59瀏覽量

4076

原文標題:AAAI 2023 Oral | 北京大學等提出HandTrackNet:點云序列中手物交互的位姿追蹤與重建

文章出處:【微信號:CVer,微信公眾號:CVer】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

北京大學口腔醫學院采購南京大展新品同步熱分析儀

曙光云立體密算體系重磅發布

北京大學在光生微波領域取得重要進展

北京光庭出席汽車產業協同創新峰會

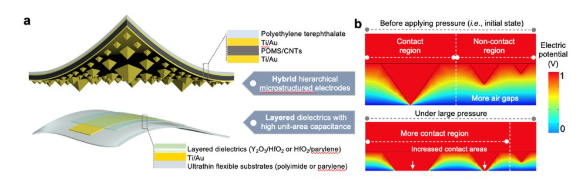

北京大學彭練矛院士團隊在高性能壓力傳感領域取得重要進展!突破性能瓶頸!

光電融合!中國團隊突破6G全頻段通信瓶頸

2025商湯獎學金夏令營活動圓滿落幕

知存科技助力北京大學校友論壇圓滿落幕

國際首創新突破!中國團隊以存算一體排序架構攻克智能硬件加速難題

知存科技創始人向北大、清華、協和醫學院捐贈880萬激勵創新

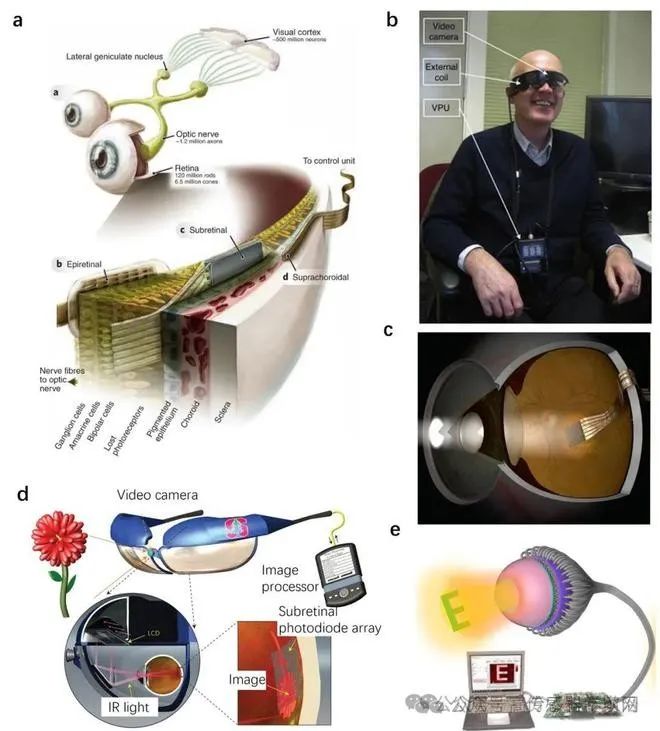

北京理工大學:研究眼機界面智能傳感硬件——從可穿戴到仿生

香橙派AIpro(20T)走進北京大學、上海交通大學等高校鯤鵬昇騰科教創新卓越中心特訓營

北京大學等提出HandTrackNet:點云序列中手物交互的位姿追蹤與重建

北京大學等提出HandTrackNet:點云序列中手物交互的位姿追蹤與重建

評論