上線僅2個(gè)月,OpenAI的最新一代產(chǎn)品-AI聊天機(jī)器人ChatGPT月活用戶接近1億。

作為自然語言處理(NLP)領(lǐng)域的前沿研究成果之一,ChatGPT已成為AIGC里程碑式的產(chǎn)品。

這周我們也與ChatGPT聊了聊他/她對(duì)大規(guī)模預(yù)訓(xùn)練背后所需資源的看法。

讓我們一起來看看ChatGPT的回答是否能讓你滿意呢?

強(qiáng)大的語言生成能力現(xiàn)在引起更多討論的是規(guī)模預(yù)訓(xùn)練。在過去的很長(zhǎng)一段時(shí)間里,許多的AI廠商都是通過本地設(shè)備來進(jìn)行訓(xùn)練的。

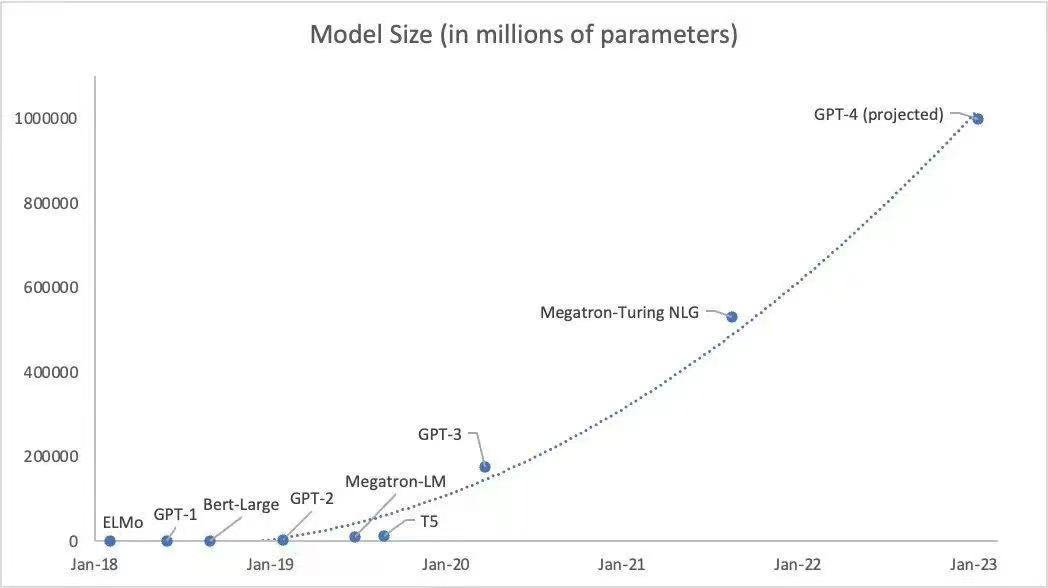

GPT-3所訓(xùn)練的參數(shù)約為1750億個(gè),這部分需要大量的算力,而目前我們已知ChatGPT導(dǎo)入了至少1萬顆英偉達(dá)高端GPU來訓(xùn)練模型。

業(yè)界部分專家認(rèn)為GPT-4訓(xùn)練參數(shù)可能會(huì)達(dá)到100萬億個(gè)參數(shù),如此大規(guī)模、長(zhǎng)時(shí)間的GPU集群訓(xùn)練任務(wù),也對(duì)網(wǎng)絡(luò)互聯(lián)底座的性能、可靠性、成本等各方面都提出了極致的要求。

面對(duì)千億、萬億參數(shù)規(guī)模的大模型訓(xùn)練,僅僅是單次計(jì)算迭代內(nèi)梯度同步需要的通信量就高達(dá)TB量級(jí)。此外還有各種并行模式、加速框架引入的通信需求,使得傳統(tǒng)低速網(wǎng)絡(luò)的帶寬遠(yuǎn)遠(yuǎn)無法支撐GPU集群的高效計(jì)算,甚至成為了其中關(guān)鍵的瓶頸。

因此要充分發(fā)揮GPU計(jì)算資源的強(qiáng)大算力,必須構(gòu)建一個(gè)全新的高性能網(wǎng)絡(luò)底座,用高速網(wǎng)絡(luò)的大帶寬來助推整個(gè)集群計(jì)算的高效率。

以CPU+GPU的異構(gòu)計(jì)算模型已經(jīng)成為高性能計(jì)算領(lǐng)域中的主流計(jì)算架構(gòu)。而高吞吐、低延時(shí)是高性能計(jì)算場(chǎng)景中最為迫切的應(yīng)用需求。

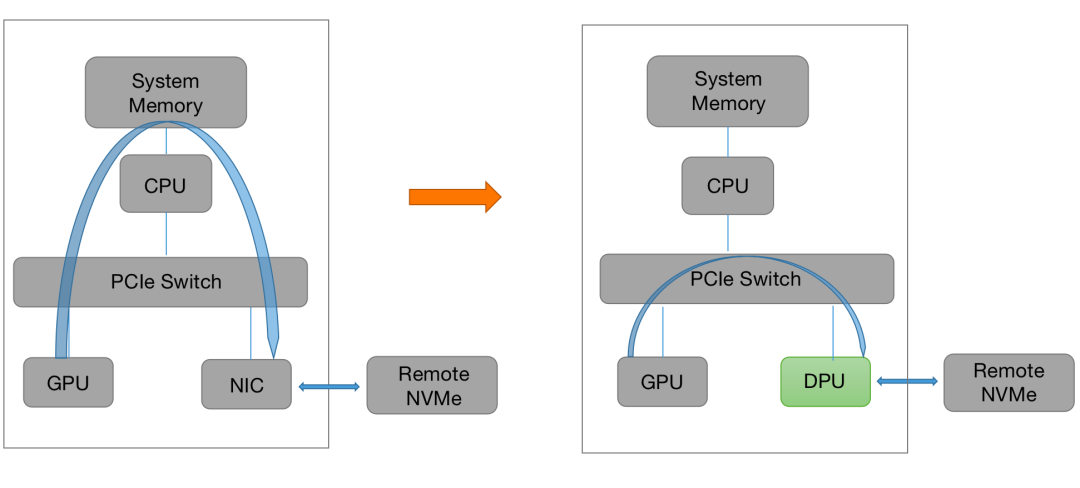

我們可以知道,GPUDirect RDMA是RDMA在異構(gòu)計(jì)算場(chǎng)景中的應(yīng)用延伸,使得GPU之間的通信不在依賴CPU轉(zhuǎn)發(fā),從而進(jìn)一步提升高性能計(jì)算場(chǎng)景中整體算力。

從DPU芯片的實(shí)現(xiàn)角度看,不同DPU廠商的核心競(jìng)爭(zhēng)壁壘在于專用加速引擎的硬件實(shí)現(xiàn)上。由于DPU是數(shù)據(jù)中心中所有服務(wù)器的流量入口,并以處理報(bào)文的方式處理數(shù)據(jù),在網(wǎng)絡(luò)芯片領(lǐng)域積累更多的廠商將更有優(yōu)勢(shì)。

傳統(tǒng)的GPU在訪問存儲(chǔ)時(shí),需要將數(shù)據(jù)先搬移到系統(tǒng)內(nèi)存,再由系統(tǒng)內(nèi)存搬移到目標(biāo)設(shè)備。而采用DPU介入后可以繞過CPU,直接通過PCIe訪問遠(yuǎn)端的NVMe設(shè)備,加速AI訓(xùn)練,大大降低CPU的開銷。

在AI/ML領(lǐng)域的工作負(fù)載對(duì)于存儲(chǔ)系統(tǒng)的要求十分苛刻,目前此類應(yīng)用已主要采用全閃存存儲(chǔ),其中NVMe全閃存逐漸成為主流趨勢(shì)。同時(shí)存儲(chǔ)與前端應(yīng)用主機(jī)的網(wǎng)絡(luò)存儲(chǔ)協(xié)議開始采用NVMe over Fabrics(NVMe-oF)。

NVMe-oF是一種存儲(chǔ)網(wǎng)絡(luò)協(xié)議,通過網(wǎng)絡(luò)將NVMe命令傳送到遠(yuǎn)程N(yùn)VMe子系統(tǒng),以利用NVMe 全閃存的并行訪問和低延遲,該規(guī)范定義了一個(gè)協(xié)議接口,旨在與高性能fabric技術(shù)配合使用,包括通過實(shí)現(xiàn)RDMA技術(shù)的InfiniBand、RoCE v2、iWARP或TCP。

NVMe-oF是一種使用NVMe協(xié)議將訪問擴(kuò)展到遠(yuǎn)程存儲(chǔ)系統(tǒng)的非易失性存儲(chǔ)器(NVM)設(shè)備的方法。這使得前端接口能夠連接到存儲(chǔ)系統(tǒng)中,擴(kuò)展到大量NVMe設(shè)備,并延長(zhǎng)數(shù)據(jù)中心內(nèi)可以訪問NVMe子系統(tǒng)的距離。NVMe-oF的目標(biāo)是顯著改善數(shù)據(jù)中心網(wǎng)絡(luò)延遲,并為遠(yuǎn)程N(yùn)VMe設(shè)備提供近似于本地訪問的延遲,目標(biāo)為10us。

我們知道AI對(duì)計(jì)算的需求非常大,目前主流的AI加速還是以GPU、FPGA和一些專門的AI芯片等為主。在GPU、AI芯片用于AI計(jì)算之前都是CPU承擔(dān)計(jì)算的任務(wù),CPU的效率難以滿足需求,從而產(chǎn)生CPU+GPU+ASIC的異構(gòu)計(jì)算。隨著DPU的出現(xiàn),這種異構(gòu)計(jì)算的發(fā)展更加徹底,可以更大提供并行處理能力,適合大規(guī)模計(jì)算的發(fā)展。

支持Chiplet技術(shù)的超異構(gòu)算力芯片,伴隨著AI/ML的發(fā)展將會(huì)得到更好的應(yīng)用,而支持Die-To-Die互聯(lián)技術(shù)將能夠提供互聯(lián)其他AI芯片和算力單元的巨大能力,擺脫一直以來PCIe發(fā)展的限制。 ??拿芯啟源自身舉例,以支持高級(jí)AI為主要目標(biāo)之一的芯啟源最新的DPU芯片,其架構(gòu)中就應(yīng)用Chiplet技術(shù)。不僅提升了自有智能網(wǎng)卡的性能,通過支持與第三方芯片的Die-To-Die互聯(lián),還可以集成更多的特定專業(yè)領(lǐng)域的芯片,比如AI訓(xùn)練中的GPU芯片。

雖然PCIe非常的標(biāo)準(zhǔn),但是帶寬非常有限的,PCIe Gen3的理論帶寬是32GB/s,PCIe Gen4的理論帶寬是64GB/s,而實(shí)測(cè)帶寬大概分別是24GB/s和48GB/s。

在AI訓(xùn)練中,每完成一輪計(jì)算,都要同步更新一次參數(shù),也就是權(quán)系數(shù)。模型規(guī)模越大,參數(shù)規(guī)模一般也會(huì)更大,這樣算力芯片的效率會(huì)收到PCIe架構(gòu)的限制,支持更高能力層次的互聯(lián)技術(shù)講徹底解決帶寬限制和瓶頸,極大提升單節(jié)點(diǎn)計(jì)算效率。

和ChatGPT聊了那么多,最后再讓我們來看看他/她對(duì)于DPU應(yīng)用了解多少呢?

審核編輯 :李倩

-

AI

+關(guān)注

關(guān)注

91文章

39793瀏覽量

301406 -

DPU

+關(guān)注

關(guān)注

0文章

414瀏覽量

26971 -

chiplet

+關(guān)注

關(guān)注

6文章

495瀏覽量

13603

原文標(biāo)題:爆紅智能AI如何看待DPU ChatGPT這樣說

文章出處:【微信號(hào):corigine,微信公眾號(hào):芯啟源】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

瑞芯微SOC智能視覺AI處理器

電子寵物“賣爆了”,網(wǎng)紅“摩突突”BOM成本僅20多元

NVIDIA推出全新BlueField-4 DPU

AI賦能6G與衛(wèi)星通信:開啟智能天網(wǎng)新時(shí)代

【「AI芯片:科技探索與AGI愿景」閱讀體驗(yàn)】+具身智能芯片

在學(xué)習(xí)D13的芯片配置,為什么我vscode,一堆爆紅,看著好煩,有沒有解決辦法

利用NVIDIA DPU重塑網(wǎng)絡(luò)安全格局

AI 邊緣計(jì)算網(wǎng)關(guān):開啟智能新時(shí)代的鑰匙?—龍興物聯(lián)

信而泰×DeepSeek:AI推理引擎驅(qū)動(dòng)網(wǎng)絡(luò)智能診斷邁向 “自愈”時(shí)代

最新人工智能硬件培訓(xùn)AI基礎(chǔ)入門學(xué)習(xí)課程參考2025版(離線AI語音視覺識(shí)別篇)

達(dá)實(shí)智能如何看待行業(yè)的發(fā)展

第三屆NVIDIA DPU黑客松開啟報(bào)名

【解構(gòu)·AI玩具】從“小智AI”引爆開發(fā)者熱潮說起

爆紅智能AI如何看待DPU

爆紅智能AI如何看待DPU

評(píng)論