PaddleSlim 發布 AI 模型自動壓縮的工具,帶來全新升級 AI 模型一鍵自動壓縮體驗。歡迎廣大開發者使用 NVIDIA 與飛槳聯合深度適配的 NGC 飛槳容器在 NVIDIA GPU 上體驗!

PaddleSlim 自動壓縮工具,

30+CV、NLP 模型實戰

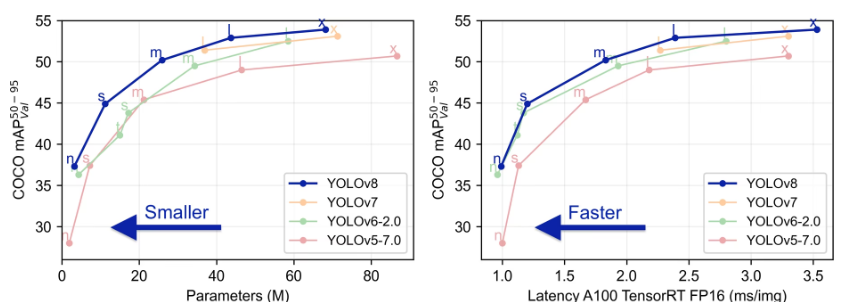

眾所周知,計算機視覺技術(CV)是企業人工智能應用比重最高的領域之一。為降低企業成本,工程師們一直在探索各類模型壓縮技術,來產出“更準、更小、更快”的 AI 模型部署落地。而在自然語言處理領域(NLP)中,隨著模型精度的不斷提升,模型的規模也越來越大,例如以 BERT、GPT 為代表的預訓練模型等,這成為企業 NLP 模型部署落地的攔路虎。

針對企業落地模型壓縮迫切的需求,PaddleSlim 團隊開發了一個低成本、高收益的 AI 模型自動壓縮工具(ACT, Auto Compression Toolkit),無需修改訓練源代碼,通過幾十分鐘量化訓練,保證模型精度的同時,極大的減小模型體積,降低顯存占用,提升模型推理速度,助力 AI 模型的快速落地!

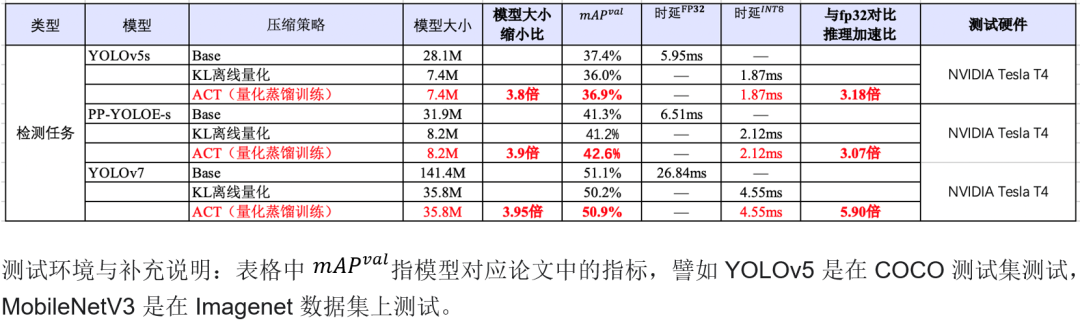

使用 ACT 中的基于知識蒸餾的量化訓練方法訓練 YOLOv7 模型,與原始的 FP32 模型相比,INT8 量化后的模型減小 75%,在 NVIDIA GPU 上推理加速 5.90 倍。

?表1 自動壓縮工具在 CV 模型上的壓縮效果和推理加速

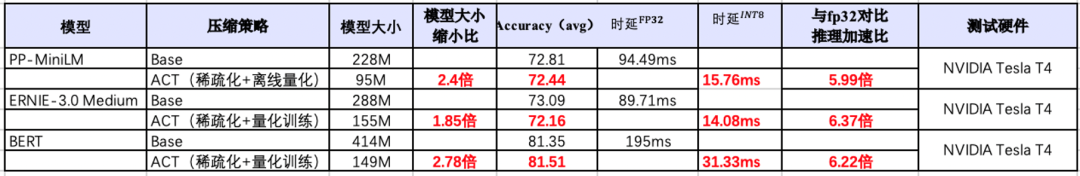

?表1 自動壓縮工具在 CV 模型上的壓縮效果和推理加速使用 ACT 中的結構化稀疏和蒸餾量化方法訓練 ERNIE3.0 模型,與原始的 FP32 對比,INT8 量化后的模型減小 185%,在 NVIDIA GPU 上推理加速 6.37 倍。

表2 自動壓縮工具在 NLP 模型上的壓縮效果和推理加速

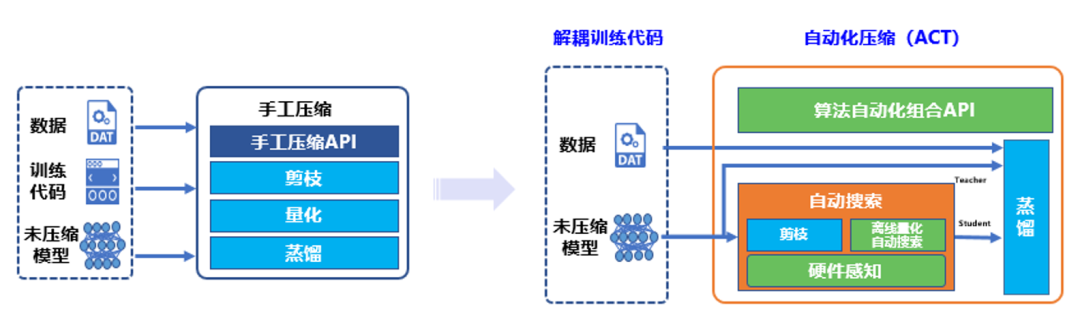

支持如此強大功能的核心技術是來源于 PaddleSlim 團隊自研的自動壓縮工具。自動壓縮相比于傳統手工壓縮,自動化壓縮的“自動”主要體現在 4 個方面:解耦訓練代碼、離線量化超參搜索、算法自動組合和硬件感知。

圖1 傳統手工壓縮與自動化壓縮工具對比

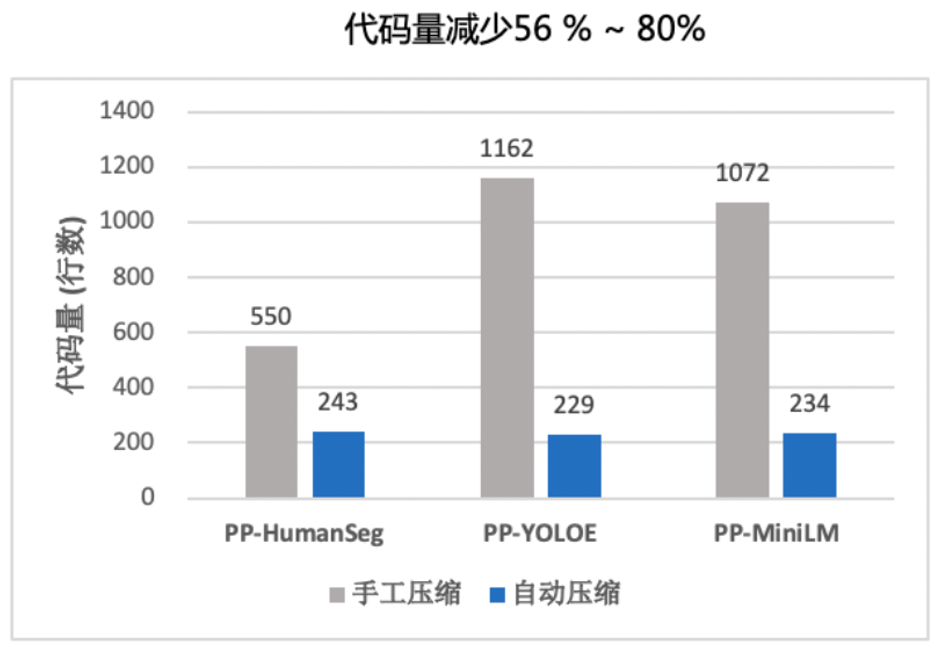

圖2 傳統手工壓縮與自動化壓縮工具代碼量對比

更多詳細文檔,請參考:

https://github.com/PaddlePaddle/PaddleSlim/tree/develop/example/auto_compression

PaddleSlim 研發團隊詳解自動壓縮工具 CV 模型和NLP模型兩日課回放,可以掃描下方二維碼,加入自動壓縮技術官方交流群獲取。除此之外,入群福利還包括:深度學習學習資料、歷屆頂會壓縮論文、百度架構師詳解自動壓縮等。

NGC 飛槳容器介紹

如果您希望體驗自動壓縮工具的新特性,歡迎使用 NGC 飛槳容器。NVIDIA 與百度飛槳聯合開發了 NGC 飛槳容器,將最新版本的飛槳與最新的 NVIDIA 的軟件棧(如 CUDA)進行了無縫的集成與性能優化,最大程度的釋放飛槳框架在 NVIDIA 最新硬件上的計算能力。這樣,用戶不僅可以快速開啟 AI 應用,專注于創新和應用本身,還能夠在 AI 訓練和推理任務上獲得飛槳+NVIDIA 帶來的飛速體驗。

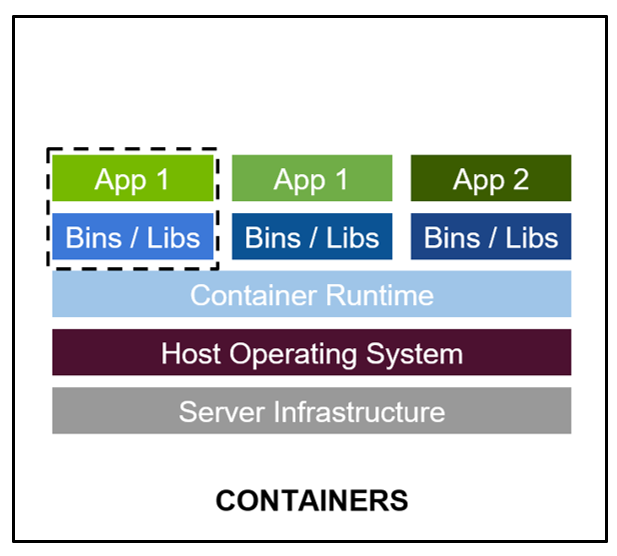

最佳的開發環境搭建工具 - 容器技術。

-

容器其實是一個開箱即用的服務器。極大降低了深度學習開發環境的搭建難度。例如你的開發環境中包含其他依賴進程(redis,MySQL,Ngnix,selenium-hub 等等),或者你需要進行跨操作系統級別的遷移。

-

容器鏡像方便了開發者的版本化管理

-

容器鏡像是一種易于復現的開發環境載體

-

容器技術支持多容器同時運行

最好的 PaddlePaddle 容器

NGC 飛槳容器針對 NVIDIA GPU 加速進行了優化,并包含一組經過驗證的庫,可啟用和優化 NVIDIA GPU 性能。此容器還可能包含對 PaddlePaddle 源代碼的修改,以最大限度地提高性能和兼容性。此容器還包含用于加速 ETL(DALI,RAPIDS)、訓練(cuDNN,NCCL)和推理(TensorRT)工作負載的軟件。

PaddlePaddle 容器具有以下優點:

-

適配最新版本的 NVIDIA 軟件棧(例如最新版本 CUDA),更多功能,更高性能。

-

更新的 Ubuntu 操作系統,更好的軟件兼容性

-

按月更新

-

滿足 NVIDIA NGC 開發及驗證規范,質量管理

通過飛槳官網快速獲取

環境準備

使用 NGC 飛槳容器需要主機系統(Linux)安裝以下內容:

-

Docker 引擎

-

NVIDIA GPU 驅動程序

-

NVIDIA 容器工具包

有關支持的版本,請參閱 NVIDIA 框架容器支持矩陣和 NVIDIA 容器工具包文檔。

不需要其他安裝、編譯或依賴管理。無需安裝 NVIDIA CUDA Toolkit。

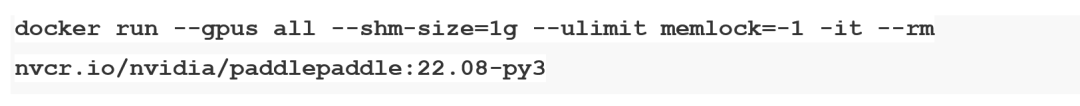

NGC 飛槳容器正式安裝:

要運行容器,請按照 NVIDIA Containers For Deep Learning Frameworks User’s Guide 中 Running A Container 一章中的說明發出適當的命令,并指定注冊表、存儲庫和標簽。有關使用 NGC 的更多信息,請參閱 NGC 容器用戶指南。如果您有 Docker 19.03 或更高版本,啟動容器的典型命令是:

*詳細安裝介紹 《NGC 飛槳容器安裝指南》

https://www.paddlepaddle.org.cn/documentation/docs/zh/install/install_NGC_PaddlePaddle_ch.html

*詳細產品介紹視頻

【飛槳開發者說|NGC 飛槳容器全新上線 NVIDIA 產品專家全面解讀】

https://www.bilibili.com/video/BV16B4y1V7ue?share_source=copy_web&vd_source=266ac44430b3656de0c2f4e58b4daf82

原文標題:在 NVIDIA NGC 上搞定模型自動壓縮,YOLOv7 部署加速比 5.90,BERT 部署加速比 6.22

文章出處:【微信公眾號:NVIDIA英偉達】歡迎添加關注!文章轉載請注明出處。

-

英偉達

+關注

關注

23文章

4087瀏覽量

99198

原文標題:在 NVIDIA NGC 上搞定模型自動壓縮,YOLOv7 部署加速比 5.90,BERT 部署加速比 6.22

文章出處:【微信號:NVIDIA_China,微信公眾號:NVIDIA英偉達】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

如何在NVIDIA Jetson AGX Thor上部署1200億參數大模型

利用NVIDIA Cosmos開放世界基礎模型加速物理AI開發

使用ROCm?優化并部署YOLOv8模型

Cadence 借助 NVIDIA DGX SuperPOD 模型擴展數字孿生平臺庫,加速 AI 數據中心部署與運營

求助,關于K230部署yolov8時遇到問題求解

如何本地部署NVIDIA Cosmos Reason-1-7B模型

如何在魔搭社區使用TensorRT-LLM加速優化Qwen3系列模型推理部署

Cognizant將與NVIDIA合作部署神經人工智能平臺,加速企業人工智能應用

在 NVIDIA NGC 上搞定模型自動壓縮,YOLOv7 部署加速比 5.90,BERT 部署加速比 6.22

在 NVIDIA NGC 上搞定模型自動壓縮,YOLOv7 部署加速比 5.90,BERT 部署加速比 6.22

評論