作為中文系學(xué)生,記得在學(xué)校時候老師叮囑有一本書一定要讀,那就是《文心雕龍》。

《文心雕龍》是由南朝劉勰所作,被魯迅先生認(rèn)為可以媲美亞里士多德的《詩學(xué)》。這部著作之所以寶貴,在于它根據(jù)中國文學(xué)的發(fā)展脈絡(luò),提出了文體、原道等一系列經(jīng)典理論。甚至在近現(xiàn)代歷史上,還讓“中國沒有自己文學(xué)理論”的說法不攻自破。

《文心雕龍》的成功,向我們展示了這樣一種理念:只有懂中國的內(nèi)容與語言,理解中國獨有的創(chuàng)作技巧、表達(dá)意境,才能提出符合中國的理論架構(gòu)。這一點或許可以從文學(xué)推而廣之,在更多與內(nèi)容創(chuàng)作相關(guān)的領(lǐng)域找到依據(jù)。

比如最近一段時間,AIGC異常火爆,尤其AI作畫已經(jīng)破圈到我身邊的每個人都想試試。但在一段時間之后,我們卻會發(fā)現(xiàn)大量海外的AI作畫平臺,在最終表達(dá)上似乎與中國創(chuàng)作者的需求有些偏差。

這種問題為什么存在?又應(yīng)該如何解決?

《文心雕龍》千年之后,另一個“文心”躍然而出。百度剛剛發(fā)布了文心系列大模型的新作——文心ERNIE-ViLG 2.0。

與其他AI作畫大模型相比,文心ERNIE-ViLG 2.0有兩個顯著的特點。首先在通用的理解能力和清晰度上更進一步,語義理解能力更強,生成的圖像更高清;另外一點就是它能夠更加準(zhǔn)確地理解中文表達(dá),也更懂中國文化。讓我們借著這個很有意思、也很獨特的AIGC差異化特質(zhì),聊聊文心ERNIE-ViLG 2.0的創(chuàng)新之路。

AI筆觸融華夏,文心依舊可雕龍。

AI作畫全球繁榮,但國人更需要基于語言與文化的理解

AI作畫其實并不是剛剛才興起,但愈發(fā)出色的繪畫能力,以及不斷降低的門檻,讓AI作畫在近半年時間風(fēng)靡全球,從一項“極客玩具” 徹底變成了街談巷議的大眾文化潮流。

AI作畫有多火?這個問題有很多答案,我們可以看到AI作畫的軟件、平臺創(chuàng)業(yè)者不斷增多,相關(guān)的全球投融資熱度在全球科技產(chǎn)業(yè)放緩的局面下一枝獨秀。“AI作畫拿下人類大獎”“AI作畫以假亂真”等消息不斷破圈,主流媒體也在爭相探討AI作畫會不會讓人類畫師感到壓力。

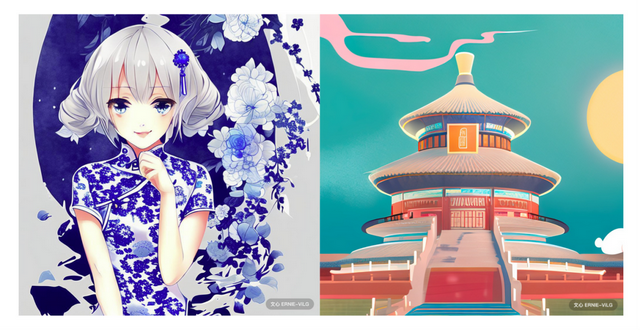

(ERNIE-ViLG 2.0在中國元素相關(guān)概念上創(chuàng)作的圖像:仙鶴、京劇)

在這種全球普遍的繁榮景象下,我們卻會注意到一重潛在的“缺失”,那就是國內(nèi)外蜂擁而起的AI作畫產(chǎn)品,背后的算法能力主要是來自基于擴散生成算法的DALL-E 2和Stable Diffusion等國外模型。或許有人會認(rèn)為這并沒有什么問題。當(dāng)然,我們也非常支持和推崇科技的全球化。但就實際應(yīng)用而言,國外大模型卻在AI作畫上有著不夠理解中國語言、文化的問題。這就像一個不通中文,也不理解中國文化的外國文學(xué)評論家,恐怕也難以寫出媲美《文心雕龍》的文藝?yán)碚摗?/p>

(ERNIE-ViLG 2.0 創(chuàng)作的圖像示例:令人震撼的科幻插圖杰作,神秘宇宙星辰背景中出現(xiàn)一只巨大的星球, 大場景,無比詳細(xì),明暗對比,32k)

具體到AI作畫中,我們會看到AI作畫的邏輯是根據(jù)文字描述生成畫面,而畫作又可能應(yīng)用到各行業(yè)的場景當(dāng)中。這就暴露出海外AI算法作為基礎(chǔ)存在的問題。比如說:

1.模型不能夠充分理解中文描述,導(dǎo)致生成畫面不夠精細(xì)、準(zhǔn)確。

2.模型不能理解中國行業(yè)與應(yīng)用場景的主要訴求、想法以及一般規(guī)則。這讓AI作畫更多停留在單純的繪畫創(chuàng)作階段,難以融入中國的行業(yè)訴求與行業(yè)場景。

3.模型不能準(zhǔn)確理解中國文化,也就難以創(chuàng)作出針對性的作品。比如讓海外AI模型創(chuàng)作與中國古典意境、節(jié)氣、節(jié)日相關(guān)的畫作,往往會產(chǎn)生巨大偏差。

面對AI作畫基礎(chǔ)模型的空白,文心ERNIE-ViLG 2.0成為了國內(nèi)首個在這一方向取得突破的工作。更懂中國文化的AI妙筆,已然成為現(xiàn)實。

丹青妙筆,中國心魂:文心ERNIE-ViLG 2.0的多樣化創(chuàng)新

從技術(shù)創(chuàng)新的邏輯上看,ERNIE-ViLG 2.0帶來的差異化是多方面的。首先,秉承著百度在文心大模型當(dāng)中探索的知識增強方向,ERNIE-ViLG 2.0本身在AI作畫的技術(shù)能力上帶來了大幅的提升。目前階段,主流AI作畫大模型依舊存在一些亟待解決的問題,其中最顯著的兩點就是語義理解不夠精細(xì),以及圖像不夠清晰。這些問題的存在,依舊限制了用戶對AI作畫的使用上限,尤其阻礙了復(fù)雜專業(yè)場景與AI作畫的結(jié)合。

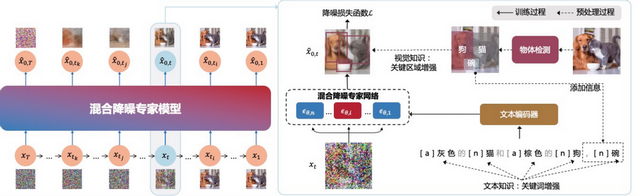

為此,ERNIE-ViLG 2.0采用了基于知識增強算法的混合降噪專家建模,使其成為全球首個將知識增強與AI作畫相互結(jié)合的大模型。同時,ERNIE-ViLG 2.0也是全球參數(shù)規(guī)模最大的AI作畫大模型。

據(jù)了解,ERNIE-ViLG 2.0 在文本生成圖像公開權(quán)威評測集 MS-COCO 和人工盲評上均超越了 Stable Diffusion、DALL-E 2等模型,取得了當(dāng)前該領(lǐng)域的世界最好效果,在語義可控性、圖像清晰度等方面均展現(xiàn)出了顯著優(yōu)勢。

(ERNIE-ViLG 2.0 創(chuàng)作的圖像示例:鳳凰周身火焰,多彩的祥云,明月,cg感)

讓我們具體來看,取得優(yōu)秀成績的ERNIE-ViLG 2.0是如何解決語義理解與畫面精度兩大通用問題的。

首先,在AI作畫模型的使用中,用戶會特別關(guān)注語義表達(dá)是否被準(zhǔn)確理解的問題,在生成比較復(fù)雜、多要素的畫作時尤其如此。為了提升相關(guān)能力,ERNIE-ViLG 2.0通過視覺、語言等多源知識指引擴散模型學(xué)習(xí),強化文圖生成擴散模型對于語義的精確理解。

基于語言和圖像知識的知識增強算法,提升了ERNIE-ViLG 2.0生成圖像的語義一致性和可控性。百度研究者提出了將知識增強算法融入擴散模型學(xué)習(xí)的方法,從而在擴散模型學(xué)習(xí)過程中,引入語言、視覺等多源知識,指引模型更加關(guān)注文本和圖像中的核心語義元素,同時針對訓(xùn)練數(shù)據(jù)噪聲帶來的訓(xùn)練圖文樣本語義偏差問題提出了文本語義補全的方法,對圖文的語義一致性進行針對性學(xué)習(xí),進而實現(xiàn)精準(zhǔn)的細(xì)粒度語義控制。

另一方面,用戶對AI生成畫作的精細(xì)度的需求也不斷提升。尤其用于行業(yè)場景,有明確指向的AI生成畫作,必須保證充分可用的圖像質(zhì)量。在這個方面,ERNIE-ViLG 2.0首次引入基于時間步的混合降噪專家模型來提升模型建模能力,讓模型在不同的生成階段選擇不同的“降噪專家”網(wǎng)絡(luò),從而實現(xiàn)更加細(xì)致的降噪任務(wù)建模,進而提升生成圖像的質(zhì)量。

(ERNIE-ViLG 2.0 架構(gòu)圖)

針對模型建模能力不足,導(dǎo)致圖像質(zhì)量不夠好的問題,百度研究者發(fā)現(xiàn),擴散模型的降噪過程中不同階段對降噪網(wǎng)絡(luò)的能力要求不同,初始階段模型需要從純隨機噪聲中生成圖像輪廓,結(jié)尾階段對模型的要求變?yōu)閷D像細(xì)節(jié)補全,傳統(tǒng)方法使用同一網(wǎng)絡(luò)建模整個降噪過程,模型需要同時滿足不同階段的建模需求。為此,百度提出了針對不同階段選擇不同網(wǎng)絡(luò)(降噪專家)進行建模的框架,可以有效解決不同階段對模型能力要求不一致的問題,減少降噪任務(wù)的互相干擾。由于每個生成階段只選取一個專家進行生成,實現(xiàn)了在不增加模型預(yù)測計算量的情況下對模型建模能力的擴充。

(ERNIE-ViLG 2.0在中國元素相關(guān)概念上創(chuàng)作的圖像:剪紙、鳳凰)

接下來,就要說到我們之前著重討論AI作畫對中文、中國文化的理解問題。這個領(lǐng)域的能力提升訣竅,在于模型訓(xùn)練需要結(jié)合海量的中文圖文數(shù)據(jù)。而對于海外科技公司與算法開發(fā)者來說,這樣的數(shù)據(jù)儲備難度太大、耗時太長,并且也缺乏足夠的市場動力。而百度則在這一領(lǐng)域具有先天的優(yōu)勢。從搜索到AI,再到深度學(xué)習(xí)框架、能力與大模型的不斷建設(shè),中文圖文數(shù)據(jù)都是百度AI發(fā)展的必選項和基礎(chǔ)項。于是,百度研究者構(gòu)建了近2億規(guī)模的高質(zhì)量中文圖文數(shù)據(jù)對,基于知識增強的混合降噪專家建模,從而使得ERNIE-ViLG 2.0具備了強大的中文語義理解能力。

最終我們可以發(fā)現(xiàn),ERNIE-ViLG 2.0具有非常精準(zhǔn)的中文理解能力,同時也對中國文化、中國元素有了充分的吸收。我們可以通過ERNIE-ViLG 2.0得到非常具有中國風(fēng)、中國文化意境的畫作。而這在其他模型中是很難實現(xiàn)的。

一幅山水寫文心,千行百業(yè)盡雕龍

對于廣大AI作畫的用戶與潛在用戶來說,最關(guān)注的事情莫過于文心ERNIE-ViLG 2.0的使用情況與使用前景。

在今天,我們可以看到AI作畫正處在高速發(fā)展的黃金階段。相信不久之后這項能力就會成為我們?nèi)粘+@得圖像內(nèi)容的基礎(chǔ)選項,完全融入我們的生活與工作。而在這種趨勢下,ERNIE-ViLG 2.0投入產(chǎn)業(yè)空間,服務(wù)千行百業(yè)的節(jié)奏也是非常快的。

在今年8月,ERNIE-ViLG 2.0模型就通過API服務(wù)的方式對外開放。一經(jīng)上線,就受到了廣大開發(fā)者和愛好者的關(guān)注。尤其值得注意的是,很多國外的開發(fā)者、AI作畫用戶都對ERNIE-ViLG 2.0給出了非常高的評價。認(rèn)為其效果遠(yuǎn)遠(yuǎn)超過目前其他的AI作畫模型。甚至有國外網(wǎng)友感嘆“最先進的 AI 動畫生成技術(shù)在中國”。這又一次證明了,民族的也就是世界的。

(ERNIE-ViLG 2.0 創(chuàng)作的圖像示例:srudio ghibli風(fēng)格,一個巨大的圓月、超現(xiàn)實的超自然村莊,抽象的生物形態(tài)建筑、白色,金色)

目前階段,AI作畫相關(guān)的軟件、平臺高速發(fā)展,開發(fā)者非常需要具有足夠強大能力的基礎(chǔ)模型。而ERNIE-ViLG 2.0已經(jīng)為廣大開發(fā)者、科技愛好者提供了飛槳開源工具和API服務(wù)能力,滿足開發(fā)者靈活探索等需求。對靈活性需求更高的開發(fā)者,可以使用飛槳的開源工具PaddleHub基于文圖生成開源算法極簡開發(fā),并完成模型的管理和一鍵預(yù)測。對便捷性需求更高的開發(fā)者,可以使用文心ERNIE-ViLG API,極速獲得沉浸式文圖生成大模型的技術(shù)體驗,更可靈活方便、高效地實現(xiàn)產(chǎn)品集成。

同時,對于更多需要AI作畫能力的普通用戶來說,百度已經(jīng)推出了基于ERNIE-ViLG 2.0大模型的AI 作畫產(chǎn)品—— AI藝術(shù)與創(chuàng)意輔助平臺:文心一格。目前,文心一格已經(jīng)成為了我們團隊小伙伴在圖像內(nèi)容創(chuàng)作方面的“輔助神器”。

(ERNIE-ViLG 2.0在中國元素相關(guān)概念上創(chuàng)作的圖像:青花瓷、建筑)

緊接著,我們可以看到ERNIE-ViLG 2.0的價值不僅僅停留在目前我們可以看到的AI作畫體驗。它更廣闊的價值在于千行百業(yè)的圖像內(nèi)容生成需求與整體數(shù)字化進展。在很多行業(yè),圖像設(shè)計和創(chuàng)作的價值都非常重要,比如工業(yè)設(shè)計、動漫設(shè)計、游戲制作、服裝設(shè)計等等。ERNIE-ViLG 2.0的未來發(fā)展空間,在于與各行業(yè)的設(shè)計需求、圖像升級需求相結(jié)合,成為輔助創(chuàng)作的效率助推器,提升相關(guān)行業(yè)的數(shù)字化、智能化水平。

隨著AI作畫的連續(xù)破圈,我們可以看到AIGC的新紀(jì)元正在開啟。這次突破一方面證明了AI技術(shù)本身具有連綿不絕的價值潛力,同時也展示了AI技術(shù)關(guān)鍵能力自主、自立、自強的必要性。

從這個角度看,ERNIE-ViLG 2.0作為文心大模型家族的新成員,既走在潮流前沿,也走在中國智能化的大道上。

AI妙筆,正在寫一部新時代的“文心雕龍”。

審核編輯 黃昊宇

-

AI

+關(guān)注

關(guān)注

91文章

39793瀏覽量

301420

發(fā)布評論請先 登錄

電子發(fā)燒友榮獲電子工業(yè)出版社博文視點 “2025 年度卓越合作伙伴”

商湯科技持續(xù)引領(lǐng)中國原生AI云廠商陣營

百度文心大模型5.0-Preview文本能力國內(nèi)第一

百度文心大模型X1.1正式發(fā)布

中興努比亞啟動接入百度文心4.5系列開源大模型

寧暢與與百度文心大模型展開深度技術(shù)合作

龍芯中科與文心系列模型開展深度技術(shù)合作

百度文心大模型X1 Turbo獲得信通院當(dāng)前大模型最高評級證書

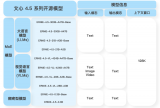

百度發(fā)布文心4.5 Turbo、X1 Turbo和多款AI應(yīng)用

百度文心快碼3.5升級,智能代碼助手正進入多模態(tài)智能體時代

一文讀懂,可重構(gòu)芯片為何是AI的完美搭檔

AI讀懂中國,文心方可雕龍

AI讀懂中國,文心方可雕龍

評論