01

引言

NAACL 會(huì)議是 ACL 的北美分會(huì),每年舉辦一次,也是 NLP 領(lǐng)域備受關(guān)注的頂會(huì)之一。NAACL 主要涉及對(duì)話、信息抽取、信息檢索、語言生成、機(jī)器翻譯、多模態(tài)、統(tǒng)計(jì)機(jī)器學(xué)習(xí)等多個(gè)方面。

本篇文章的作者Antoine SIMOULIN協(xié)助了NAACL 2022,他結(jié)合今年一些論文的情況,就大規(guī)模預(yù)訓(xùn)練語言模型的應(yīng)用、表現(xiàn)、期望等做了概述,總結(jié)并思考了當(dāng)今計(jì)算語言學(xué)的發(fā)展趨勢(shì)、不足與挑戰(zhàn)。

02

2.1大規(guī)模預(yù)訓(xùn)練語言模型數(shù)量增多

人們?cè)絹碓綐酚^地看待大規(guī)模預(yù)訓(xùn)練語言模型的潛在應(yīng)用,這使人們的注意力從它們?yōu)槭裁匆约叭绾喂ぷ鬓D(zhuǎn)移到如何確保它們?cè)诂F(xiàn)實(shí)世界中可以更好地工作。

對(duì)話是語言模型的直接應(yīng)用。Amazon Alexa AI高級(jí)首席科學(xué)家Dilek Hakkani-Tur表示,由于公共數(shù)據(jù)集、語言模型和產(chǎn)品的蓬勃發(fā)展,對(duì)話研究正處于激動(dòng)人心的階段。她還概述了剩余的挑戰(zhàn):基于知識(shí)的回復(fù)生成、開放域?qū)υ捴挟a(chǎn)生的事實(shí)響應(yīng)、知識(shí)攝取以及收集跨長(zhǎng)文檔或多源信息。

2.2 開放對(duì)話

通過給定恰當(dāng)格式的輸入文本并提供相關(guān)上下文,模型可以產(chǎn)生符合條件的輸出。這種交互對(duì)話范式可以應(yīng)用在很多任務(wù)上,如問答(Sanagavarapu et al. 2022 (opens new window), Qian et al. 2022 (opens new window), You et al. 2022 (opens new window))或摘要總結(jié)(Fang et al. 2022 (opens new window), Zhao et al. 2022 (opens new window), Asi et al. 2022 (opens new window))。此外,對(duì)話數(shù)據(jù)可用于學(xué)習(xí)高效的語言表示 (Zhou et al. 2022 (opens new window))。

2.3 結(jié)構(gòu)融合和常識(shí)知識(shí)

我們期望大規(guī)模預(yù)訓(xùn)練語言模型能夠準(zhǔn)確回答事實(shí)問題,讓模型擁有如“百科全書”一般的知識(shí)。知識(shí)圖譜提供了可以與神經(jīng)網(wǎng)絡(luò)一起使用的硬結(jié)構(gòu)信息。可以在命名實(shí)體及其關(guān)系之間進(jìn)行顯式通信(Ayoola et al. 2022 (opens new window)),或者將符號(hào)和顯式知識(shí)提煉成模型參數(shù)的隱式編碼知識(shí) (Moiseev et al. 2022 (opens new window))。

我們還希望大規(guī)模預(yù)訓(xùn)練語言模型擁有我們所有人擁有的日常知識(shí)。例如,我們希望模型不會(huì)生成“狗正在從噴氣式飛機(jī)上經(jīng)過”這樣的句子(Seo et al. 2022 (opens new window)),或牙刷在空間上應(yīng)與浴室相關(guān)而不是與客廳相關(guān)(Henlein and Mehler 2022 (opens new window))。

最后,這些事實(shí)取決于時(shí)間。如果是在模型訓(xùn)練后發(fā)生的事件,例如新冠肺炎大流行,那么模型并不會(huì)將其考慮在內(nèi),否則會(huì)導(dǎo)致時(shí)間錯(cuò)位 (Luu et al. 2022 (opens new window))。

2.4 推理

我們希望模型可以校對(duì)事實(shí)并推斷它們之間的關(guān)系。(Sun et al. 2022 (opens new window))提出了JointLK,這是一個(gè)在LM(語言模型)和KG(知識(shí)圖譜)之間進(jìn)行多步聯(lián)合推理的模型,可以解決問答任務(wù)。多跳問答任務(wù)也涉及推理,因?yàn)樗枰茢喽鄠€(gè)間接引用來連接詢問(query)中提到的實(shí)體。(Kinet al. 2022 (opens new window))提出了一種方法:對(duì)這種特定類型的問答使用知識(shí)庫。

2.5 超越語言本身

模型不僅僅需要精通語言,它們還需要捕捉語言背后的含義和意圖,捕捉真實(shí)世界的一些直觀表述,并對(duì)實(shí)體和現(xiàn)有的關(guān)系進(jìn)行復(fù)雜的推斷。要推動(dòng)大規(guī)模預(yù)訓(xùn)練的語言模型向前發(fā)展,關(guān)鍵是:僅憑文本可以訓(xùn)練高效且有意義的模型嗎?

2.6 多模態(tài)、多語言、對(duì)比學(xué)習(xí)

我們是否需要在訓(xùn)練過程中引入其他模態(tài),例如音頻信息或者圖像信息?事實(shí)上,嬰兒在學(xué)習(xí)時(shí)會(huì)受到多種類型信息的刺激。關(guān)于多模態(tài)學(xué)習(xí),(Zhang et al.2022 (opens new window))使用文本和圖像混合信息的對(duì)比框架來構(gòu)建句子編碼。(Wang et al. 2022 (opens new window))提出將文本和圖像結(jié)合起來,以更好地確認(rèn)命名實(shí)體識(shí)別。

2.7 語言學(xué)和符號(hào)結(jié)構(gòu)的地位

計(jì)算語言學(xué)見證了大規(guī)模預(yù)訓(xùn)練語言模型的廣泛使用,但大規(guī)模預(yù)訓(xùn)練語言模型對(duì)語言學(xué)和符號(hào)的假設(shè)很少。在激動(dòng)人心的小組會(huì)議上,Chitta Baral、Dilek Hakkani-Tür、Emily Bender和Chris Manning研究了這一觀察可能如何影響未來的研究方向。科研資金通常流向研究神經(jīng)網(wǎng)絡(luò)的工作,因此人們對(duì)利用語言學(xué)進(jìn)行分析并不感興趣。但神經(jīng)網(wǎng)絡(luò)是我們應(yīng)該追逐的唯一趨勢(shì)嗎?

Chris Manning根據(jù)經(jīng)驗(yàn)觀察到,孩子們可以在沒有任何語言學(xué)專業(yè)知識(shí)的情況下學(xué)習(xí)語言。我們或許可以從語言理論和概念中汲取靈感,如復(fù)合性、系統(tǒng)概括、符號(hào)的穩(wěn)定意義和校對(duì)相關(guān)。但是,我們應(yīng)該關(guān)注意義的直接表征,而不是語言本身,因?yàn)檎Z言是一種間接表征。

Emily Bender認(rèn)為如果沒有語言學(xué),包括結(jié)構(gòu)語言學(xué)、形態(tài)學(xué)、語法學(xué)、語義學(xué)、語言語用學(xué)、兒童語言習(xí)得、語言類型學(xué)和社會(huì)語言學(xué),那么NLP就不應(yīng)該作為一個(gè)領(lǐng)域而存在。

2.8 文本內(nèi)涵的定義

在SemEval研討會(huì)上,Jacob Andreas討論了語言模型在文本內(nèi)涵表示方面的潛力,以及是否可以單獨(dú)從文本中學(xué)習(xí)到文本的內(nèi)涵。會(huì)議期間多次提到關(guān)于文本的內(nèi)涵。文本內(nèi)涵是指世界上的外部參考,人們腦海中的內(nèi)部思想,還是用語言表達(dá)的觀念?更廣泛地說,我們可以期望一個(gè)模型在沒有任何形式的社交互動(dòng)或?qū)嶋H經(jīng)驗(yàn)的情況下,只憑借文本訓(xùn)練就展示人類的行為嗎?

2.9 巨大的能力帶來巨大的責(zé)任

隨著大規(guī)模預(yù)訓(xùn)練語言模型變得越來越可行和廣泛采用,工程師們對(duì)他們的觀念變得更加負(fù)責(zé)。

2.10 價(jià)值敏感設(shè)計(jì)

Batya Friedman就道德和技術(shù)想象力應(yīng)該如何塑造技術(shù)發(fā)表了公開演講。除了安全、可靠性、效率或成本等工程標(biāo)準(zhǔn)外,還應(yīng)考慮其他標(biāo)準(zhǔn),包括專注和身體完整性。為了使技術(shù)和社會(huì)結(jié)構(gòu)和諧發(fā)展,我們應(yīng)該衡量大規(guī)模語言模型帶來的的影響,例如規(guī)模、時(shí)間、結(jié)構(gòu)以及應(yīng)用人類價(jià)值觀作為評(píng)估系統(tǒng)性能的標(biāo)準(zhǔn)。

2.11 拓寬NLP

眾所周知,自然語言處理是一個(gè)快速發(fā)展的領(lǐng)域,但這個(gè)領(lǐng)域的演變非常多樣化,研究資源也非常集中。科技公司擁有巨大的行動(dòng)力,使學(xué)者難以跟上步伐。此外,研究資源在地理上分布不均,例如Manuel Montes-y-Gómez展示了墨西哥西班牙語NLP社區(qū)研究現(xiàn)狀,該研究不如美式英語先進(jìn)。

2.12 NLP未來的一些挑戰(zhàn):組成性、基礎(chǔ)或解釋

盡管大規(guī)模預(yù)訓(xùn)練語言模型非常令人興奮,并且我們對(duì)它們的可靠性和效率實(shí)現(xiàn)任務(wù)自動(dòng)化的能力越來越樂觀,但一些挑戰(zhàn)仍然存在。

一個(gè)挑戰(zhàn)是跟蹤模型為什么產(chǎn)生一個(gè)給定的輸出。(Tan 2022 (opens new window))區(qū)分了幾種我們能從模型或人類所期望的概念解釋和挑戰(zhàn)。

根據(jù)許多研究,模型在系統(tǒng)推廣和顯式組成方面是失敗的,因?yàn)樗鼈円蕾囉谔摷俚南嚓P(guān)性。在這方面,(Wei?enhorn et al. 2022 (opens new window))使用復(fù)合語義解析器來解決COGS數(shù)據(jù)集上的成分概括。(Qui et al. 2022 (opens new window)) 提出了一種基于上下文無關(guān)語法主干的數(shù)據(jù)增強(qiáng)方法。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4838瀏覽量

107800 -

計(jì)算

+關(guān)注

關(guān)注

2文章

460瀏覽量

40001 -

語言模型

+關(guān)注

關(guān)注

0文章

571瀏覽量

11319

原文標(biāo)題:結(jié)合NAACL2022對(duì)計(jì)算語言學(xué)趨勢(shì)的思考與分析

文章出處:【微信號(hào):zenRRan,微信公眾號(hào):深度學(xué)習(xí)自然語言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

自然語言處理NLP的概念和工作原理

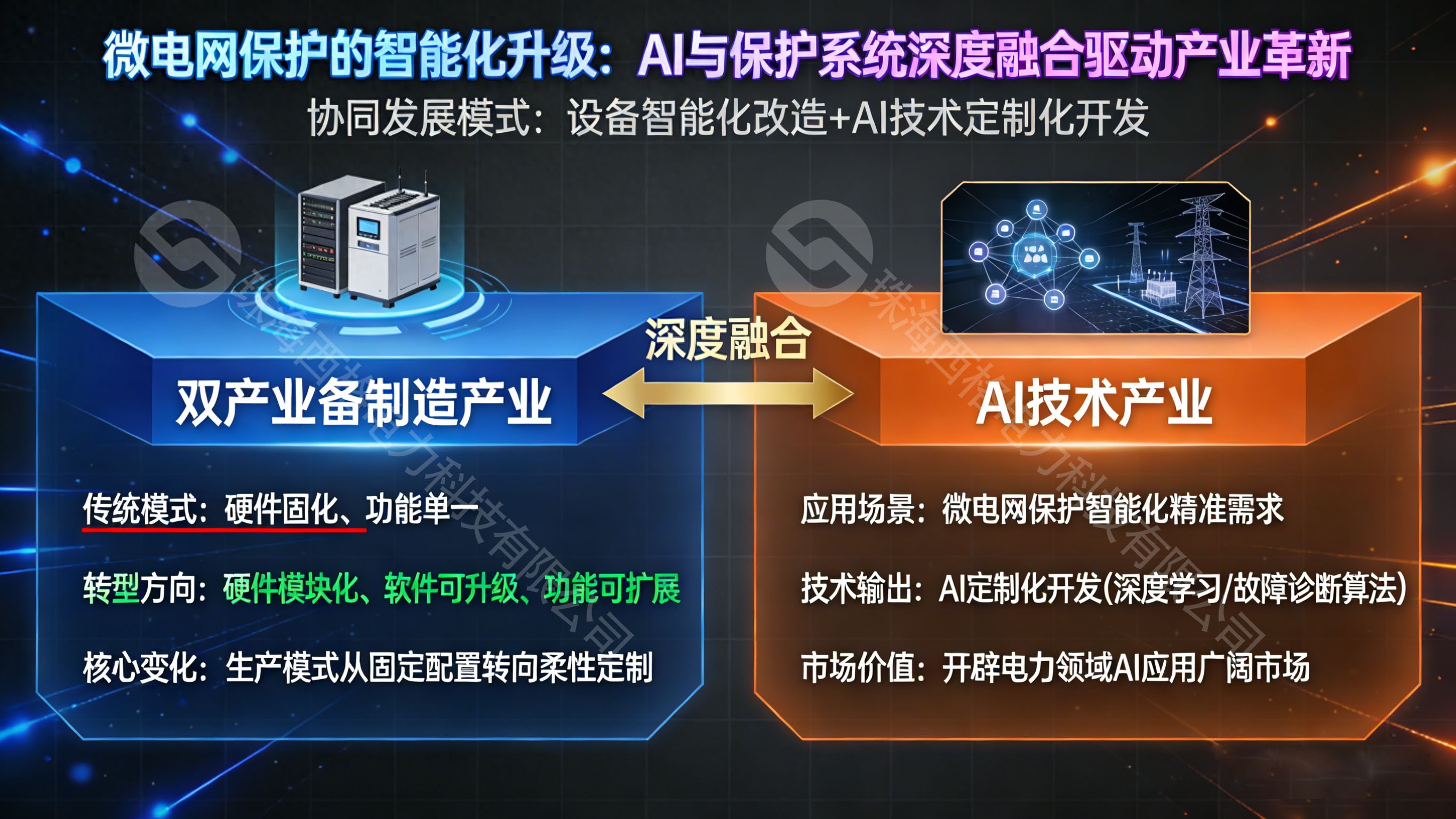

微電網(wǎng)保護(hù)的發(fā)展趨勢(shì)對(duì)相關(guān)產(chǎn)業(yè)有哪些影響?

微電網(wǎng)保護(hù)的發(fā)展趨勢(shì)是什么?

室外單模光纖技術(shù)發(fā)展趨勢(shì):邁向更高速度、更大容量

電磁環(huán)境模擬及偵察系統(tǒng)的作用、技術(shù)特點(diǎn)及未來發(fā)展趨勢(shì)

[新啟航]碳化硅 TTV 厚度測(cè)量技術(shù)的未來發(fā)展趨勢(shì)與創(chuàng)新方向

![[新啟航]碳化硅 TTV 厚度測(cè)量技術(shù)的未來<b class='flag-5'>發(fā)展趨勢(shì)</b>與創(chuàng)新方向](https://file1.elecfans.com/web3/M00/20/D6/wKgZPGhd-raAI0RYAACIgEePWXY565.png)

國際標(biāo)準(zhǔn)在分布式能源并網(wǎng)場(chǎng)景中的應(yīng)用現(xiàn)狀和發(fā)展趨勢(shì)是怎樣的?

AI工藝優(yōu)化與協(xié)同應(yīng)用的未來發(fā)展趨勢(shì)是什么?

人工智能技術(shù)的現(xiàn)狀與未來發(fā)展趨勢(shì)

工控機(jī)的現(xiàn)狀、應(yīng)用與發(fā)展趨勢(shì)

物聯(lián)網(wǎng)未來發(fā)展趨勢(shì)如何?

FPGA在數(shù)字化時(shí)代的主要發(fā)展趨勢(shì)

混合信號(hào)設(shè)計(jì)的概念、挑戰(zhàn)與發(fā)展趨勢(shì)

工業(yè)電機(jī)行業(yè)現(xiàn)狀及未來發(fā)展趨勢(shì)分析

基于RK芯片的主板定制化:挑戰(zhàn)、機(jī)遇與發(fā)展趨勢(shì)

計(jì)算語言學(xué)的發(fā)展趨勢(shì)、不足與挑戰(zhàn)

計(jì)算語言學(xué)的發(fā)展趨勢(shì)、不足與挑戰(zhàn)

評(píng)論