項(xiàng)目背景

我們正面臨著越來越多的嵌入機(jī)器學(xué)習(xí)革命。而當(dāng)我們談到機(jī)器學(xué)習(xí)(ML)時,首先想到的就是圖像分類,一種 ML Hello World!

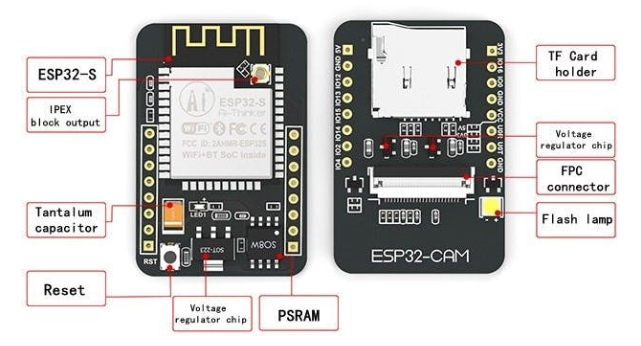

ESP32-CAM 是最受歡迎且價格合理的已集成攝像頭的開發(fā)板之一,它結(jié)合了 Espressif ESP32-S MCU 芯片和 ArduCam OV2640 攝像頭。

ESP32 芯片功能強(qiáng)大,甚至可以處理圖像。它包括 I2C、SPI、UART 通信以及 PWM 和 DAC 輸出。

參數(shù):

工作電壓:4.75-5.25V

飛濺:默認(rèn) 32Mbit

RAM:內(nèi)部 520KB + 外部 8MB PSRAM

無線網(wǎng)絡(luò):802.11b/g/n/e/i

藍(lán)牙:藍(lán)牙 4.2BR/EDR 和 BLE 標(biāo)準(zhǔn)

支持接口(2Mbps):UART、SPI、I2C、PWM

IO口:9

串口速率:默認(rèn)115200bps

頻譜范圍:2400 ~2483.5MHz

圖像輸出格式:JPEG(僅支持OV2640)、BMP、GRAYSCALE

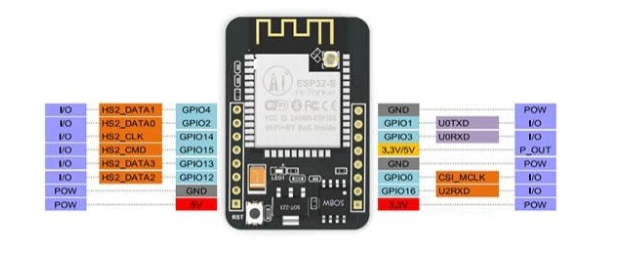

下面,一般電路板引腳排列:

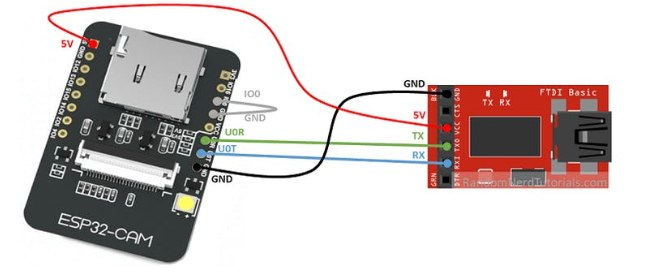

請注意,此設(shè)備沒有集成 USB-TTL 串行模塊,因此要將代碼上傳到 ESP32-CAM 需要一個特殊的適配器,如下所示:

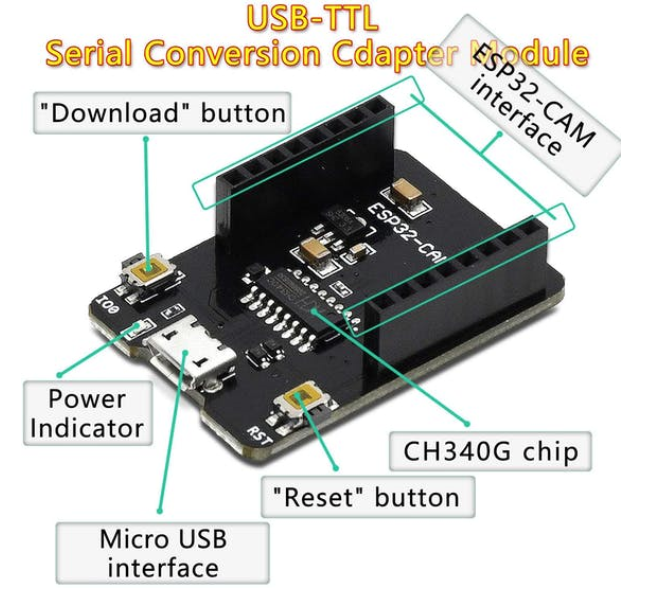

或 USB-TTL 串行轉(zhuǎn)換適配器如下:

如果你想了解 ESP32-CAM,我強(qiáng)烈推薦Rui Santos 的書籍和教程。

在 Arduino IDE 上安裝 ESP32-Cam

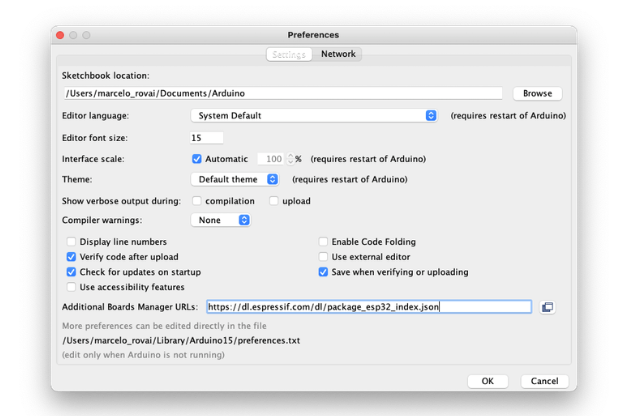

從 Arduino IDE 打開首選項(xiàng)窗口并轉(zhuǎn)到:Arduino 》偏好

使用以下行輸入:

https://dl.espressif.com/dl/package_esp32_index.json

在 Additional Board Manager URLs 中輸入下圖內(nèi)容

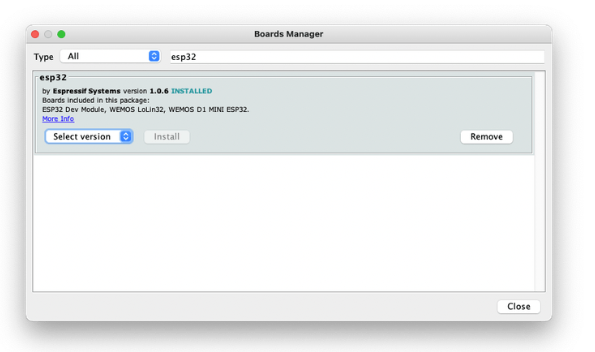

接著,打開 boards manager,轉(zhuǎn)到Tools 》 Board 》 Boards Manager.。。并使用esp32 輸入。選擇并安裝最新的軟件包

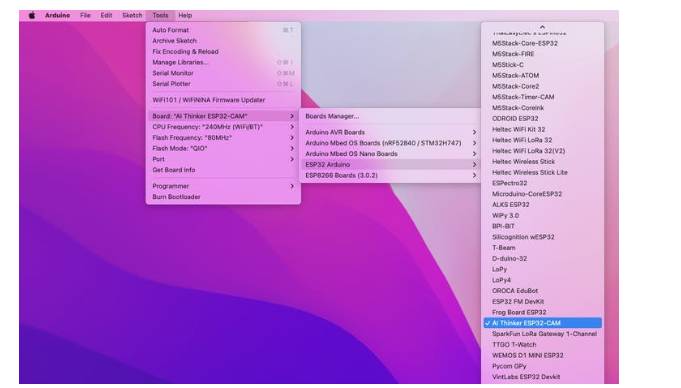

選擇 ESP32 開發(fā)板:

例如,AI-Thinker ESP32-CAM

最后別忘記選擇連接 ESP32-Cam的端口。

這就對了!設(shè)備應(yīng)該沒問題。讓我們做一些測試。

用 BLINK 測試電路板

ESP32-CAM 有一個與 GPIO33 連接的內(nèi)置 LED。因此,相應(yīng)地更改 Blink 草圖:

| #define LED_BUILT_IN 33 void setup() { pinMode(LED_BUILT_IN, OUTPUT); // Set the pin as output } // Remember that the pin work with inverted logic // LOW to Turn on and HIGH to turn off void loop() { digitalWrite(LED_BUILT_IN, LOW); //Turn on delay (1000); //Wait 1 sec digitalWrite(LED_BUILT_IN, HIGH); //Turn off delay (1000); //Wait 1 sec } |

特別提醒,LED 位于電路板下方。

測試 WiFi

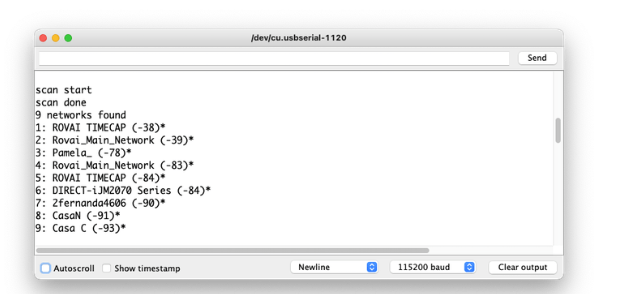

ESP32S 的聲音特性之一是其 WiFi 功能。所以,讓我們測試一下它的收音機(jī),掃描它周圍的 wifi 網(wǎng)絡(luò)。你可以做到這一點(diǎn),運(yùn)行板附帶的代碼示例之一。

轉(zhuǎn)到 Arduino IDE 示例并查找WiFI ==> WiFIScan

在串行監(jiān)視器上,您應(yīng)該會看到設(shè)備范圍內(nèi)的 wifi 網(wǎng)絡(luò)(SSID 和 RSSI)。這是我在家里得到的:

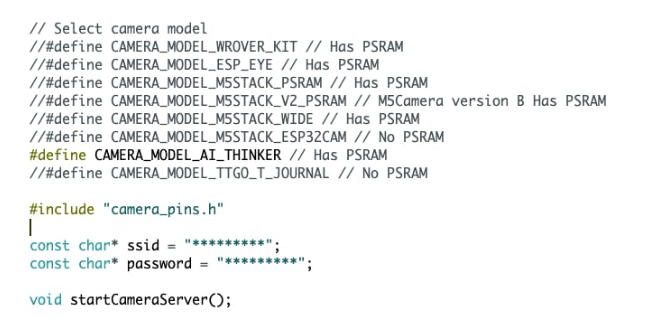

測試相機(jī)

對于相機(jī)測試,您可以使用以下代碼:

示例 ==> ESP32 ==> 相機(jī) ==> CameraWebServer

只選擇合適的相機(jī):

| #define CAMERA_MODEL_AI_THINKER |

并使用網(wǎng)絡(luò)憑據(jù)輸入:

|

const char* ssid = "*********"; const char* password = "*********"; |

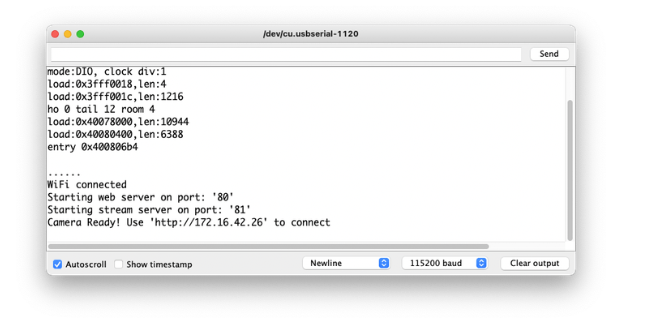

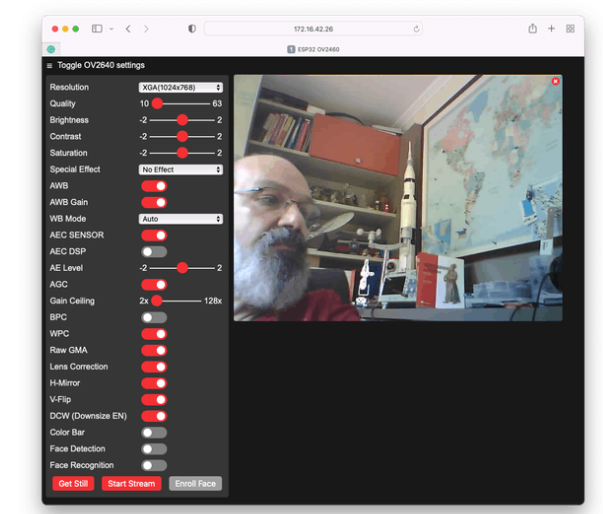

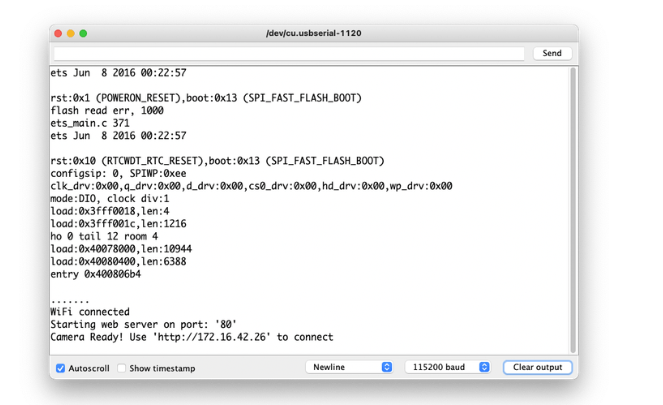

在串行監(jiān)視器上,您將獲得正確的地址來運(yùn)行您可以控制攝像機(jī)的服務(wù)器:

這里我輸入的是:http: //172.16.42.26

運(yùn)行你的網(wǎng)絡(luò)服務(wù)器

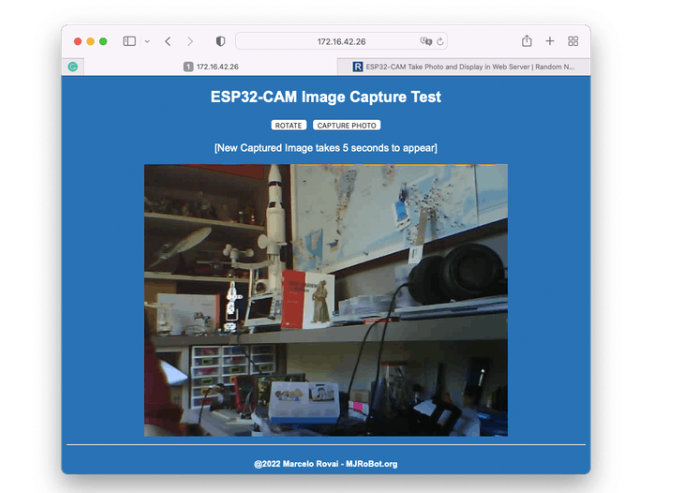

到目前為止,我們可以測試所有 ESP32-Cam 硬件(MCU 和攝像頭)以及 wifi 連接。現(xiàn)在,讓我們運(yùn)行一個更簡單的代碼來捕獲單個圖像并將其呈現(xiàn)在一個簡單的網(wǎng)頁上。本代碼基于 Rui Santos 偉大的教程:ESP32-CAM Take Photo and Display in Web Server 開發(fā)

從 GitHub 下載文件:ESP332_CAM_HTTP_Server_STA ,更改 wifi 憑據(jù)并運(yùn)行代碼。結(jié)果如下:

嘗試檢查代碼;更容易理解相機(jī)的工作原理。

水果與蔬菜 - 圖像分類

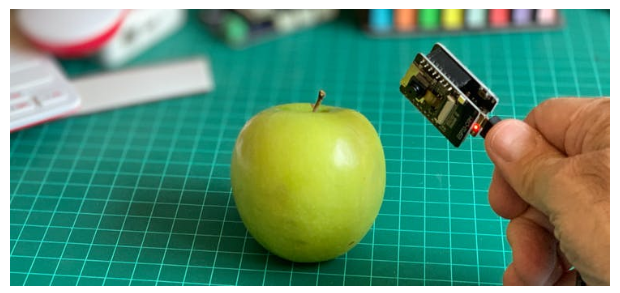

現(xiàn)在我們已經(jīng)運(yùn)行了嵌入式相機(jī),是時候嘗試圖像分類了。

我們應(yīng)該開始訓(xùn)練模型并繼續(xù)在 ESP32-CAM 上進(jìn)行推理。我們需要找到大量的數(shù)據(jù)用于訓(xùn)練模型。

TinyML 是一組與嵌入式設(shè)備上的機(jī)器學(xué)習(xí)推理相關(guān)的技術(shù),由于限制(在這種情況下主要是內(nèi)存),我們應(yīng)該將分類限制為三到四個類別。我們將蘋果與香蕉和土豆區(qū)分開來(您可以嘗試其他類別)。

因此,讓我們找到一個包含這些類別的圖像的特定數(shù)據(jù)集。Kaggle 是一個好的開始:

https://www.kaggle.com/kritikseth/fruit-and-vegetable-image-recognition

該數(shù)據(jù)集包含以下食品的圖像:

水果-香蕉、蘋果、梨、葡萄、橙子、獼猴桃、西瓜、石榴、菠蘿、芒果。

蔬菜- 黃瓜、胡蘿卜、辣椒、洋蔥、土豆、檸檬、番茄、蘿卜、甜菜根、卷心菜、生菜、菠菜、大豆、花椰菜、甜椒、辣椒、蘿卜、玉米、甜玉米、紅薯、辣椒粉、墨西哥胡椒、姜、 大蒜、 豌豆、 茄子。

每個類別分為訓(xùn)練(100 張圖像)、測試(10 張圖像)和驗(yàn)證(10 張圖像)。

將數(shù)據(jù)集從 Kaggle 網(wǎng)站下載到您的計算機(jī)。

使用 Edge Impulse Studio 訓(xùn)練模型

我們將使用 Edge Impulse 進(jìn)行培訓(xùn),這是在邊緣設(shè)備上進(jìn)行機(jī)器學(xué)習(xí)的領(lǐng)先開發(fā)平臺。

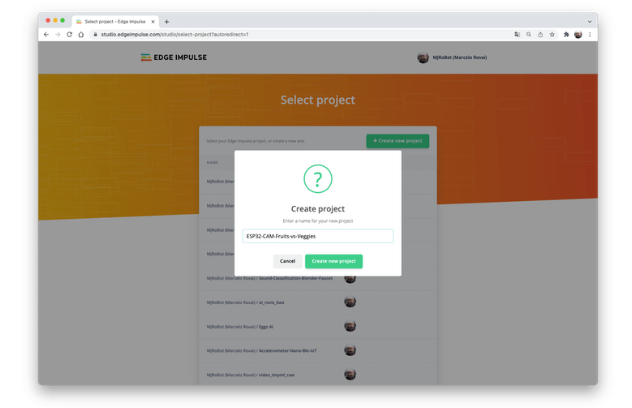

在 Edge Impulse 輸入您的帳戶憑據(jù)(或創(chuàng)建一個免費(fèi)帳戶)。接下來,創(chuàng)建一個新項(xiàng)目:

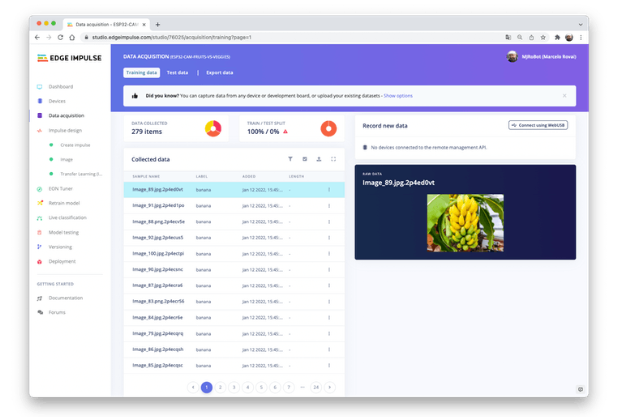

數(shù)據(jù)采集

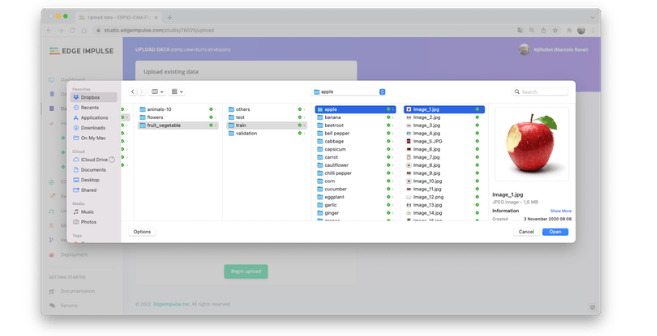

接下來,在上傳數(shù)據(jù)部分,從您的計算機(jī)上傳所選類別的文件:

如果您以三類數(shù)據(jù)結(jié)束,閱讀培訓(xùn)會有所幫助

您還可以上傳額外的數(shù)據(jù)以進(jìn)行進(jìn)一步的模型測試或拆分訓(xùn)練數(shù)據(jù)。

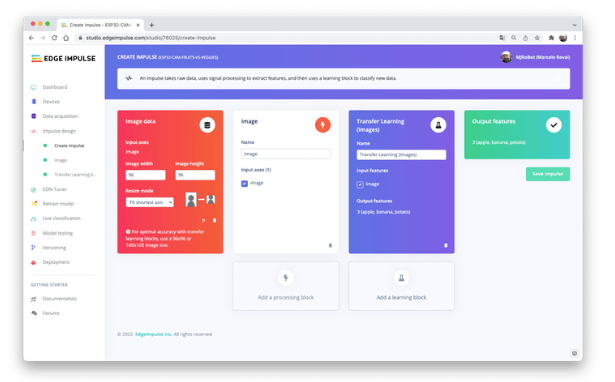

沖動設(shè)計

脈沖獲取原始數(shù)據(jù)(在本例中為圖像),提取特征(調(diào)整圖片大小),然后使用學(xué)習(xí)塊對新數(shù)據(jù)進(jìn)行分類。

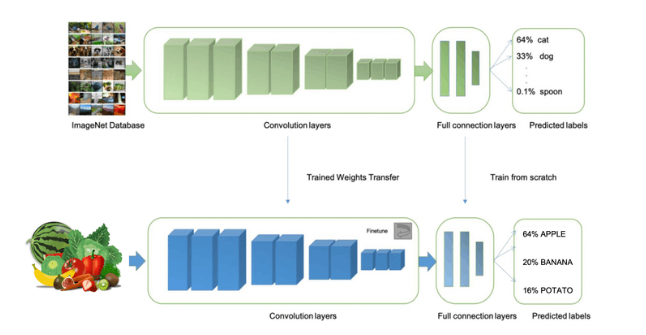

如前所述,對圖像進(jìn)行分類是深度學(xué)習(xí)最常見的用途,但要完成這項(xiàng)任務(wù)需要使用大量數(shù)據(jù)。每個類別我們有大約 90 張圖片。這個數(shù)字夠嗎?一點(diǎn)也不!我們將需要數(shù)千張圖像來“教授或建模”以區(qū)分蘋果和香蕉。但是,我們可以通過使用數(shù)千張圖像重新訓(xùn)練先前訓(xùn)練的模型來解決這個問題。我們將這種技術(shù)稱為“遷移學(xué)習(xí)”(TL)。

使用 TL,我們可以在我們的數(shù)據(jù)上微調(diào)預(yù)訓(xùn)練的圖像分類模型,即使在相對較小的圖像數(shù)據(jù)集(我們的案例)中也能達(dá)到良好的性能。

因此,從原始圖像開始,我們將調(diào)整它們的大小(96x96)像素,然后將它們提供給我們的遷移學(xué)習(xí)塊:

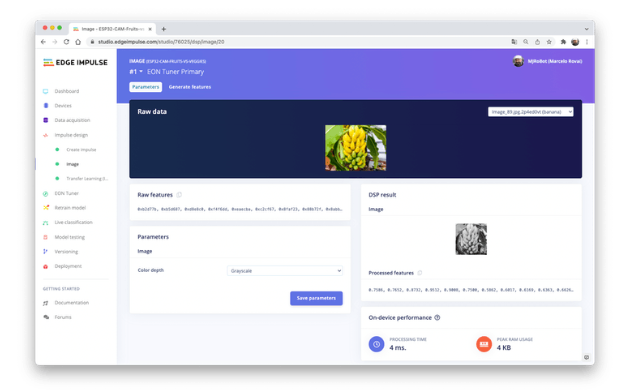

預(yù)處理(特征生成)

除了調(diào)整圖像大小外,我們還應(yīng)該將它們更改為灰度,以保持實(shí)際的 RGB 顏色深度。這樣做,我們的每個數(shù)據(jù)樣本都將具有 9 維、216 個特征 (96x96x1)。保持RGB,這個尺寸會大三倍。使用灰度有助于減少推理所需的最終內(nèi)存量。

不要忘記“保存參數(shù)”。這將生成要在訓(xùn)練中使用的特征。

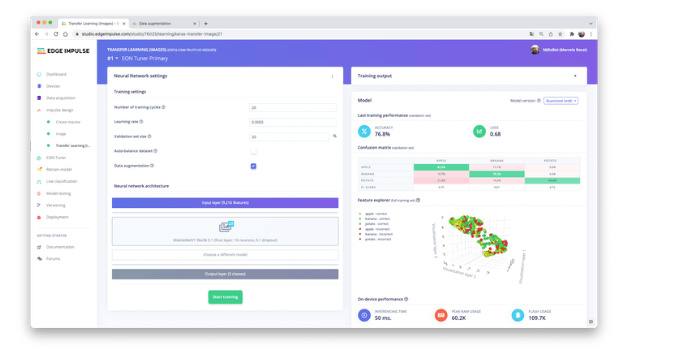

培訓(xùn)(遷移學(xué)習(xí)和數(shù)據(jù)增強(qiáng))

2007 年,Google 推出了MobileNetV1,這是一個通用計算機(jī)視覺神經(jīng)網(wǎng)絡(luò)系列,專為移動設(shè)備而設(shè)計,支持分類、檢測等。MobileNets 是小型、低延遲、低功耗的模型,參數(shù)化以滿足各種用例的資源限制。

盡管基本的 MobileNet 架構(gòu)已經(jīng)很小并且具有低延遲,但很多時候,特定用例或應(yīng)用程序可能需要模型更小更快。為了構(gòu)建這些更小且計算成本更低的模型,MobileNet 引入了一個非常簡單的參數(shù)α (alpha),稱為寬度乘數(shù)。寬度乘數(shù) α 的作用是在每一層均勻地細(xì)化網(wǎng)絡(luò)。

Edge Impulse Studio 提供 MobileNet V1(96x96 圖像)和 V2(96x96 和 160x160 圖像),具有多個不同的α值(從 0.05 到 1.0)。例如,對于 V2、160x160 圖像和 α=1.0,您將獲得最高準(zhǔn)確度。當(dāng)然,有一個權(quán)衡。精度越高,運(yùn)行模型所需的內(nèi)存就越多(大約 1.3M RAM 和 2.6M ROM),這意味著更多的延遲。

在另一個極端,使用 MobileNet V1 和 α=0.10(大約 53.2K RAM 和 101K ROM)將獲得更小的占用空間。

為了在 ESP32-CAM 上運(yùn)行這個項(xiàng)目,我們應(yīng)該停留在可能性的較低端,保證推理的情況,但不能保證高精度。

與深度學(xué)習(xí)一起使用的另一項(xiàng)必要技術(shù)是數(shù)據(jù)增強(qiáng)。數(shù)據(jù)增強(qiáng)是一種可以幫助提高機(jī)器學(xué)習(xí)模型準(zhǔn)確性的方法。數(shù)據(jù)增強(qiáng)系統(tǒng)在訓(xùn)練過程中(如翻轉(zhuǎn)、裁剪或旋轉(zhuǎn)圖像)對訓(xùn)練數(shù)據(jù)進(jìn)行小的、隨機(jī)的更改。

在這里,您可以看到 Edge Impulse 如何對您的數(shù)據(jù)實(shí)施數(shù)據(jù)增強(qiáng)策略:

|

# Implements the data augmentation policy def augment_image(image, label): # Flips the image randomly image = tf.image.random_flip_left_right(image) # Increase the image size, then randomly crop it down to # the original dimensions resize_factor = random.uniform(1, 1.2) new_height = math.floor(resize_factor * INPUT_SHAPE[0]) new_width = math.floor(resize_factor * INPUT_SHAPE[1]) image = tf.image.resize_with_crop_or_pad(image, new_height, new_width) image = tf.image.random_crop(image, size=INPUT_SHAPE) # Vary the brightness of the image image = tf.image.random_brightness(image, max_delta=0.2) return image, label |

在訓(xùn)練期間暴露于這些變化可以幫助防止模型通過“記憶”訓(xùn)練數(shù)據(jù)中的表面線索而走捷徑,這意味著它可以更好地反映數(shù)據(jù)集中深層的潛在模式。

我們模型的最后一層將有 16 個神經(jīng)元,其中 10% 的 dropout 用于防止過擬合。這是訓(xùn)練輸出:

結(jié)果不是很好。該模型達(dá)到了大約 77% 的準(zhǔn)確率,但預(yù)計在推理期間使用的 RAM 內(nèi)存量非常小(大約 60 KB),這非常好。

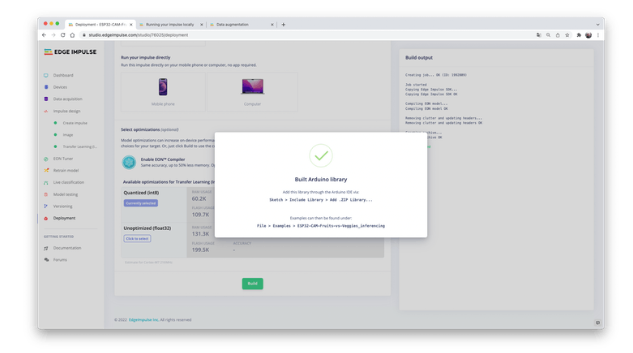

部署

訓(xùn)練后的模型將部署為 .zip Arduino 庫,用于特定的 ESP32-Cam 代碼。

打開您的 Arduino IDE 并在Sketch 下,轉(zhuǎn)到Include Library并添加.ZIP Library。選擇您剛剛從 Edge Impulse Studio 下載的文件,就是這樣!

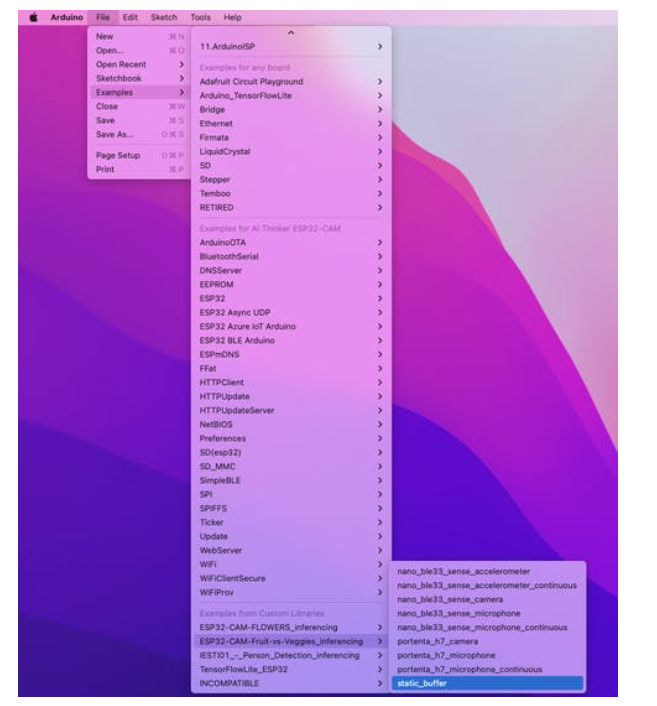

在Arduino IDE 的示例選項(xiàng)卡下,您應(yīng)該在項(xiàng)目名稱下找到一個草圖代碼。

打開靜態(tài)緩沖區(qū)示例:

您可以看到,第一段代碼正是調(diào)用了一個庫,該庫具有在您的設(shè)備上運(yùn)行推理所需的一切。

#include 《ESP32-CAM-Fruit-vs-Veggies_inferencing.h》

當(dāng)然,這是一個通用代碼(一個“模板”),它只獲取一個原始數(shù)據(jù)樣本(存儲在變量中:features = {} 并運(yùn)行分類器,進(jìn)行推理。結(jié)果顯示在串行監(jiān)視器上。

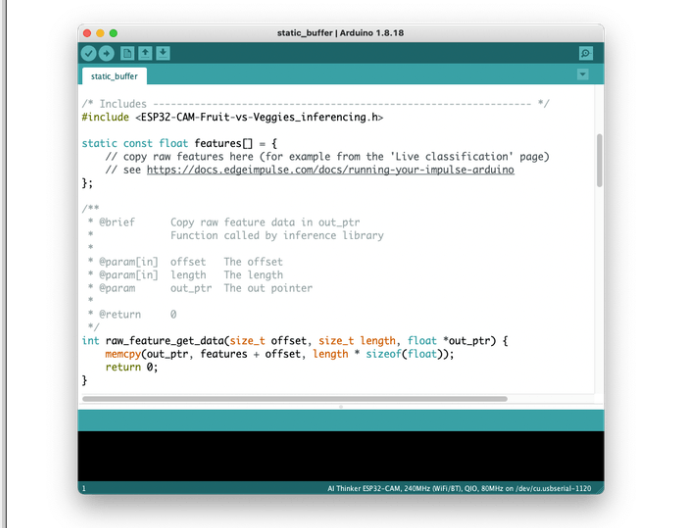

我們應(yīng)該做的是從相機(jī)中獲取樣本(圖像),對其進(jìn)行預(yù)處理(調(diào)整為 96x96,轉(zhuǎn)換為灰度并平整它。這將是我們模型的輸入張量。輸出張量將是一個包含三個值,顯示每個類的概率。

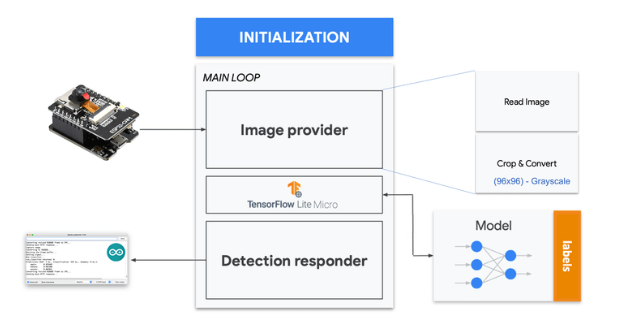

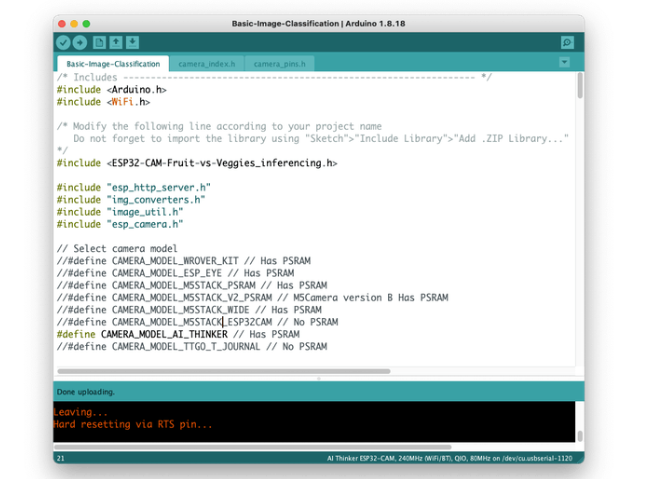

在網(wǎng)站上:https ://github.com/edgeimpulse/example-esp32-cam,Edge impulse 改編了可用于相機(jī)測試的代碼(示例 ==》 ESP32 ==》 相機(jī) ==》 CameraWebServer),包括必要的在 ESP32-CAM 上運(yùn)行推理。在 GitHub 上,下載代碼Basic-Image-Classification,包括您的項(xiàng)目庫,選擇您的相機(jī)和您的 wifi 網(wǎng)絡(luò)憑據(jù):

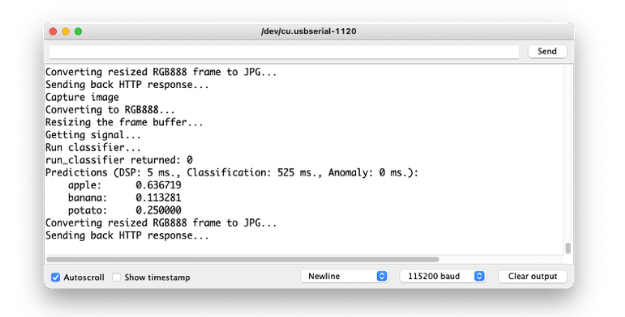

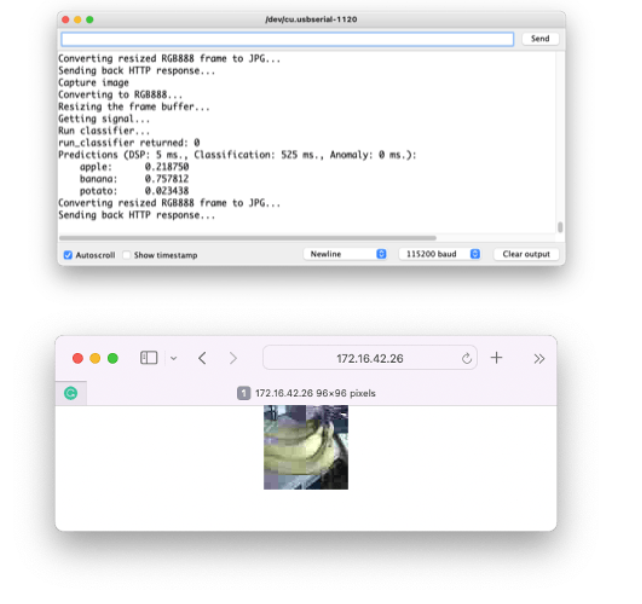

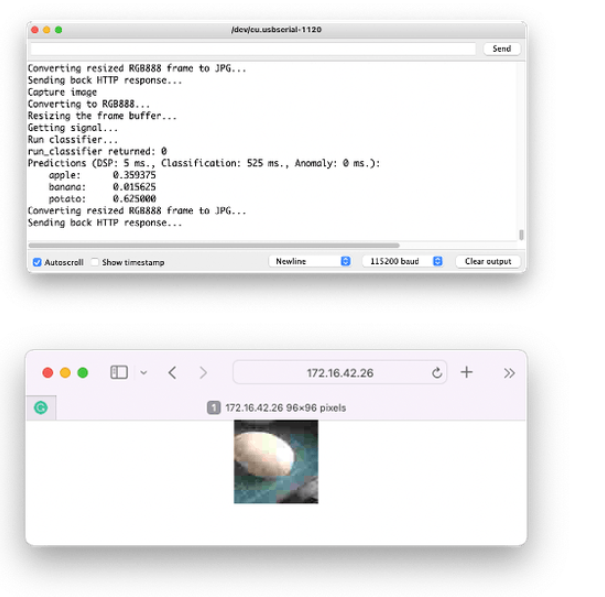

將代碼上傳到您的 ESP32-Cam,您應(yīng)該可以開始對水果和蔬菜進(jìn)行分類了!您可以在串行監(jiān)視器上檢查它:

測試模型(推理)

用相機(jī)拍照,分類結(jié)果會出現(xiàn)在串口監(jiān)視器上:

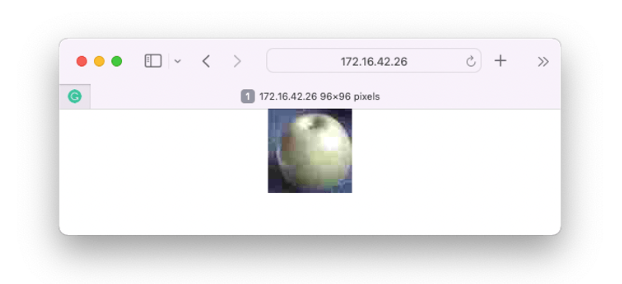

可以在網(wǎng)頁上驗(yàn)證相機(jī)捕獲的圖像:

其他測試:

結(jié)論

ESP32-Cam 是一種非常靈活、不昂貴且易于編程的設(shè)備。該項(xiàng)目可以證明 TinyML 的潛力,但我不確定整體結(jié)果是否可以應(yīng)用于實(shí)際應(yīng)用程序(以開發(fā)的方式)。只有最小的遷移學(xué)習(xí)模型才能正常工作(MobileNet V1,α=0.10),任何使用更大的α來提高準(zhǔn)確性的嘗試都會導(dǎo)致 Arena 分配錯誤。可能的原因之一是運(yùn)行相機(jī)的最終通用代碼中已經(jīng)使用的內(nèi)存量。因此,項(xiàng)目的下一步是優(yōu)化最終代碼,釋放更多內(nèi)存用于運(yùn)行模型。

-

攝像頭

+關(guān)注

關(guān)注

61文章

5091瀏覽量

103129 -

ESP32

+關(guān)注

關(guān)注

26文章

1195瀏覽量

21719

發(fā)布評論請先 登錄

樂鑫發(fā)布首個 MCU 級 Matter 攝像頭方案,啟明云端樂鑫代理

ESP32-S3在初始化攝像頭時檢測到攝像頭模組型號不被支持

僅39.9元!ESP32-P4開發(fā)板+7寸屏+攝像頭,嵌入式視覺入門方案完整開源,啟明云端樂鑫代理

樂鑫科技發(fā)布首個MCU級Matter攝像頭解決方案

Termux手機(jī)攝像頭采集圖像/視頻流 部署 YOLO 模型推理

自動駕駛既然有雙目攝像頭了,為什么還要三目攝像頭?

車載雙目攝像頭如何“看見”世界?

創(chuàng)世SD NAND貼片卡:智能攝像頭存儲難題的完美解決方案 #人工智能 #智能攝像頭 #攝像頭

紅外攝像頭模組是什么?科技時代的眼睛

ESP32-P4—具備豐富IO連接、HMI和出色安全特性的高性能SoC

esp32cam

有償求助!esp32cam攝像頭車牌識別代碼執(zhí)行時,上位機(jī)閃退

樂鑫ESP-RTC實(shí)時音視頻通信方案

社區(qū)安裝IPC攝像頭,跟安裝一般安防監(jiān)控攝像頭有什么區(qū)別?

基于ESP32的TinyML圖像分類攝像頭的設(shè)計方案

基于ESP32的TinyML圖像分類攝像頭的設(shè)計方案

評論