量子計(jì)算渴望在更快的時間內(nèi)為目前無法用經(jīng)典計(jì)算解決的問題提供更強(qiáng)大的計(jì)算能力。 NVIDIA 最近發(fā)布了 cuQuantum SDK ,這是一個用于加速量子信息科學(xué)發(fā)展的高性能庫。 cuQuantum 最近被用于 打破在 DGX SuperPOD 上運(yùn)行 MaxCut 量子算法模擬的世界紀(jì)錄 ,比以前的工作多了 8 倍的量子位。

cuQuantum 的初始目標(biāo)應(yīng)用程序是 量子電路模擬, 的加速,它由兩個主要庫組成:

cuStateVec :加速狀態(tài)向量模擬。

cuTensorNet :加速張量網(wǎng)絡(luò)模擬。

在本文中,我們將對這兩個庫進(jìn)行概述,并對 cuTensorNet 進(jìn)行更詳細(xì)的討論。

為什么要使用 cuStateVec ?

cuQuantum SDK 中的 cuStateVec 庫通過針對模擬器中出現(xiàn)的大多數(shù)用例優(yōu)化 GPU 內(nèi)核,為基于狀態(tài)向量的模擬提供了高性能解決方案。雖然狀態(tài)向量法非常適合運(yùn)行深度量子電路,但即使在當(dāng)今最大的超級計(jì)算機(jī)上,也不可能對具有大量量子比特的量子電路進(jìn)行模擬,這些量子比特呈指數(shù)增長。

為什么要使用 cuTensorNet ?

作為替代方案,張量網(wǎng)絡(luò)方法是一種將 N 量子位的量子態(tài)表示為一系列張量收縮的技術(shù)。這使得量子電路模擬器能夠通過交換算法與計(jì)算所需的空間來處理具有許多量子位的電路。根據(jù)電路拓?fù)浜蜕疃鹊牟煌@也可能會變得非常昂貴。然后,主要的挑戰(zhàn)是有效地計(jì)算這些張量收縮。

量子計(jì)算渴望在更快的時間內(nèi)為目前無法用經(jīng)典計(jì)算解決的問題提供更強(qiáng)大的計(jì)算能力。 NVIDIA 最近發(fā)布了 cuQuantum SDK ,這是一個用于加速量子信息科學(xué)發(fā)展的高性能庫。 cuQuantum 最近被用于 打破在 DGX SuperPOD 上運(yùn)行 MaxCut 量子算法模擬的世界紀(jì)錄 ,比以前的工作多了 8 倍的量子位。

cuQuantum 的初始目標(biāo)應(yīng)用程序是 量子電路模擬, 的加速,它由兩個主要庫組成:

cuStateVec :加速狀態(tài)向量模擬。

cuTensorNet :加速張量網(wǎng)絡(luò)模擬。

在本文中,我們將對這兩個庫進(jìn)行概述,并對 cuTensorNet 進(jìn)行更詳細(xì)的討論。

為什么要使用 cuStateVec ?

cuQuantum SDK 中的 cuStateVec 庫通過針對模擬器中出現(xiàn)的大多數(shù)用例優(yōu)化 GPU 內(nèi)核,為基于狀態(tài)向量的模擬提供了高性能解決方案。雖然狀態(tài)向量法非常適合運(yùn)行深度量子電路,但即使在當(dāng)今最大的超級計(jì)算機(jī)上,也不可能對具有大量量子比特的量子電路進(jìn)行模擬,這些量子比特呈指數(shù)增長。

為什么要使用 cuTensorNet ?

作為替代方案,張量網(wǎng)絡(luò)方法是一種將 N 量子位的量子態(tài)表示為一系列張量收縮的技術(shù)。這使得量子電路模擬器能夠通過交換算法與計(jì)算所需的空間來處理具有許多量子位的電路。根據(jù)電路拓?fù)浜蜕疃鹊牟煌@也可能會變得非常昂貴。然后,主要的挑戰(zhàn)是有效地計(jì)算這些張量收縮。

cuQuantum SDK 中的 cuTensorNet 庫為這些類型的張量網(wǎng)絡(luò)計(jì)算提供了高性能解決方案。

cuTensorNet 庫提供 C 和 Python API ,以提供對高性能張量網(wǎng)絡(luò)計(jì)算的訪問,從而加速量子電路模擬。這些 API 非常靈活,使您能夠控制、探索和研究實(shí)現(xiàn)的每一種算法技術(shù)。

cuTensorNet 算法描述

在本節(jié)中,我們將討論 cuTensorNet 中使用的不同算法和技術(shù)。它包括兩個主要組件: pathfinder 和 execution 。

pathfinder 在短時間內(nèi)提供了一條成本最低的最佳收縮路徑,執(zhí)行步驟使用高效內(nèi)核在 GPU 上計(jì)算該路徑。這兩個組件相互獨(dú)立,可以與提供類似功能的任何其他外部庫進(jìn)行互操作。

探路者

在高層, cuTensorNet 采用的方法是圍繞基于圖形分區(qū)的探路者進(jìn)行超優(yōu)化。有關(guān)更多信息,請參閱 超優(yōu)化張量網(wǎng)絡(luò)收縮 。

探路者的作用是找到一條收縮路徑,使收縮張量網(wǎng)絡(luò)的成本最小化。為了加快這一步,我們開發(fā)了許多算法改進(jìn)和優(yōu)化,而且這一步還會更快。

尋找最優(yōu)收縮路徑在很大程度上取決于網(wǎng)絡(luò)的大小。網(wǎng)絡(luò)越大,尋找最優(yōu)收縮路徑所需的技術(shù)和計(jì)算量就越大。

cuTensorNet pathfinder 由三個算法模塊組成。

Simplification :對張量網(wǎng)絡(luò)進(jìn)行預(yù)處理以找到所有明顯的直接收縮集的技術(shù)。它將它們從網(wǎng)絡(luò)中移除,并用其最終張量替換每個集合。其結(jié)果是更小的網(wǎng)絡(luò),更容易在以下模塊中處理。

Path computation :探路者組件的核心。它基于一個圖分區(qū)步驟,然后是使用重新配置調(diào)整和切片技術(shù)的第二個步驟。遞歸地調(diào)用圖分區(qū)來分割網(wǎng)絡(luò)并形成收縮路徑(例如,成對收縮樹)。

Hyper-optimizer: 路徑計(jì)算模塊上的一個循環(huán),在每次迭代中形成一條收縮路徑。對于每次迭代,超級優(yōu)化器都會為路徑計(jì)算創(chuàng)建不同的參數(shù)配置,同時跟蹤找到的最佳路徑。您可以隨意更改或修復(fù)這些配置參數(shù)。所有配置參數(shù)都可以通過cutensornetContractionOptimizerConfigSetAttribute設(shè)置。有關(guān)更多信息,請參閱 cuTensorNet documentation 。

從第一步生成的路徑可能不接近最優(yōu),因此通常會執(zhí)行重構(gòu)調(diào)整。重構(gòu)在整體收縮樹中選擇幾個小的子樹,并試圖提高它們的收縮成本,如果可能的話,降低總體成本。

路徑計(jì)算模塊的另一個特點(diǎn)是切片技術(shù)。切片的主要目標(biāo)是將網(wǎng)絡(luò)收縮過程放入可用的設(shè)備內(nèi)存中。切片通過排除某些張量模式并顯式展開它們的范圍來實(shí)現(xiàn)這一點(diǎn)。這將生成許多類似的收縮樹,或 slices ,其中每一個對應(yīng)于排除模式之一。

收縮路徑或樹不會改變。在這種情況下,只有一些模式被排除在外,每個切片的計(jì)算獨(dú)立于其他模式。因此,切片可以被認(rèn)為是為不同設(shè)備創(chuàng)建獨(dú)立工作的最佳技術(shù)之一。

實(shí)踐經(jīng)驗(yàn)表明,找到最佳收縮路徑對這里使用的每種技術(shù)的配置參數(shù)的選擇都很敏感。為了提高找到最佳收縮路徑的概率,我們將該模塊封裝在一個超級優(yōu)化器中。

尋路性能

在考慮探路者的性能時,有兩個相關(guān)的指標(biāo):找到的路徑的質(zhì)量和找到該路徑所需的時間。前者如圖 3 所示,以失敗導(dǎo)致的收縮成本來衡量。用于基準(zhǔn)測試的電路是谷歌量子人工智能 2019 年量子優(yōu)勢論文 的隨機(jī)量子電路,深度為 12 、 14 和 20 。

與 opt_einsum 庫相比, cuTensorNet 在尋找最佳路徑方面表現(xiàn)良好,在這些電路方面略優(yōu)于 Cotengra 。

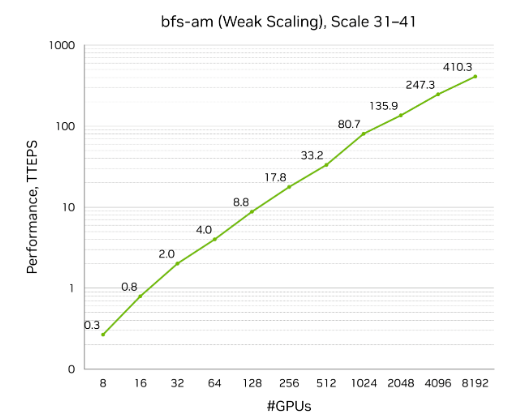

cuTensorNet 也能快速找到高質(zhì)量的路徑。對于不同深度的懸鈴木量子電路問題,圖 4 繪制了 cuTensorNet 與科滕格拉相比的收縮所需時間。對于網(wǎng)絡(luò)中有 3000 多個張量的最復(fù)雜問題, cuTensorNet 仍能在 40 秒內(nèi)找到最佳路徑。

處決

執(zhí)行組件依賴 cuTENSOR 庫作為后端,以便在 GPU 上高效執(zhí)行。它包括以下幾個階段:

Planning :執(zhí)行組件的決策引擎。它分析收縮路徑,決定使用最小工作空間在 GPU 上執(zhí)行它的最佳方式。它還決定了每個成對收縮使用的最佳內(nèi)核。

Computation :此階段使用 cuTENSOR 庫計(jì)算所有成對收縮。

Autotuning :(可選)基于不同啟發(fā)式的不同內(nèi)核嘗試成對收縮,并選擇最佳內(nèi)核。

執(zhí)行性能

圖 5 測量了 cuTensorNet 與 CuPy 在幾個不同電路中收縮執(zhí)行的加速比。根據(jù)賽道的不同, cuTensorNet 提供了約 8-20 倍的收縮執(zhí)行加速。

cuTensorNet 示例

cuTensorNet 提供了 C 和 Python API ,允許您高效地計(jì)算張量網(wǎng)絡(luò)收縮,而無需任何關(guān)于如何找到最佳收縮路徑或如何在 GPU 上執(zhí)行收縮的專業(yè)知識。

高級 Python API

cuTensorNet 提供高級 Python API ,可與 NumPy 和 PyTorch 張量互操作。例如,張量網(wǎng)絡(luò)的einsum表達(dá)式可以在對contract的單個函數(shù)調(diào)用中使用。 cuTensorNet 執(zhí)行所有必需的步驟,結(jié)果返回約定的網(wǎng)絡(luò)。

import cupy as cp

import cuquantum # Compute D_{m,x,n,y} = A_{m,h,k,n} B_{u,k,h} C_{x,u,y} # Create an array of extents (shapes) for each tensor extentA = (96, 64, 64, 96) extentB = (96, 64, 64) extentC = (64, 96, 64) extentD = (96, 64, 96, 64) # Generate input tensor data directly on GPU A_d = cp.random.random(extentA, dtype=cp.float32) B_d = cp.random.random(extentB, dtype=cp.float32) C_d = cp.random.random(extentC, dtype=cp.float32) # Set the pathfinder options options = cuquantum.OptimizerOptions() options.slicing.disable_slicing = 1 # disable slicing options.samples = 100 # number of hyper-optimizer samples # Run the contraction on a CUDA stream stream = cp.cuda.Stream() D_d, info = cuquantum.contract( 'mhkn,ukh,xuy->mxny', A_d, B_d, C_d, optimize=options, stream=stream, return_info=True) stream.synchronize() # Check the optimizer info print(f"{info[1].opt_cost/1e9} GFLOPS")

從這個代碼示例中,您可以看到所有 cuTensorNet 操作都封裝在一個contract API 中。本例的輸出為 14.495514624 GFLOPS :基于路徑查找器找到的收縮路徑估計(jì)的浮點(diǎn)操作數(shù)。要手動執(zhí)行相同的步驟,還可以使用 cuQuantum.Network object 。

低級 API

如前所述, C 和 Python API 是以一種直觀的表達(dá)方式設(shè)計(jì)的。您可以調(diào)用 pathfinder 函數(shù)以獲得優(yōu)化的路徑,然后調(diào)用以使用該路徑在 GPU 上執(zhí)行收縮。

對于高級用戶, cuTensorNet library API 旨在授予訪問該領(lǐng)域研究可用的所有算法選項(xiàng)的權(quán)限。例如,您可以控制 pathfinder 可以嘗試找到最佳收縮路徑的 hyper optimizer 樣本數(shù)。

有幾十個參數(shù)可以修改或控制。這些都可以通過 helper 函數(shù)訪問,并允許簡單功能 API 保持不變。你也可以提供自己的路徑。有關(guān)較低級別選項(xiàng)的更多信息以及如何使用它們的示例,請參閱 cuquantum.Network 。

總結(jié)

NVIDIA CuQuin SDK 的 CursSnReNET 庫旨在加速 GPU 上的張量網(wǎng)絡(luò)計(jì)算。在這篇文章中,我們展示了最先進(jìn)的張量網(wǎng)絡(luò)庫對關(guān)鍵量子算法的加速。

在改進(jìn) cuTensorNet 并通過新的算法改進(jìn)和多節(jié)點(diǎn)、多 GPU 執(zhí)行來擴(kuò)展它方面有著廣泛的發(fā)展。

cuTensorNet 圖書館的目標(biāo)是為量子計(jì)算領(lǐng)域的突破性發(fā)展提供一個有用的工具。有沒有關(guān)于如何改進(jìn) cuQuantum 庫的反饋和建議?

關(guān)于作者

Azzam Haidar 是 NVIDIA 開發(fā) HPC 和量子計(jì)算軟件的高級工程師。 2008 年,他在圖盧茲國立理工學(xué)院和法國 CERFACS 實(shí)驗(yàn)室獲得計(jì)算機(jī)科學(xué)和應(yīng)用數(shù)學(xué)博士學(xué)位。在加入 Nvidia 之前,他是諾克斯維爾田納西大學(xué)創(chuàng)新計(jì)算實(shí)驗(yàn)室的研究主任。

Leo Fang 是NVIDIA 的高級工程師,專注于 HPC 、量子計(jì)算和 Python 軟件。 2017 年,他在杜克大學(xué)獲得物理學(xué)博士學(xué)位。在加入 NVIDIA 之前,他是布魯克海文國家實(shí)驗(yàn)室計(jì)算科學(xué)倡議的助理計(jì)算科學(xué)家。他也是許多開源項(xiàng)目的定期貢獻(xiàn)者,包括 CuPy 、 mpi4py 、 conda forge 和 Python 數(shù)據(jù) API 標(biāo)準(zhǔn)聯(lián)盟。

審核編輯:郭婷

-

NVIDIA

+關(guān)注

關(guān)注

14文章

5597瀏覽量

109793 -

gpu

+關(guān)注

關(guān)注

28文章

5196瀏覽量

135507 -

API

+關(guān)注

關(guān)注

2文章

2375瀏覽量

66805

發(fā)布評論請先 登錄

NVIDIA DGX SuperPOD為Rubin平臺橫向擴(kuò)展提供藍(lán)圖

NVIDIA Omniverse基于Container的部署推流方案

NVIDIA 收購開源工作負(fù)載管理提供商 SchedMD

NVIDIA在ISC 2025分享最新超級計(jì)算進(jìn)展

HighPoint與 ICY DOCK 達(dá)成合作,為專業(yè)計(jì)算提供高速靈活的 NVMe 存儲擴(kuò)展解決方案

NVIDIA Spectrum-X 以太網(wǎng)交換機(jī)助力 Meta 和 Oracle 加速網(wǎng)絡(luò)性能

NVIDIA AI網(wǎng)絡(luò)閃耀2025云棲大會

NVIDIA DGX Spark桌面AI計(jì)算機(jī)開啟預(yù)訂

NVIDIA通過全新 Omniverse庫、Cosmos物理AI模型及AI計(jì)算基礎(chǔ)設(shè)施,為機(jī)器人領(lǐng)域開啟新篇章

借助NVIDIA技術(shù)加速半導(dǎo)體芯片制造

NVIDIA將為每家AI工廠提供網(wǎng)絡(luò)安全

NVIDIA助力解決量子計(jì)算領(lǐng)域重大挑戰(zhàn)

NVIDIA GTC2025 亮點(diǎn) NVIDIA推出 DGX Spark個人AI計(jì)算機(jī)

NVIDIA 宣布推出 DGX Spark 個人 AI 計(jì)算機(jī)

NVIDIA cuTensorNet為張量網(wǎng)絡(luò)計(jì)算提供方案

NVIDIA cuTensorNet為張量網(wǎng)絡(luò)計(jì)算提供方案

評論