電子發燒友網報道(文/梁浩斌)去年8月,企業家林文欽駕駛開啟“自動駕駛功能”的蔚來ES8發生事故導致身亡,引起了大眾對于車企在“自動駕駛”宣傳上造成誤導的質疑。使得在早期大肆宣傳“自動駕駛”的一些車企,都開始在宣傳用詞上有所收斂,比如小鵬已經將原本官網上描述的“自動輔助駕駛系統”改成“智能輔助駕駛系統”。

當然也有小部分頭鐵的企業依然將“自動駕駛”放在介紹頁最顯眼的地方,是誰在這里就不提了。目前大部分帶有輔助駕駛功能的車型,都是L2級別的系統,但按照普遍認知中達到了“高度自動駕駛”程度的L4級系統,就真的安全嗎?

近日理想汽車CEO李想在微博發表了關于公司智能駕駛研發的成績單,復旦大學計算機科學技術學院副院長、國家 973 計劃項目首席科學家楊珉教授在看到了李想的微博后,回復并質疑了當前智能駕駛系統的安全性。

“說實話,我們安全研究人員覺得自動駕駛安全性沒有想象的那么香,我們最新研發的駕駛系統安全性測試平臺針對某L4級別系統測試后,小伙伴們紛紛倒吸一口零度以下涼氣,表示不要嘗試L2以上功能。”

在楊珉教授給出的例子中,演示了某L4級別無人駕駛汽車必然會發生碰撞的其中一個特定場景。

當車輛在既定車道行駛,前方車輛突然有加塞動作時,車輛并未有減速動作,在此場景下必觸發碰撞。而如果是人類駕駛員遇到這種場景,一般會先在后面減速跟隨一段時間或閃爍大燈提醒前方車輛,確認安全后再通過。

當車輛在既定車道行駛,前方車輛突然有加塞動作時,車輛并未有減速動作,在此場景下必觸發碰撞。而如果是人類駕駛員遇到這種場景,一般會先在后面減速跟隨一段時間或閃爍大燈提醒前方車輛,確認安全后再通過。

雖然按照事故定責案例來看,責任主要在變道車輛上,但對于自動駕駛而言這樣100%發生事故的場景顯然是一個重大安全缺陷。而且這并不是孤例,楊珉教授還透露,測試系統僅在一周內就發現數百個碰撞的案例。難道自動駕駛真的是個偽命題?

智能駕駛系統盲區多

由于真實路況復雜,盡管目前的智能駕駛系統經過多年的發展,有足夠的真實場景用于機器學習訓練,但遇到個別特殊場景依然會出現無法識別的狀況。

比如在2020年7月,一輛特斯拉Model S在美國公路上開啟了Autopilot自動輔助駕駛系統時,無法識別前方白色的警車,在造成追尾的同時還波及到警車前方的一輛救護車。

白色似乎是特斯拉自動輔助駕駛系統的一個盲區。同樣在2020年,中國臺灣嘉義縣的一輛特斯拉Model 3在高速公路上開啟Autopilot自動輔助駕駛系統時,沒有識別到前方因事故側翻在路上的白色貨車,毫無減速地撞上去。而調查結果顯示,當時系統將白色貨車錯誤識別成天空,因此并沒作出減速動作。

白色似乎是特斯拉自動輔助駕駛系統的一個盲區。同樣在2020年,中國臺灣嘉義縣的一輛特斯拉Model 3在高速公路上開啟Autopilot自動輔助駕駛系統時,沒有識別到前方因事故側翻在路上的白色貨車,毫無減速地撞上去。而調查結果顯示,當時系統將白色貨車錯誤識別成天空,因此并沒作出減速動作。

另一方面,因施工或其他情況導致路面劃線不清晰時,系統同樣容易出現誤判。(如上圖)

而上文楊珉教授給出的例子,其實現實中早已經有類似事件發生。此前在深圳南坪,一輛Model 3在開啟Autopilot自動輔助駕駛系統的情況下,由于最右車道被封,在右前方行駛的比亞迪渣土車提早打了轉向燈,并向Model 3所在的車道變線。但Autopilot系統并沒有停下,反而加速跟上前車,最終發生碰撞。

不單是特斯拉,其他品牌的車型都出現過系統識別錯誤的事故。比如去年9月,一輛開啟了NGP(智能導航輔助駕駛)的小鵬P7,在高速公路上追尾了一輛空載的掛車。原因很可能是因為掛車底盤高度太低而出現誤判。

去年1月,在沈海高速上一輛蔚來ES8在開啟NIO Pilot自動輔助駕駛功能的時候,撞上了因輪胎問題在高速公路最內側車道拋錨的五菱宏光。在車主提供的行車記錄視頻中可以看到,當時的天氣狀況不太理想,雨勢較大。

當然,以上事故中,司機分神是其中一個重要原因之一,不過類似事件的頻發,也反映出智能駕駛系統對于特定場景識別的盲區。

可能會有人認為,這些車企的智能駕駛系統級別不高,一些自動駕駛公司的L4級別系統會有更好效果。確實,大多自動駕駛公司從一開始就往著完全自動駕駛的方向去研發,目前一些Robotaxi項目也開始落地,但從實際體驗上來看依然存在一些危險動作。

比如百度Apollo的L4自動駕駛,在某博主體驗的過程中,車輛在通過人行橫道時沒有明顯減速,從普通駕駛員的角度來看,有多次危險動作出現。

盡管現實中可能是小概率事件,但對于汽車而言,無論發生的概率有多少,只要有可能發生,都會直接關系到乘員的生命安全,這也是為何車規級產品要求的缺陷率要達到0PPM(百萬分之0)。

自動駕駛還能不能成?

去年8月,工信部發布了一份關于加強智能網聯汽車生產企業及產品準入管理的意見文件,其中最關鍵的一句話是:明確未經審批,不得通過在線等軟件升級方式新增或更新汽車自動駕駛功能。

而在給汽車推送自動駕駛功能前,“應當確保汽車產品至少滿足系統失效識別與安全響應、人機交互、數據記錄、過程保障和模擬仿真等測試驗證的要求。”這意味著在監管層面上,監管部門已經開始推進車企“自動駕駛”功能安全性方面的審核。

但真的要實現純自動駕駛,可能不是某個車企依靠自己技術能夠做到的。在真實的交通場景中,車輛與車輛之間是互為黑盒子的關系,對于人類駕駛員而言,與其他駕駛員其實一直處于不斷互相判斷、互相試探的過程,在這個過程中的變數,不只是駕駛員對實時路面情況基于經驗的判斷以及反應速度,還有不同駕駛員的心理狀態。

這或許是目前業界對于完全自動駕駛誕生的時間節點并不樂觀的原因之一。因此,V2X一類的技術如今還難以大規模普及的情況下,純自動駕駛依然遙遙無期。

所以,未來要避免因智能駕駛功能而出現的事故,重點還是在于人類駕駛員,從技術的角度來看,DMS(駕駛員監控系統)在未來的智能駕駛功能上將會處于更加重要的地位,通過判定更加敏感的DMS來及時提醒駕駛員,確保駕駛員保持對路面的專注。只是,這跟自動駕駛的初衷似乎又有點相違背了...

而對于目前自動駕駛的小概率缺陷,楊珉教授的這句話也引人深思:“時代的每一片雪花,落在每一個人身上都是一座大山。”

當然也有小部分頭鐵的企業依然將“自動駕駛”放在介紹頁最顯眼的地方,是誰在這里就不提了。目前大部分帶有輔助駕駛功能的車型,都是L2級別的系統,但按照普遍認知中達到了“高度自動駕駛”程度的L4級系統,就真的安全嗎?

近日理想汽車CEO李想在微博發表了關于公司智能駕駛研發的成績單,復旦大學計算機科學技術學院副院長、國家 973 計劃項目首席科學家楊珉教授在看到了李想的微博后,回復并質疑了當前智能駕駛系統的安全性。

圖源:微博

“說實話,我們安全研究人員覺得自動駕駛安全性沒有想象的那么香,我們最新研發的駕駛系統安全性測試平臺針對某L4級別系統測試后,小伙伴們紛紛倒吸一口零度以下涼氣,表示不要嘗試L2以上功能。”

在楊珉教授給出的例子中,演示了某L4級別無人駕駛汽車必然會發生碰撞的其中一個特定場景。

雖然按照事故定責案例來看,責任主要在變道車輛上,但對于自動駕駛而言這樣100%發生事故的場景顯然是一個重大安全缺陷。而且這并不是孤例,楊珉教授還透露,測試系統僅在一周內就發現數百個碰撞的案例。難道自動駕駛真的是個偽命題?

智能駕駛系統盲區多

由于真實路況復雜,盡管目前的智能駕駛系統經過多年的發展,有足夠的真實場景用于機器學習訓練,但遇到個別特殊場景依然會出現無法識別的狀況。

圖源:亞利桑那州公共安全部

比如在2020年7月,一輛特斯拉Model S在美國公路上開啟了Autopilot自動輔助駕駛系統時,無法識別前方白色的警車,在造成追尾的同時還波及到警車前方的一輛救護車。

另一方面,因施工或其他情況導致路面劃線不清晰時,系統同樣容易出現誤判。(如上圖)

而上文楊珉教授給出的例子,其實現實中早已經有類似事件發生。此前在深圳南坪,一輛Model 3在開啟Autopilot自動輔助駕駛系統的情況下,由于最右車道被封,在右前方行駛的比亞迪渣土車提早打了轉向燈,并向Model 3所在的車道變線。但Autopilot系統并沒有停下,反而加速跟上前車,最終發生碰撞。

不單是特斯拉,其他品牌的車型都出現過系統識別錯誤的事故。比如去年9月,一輛開啟了NGP(智能導航輔助駕駛)的小鵬P7,在高速公路上追尾了一輛空載的掛車。原因很可能是因為掛車底盤高度太低而出現誤判。

去年1月,在沈海高速上一輛蔚來ES8在開啟NIO Pilot自動輔助駕駛功能的時候,撞上了因輪胎問題在高速公路最內側車道拋錨的五菱宏光。在車主提供的行車記錄視頻中可以看到,當時的天氣狀況不太理想,雨勢較大。

當然,以上事故中,司機分神是其中一個重要原因之一,不過類似事件的頻發,也反映出智能駕駛系統對于特定場景識別的盲區。

可能會有人認為,這些車企的智能駕駛系統級別不高,一些自動駕駛公司的L4級別系統會有更好效果。確實,大多自動駕駛公司從一開始就往著完全自動駕駛的方向去研發,目前一些Robotaxi項目也開始落地,但從實際體驗上來看依然存在一些危險動作。

比如百度Apollo的L4自動駕駛,在某博主體驗的過程中,車輛在通過人行橫道時沒有明顯減速,從普通駕駛員的角度來看,有多次危險動作出現。

盡管現實中可能是小概率事件,但對于汽車而言,無論發生的概率有多少,只要有可能發生,都會直接關系到乘員的生命安全,這也是為何車規級產品要求的缺陷率要達到0PPM(百萬分之0)。

自動駕駛還能不能成?

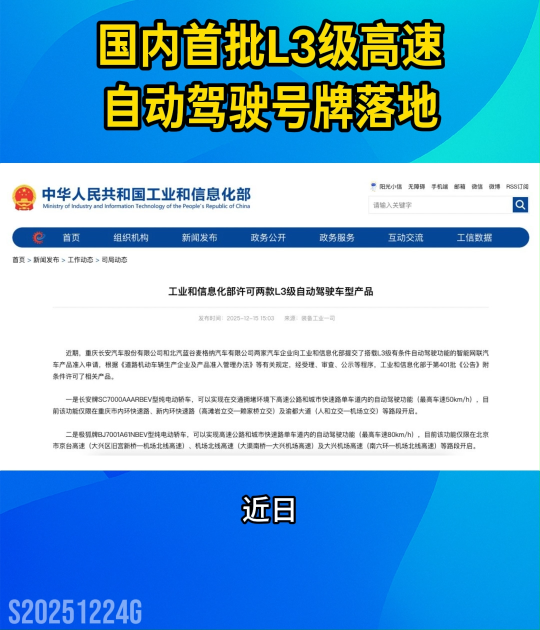

圖源:工信部

去年8月,工信部發布了一份關于加強智能網聯汽車生產企業及產品準入管理的意見文件,其中最關鍵的一句話是:明確未經審批,不得通過在線等軟件升級方式新增或更新汽車自動駕駛功能。

而在給汽車推送自動駕駛功能前,“應當確保汽車產品至少滿足系統失效識別與安全響應、人機交互、數據記錄、過程保障和模擬仿真等測試驗證的要求。”這意味著在監管層面上,監管部門已經開始推進車企“自動駕駛”功能安全性方面的審核。

但真的要實現純自動駕駛,可能不是某個車企依靠自己技術能夠做到的。在真實的交通場景中,車輛與車輛之間是互為黑盒子的關系,對于人類駕駛員而言,與其他駕駛員其實一直處于不斷互相判斷、互相試探的過程,在這個過程中的變數,不只是駕駛員對實時路面情況基于經驗的判斷以及反應速度,還有不同駕駛員的心理狀態。

這或許是目前業界對于完全自動駕駛誕生的時間節點并不樂觀的原因之一。因此,V2X一類的技術如今還難以大規模普及的情況下,純自動駕駛依然遙遙無期。

所以,未來要避免因智能駕駛功能而出現的事故,重點還是在于人類駕駛員,從技術的角度來看,DMS(駕駛員監控系統)在未來的智能駕駛功能上將會處于更加重要的地位,通過判定更加敏感的DMS來及時提醒駕駛員,確保駕駛員保持對路面的專注。只是,這跟自動駕駛的初衷似乎又有點相違背了...

而對于目前自動駕駛的小概率缺陷,楊珉教授的這句話也引人深思:“時代的每一片雪花,落在每一個人身上都是一座大山。”

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

汽車安全

+關注

關注

4文章

346瀏覽量

35459 -

自動駕駛

+關注

關注

793文章

14888瀏覽量

179992

發布評論請先 登錄

相關推薦

熱點推薦

L3級自動駕駛在技術上有什么不一樣的要求?

[首發于智駕最前沿微信公眾號]最近,很多小伙伴在后臺私信,想了解L3級自動駕駛有哪些技術要求。其實對于自動駕駛行業來說,L3級是一個非常重要的分水嶺。一旦達到

思必馳首席科學家俞凱教授當選2026年度IEEE Fellow

日前,全球最大的專業技術組織國際電氣電子工程師協會(The Institute of Electrical and Electronics Engineers, IEEE)公布了2026年度IEEE Fellow(會士)名單,上海交通大學特聘教授、思必馳聯合創始人、首席科學家

中興通訊崔麗受邀出席2025騰沖科學家論壇

近日,“2025騰沖科學家論壇”在云南啟幕。本屆論壇以“科學·AI改變世界”為主題,匯聚包括諾貝爾獎、圖靈獎、菲爾茲獎得主在內的國際頂尖科學家,以及百余位兩院院士、高校校長、科技精英與產業領袖,共話

NVIDIA與Uber合作推進全球L4級自動駕駛移動出行網絡

NVIDIA 宣布與 Uber 達成合作,將共同擴展全球 L4 級自動駕駛移動出行網絡。合作將依托 Uber 新一代無人駕駛出租車和自動配送車隊,采用全新 NVIDIA DRIVE A

不同等級的自動駕駛技術要求上有何不同?

談到自動駕駛,不可避免地會涉及到自動駕駛分級,美國汽車工程師學會(SAE)根據自動駕駛系統與人類駕駛員參與駕駛行為程度的不同,將

國際類腦計算科學家Yulia Sandamirskaya教授加盟時識科技

近日,國際類腦計算與神經形態機器人領域知名科學家Yulia Sandamirskaya 教授,作為科學家顧問正式加入時識科技(SynSense)。

自動駕駛事故如何判定?誰應負主要責任?

個問題,那就是如果在使用組合輔助駕駛階段出現事故,這個事故應該如何判定?責任應該由誰來承擔? 從智駕等級分類看責任判定 根據美國汽車工程師協會的分類,將自動駕駛分為了L0到L5共6個分

自動駕駛安全基石:ODD

電子發燒友網綜合報道 自動駕駛ODD(Operational Design Domain)即設計運行域,是指自動駕駛系統被設計為安全、有效運行的具體條件范圍。它定義了自動駕駛汽車在哪些

新能源車軟件單元測試深度解析:自動駕駛系統視角

μs會導致車輛軌跡偏移0.1米(在高速場景下可能引發碰撞)。

?安全與合規的剛性需求?

自動駕駛系統需同時滿足ISO 26262(功能安全)和ISO 21448(預期功能安全,SOTIF

發表于 05-12 15:59

自動駕駛安全程度達到99%是否就足夠了?

可以保留最后1%的不確定性? 其實在自動駕駛技術走向規模化商用的進程中,安全始終被視為最核心的命題。從過去的輔助駕駛,到現在的L2級別的組合輔助駕駛

自動駕駛如何設置合理的接管機制?

隨著高階智駕技術的發展,高速NOA、城市NOA等智駕功能越發平權,消費者也可以享受到技術帶來的便利。現階段的高階智駕僅是達到L2級自動駕駛,在使用時一定需要駕駛員監測路況,遇到無法預料

廣汽集團L3自動駕駛乘用車率先上市

隨著人工智能技術快速發展,L2高階智駕領域已經掀起了“智駕平權”革命。而更高階的L3級自動駕駛也將迎來歷史性拐點。誰能率先布局,實現L3自動駕駛

產業鏈起飛!L3級自動駕駛年內有望落地

近期聯合保險機構推出定制化智駕保險產品。 ? 長安汽車宣布計劃2026年實現全場景L3級自動駕駛,2028年進一步實現全場景L4級功能。 ? 嵐圖汽車CEO盧放在與華為智能汽車解決方案

發表于 03-13 00:22

?1834次閱讀

自動駕駛被曝嚴重缺陷!國家973首席科學家呼吁:不要嘗試 L2以上功能

自動駕駛被曝嚴重缺陷!國家973首席科學家呼吁:不要嘗試 L2以上功能

評論